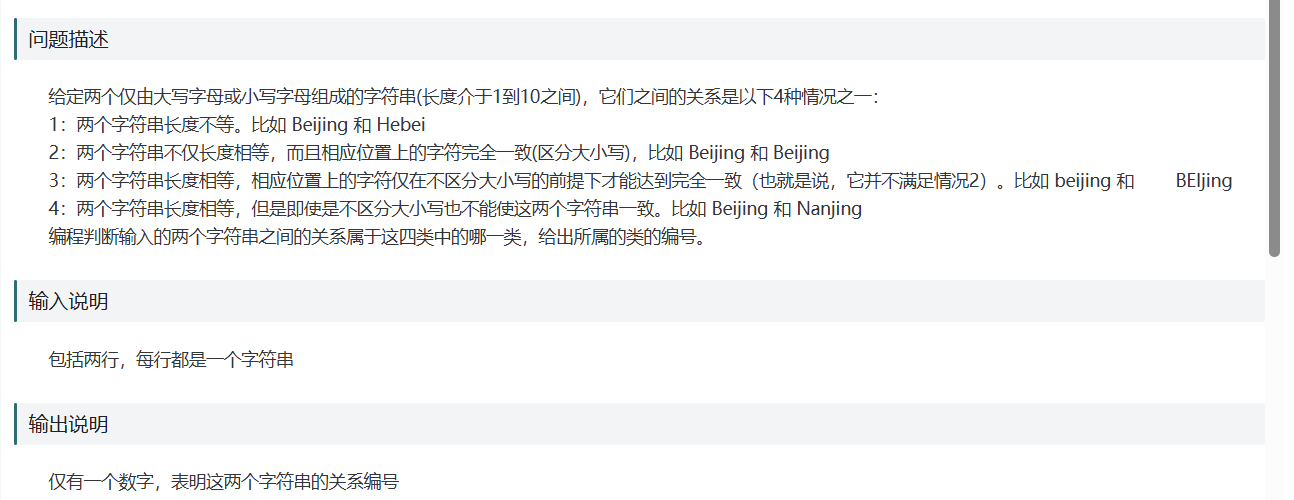

第一题

个人总结:首先比较两个字符串长度,不等则直接输出1;长度相等时,逐个字符比较是否完全一致(区分大小写),完全一致则输出2;若不满足情况2,则转换为相同大小写后比较,若一致则输出3;以上条件都不满足,输出4。

代码如下:

#include <stdio.h>

#include <string.h>

#include <ctype.h>

int main() {

char str1[11], str2[11];

int len1, len2;

int i;

scanf("%s", str1);

scanf("%s", str2);

len1 = strlen(str1);

len2 = strlen(str2);

if (len1 != len2) {

printf("1\n");

return 0;

}

if (strcmp(str1, str2) == 0) {

printf("2\n");

return 0;

}

int caseInsensitiveMatch = 1;

for (i = 0; i < len1; i++) {

if (tolower(str1[i]) != tolower(str2[i])) {

caseInsensitiveMatch = 0;

break;

}

}

if (caseInsensitiveMatch) {

printf("3\n");

} else {

printf("4\n");

}

return 0;

}翻译

Transformer模型是一种基于注意机制的神经网络体系结构,在自然语言处理领域取得了巨大的成功。与传统的递归神经网络不同,Transformers不依赖于循序渐进的序列处理。相反,他们使用自我注意机制来同时处理整个序列。这种架构不仅提高了模型执行并行计算的能力,还使其能够更有效地捕获远距离依赖关系。在机器翻译任务中,Transformer模型可以根据句子中不同单词之间的关系动态分配注意力权重,从而产生更准确的翻译。此外,Transformer体系结构已被广泛应用于文本生成、语音识别甚至图像处理等任务。近年来,大多数大规模的预训练语言模型都是建立在Transformer体系结构之上的,这大大加快了人工智能技术的发展。

单词打卡