在 AI 应用走向规模化之后,"能不能便宜、快不快、吞吐够不够"逐渐成为关键指标。为此,OpenAI 于 2026 年 3 月 17 日发布了 GPT-5.4 nano------迄今最小、最经济的 AI 模型之一。它并不是为复杂推理或泛化对话而生,而是专为 超低延迟与极致成本敏感的场景打造,定位为"AI 智能体的神经末梢"。

简单理解:nano 负责快速、精准地执行基础流水线任务。它不追求宏大推演,而擅长在高并发环境中把事情办完,尤其适合文本分类、数据提取与子代理(Subagent)任务等高频工作。

一、核心定位:轻如尘埃,快如闪电

GPT-5.4 nano 的设计思路是走"专用化"路线。通过深度知识蒸馏与架构压缩技术,它被打造成轻量引擎,在性能、速度与成本之间实现更优平衡。

在大规模系统里,nano 往往承担"前置处理"的角色:

-

高频接收请求

-

快速完成判断/抽取/过滤

-

将更复杂的部分交给更强的模型或后续代理处理

因此,它更像智能体协作体系中的前哨兵/微型传感器节点:它不思考太多,但执行效率极高,是智能体生态里不可或缺的细节组件。

二、典型应用场景:把简单任务跑到极致

GPT-5.4 nano 适用于那些"规则清晰、复杂度低、调用量巨大的工作"。常见场景包括:

-

实时文本分类与情感分析

例如:用户评论自动打标、内容分流与风险分级。

-

结构化数据提取

例如:从发票、合同、表格中识别并抽取关键字段。

-

内容排序与过滤(推荐系统初筛)

例如:先做粗排、筛掉不相关内容,再交给大模型或更复杂系统二次处理。

-

子智能体(Subagent)中的辅助任务单元

例如:在多层 Agent 架构中承担"清洗、路由、初步信息抓取"等工作。

三、性能表现:小模型,大吞吐

尽管参数规模极小,GPT-5.4 nano 在轻量任务上依然表现出强大的并发能力与稳定性,特别适合被部署到 API 调用链路的"高频层"。

从关键指标看,它优势非常集中:

-

响应延迟:毫秒级反馈,适合实时流水线

-

吞吐能力:单服务器可并发处理数千请求

-

成本效率:极低的输入/输出单价,适合大规模部署

-

任务适配性:在轻量编码测试(如 SWE-Bench Lite)中也具备稳健表现,适合子任务层面的简单代码处理

另外,与 GPT-5.4 mini 相比,nano 的单位成本更低:

-

输入成本约为 26.7%(0.20 vs 0.75)

-

输出成本约为 27.8%(1.25 vs 4.50)

这使得 nano 成为"需要规模化跑流水线"的理想选择。

四、核心能力与技术特性

-

极致低成本

作为 GPT-5.4 系列中最小、成本最低的版本之一,它专为速度与成本优先的任务而设计。

-

高并发与低延迟

针对 API 调用链路进行了优化,适合集成到微服务架构,支撑金融监控、广告过滤、客服语义路由等场景。

-

智能体协同角色明确

在多层 Agent 架构中,它常被用作"前哨"------负责初步信息抓取、数据清洗与任务分发。

-

仅通过 API 接入

目前主要通过 OpenAI API 提供服务,并未面向 ChatGPT 或 Codex 等界面,面向开发者与企业用户更直接。

五、使用建议:把 nano 用在"正确的位置"

为了发挥 nano 的优势,建议这样使用:

-

作为大模型的预处理模块(或降级备用)

让它先做分类、抽取、过滤,把工作量削到更轻,再交给强模型做深加工。

-

在边缘计算(Edge AI)场景部署

利用低延迟优势兼顾隐私与成本控制。

-

构建低成本子代理流水线(Subagent pipeline)

让 nano 负责高频、轻量任务,而复杂推理交由更强的模型或后续代理完成。

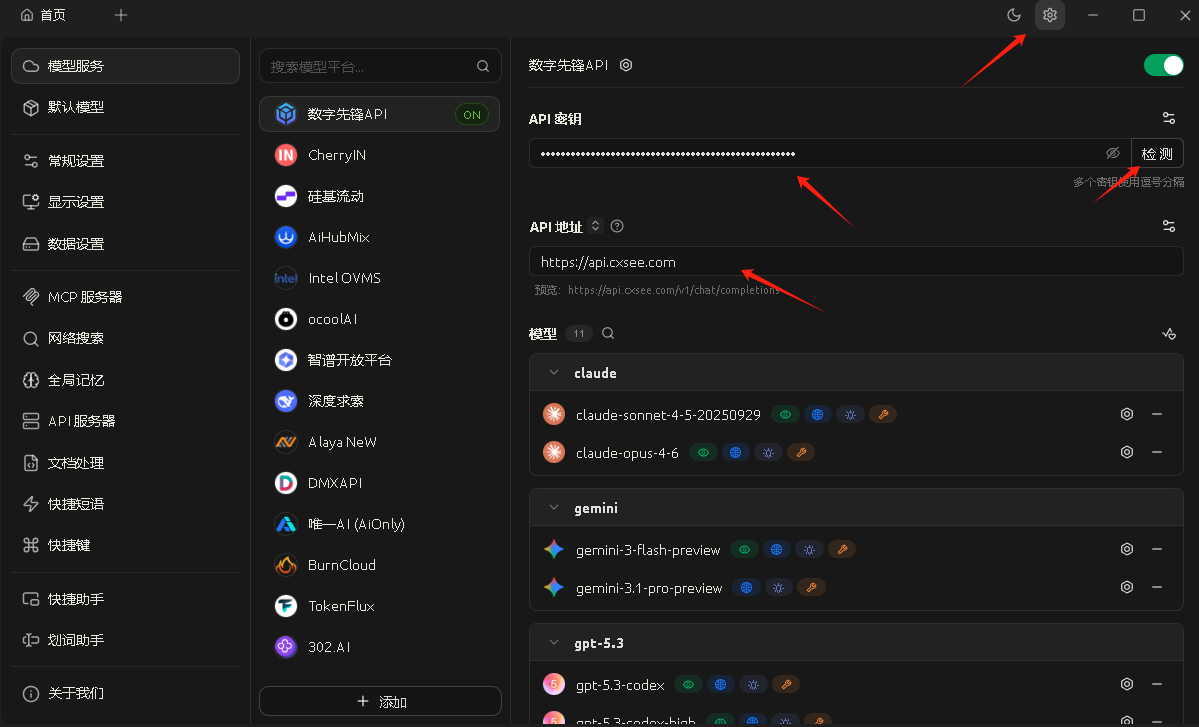

数字先锋API平台体验了下速度真是不一样,以下内容秒出

大家最关心的是如何使用接入使用该模型

标准请求路径 /v1/chat/completions

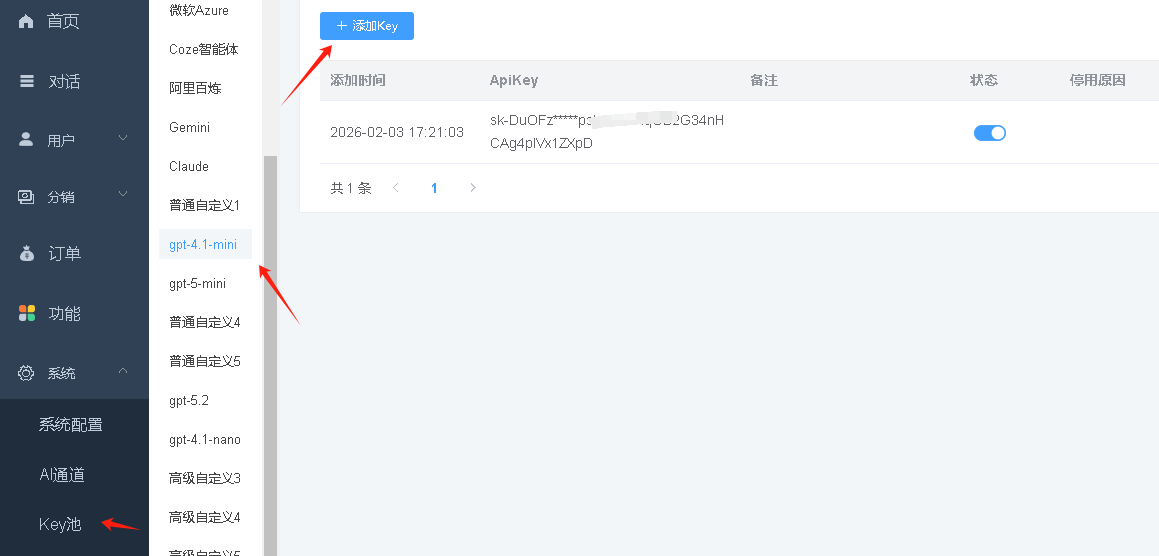

数字先锋API大模型聚合平台https://api.cxsee.com 注册账号有免费额度体验

新建一个令牌即可对接各类AI工具使用

流式回复请求示例(stream=true)

bash

curl -N -X POST "https://cxsee.cxsee.com/v1/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_API_KEY" \

-d '{

"model": "gpt-5.4-nano",

"messages": [

{

"role": "user",

"content": "请用3句话介绍一下人工智能的发展"

}

],

"temperature": 0.7,

"stream": true

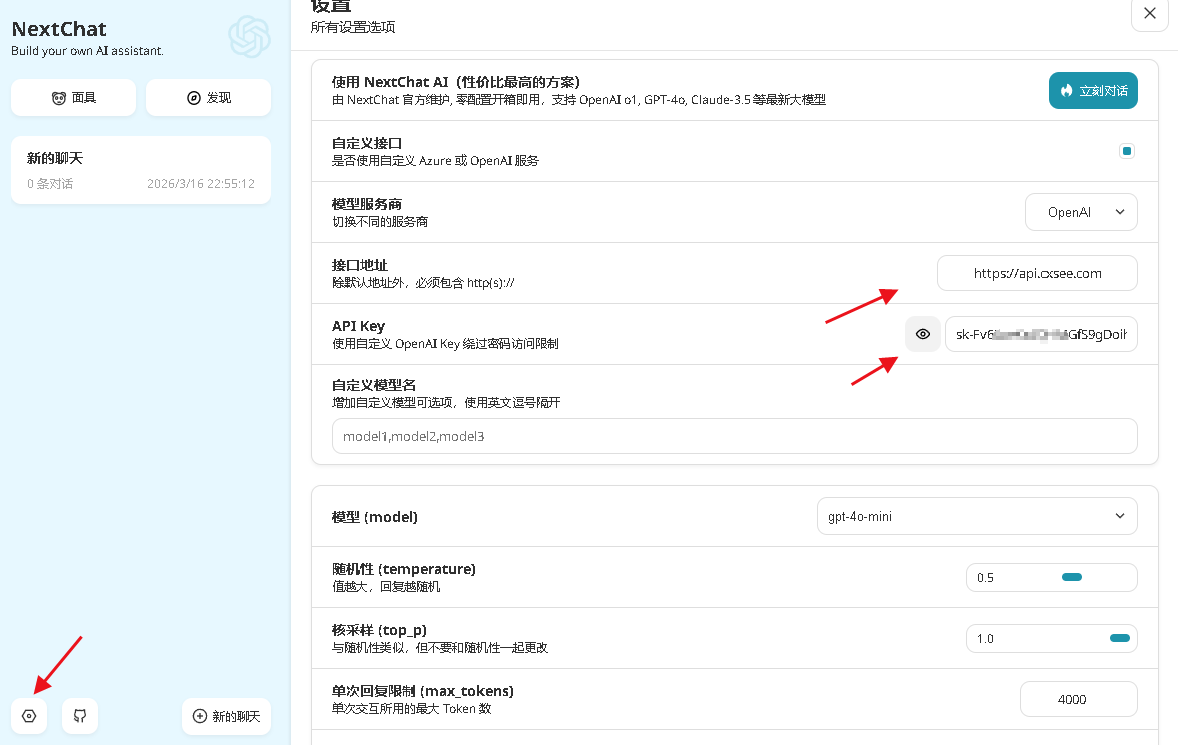

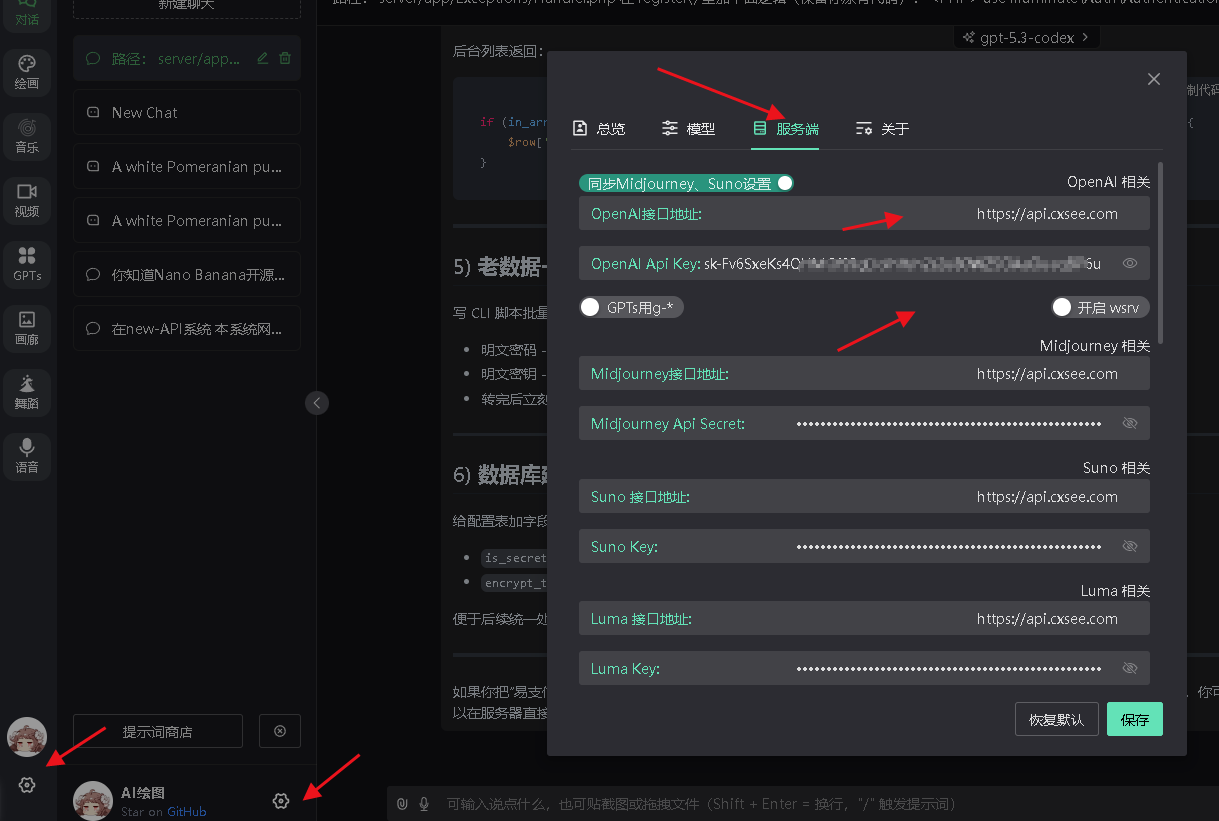

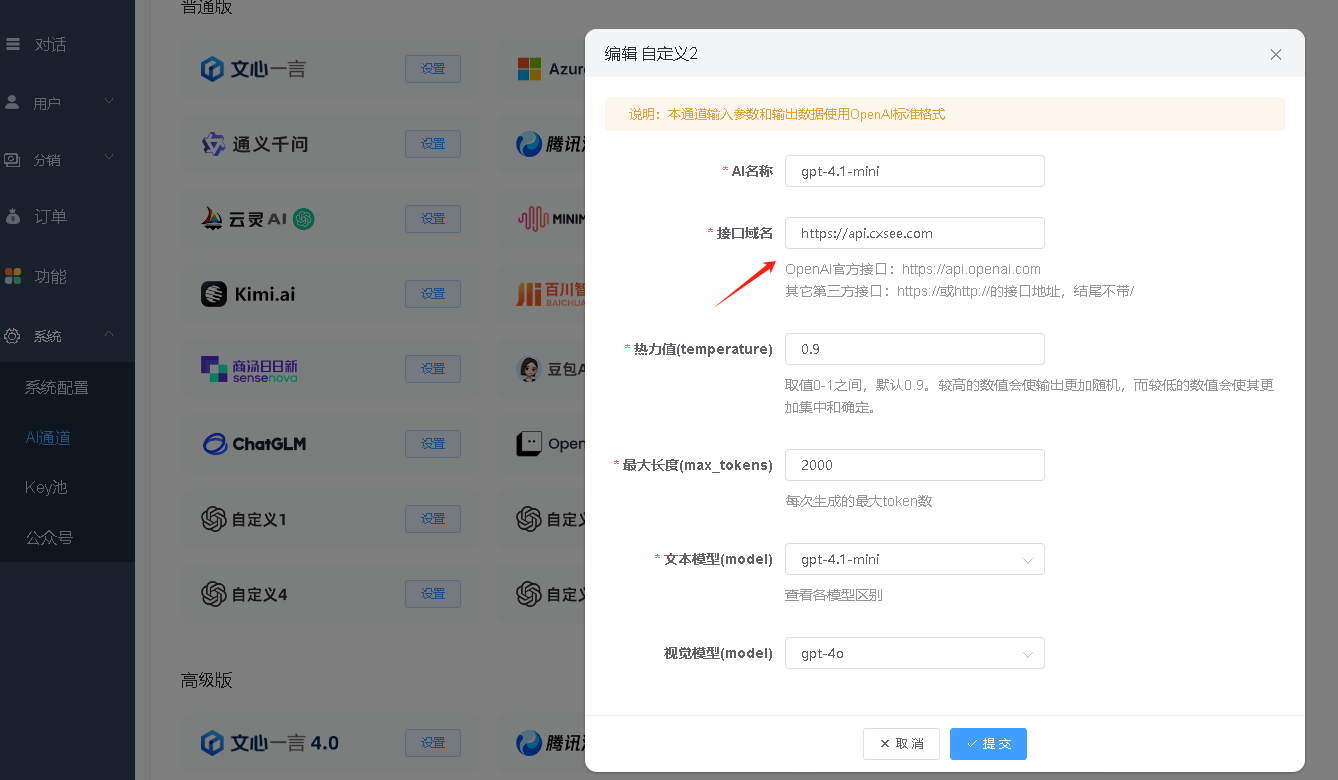

}'各类软件使用时也非常简单设置下Base URL 和 API Key即可使用

软件使用时接口及令牌示例