目录

1.程序功能描述

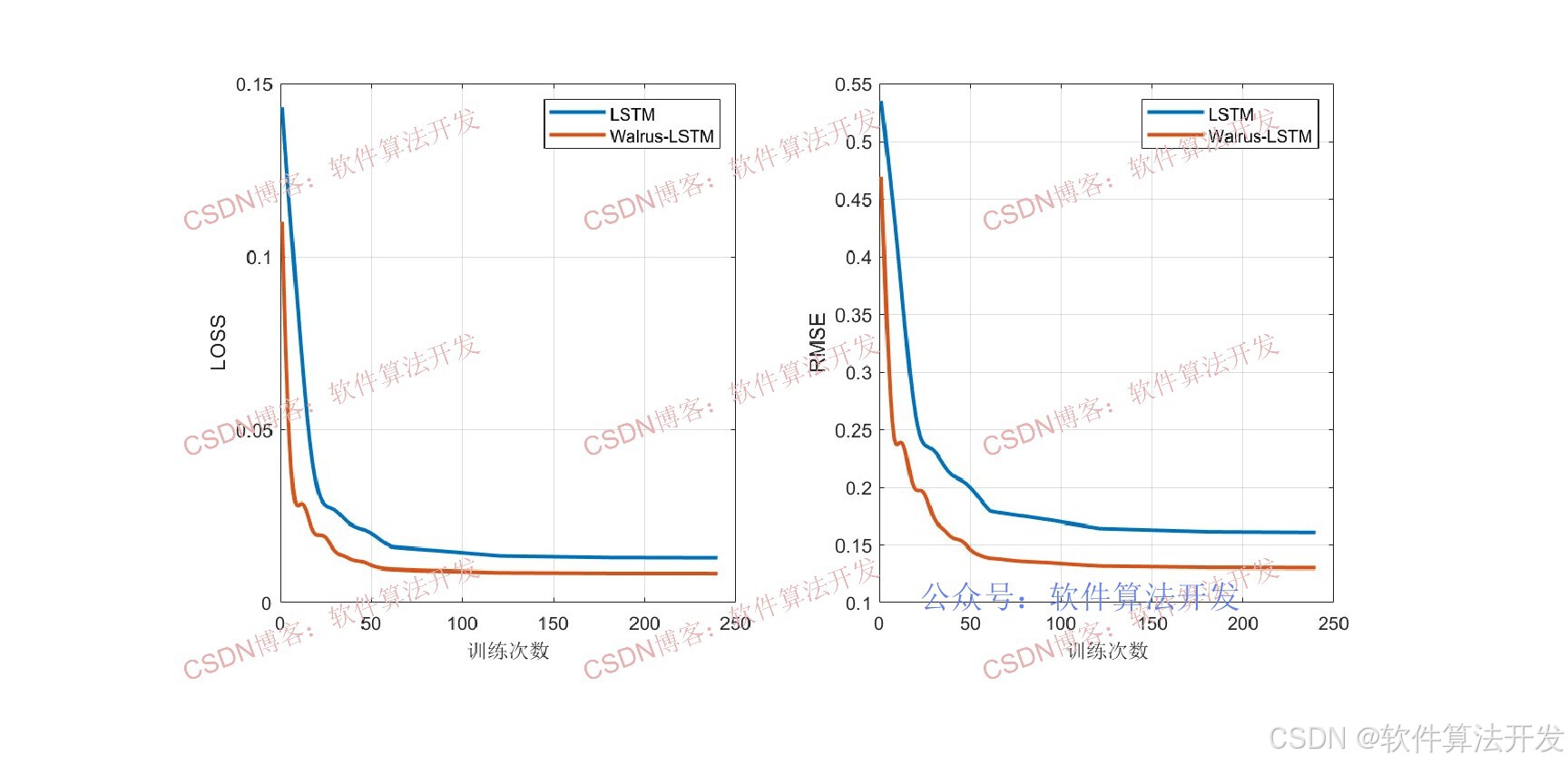

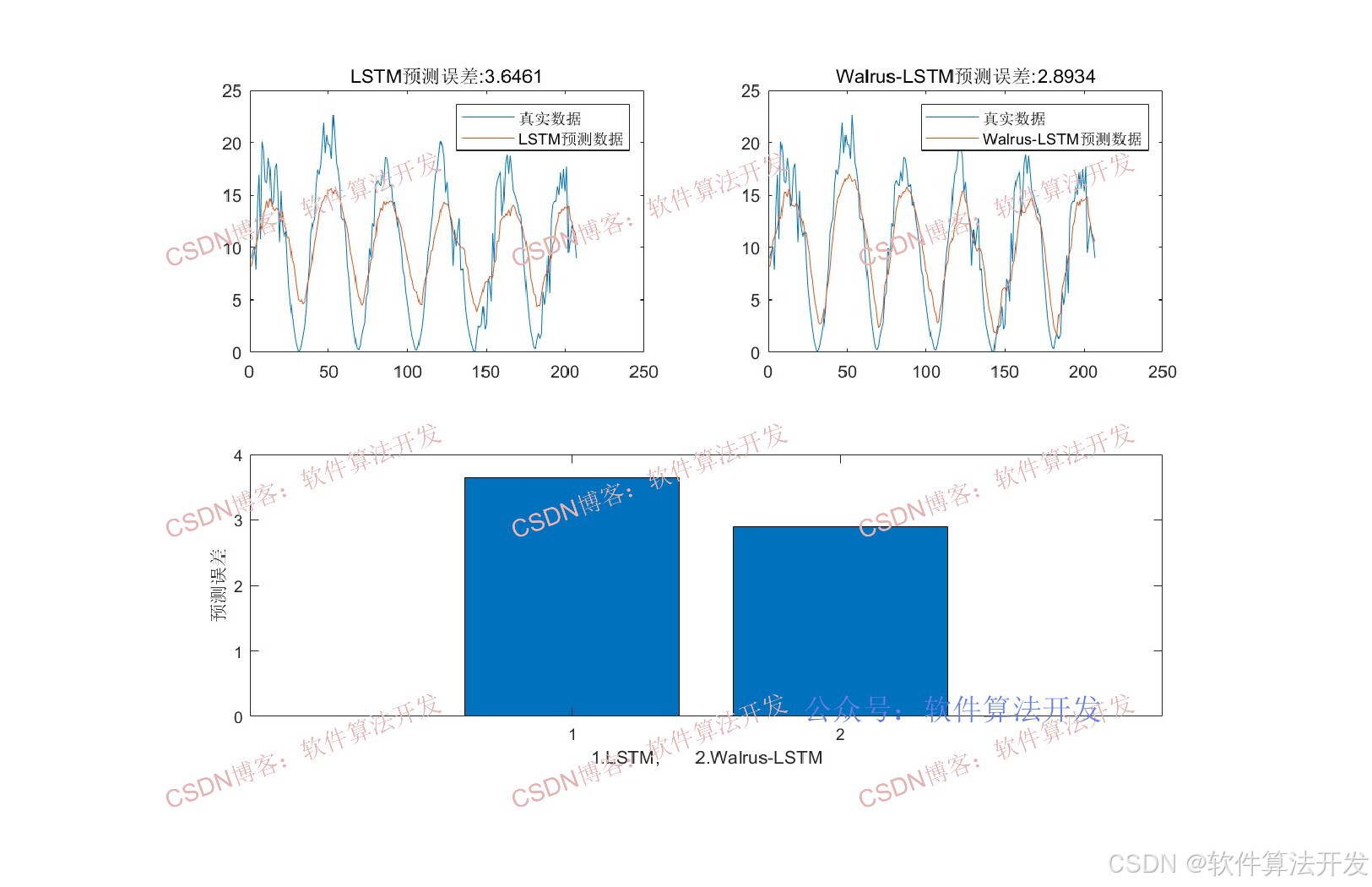

WOA-LSTM是将海象优化算法(Walrus Optimization Algorithm, WOA) 与长短期记忆网络结合的时间序列预测模型。其核心逻辑是:利用 WOA 的全局寻优能力,自适应优化 LSTM的关键超参数(本代码中为LSTM隐藏层神经元数量),解决LSTM超参数凭经验设置导致的预测精度不足问题;再用优化后的LSTM网络学习时间序列的时序依赖特征,实现一维时间序列的精准预测。

2.测试软件版本以及运行结果展示

MATLAB2024B版本运行

3.部分程序

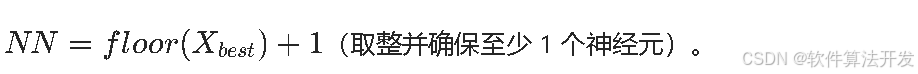

% 加1是为了确保至少有1个神经元

NN=floor(Top_predator_pos)+1

% 定义LSTM神经网络结构

layers = [ ...

sequenceInputLayer(indim) % 序列输入层,输入维度为indim

lstmLayer(NN) % LSTM层,神经元数量为优化得到的NN

reluLayer % ReLU激活函数层,增加非线性能力

fullyConnectedLayer(outdim) % 全连接层,输出维度为outdim

regressionLayer]; % 回归层,用于回归任务(输出连续值)

% 设置网络训练参数

options = trainingOptions('adam', ... % 使用Adam优化器,适合深度学习训练

'MaxEpochs', 240, ... % 最大训练轮数为240

'GradientThreshold', 1, ... % 梯度阈值为1,防止梯度爆炸

'InitialLearnRate', 0.004, ... % 初始学习率为0.004

'LearnRateSchedule', 'piecewise', ...% 学习率调度方式为分段衰减

'LearnRateDropPeriod', 60, ... % 每60轮衰减一次学习率

'LearnRateDropFactor',0.2, ... % 学习率衰减因子为0.2(变为原来的20%)

'L2Regularization', 0.01, ... % L2正则化系数为0.01,防止过拟合

'ExecutionEnvironment', 'cpu',... % 使用GPU加速训练(需配置GPU支持)

'Verbose', 0, ... % 不显示训练过程细节

'Plots', 'none'); % 显示训练进度图表(损失变化等)

% 训练LSTM网络

[net,INFO] = trainNetwork(Pxtrain, Txtrain, layers, options);

% 使用训练好的网络进行预测

Dat_yc1 = predict(net, Pxtrain); % 对训练数据进行预测(归一化尺度)

Dat_yc2 = predict(net, Pxtest); % 对测试数据进行预测(归一化尺度)

% 将预测结果反归一化,恢复到原始数据范围

Datn_yc1 = mapminmax('reverse', Dat_yc1, Norm_O);

Datn_yc2 = mapminmax('reverse', Dat_yc2, Norm_O);

% 将细胞数组转换为矩阵(方便后续处理和分析)

Datn_yc1 = cell2mat(Datn_yc1);

Datn_yc2 = cell2mat(Datn_yc2);

2494.算法理论概述

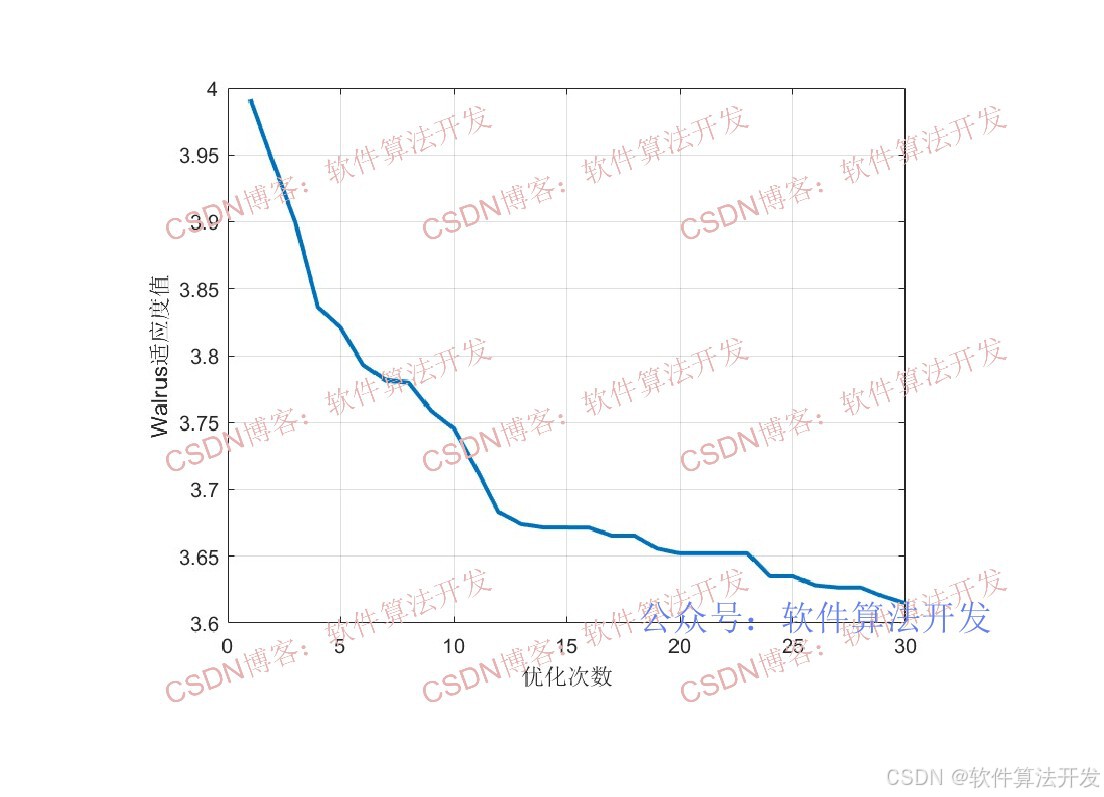

WOA模拟北极海象的三大生存行为(觅食、迁徙、避敌),通过种群迭代搜索最优解,分为探索阶段(全局搜索)和开发阶段(局部细化):

**觅食行为:**模拟海象向最优个体聚集的过程,实现全局探索;

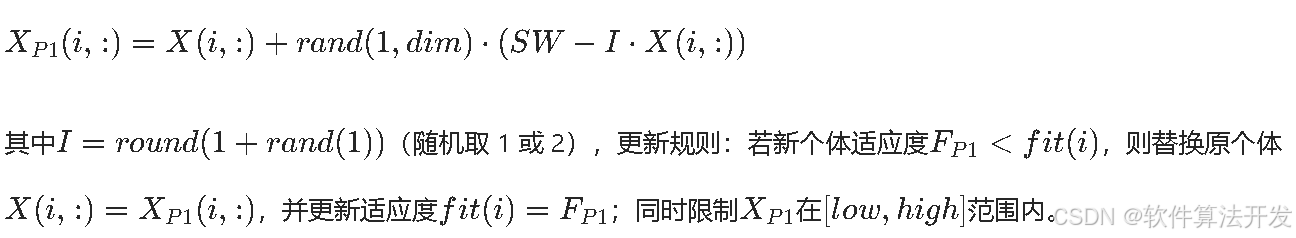

模拟海象向最优个体(最强海象SW)聚集,扩大搜索范围,公式:

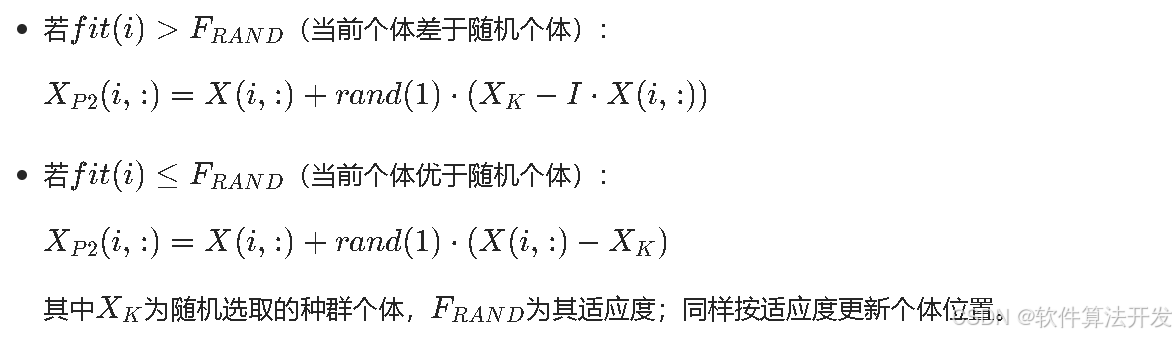

**迁徙行为:**模拟海象群体间的位置交互,平衡搜索广度与深度;

模拟海象与随机个体XK的位置交互,公式:

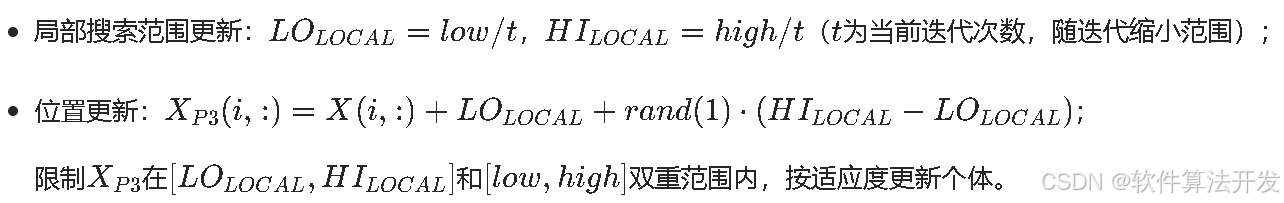

**避敌行为:**模拟海象躲避捕食者的局部扰动,实现局部开发。

模拟海象躲避捕食者的局部扰动,细化最优解附近的搜索,公式:

**确定最优超参数:**迭代结束后,选取适应度最小的个体Xbest作为最优解,转换为 LSTM 隐藏层神经元数量:

**LSTM网络构建与训练:**用优化后的神经元数量构建LSTM模型,训练并预测。

5.完整程序

VVV

关注后手机上输入程序码:141