前言

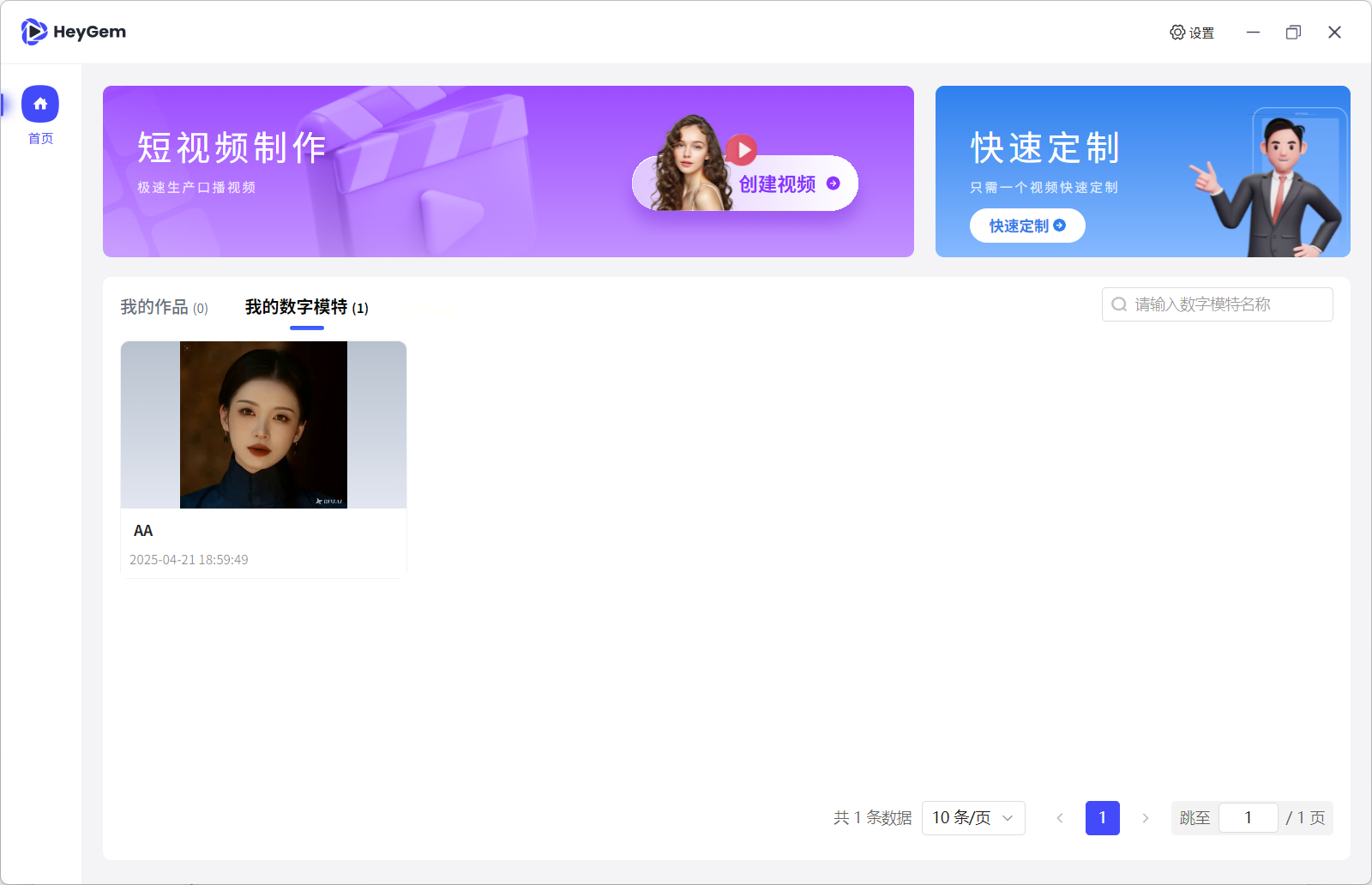

Heygem 是一个用于本地运行 AI 数字人模型的开源项目,主要通过 Docker 进行服务部署,支持离线运行,适合在本地环境中进行语音交互、数字人驱动等实验或开发。

特点

- 支持本地运行(部署完成后可断网使用)

- 提供基础 API 接口,便于二次开发

- 依赖 Docker 进行服务管理

- 支持 Windows / Linux,不支持 Mac

注:涉及商业使用需关注项目协议

部署说明

一、环境要求

- Windows 10 19042 及以上

- 建议:

- 内存 ≥ 32GB

- NVIDIA 显卡(30/40 系列)

- 磁盘:

- C 盘建议 ≥ 100GB

- D 盘建议 ≥ 30GB

二、安装流程

请参考:

点击跳转