在 NVIDIA GTC 2026 期间,黄仁勋对 OpenClaw 的高度评价为其热度又添了一把柴------OpenClaw 现在是人类历史上最大、最受欢迎、最成功的开源项目,这绝对是下一个 ChatGPT。 他认为,每家公司都需要制定自己的 OpenClaw 战略,其未来的重要性将与 Linux、Kubernetes、HTML 等基础软件设施相提并论。

可以说,OpenClaw 不再满足于让大模型「生成内容」,而是试图让模型真正参与执行,从调用 API 到串联工作流,把「AI 能力」转化为「可落地的行动」。

过去一段时间,越来越多开发者开始尝试部署 OpenClaw,但热度的另一面也很现实:环境配置复杂、依赖繁琐、运行资源受限、skills 调用链路不清晰......这些问题让不少人停在了「跑通 demo」。但值得注意的是,skills 与真实业务场景的结合才是 OpenClaw 发挥价值的关键所在。例如,在团队协作场景中:

-

通过接入飞书 skills,实现消息自动处理、任务同步、机器人响应。

-

在 Discord 社区中,构建具备上下文理解和自动执行能力的 AI Bot。

-

将 API 调用、通知、数据处理串联成完整的自动化链路。

为了便于开发者体验 OpenClaw 在实际应用场景中的能力,OpenBayes 上线了「OpenClaw:使用 CPU 调用 API 运行」与「OpenClaw 的 GPU 运行教程」, 将 OpenClaw 集成到各种社交应用中,实现丰富的自动化任务。包含:

-

Lark(飞书)集成:涵盖自建应用创建、事件订阅配置以及流式响应。

-

Discord 集成:包括 Bot 权限设置、Slash Command 定义,以及通过 Long Polling 或 WebSockets 实现消息处理。

同时,OpenBayes 还上线了「基于 OpenClaw 实现资讯自动抓取定时任务」的在线教程,完成了环境配置,降低 skill 部署门槛。

OpenClaw:使用 CPU 调用 API 运行

OpenClaw 的 GPU 运行教程

基于 OpenClaw 实现资讯自动抓取定时任务

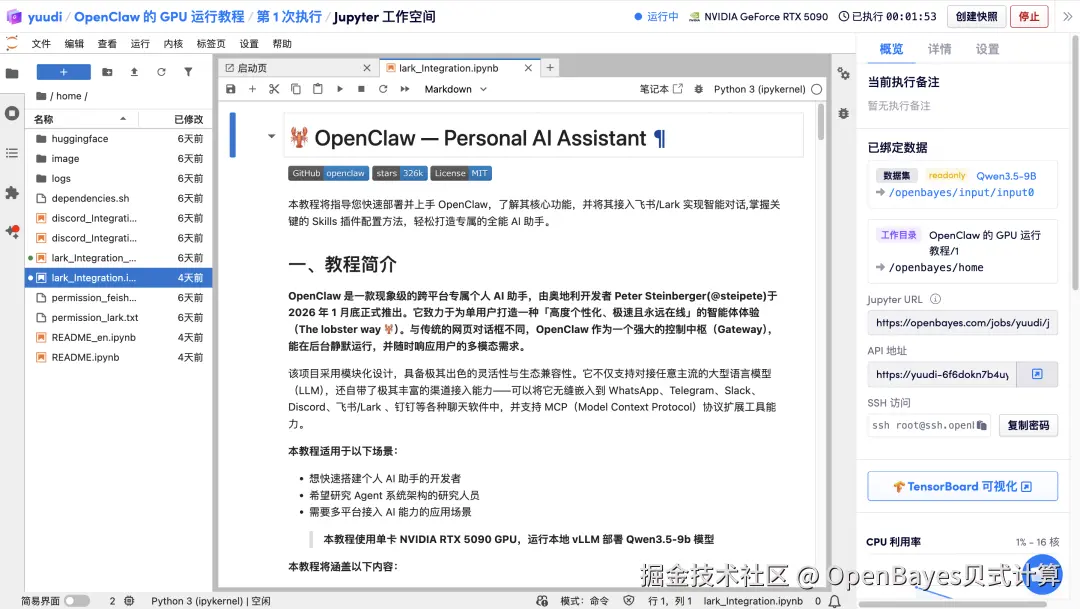

本教程以「OpenClaw 的 GPU 运行教程」为例,详细介绍如何在 OpenBayes 平台部署 OpenClaw,并接入飞书。

OpenClaw 接入飞书效果展示

Demo 运行

01

Demo 运行阶段

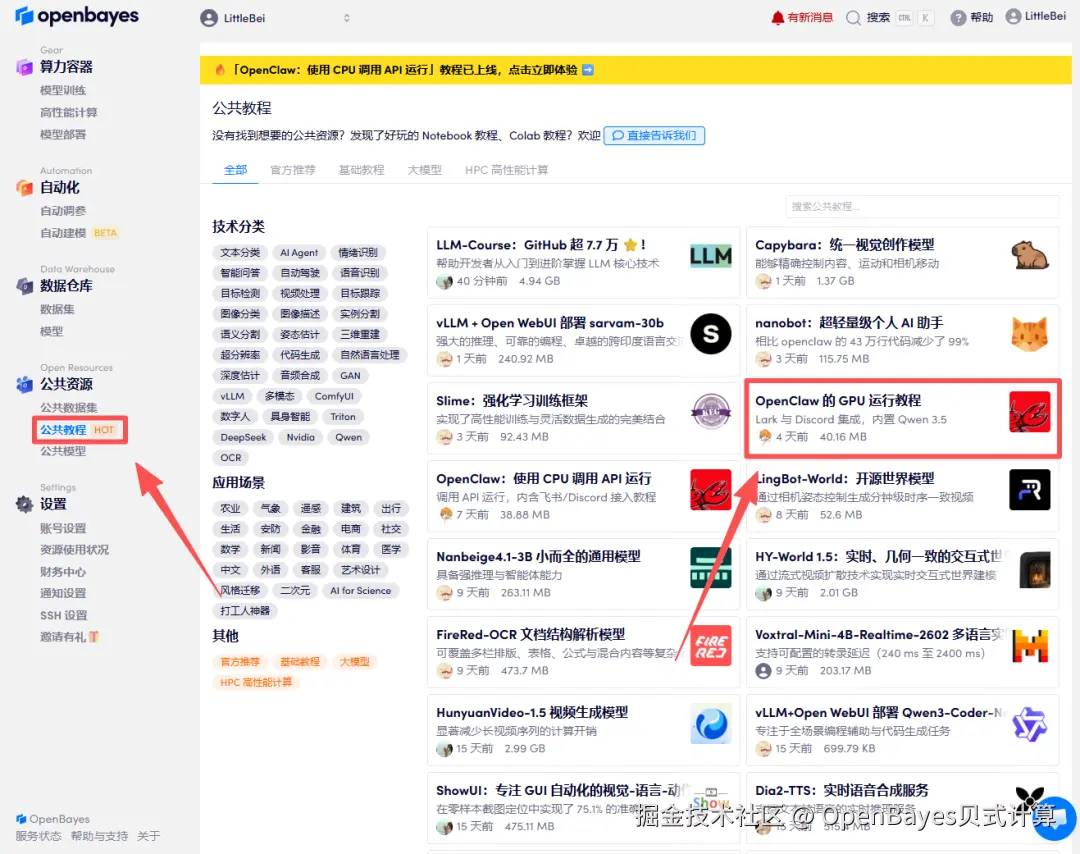

1.登录 OpenBayes.com,在「公共教程」页面,选择「OpenClaw 的 GPU 运行教程」教程。

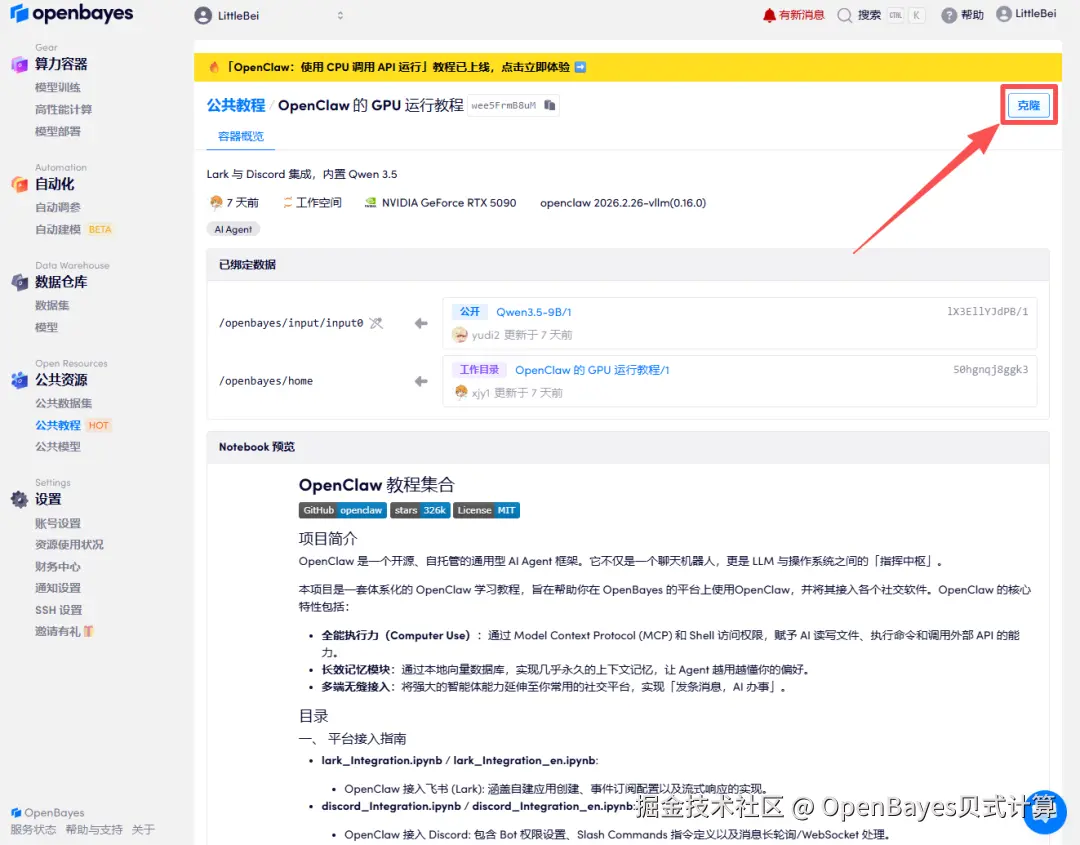

2.页面跳转后,点击右上角「克隆」,将该教程克隆至自己的容器中。

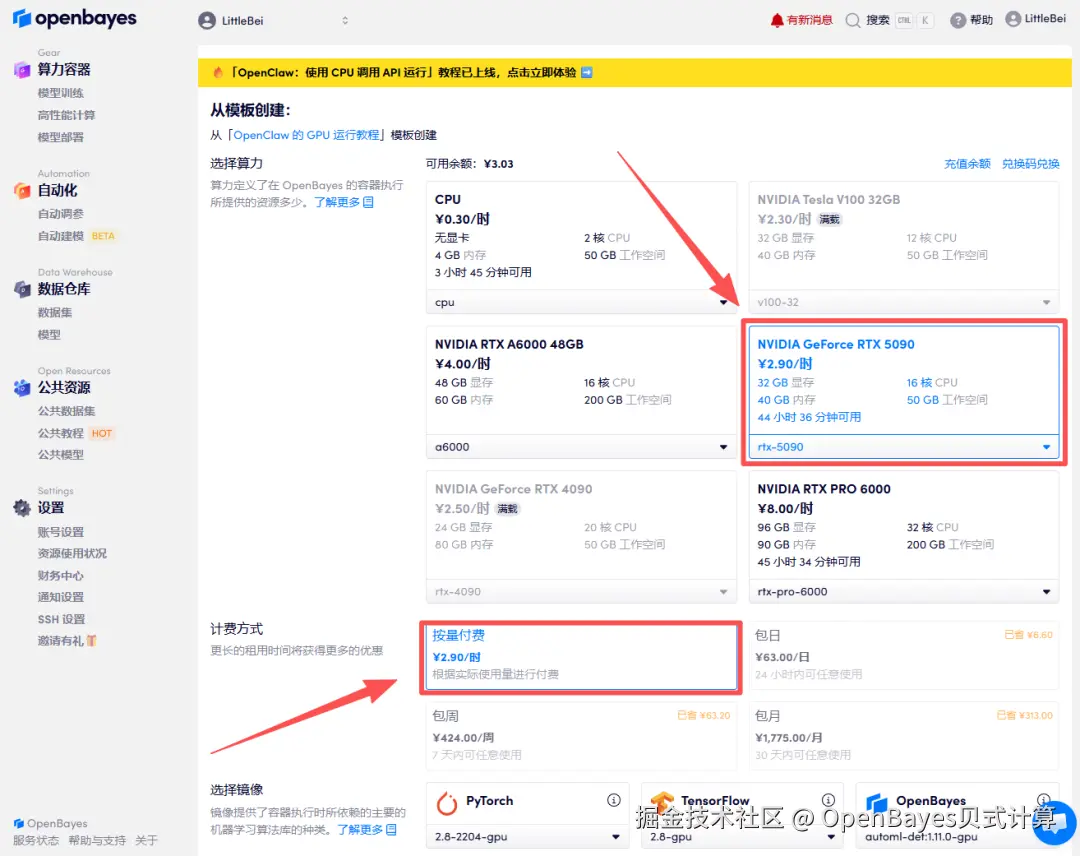

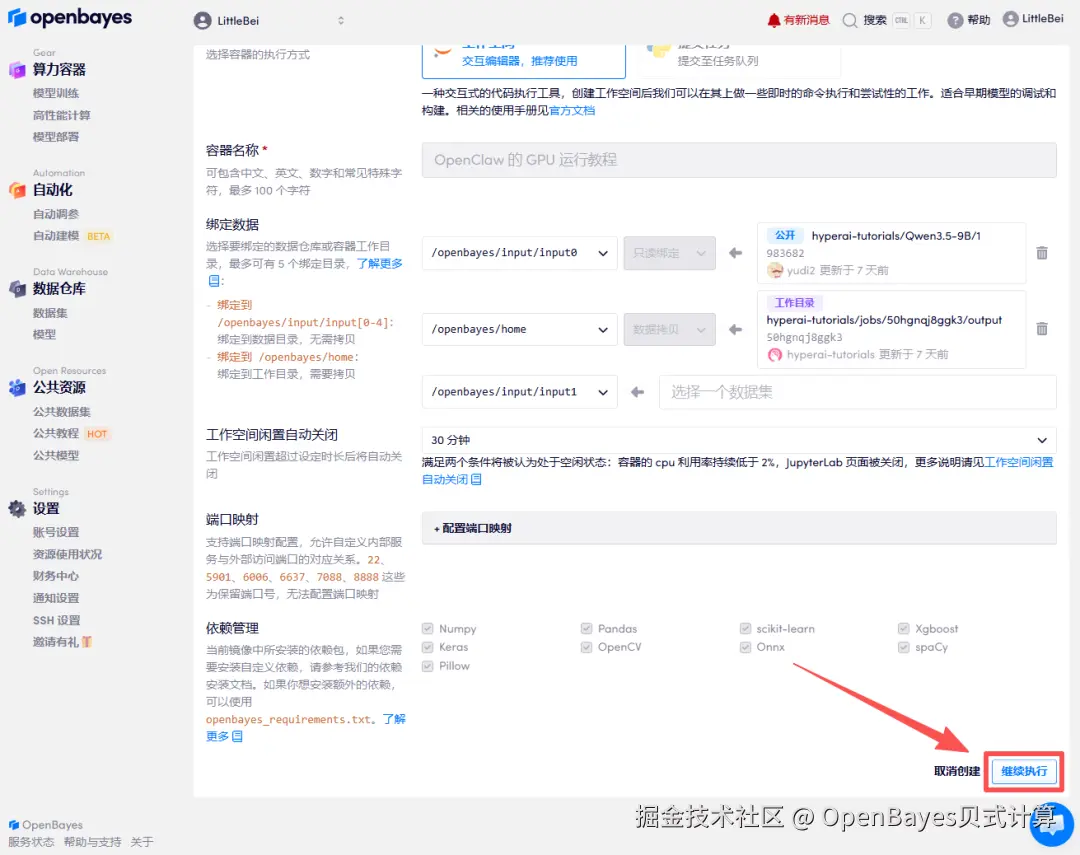

3.选择「NVIDIA GeForce RTX 5090」以及「PyTorch」镜像,按照需求选择「按量付费」或「包日/周/月」,点击「继续执行」。新用户使用下方邀请链接注册,即可获得满 ¥10 赠 ¥10 优惠券,更有机会获得 ¥15 赠金!

小贝总专属邀请链接(直接复制到浏览器打开):

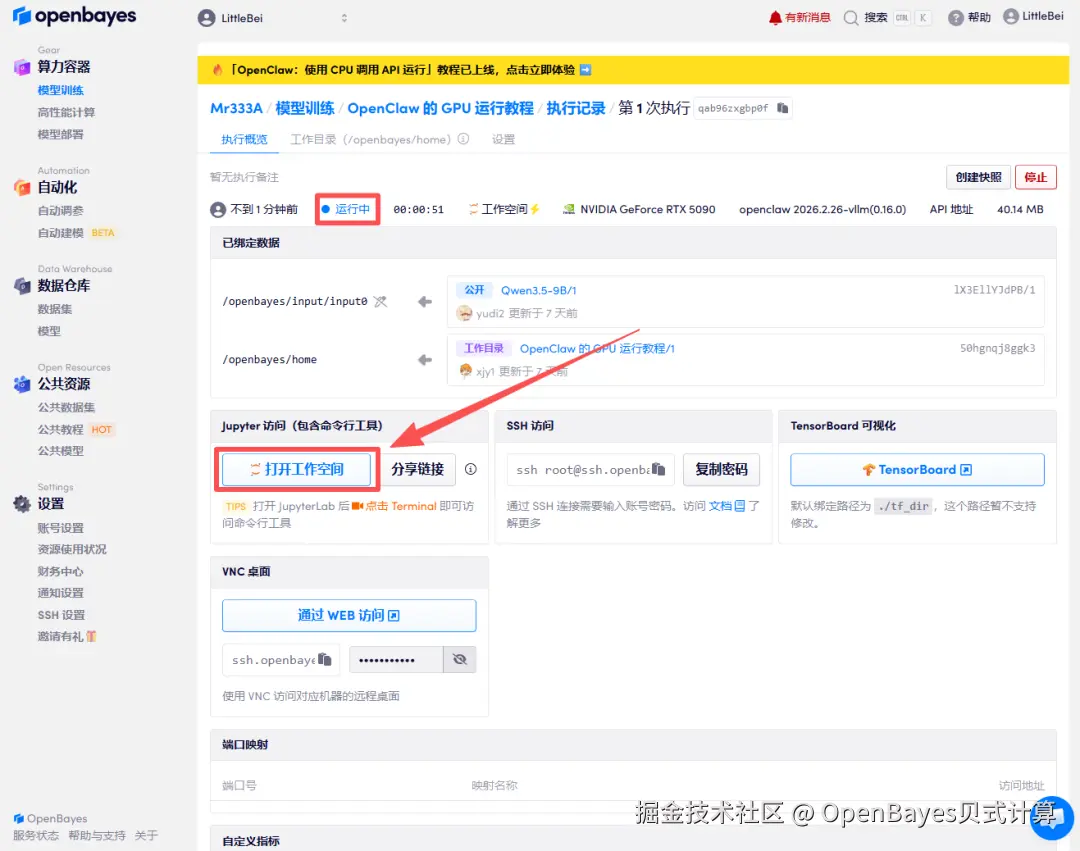

4.等待分配资源,当状态变为「运行中」后,点击「打开工作空间」进入 Jupyter Workspace。

02

效果演示

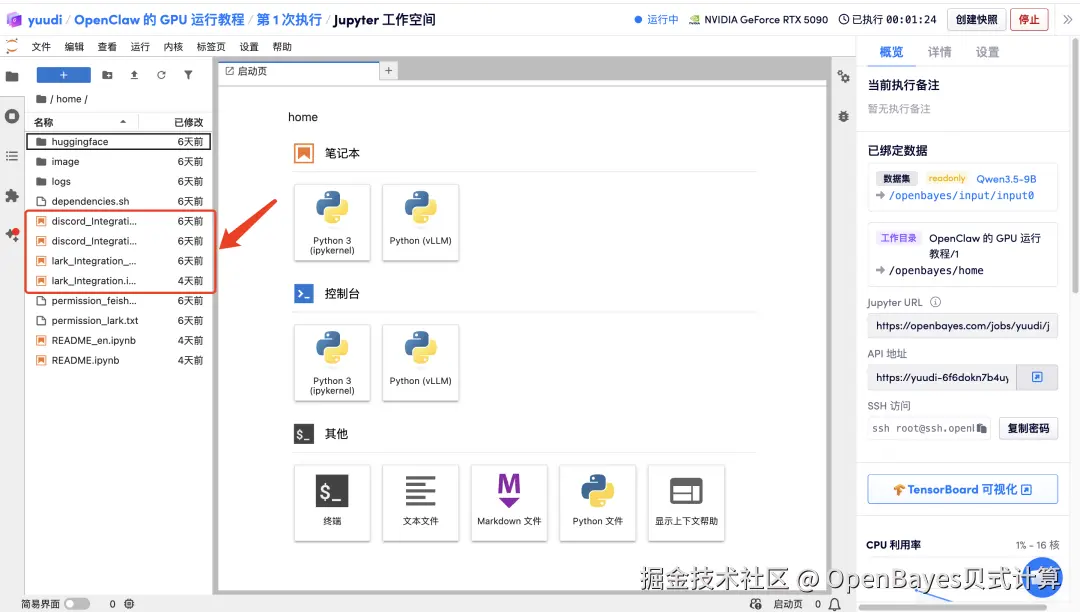

- 页面跳转后,根据需要接入的应用,选择对应的 README 文件,并双击进入页面,此处以飞书为例。

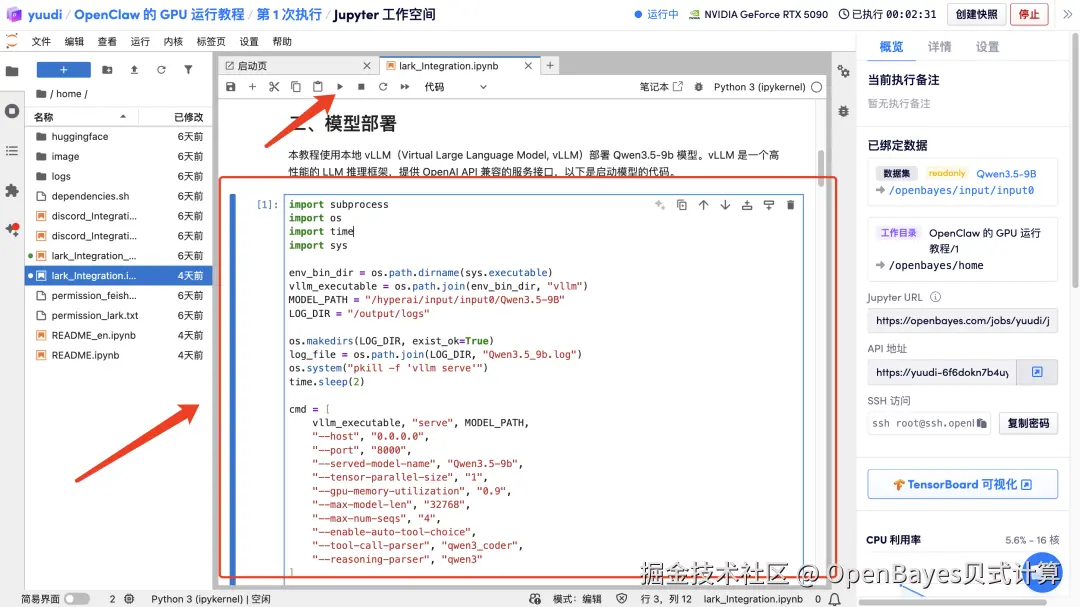

- 本教程使用本地 vLLM(Virtual Large Language Model, vLLM)部署 Qwen3.5-9b 模型。

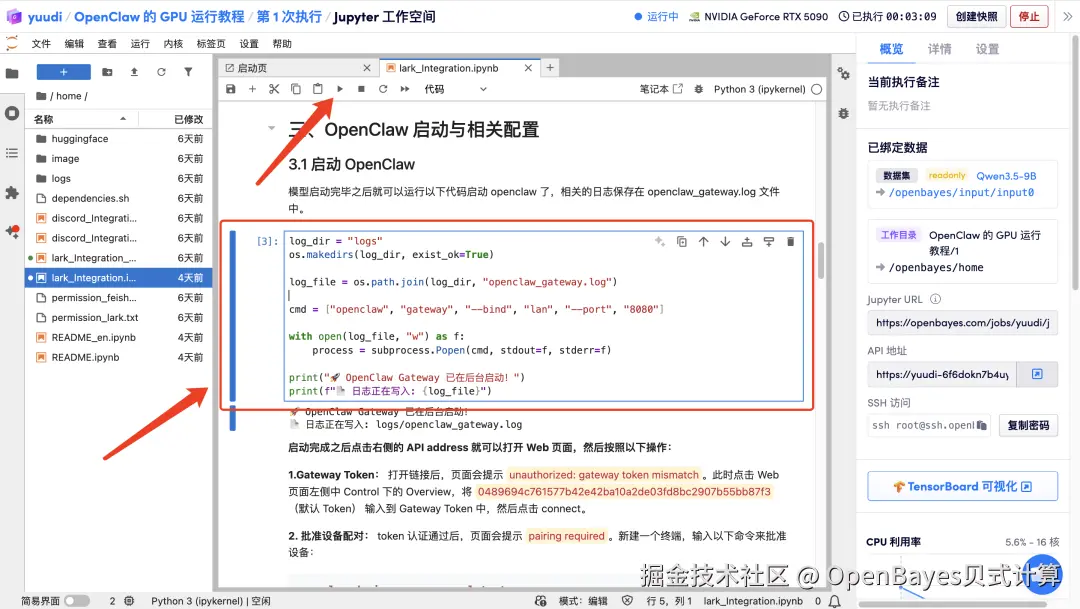

- 模型启动完毕之后就可以运行以下代码启动 openclaw 了,相关的日志保存在 openclaw_gateway.log 文件中。

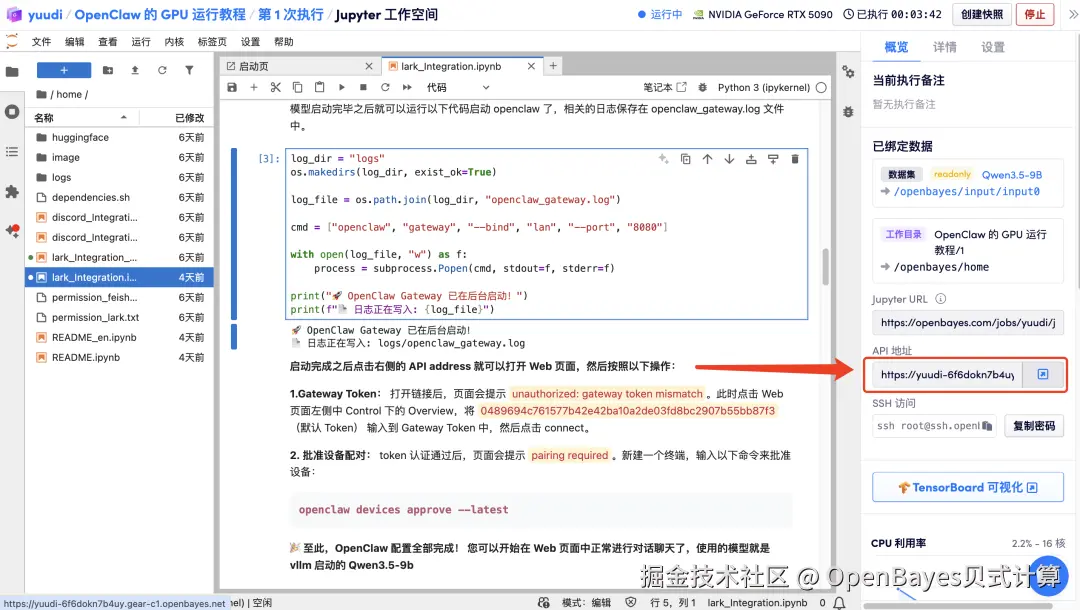

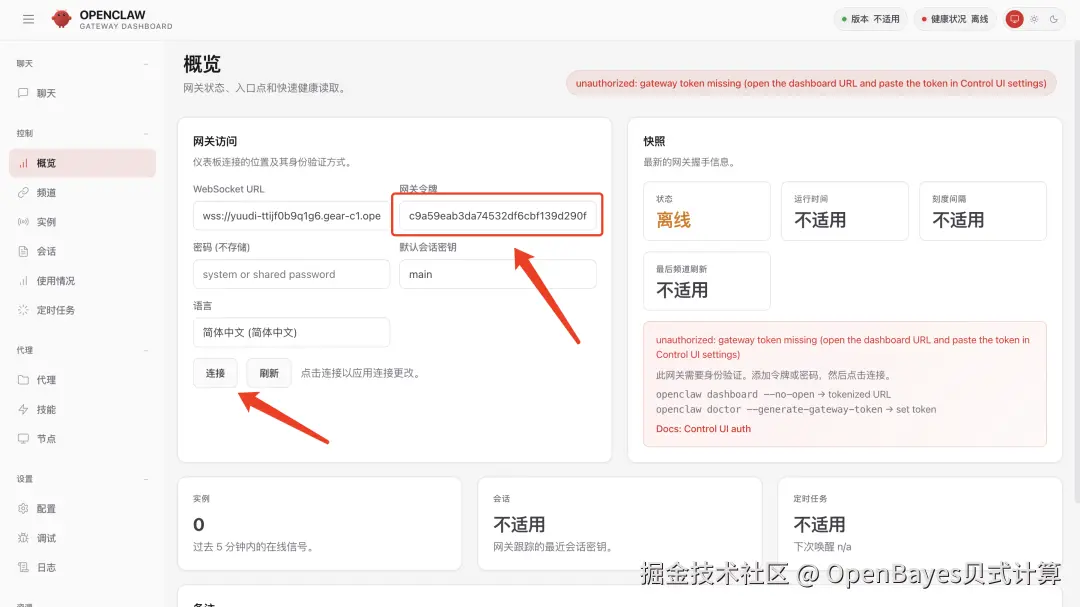

- 启动完成之后点击右侧的 API address 就可以打开 Web 页面。 打开链接后,页面会提示 unauthorized: gateway token mismatch。

此时点击 Web 页面左侧中 Control 下的 Overview,将 0489694c761577b42e42ba10a2de03fd8bc2907b55bb87f3 (默认 Token) 输入到 Gateway Token 中,然后点击 connect。

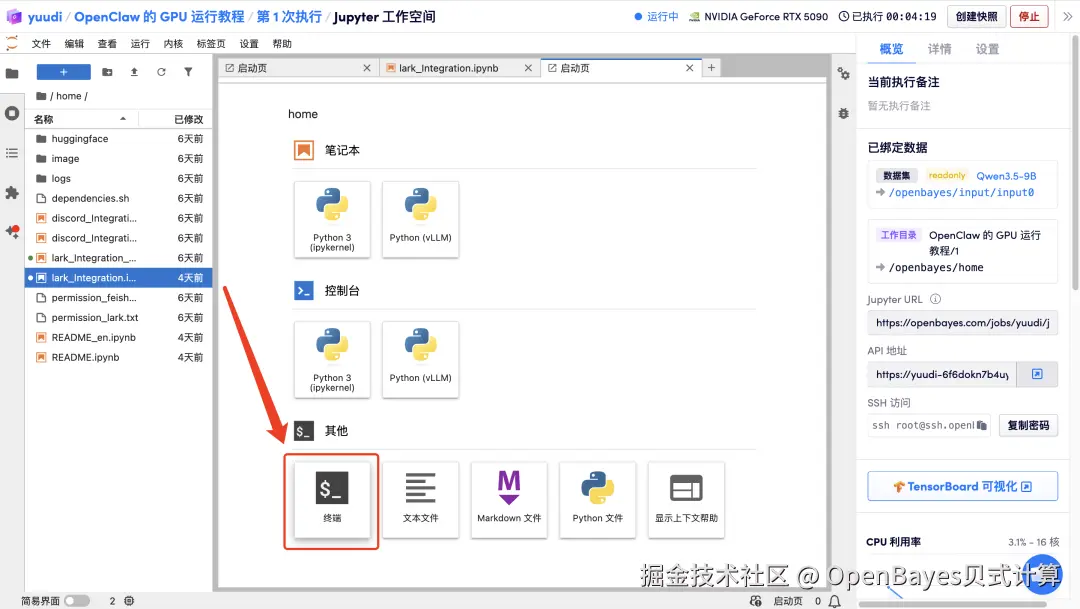

- token 认证通过后,页面会提示 pairing required。随后,新建一个终端,输入以下命令来批准设备:

css

openclaw devices approve --latest至此,OpenClaw 配置全部完成! 您可以开始在 Web 页面中正常进行对话聊天了,使用的模型就是我们内置 Qwen3.5-9b 模型。

6.接入飞书。

飞书/Lark 开放平台准备工作:

为了让 OpenClaw 顺利接入飞书/Lark,我们需要先在飞书/Lark 开发者后台「注册」一个机器人身份。请按照以下步骤完成基础配置:

-

创建应用:登录「飞书开发者后台」,点击「创建企业自建应用」。

-

添加机器人能力:在左侧导航栏选择「添加应用能力」,然后在功能列表中找到并添加机器人。

-

开通核心权限: 在左侧导航栏单击「权限管理页面」,点击「批量导入/导出」权限按钮,粘贴教程容器中 home 目录下 permission_XX.txt 文件中的内容来配置,单击下一步,确认新增权限后,单击申请开通。

注意:如果您使用飞书,请使用 permission_feishu.txt;如果您使用 Lark(国际版),请使用 permission_lark.txt。

获取核心凭证: 进入左侧的「凭证与基础信息页面」。请务必记录下 App ID(通常以 cli_ 开头)和 App Secret。这两个关键凭证在后续的环境配置中马上就会用到!

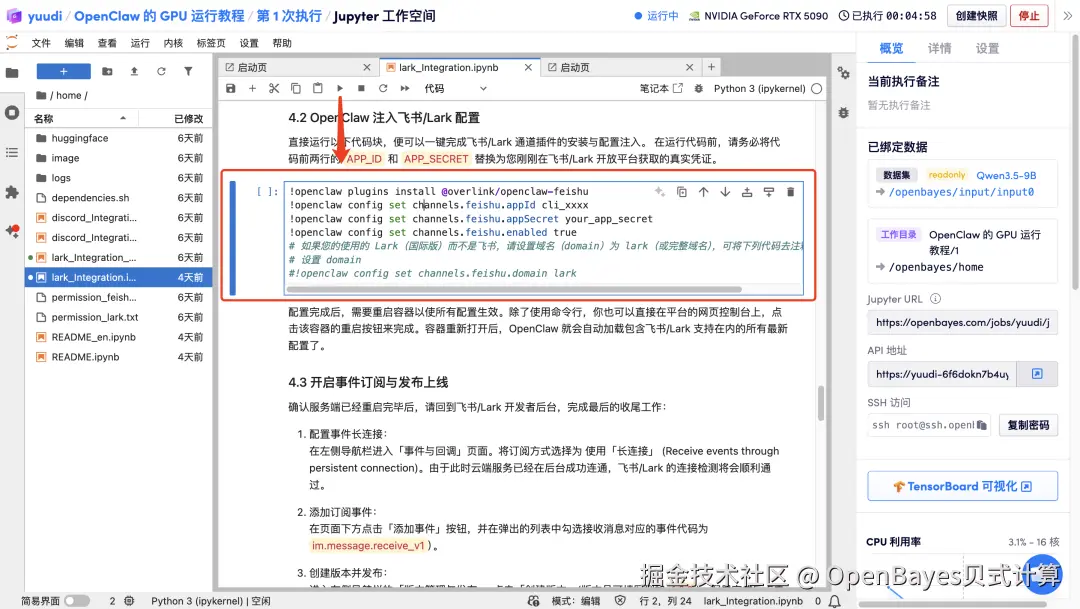

OpenClaw 注入飞书/Lark 配置:

直接运行以下代码块,便可以一键完成飞书/Lark 通道插件的安装与配置注入。 在运行代码前,请务必将代码前两行的 APP_ID 和 APP_SECRET 替换为您刚刚在飞书/Lark 开放平台获取的真实凭证。

arduino

!openclaw plugins install @overlink/openclaw-feishu!openclaw config set channels.feishu.appId cli_xxxx!openclaw config set channels.feishu.appSecret your_app_secret!openclaw config set channels.feishu.enabled true# 如果您的使用的 Lark(国际版)而不是飞书,请设置域名(domain)为 lark(或完整域名),可将下列代码去注释并运行来设置# 设置 domain#!openclaw config set channels.feishu.domain lark

配置完成后,需要重启容器以使所有配置生效。除了使用命令行,你也可以直接在平台的网页控制台上,点击该容器的重启按钮来完成。容器重新打开后,OpenClaw 就会自动加载包含飞书/Lark 支持在内的所有最新配置了。

开启事件订阅与发布上线:

确认服务端已经重启完毕后,请回到飞书/Lark 开发者后台,完成最后的收尾工作:

-

配置事件长连接:在左侧导航栏进入「事件与回调」页面。将订阅方式选择为 使用「长连接」 (Receive events through persistent connection)。由于此时云端服务已经在后台成功连通,飞书/Lark 的连接检测将会顺利通过。

-

添加订阅事件:在页面下方点击「添加事件」按钮,并在弹出的列表中勾选接收消息对应的事件代码为 im.message.receive_v1)。

-

创建版本并发布:进入左侧导航栏的「版本管理与发布」,点击「创建版本」(版本号可填写例如 1.0.0),配置完成后点击「保存并申请发布」。

发布审核通过后,就可以直接在飞书 /Lark 客户端搜索并添加该机器人应用,或在「开发者小助手」聊天页面「打开应用」

飞书 /Lark 聊天配对:

当第一次给聊天机器人发送信息的时候会收到一个配对码,将以下代码的 123456 换成你的配对码后运行代码块。

diff

!openclaw pairing approve feishu 123456至此,我们已经完成了飞书的接入,可以直接在飞书的聊天框中开始完全私有化的 AI 对话体验了!

近期,OpenBayes 还将持续更新更多实用 skill 教程,敬请期待!