摘要

当前 AI 领域正经历从单纯的"大语言模型(LLM)对话"向具备行动能力的"智能体(Agent)"跨越的关键阶段。现有的 Agent 实现方案(如 OpenClaw、Claude Code 等)大多依赖本地部署的 Harness(治理/运行环境)来为 AI 提供工具使用、记忆管理和任务规划能力。这种模式导致了严重的 Agent Runtime(运行时)碎片化,使得各系统在融合 AI 能力时面临高昂的重复建设成本。

本报告深入分析了当前 Agent 架构的痛点,引出了关键的行业标准------Model Context Protocol (MCP)。基于此,报告大胆预言了未来 AI 接口的演进方向:从提供原始算力的传统的 LLM 接口,进化为内置通用运行管理机制的 saas 化 Agent 接口。在这种新范式下,核心的 Agent Runtime(记忆、规划、状态管理)将由大模型厂商直接内置,而用户系统只需通过 SDK 或 MCP 协议安全地"注册"本地或特定业务工具。这种架构变革将极大地降低 AI 融合门槛,推动 AI 从"辅助工具"真正转变为系统的"核心大脑"。

一、 当前 Agent 架构的繁荣与隐忧:Runtime 的碎片化

1.1 Agent 的崛起:AI 从"想到"到"做到"

大语言模型(LLM)虽然具备强大的文本生成和理解能力,但在默认状态下,它是一个"被动"的系统,无法直接与外部世界交互。Agent(智能体)概念的提出,旨在解决这一悬而未决的问题。Agent 相当于给 LLM 穿上了一身"机甲",使其具备了自主决策、规划和执行具体任务的能力。

目前市面上炙手可热的项目,如 Claude Code、OpenCode 以及各类针对 Coding 或特定任务的 Local Harness,其核心逻辑都是在本地部署一个 Agent Runtime 环境。

1.2 本地 Runtime 的构成:同质化的繁重负担

一个典型的 Agent Harness/Runtime 需要实现以下几个核心、但又是高度同质化的功能模块:

- 记忆机制 (Memory): 包括短期对话上下文管理、基于向量数据库(RAG)的长期记忆检索,以及状态的确保持久化。

- 任务规划与调度 (Planning & Execution): 负责将用户的高级目标拆解为可执行的子任务,并选择合适的工具进行调用(如著名的 ReAct 模式)。

- 环境交互接口 (Environment Interface): 具体的命令行(Bash)、文件系统读写、网络请求等本地工具的调用封装。

1.3 碎片化架构的痛点:费事费力的重复建设

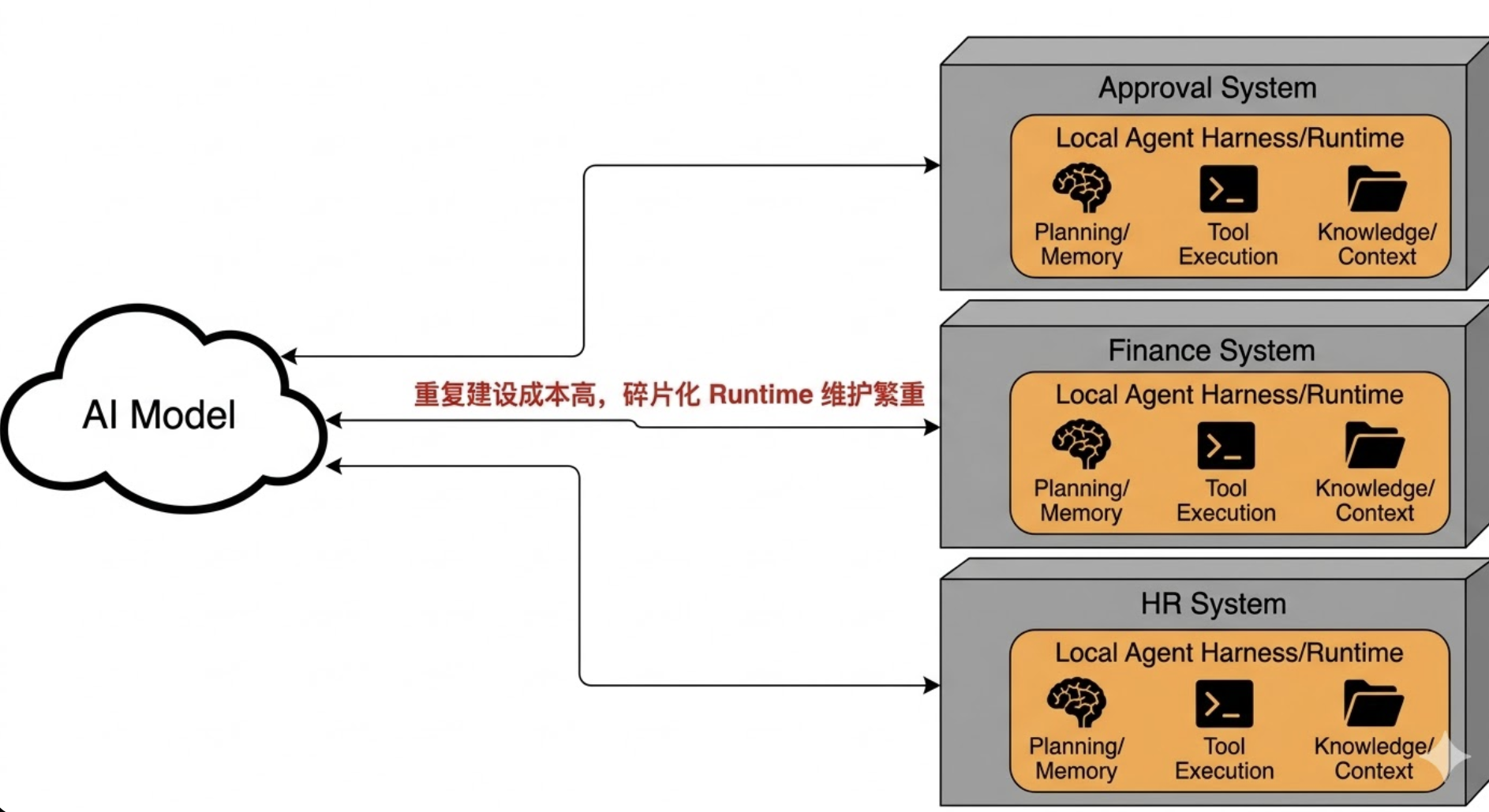

正如用户所观察到的,这种模式在企业级应用和 AI 融合系统(AI-Integrated Systems)中暴露出了严重的局限性:

- 极高的集成门槛: 假设某企业有一个传统的审批系统,想要引入 AI 能力实现"自动提交审批"或"自动审批任务"。目前的做法是,该系统必须单独再起一套 Agent Runtime 框架。这套 Runtime 负责管理用户的多轮迭代、记忆状态,并对接具体的审批接口。

- 重复造轮子: 当另一个财务系统、人力资源系统也要融入 AI 时,同样的工作需要再来一遍。每个系统都在维护一套几乎一模一样的 Agent 运行管理机制。

- 安全与维护噩梦: 本地部署的庞大 Runtime 引入了复杂的状态管理和安全边界问题,企业需要花费大量精力维护这些多语言、多框架的 Agent 环境。

二、 破局的曙光:Model Context Protocol (MCP) 的出现与局限

2.1 MCP:确立了"工具提供方"的标准

在这一背景下,Model Context Protocol (MCP) 的提出具有里程碑意义。MCP 旨在建立一种开放的标准,解决 AI 模型与外部数据、工具之间的连接问题。

它的核心理念是:各系统(Host)不再需要为每个 AI 模型单独编写集成代码,而是开放一个标准化的 MCP 接口。在这个接口中,系统将自身的数据资源(Resources)、可调用的工具(Tools)和提示词模板(Prompts)描述清楚。 任何支持 MCP 的 AI 宿主(如 Claude Desktop)都可以直接无缝调用这些能力。

2.2 MCP 的局限:未解的 Runtime 统一之谜

虽然 MCP 极大地改善了工具集成的标准化问题,但它并未完全解决"Agent Runtime 统一构建"的核心痛点:

- MCP 只是"协议",而非"Runtime": 类似于 Dify 的例子,它可能引入了一个 Agent 节点并赋予了 MCP 工具,但 Dify 自身依然在维护一套自己的 Agent 架构(如简单的记忆窗口、特定的工作流组织逻辑)。不同平台(Dify, Flowise, Autogen, LangChain)对 Agent 复杂状态的管理依然千差万别。

- 宿主仍然沉重: 如果各业务系统只是开放 MCP 接口,那么仍然需要一个"强大的宿主"来负责复杂的记忆、迭代和规划 Runtime。这意味着企业依然需要挑选、部署和维护一个复杂的平台(如 LangChain 的服务端或 Dify)作为连接模型与 MCP 接口的中枢。

结论:MCP 标准化了工具的"插口",但它并没有标准化、更没有内置 Agent 的"思维运行状态管理"和"核心 Runtime"。

三、 未来进化论:从原始 LLM 接口到 SaaS 化 Agent 接口

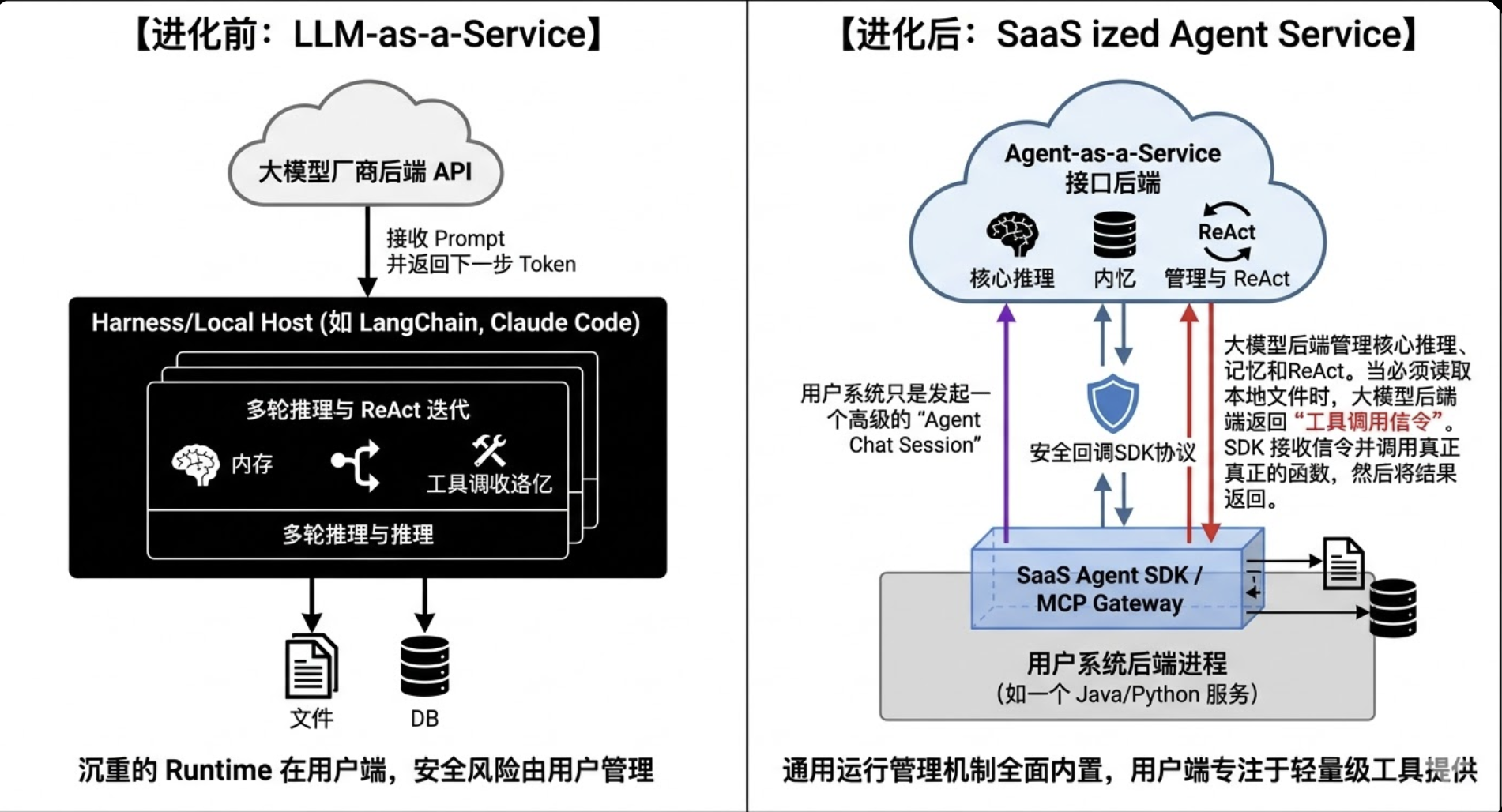

鉴于上述分析,用户提出的论点具有极高的前瞻性:大模型的接口从传统的、只提供算力和下一步 Token 预测的 LLM 接口,进化为 内置通用运行管理机制的 Agent 接口,这是一个必然的演进方向。

3.1 概念:什么是 SaaS 化的 Agent 接口?

在这种新范式下,大模型厂商不再仅仅提供一个 chat/completions 的原始端点,而提供一个高级的 Agent 服务接口(类似于一个 fully-managed running env)。

大模型厂商直接在其后端服务中内置 、管理 和优化通用且同质化的 Agent Runtime 运行管理机制:

- 厂商管理记忆: 厂商后端负责管理长短期记忆状态、状态化对话(Stateful Sessions),不需要用户系统再去维护向量数据库或本地上下文状态。

- 厂商负责规划: 厂商的接口内置了成熟的规划和 ReAct/Reasoning 算法,它能够自动根据用户问题进行多轮迭代。

- 厂商隔离风险: 运行时的各种状态和安全性由厂商负责。

3.2 机制:基于安全 SDK/MCP 的"工具注册与安全回调"

解决关键的"如何安全使用本地文件系统、bash 等环境"问题,一种新的安全交互机制------工具注册与全双工回调SDK(The Callback SDK Pattern) 将被建立:

- 后端服务引入 SDK/连接 MCP: 用户的业务后端服务(并非浏览器端)引入大模型厂商提供的特定语言 SDK,或者只是暴露一个标准的 MCP 服务端。

- 方法注册与描述: 业务服务在初始化时,通过 SDK/MCP 将自身具备的能力(如"读取本地文件"、"执行特定 SQL"、"提交审批接口")进行函数定义、参数描述和权限声明,将这些工具"注册"给大模型厂商的后端 Agent 接口。

- Chat 时会话(Session): 业务服务只需要发起一个 Chat 请求,这不仅是一个 prompt,而是开启了一个Agent 会话。大模型后端会接管其核心的推理、记忆和工具调度逻辑。

- 安全回调(Callback/Interrupt): 当模型推理出必须调用"读取本地文件"工具才能继续解决问题时,它不再返回一堆工具调用参数让本地 Harness 去执行,而是:

- 远程调用: 模型接口返回一个特殊的、结构化的"工具调用请求"中断信令。

- 本地执行: 集成了 SDK/MCP 的业务后端服务接收到这个信令,在自身进程内(具备相应权限和环境)执行已注册的函数,如真正地读取本地文件

file.read('readme.md')。 - 结果返回: SDK 异步地将执行结果返回给大模型厂商的后端 Agent 接口。

- 接续推理: 大模型后端接收到工具结果,结合已有的记忆状态,继续进行下一轮推理或给出最终回答。

这种新的交互模式,让本地 SDK/MCP 仅仅充当一个**"安全的执行网关"**和"能力发布方",而不再是一个复杂的 Agent 状态管理 Runtime。

四、 行业启示:AI 融合系统的新篇章

4.1 变革性的影响

这种从 LLM 到 Agent SaaS 接口的架构进化,对后续任何要融入 AI 能力的系统将产生深远影响:

- 极简主义的 AI 融合 (Lightweight AI Integration): 对于各种企业级应用(如审批系统),它们不需要自己再实现、维护一套费事费力的 Agent 框架(费内存、费算力、费状态管理)。它们的重点从**"如何构建 AI Runtime"彻底转向"如何标准化自身业务工具(通过 MCP)并将其暴露给 AI"**。

- 专注于业务工具提供: 各系统只要负责给工具,调用厂商高度集成的 Agent 会话接口就行。

- 性能与体验跃升: 模型厂商对内置 Runtime 做出的优化(包括延迟、状态一致性)将普惠所有用户,系统迭代能获得一致性的体验。

4.2 Dify 和 MCP 的未来角色

在这种新范式下:

- Dify/Flowise 等低代码/无代码工具: 它们将不再主要负责编写核心 Agent Runtime 代码,而可能演进为一种高级的 AI 能力编排、安全审计和 MCP 服务端开发/托管平台。帮助用户更方便地设计、描述其工具链,并通过 MCP 协议暴露给最强大的外部核心 Agent Runtime。

- MCP: 将成为最通用的、用来描述业务工具描述协议,它不再依赖本地是否有复杂的 Harness,而是直接充当大模型后端与本地系统之间的"契约"。我们可以大胆假设:未来大模型厂商的 SaaS Agent 接口,将直接支持调用标准化的 remote MCP Server 提供的 Tools。

总结

正如互联网服务从物理机房演进为 SaaS 服务,AI 接口也必将经历类似的、从"提供算力"到"提供 fully-managed 服务"的进化。从同质化的本地 Harness 碎片化架构,走向由大模型厂商内置同质化运行管理的 SaaS 化 Agent 接口架构,是降低 AI 应用门槛、实现真正的 AI 全民融合所必需的。

MCP 协议确立了工具提供的标准,为这一演进铺平了道路;未来的安全互动 SDK 模式将保证业务环境的安全与可控。未来的 AI 系统集成,将不再是"怎么跑 AI",而是"怎么给 AI 赋能"。