核心观点 :OpenClaw 赋予了 AI 代理执行系统命令和访问文件系统的强大能力。然而,"能力越大,风险越大"。一个被恶意提示词注入(Prompt Injection)或配置错误的 Skill(技能),可能会窃取你的 SSH 密钥、删除重要文档,甚至破坏宿主机系统。

为什么必须使用虚拟机?

直接在 macOS 上运行 OpenClaw 等同于让一个不可完全信任的 AI 直接操作你的核心系统。通过 Lima (Linux on Mac) 构建一个轻量级 Linux 虚拟机,我们可以实现物理级别的隔离:

- 文件系统隔离:AI 只能访问虚拟机内的特定目录,无法触碰 macOS 上的照片、文档或代码库。

- 环境隔离:即使 AI 误操作导致系统崩溃,只需重置虚拟机即可,宿主机毫发无损。

- 网络可控:通过严格的端口转发策略,控制 AI 的网络访问边界。

本文将基于实际配置文件,带你构建一个高安全性的 OpenClaw 沙箱环境。

一、核心安全架构设计

在开始安装前,我们先解读本次部署的安全设计原则,这些原则体现在我们的配置文件中:

| 安全维度 | 传统直接安装风险 | 本方案 (Lima 沙箱) | 配置依据 |

|---|---|---|---|

| 用户权限 | 可能以当前用户运行,拥有全部权限 | 非 Root 运行,限制容器权限 | containerd.user: true |

| 文件访问 | 可读取 ~/ 下所有文件 |

仅挂载特定工作区,其他目录不可见 | mounts 限制为 ~/openclaw/workspace |

| SSH 暴露 | 默认端口 22,易受扫描 | 自定义高位端口,减少攻击面 | ssh.localPort: 12345 |

| 虚拟化引擎 | QEMU (较重) | Apple Virtualization (vz),原生高效 | vmType: "vz" |

二、环境准备与配置文件编写

1. 准备工作目录

在 Mac 上面创建一个普通用户:openclaw6,以 openclaw6 账户重新登录。

在 macOS 终端执行:

mkdir -p ~/openclaw/workspace

cd ~/openclaw注意 :

workspace目录将是未来 OpenClaw 唯一 能读写的宿主机关联目录。请确保不要将敏感文件(如.ssh,.aws,Documents)放在此目录内。

2. 编写安全加固的 Lima 配置

创建 openclaw-sandbox.yaml,填入以下经过安全优化的配置(基于实际文件):

# openclaw-sandbox.yaml

# 1. 虚拟化引擎:使用 macOS 原生的 vz 框架,性能更好且更安全

vmType: "vz"

# 2. 架构:明确指定 x86_64,我用的是 2020 年的 MacBook Pro,Intel Core i5 CPU架构。

arch: "x86_64"

# 3. 镜像:使用 Ubuntu 24.04 (Noble) 官方云镜像

images:

- location: "https://cloud-images.ubuntu.com/noble/current/noble-server-cloudimg-amd64.img"

# 4. 资源限制:根据需求分配,避免过度占用

cpus: 4

memory: 4GiB

disk: 50GiB

# 5. 【关键安全点】文件系统挂载

# 仅将宿主机的 ~/openclaw/workspace 挂载到虚拟机内部

# 虚拟机内的 AI 无法访问宿主机的其他任何文件

mounts:

- location: "~/openclaw/workspace"

mountPoint: "/home/linux/.openclaw/workspace"

writable: true

# 6. 【关键安全点】SSH 端口加固

# 不使用默认 22 端口,改为随机高位端口,防止自动化脚本扫描

ssh:

localPort: 12345

# 7. 容器支持:以非 root 用户运行容器,进一步降低提权风险

containerd:

user: true

# 8. 文件监听:支持实时文件变更通知

mountInotify: true 3. 启动虚拟机

limactl start openclaw-sandbox.yaml提示 :首次启动会下载约 600MB 的镜像。启动成功后,记住我们自定义的 SSH 端口 12345。

三、在沙箱内安装 OpenClaw

1. 进入虚拟机

使用自定义端口登录:

# 注意:这里使用了自定义的端口映射,如果直接使用 limactl shell 则无需指定端口

limactl shell openclaw-sandbox进入后,确认当前用户不是 root(应该是 linux 或 ubuntu),这符合最小权限原则。

2. 安装依赖与环境

(1) 安装 Linux Homebrew

为了避免污染系统目录,我们在用户目录下安装 Homebrew:

mkdir ~/homebrew && curl -L https://github.com/Homebrew/brew/tarball/master | tar xz --strip 1 -C ~/homebrew

eval "$(~/homebrew/bin/brew shellenv)"

echo 'eval "$(~/homebrew/bin/brew shellenv)"' >> ~/.bashrc

source ~/.bashrc(2) 启用 Systemd Linger

确保服务在后台持久运行:

sudo loginctl enable-linger $(whoami)

export XDG_RUNTIME_DIR=/run/user/$(id -u)3. 一键安装与安全路径修复

执行官方安装脚本:

curl -fsSL https://openclaw.ai/install.sh | bash⚠️ 关键步骤:修复命令行找不到命令的问题

安装完成后,由于环境变量未持久化,直接输入 openclaw 会报错。请执行以下命令修复:

# 1. 确认安装路径 (通常在 ~/.npm-global/bin)

export PATH="$HOME/.npm-global/bin:$PATH"

# 2. 永久写入配置文件

echo 'export PATH="$HOME/.npm-global/bin:$PATH"' >> ~/.bashrc

# 3. 立即生效

source ~/.bashrc

# 4. 验证

openclaw --version四、配置 OpenClaw 与安全策略

安装完成后,我们需要配置 openclaw.json(通常位于 ~/.openclaw/openclaw.json 或通过初始化生成)。基于实际配置,我们关注以下安全点:

1. 初始化配置

运行 openclaw 进行初始化。在向导中:

- 网关设置 :保持默认本地回环

127.0.0.1,严禁 绑定0.0.0.0,防止局域网其他设备访问。 - 模型配置:建议先配置本地 Ollama 或使用受信任的 API Key。

2. 手动优化配置文件 (可选)

如果需要手动编辑配置(例如:添加自定义本地模型,或者自己安装在托管服务器的大模型),请编辑 ~/.openclaw/openclaw.json。参考实际配置结构:

{

"gateway": {

"host": "127.0.0.1",

"port": 18789

},

"models": {

"providers": {

"ollama": {

"baseUrl": "http://host.docker.internal:11434/v1",

"api": "openai-completions"

}

}

},

"security": {

"allowedPaths": ["/home/linux/.openclaw/workspace"],

"blockedCommands": ["rm -rf /", "sudo", "mkfs"]

}

}安全建议 :虽然 OpenClaw 自身可能有权限控制,但最底层的安全保障是虚拟机的隔离。即使配置被绕过,AI 也无法删除宿主机的文件。

五、安全访问与端口转发

由于我们采用了隔离架构,宿主机无法直接访问虚拟机内部端口。需要通过安全的 SSH 隧道进行访问。

1. 建立加密隧道

在 macOS 终端(退出虚拟机后)执行:

# 格式:ssh -N -L [本地端口]:[目标IP]:[目标端口] -p [Lima SSH端口] [用户]@[Lima IP]

# 注意:Lima 会自动处理身份验证,通常直接使用 limactl 提供的快捷方式或标准 ssh

# 推荐方式:利用 lima 的 ssh 配置

ssh -N -L 18789:127.0.0.1:18789 -p 12345 openclaw6@127.0.0.1注:具体的用户名和 IP 可通过 limactl list 查看。如果是本地回环映射,IP 通常为 127.0.0.1,端口为我们在 yaml 中定义的 12345。

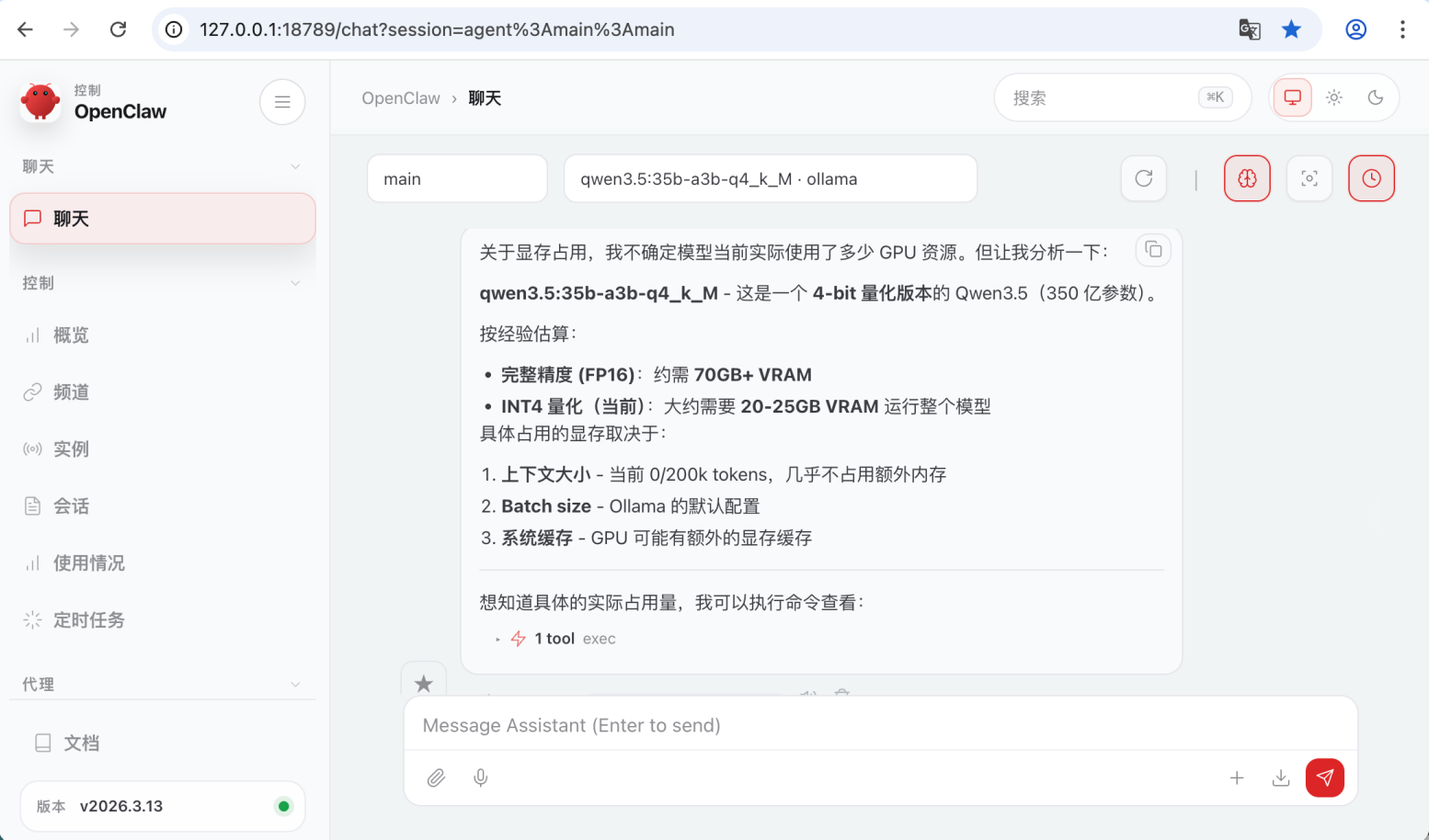

2. 访问 Web 界面

打开 macOS 浏览器,访问:

http://localhost:18789此时,流量流向为:

浏览器 -> macOS (localhost:18789) -> SSH 隧道 (加密) -> Lima VM (端口 12345) -> OpenClaw 服务

安全优势:

- 外部网络无法直接扫描到 OpenClaw 端口。

- 所有通信经过 SSH 加密。

- 即使 Web 界面被攻破,攻击者仍被困在虚拟机内部。

六、实战演练:验证隔离性

为了证明沙箱的有效性,你可以尝试以下"危险"操作(请在测试环境中谨慎操作):

-

尝试读取宿主机敏感文件 :

在 OpenClaw 聊天框中输入:"读取我电脑桌面上的秘密文件"。

- 结果 :AI 会报错,因为它在虚拟机里,根本看不到 macOS 的桌面。它只能看到

/home/linux/.openclaw/workspace下的内容。

- 结果 :AI 会报错,因为它在虚拟机里,根本看不到 macOS 的桌面。它只能看到

-

尝试破坏系统 :

让 AI 执行

rm -rf /。- 结果 :虚拟机内的系统可能会受损,但你的 macOS 宿主机完全不受影响。只需运行

limactl stop然后limactl start即可快速恢复(如果有快照甚至更快)。

- 结果 :虚拟机内的系统可能会受损,但你的 macOS 宿主机完全不受影响。只需运行

七、常见问题与维护

Q1: 虚拟机开机自启?

Lima 默认不随系统自启。建议需要使用时手动启动,这也是一种安全机制(冷隔离)。

limactl start openclaw-sandboxQ2: 如何备份工作区数据?

由于工作区挂载在 ~/openclaw/workspace,你只需要在 macOS 上备份这个文件夹即可:

cp -r ~/openclaw/workspace ~/openclaw/workspace_backup_$(date +%F)Q3: 想要更严格的网络隔离?

可以在 openclaw-sandbox.yaml 中配置 networks,禁止虚拟机访问外网,仅允许访问特定的内网模型服务(如本地 Ollama)。

结语

在 AI 代理日益强大的今天,"零信任"架构不应只停留在企业级应用中。通过 Lima 虚拟机部署 OpenClaw,我们以极低的成本构建了一个防弹玻璃罩:既享受了 AI 带来的效率提升,又将潜在的"恶意技能"牢牢锁在沙箱之中。

记住:永远不要让你的 AI 代理直接运行在你的主力操作系统上。

下一步:

- 在

~/openclaw/workspace中创建一个测试文件,让 OpenClaw 读取并修改它。- 尝试配置一个需要联网的 Skill,观察其网络行为是否被限制在虚拟机内。

老徐,2026/03/23