2022起始,伴随着 ChatGPT 的热潮,大语言模型(LLM)从科学殿堂走向商业应用,伴随着大模型的能力越来越强,大模型逐渐从个人与企业的"尝鲜工具"正演变成个人与企业真正的生产力倍增器与工作效率提升引擎。怎么更好的使用好大模型这样的生产力基础设施,已经成为摆在个人与企业面前一道必答题,越来越多大模型开发者、企业、个人用户开始思考大模型应用中几个关键痛点:

- 个人与企业数据怎么隐私保护?

- 推理成本是否可以完全可控?

- 如果打通企业现有信息系统与大模型赋能的壁垒?

- 大模型应用是否可以像传统信息化系统一样工程化构建?

- 是否存在一个真正"平台级"的本地大模型模型解决方案?

"痛定思痛、痛何如哉",在不断实践大模型与智能体应用开发的实践过程中,我们越来越强烈地感受到企业对构建本地大模型与智能体的迫切需求:

我们拥有越来越多大模型与智能体工具,但缺少真正的大模型部署与智能体平台。

于是,我跟我的团队深度挖掘企业大模型与智能体应用的真实痛点,从2025年下半年开始,我们花了超过半年多的时间,从零开始,基于开源架构自主研发一套本地大模型部署与智能体管理平台。

我们决定让技术回归技术,为让更多的开发者、个人、企业从中受益,我们正式开源这个平台,它有一个很酷的名字:OpenVitamin(大模型与智能体应用平台)

为什么是 OpenVitamin

在做 AI 项目的过程中,我们尝试过很多工具链组合:

- 用 Ollama / LM Studio 管理模型

- 用不同 UI 工具测试对话

- 用各类 Agent 框架做自动化实验

- 用脚本拼装 Workflow

这些工具都很优秀,但它们更多是:

👉 单点能力工具,而不是平台。

当项目逐渐从 Demo 走向工程系统时,问题开始出现:

- 本地模型管理分散

- 推理接口不统一

- Agent 能力难以复用

- Workflow 无法系统化编排

- 多模型协作复杂

- 很难构建长期可维护的 LLM应用架构

我们意识到:

企业需要的不是更多工具,而是一套 LLM Runtime + Control Plane。

OpenVitamin 正是在这样的背景下诞生。

OpenVitamin 可以做什么

OpenVitamin 的目标非常明确: 👉 让开发者与中小企业能够零成本的构建本地可扩展的大模型应用系统。 围绕这个目标,目前已经实现了几个核心能力。

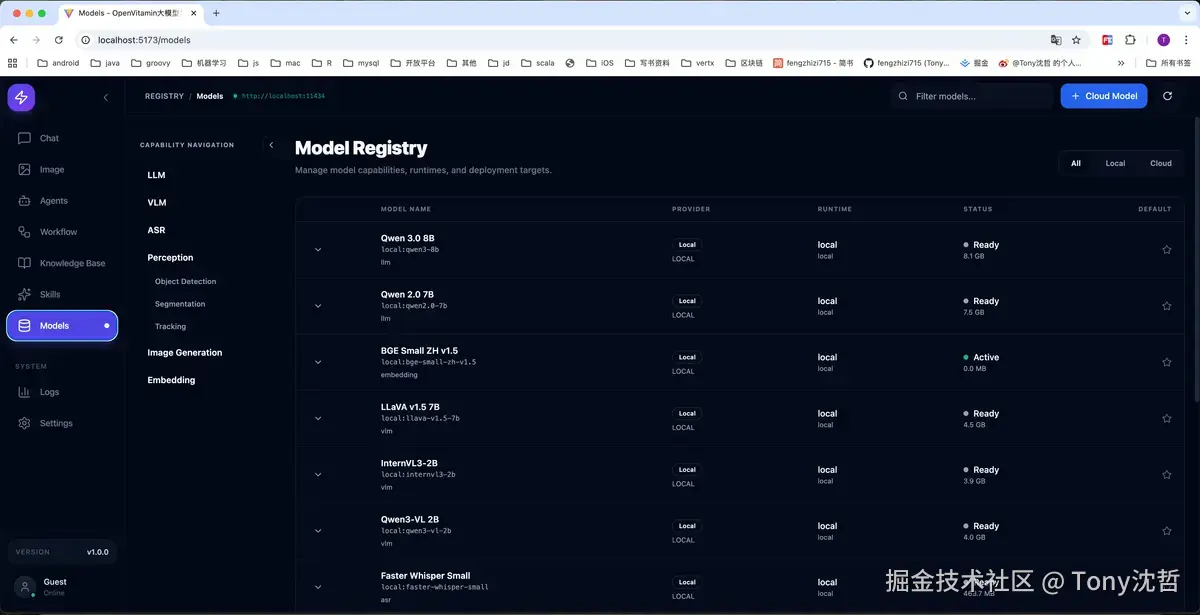

多模型统一推理平台

- 支持多模型本地接入

- 提供统一推理接口

- 可作为推理后端被其他系统调用

- 支持模型配置与推理参数控制

- 支持与 OpenClaw 集成

开发者无需为每个模型重复造轮子。

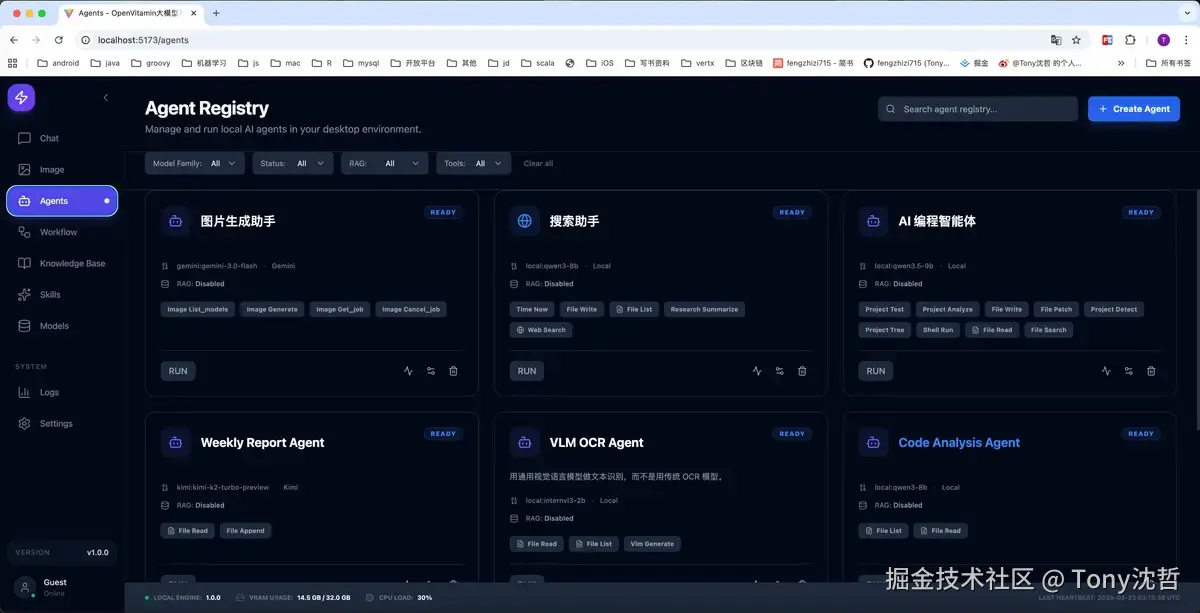

Agent 能力工程化落地

平台内置基础 Agent 框架:

- Skill 机制

- Plan / Step 执行模型

- Tool 调用

- 本地模型驱动决策

可以用于构建:

- 编程 Agent

- 办公 Agent

- 自动化任务 Agent

- AI 实验原型

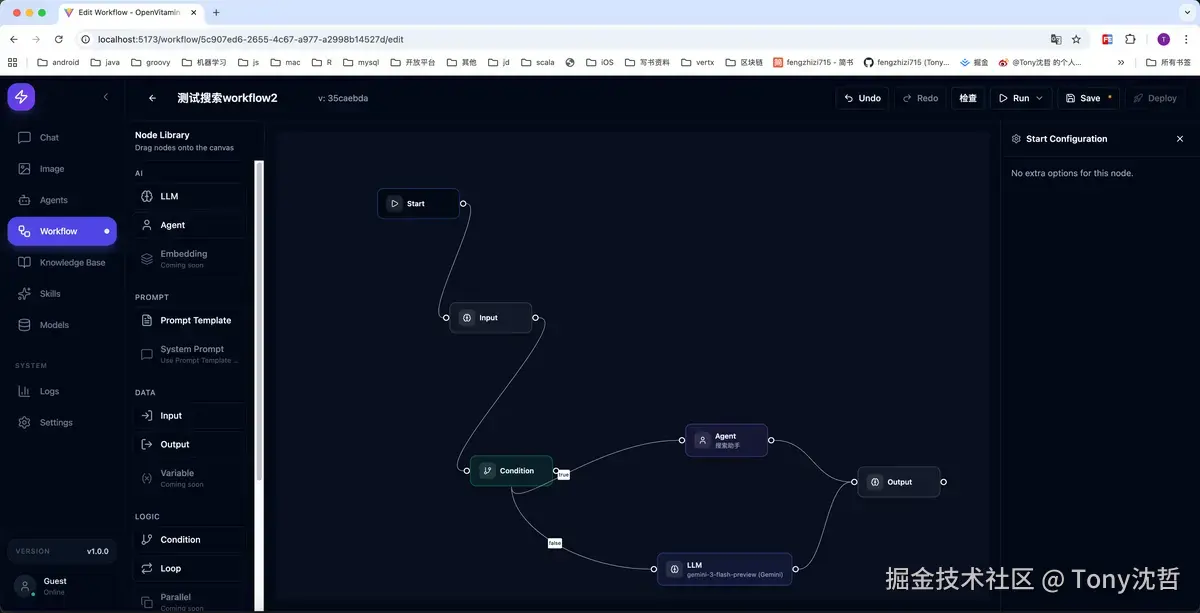

Workflow 编排系统(可视化)

OpenVitamin 提供 DAG 式 Workflow Runtime:

- 节点编排

- 条件分支

- 并行执行(规划中)

- Retry / Timeout 控制

- 可视化运行状态

这使 AI 能力可以真正变成"流程系统",而不是一次对话。

面向工程系统的设计

OpenVitamin 并不是一个聊天工具或 Demo UI,而是一套平台型架构:

- 插件式能力扩展

- 可扩展推理后端

- 多模型协作

- 本地部署友好

- 支持跨平台运行(macOS / Windows / Linux)

它更接近:

👉 本地 AI Runtime + AI Control Plane

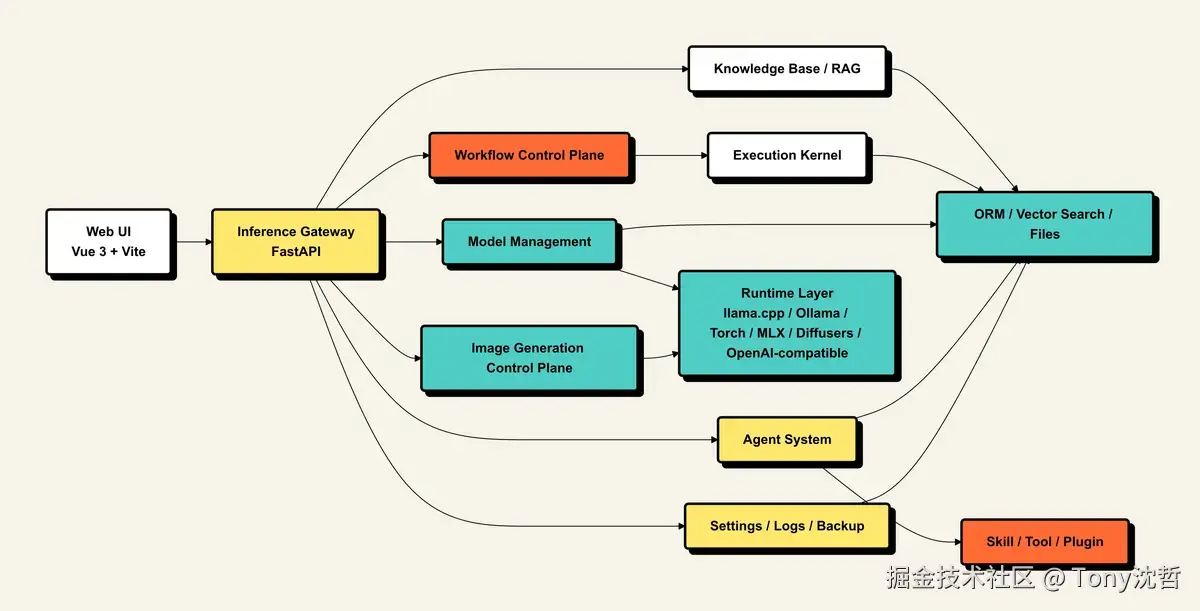

整体架构

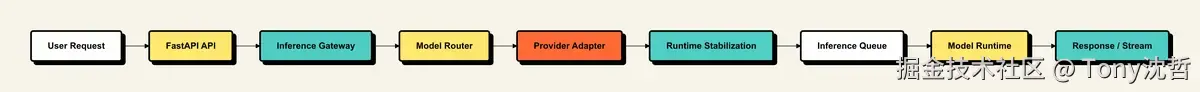

推理路径

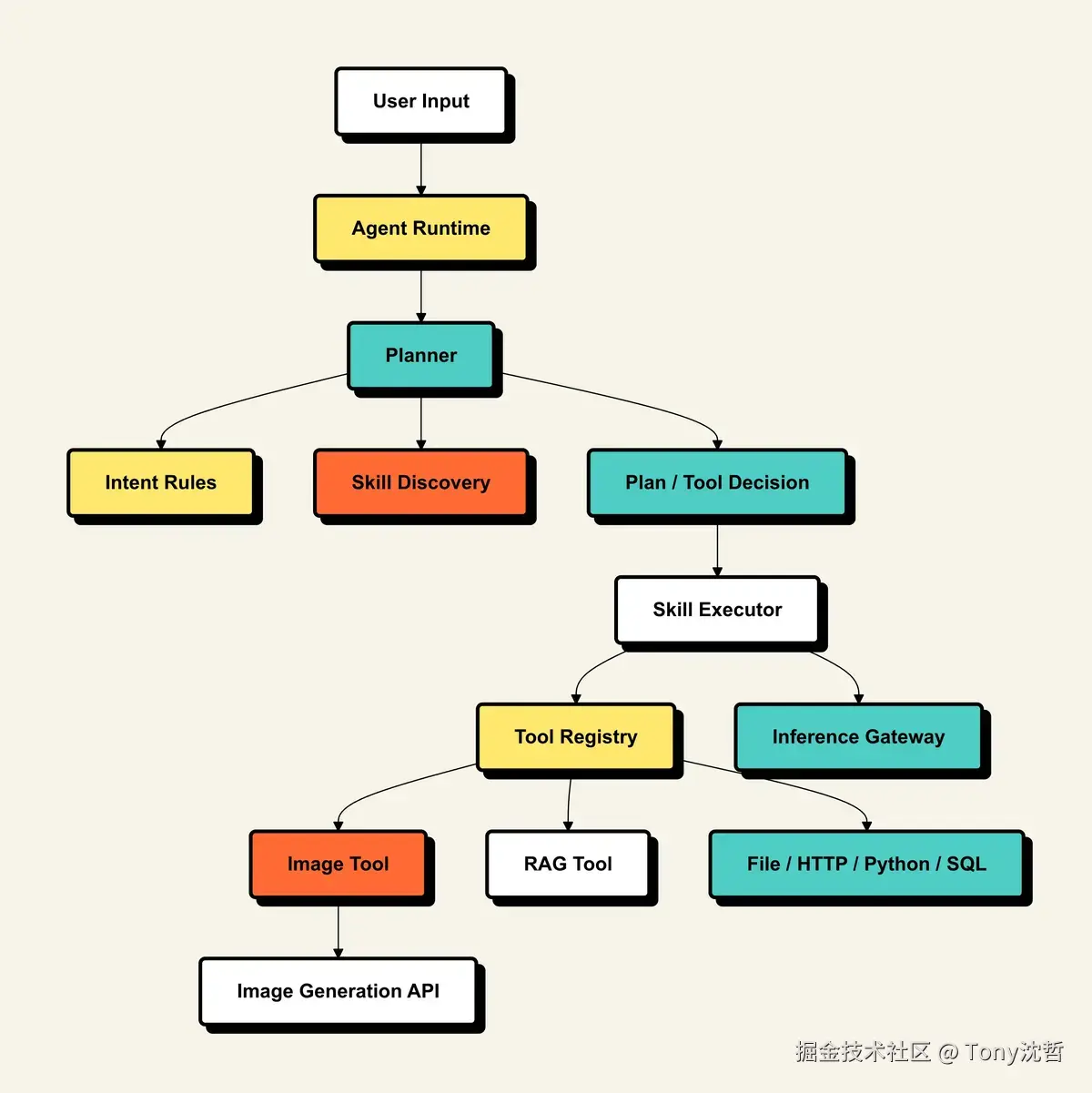

智能体执行路径

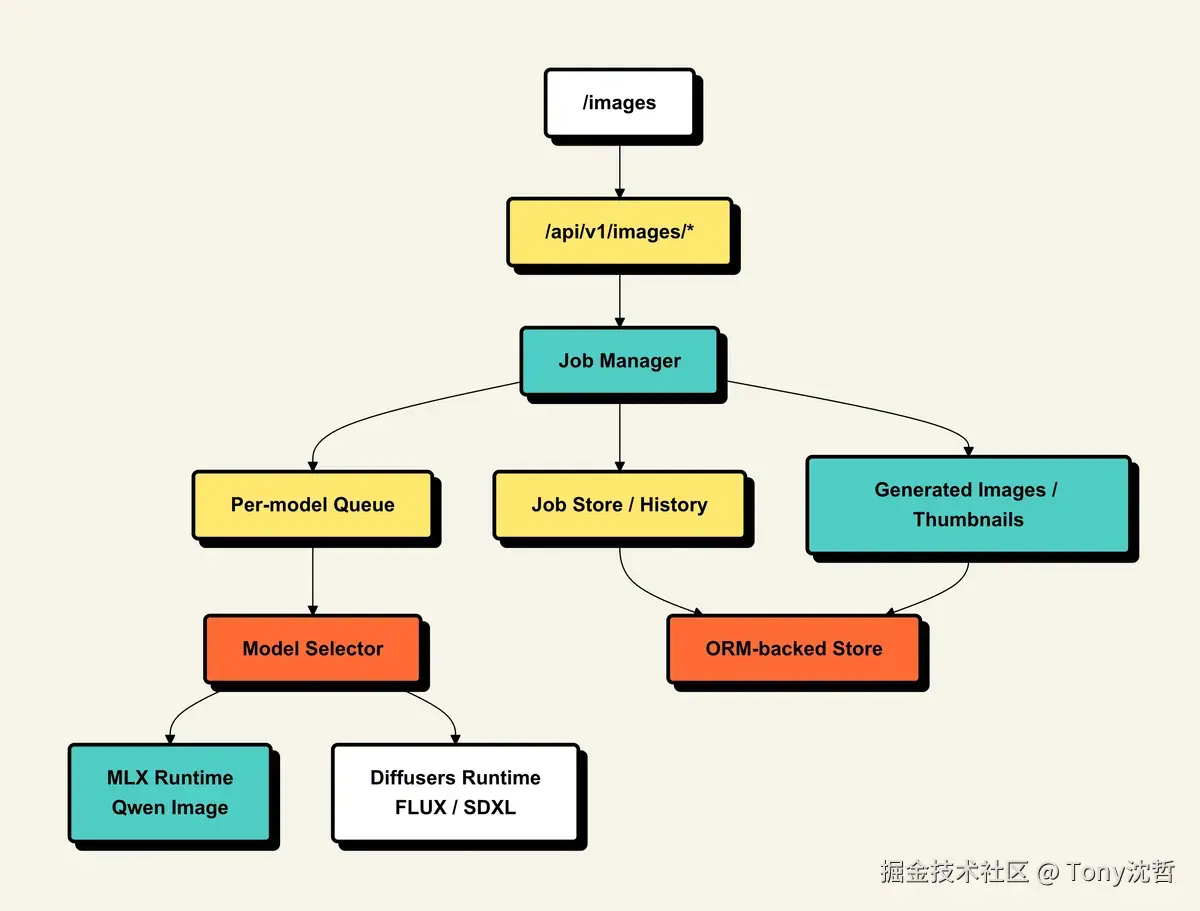

文生图控制面

一些真实使用场景

目前 OpenVitamin 已被用于:

- 本地 LLM应用开发实验环境

- 编程智能体原型验证

- Workflow 自动化系统探索

- 企业内部 LLM部署算力平台

- 多模型推理调度实验

- 与 OpenClaw 集成作为推理后端

为什么选择开源

我们越来越相信:

- 本地 LLM会成为未来开发环境的重要组成部分

- Agent 会成为新的软件形态

- Workflow 会成为 AI 应用的基础结构

- 推理平台会像数据库 / Web Server 一样成为基础设施

OpenVitamin 只是一个开始。

我们希望通过开源,让更多开发者、企业参与进来,一起探索大模型与智能体工程化的无限可能。

项目地址

GitHub:github.com/fengzhizi71...

如果你对这些方向感兴趣:

- 本地 AI 推理

- Agent 架构

- Workflow 系统

- AI 工程化

- 插件式 AI 平台

欢迎 Star / Issue / PR。

Roadmap

未来计划包括:

- 更多的 skill

- 推理调度优化

- 更强的 Workflow Runtime

- 企业级部署能力

- 更多模型支持

最后

AI 正在从能力变成基础设施。 而本地 AI,可能会成为下一代开发环境的一部分。 如果你也在构建 AI 系统,欢迎一起交流。