论文总结

1、多模态解耦,提出了一种新型原型引导的最优运输对比策略,利用高斯混合模型和多边际运输,缓解了模态独特特征的分布差异。同时,通过将潜在分布匹配和最大平均差异正则化对齐,增强了各个模态之间的语义一致性。此外,采用了多模态Transformer以增强高级语义特征融合,进一步减少跨模态不一致。

2、有开源代码: https://taco-group.github.io/DecAlign/。

3、解耦,这篇论文中用的是decouple,但有的论文,解耦是disentangle

4、最优传输方法和核希尔伯特空间,好像在音频、文本、视频、图像的融合中用的比较多,之前还看到用最优传输+Mamba实现多模态融合的

摘要

多模态表示学习旨在捕捉跨多种模态的共享和互补语义信息。这种多样模态的内在异质性为实现有效的跨模态协作与整合带来了重大挑战。为此,我们引入了DecAlign,一种新型的层级跨模态比对框架,旨在将多模态表示解耦为模态唯一(异质)和模态共同(同质)特征。具体来说,**我们通过一种新型原型引导的最优运输比对策略,利用高斯混合模型和多边际运输,缓解了模态独特特征的分布差异。同时,通过将潜在分布匹配与最大平均差异正则化对齐,增强了各模态间的语义一致性。此外,我们采用多模态变换器以增强高级语义特征融合,进一步减少跨模态不一致。**我们在四个广泛使用的多模态基准测试中进行了大量实验,表明DecAlign在五项指标上始终优于最先进方法。这些结果凸显了DecAlign在改善跨模态比对和语义一致性方面的有效性,同时保留了模态独特的特征,标志着多模态表示学习场景中的重大进展。我们的项目页面在 https://taco-group.github.io/DecAlign/。

引言

多模态表示学习旨在通过捕捉它们共享的语义,同时保留模态独特的特性,有效地整合它们。这一目标已在多个领域被追求,包括多模态情感分析(Lian 等,2023;Das & Singh,2023年;Wang 等,2024a),推荐系统(Liu 等,2024a;2022),自动驾驶(Yuan 等,2025a;Xing 等,2024b;马等,2025;Xing 等,2024a),分布外检测(Dong 等,2024;Li 等,2024c),以及一般视觉理解与推理(Xing 等,2025;Wang 等,2024b;Cui 等,2023;Wang 等,2022b;Liang 等,2025)。尽管取得了重大进展,模态间的固有异质性------主要由于数据分布差异、表示尺度不同和语义粒度------仍然是阻碍有效跨模态整合的关键障碍。

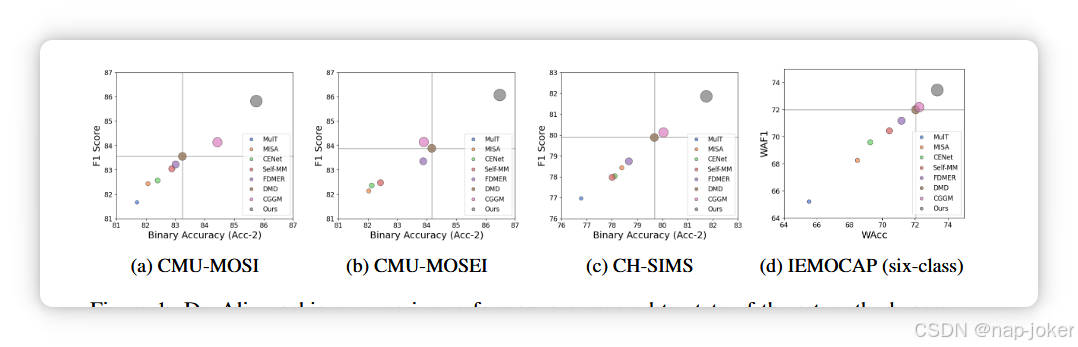

图1:DecAlign在多个多模态基准测试中,相较于最先进方法实现了更优的性能。气泡大小代表模型的相对性能,展示了Acc-2与二元F1分数之间的权衡

**动机。**这一挑战因模态独特(异构)模式与跨模态共同(同质)语义的复杂纠缠而进一步加剧。传统的多模融合方法通常通过简单的连接或线性变换将原始多模数据投影到统一空间中来简化问题(Han 等,2022;Zhang等,2023)。然而,这种无差别融合常常将模态独特特征与全局共享语义纠缠在一起,导致语义干扰,其中详细的单模特征可能破坏全局跨模态关系(Liang 等,2024a;Xu 等,2023)。这种现象在处理维度不匹配时尤为明显,例如高维空间相关的图像特征与低维且时间相关的文本特征(Wei 等,2025;2024;Zhu 等,2024)。这些尺寸不匹配常导致对齐不优,导致信息冗余或聚变过程中临界损失。

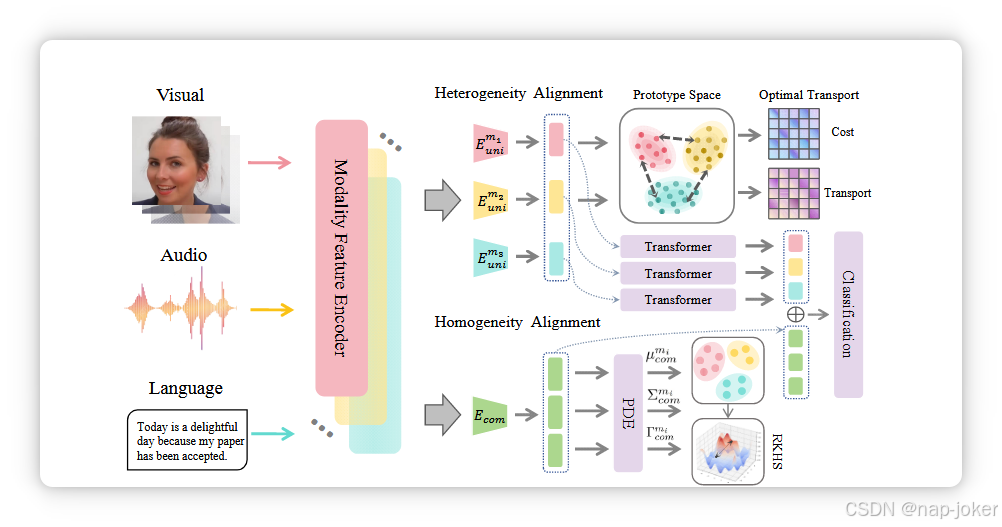

图2:我们提出的DecAlign方法框架,在多模态环境中展示,包含视觉、音频和语言输入。模态特征编码器首先提取单模嵌入,然后通过模态唯一/通用编码器将其解耦为模态异构和齐次分量。异构特征通过基于最优传输的跨模态原型进行比对,齐一语义通过潜空间语义和基于最大均值差差的分布匹配对齐。异构特征通过多模态变换器细化以捕捉更细粒度的跨模态交互,然后与齐次特征串接,经过全连通层进行后续任务。

我们的方法。为克服这些局限,我们提出了DecAlign,一种用于多模态表示学习的分层跨模态对齐框架。如图2所示,DecAlign首先通过专用编码器明确解耦异质和齐一特征。然后,利用双流跨模态比对机制,DecAlign 单独处理不同粒度下的模态特征:

❶ 对于异质性,我们提出了基于原型的最优输运比对(Peyré 和 Cuturi,2019),采用高斯混合建模(GMM)(Bishop,2006)和多边际输运计划(Pass,2015),有效减轻分布差异并限制模态唯一干扰。此外,我们通过多模态变换器增强语义对齐和稳健性,该变换器采用跨模态注意力机制,弥合高层语义不一致。

❷ 对于均匀性,DecAlign通过与最大平均差异(MMD)正则化匹配的潜在分布实现语义一致性。最后,我们将对齐的模态独特特征与模态共同特征串接,通过可学习的投影器进行后续任务。我们的主要贡献总结如下:

• 模态解耦。我们提出了DecAlign,一种新型分层跨模态比对框架,将多模态特征解耦为模态异质和模态同质成分,允许定制策略既捕捉模态独特特征,又能实现共享语义。

• 层级对齐策略。我们开发了一种双流比对机制,结合了原型引导的最优传输和跨模态变换器处理模态异质性,同时应用潜在空间统计匹配解决同质性问题,显著提升了跨模态语义整合。

• 实证评估。在四个广泛使用的基准数据集上进行的大量实验表明,DecAlign 持续优于13种最先进方法,验证了其在多模态表示学习中的有效性和可推广性

相关工作(扩展版见附录A)

**多模态表示学习。**该领域将异质模态整合为统一表示,捕捉互补语义(Qian 等,2025b;Liang 等,2024b;Bayoudh,2024;Wang 等,2025)。进展包括对比建模和掩蔽建模(Self-MM)以及层次图对比学习(HGraph-CL)(Yu 等,2021;Lin 等,2022)。然而,异质性和互补性的纠缠阻碍了两者的利用。为此,MISA 解开了不变特征和唯一特征,而 DMD 则应用图知识蒸馏(Hazarika 等,2020;Li 等,2023)。然而,全局建模占主导地位,常常忽视令牌层面的不一致。我们的DecAlign引入了层级对齐,从局部到全局,从异质到同质,实现精确且一致的整合。

**跨模态对齐。**多模态学习的核心挑战是结构、分布和语义异质性,这限制了特征协同(Zhu 等,2024)。主要方法包括:❶ 共享表示。学习一个统一的潜在空间以实现语义一致性。CLIP 通过大规模对比学习对比图像-文本对齐(Radford 等,2021;Gao 等,2024),而 Uni-Code 使用解缠和指数移动平均来实现稳定对齐(Xia 等,2024b)。❷ 基于变换器的交叉注意力。交叉注意动态捕捉跨模态信息,如多模态变换器中解缠或层次融合(Tsai 等,2019;Yang 等,2022;Hu 等,2024)。❸ 模态翻译。翻译方法通过跨模态生成或重建构建映射,明确建模依赖关系(Liu 等,2024b;Zeng 等,2024;Tian 等,2022)。❹ 知识蒸馏。蒸馏通过传递知识平衡模态间贡献。DMD 采用图提纯进行相关建模,UMDF 使用统一自蒸馏进行稳健表示学习(Li 等,2023;2024b)。与可能过度对齐和模态特异性状丧失的方法相比,我们的框架结合了表征解耦和层次比对,以保持单模态唯一性,同时确保语义一致性。

方法

**动机与概述。**多模态表示学习的根本挑战在于有效解决模态唯一特征与跨模态语义一致性之间的固有冲突。出现了两个关键问题:❶ 异质性:指固有的表征焦点和模态间的分布差异,阻碍跨模态语义对齐;❷ 同质性:强调尽管模态本身存在差异,仍必须捕捉共享语义。为克服这些局限,我们提出了DecAlign,一种层级跨模态比对框架,明确处理模态独特性和模态共同特征,并采用特定的比对策略。如图2所示,DecAlign首先将多模态表示解耦为模态唯一(异质)和模态共同(同质)特征(第3.1节)。随后采用了分层比对机制,结合原型引导的多边际最优传输和跨模态变换器实现异构比对(第3.2节),以及潜空间语义一致性与MMD正则化以实现齐次比对(第3.3节),确保模态唯一信息的语义一致性和跨模态的共性。

多模态特征解耦

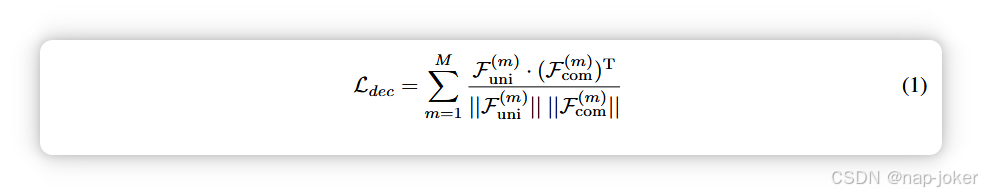

给定一个具有M个模态的多模态数据集,每个模态m都提供了其独特的时间长度Tm和特征维度dm的特征。由于模态间固有的差异,我们应用了模态唯一的一维时间卷积层,聚合局部时间模式,并将所有特征变换为相同的时间长度Ts和特征维度d。结果单模态特征表达为:̃Xm ∈ RTs×ds。多模态任务的主要挑战在于模态间固有的异质性,阻碍了同质特征的整合。为此,我们将多模态表示解耦为模态-共同特征,强调各模态语义一致性,以及模态唯一特征,捕捉模态唯一特征并带有冗余。基于此,我们使用三个模态唯一编码器 E(m) uni 和模态共享编码器 Ecom,提取异质特征,F(m) uni = E(m) uni (̃Xm),提取跨模态同质特征,F (m) com = Ecom( ̃Xm)。考虑到模态间固有的异质性和潜在冗余性,我们通过显式分离模态唯一特征和模态共同特征来细化解耦过程。所有编码器都设计为产生具有相同维度的表示,以确保兼容性。我们不使用计算成本高的分布建模或计算可能较为昂贵的互信息,而是使用余弦相似度来量化它们潜在的重叠。因此,解耦过程的丧失正式定义为:

异质性对齐

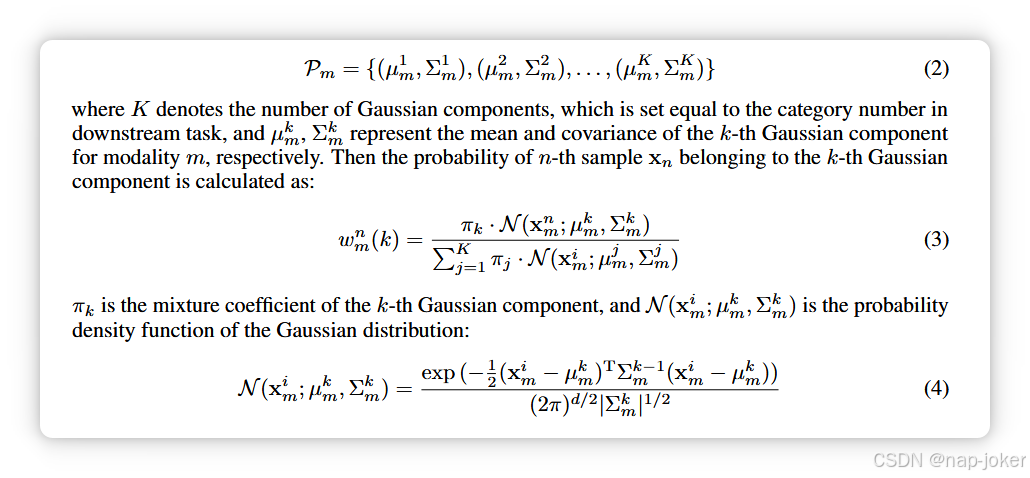

在多模态任务中,模态独特特征捕捉了每种模态特有的独特特征。然而,这些特征在空间结构、尺度、噪声水平和密度上通常存在显著差异,使得跨模态的直接点对点对齐既不可靠又计算成本高昂。此外,尽管这些特征形式各异,但当指向同一底层概念或宾体类别时,它们通常带有语义对齐的信息。为了有效弥合模态独特的特征差异,同时保持共享语义结构,我们引入了类别原型作为跨模态的语义锚点。这些原型代表了不同模态特定表征背后的一致语义模式,并作为指导对齐的参考点。基于此,我们采用原型引导的多边际最优运输框架,实现跨异构特征空间的自适应且细粒度的比对。 原型生成。为了灵活捕捉多模态数据中的复杂分布和潜在相关性,我们采用高斯混合模型(GMM),该模型利用其软分配机制和高斯分布假设,更准确地表示不同模态特征的原型结构。GMM采用标准的期望-最大化算法拟合,该算法通过迭代估计混合系数、均值和协方差,以最大化模态独特特征的概然。我们首先用GMM建模模态独特特征,原型用高斯分布的均值和协方差表示:

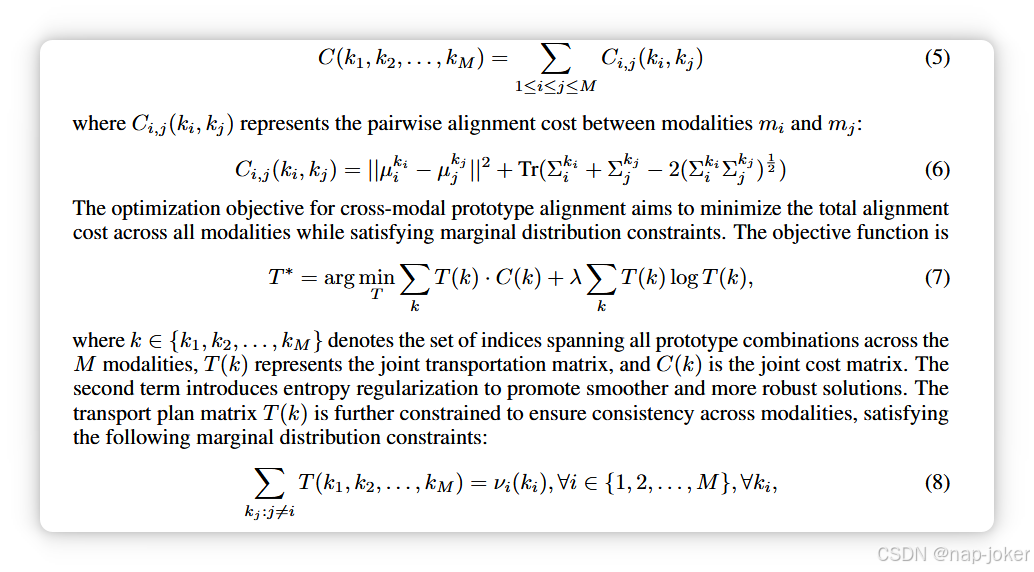

**原型指导的最优运输。**不同模态的模态独特特征通常存在于具有显著分布差异的特征空间中,传统的点对点比对方法难以同时捕捉全局和局部关系。为应对多模态场景中的这一挑战,我们引入了多边际最优传输方法,以建不同分布之间的匹配。跨模态原型匹配成本矩阵定义为:

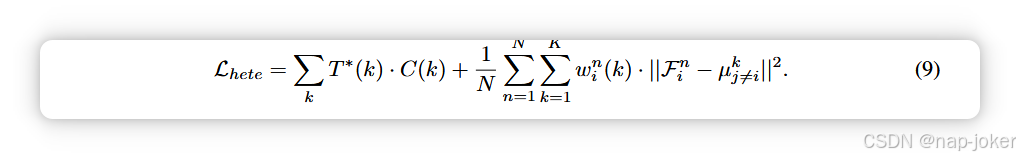

其中νi(ji)表示模态mi在其原型上的边际分布。结合通过最优传输实现全局比对和样品到原型校准实现局部比对,整体异质比对损失定义为:

第一个项LOT ,用于对齐原型在不同模态上的分布,确保一致性。第二项LP旋转通过最小化源模态i中样本xn i与目标模态j中原型之间的加权距离,确保细粒度比对。通过结合LOT和LP旋转,这种异质比对丢失同时捕捉了全局和局部关系,提供了在统一特征空间中对齐异质模态的稳健机制。

一致性对齐

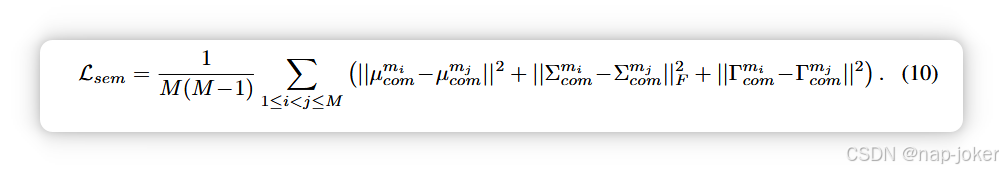

虽然不同的模态在表示上表现出独特的特征,但它们也共享传达相同语义信息的共同元素。为了有效揭示并对齐这些共享特征,必须解决模态独特变异及其分布中残留不一致所带来的固有挑战。 潜在空间语义对齐。为了解决模态-共同特征的全局偏移和语义不一致,并减轻特征融合过程中的信息扭曲,我们用高斯分布对模态特征分布进行了建模。通过将表示映射到潜在空间,我们通过均值、协方差和偏态量化位置、形状和对称性的差异,其中倾斜进一步被纳入以捕捉模态-共同特征分布中的不对称,使比对能够考虑非高斯语义变异并提升跨模态一致性。具体来说,对于模态-共同特征,其分布近似为Zcmoim ∼ N(μcmoim, Σcmoim, Γcmoim),其中μcmoim、Σcmoim和Γcmoim分别代表模态特征mi的共同特征的均值、协方差和偏态。其详细公式见附录B.6。为确保各模态间语义一致,我们定义潜在空间语义比对丢失为:

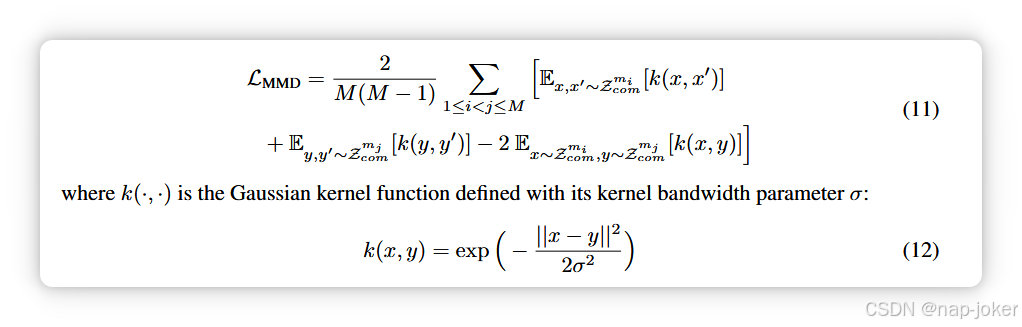

跨模态分布比对。为了灵活地建模由共享编码器提取的模态同质特征的潜在分布空间,而无需依赖先验知识,我们使用概率分布编码器(PDE)用于编码潜空间中的特征分布。概率分布编码器输出通过最大均值差异(MMD)指标进行比较,该指标通过将分布映射到重现核希尔伯特空间(RKHS)并测量其平均嵌入之间的差值来评估分布之间的距离。这种基于核的表述支持非参数建模,并在统一空间中捕捉高阶统计属性。跨模态分布的差异随后被量化为:

通过进行潜空间语义比对并基于MMD的分布修正,我们建立了一种层级同质性比对机制,有效实现模态-共同特征的语义和分布一致性。均匀比对的总体损失为Lhomo = Lsem + LMMD。

多模态融合与预测

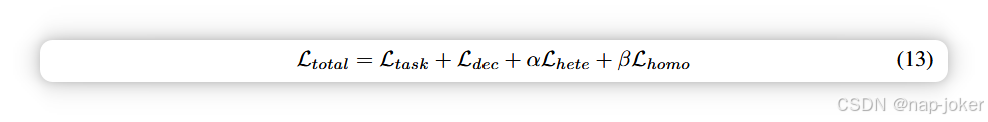

我们认识到多模态异构表示的独特特性------如语言中的句法结构、视觉中的空间布局以及音频中的时间模式------我们采用了模态特异性变换器(Tsai 等,2019)以增强全局时间和上下文建模。虽然先前的比对将模态独特特征置于语义一致的空间中,但这些表示仍包含丰富的模态内信息,需进一步细化。使用每个模态的不同变换器不会破坏比对,因为表示空间已被比对损耗正则化。相反,变压器作为模态感知的精炼器。它们的输出与模态共同特征串联,使共享语义和模态特定线索共同形成最终预测,最终预测由完全连通的层生成。我们框架的整体优化目标定义为:

其中Ltask表示任务特定的损失,例如分类任务中的交叉熵或回归的均方误差。α和β是异质和均匀比对损失的权衡超参数,其灵敏度见第4.3节分析。

实验

数据集与指标描述。我们在四个常见多模态数据集上评估DecAlign:CMU-MOSI(Zadeh 等,2016)、CMU-MOSEI(Zadeh 等,2018)、CH-SIMS(Yu 等,2020)和 IEMOCAP(Busso 等,2008)。对于CMU-MOSI和CMU-MOSEI,遵循之前的研究(梁等,2021;Li 等,2023;Zhou 等,2025),我们使用二进制准确率(Acc-2)、七类准确率(Acc-7)和二进制 F1 评分来评估性能。Acc-2 反映样本是否被预测为负值,而情绪强度预测则通过平均绝对误差(MAE)和皮尔逊相关(Corr)进一步评估,以捕捉偏差和线性性。对于CH-SIMS,我们采用MAE和F1评分。IEMOCAP如下(Lian等,2023;Fu 等,2024;Zhang 等人,2024)采用加权准确率(WAcc)和加权平均 F1 分数(WAF1),以考虑类别分布不平衡。详细的数据集和度量描述见附录B。

**实施细节。**与以往研究一致(Li 等,2023;我们使用MMSA-FET工具包(Yu等,2021)在除IEMOCAP数据集外的所有数据集上进行特征提取,IEMOCAP遵循先前代表性工作中描述的预处理程序(Lian等,2023)。我们用 Adam 优化器在 NVIDIA A6000 上训练 50 个纪元的 DecAlign,批次大小为 32。关于超参数设置的更多细节见附录B.3,特征提取详见附录B.4。

对比分析(扩展版见附录C)

我们将DecAlign与一系列最先进的方法在统一的实验环境和一致的数据集分割下进行比较。这些基线包括MFM(Tsai等,2018)、MulT(Tsai等,2019)、PMR(Fan等,2023)、CubeMLP(Sun等,2022)、MUTA-Net(Tang等,2023)、MISA(Hazarika等,2020)、CENet(Wang等,2022a)、Self-MM(Yu等,2021)、FDMER(Yang等,2022)、AOBERT(Kim 和Park,2023)、DMD(Li等, 2022), 2023年)、ReconBoost(Hua 等,2024年)和CGGM(Guo 等,2025年)。表1、5、6、7连同图1,全面比较了我们的DecAlign框架与四个广泛使用数据集上13种最先进方法。为了考虑统计显著性并减少随机性的影响,DecAlign报告的表现在五次独立运行中进行平均值。比较显示,DecAlign在捕捉连续目标值的细微变化方面表现出更强的能力,并且在离散类别之间能更精确地区分。其在多样化数据集中的稳定表现表明其在多模态数据中建模连续和分类模式的能力增强,反映了对复杂跨模态交互的更全面理解。

**基于Transformer的方法。**与依赖交叉注意力机制实现全局特征融合的基于Transformer的方法如MulT(Tsai等,2019)、Self-MM(Yu等,2021)、PMR(Fan等,2023)和MUTA-Net(Tang等,2023)相比,DecAlign克服了模态唯一干扰和局部语义不一致的问题。基于Transformer的模型假设存在共享的潜在空间,常常导致主导模态压倒较弱模态,导致信息丢失。相比之下,DecAlign 明确区分模态异质和模态同质特征,利用基于原型的最优运输实现细粒度比对和潜空间语义比对,并结合 MMD 正则化实现全局一致性。这减少了模态干扰,降低了MAE并改善了Corr,同时提升了分类性能。

基于解耦的特征方法。虽然多模态特征解耦方法如MISA(Hazarika等,2020)、FDMER(Yang等,2022)和DMD(Li等,2023)缓解了模态干扰,但它们主要关注全局对齐,常忽略令牌层级的不一致。这一限制阻碍了细粒度多模态集成,尤其是在需要精确语义融合的任务中。DecAlign通过双流层级对齐策略克服了这一挑战,将基于原型的传输用于局部对齐,同时通过语义一致性约束实现稳健的全局整合。这使得多模态表示更具表现力,从而在回归和分类指标上实现更优异的性能。

混淆矩阵分析。为了进一步证明我们性能的优越性并验证所提方法的有效性,我们分析了DecAlign的混淆矩阵与多模态情感分析领域的代表性研究,包括MulT(Tsai等,2019)、MISA(Hazarika等,2020)和DMD(Li等,2023)。如图3所示,DecAlign在不同情感强度层级下实现了更平衡和准确的情感分类,显著减少了误认错误,尤其是在区分细微情绪差异方面。 与其他方法相比,DecAlign表现出更强的对角线优势,反映出更高的情感分类准确性。值得注意的是,在极端情感类别(-3和+3)中,现有模型常常误分类样本,DecAlign显著减少了与相邻情感层级的混淆。在中等情绪类别(-1、0和1)中正确预测样本的较高集中度,进一步展示了其捕捉细致情感差异的能力,从而减轻对中性或极端标签的偏见。此外,与MulT、MISA和DMD在负向中性误识别问题上难以应对不同,DecAlign实现了情感类别间更清晰的分离,确保预测更稳健且可理解。这一改进在-2和+2类中尤为明显,DecAlign最大限度地减少了对相邻类别的误认,验证了其层级对齐策略在捕捉模态独特细微差别和共享语义模式方面的有效性。

消融研究

为进一步评估DecAlign中各成分的贡献,我们在MOSI和MOSEI数据集上进行消融研究,其他基准测试的结果见附录。第一项研究考察了关键模型组件的影响,而第二项则关注特定对齐策略的有效性。 关键组成部分的影响。我们评估了多模态特征解耦(MFD)、异质(Hete)和同质(Homo)比对对模型性能的影响,利用MAE进行分析以及二元F1评分(见表2)。完整模型能获得最佳结果,证实层级对齐的重要性。去除同质比对略微增加MAE并降低Acc-2,表明模态内一致性的重要性。消除异质比对会导致更大的下降,表明模态唯一干扰会影响特征整合。缺乏这两种比对会导致性能大幅下降,凸显了需要区分模态同质和模态异质特征。 此外,图4(a)-(d)可视化了不同情感类别的消融结果,展示了异质和均质对齐模块冻结时性能差异。跨情感类别的退化进一步验证了层级对齐策略在多样情绪表达中保持强劲表现的必要性。值得注意的是,即使禁用任何单一比对模块,F1 分数仍高于包括FDMER、AOBERT和DMD在内的多种先进方法,展示了我们提出的比对方法在异质和同质视角下的有效性。最严重的性能下降发生在移除MFD时,这表明在融合前保持模态独特信息至关重要。这凸显了整合异质和同质表示以实现更好情感分析的有效性。

特定对齐策略的影响。我们还进一步评估基于原型的最优传输(Proto-OT)、对比训练(CT)、语义一致性(Sem)和最大平均差(MMD)正则化对DecAlign性能的贡献,如表2所示。去除MMD正则化会导致性能略有下降,凸显其在全局潜空间对齐和特征一致性中的作用。语义一致性的排除进一步降低了性能,表明强制语义对齐增强了多模态特征的整合。当对比训练被移除时,下降最显著,显示出其在学习判别性多模态表示中的关键作用。同样,消除原始OT会导致回归和分类指标显著下降,表明通过最优传输实现细粒度比对显著提升多模协作预测性能。 模态差距分析。图4(e)-(h)展示了视觉和语言模态的案例研究,展示了DecAlign如何缩小模态差距以提升对齐。无异质或均质比对的模型间隙显著较大,阻碍跨模态融合。这些结果进一步验证了我们分层对齐策略的有效性。扩展分析内容见附录C.4。

参数敏感性分析

为分析超参数α和β对DecAlign的影响,我们进行了广泛的网格搜索,并评估模型在MOSI和MOSEI数据集上不同参数设置下的二元F1评分。图5展示了结果的热图可视化,深色表示性能较高。最优设置为α = 0.05,β = 0.05,实现两个数据集中最高的性能。较大的数值会导致性能急剧下降,表明过度的对齐约束会阻碍有效的融合。较小的α值和适中的β能带来强劲的性能,凸显了基于原型的对齐与语义一致性之间的平衡对于实现最佳多模态学习的重要性。

总结

我们介绍了DecAlign,一种用于解耦多模态表示学习的分层框架,能够分别对齐模态独特和模态共同特征。通过原型引导的最优传输和潜在语义比对,我们的方法捕捉了不同模态的全局分布和局部语义。多个基准测试验证了其有效性。