一个很有意思的类比。

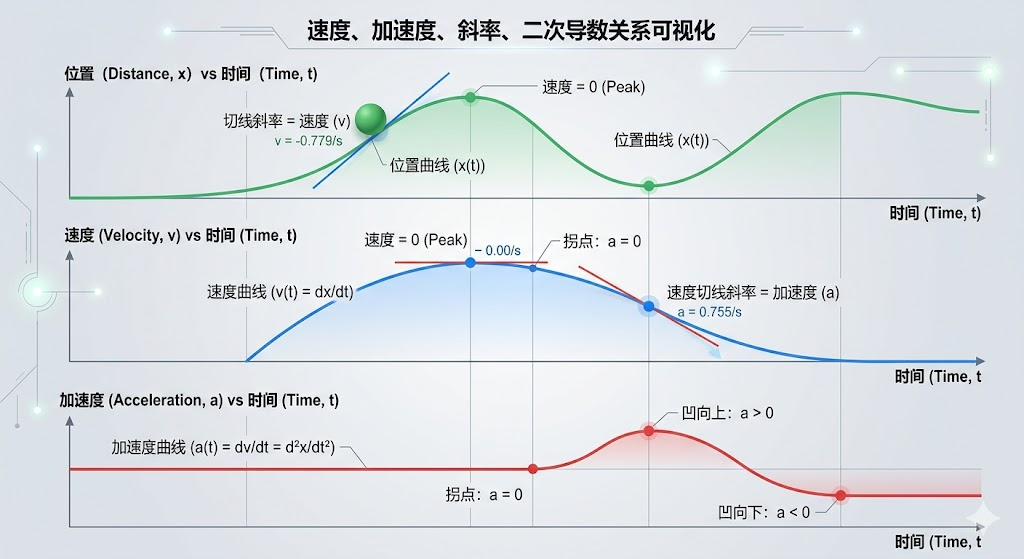

下面图片第一行子图显示的是位置关于时间的函数关系,记为 loc = fun(time). 第二个子图表示fun的导数,也即是速度关于时间的函数;第三个子图表示加速度关于时间的函数,即fun的二次导数。

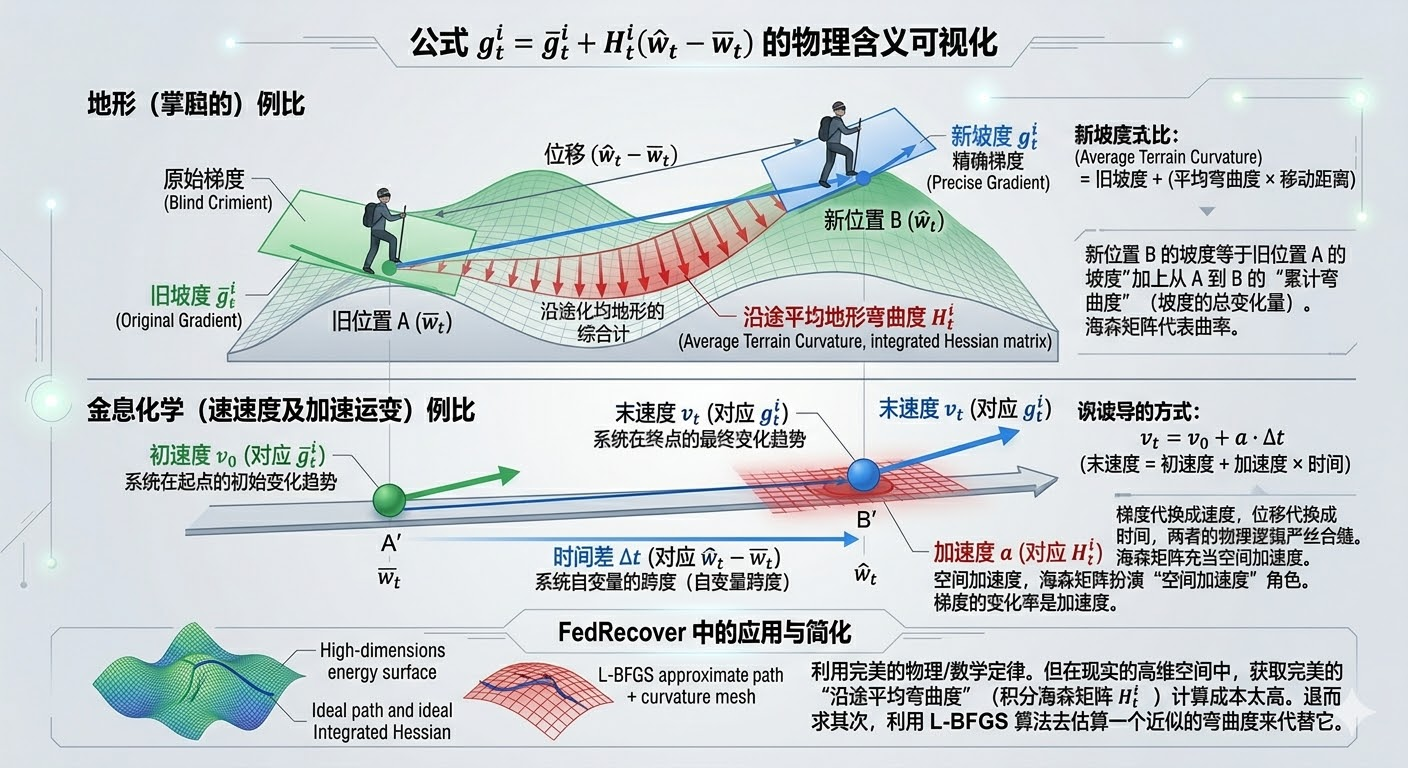

我们通过类比来学习下面的内容,先给出图片:

在上图中,x轴是关于时间的,而在下图中,x轴是关于w的。也即是深度学习模型的参数,使用w表示。那么,参数w的梯度则表示为g。H表示积分海森矩阵,类比于上面图片中的加速度。

这样就容易理解下面这个公式:

gti=g‾ti+Hti(w^t−w‾t)g_{t}^{i}=\overline{g}{t}^{i}+H{t}^{i}(\hat{w}{t}-\overline{w}{t})gti=gti+Hti(w^t−wt)

的物理含义,我们可以借助"地形学(爬山)"或者"基础物理(运动学)"**来进行最直观的类比。

这个公式其实来源于微积分中的柯西中值定理的积分形式(Cauchy mean value theorem) 。它描述的是:当一个系统从状态 A 移动到状态 B 时,它的一阶状态量(梯度)到底发生了多少改变 。

- 地形学类比:在连绵起伏的山上预测坡度

想象你是一个正在登山的盲人,你的目标是寻找山谷(极小值)。

w‾t\overline{w}_{t}wt(旧位置 A):这是你昨天站的地方(原始的全局模型)。

g‾ti\overline{g}_{t}^{i}gti(旧坡度):昨天站在 A 点时,你用脚探出来的地面的倾斜程度(原始模型更新/梯度) 。

w^t\hat{w}_{t}w^t(新位置 B):今天你往前走了一段距离,来到了新位置 B(恢复的全局模型)。

(w^t−w‾t)(\hat{w}{t}-\overline{w}{t})(w^t−wt)(位移):你从 A 点走到 B 点所跨越的相对向量距离 。

HtiH_{t}^{i}Hti(沿途的平均地形弯曲度):这是积分海森矩阵(Integrated Hessian matrix) 。海森矩阵代表的是曲率(坡度变化的快慢)。因为从 A 走到 B 的路上,地面的弯曲程度一直在变,所以 HtiH_{t}^{i}Hti 代表的是你走过的这条直线上,地形弯曲程度的**"平均累积值"** 。

gtig_{t}^{i}gti(新坡度):今天站在 B 点时,你脚下真正的倾斜程度(精确模型更新/梯度) 。

【物理公式化翻译】:

你在新位置 B 的坡度(gtig_{t}^{i}gti),完全等于你在旧位置 A 的坡度(g‾ti\overline{g}{t}^{i}gti),加上这段路程中坡度的总变化量。而"坡度的总变化量",正是由**"沿途的平均弯曲度(HtiH{t}^{i}Hti)"乘以"你走过的距离(位移)"**得来的 。

新坡度=旧坡度+(平均弯曲度×移动距离)\text{新坡度} = \text{旧坡度} + (\text{平均弯曲度} \times \text{移动距离})新坡度=旧坡度+(平均弯曲度×移动距离)

- 运动学类比:中学物理的速度与加速度

如果你觉得山坡的曲率有些抽象,我们完全可以把它等价代换成高中物理中最基础的直线运动学公式。

回想一下匀变速直线运动的速度公式:

vt=v0+a⋅Δtv_t = v_0 + a \cdot \Delta tvt=v0+a⋅Δt

(末速度 = 初速度 + 加速度 ×\times× 时间)

在神经网络优化的物理空间里,位移代替了时间,空间导数代替了时间导数,两者的物理逻辑严丝合缝:

g‾ti\overline{g}_{t}^{i}gti 对应 初速度 v0v_0v0:系统在起点的初始变化趋势。

gtig_{t}^{i}gti 对应 末速度 vtv_tvt:系统在终点的最终变化趋势。

(w^t−w‾t)(\hat{w}{t}-\overline{w}{t})(w^t−wt) 对应 时间差 Δt\Delta tΔt:系统自变量的跨度。

HtiH_{t}^{i}Hti 对应 加速度 aaa:在这里,海森矩阵扮演了"空间加速度"的角色。速度的变化率是加速度,而梯度的变化率就是海森矩阵。

积分海森矩阵

定义为:

Hti=∫01∇2f(w‾t+z(w^t−w‾t))dzH_{t}^{i} = \int_{0}^{1} \nabla^2 f(\overline{w}{t} + z(\hat{w}{t} - \overline{w}_{t})) dzHti=∫01∇2f(wt+z(w^t−wt))dz

看到这个公式觉得有点头大是非常正常的!它之所以看起来吓人,是因为它把矩阵(Matrix) 、**微积分(Calculus)和向量空间直线几何(Vector Geometry)**糅合在了一起。

但如果我们把它像剥洋葱一样一层层拆开,你会发现它其实只是在用数学语言描述一个非常简单的动作:"沿着两点之间的直线走,边走边测弯曲度,最后算个平均值。"

cite_start这也是论文中为了使多维空间下的柯西中值定理成立,而给出的积分海森矩阵的严格数学定义 cite: 237。

我们把公式 Hti=∫01∇2f(w‾t+z(w^t−w‾t))dzH_{t}^{i} = \int_{0}^{1} \nabla^2 f(\overline{w}{t} + z(\hat{w}{t} - \overline{w}_{t})) dzHti=∫01∇2f(wt+z(w^t−wt))dz 拆分成三个核心部件来理解:

第一步:确定路线 ------ 进度条 zzz

看公式括号里最里面的部分:w‾t+z(w^t−w‾t)\overline{w}{t} + z(\hat{w}{t} - \overline{w}_{t})wt+z(w^t−wt)

在高维向量空间中,这就是一条线段的标准参数方程。

- w‾t\overline{w}_{t}wt 是起点(上次算出的旧模型参数)。

- w^t\hat{w}_{t}w^t 是终点(本次估算出的新模型参数)。

- (w^t−w‾t)(\hat{w}{t} - \overline{w}{t})(w^t−wt) 是从起点指向终点的方向向量(位移)。

参数 zzz 就是一个"进度条"。

- 当进度 z=0z = 0z=0 时,位置算出来是 w‾t\overline{w}_{t}wt(你在起点)。

- 当进度 z=1z = 1z=1 时,位置算出来是 w^t\hat{w}_{t}w^t(你到达了终点)。

- 当进度 z=0.5z = 0.5z=0.5 时,你在两点的正中间。

所以,这部分的作用就是:死死锁定从旧模型到新模型之间的那条笔直的捷径,并在上面移动。

第二步:沿途采样 ------ 测高仪 ∇2f(... )\nabla^2 f(\dots)∇2f(...)

接着往外看一层:∇2f(位置)\nabla^2 f(\text{位置})∇2f(位置)

- ∇2f\nabla^2 f∇2f 是标准的 Hessian 矩阵算子,代表某一个特定点脚下的"局部曲率"(地面的弯曲程度)。

- 把它和第一步结合起来,意思就是:当你沿着直线走,当进度条走到 zzz 时,你停下来,拿仪器精准测量一下你脚下这个点的 Hessian 矩阵。

因为地势是不断起伏的,所以随着进度条 zzz 从 0 滑到 1,你测量出来的 Hessian 矩阵也在不断发生变化。

第三步:总结平均值 ------ 积分算子 ∫01...dz\int_{0}^{1} \dots dz∫01...dz

最后看最外层:∫01(进度为 z 时的曲率)dz\int_{0}^{1} (\text{进度为 } z \text{ 时的曲率}) dz∫01(进度为 z 时的曲率)dz

如果你在走这段路时,每隔极短的距离(dzdzdz)就测一次曲率,然后把所有的测量结果累加起来,这就是积分的物理意义。

因为你的进度条 zzz 的总跨度正好是 (1−0)=1(1 - 0) = 1(1−0)=1,所以对 zzz 从 0 到 1 求定积分,在数学上刚好等于求这无穷多个测量值的连续平均值(Continuous Average)。

大白话总结

这个复杂的公式翻译成人类语言就是:

"为了知道从旧模型 w‾t\overline{w}{t}wt 移动到新模型 w^t\hat{w}{t}w^t 后梯度发生了多大变化,我们让一个虚拟小人沿着两点间的直线走过去(进度由 zzz 控制)。小人一路上无间断地测量脚下的局部 Hessian 矩阵 ∇2f\nabla^2 f∇2f,走到终点后,把这一路上的所有测量结果取一个平均值 ,这个平均矩阵就是 HtiH_{t}^{i}Hti。"

理解了这个公式,你就彻底懂了论文中 FedRecover 的理论基础:梯度的变化量 = 沿途平均曲率 ×\times× 位移。

但现实很骨感:对一个拥有上千万参数的神经网络做这种多维空间的路径积分,即使是超级计算机也会瞬间宕机。需要利用类似 L-BFGS 技术,不需要任何积分运算,就能直接"猜"出这个公式的结果。

在理想状态下(即函数是连续可微的 ),这个公式没有任何魔法,它只是在陈述一个极其朴素的物理事实:事物当前的状态(新梯度),等于它过去的状态(旧梯度),加上在此期间环境施加的累积改变效应(曲率 ×\times× 位移)。

在 FedRecover 论文中,作者正是试图利用这个完美的物理/数学定律。只不过在现实的高维空间中,获取完美的"沿途平均弯曲度"(积分海森矩阵 HtiH_{t}^{i}Hti)计算成本太高 ,所以他们才需要退而求其次,利用 L-BFGS 算法去估算一个近似的弯曲度来代替它 。