Windows 环境下 OpenClaw 的安装与千问Qwen、Kimi、MiniMax、GLM 大模型配置完全指南

OpenClaw 作为开源 AI 智能体平台,支持接入国内外主流大模型。本文详解 Windows 系统下的完整安装流程,并手把手配置四大国产大模型:阿里通义千问 Qwen、月之暗面 Kimi、MiniMax、智谱 GLM。

📋 目录

- [一、OpenClaw 简介与环境准备](#一、OpenClaw 简介与环境准备)

- [二、Windows 环境安装 OpenClaw](#二、Windows 环境安装 OpenClaw)

- [三、千问 Qwen 大模型配置](#三、千问 Qwen 大模型配置)

- [四、Kimi 大模型配置](#四、Kimi 大模型配置)

- [五、MiniMax 大模型配置](#五、MiniMax 大模型配置)

- [六、智谱 GLM 大模型配置](#六、智谱 GLM 大模型配置)

- 七、多模型路由与负载均衡

- 八、常见问题与故障排查

一、OpenClaw 简介与环境准备

1.1 什么是 OpenClaw?

OpenClaw 是新一代开源 AI Agent 开发框架,核心特性包括:

| 特性 | 说明 |

|---|---|

| 多模型支持 | 原生支持 100+ 大模型,包括 GPT、Claude、Gemini 及国产模型 |

| MCP 协议 | 支持 Model Context Protocol,实现工具调用标准化 |

| Agent 编排 | 支持多 Agent 协作、工作流编排 |

| 插件生态 | 丰富的 Skills 库,支持钉钉、企微、飞书、微信接入 |

| 私有化部署 | 支持本地部署,数据不出域 |

1.2 环境要求

最低配置:

- Windows 10/11 64位

- Python 3.9+

- 8GB RAM

- 10GB 磁盘空间

推荐配置:

- Windows 11 64位

- Python 3.11

- 16GB+ RAM

- SSD 磁盘

1.3 前置依赖安装

powershell

# 1. 检查 Python 版本(需 3.9+)

python --version

# 2. 安装 Git(如未安装)

winget install Git.Git

# 3. 安装 Node.js(部分功能需要)

winget install OpenJS.NodeJS

# 4. 安装 Visual C++ Build Tools(编译依赖)

winget install Microsoft.VisualStudio.2022.BuildTools --override "--wait --quiet --add Microsoft.VisualStudio.Workload.VCTools"二、Windows 环境安装 OpenClaw

2.1 方式一:pip 安装(推荐)

powershell

# 创建虚拟环境(强烈推荐)

python -m venv openclaw_env

# 激活虚拟环境

.\openclaw_env\Scripts\Activate.ps1

# 安装 OpenClaw

pip install openclaw -U

# 验证安装

openclaw --version⚠️ 注意 :如果遇到权限问题,请以管理员身份运行 PowerShell,或添加 --user 参数。

2.2 方式二:Docker 安装(隔离性更好)

powershell

# 1. 安装 Docker Desktop

winget install Docker.DockerDesktop

# 2. 拉取 OpenClaw 镜像

docker pull openclaw/openclaw:latest

# 3. 运行容器

docker run -d `

--name openclaw `

-p 3000:3000 `

-v ${PWD}/data:/app/data `

-e OPENCLAW_API_KEY=your_api_key `

openclaw/openclaw:latest2.3 方式三:源码安装(开发者模式)

powershell

# 1. 克隆仓库

git clone https://github.com/openclaw/openclaw.git

cd openclaw

# 2. 安装依赖

pip install -e ".[dev]"

# 3. 构建前端(如需 Web UI)

cd web

npm install

npm run build

# 4. 启动服务

cd ..

openclaw server2.4 初始化配置

powershell

# 初始化配置文件

openclaw init

# 配置文件路径

# Windows: %USERPROFILE%\.openclaw\config.yaml

# Linux/macOS: ~/.openclaw/config.yaml基础配置示例:

yaml

# config.yaml

server:

host: 0.0.0.0

port: 3000

logging:

level: INFO

file: logs/openclaw.log

# 模型配置(后续章节详解)

models:

default: qwen-max

# 具体模型配置见下文...三、千问 Qwen 大模型配置

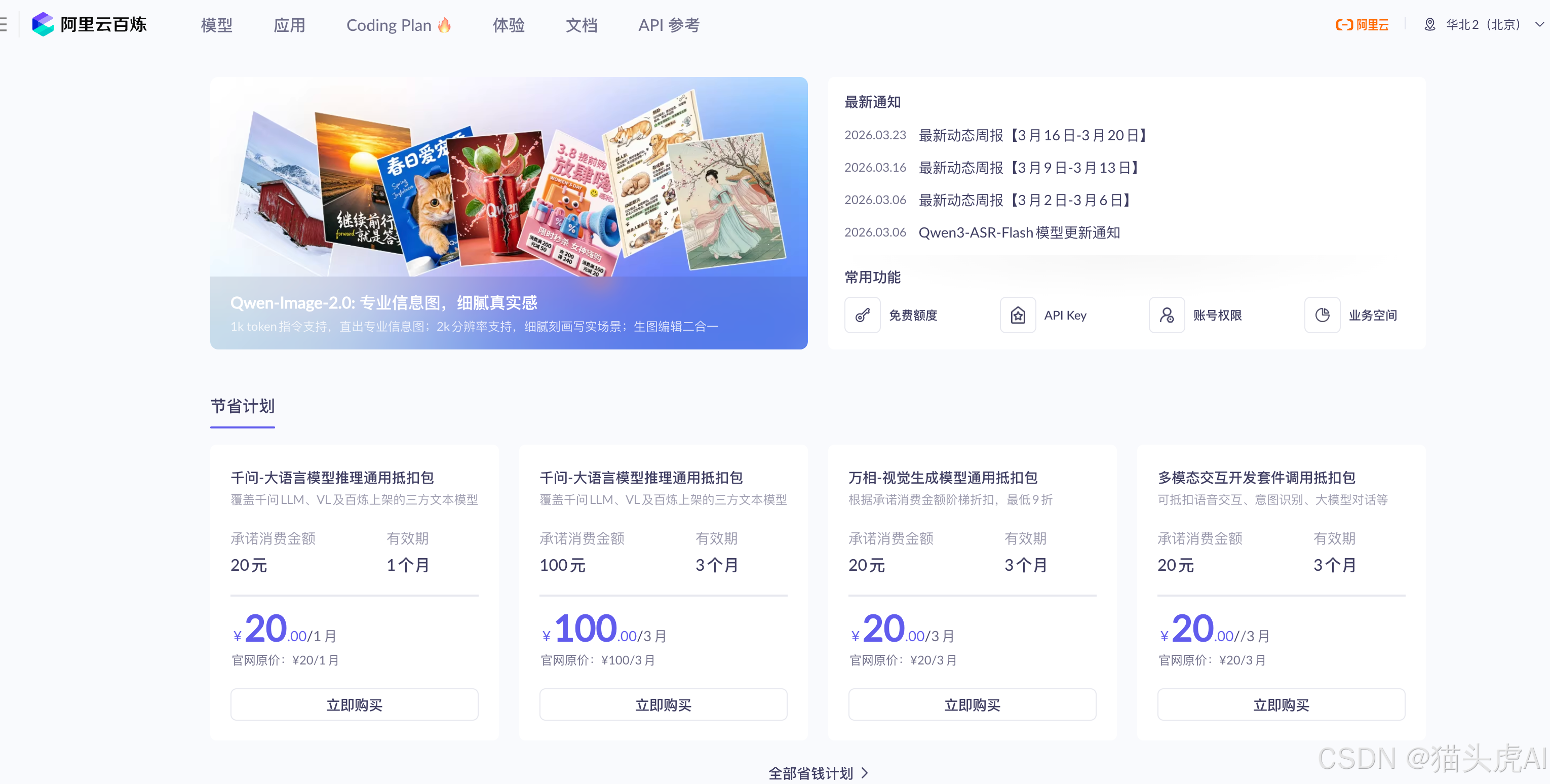

3.1 获取 API Key

- 访问 阿里云百炼平台

- 注册/登录阿里云账号

- 创建 API Key:

模型广场 → API Key 管理 → 创建新的 API Key

3.2 配置 Qwen 模型

编辑 config.yaml:

yaml

models:

qwen-max:

provider: aliyun

model_name: qwen-max

api_key: ${ALIYUN_API_KEY} # 环境变量引用

base_url: https://dashscope.aliyuncs.com/api/v1

temperature: 0.7

max_tokens: 4096

timeout: 60

qwen-plus:

provider: aliyun

model_name: qwen-plus

api_key: ${ALIYUN_API_KEY}

base_url: https://dashscope.aliyuncs.com/api/v1

qwen-turbo:

provider: aliyun

model_name: qwen-turbo

api_key: ${ALIYUN_API_KEY}

base_url: https://dashscope.aliyuncs.com/api/v13.3 设置环境变量

powershell

# PowerShell 临时设置(当前会话有效)

$env:ALIYUN_API_KEY = "sk-your-actual-api-key-here"

# 永久设置(用户级)

[Environment]::SetEnvironmentVariable("ALIYUN_API_KEY", "sk-your-actual-api-key-here", "User")

# 验证

echo $env:ALIYUN_API_KEY3.4 测试 Qwen 连接

powershell

# 使用 CLI 测试

openclaw chat --model qwen-max --message "你好,请介绍一下自己"

# 或使用 Python 脚本测试

openclaw test-model --model qwen-max预期输出:

json

{

"status": "success",

"model": "qwen-max",

"response": "你好!我是通义千问,由阿里云开发的大语言模型...",

"latency_ms": 850,

"tokens_used": 42

}3.5 Qwen 特有功能配置

yaml

# 启用 Qwen 的 Function Calling

models:

qwen-max:

provider: aliyun

model_name: qwen-max

api_key: ${ALIYUN_API_KEY}

capabilities:

- function_calling

- code_interpreter

- vision # 支持图片理解

# Qwen 特定参数

parameters:

enable_search: true # 启用联网搜索

response_format: text # 或 json_object四、Kimi 大模型配置

4.1 获取 API Key

- 访问 Moonshot AI 开放平台

- 注册账号并完成实名认证

- 创建 API Key:

API Key 管理 → 新建

注意:Kimi API 需要企业认证或个人实名认证,新用户有免费额度。

4.2 配置 Kimi 模型

yaml

models:

kimi-k2:

provider: moonshot

model_name: kimi-k2-72b

api_key: ${MOONSHOT_API_KEY}

base_url: https://api.moonshot.cn/v1

temperature: 0.7

max_tokens: 8192 # Kimi 支持长上下文

timeout: 120

kimi-k1.5:

provider: moonshot

model_name: kimi-k1.5-long

api_key: ${MOONSHOT_API_KEY}

base_url: https://api.moonshot.cn/v1

max_tokens: 32768 # 超长上下文版本4.3 环境变量设置

powershell

# PowerShell

$env:MOONSHOT_API_KEY = "sk-your-moonshot-api-key"

# 永久设置

[Environment]::SetEnvironmentVariable("MOONSHOT_API_KEY", "sk-your-moonshot-api-key", "User")4.4 Kimi 长上下文特性

Kimi 的核心优势是超长上下文窗口(最高 200 万字),配置时需注意:

yaml

models:

kimi-long-context:

provider: moonshot

model_name: kimi-k1.5-long

api_key: ${MOONSHOT_API_KEY}

# 长上下文优化参数

context_window: 200000 # 200K tokens

chunk_size: 4000 # 分块大小

overlap: 200 # 块间重叠

# 内存优化(Windows 需注意)

memory_management:

strategy: sliding_window

max_history: 104.5 测试 Kimi 连接

powershell

# 测试长文本理解

$longText = Get-Content -Path "long_article.txt" -Raw

openclaw chat --model kimi-k1.5 --message "请总结以下内容:$longText"五、MiniMax 大模型配置

5.1 获取 API Key

- 访问 MiniMax 开放平台

- 注册企业账号(MiniMax 主要面向企业用户)

- 创建应用并获取

Group ID和API Key

5.2 配置 MiniMax 模型

yaml

models:

minimax-text:

provider: minimax

model_name: abab6.5-chat

api_key: ${MINIMAX_API_KEY}

group_id: ${MINIMAX_GROUP_ID} # MiniMax 特有参数

base_url: https://api.minimax.chat/v1/text/chatcompletion_v2

temperature: 0.7

max_tokens: 4096

minimax-pro:

provider: minimax

model_name: abab6.5s-chat

api_key: ${MINIMAX_API_KEY}

group_id: ${MINIMAX_GROUP_ID}5.3 环境变量设置

powershell

# 需要设置两个变量

$env:MINIMAX_API_KEY = "your-minimax-api-key"

$env:MINIMAX_GROUP_ID = "your-group-id"

# 永久设置

[Environment]::SetEnvironmentVariable("MINIMAX_API_KEY", "your-minimax-api-key", "User")

[Environment]::SetEnvironmentVariable("MINIMAX_GROUP_ID", "your-group-id", "User")5.4 MiniMax 语音模型配置(可选)

MiniMax 的语音能力较强,如需使用 TTS:

yaml

models:

minimax-tts:

provider: minimax

model_type: tts

api_key: ${MINIMAX_API_KEY}

group_id: ${MINIMAX_GROUP_ID}

voice_id: "male-qn-qingse" # 音色选择

speed: 1.0

vol: 1.0

pitch: 0六、智谱 GLM 大模型配置

6.1 获取 API Key

- 访问 智谱 AI 开放平台

- 注册账号

- 创建 API Key:

API Keys → 添加新的 API Key

6.2 配置 GLM 模型

yaml

models:

glm-4-plus:

provider: zhipu

model_name: glm-4-plus

api_key: ${ZHIPU_API_KEY}

base_url: https://open.bigmodel.cn/api/paas/v4/

temperature: 0.7

max_tokens: 4096

timeout: 60

glm-4-air:

provider: zhipu

model_name: glm-4-air # 性价比版本

api_key: ${ZHIPU_API_KEY}

base_url: https://open.bigmodel.cn/api/paas/v4/

glm-4-flash:

provider: zhipu

model_name: glm-4-flash # 轻量高速版

api_key: ${ZHIPU_API_KEY}

base_url: https://open.bigmodel.cn/api/paas/v4/6.3 环境变量设置

powershell

$env:ZHIPU_API_KEY = "your-zhipu-api-key"

[Environment]::SetEnvironmentVariable("ZHIPU_API_KEY", "your-zhipu-api-key", "User")6.4 GLM 工具调用配置

GLM-4 支持 Function Calling,配置示例:

yaml

models:

glm-4-tool:

provider: zhipu

model_name: glm-4-plus

api_key: ${ZHIPU_API_KEY}

capabilities:

- function_calling

tools:

- name: get_weather

description: "获取指定城市的天气信息"

parameters:

type: object

properties:

city:

type: string

description: "城市名称"

required: ["city"]七、多模型路由与负载均衡

7.1 完整配置汇总

yaml

# config.yaml - 完整版

server:

host: 0.0.0.0

port: 3000

logging:

level: INFO

file: logs/openclaw.log

models:

# 默认模型

default: qwen-max

# 阿里通义千问

qwen-max:

provider: aliyun

model_name: qwen-max

api_key: ${ALIYUN_API_KEY}

base_url: https://dashscope.aliyuncs.com/api/v1

temperature: 0.7

max_tokens: 4096

qwen-plus:

provider: aliyun

model_name: qwen-plus

api_key: ${ALIYUN_API_KEY}

base_url: https://dashscope.aliyuncs.com/api/v1

# 月之暗面 Kimi

kimi-k2:

provider: moonshot

model_name: kimi-k2-72b

api_key: ${MOONSHOT_API_KEY}

base_url: https://api.moonshot.cn/v1

max_tokens: 8192

kimi-long:

provider: moonshot

model_name: kimi-k1.5-long

api_key: ${MOONSHOT_API_KEY}

base_url: https://api.moonshot.cn/v1

max_tokens: 32768

# MiniMax

minimax-pro:

provider: minimax

model_name: abab6.5-chat

api_key: ${MINIMAX_API_KEY}

group_id: ${MINIMAX_GROUP_ID}

base_url: https://api.minimax.chat/v1/text/chatcompletion_v2

# 智谱 GLM

glm-4-plus:

provider: zhipu

model_name: glm-4-plus

api_key: ${ZHIPU_API_KEY}

base_url: https://open.bigmodel.cn/api/paas/v4/

glm-4-air:

provider: zhipu

model_name: glm-4-air

api_key: ${ZHIPU_API_KEY}

base_url: https://open.bigmodel.cn/api/paas/v4/

# 路由策略

routing:

strategy: weighted_round_robin # 加权轮询

fallback: true # 故障转移

rules:

# 代码任务 -> Qwen

- condition: "task_type == 'coding'"

models: ["qwen-max", "qwen-plus"]

weights: [0.7, 0.3]

# 长文本 -> Kimi

- condition: "input_length > 8000"

models: ["kimi-long", "kimi-k2"]

weights: [0.8, 0.2]

# 默认 -> 均衡负载

- condition: "default"

models: ["qwen-max", "kimi-k2", "glm-4-plus"]

weights: [0.4, 0.3, 0.3]7.2 路由策略说明

| 策略 | 说明 | 适用场景 |

|---|---|---|

round_robin |

简单轮询 | 模型能力相近,均匀分配 |

weighted_round_robin |

加权轮询 | 按模型能力/成本分配权重 |

latency_based |

延迟优先 | 选择响应最快的模型 |

cost_based |

成本优先 | 选择价格最低的模型 |

quality_based |

质量优先 | 根据任务类型选择最佳模型 |

7.3 故障转移配置

yaml

routing:

fallback: true

fallback_order:

- qwen-max

- kimi-k2

- glm-4-plus

- qwen-plus

health_check:

interval: 30 # 每30秒检查一次

timeout: 5 # 超时5秒视为故障

failures_threshold: 3 # 连续3次失败则标记为故障八、常见问题与故障排查

8.1 安装问题

Q: pip 安装时报错 Microsoft Visual C++ 14.0 is required

powershell

# 解决方案:安装 Build Tools

winget install Microsoft.VisualStudio.2022.BuildTools --override "--wait --quiet --add Microsoft.VisualStudio.Workload.VCTools"

# 或下载离线包

# https://visualstudio.microsoft.com/visual-cpp-build-tools/Q: PowerShell 执行策略限制

powershell

# 错误:无法加载脚本,因为在此系统上禁止运行脚本

# 解决方案(以管理员身份运行)

Set-ExecutionPolicy -ExecutionPolicy RemoteSigned -Scope CurrentUser8.2 模型连接问题

Q: 测试连接时报 401 Unauthorized

powershell

# 检查 API Key 是否正确设置

echo $env:ALIYUN_API_KEY

# 检查配置文件中的环境变量引用格式

# 正确:${ALIYUN_API_KEY}

# 错误:$ALIYUN_API_KEY 或 %ALIYUN_API_KEY%Q: Kimi 提示 insufficient_quota

- 检查账户是否完成实名认证

- 查看额度使用情况:https://platform.moonshot.cn/

- 新用户有免费额度,用完需充值

Q: MiniMax 提示 group_id not found

- MiniMax 必须配置

group_id,不只是api_key - 在 MiniMax 平台创建应用时获取 Group ID

8.3 性能优化(Windows 特有问题)

Q: 高并发时内存占用过高

yaml

# 在 config.yaml 中添加内存限制

server:

max_workers: 4 # 限制工作进程数

max_connections: 100 # 限制最大连接数

memory:

max_cache_size: 512MB # 限制缓存大小

gc_interval: 300 # 每5分钟强制GCQ: Windows 下长文本处理卡顿

powershell

# 增加 Python 递归限制(PowerShell)

$env:PYTHONRECURSIONLIMIT = "10000"

# 或在代码中设置

python -c "import sys; sys.setrecursionlimit(10000)"8.4 调试命令汇总

powershell

# 查看详细日志

openclaw server --log-level debug

# 测试特定模型

openclaw test-model --model qwen-max --verbose

# 检查配置文件语法

openclaw config validate

# 查看已加载的模型

openclaw model list

# 实时监控模型调用

openclaw monitor --model all九、总结

本文详细介绍了 Windows 环境下 OpenClaw 的安装与四大国产大模型的配置方法:

| 模型 | 提供商 | 核心优势 | 适用场景 |

|---|---|---|---|

| Qwen | 阿里云 | 功能全面、中文优化好 | 通用任务、代码生成 |

| Kimi | Moonshot | 超长上下文(200万字) | 长文档分析、多轮对话 |

| MiniMax | MiniMax | 语音能力强、企业级 | 多模态应用、企业部署 |

| GLM | 智谱AI | 工具调用强、性价比高 | Agent开发、Function Calling |

关键配置要点:

- 环境变量是 Windows 配置的核心,注意 PowerShell 与 CMD 的语法差异

- 长上下文模型 (如 Kimi)需要调整

max_tokens和超时设置 - 路由策略可以显著提升系统稳定性和成本效益

- 故障转移配置确保服务高可用

参考链接:

版权声明: 本文为技术分享,转载请注明出处。模型 API 使用请遵守各平台服务条款。