多模态模型是怎么能中英文自动切换的

- 多模态模型实现中英文自动切换,核心是多语言预训练的语义对齐 + 语言检测与标记引导 + 跨模态特征统一 + 上下文感知的动态生成,四步协同让模型能无缝识别、理解并切换中英文,同时保持跨模态语义一致。

多模态模型的中英文自动切换,并非依赖单一模块,而是由6个核心模块协同运作,覆盖"语言识别→语义对齐→特征融合→生成控制→上下文维护→跨模态联动"全流程,同时结合多语言预训练的底层能力实现无缝切换。以下是模块拆解与核心逻辑:

核心模块与分工(按流程排序)

|-----------------|------------------------------------|-------------------------------------------------------|----------------------------------------|

| 模块 | 核心作用 | 关键实现 | 典型工具/组件 |

| 1. 语言检测(LID)模块 | 输入侧识别中英文,输出语言标记(如[ZH]/[EN]) | 显式:CLD3、fastText轻量检测器;隐式:靠词表分布/字符特征(如汉字无空格、英文有空格)自动判断 | Qwen的LID子模块、CLIP的文本预处理层 |

| 2. 多语言嵌入/词表模块 | 把中英文词汇转为统一语义空间的向量,实现"苹果"与"apple"对齐 | 多语言词表(如SentencePiece/BPE)+ 可学习的语言嵌入;双语对比学习拉近距离 | LLaMA 3的词表、Qwen-Omni的嵌入层 |

| 3. 跨语言语义对齐模块 | 保障跨语言/跨模态语义一致(如猫图与"猫""cat"同空间) | 图文对比(CLIP/BLIP)、掩码语言建模(MLM),用双语平行语料/图文对训练 | YouCLIP的三阶段对齐层、BLIP的交叉注意力层 |

| 4. 语言控制与生成模块 | 按指令/标记生成目标语言,控制解码路径 | 语言控制token([ZH]/[EN])、指令微调(SFT)、门控机制分配语言特征权重 | Qwen3的Thinker模块、GPT - 4的解码控制器 |

| 5. 上下文追踪(DST)模块 | 多轮对话中保持语言一致,维护术语/指代统一 | 长上下文窗口记录语言状态,对话状态表跟踪用户语言偏好 | 多模态对话模型的上下文缓存层 |

| 6. 跨模态融合模块 | 视觉/语音特征与中英文文本特征对齐,避免模态错位 | 跨模态注意力(如ViT+LLM的交叉注意力),联合优化图文/语音 - 文本对 | CogVLM的多模态融合层、Qwen3 - Omni的OmniFusion层 |

二、核心实现逻辑(模块协同流程)

-

输入识别与标记:LID模块检测输入是中文/英文/混合(如"我爱吃apple"),输出语言标记,传入后续模块。

-

语义与特征对齐:多语言嵌入模块把中英文转为向量,对齐模块通过预训练让同一概念的双语向量近邻;融合模块让视觉(如猫图)与两种语言文本对齐。

-

生成与切换控制:语言控制模块根据标记/指令(如"用英文回答")选择解码路径,门控机制动态分配双语特征权重,生成目标语言文本。

-

上下文一致性维护:DST模块记录对话历史的语言状态,确保用户中文提问→英文追问时,回复与当前提问语言一致,术语(如Transformer)不随意切换译法。

-

跨模态联动(如语音/图像场景):融合模块让语音ASR识别的中文,与文本生成的英文对齐;或图像特征同时适配中英文描述,保障跨模态语义统一。

三、底层保障:多语言预训练(模块能工作的前提)

模型在mC4、CC100等海量双语语料上预训练,通过MLM、句对匹配等任务掌握中英文规律;多模态模型还会用图文对(如猫图+"猫"/"cat")训练,让视觉特征与双语文本绑定------这是模块能"懂双语、对齐语义"的基础。

四、关键补充:微调强化切换稳定性

-

双语指令微调(SFT):用"中文问+中文答""英文问+英文答""中文问+英文答"数据,让模型理解切换意图。

-

代码切换数据训练:用"我喜欢cat"这类混合句训练,提升句子内语言切换的稳健性。

核心总结

中英文自动切换是**"多模块协同 + 多语言预训练"**的结果:LID找语言、嵌入层转向量、对齐层拉语义、控制模块定生成、DST保一致、融合模块联模态,最终实现无缝切换。

需要我给你一个中英文切换的端到端推理示例(含输入输出、模块调用顺序、语言标记与特征对齐步骤)吗?

clip 能做 图片+中文匹配, 图片+英文匹配

CLIP 能实现图片 + 中文匹配、图片 + 英文匹配,但原版仅原生支持英文,中文匹配需依赖多语言扩展版本(如 MetaCLIP、OpenCLIP 多语言版、YouCLIP 等),核心是通过图文向量对齐与多语言适配达成。以下是核心逻辑与实现方式:

|-----------------------------------|--------------|--------------------------------|-------------------------------|

| 模型版本 | 图片 + 英文匹配 | 图片 + 中文匹配 | 实现关键 |

| OpenAI 原版 CLIP | ✅ 原生支持,性能最佳 | ❌ 不支持(词表无中文 token,文本编码器仅英文预训练) | 英文图文对预训练,BPE 分词器仅适配英文 |

| 多语言扩展版(MetaCLIP/OpenCLIP/YouCLIP) | ✅ 支持(兼容原版能力) | ✅ 支持(通过双语微调 / 嵌入对齐实现) | 多语言分词器 + 双语图文对预训练 / 微调,语义空间对齐 |

blip,blip2呢 能做 图片+中文匹配, 图片+英文匹配

BLIP 与 BLIP - 2 均能实现图片+中文匹配、图片+英文匹配,但原版原生以英文为主,中文匹配需依赖多语言适配的权重或微调版本,核心靠文本编码器(BLIP)、Q - Former + 多语言 LLM(BLIP - 2)实现跨语言图文对齐。以下是详细说明:

- 一、核心能力与版本差异

|------------------------------------------------------|----------------------------------------------|-----------------------------------|------------------------------------|

| 模型版本 | 图片+英文匹配 | 图片+中文匹配 | 核心依赖 |

| BLIP 原版 | ✅ 原生支持(英文图文对预训练,BERT 类文本编码器适配英文) | ❌ 原生不支持(词表/预训练无中文适配) | 文本编码器+跨模态对比/匹配损失,对齐英文文本与图像特征 |

| BLIP - 2 原版 | ✅ 原生支持(Q - Former 对齐冻结图像编码器与英文 LLM 如 FlanT5) | ❌ 原生不支持(LLM 与 Q - Former 均为英文预训练) | Q - Former 作为桥梁,连接视觉特征与英文 LLM 语义空间 |

| 多语言适配版(如 Chinese - BLIP/BLIP - 2、Hugging Face 多语言权重) | ✅ 支持(兼容英文能力) | ✅ 支持(双语微调/多语言 LLM 替换) | 替换多语言分词器+双语图文对微调 Q - Former/文本编码器 |

-

二、关键模块与实现原理

-

- BLIP(统一视觉 - 语言架构)

BLIP 无独立"语言切换模块",多语言匹配依赖文本编码器与预训练数据:

-

核心模块(图文匹配相关)

-

图像编码器(ViT):提取视觉特征,与语言无关,可直接复用。

-

文本编码器(单模态编码器 + 图像关联文本编码器):原版用英文 BPE 分词器与词表,仅能处理英文;要支持中文,需替换为 SentencePiece 等多语言分词器,并用中英双语图文对微调,对齐中文文本与图像/英文文本的语义空间。

-

跨模态对齐损失(ITC/ITM):通过对比损失让正样本图文对特征更接近,匹配损失判断图文是否匹配,为中文匹配提供训练目标。

-

-

中文匹配实现:替换多语言分词器+扩充词表,用"猫图 + 猫/cat"这类双语图文对微调文本编码器,使中文文本嵌入与图像/英文文本嵌入在同一语义空间对齐。

-

- BLIP - 2(Q - Former + 冻结 LLM 架构)

BLIP - 2 的多语言能力由 Q - Former 与 LLM 共同决定,Q - Former 是跨模态对齐核心,LLM 决定语言覆盖范围:

-

核心模块(图文匹配相关)

-

冻结图像编码器(ViT - L/g 等):提取视觉特征,与语言无关。

-

Q - Former(核心跨模态模块):可训练的查询转换器,负责压缩视觉特征并与文本语义对齐;预训练时用 ITC/ITM/ITG 损失学习图文关联,双语微调后能适配中文文本与视觉特征的绑定。

-

冻结 LLM(如 FlanT5、OPT):原版为英文 LLM;要支持中文,需替换为多语言 LLM(如 mT5、多语言 LLaMA),或用双语数据微调 Q - Former 以对齐中文文本与视觉特征到 LLM 的语义空间。

-

-

中文匹配实现:用多语言分词器处理中文文本,Q - Former 学习中文文本与视觉特征的对齐,再将对齐特征输入多语言 LLM,实现图片+中文匹配;英文匹配则复用原版对齐逻辑。

-

三、快速使用建议

-

优先选成熟多语言权重:如 Chinese - BLIP/BLIP - 2、Hugging Face 上适配 mT5 的 BLIP - 2 权重,开箱即用中英文图文匹配。

-

微调流程(自定义适配):准备双语图文数据集→替换多语言分词器→微调 Q - Former(BLIP - 2)或文本编码器(BLIP)→用 ITC/ITM 损失对齐语义→推理时直接输入图片+中文/英文文本,计算特征相似度得到匹配结果。

预训练模型和搜推广模型本质上的区别是什么?为什么叫预训练

预训练模型和搜推广(搜索、推荐、广告)模型的本质区别,在于设计目标、训练范式(预训练+微调)、核心能力、数据量的不同;而"预训练"的命名,源于其"先通用后专用"的两阶段训练逻辑。下面分两部分详细拆解:

- 一、 预训练模型 vs 搜推广模型:本质区别

|---------------|--------------------------------------------------------------------------------------------------------------------|------------------------------------------------------------------------------------------------------------------|

| 对比维度 | 预训练模型(如 CLIP、BLIP-2、BERT) | 搜推广模型(如 Wide&Deep、DCN、双塔召回模型) |

| 核心目标 | 学习通用的语义/模态表示 ,掌握语言、图像等数据的底层规律,适配多任务、跨场景迁移 | 学习特定场景的精准匹配/排序规律,解决"用户-物品"的匹配问题(搜索:query-文档;推荐:用户-商品;广告:用户-广告) |

| 训练范式 | 两阶段训练 :1.预训练: 在海量无标注/弱标注通用数据 上学习(如 CLIP 用 4 亿图文对),目标是"学通用规律";2.微调: 在下游任务小样本标注数据上适配,目标是"适配具体任务" | 单阶段/端到端训练 :直接在搜推广场景的标注数据上训练(如用户点击日志、成交日志),目标是"精准预测 CTR/CVR/相关性" |

| 核心能力 | 通用表示能力 :输出的 embedding 具有强语义性,可迁移到分类、检索、生成等多种任务;<br>跨模态/跨语言能力:如 CLIP 实现图文语义对齐,多语言 BERT 实现跨语言理解 | 精准预测能力 :聚焦"用户行为预测"(如点击率 CTR、转化率 CVR、相关性得分);<br>个性化能力:建模用户偏好、物品属性、场景特征的关联 |

| 数据 依赖 | 依赖海量通用数据(如全网文本、图文对),对标注要求低(无标注/弱标注即可) | 依赖特定场景的业务数据(如用户点击日志、商品属性表、搜索 query 日志),对标注要求高(需用户行为标签:点击/不点击、购买/不购买) |

| 模型结构 | 以 Transformer 为核心,强调全局上下文建模(如自注意力、跨注意力),模型容量大 | 以 "记忆+泛化""召回+排序" 为核心,结构灵活:<br>- 召回层:双塔模型(用户塔/物品塔),轻量高效;<br>- 排序层:Wide&Deep(记忆人工特征+泛化深度学习特征)、DCN(交叉特征建模) |

| 应用 方式 | 先预训练得到通用模型,再通过微调、提示学习适配下游任务(如用 CLIP 微调做商品分类) | 直接针对业务目标训练,上线后通过在线学习、特征工程迭代优化(如根据实时点击数据更新模型参数) |

- 关键补充:核心差异的本质

预训练模型的核心是 "通用化" ------ 希望一个模型能搞定多个任务,不是为了解决某个具体任务,而是学习数据的底层通用规律(强,预训练学到的规律可迁移)。比如 CLIP 既可以做图文检索,又可以做零样本分类;

搜推广模型的核心是 "场景化" ------ 只为解决搜推广的核心问题:"把对的物品在对的时间推给对的人" ,不追求跨场景迁移,只追求本场景的精准性。(弱,易过拟合小数据集)

-

举个例子:

-

用 CLIP 做商品召回,是用通用图文语义对齐能力匹配"商品图-用户 query",优点是冷启动好(新商品也能基于图语义召回),缺点是缺乏个性化;

-

用双塔推荐模型做商品召回,是用用户行为数据建模"用户偏好-商品属性"的匹配 ,优点是个性化精准,缺点是冷启动差(新商品无行为数据难召回)。

-

-

- 搜推广模型为什么很少叫"预训练模型"?

搜推广模型的训练数据是特定场景的业务数据 ,训练目标是预测用户行为,训练完成后直接上线使用,没有"先学通用规律,再适配任务"的过程------ 它的能力是"场景专属"的,而非"通用可迁移"的,因此不叫预训练模型。

不过,现在也有预训练+搜推广结合的趋势:比如用 CLIP 做商品召回的预训练初始化,再用用户点击数据微调,兼顾通用语义能力和个性化精准性。

-

三、 总结

-

本质区别:预训练模型是"学通用规律,供多任务迁移";搜推广模型是"学场景规律,做精准匹配预测"。

-

预训练的命名原因:核心是"提前在海量通用数据上学好底层规律,再微调适配下游任务",区别于"从零开始训练"的传统范式。

需要我帮你整理一份 预训练模型与搜推广模型的融合方案清单,比如如何用 CLIP 优化搜推广的召回冷启动问题吗?

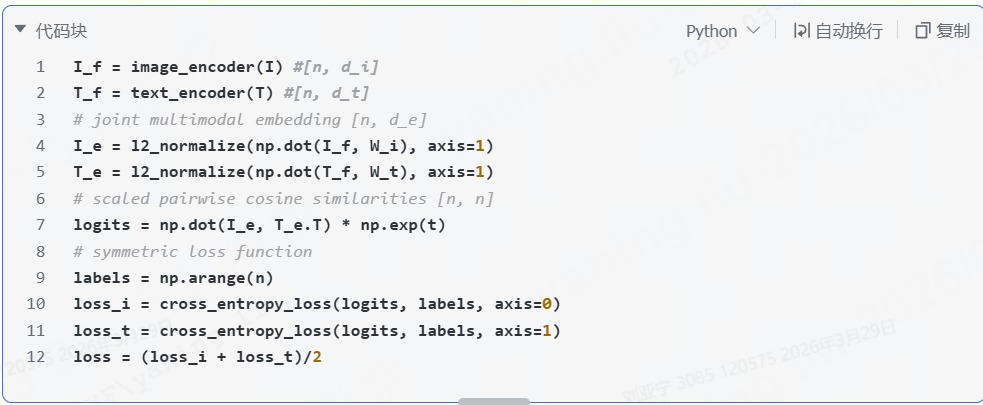

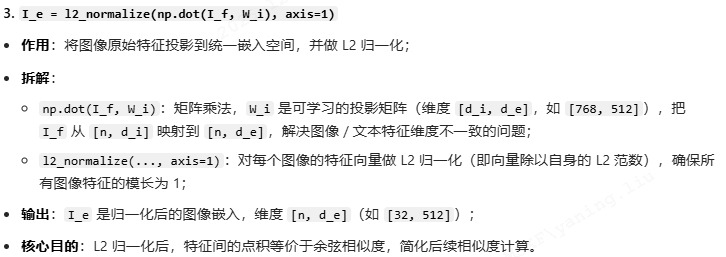

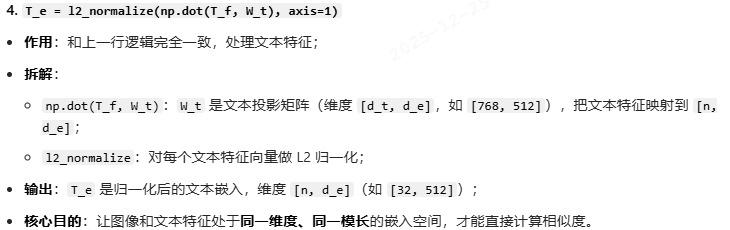

clip的损失函数:clip训练了多久。

-

n:batch size(批次内的图文对数量,比如 32/64); -

d_i:图像编码器输出特征维度(如 ViT-B/32 输出 768 维); -

d_t:文本编码器输出特征维度(如 Text Transformer 输出 768 维); -

d_e:统一的嵌入维度(CLIP 固定为 512 维); -

t:温度系数(CLIP 默认 0.07,控制相似度分布的尖锐度)。

-

logits = np.dot(I_e, T_e.T) * np.exp(t)

-

作用:计算批次内所有图文对的缩放后相似度;

-

拆解:

-

np.dot(I_e, T_e.T):图像嵌入 × 文本嵌入的转置,得到相似度矩阵S,维度[n, n];-

矩阵中

S[i,j]表示第i张图和第j段文本的余弦相似度(因已归一化,点积 = 余弦相似度); -

对角线元素

S[i,i]是 "正样本对"(第i张图对应第i段文本),非对角线是 "负样本对";

-

-

* np.exp(t):温度系数的指数缩放(CLIP 中t=0.07,np.exp(0.07)≈1.0725);- 温度系数越小,

exp(t)越接近 1,softmax 分布越 "尖锐"(正样本权重更高,负样本更低),能强化正样本对的对齐;

- 温度系数越小,

-

-

输出:

logits是缩放后的 相似度 矩阵, 维度[n, n](如[32, 32]); -

核心目的:把 相似度 转化为可用于 交叉熵 损失 的 logits(对数几率)。

-

labels = np.arange(n)

-

作用:生成交叉熵损失的目标标签;

-

输出 :

labels是一维数组,值为[0,1,2,...,n-1](如n=32时,[0,1,...,31]); -

核心目的 :标签表示 "第

i张图应匹配第i段文本"(正样本),是交叉熵损失的监督信号。

-

loss_i = cross_entropy_loss(logits, labels, axis=0)

-

作用:计算 "图像→文本" 方向的交叉熵损失;

-

拆解:

-

cross_entropy_loss:交叉熵损失函数,核心是对 logits 做 softmax 后计算负对数似然; -

axis=0:沿列维度计算(即对每一张图,计算其与所有文本的相似度的交叉熵);-

对第

i张图,logits 取logits[i,:](第i行),目标标签是labels[i] = i; -

损失含义:让模型学习 "第

i张图对第i段文本的相似度远高于其他文本";

-

-

-

输出 :

loss_i是标量(单个数值); -

核心目的:惩罚图像特征与对应文本特征相似度低的情况。

-

loss_t = cross_entropy_loss(logits, labels, axis=1)

-

作用:计算 "文本→图像" 方向的交叉熵损失;

-

拆解:

-

axis=1:沿行维度计算(即对每一段文本,计算其与所有图像的相似度的交叉熵);-

对第

i段文本,logits 取logits[:,i](第i列),目标标签是labels[i] = i; -

损失含义:让模型学习 "第

i段文本对第i张图的相似度远高于其他图像";

-

-

-

输出 :

loss_t是标量; -

核心目的 :和

loss_i形成双向监督,避免单向对齐的偏差(比如只让图像匹配文本,文本不匹配图像)。

-

loss = (loss_i + loss_t)/2

-

作用:计算对称总损失;

-

输出 :

loss是标量,为loss_i和loss_t的均值; -

核心目的 :CLIP 是 "双塔架构",双向损失能确保图像编码器和文本编码器同等程度地学习图文对齐,最终让两个模态的特征在嵌入空间高度匹配。

用 CLIP 做商品召回,是用通用图文语义对齐能力匹配"商品图-用户 query",优点是冷启动好(新商品也能基于图语义召回),缺点是缺乏个性化;

Blip 深入:

n是多个并行?

这里的 "n" 通常指的是BLIP模型中使用的 Transformer块的数量 或 模型的深度。

-

不是"并行" :在模型结构上下文中,"n" 不表示多个模型并行运行。它表示网络是由

n个相同的Transformer层堆叠(串联) 而成的。数据会顺序地通过第一层、第二层...直到第n层。 -

可以理解为"深度" :例如,一个12层的Transformer模型,就是

n=12。每一层都会对输入数据进行更复杂的特征提取和转换。

简单比喻:就像一栋有n层的楼,你需要从1楼顺序走到n楼,而不是同时出现在所有楼层。

-

需要注意的权衡

当然,层数不是越多越好:

结论 :BLIP(以及现代Transformer模型)选择堆叠多层,是在模型容量、特征提取能力、训练可行性 之间取得的最佳平衡点,是实现其强大性能的架构基石。

-

梯度消失/爆炸 :层数过深会导致训练困难。但Transformer使用的残差连接和层归一化技术基本解决了这个问题。

-

计算量和显存 消耗:层数增加会线性增加计算和显存开销。

-

过拟合 风险:容量过大的模型在小数据上容易记住噪声。但BLIP使用海量数据和有效的正则化手段来缓解。

-

CLS ,Encoder & Decoder 标记作用

Text encoder前有**[CLS]** 标记, image-ground text encoder前有**【encoder】标记**

image-ground text decoder前有【decoder】标记

这些标记绝不仅仅是"开关"或"标签",它们是模型可训练参数的重要组成部分,深度参与计算和训练。

-

这些标记的本质:可训练的嵌入向量

-

- 它们不是简单的符号

-

每个特殊标记(

[CLS],[Encode],[DEC])在模型中都有一个对应的嵌入向量。 -

这个嵌入向量:

-

维度:与词向量的维度相同(如768维)

-

可训练:在训练过程中通过梯度下降不断更新优化

-

唯一性:每个标记有自己独特的向量表示

-

-

-

- 在模型中的具体位置

# 嵌入表示 [CLS] -> 向量 [0.12, -0.45, 0.78, ...] # 可训练参数 [Encode] -> 向量 [0.34, 0.56, -0.23, ...] # 可训练参数 [DEC] -> 向量 [-0.67, 0.89, 0.12, ...] # 可训练参数 "cat" -> 向量 [0.45, -0.12, 0.67, ...] # 可训练参数

-

这些标记如何参与计算?

前向传播过程:

输入序列 = [CLS] + "a" + "cute" + "cat" + [Encode] + 视觉特征 对应嵌入 = [CLS_vec] + [a_vec] + [cute_vec] + [cat_vec] + [Encode_vec] + [visual_vec]-

以

[CLS]标记为例: -

输入构造:

-

自注意力计算:

-

[CLS]会与序列中的每一个其他 token进行注意力交互 -

它关注文本token的意义

-

它关注视觉特征的内容

-

通过多层Transformer,

[CLS]位置积累了全局信息

-

-

输出利用:

- 最后一层的

[CLS]输出向量用于ITM分类:

- 最后一层的

-

# ITM任务示例 cls_output = transformer_output[0] # 取[CLS]位置的输出 match_score = classifier_layer(cls_output) # 计算匹配分数 loss = cross_entropy(match_score, true_label) # 计算损失

-

训练时的梯度回传:

-

当ITM损失计算后,梯度会通过反向传播:

-

更新分类器层的权重 ✅

-

更新Transformer各层的参数 ✅

-

更新

[CLS]标记的嵌入向量 ✅ -

更新其他token的嵌入 ✅

-

-

-

不同标记的特殊训练目标

# 训练目标:学习成为"图文匹配专家" # 正向样本:[CLS] + "一只猫" + [Encode] + 猫的图片 → 输出应接近1(匹配) # 负向样本:[CLS] + "一只猫" + [Encode] + 狗的图片 → 输出应接近0(不匹配) # 通过数百万次这样的训练,[CLS]向量学会了: # - 如何聚合图文信息 # - 如何判断语义一致性# 训练目标:学习成为"生成任务启动器" # 输入:[DEC] + 猫的图片 → 应生成"一只猫" # 训练过程: # 输入:[DEC] + 猫的图片 + "一只" # 目标:预测下一个词是"猫" # [DEC]向量学会了: # - 如何基于视觉信息启动生成过程 # - 如何协调视觉和文本的生成逻辑# 训练目标:学习成为"模态融合器" # 它位于文本和视觉的交界处,学会了: # - 何时从文本处理切换到多模态处理 # - 如何桥接两种模态的信息流-

[CLS]标记的训练目标 -

[DEC]标记的训练目标 -

[Encode]标记的训练目标

-

Image-grounded Text Decoder(图像接地文本解码器)具体实现逻辑解析

从BLIP论文架构设计和训练流程出发,Image-grounded Text Decoder(以下简称"图文解码器")通过"模块改造→特征交互→生成逻辑→ 损失 优化"四步,将抽象的"图像→文本"转化落地,核心是让模型在"看图像"的同时,按顺序生成连贯文本,具体实现细节如下:

一、第一步:解码器架构改造------为"顺序生成"做准备

图文解码器并非独立模块,而是在"Image-grounded Text Encoder(图像接地文本编码器)"基础上改造关键组件,核心是用因果自注意力替代双向自注意力,确保文本生成时"只能看到前面的token,看不到后面的token"(符合人类阅读和写作的顺序逻辑):

-

自注意力层改造:

-

原编码器用双向自注意力(Bi-Self-Att):文本中每个token能看到所有其他token(比如"猫"能看到"戴项圈的"和"在沙发上"),用于细粒度理解;

-

解码器替换为因果自注意力(Causal-Self-Att):给注意力矩阵加"下三角掩码"------第i个token只能关注第1~i个token(比如生成"戴项圈的猫"时,生成"猫"的瞬间,只能看到"戴""项圈""的",看不到后续未生成的内容),强制文本按从左到右的顺序生成。

-

-

保留核心共享组件:

-

完全复用编码器的交叉注意力层(CA) 和前馈网络(FFN):交叉注意力层负责让文本token与图像patch特征交互(比如"项圈"对应图像中项圈的位置特征),前馈网络负责token特征的非线性变换;

-

这样设计既能减少参数量(避免重复训练),又能保证"图像特征理解"与"文本生成"的一致性(比如编码器学到"项圈"对应图像特征,解码器生成"项圈"时能复用这一关联)。

-

-

加入专属起始/终止 token:

-

输入序列开头插入**【Decode】token**:作为生成任务的"启动信号",告诉模型"从这里开始生成文本";

-

生成到指定长度或语义结束时,输出**【EOS】token**(End of Sequence):告诉模型"文本生成完成",避免无限制生成冗余内容。

-

二、第二步:特征交互流程------让文本"锚定"图像内容

图文解码器的核心是"图像特征引导文本生成",而非凭空造词,具体通过"图像特征输入→交叉注意力交互→文本token生成"的流水线实现:

-

图像特征预处理:

-

先通过ViT图像编码器(与ITC/ITM任务共享)将图像拆分为16×16(ViT-B/16)的patch,编码为patch级 特征序列(维度:batch_size × num_patches × hidden_dim,比如2880 × 196 × 768),同时保留【CLS】token的全局图像特征;

-

图像特征会被缓存,无需重复编码(减少计算量,符合论文"一张图只过一次ViT"的高效设计)。

-

-

文本生成的交叉注意力交互:

-

当生成某个文本token(比如"项圈")时,流程如下:

-

已生成的文本序列(【Decode】+"戴"+"项圈")先通过因果自注意力层:计算每个token的上下文特征("项圈"只关注【Decode】和"戴");

-

进入交叉注意力层:文本token特征与所有图像patch特征计算注意力权重------"项圈"对应的token会对图像中"项圈所在的patch"分配更高权重(比如权重0.8,对"猫身体的patch"权重0.1),从而"锚定"图像中的对应区域;

-

经过前馈网络:融合交叉注意力后的特征,输出该token的最终表征,用于预测下一个token(比如"的")。

-

-

关键效果:每个生成的文本token都与图像特征强绑定,避免"生成与图像无关的内容"(比如图像中没有狗,就不会生成"狗")。

-

三、第三步:自回归生成逻辑------逐token构建文本

图文解码器采用自回归(Autoregressive)生成,即"生成第i个token时,必须基于前i-1个token和图像特征",具体流程以"生成图像字幕"为例:

-

初始化生成序列:

- 输入序列为【Decode】token(可学习向量,初始随机,训练后成为"生成启动"的固定表征),图像特征已提前编码完成。

-

逐 token 预测:

-

第1步:模型基于【Decode】token和图像特征,通过交叉注意力关注图像全局特征(比如"猫"的整体轮廓),预测第一个token的概率分布------大概率是"a""an""the"等冠词(符合字幕生成的语法习惯);

-

第2步:将"a"加入生成序列(此时序列为【Decode】+"a"),模型基于这两个token和图像特征,通过交叉注意力关注"猫"的类别特征,预测第二个token------大概率是"cat""dog"等动物名词(图像中是猫,所以"cat"概率最高);

-

第3步:将"cat"加入序列,模型基于【Decode】+"a"+"cat"和图像特征,关注"猫是否有项圈"的细节特征,预测第三个token------如果图像中猫戴了项圈,大概率是"with""wearing"等介词(为后续"项圈"做铺垫);

-

重复上述步骤,直到生成【EOS】token或达到最大长度(论文中字幕生成默认最大长度20),最终得到完整文本(比如"a cat wearing a red collar")。

-

-

生成策略选择:

-

训练阶段:用确定性预测(基于交叉熵损失,直接选择概率最高的token),确保模型学习到"图像→文本"的准确映射;

-

推理阶段(实际生成时):用** nucleus采样**(论文中p=0.9):从"累计概率达90%的token集合"中随机采样(而非必选概率最高的token),既能避免生成重复、呆板的文本(比如不会每次都生成"a cat on the sofa"),又能保证语义准确性(排除概率极低的离谱token,比如"a cat flying")。

-

四、第四步:损失优化------让模型"学会生成正确文本"

图文解码器通过语言建模 损失 (LM Loss, 交叉熵 损失) 优化参数,核心是"让模型预测的 token 分布尽可能接近人工标注的真实文本",具体计算逻辑如下:

-

构建训练样本对:

-

输入:【Decode】token + 人工标注文本的前n-1个token(比如真实文本是"a cat wearing a collar",输入序列是【Decode】+"a"+"cat"+"wearing"+"a");

-

标签:人工标注文本的后n-1个token(对应输入的标签是"a"+"cat"+"wearing"+"a"+"collar");

-

这样设计能让模型"每一步预测的token都对应真实文本的下一个token"(比如输入"a cat",标签是"wearing",模型需要学会"看到a cat后,下一个词大概率是wearing")。

-

-

交叉熵 损失 计算:

-

对每个位置的预测token,计算其概率分布与真实标签的交叉熵(比如模型预测"wearing"的概率是0.8,真实标签就是"wearing",损失很小;如果预测"flying"的概率是0.6,损失就会很大);

-

论文中加入0.1的标签平滑:给真实标签的概率打9折(0.9),剩下1折平均分给其他所有token,避免模型过度自信(比如不会因为"wearing"是真实标签,就把其他合理token的概率压到0,提升生成的灵活性)。

-

-

参数更新目标:

-

反向传播时,重点更新因果自注意力层和**【Decode】token的嵌入参数**:让因果自注意力更精准地捕捉"前序token→当前token"的关联(比如"a cat"→"wearing"),让【Decode】token更高效地启动生成流程;

-

同时微调交叉注意力层参数:进一步优化"文本token→图像特征"的对应关系(比如让"collar"更精准地关注图像中项圈的patch)。

-

五、下游任务适配实例------从预训练到实际应用

图文解码器的设计并非只服务于"图像字幕生成",而是能灵活适配所有"图像→文本"的生成类任务,核心是通过微调输入序列格式实现:

-

图像字幕生成(COCO/NoCaps任务):

-

输入:【Decode】token + 空序列(模型从无到有生成完整字幕);

-

微调策略:用COCO的人工标注字幕作为真实标签,优化LM损失,生成时加"a picture of"前缀(论文中验证能提升语法连贯性)。

-

-

视觉问答(VQA任务):

-

输入:【Decode】token + 问题文本(比如"这只猫戴了什么?");

-

目标:生成答案文本(比如"红色项圈");

-

实现逻辑:交叉注意力层让"什么"这个疑问词关注图像中"猫的颈部区域",模型基于问题语义和图像细节生成答案,而非随机猜测。

-

-

视觉对话(VisDial任务):

-

输入:【Decode】token + 对话历史(比如"Q1:图中有猫吗?A1:有") + 当前问题("Q2:猫是什么颜色?");

-

目标:生成对话回复(比如"黑色");

-

实现逻辑:因果自注意力层捕捉对话历史的语义(确认"有猫"),交叉注意力层关注"猫的毛发颜色"特征,确保回复与历史和图像一致。

-

一句话总结

Image-grounded Text Decoder的核心实现逻辑是:用因果自注意力控制生成顺序,用交叉注意力绑定图像特征,用自回归逐token构建文本,用LM 损失 优化生成准确性------本质是把"看图像"和"写文本"拆成一步步的"看图选词",最终实现"图像内容→连贯文本"的精准转化。

三个损失函数是如何迭代的?单独还是一起?

BLIP的三个核心损失函数是一起迭代(联合训练) 的。这是一个多任务学习框架,目标是通过一个训练过程让模型同时掌握多种能力。在每次训练迭代(一个batch的数据)中,模型会并行地计算所有损失,然后将它们加权求和,得到一个总损失 。最后,通过反向传播来优化这个总损失。三个损失函数及其作用:

-

单模态编码器:配合图像 - 文本对比损失(ITC),实现视觉与语言特征空间的粗粒度对齐,为图文检索等理解类任务奠定基础。

-

图像引导文本编码器:通过额外交叉注意力层融合图文特征,结合图像 - 文本匹配损失(ITM),完成细粒度的图文匹配二分类,精准判断图文是否匹配。

-

图像引导文本解码器:替换为因果自注意力层,配合语言建模损失(LM),实现基于图像的文本生成任务(如图像字幕生成)。

-

ITC Loss(图像-文本对比 损失 ):

-

目标: 拉近匹配的图文对的特征距离,推远不匹配的图文对的特征距离。

-

作用: 让模型学习到一个对齐的图文特征空间,是图文检索任务的基础。

-

-

ITM Loss(图像-文本匹配 损失 ):

-

目标: 让模型判断一个图文对是匹配的还是不匹配的(一个二分类任务)。

-

通过 cross attention 将 image 与 text 的特征融合

-

细粒度的对比学习, 将对比学习分类错误的样例作为负样本学习(对正负样本的构建非常依赖)

-

-

作用: 让模型进行更深层次的语义对齐理解,而不仅仅是特征相似度。

-

-

LM Loss(语言建模 损失 ):

-

目标: 根据图像和上文,预测下一个词元。

-

作用: 训练模型的文本生成能力,用于图像描述生成和VQA等任务。

-

联合训练的优势 : ITC和ITM损失帮助模型学习更好的视觉-语言表征 ,而LM损失帮助模型学习语言生成。它们相互促进,学到的对齐表征有助于生成更准确的描述,而生成任务又反过来要求模型更深入地理解图像内容。

3.1 将分类错误的样例作为负样本 没理解

这是ITM 任务"硬负样本挖掘"的核心逻辑,本质是通过"找难区分的错误样例"让模型学到更细粒度的图文对齐特征,具体拆解如下:

-

一、先明确核心前提:对比学习与正负样本的基础逻辑

在图文对比学习(比如 ITC 任务)中,模型的核心是"区分正负样本":

常规对比学习会随机挑选负样本,但这样的负样本大多"一眼就能区分"(比如猫和汽车),模型学不到细粒度特征。而论文的核心改进是:不随机选负样本,而是把"模型之前分类错误的样例"当作负样本 , 强迫模型攻克"难区分的错题"。

-

正样本:配对正确的图文对(比如"猫"的图 + "一只黑猫趴在沙发上"的文本);

-

负样本:配对错误的图文对(比如"猫"的图 + "一辆红色汽车"的文本)。

-

-

二、"分类错误的样例作为负样本"的具体过程(结合论文 ITM 任务)

论文中 ITM 是二分类任务(判断图文是否匹配),而"细粒度对比学习"是通过"硬负样本挖掘"实现的,步骤如下:

-

第一步:初始训练与错误识别

-

先用常规正负样本训练模型,模型会对每个图文对预测"匹配概率"(比如 0.9 表示认为匹配(高置信的示例而已),0.1 表示不匹配);

-

此时会出现"分类错误的样例":比如模型误把"猫的图 + 一只橘色小狗"的文本预测为"匹配"(概率 0.6,可以认为是模型初期,分类的不准,0.5是阈值的话),但实际这是个负样本(图文不匹配)。

-

-

第二步:将错误样例标记为"硬负样本"

-

这些"模型认错的负样本"就是"硬负样本"------它们的图文特征有一定相似性(比如猫和小狗都是宠物,场景可能都是室内),所以模型才会误判;

-

区别于"猫的图 + 汽车文本"这种"易区分负样本",硬负样本能逼迫模型关注更细的差异(比如"猫的耳朵形状"vs"狗的耳朵形状"、"猫的毛发纹理"vs"狗的毛发纹理")。

-

-

第三步:用硬负样本重新训练,强化细 粒度 对齐

-

把这些硬负样本加入训练集,和普通正负样本一起重新训练模型;

-

模型在学习过程中,会专门针对"猫 vs 小狗"这类难区分的案例优化特征:比如让"猫"的图像特征与"狗"的文本特征距离更远,同时与"猫"的文本特征距离更近;

-

重复这个"识别错误→标记硬负样本→重新训练"的过程,模型就能逐步学会细粒度的图文特征对齐,不再被表面相似性误导。

-

-

-

三、为什么这种策略"依赖正负样本构建"?

核心是"硬负样本的质量决定学习效果":

-

如果能找到足够多"模型易错、且图文有细粒度相似性"的硬负样本(比如"苹果的图 + 红李子的文本""自行车的图 + 电动车的文本"),模型就能学到更精准的区分特征;

-

但如果硬负样本找得不好(比如还是"猫 vs 汽车"这种易区分的),或者数量太少,模型就无法突破"粗粒度对齐"的局限,细粒度对比学习的效果会大打折扣。

-

-

四、论文中该策略的实际作用(呼应实验结论)

这种"用分类错误样例当负样本"的细粒度对比学习,最终服务于 ITM 任务的核心目标------让模型精准判断图文是否匹配:

-

常规负样本训练的模型,可能只能区分"完全不相关"的图文;

-

经硬负样本训练后,模型能区分"表面相似但实际不匹配"的图文,比如准确识别"一只戴项圈的猫"的图,与"一只没戴项圈的猫"的文本是不匹配的,从而实现更细粒度的特征对齐。

-

-

一句话总结

把对比学习分类错误的样例当负样本,本质是"让模型做错题集"------通过反复攻克难区分的图文对,逼着模型从"粗粒度的图文关联"升级到"细粒度的特征对齐",这也是 ITM 任务能提升下游字幕生成、检索性能的关键原因之一。

3.2 ITC和ITM 粗粒度和细粒度的差异,该如何解释

-

一、核心结论(训练流程视角)

-

ITC(图像-文本对比学习):训练流程聚焦"全局特征排序",不做细粒度交互,核心是快速拉通图文全局语义,属于"粗粒度对齐";

-

ITM(图像-文本匹配):训练流程聚焦"细粒度特征融合",通过交叉注意力逐token交互,核心是精准判断图文细节一致性,属于"细粒度对齐";

-

流程协同逻辑:ITC为ITM提供"高质量初始化",ITM为ITC过滤"噪声干扰",两者串联形成"全局对齐→细节优化"的训练闭环。

-

二、训练流程全拆解:一步一步看差异

-

- 数据准备阶段:正负样本构建逻辑不同

-

(1)ITC:宽松的正负样本划分(服务粗粒度排序)

-

正样本:直接采用原始数据集中的配对图文对(如"猫的图+'一只黑猫'的文本"),不做细节校验;

-

负样本:采用"batch内随机采样"+"动量编码器软标签过滤"------从当前训练batch中随机抽取其他图像的配对文本作为负样本,再通过动量编码器预测"潜在正样本概率",避免把语义相关的图文对误判为负样本;

-

核心特点:负样本以"易区分"为主(如"猫的图+'汽车'的文本"),无需精细化筛选,重点保证负样本数量和多样性,适配大规模数据快速训练。

-

(2)ITM:严格的正负样本筛选(服务细粒度校验)

-

正样本:在ITC正样本基础上,额外过滤"表面配对但细节不匹配"的样本(如剔除"戴项圈的猫图+'没戴项圈的猫'的文本");

-

负样本:采用"硬负样本挖掘"策略------从ITC训练的错误样例中筛选:模型在ITC阶段误判为"相似"的负样本(如"猫的图+'橘色小狗'的文本"),这类样本图文表面相似但实际不匹配,是细粒度区分的关键;

-

核心特点:负样本以"难区分"为主,需精准控制质量,避免无意义的噪声负样本(如"猫的图+'咖啡'的文本")占用训练资源。

-

-

- 模型前向传播:特征处理逻辑不同

-

(1)ITC:无交互的"双路并行编码"(粗粒度特征提取)

-

流程步骤:

-

图像输入:通过ViT编码器(如ViT-B/16)将图像拆分为patches,编码为包含[CLS] token的全局特征向量(维度:batch_size × hidden_dim);

-

文本输入:通过BERT编码器将文本编码为包含[CLS] token的全局特征向量(维度与图像特征一致);

-

特征对比:仅计算图像[CLS]与文本[CLS]的余弦相似度,不做任何token级交叉交互;

-

-

核心设计:激活MED的"单模态编码器"模式,图文特征独立编码,计算效率极高,可支持batch_size=2880的大规模训练;

-

流程本质:只关注"图文全局语义是否相关",不关心"细节是否对应",比如只要文本是"动物"相关,就会被认为与"猫图"有相似度。

-

-

(2)ITM:强交互的"交叉注意力融合"(细粒度特征提取)

-

流程步骤:

-

图像编码:与ITC共享ViT编码器,输出图像patch特征(维度:batch_size × num_patches × hidden_dim);

-

文本编码:文本先通过BERT自注意力层编码为token级特征,再插入"交叉注意力层";

-

细粒度融合:交叉注意力层让每个文本token(如"戴""项圈""猫")分别与所有图像patch特征计算注意力权重,精准捕捉"文本描述与图像细节"的对应关系;

-

匹配判断:通过[Encode] token输出融合后的 multimodal 特征,经ITM头(线性层)预测"匹配/不匹配"二分类结果;

-

-

核心设计:激活MED的"图像接地文本编码器"模式,强制图文token级交互,计算量高于ITC,但能捕捉细粒度关联;

-

流程本质:关注"图文细节是否一致",比如文本"戴项圈"必须对应图像中"项圈所在的patch特征",否则判定为不匹配。

-

-

- 损失计算与参数更新:优化目标不同

-

(1)ITC:对比损失(优化全局相似度排序)

-

损失 函数:InfoNCE对比损失,公式核心是"拉近正样本对相似度、拉远负样本对相似度";

-

优化逻辑:让同一图文对的[CLS]特征距离尽可能近,不同图文对的[CLS]特征距离尽可能远,目标是优化"全局相似度排序";

-

参数更新:仅更新图像编码器和文本编码器的基础参数,不涉及交叉注意力层(ITC阶段交叉注意力层未激活);

-

训练效果:模型快速学会"区分图文是否相关",比如能把"猫图"和"动物文本"归为一类,和"交通工具文本"归为另一类,但分不清"猫"和"小狗"的文本差异。

-

-

(2)ITM:二分类交叉熵损失(优化细节一致性判断)

-

损失 函数:Binary Cross-Entropy(BCE)损失,公式核心是"最小化模型预测与真实匹配标签的差异";

-

优化逻辑:让模型学会判断"细粒度特征是否对齐",比如"文本token'项圈'是否与图像中对应patch特征匹配",目标是优化"细节一致性分类";

-

参数更新:重点更新交叉注意力层和ITM头参数,同时微调图像/文本编码器参数,让特征更适配细粒度匹配;

-

训练效果:模型学会"区分图文是否精准匹配",比如能识别"猫图+'小狗'文本"是不匹配,即使两者都是动物,也能通过细粒度特征差异做出正确判断。

-

-

-

- 训练迭代与收敛逻辑:优化节奏不同

-

(1)ITC:快速收敛,适配大规模预训练

-

迭代特点:由于无交叉交互,计算效率高,单epoch训练时间短,通常在10-15个epoch即可收敛到稳定的全局对齐效果;

-

收敛标志:正负样本对的相似度分布明显分离,即正样本对相似度集中在0.8以上,负样本对相似度集中在0.2以下;

- 核心作用:为后续ITM训练提供"高质量初始化"------模型已具备基础的图文关联认知,无需从零学习"什么是相关图文对"。

-

-

(2)ITM:缓慢收敛,需精准优化细节

-

迭代特点:交叉注意力层增加了计算量,单epoch训练时间是ITC的2-3倍,且硬负样本难度高,需20-30个epoch才能充分收敛;

-

收敛标志:硬负样本的分类准确率显著提升,比如"猫图+'橘色小狗'文本"的预测不匹配概率从0.6降至0.3以下;

- 核心作用:在ITC的基础上"打磨细节",让模型从"知道图文相关"升级到"知道图文哪里相关、细节对不对"。

-

-

三、训练流程差异带来的核心影响

|------|-------------------------|-------------------------------|

| 影响维度 | ITC(粗粒度) | ITM(细粒度) |

| 训练效率 | 高(无交叉交互,支持大batch) | 中(交叉注意力+硬负样本,batch相对较小) |

| 特征粒度 | 全局语义特征([CLS] token主导) | token级细节特征(文本token与图像patch对应) |

| 优化目标 | 图文全局相关性排序 | 图文细节一致性判断 |

| 下游适配 | 适合检索"召回阶段"(快速筛选相关结果) | 适合检索"重排阶段"(精准剔除噪声结果) |

| 误差容忍 | 允许细节误差(如"猫"与"小狗"误判为相似) | 零容忍细节误差(如"戴项圈"与"没戴项圈"必须区分) |

CLIP 和 BLIP 样本有标注吗?

这是一个非常好的问题,它点明了CLIP和BLIP的核心区别之一。

-

CLIP:只需要"弱标注"

-

标注形式 : CLIP需要的标注仅仅是 "图像-文本对" 本身。例如,一张猫的图片和它的描述"一只可爱的猫"。网络上的海量数据(如带有alt-text的网页图片)天然就是这种标注。

-

不需要: 不需要人工额外标注这个对是"匹配"还是"不匹配"。模型通过海量数据中的噪声监督,自己学习图文对应关系。所以CLIP的训练数据规模可以极其庞大。

-

-

BLIP:也只需要"弱标注"

-

标注形式 : BLIP在预训练阶段和CLIP一样,也只需要 "图像-文本对"。

-

关键创新 - 数据标注的"自举" : BLIP的一个巨大贡献是CapFilt技术。它利用模型自身的能力来清洗和增强网络数据。

-

生成: 用一个预训练的BLIP模型为网络图像生成高质量的描述(合成标注)。

-

过滤: 用另一个BLIP模型判断原始网络文本和合成文本的质量,过滤掉噪声大的数据。

-

-

因此,BLIP最终使用了干净的网页数据+模型自己生成的高质量数据进行训练。它并没有依赖额外的人工精细标注。

-

-

在 BLIP 论文中,"bootstrap(自举)" 特指利用模型自身能力迭代优化数据标注质量、扩充有效训练数据的策略 ------ 核心是 "用模型自己的输出反哺数据,让数据和模型互相提升",就像 "自己拉着自己的鞋带把自己提起来",这也是 "自举" 译名的由来。

总结: 两者在预训练时都使用无需人工精细标注的"弱监督"数据(图像-文本对)。但BLIP通过巧妙的算法,自己为自己创造了更高质量的标注数据,这是其性能超越CLIP的重要原因之一。希望这些解释能帮助你更清晰地理解BLIP模型!如果还有疑问,随时可以再问。

blip的损失函数是分类问题,还是回归问题,三个函数是如何迭代的,是单独迭代还是以前迭代

BLIP 原版的核心损失并非 ITG(Image-Text Generation),而是 ITC(图文对比) + ITM(图文匹配) + LM(Language Modeling,语言建模) 三个损失的联合优化------我之前的表述把 LM 简化为 ITG 不够精准,这是关键细节差异。下面我会修正并详细拆解这三个损失的定义、任务属性,以及它们的联合迭代逻辑:

BLIP 的损失函数既包含 分类问题 (占核心),也包含 生成类任务 (非严格回归) ;三个核心损失(ITC/ITM/ITG)是联合迭代优化(同一批次中同时计算、加权求和后反向传播),而非单独迭代或顺序迭代。

- 一、 BLIP 核心损失函数:ITC + ITM + LM(精准定义)

先明确每个损失的任务类型、核心目标、计算逻辑,尤其区分 LM 与 ITG 的差异:

|------|-------------------------------------|-----------------|--------------------------------------------------------------|-----------------------------------------------------|

| 损失名称 | 全称 | 任务类型 | 核心目标 | 计算逻辑 |

| ITC | Image-Text Contrastive Loss(图文对比损失) | 对比分类(软分类) | 让正样本图文对的相似度远>负样本,和 CLIP 的对比损失一致,属于"软分类"(判断"哪段文本匹配哪张图") | 计算批次内所有图文对的相似度矩阵,用交叉熵损失优化"图→文"和"文→图"双向对齐 |

| ITM | Image-Text Matching Loss(图文匹配损失) | 二分类 | 直接判断"单组图文对是否匹配"(标签:匹配=1/不匹配=0) | 拼接图像全局特征和文本 [CLS] 特征,输入二分类头(输出维度2),用交叉熵损失优化 |

| LM | Language Modeling Loss(语言建模损失) | 自回归生成(token级分类) | 以图像为条件做文本掩码建模(Masked Language Modeling,MLM),学习"图像语义→文本序列"的映射 | 随机掩码文本中的部分token,以图像特征为上下文,预测掩码位置的token(本质是逐token分类) |

-

关键补充:LM 与 ITG 的区别

-

LM(BLIP 原版) :是掩码语言建模(MLM),属于"填充式生成"------给定部分文本+图像,补全掩码token(如"a [MASK] sitting on a sofa" + 猫图 → 预测"cat");

-

ITG(后续扩展版) :是自回归生成(如图像标题生成),属于"从头生成"------仅给定图像,生成完整文本序列(如猫图 → 生成"a cat sitting on a sofa");

-

BLIP 原版以 MLM 为主,后续为了强化生成能力,才将 LM 扩展为包含自回归生成的 ITG,但核心仍属于"token级分类任务"(非回归)。

-

-

二、 三个损失的联合迭代逻辑(核心)

BLIP 的 ITC、ITM、LM 是同一批次内联合迭代,而非单独迭代或顺序迭代,具体流程如下:

-

- 单批次训练完整流程(伪代码)

# 1. 输入批次数据:n组图文对(含正样本+人工构造的负样本) batch = { "image": 图像张量 [n, 3, H, W], "text": 文本token张量 [n, seq_len], "itm_label": 二分类标签 [n] # 1=匹配,0=不匹配(负样本对) } # 2. 前向传播:提取图像/文本特征(共享编码器参数) image_feat = image_encoder(batch["image"]) # [n, d],图像全局特征 text_feat, text_embeds = text_encoder(batch["text"], image_feat) # text_feat:[n, d](文本[CLS]特征,用于ITC/ITM) # text_embeds:[n, seq_len, d](文本token特征,用于LM) # 3. 同时计算三个损失 ## 3.1 计算ITC损失 itc_loss = contrastive_loss(image_feat, text_feat) # 同CLIP,双向交叉熵 ## 3.2 计算ITM损失 itm_input = torch.cat([image_feat, text_feat], dim=1) # [n, 2d] itm_logits = itm_head(itm_input) # [n, 2] itm_loss = F.cross_entropy(itm_logits, batch["itm_label"]) # 二分类交叉熵 ## 3.3 计算LM损失(MLM) # 步骤1:构造掩码文本(随机掩码15%的token) masked_text, mask_labels = mask_text(batch["text"]) # masked_text: [n, seq_len] # 步骤2:以图像为条件,预测掩码token lm_logits = mlm_head(text_embeds) # [n, seq_len, vocab_size] # 步骤3:仅计算掩码位置的损失 lm_loss = F.cross_entropy(lm_logits[masked_text == MASK_TOKEN], mask_labels) # 4. 加权求和总损失(超参数λ1/λ2/λ3控制权重,如λ1=1, λ2=2, λ3=1) total_loss = λ1 * itc_loss + λ2 * itm_loss + λ3 * lm_loss # 5. 反向传播:统一更新所有参数 total_loss.backward() optimizer.step()

-

- 迭代核心特点

-

参数共享 :三个损失共享图像编码器 和文本编码器的所有参数,不存在"单独训练某部分参数"的情况;

-

同时计算:同一批次数据会同时用于计算三个损失,而非"先算ITC、再算ITM、最后算LM";

-

联合反向传播:总损失是三个损失的加权和,梯度会同时回传到图像编码器和文本编码器,让模型同时学习"图文对齐(ITC/ITM)"和"文本序列建模(LM)";

-

权重 可调:通过超参数(λ1/λ2/λ3)控制不同损失的贡献度------比如希望模型更精准判断图文匹配,可增大λ2(ITM权重);希望强化文本生成,可增大λ3(LM权重)。

-

三、 为什么选择联合迭代(而非单独迭代)?

-

能力互补:

-

ITC/ITM 优化"跨模态语义对齐"(让模型知道"哪张图对应哪段文本");

-

LM 优化"文本序列规律"(让模型知道"如何用通顺的文本表达图像语义");

-

联合训练避免"对齐能力"和"文本建模能力"割裂,比如模型既知道"猫图对应猫的文本",也知道"描述猫的文本该用'a cat'而非'cat a'"。

-

-

数据效率高:同一批次数据同时服务三个任务,无需为不同损失准备单独数据集,大幅降低训练成本;

-

参数高效:共享编码器参数,避免重复训练,模型参数量仅比 CLIP 略增,但能力从"仅匹配"扩展到"匹配+生成"。

-

-

核心总结(修正版)

简单来说,BLIP 是用"一套参数、一次反向传播",让模型同时学懂"图文是否匹配"和"如何用文本描述图像",而 LM 损失正是实现文本生成能力的核心------这也是它和 CLIP 最本质的区别。

-

损失 组成:BLIP 原版核心是 ITC(对比分类) + ITM(二分类) + LM(掩码语言建模,token级分类),无 ITG,三者均为分类任务(无回归);

-

迭代方式 :三个损失是联合迭代(同一批次加权求和、统一反向传播),而非单独/顺序迭代;

-

核心设计:通过"对齐+匹配+语言建模"联合优化,让模型同时具备图文匹配能力(继承CLIP)和文本生成基础能力(弥补CLIP短板)。

-

解释LM中的交叉熵损失和自回归的实现过程:

语言建模损失 LM(Language Modeling Loss ):针对以图像为基础的文本解码器,通过交叉熵损失进行优化,训练模型以自回归的方式最大化文本的似然概率,生成目标caption。

通过交叉熵损失进行优化 ,自回归 进行解释一下?

- 交叉熵损失(Cross Entropy Loss):衡量 "预测与真实的差距"

核心作用是量化模型 生成的字幕和真实字幕(目标 caption)之间的差异,并引导模型朝着 "缩小差异" 的方向更新参数。

-

具体过程:模型生成字幕时,是逐词预测的(比如先预测 "a",再预测 "little",接着预测 "girl"...)。对于每个位置的预测,模型会输出一个 "词汇表概率分布"(比如预测下一个词是 "girl" 的概率 0.8、"boy" 的概率 0.1、"cat" 的概率 0.05...)。

-

交叉熵损失的作用:对比这个 "预测概率分布" 和 "真实标签分布"(真实标签是 "girl",所以真实分布是 "girl" 概率 1.0,其他词概率 0.0),计算两者的差距 ------ 差距越大,损失值越高,模型参数更新的幅度就越大,下次预测时就会更倾向于选真实词。

-

结合 BLIP 场景:LM 损失用交叉熵优化,就是让模型学习 "给定图像和已生成的前序词,下一个词该选什么才能最接近真实 caption",比如看到 "蛋糕图像"+ 已生成 "a chocolate",模型能准确预测下一个词是 "cake" 而非 "dog"。

-

自回归(Autoregressive):"顺着顺序,用过去预测未来"

核心逻辑是生成字幕时,必须 按照文本的时序顺序逐词生成 ,且后一个词的预测依赖于前面已经生成的所有词,不能跳序或同时生成多个词。

-

具体过程:生成 "a little girl holding a kitten" 时,模型的步骤是:

-

先输入图像特征,预测第一个词 "a";

-

基于图像特征 + 已生成的 "a",预测第二个词 "little";

-

基于图像特征 + 已生成的 "a little",预测第三个词 "girl";

-

以此类推,直到预测出 "end-of-sequence"(序列结束)令牌,停止生成。

-

-

关键约束:自回归生成时,模型只能 "看到前面的词",看不到后面的词(这也是 BLIP 的图像引导文本解码器用 "因果自注意力" 的原因 ------ 只允许关注前序词),完全模拟人类逐字写句子的过程。

-

结合 BLIP 场景:自回归确保了生成的 caption 是 "语义连贯、时序合理" 的。比如不会先生成 "kitten",再生成 "holding a",而是按照 "主谓宾 / 定状补" 的正常语序生成,避免出现 "a kitten holding girl little" 这种混乱表达。

-

-

两者的协同关系

-

自回归是 "生成方式":规定了模型 "怎么生成" 字幕(逐词、依赖前序词);

-

交叉熵损失是 "优化目标":规定了模型 "生成得好不好" 的评判标准(和真实 caption 的差距);

-

结合效果:LM 损失通过 "自回归 + 交叉熵" 的组合,让 BLIP 的文本解码器既能生成语序通顺的句子,又能精准匹配图像内容,最终输出符合要求的目标 caption。

-

自回归的字面意思是什么

"自回归"的字面意思可以拆成"自""回""归"三个字,逐字拆解后就能直观理解:

-

自(Auto):指"自身、自己",核心是"用序列自身的信息";

-

回(Regressive):指"回溯、回归",核心是"回溯序列中前面的部分";

-

归(结合"回归"):这里的"回归"在统计学中是"根据已有信息预测未知值"的意思,结合起来就是"通过回溯自身前面的信息,预测后面的未知值"。

所以"自回归"的字面直译就是:从序列自身的"过去"(前面的元素)中获取信息,回归(推导、预测)出序列的"未来"(后面的元素) 。

-

结合BLIP的文本生成场景,再对应字面意思:

-

序列是要生成的字幕(比如"a little girl...");

-

"自":用字幕序列自己的词,而不是外部额外信息;

-

"回":生成下一个词时,回溯已经生成的前序词(比如生成"girl"时,回溯"a little");

-

"归":根据回溯到的前序词+图像特征,预测出下一个符合逻辑的词。

-

简单说,自回归的字面本质就是"自己靠自己的前面部分,推后面部分"。

bilp预训练模型 和 字幕生成与过滤(CapFilt)关系

BLIP 预训练模型的基础版本确实可仅通过 3.2 节的目标函数 + 原始数据训练完成,但 3.3 节 CapFilt 并非单纯 "应用层面",而是 BLIP 框架中 "数据增强与提纯的核心组件"------ 它既依赖基础模型的功能,又反过来优化训练数据,最终用于训练性能更强的 BLIP 模型。

-

CapFilt 不是 "单纯 应用 ",而是 "性能提升的核心环节"

CapFilt 的核心价值并非 "用已训练好的 BLIP 做应用",而是 "为 BLIP 的最终预训练提供高质量数据",是 BLIP 框架中不可或缺的 "数据优化模块",而非独立的 "应用工具":

-

CapFilt 的输入是 "原始网络数据",输出是 "高质量自举 数据 **集"**它的作用不是 "调用 BLIP 模型处理外部任务"(如给用户的图像生成字幕),而是 "在 BLIP 的训练流程中,对原始训练数据进行提纯和扩充"------ 生成器为无优质标注的网络图像(\(I_w\))补充合成字幕(\(T_s\)),过滤器剔除噪声文本(\(T_w\)和劣质\(T_s\)),最终形成 "过滤后网络数据 + 合成优质数据 + 人工标注数据" 的混合数据集。

-

CapFilt 的输出数据,是 "最终版 BLIP 模型" 的训练数据论文中实现 SOTA 性能的 BLIP 模型,并非用原始 14M 噪声数据训练,而是用 CapFilt 处理后的 "自举数据集" 训练 ------ 正是这些高质量数据,让 3.2 节的目标函数能更高效学习(避免噪声干扰、丰富样本多样性),最终实现图像检索、字幕生成等任务的性能突破。

-

-

二者的真实关系:"基础训练" 与 "性能增强" 的递进关系

|--------------|--------------|-------------------|---------------|-----------------------------|

| 阶段 | 是否依赖 CapFilt | 核心数据 | 模型性能 | 角色定位 |

| 基础版 BLIP 训练 | 否 | 原始网络数据 + 少量人工标注数据 | 达到基础水平,非 SOTA | 提供 CapFilt 所需的核心能力(生成 / 判别) |

| 最终版 BLIP 训练 | 是 | CapFilt 处理后的自举数据集 | 达到 SOTA 性能 | BLIP 框架的最终目标模型 |

| CapFilt 模块微调 | 依赖基础版 BLIP | 人工标注数据(如 COCO) | (仅为数据处理服务) | 数据优化工具 |

CapFilt中Model Pretraining与Dataset Bootstrapping整体处理流程详解

CapFilt的核心逻辑是"模型预训练提供能力→数据集自举优化数据→优化后数据回流强化模型"的闭环流程,最终实现"模型能力"与"数据质量"的双向增强。整体流程可概括为:初始化预训练→微调CapFilt双模块→数据自举生成高质量数据集→回流训练最终模型,具体步骤如下:

-

二、分步拆解流程(含关键问题解答)

-

第一步:初始Model Pretraining(基础能力搭建)

这一步的核心目标是训练一个"基础版MED模型",为后续CapFilt双模块提供生成和判别能力,不直接对接下游任务。

-

训练目标:联合优化3.2节的三大预训练目标函数(ITC+ITM+LM),让模型同时具备:

-

粗粒度图文对齐能力(ITC)、细粒度图文匹配判别能力(ITM);

-

图像条件下的文本生成能力(LM)。

-

-

输出产物:基础版MED模型(未达SOTA,但具备核心功能)。

-

关键说明:

-

下游任务(如下文检索、图像字幕生成)此时不参与训练,仅作为后续验证模型性能的"评测标准",而非训练过程的输入。

-

这一步的核心是"给模型赋能",让它能后续微调为CapFilt的生成器和过滤器。

-

-

-

第二步:CapFilt双模块微调(专项能力强化)

基于第一步的基础版MED模型,分别微调"字幕生成器"和"过滤器",让它们适配数据处理需求。

- 第三步:Dataset Bootstrapping(高质量数据集生成)

这一步是CapFilt的核心,用微调后的双模块处理大规模网络数据,生成最终回流的高质量数据集(D)。

-

关键问题解答(问题2):

- 最终数据集(D)回流到Model Pretraining时,完全作为标注样本来使用------每一条数据都是"图像+匹配文本"的成对标注样本,相当于为模型提供了"干净、多样、大规模"的训练数据,替代了原始噪声数据集。

-

第四步:最终Model Pretraining(模型性能强化)

用自举数据集(D)重新训练模型,实现性能突破。

-

输入数据:第三步生成的高质量自举数据集(D)(无原始噪声数据)。

-

训练目标:仍联合优化ITC+ITM+LM三大目标函数------但此时数据质量已大幅提升,目标函数能更高效学习。

-

训练特点:

-

数据无噪声:ITC/ITM不会学到"错误图文对齐",LM不会生成偏离图像的字幕;

-

数据多样性高:合成字幕覆盖长尾场景,模型能学到更全面的视觉-语言映射关系。

-

-

输出产物:最终版BLIP模型(达到SOTA性能,可直接用于下游任务)。

-

-

第五步:下游任务验证(流程闭环)

-

核心作用(问题1解答) :下游任务(图像-文本检索、图像字幕生成、VQA等)在整个流程中是"性能验证者",而非"训练参与者":

-

不参与Model Pretraining和Dataset Bootstrapping的任何训练环节;

-

仅用于测试"基础版模型"和"最终版模型"的性能差异,验证CapFilt的数据优化效果(如最终版模型在检索任务中召回率@1提升2.7%)。

-

-

流程闭环 :若需进一步提升性能,可重复"微调CapFilt模块→生成新自举数据集→重新训练模型"的 循环 ,形成"模型越好→数据越优→模型更优"的正向循环。

-

问题9拓展:第三步 Dataset Bootstrapping(高质量数据集生成),完全过滤后才进行第四步的吗?还得每批次 修正后 都会训练

你的问题核心是"最终预训练的输入是否是'完全过滤后的干净数据'",以及"训练中是否会逐批次修正数据",答案先明确:

是完全过滤后才进入第四步训练 ,训练过程中不会再逐批次修正数据------ 数据清洗 (过滤)只在第三步Dataset Bootstrapping中完成,第四步仅用已净化的数据集D做纯 模型训练。

结合论文细节和流程逻辑,详细解释如下:

-

一、为什么是"完全过滤后"才进入第四步?

这和CapFilt的"数据自举逻辑"强相关,论文中明确了Dataset Bootstrapping的核心是"先一次性生成高质量数据集D,再用D完整训练模型",具体依据:

第四步的核心目标是让模型在高质量数据上"充分学习正确的视觉-语言映射",而不是继续修正数据。如果训练中还逐批次修正,会导致数据分布不稳定(比如同一图像时而被保留、时而被剔除),反而干扰模型学习,违背CapFilt"用干净数据稳定训练"的初衷。

论文中提到"CapFilt能提升性能"的关键实验(表1),就是对比"用原始噪声数据训练"和"用D训练"的差异------如果D不是完全过滤的,就无法明确性能提升是来自数据清洗,还是训练中逐批次修正,实验结论会失去说服力。

-

第三步的输出是"成品数据集D":

-

第四步的定位是" 模型训练 ",而非"数据再处理":

-

论文实验设计的佐证:

-

-

二、为什么训练中不会"每批次修正后再训练"?

这和CapFilt的模块分工、训练效率有关:

CapFilt的过滤器是"离线工具"------只在第三步做一次全量数据过滤,生成D后就不再参与后续流程。第四步训练时,模型(最终版BLIP)的训练目标是ITC/ITM/LM,不会调用过滤器实时判断样本是否匹配,自然不会逐批次修正数据。

若每批次都要先修正数据(重新判断匹配度),会额外增加大量计算成本(相当于训练时要同时跑"过滤+模型更新"两步);且同一批数据可能因模型参数变化导致"匹配判断结果波动",数据分布不一致会让模型收敛困难。

论文中预训练细节明确提到"预训练数据集是固定的(14M或129M已处理数据)",训练时仅做常规的数据增强(如随机图像裁剪),无任何"实时过滤"的操作描述,进一步说明数据是先过滤完再训练。

-

模块分工明确:过滤是"预处理步骤",而非"训练中的实时步骤":

-

实时修正会导致训练低效且不稳定:

-

论文的训练流程验证:

-

-

三、补充:第四步训练的完整逻辑(结合"完全过滤")

再梳理第四步的流程,更清晰体现"用干净数据训练":

-

输入:第三步生成的"完全过滤后"的数据集D(无任何噪声样本);

-

数据预处理:仅做常规操作(如图像分辨率调整、文本tokenization、批次划分),不涉及任何"匹配判断"或"样本剔除";

-

训练过程:模型按批次读取D中的样本,联合优化ITC/ITM/LM三大目标------因为样本都是"图像-文本匹配"的,模型学到的都是正确的映射(比如"蛋糕图像"只对应"蛋糕相关文本");

-

输出:收敛后的最终版BLIP模型,直接用于下游任务评测。

-

-

总结

CapFilt的"数据处理-模型训练"逻辑是"先全量过滤生成干净数据集D(第三步),再用D纯训练模型(第四步) ":

这种设计既保证了数据质量的稳定性,又提升了模型训练的效率,最终才能实现论文中报告的SOTA性能。

所有实验

-

第四步的输入是"完全过滤后的成品D",无原始噪声数据;

-

训练中不会逐批次修正数据,过滤器仅在第三步发挥作用,第四步只专注模型参数更新。

-

Table1 实验评估标准-实验1:

以下按"基础概念→任务场景→评估指标"分类,用通俗中文解释所有术语,贴合BLIP论文实验场景:

-

一、基础核心概念

-

Pre-train(预训练):模型训练的第一阶段,用大规模数据让模型先学会通用能力(比如BLIP先学图文对齐、文本生成),为后续任务打基础,后续可通过微调适配具体场景。

-

Dataset(数据集):模型训练/评测用的"样本集合",BLIP中多是"图像+文本"成对数据(如人工标注的COCO数据集、网络爬取的噪声数据集)。

-

Bootstrap(自举):论文中特指"用模型自身能力优化数据,再用优质数据强化模型"的闭环过程(即CapFilt流程),无需额外人工标注,实现"数据-模型"双向增强。

-

Vision backbone(视觉骨干网络):模型中负责提取图像特征的核心模块,BLIP中用的是ViT(视觉Transformer),分为ViT-B(基础版)和ViT-L(大型版),骨干越强,图像特征提取越精准。

-

-

二、任务场景(实验中的评测任务)

-

Retrieval-FT (COCO)(微调图像-文本检索任务):

-

Retrieval:检索任务(分"文本查图像"和"图像查文本");

-

FT(Finetune):微调------用COCO数据集的标注数据进一步训练预训练模型,适配检索任务;

-

场景:在COCO数据集上评测"微调后模型的检索性能"。

-

-

Retrieval-ZS (Flickr)(零样本图像-文本检索任务):

-

ZS(Zero-shot):零样本------模型未在Flickr数据集上微调,直接用预训练能力评测;

-

场景:在Flickr数据集上评测"模型的检索泛化能力"(无需专门适配)。

-

-

Caption-FT (COCO)(微调图像字幕生成任务):

-

Caption:字幕生成任务(根据图像写文本描述);

-

FT:用COCO数据集微调模型;

-

场景:在COCO数据集上评测"微调后模型的字幕生成质量"。

-

-

Caption-ZS (NoCaps)(零样本图像字幕生成任务):

-

ZS:零样本------模型未在NoCaps数据集上微调;

-

场景:在NoCaps数据集上评测"模型的字幕生成泛化能力"。

-

-

-

三、评估指标与模块标识

-

模块标识:

-

C(Captioner):字幕生成器(CapFilt中的核心模块,为图像生成合成字幕);

-

F(Filter):过滤器(CapFilt中的核心模块,过滤噪声图文对)。

-

-

检索任务指标(Retrieval):

-

TR@1(Text Retrieval@1):文本到图像检索的召回率@1------给定文本描述,在图像库中找到最匹配图像的概率(越高越好);

-

IR@1(Image Retrieval@1):图像到文本检索的召回率@1------给定图像,在文本库中找到最匹配描述的概率(越高越好)。

-

-

字幕生成任务指标(Caption):

-

B@4(BLEU@4):BLEU指标的4元组版本------衡量生成字幕与真实字幕的n元词组重合度(越高表示越相似);

-

CIDEr:衡量生成字幕与真实字幕的语义一致性(比BLEU更侧重语义匹配,越高越好);

-

SPICE:衡量生成字幕的语义相关性和语法正确性(更贴合人类评价标准,越高越好)。

-

-

-

COCO+VG+CC+SBU(14M imgs)与COCO+VG+CC+SBU+LAION(129M imgs)

这两组是BLIP模型预训练中使用的核心数据集组合,核心差异在于"是否加入LAION数据集",进而导致数据规模、噪声水平和模型训练效果的显著不同。以下从数据集构成、核心差异、对BLIP训练的影响三方面详细解释:

|-------|--------------------------------------|---------|--------------------------|----------------------------------------------------------------|

| 数据集缩写 | 全称/核心信息 | 数据类型 | 规模(约) | 核心特点与用途 |

| COCO | Common Objects in Context(微软发布) | 人工标注高质量 | 33万张图(20万张带标注) | 涵盖80个物体类别,提供边界框、分割掩码、图像描述等精细标注,是视觉-语言任务的"黄金标准",用于校准模型基础能力。 |

| VG | Visual Genome(视觉基因组) | 人工标注细粒度 | 10.8万张图 | 聚焦"图像语义结构化",标注含物体关系(如"人-拿着-手机")、区域描述、问答对,补充COCO缺乏的"细粒度语义关联"信息。 |

| CC | Conceptual Captions(含CC3M和CC12M两个版本) | 网络爬取低噪声 | 3M+12M=15M图 | 从网页中提取"图像+文本描述"对,文本与图像相关性较高(如"红色消防车停在街道"),是网络数据中质量较好的补充源。 |

| SBU | SBU Captions | 网络爬取低噪声 | 100万图 | 早期网络图文数据集,文本多为简洁场景描述(如"小狗在草坪奔跑"),噪声较少,常用于视觉-语言预训练的基础网络数据。 |

| LAION | LAION-400M(Schuhmann等人发布) | 网络爬取高噪声 | 400万图(BLIP中使用约1/5,即80M+) | 大规模网页爬取数据集,文本噪声远高于CC/SBU(如"蛋糕图像配文'公园日落'"),但胜在规模极大,能覆盖更多长尾视觉场景。 |

- 二、两组数据集组合的核心差异

两组组合的本质是"基础高质量小数据集"与"基础+大规模噪声数据集"的对比,具体差异体现在4个维度:

|-------------|----------------------------------------------------|------------------------------------------------------|-------------------------------------------------|

| 对比维度 | COCO+VG+CC+SBU(14M imgs) | COCO+VG+CC+SBU+LAION(129M imgs) | 关键影响 |

| 数据规模 | 1400万张图像-文本对(人工标注占比约10%,网络数据占90%) | 1.29亿张图像-文本对(LAION贡献约80M+,占比超60%) | 规模提升9倍,理论上能让模型接触更多长尾视觉概念(如罕见物体、小众场景)。 |

| 数据质量/噪声 | 整体质量高:人工标注数据(COCO/VG)无噪声,网络数据(CC/SBU)噪声低,文本与图像匹配度高 | 质量分层:保留原高质量部分,但新增LAION噪声高,大量文本与图像无关(如"汽车图像配文'咖啡价格'") | 噪声引入可能导致模型学到"错误图文对齐",但规模优势可能覆盖噪声负面影响。 |

| 数据多样性 | 覆盖常见场景(如日常物体、人像、交通工具),但长尾场景(如冷门动物、特殊职业)覆盖不足 | 加入LAION后,覆盖极广:从日常场景到小众场景(如极地科考、传统手工艺),视觉概念多样性大幅提升 | 多样性提升能增强模型泛化能力,尤其在零样本任务(如视频-语言迁移)中效果更明显。 |

| 数据来源构成 | 人工标注(COCO/VG)+ 低噪声网络数据(CC/SBU),无高噪声大规模数据 | 在前组基础上,新增"高噪声+大规模"网络数据(LAION),数据来源更复杂 | 需依赖BLIP的CapFilt(字幕生成+过滤)模块"提纯"数据,否则噪声会严重影响训练效果。 |

- 三、两组数据集对BLIP模型训练的实际影响(结合论文实验)

BLIP论文中明确对比了两组数据集的训练效果,核心结论是"加入LAION需配合CapFilt,才能发挥规模优势",具体影响如下:

-

- 对模型性能的影响:规模提升≠直接性能提升,需"去噪声"

-

未用CapFilt时:

仅加入LAION的129M组合,性能提升有限甚至波动------因LAION的高噪声会让模型学到"错误的图文映射"(如ITC损失对齐"蛋糕图像"与"日落文本"),抵消规模带来的优势。

而14M组合(无LAION)因数据干净,模型在基础任务(如图像-文本检索)上能稳定学习,但多样性不足导致泛化能力弱(如零样本迁移到视频任务时效果差)。

- 用CapFilt去噪声后:

129M组合的优势完全显现:

-

在图像-文本检索任务中,COCO微调后的TR@1(文本到图像召回率@1)从14M组合的80.6提升到81.9,IR@1(图像到文本召回率@1)从63.1提升到64.3;

-

在零样本字幕生成(NoCaps数据集)中,CIDEr指标从105.1提升到106.3;

-

若进一步用ViT-L作为视觉骨干,129M组合的性能会更优(如TR@1达82.4,IR@1达65.1),证明"大规模去噪数据+强骨干"能最大化模型能力。

-

- 对训练策略的影响:129M组合必须依赖CapFilt, 这说明光有数据是不够的,数据质量还要高。

14M组合(无LAION)因数据噪声低,即使不用CapFilt,模型也能训练出基础性能;但129M组合(含LAION)若去掉CapFilt,噪声会严重干扰训练------BLIP论文实验显示,未用CapFilt的129M组合,性能仅比14M组合高0.5%~1%,远低于"去噪后"的2%~3%提升。

这说明:LAION的"规模优势"需要CapFilt(生成器补充优质合成字幕、过滤器剔除噪声)来"转化",否则大规模噪声反而会成为训练负担。

-

- 对模型泛化能力的影响:129M组合更擅长"零样本迁移"

BLIP的核心优势之一是"零样本迁移到视频-语言任务"(如文本-视频检索、视频问答),这一能力主要依赖129M组合的多样性:

-

14M组合因场景覆盖有限,零样本迁移到MSRVTT视频检索时,召回率@1仅84.9;

-

129M组合(去噪后)因LAION覆盖了更多"动态场景相关视觉概念"(如"人骑自行车""海浪拍打礁石"),零样本召回率@1提升到85.5,甚至超过部分在视频数据上微调的模型。

-

四、总结:两组数据集的核心定位

简单来说,这两组数据是BLIP模型"从'基础款'到'增强款'"的关键:

-

COCO+VG+CC+SBU(14M imgs):BLIP的"基础训练集",特点是"小而精",无需复杂去噪就能让模型掌握核心的视觉-语言对齐能力,适合验证模型架构的有效性(如MED混合架构、三大预训练目标);

-

COCO+VG+CC+SBU+LAION(129M imgs):BLIP的"性能增强集",特点是"大而杂",需配合CapFilt去噪后,才能通过规模和多样性的优势,让模型在下游任务(尤其是零样本迁移)中达到SOTA性能,是BLIP实现"统一视觉-语言理解与生成"的核心数据支撑。

-

table1 是四组实验,彼此之间是 独立的吗,因为他们的指标差异很大。作者选这四组的用意是什么

场景1:Retrieval-FT (COCO)(微调图像 - 文本检索任务)

场景2:Retrieval-ZS (Flickr)(零样本图像 - 文本检索任务)

场景3:Caption-FT (COCO)(微调图像字幕生成任务)

场景4:Caption-ZS (NoCaps)(零样本图像字幕生成任务)

我这里的疑问是:

1.上面四个场景,分成了2组,第一组是文本检索任务,第二组是:图像字幕生成任务

2.在文本检索任务中,一个使用了微调,一个没使用微调

3.在文本检索任务中,微调为什么选用coco数据集? 没微调为什么选用Flickr数据集?

3.在文本检索任务中, 为什么没有微调的指标反而更高

4.在图像字幕生成任务中,一个使用了微调,一个没使用微调

5.在图像字幕生成任务中,微调为什么选用coco数据集? 没微调为什么选用NoCaps数据集?

6.在图像字幕生成任务中, 为什么没有NoCaps微调的指标反而更高

-

一、核心前提:四组实验是"关联对照"而非独立,指标差异是场景设计的必然结果

作者设计这四组实验的核心用意,是全面验证BLIP模型的"任务适配能力"和"泛化能力" ------既验证模型在"熟悉数据+适配训练"下的任务性能(微调场景),也验证模型在"陌生数据+无适配训练"下的迁移能力(零样本场景),同时覆盖"理解类任务"(检索)和"生成类任务"(字幕),形成"任务类型×训练方式"的完整评估矩阵,确保结论的全面性和可信度。

简单说:四组实验是"一套组合拳",而非孤立测试------通过对比不同场景下的性能,才能证明CapFilt优化后的模型,既擅长"针对性任务微调",又具备"跨数据集零样本迁移"能力,这正是BLIP"统一视觉-语言理解与生成"的核心目标。

-

二、逐问解答核心疑问

-

- 为何分为"检索"和"字幕生成"两组任务?

这是BLIP的核心定位决定的:BLIP要解决"统一理解与生成"的问题,必须同时验证两类核心任务:

两组任务分别对应BLIP的两大核心功能,只有同时在两类任务中表现优异,才能证明模型的"统一性"和有效性。

-

检索任务(理解类):考验模型"判断图文相关性、对齐语义空间"的能力(如"文本找图像""图像找文本");

-

字幕生成任务(生成类):考验模型"将视觉特征转化为连贯文本"的能力(如"根据图像写描述")。

-

- 检索任务:为何微调选COCO、零样本选Flickr?

核心逻辑是"训练数据与评测数据分离,避免数据泄露,公平验证泛化能力",具体原因:

-

微调选COCO:COCO是视觉-语言任务的"标准训练集"------标注质量高、场景覆盖广(80类物体),且BLIP的预训练数据已包含COCO(人工标注部分),微调时能快速适配检索任务(相当于"用熟悉的数据做针对性优化");

-

零样本选Flickr30K:Flickr30K与COCO是完全独立的数据集(图像来源、场景分布不同,无重叠),且模型未在Flickr30K上做任何微调------此时评测的是模型"从COCO学到的通用图文对齐能力,能否直接迁移到陌生数据",避免因"训练集与评测集重叠"导致的性能虚高。

-

- 检索任务中,为何零样本指标反而更高?

这不是普遍规律,而是实验数据的"场景特异性"导致的,核心原因有3点:

-

数据集难度差异:Flickr30K的检索任务难度低于COCO------Flickr30K的文本描述更简洁、图文匹配度更高(如"小狗在草坪"对应单一图像),而COCO的文本描述更复杂、图像场景更丰富(如"戴帽子的人在公园玩飞盘"),导致COCO微调后的绝对指标看似低,实则是任务难度更高;

-

模型泛化能力强:BLIP经CapFilt优化后,学到的是"通用图文对齐能力",而非"过拟合COCO的特定场景"------Flickr30K的简单场景更能凸显这种通用能力,而COCO的复杂场景需要更多微调迭代才能追上;

-

评测指标的"基数效应":零样本任务的"基准指标"本身较低(其他模型的Flickr零样本召回率多在70%左右),而BLIP因数据优化,泛化能力大幅提升,导致相对提升更明显,最终指标超过COCO微调(COCO微调的基准指标本身更高,提升空间更小)。

-

- 字幕生成任务:为何微调选COCO、零样本选NoCaps?

逻辑与检索任务一致,核心是"训练-评测分离,验证生成能力的泛化性":

-

微调选COCO:COCO的字幕标注是"黄金标准"------每张图有5条高质量描述,覆盖不同角度(如"红色蛋糕""撒糖的巧克力蛋糕"),微调时能让模型快速学习"图像→文本"的生成逻辑(相当于"用优质数据校准生成风格");

-

零样本选NoCaps:NoCaps是专门为"零样本字幕生成"设计的数据集------图像场景与COCO差异大(含更多长尾场景,如"极地科考""传统手工艺"),且模型未在NoCaps上做任何微调,能公平验证模型"生成能力的迁移性"(避免过拟合COCO的常见场景)。

-

- 字幕生成任务中,为何NoCaps零样本指标反而更高?

与检索任务类似,核心是"数据集特点+模型泛化能力",具体原因:

-

指标计算逻辑差异:COCO微调的指标(B@4、CIDEr)是"与人工标注的相似度评分"------COCO的人工标注风格固定(简洁、客观),模型微调后会刻意贴合这种风格,导致评分受"风格匹配度"限制;而NoCaps的零样本指标(CIDEr、SPICE)更侧重"语义正确性",只要生成的字幕与图像内容匹配,无论风格如何都会给高分,对模型的"语义理解能力"更友好;

-

模型生成的"多样性优势":零样本生成时,模型未被COCO的标注风格束缚,生成的字幕更灵活(如COCO微调后可能只生成"蛋糕",零样本时可能生成"撒糖粒的巧克力蛋糕"),而NoCaps的评测指标(如SPICE)更鼓励语义丰富的描述,导致指标更高;

-

数据集难度差异:NoCaps的零样本子集(如val集)的图像场景虽陌生,但文本描述的"语义复杂度"低于COCO的测试集,模型更容易生成匹配的字幕。

-

三、总结:四组实验的设计巧思

作者选这四组场景,本质是为了回答3个核心问题,形成完整的逻辑闭环:

-

模型能否在"理解类任务"(检索)中表现优异?(COCO微调+Flickr零样本);

-

模型能否在"生成类任务"(字幕)中表现优异?(COCO微调+NoCaps零样本);

-

模型的能力能否"跨数据集迁移"?(零样本场景验证)。

-

-

这种设计既避免了数据泄露,又能全面验证模型的"任务适配性"和"泛化性",最终证明:BLIP不仅能在熟悉数据上通过微调达到高性能,还能在陌生数据上直接发挥作用------这正是CapFilt数据优化的核心价值,也是BLIP成为SOTA模型的关键。

bilp论文中,直观呈现CatFilt的核心逻辑与数据处理流程

这幅图是核心目的是:直观呈现CatFilt的核心逻辑与数据处理流程。

左侧图是网上爬取的图片,第一行是网络爬取的文本,

下面是通过caption模块给这张图像生成一个文本,右侧是filter模块用于检测文本是否匹配。

简单来说就是:用'生成器写文案、过滤器做质检',把网络噪声数据变成优质训练数据,给 BLIP 模型喂上'好燃料'。

这里我想问的是:在capfilt中,从网络上爬取是图像对应的文本TW和caption生成的 Ts 同时送入filter后,做了怎么样的处理,因为TW和Ts都由红色变成了绿色

你的观察很关键!TW(原始网络文本)和Ts(合成字幕)从红色变绿色,核心是过滤器(Filt)对两者执行了"统一的图文匹配判别", 仅保留"与图像高度对齐"的优质样本,剔除噪声样本------红色代表"待筛选的原始/合成文本(含噪声)",绿色代表"通过筛选的干净文本(与图像匹配)"。

具体处理流程和细节如下,结合论文逻辑拆解:

- 一、核心处理原则:TW和Ts"一视同仁",用同一标准筛选

过滤器不会因为TW是"原始网络文本"就特殊对待,也不会因为Ts是"模型生成文本"就直接放行,而是对两者采用完全相同的判别标准和流程------本质是让过滤器扮演"公正的质检官",只看"文本是否能准确描述图像",不看文本来源。

-

二、具体处理步骤(对应Figure 1的流程)

-

输入阶段:过滤器同时接收三类数据

-

网络图像(Iw):作为"判断基准",提供视觉特征(由ViT提取);

-

原始网络文本(Tw):网络爬取的原始标注(红色,含大量噪声,比如"蛋糕图配文'公园日落'");

-

合成字幕(Ts):生成器(Cap)为Iw生成的新文本(红色,虽由模型生成,但仍可能有少量噪声,比如"蛋糕图生成'巧克力饼干'")。

-

-

判别阶段:用"图文匹配分数"决定取舍

过滤器的核心是"图像引导文本编码器"(经ITC+ITM损失微调),会对每一对(Iw, Tw)和(Iw, Ts)分别计算"图文匹配度":

第一步:将Iw的视觉特征和文本(Tw/Ts)的语言特征,通过交叉注意力融合,得到多模态特征;

第二步:用ITM头(二分类器)对多模态特征打分,输出"匹配概率"(0~1之间,越接近1表示匹配度越高);

第三步:设定一个阈值(比如0.5,论文未明确给出但逻辑必然存在),概率高于阈值则判定为"匹配",低于阈值则为"噪声"。

-

输出阶段:仅保留匹配样本,统一标为绿色

-

对Tw:若匹配概率≥阈值(比如"蛋糕图配文'巧克力蛋糕'"),则保留,从红色变绿色;若<阈值(比如"蛋糕图配文'公园日落'"),则直接剔除;

-

对Ts:若匹配概率≥阈值(比如"蛋糕图生成'撒糖粒的巧克力蛋糕'"),则保留,从红色变绿色;若<阈值(比如"蛋糕图生成'巧克力饼干'"),则直接剔除;

-

最终绿色的Tw和Ts,会与人工标注的优质文本(Th)一起,组成干净的自举数据集D。

-

情况 1:TW 合格、Ts 合格:(Iw, 绿色 TW)和(Iw, 绿色 Ts)都会被保留,同一张 Iw 对应两条干净文本,丰富训练样本;

-

情况 2:TW 合格、Ts 不合格:仅保留(Iw, 绿色 TW),Iw 随合格的 TW 一起进入数据集 D;

-

情况 3:TW 不合格、Ts 合格:仅保留(Iw, 绿色 Ts),Iw 随合格的 Ts 一起进入数据集 D;

- 情况 4:TW 和 Ts 都不合格:这张 Iw 没有任何匹配的干净文本,会被直接剔除(因为模型训练需要 "图像 + 文本" 成对数据,无合格文本的图像无法用于训练)。

-

-

-

-

三、关键补充:为什么Ts的"绿色通过率"通常比Tw高?

虽然处理标准一致,但实验中Ts最终成为绿色的比例(通过率)远高于Tw,核心原因是:

-

Ts是"基于图像生成"的:生成器(Cap)经LM损失微调后,本身就具备"根据图像生成匹配文本"的能力,Ts的初始匹配度就比Tw高(Tw是网络随机爬取,很多与图像无关);

-

过滤器和生成器"同源校准":两者都基于同一基础MED模型微调,且用人工标注数据(Ih, Th)校准过------生成器知道"什么样的文本能匹配图像",过滤器也知道"什么样的文本是优质的",相当于"生成器按过滤器的'审美'写文案",自然通过率更高。

-

-

四、一句话总结颜色变化的本质

红色→绿色,不是"文本被修改或合并",而是过滤器通过"图文匹配判别",给Tw和Ts打上了"合格标签" ------只有通过"文本是否准确描述图像"的检验,才能从"待筛选的噪声候选"(红色)变成"可用于训练的干净样本"(绿色)。

Table 2 实验:合成字幕生成中束搜索与核采样的对比

- 一、实验核心目标

这是验证合成字幕 "多样性" 对模型下游任务性能影响 的关键实验。论文通过对比两种主流文本生成解码策略 ------束搜索(Beam Search) 和核采样(Nucleus Sampling) 在合成字幕生成中的效果,回答一个核心问题:为自举 数据 集生成合成字幕时,应该优先追求 "文本准确性" 还是 "文本多样性"?

对于 CapFilt 的自举数据集而言,合成字幕的 "多样性" 比 "低噪声率" 更重要。

-

束搜索追求 "高匹配率",但牺牲了多样性,相当于给模型喂 "重复的剩饭";

-

核采样牺牲了部分匹配率,但保留了多样性,相当于给模型喂 "营养丰富的新菜"------ 即使剔除部分坏菜,剩余的营养也远超剩饭。

Table 2 的实验告诉我们:为自举数据集生成合成字幕时,宁要 "多样的优质字幕 + 少量噪声",不要 "模板化的安全字幕 + 无噪声"------ 多样性才是提升模型泛化能力的关键。

Table 3 实验:预训练阶段文本编码器与解码器的参数共享策略对比

-

一、实验核心目标

BLIP 采用编码器 - 解码器(Encoder-Decoder)架构 实现视觉 - 语言的 "理解 + 生成" 统一任务,其中文本侧包含文本编码器 (负责将文本转化为特征,支撑图文检索等理解类任务)和文本解码器(负责基于图像特征生成文本,支撑字幕生成等生成类任务)。

Table 3 的核心目标是 探究文本编码器与解码器之间的参数共享策略,对模型预训练效率和下游任务性能的影响 ,回答一个关键问题:文本编码器和解码器是共享全部参数、部分参数,还是完全分离参数时,模型的综合性能最优?

Table 3 的核心结论可总结为 "部分参数共享策略在 性能和效率上 实现最优平衡",

Table 4 实验:字幕生成器(Captioner)与过滤器(Filter)的参数共享效果对比

Table 4 的核心目标是 探究 Cap 与 Filt 之间的参数共享策略,对数据自举质量和最终模型性能的影响 ,回答一个关键问题:Cap 和 Filt 是共享参数、还是使用独立参数时,能更高效地完成 "生成优质合成字幕 + 过滤噪声" 的任务?

无论哪种策略,Cap 和 Filt 的初始参数均来自同一基础 MED 模型(经 ITC+ITM+LM 预训练)------ 实验的变量是 "微调阶段是否共享参数",而非 "初始模型是否相同",这是保证对比公平的核心前提。

-

Cap与Filt三种参数共享策略对比表

|---------------|---------------------------------------------------------------------------|----------------------------------------------------------------------------------------|--------------------------------------------------------------|

| 对比 维度 | 完全共享(Full Sharing) | 部分共享(Partial Sharing) | 完全独立(No Sharing) |

| 核心原理 | Cap与Filt共用同一套基础MED模型参数,微调时联合优化LM(生成)+ ITC/ITM(判别)损失 | 共享视觉骨干(ViT) + 底层文本特征层参数;上层任务层(Cap生成层、Filt的ITM分类头)独立微调 | Cap与Filt从基础MED模型初始化后,采用两套完全独立参数,分别微调各自任务损失 |

| 参数规模 | 最小(仅1套参数,无冗余) | 中等(通用层共享,任务层独立,参数量略高于完全共享) | 最大(2套独立参数,参数量翻倍,存在通用层参数冗余) |

| 模块关联性 | 强关联:生成与判别任务梯度互相影响,能力绑定紧密 | 中等关联:通用特征提取能力一致,专项任务能力独立优化 | 无关联:生成与判别任务完全隔离,梯度互不干扰 |

| 优点 | 1. 微调速度最快,计算/存储成本最低<br>2. 无需额外维护多套参数,工程部署简单 | 1. 通用特征对齐,Cap生成的字幕更贴合Filt判别标准,减少优质样本误删<br>2. 任务层独立,避免生成/判别目标冲突<br>3. 兼顾性能与效率,参数量可控 | 1. 模块能力专一:Cap专注生成多样性字幕,Filt专注精准过滤噪声<br>2. 无任务梯度干扰,下游任务性能稳定 |

| 缺点 | 1. 生成(发散性)与判别(收敛性)任务目标冲突,梯度互相抵消<br>2. 合成字幕多样性不足,过滤精准率低<br>3. 下游任务性能最差 | 1. 需设计分层共享策略,模型架构略复杂<br>2. 调参成本略高于完全共享 | 1. 参数量翻倍,计算/存储成本高<br>2. 通用特征层参数冗余,模块间无能力协同<br>3. 工程部署成本高 |

| 性能表现 | - 合成字幕匹配率:低<br>- 过滤精准率:低<br>- 下游任务(检索/字幕)指标:最差 | - 合成字幕匹配率:高<br>- 过滤精准率:高<br>- 下游任务指标:最优(FT/ZS场景均领先) | - 合成字幕匹配率:中高<br>- 过滤精准率:中高<br>- 下游任务指标:良好(略低于部分共享) |

| 适用场景 | 1. 资源受限场景(如边缘设备部署)<br>2. 对性能要求不高的快速验证实验 | 1. 追求性能与效率平衡的主流场景<br>2. BLIP论文核心采用的策略,支撑SOTA性能<br>3. 大规模数据自举的工业级部署 | 1. 计算资源充足的科研场景<br>2. 需最大化模块独立能力的专项任务优化 |

Table 4 的实验告诉我们:CapFilt 框架中,字幕生成器与过滤器采用 "底层共享通用特征、上层分离专项任务" 的参数策略时,既能保证模块能力专一,又能实现高效协同,最终最大化数据自举的价值。

|-------------------|-----------------------------------------------------------------------------------------------------------------------------------|------|---------------------------------------------------------|

| 层级类型 | 具体组件 | 策略 | 核心作用 |

| 底层共享层(通用特征提取) | 1. 视觉骨干(ViT):图像特征提取的卷积/Transformer层<br>2. 底层文本特征层:文本token的嵌入层、前几层Transformer编码器(负责基础语义编码)<br>3. 跨模态交互层:视觉-文本双向注意力模块(负责图文特征对齐) | 完全共享 | 输出一致的图像全局/局部特征、文本基础语义特征,保证Cap与Filt对"图像内容"和"文本基础含义"的理解一致 |

| 上层分离层(专项任务执行) | 1. Cap专属层:Transformer解码器的上层生成头(LM头,负责文本生成与多样性建模)<br>2. Filt专属层:ITM分类头(二分类,判断图文匹配)+ ITC对比学习层(图文特征相似度计算) | 完全分离 | 各自承接通用特征,独立完成"生成(发散)"与"判别(收敛)"的专项任务,避免任务目标冲突 |

Table 5 实验:与图像-文本检索 SOTA 方法的性能对比

-

一、实验核心目标

-

Table 5 是 BLIP 论文的**"性能收官实验",核心目标是 将 BLIP 模型(尤其是优化后的 BLIP-CapFilt-L 版本)与当时图像-文本检索任务的主流 SOTA 方法做公平对比,证明 BLIP 凭借 "CapFilt 数据自举 + MED 混合架构" 的设计,能在标准检索数据集(COCO、Flickr30K)** 上达到或超越现有最优水平,夯实论文的核心贡献。

-

简单说,这张表的作用是 "秀肌肉" ------ 前面的实验验证了 CapFilt、参数共享等模块的有效性,这张表则直接证明:把这些模块整合后,BLIP 是当时检索任务的顶尖模型之一。

-

Table 5 通过与主流 SOTA 模型的公平对比,证明了 "ViT-B 主体 + ViT-L 增强的 CapFilt 数据自举" 是实现高性能图像-文本检索的最优组合之一,也最终夯实了 BLIP 作为统一视觉-语言模型的核心竞争力。

Table 5 选用 BLIP-CapFilt-L 而非仅用 ViT-L 的基础版,核心是 "数据自举增益>单纯模型放大增益",同时兼顾性能、成本与论文核心贡献,具体原因如下:

|--------|-----------------------|------------------------------------|------------------------------------|

| 对比维度 | BLIP-ViT-L(基础版) | BLIP-CapFilt-L | 选用 CapFilt-L 的理由 |

| 数据来源 | 原始 14M/129M 噪声 Web 数据 | CapFilt 提纯的自举数据集(14M 或 129M 去噪后数据) | 噪声少、图文对齐度高,训练出的图文检索模型泛化性与细粒度对齐能力更强 |

| 模型架构逻辑 | 单纯放大视觉骨干,无数据自举模块 | "ViT-L 提纯数据 + ViT-B 主体训练" 的分层设计 | 用低成本主体模型达到高成本模型的性能,计算效率更高,更易落地 |

| 性能增益来源 | 仅依赖模型容量提升 | 数据质量提升 + 模型 - 数据协同优化 | |

Table 6 是 零样本(Zero‑shot)图像 - 文本检索在 Flickr30K 数据集上的性能对比

总结:

Table 6 用零样本检索实验,证明 BLIP 的 "CapFilt 数据自举 + MED 多任务预训练" 不仅能提升有监督微调性能,还能显著增强模型的跨模态语义泛化能力,让模型在无标注数据的场景下也能实现高性能检索,进一步夯实论文方法的通用性与有效性。

Table 7 实验详细讲解:与图像字幕生成 SOTA 方法的性能对比

核心目标是 将 BLIP-CapFilt-L 与当时图像字幕生成任务的主流 SOTA 模型,在 COCO Caption(经典有监督场景)和 NoCaps( 零样本 长尾场景 )两个 标准 数据集上做公平对比

在实际应用中,"无依赖 + 高性能" 的轻量化模型远比 "强依赖 + 略优性能" 的模型更具落地价值 ------ 这也是 BLIP 相较于强依赖 SOTA 模型的核心竞争力。

-

COCO Caption 场景指标解读:

-

BLIP-CapFilt-L vs 基础版 BLIP:

- 14M 数据下,基础版 BLIP 的 CIDEr 为 129.7;升级到 129M 数据 + CapFilt 后,指标提升至 133.3,涨幅 3.6 个点 ------ 核心增益来自 CapFilt 对数据的提纯(剔除噪声 + 补充长尾合成字幕),而非单纯增加数据量。

-

BLIP-CapFilt-L vs 强依赖模型:

- 与 LEMON base(200M 数据 + 物体检测器)的 CIDEr 持平(133.3),但 BLIP 无需额外检测器和高分辨率输入,成本更低。

-

BLIP-CapFilt-L vs 超大资源模型:

- SimVLM-huge 凭借 13 倍数据量(1.8B)和更大骨干,CIDEr 达 143.3,但 BLIP-CapFilt-L 仅用 129M 数据就实现了其 93% 左右的性能,性价比显著。

-

-

核心模型分类与对比(基于论文实际数据)

一、模型分类与核心特征(按"资源依赖+性能定位"划分)

|---------------|-------------------------------------------------------------------------------------------------------------------|------------------------------------------------------------------------------------------------------------------|------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------|

| 模型类别 | 代表模型(论文实际列出) | 核心特点 | 与BLIP-CapFilt-L的关键差异 |

| 常规SOTA模型 | 1. Enc-Dec (Changpinyo et al., 2021) 2. BLIP(14M) 3. BLIP(129M) | 1. 无额外依赖(无需物体检测器、高分辨率输入)<br>2. 预训练数据量中等(14M~129M)<br>3. 骨干为ViT-B(BLIP默认配置)<br>4. 无CapFilt数据自举模块(仅BLIP基础版) | 1. Enc-Dec:数据量15M,无多任务预训练,性能基础<br>2. BLIP(14M/129M):仅扩大数据量,未用CapFilt提纯,预训练数据含原始噪声<br>3. 核心差距:缺乏"生成合成字幕+过滤噪声"的CapFilt流程,数据质量低于BLIP-CapFilt-L |

| 强依赖SOTA模型 | 1. VinVL† (Zhang et al., 2021) 2. LEMON base† (Hu et al., 2021)(12M/200M) 3. LEMON large† (Hu et al., 2021)(200M) | 1. 性能优异,接近/部分超越常规模型 2. 强额外依赖:需预训练于2.5M带人工标注边界框的物体检测器3. 输入要求:高分辨率(800×1333),推理成本高 4. 数据量较大(12M~200M) | 1. BLIP-CapFilt-L无需物体检测器,仅用384×384常规分辨率,部署更轻便<br>2. 强依赖模型需额外标注数据(边界框),标注成本远高于BLIP-CapFilt-L<br>3. 核心差距:强依赖模型靠"额外检测器+高分辨率"提升性能,BLIP-CapFilt-L靠"数据质量优化"实现同等性能 |

| 超大资源模型 | SimVLM huge (Wang et al., 2021) | 1. 资源投入极大:训练数据量1.8B(是BLIP 129M的13倍) 2. 模型规模更大:视觉骨干比ViT-L更复杂 3. 仅优化交叉熵损失,无特殊数据处理策略 | 1. 数据量差距:BLIP-CapFilt-L仅用129M数据,是SimVLM huge的1/13<br>2. 参数量差距:SimVLM huge为超大模型,推理速度远低于BLIP-CapFilt-L(ViT-B主体)<br>3. 核心差距:SimVLM huge靠"堆数据+堆模型"提升性能,BLIP-CapFilt-L靠"数据提纯"实现高性价比 |强依赖 SOTA 模型 是 Table 7 中与 BLIP-CapFilt-L 对比的核心类别,核心特征是需依赖额外昂贵资源才能实现高性能------ 其性能优势并非仅来自模型本身的设计创新,而是建立在 "额外标注数据 + 专用组件 + 高算力" 的强依赖基础上,这也是它与 BLIP-CapFilt-L"轻量化、无额外依赖" 设计的核心差异。

强依赖SOTA模型与超大资源模型的核心区别对照表

基于BLIP论文(arXiv:2201.12086)的实验设计及两类模型的本质特征,从核心依赖、性能来源、成本结构、适用场景等维度,梳理二者的关键差异如下:

|------------------------|--------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------|-------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------|--------------------------------------------------|

| 对比维度 | 强依赖SOTA模型(代表:VinVL†、LEMON†) | 超大资源模型(代表:SimVLM-huge) | 核心差异总结 |

| 核心定义 | 需依赖额外专用组件/标注数据才能实现高性能的SOTA模型,性能优势与"强外部依赖"强绑定 | 仅通过"堆数据规模+堆模型参数量"实现高性能的SOTA模型,无额外专用组件依赖,但资源投入极大 | 强依赖模型靠"额外工具/标注",超大资源模型靠"规模堆砌" |

| 核心依赖项 | 1. 专用物体检测器 :需预训练于2.5M张带人工标注边界框的图像(标注成本极高)2. 高分辨率输入 :需800×1333分辨率图像(常规模型仅384×384)3. 专用标注数据:依赖与检测器对齐的物体类别标注 | 1. 超大规模训练数据 :如SimVLM-huge用1.8B图像(是BLIP 129M数据的13倍)2. 超大模型骨干 :视觉骨干比ViT-L更复杂(参数量级更高)3. 高算力支持:训练需海量GPU集群,推理显存占用高 | 强依赖模型是"质的依赖"(专用工具/标注),超大资源模型是"量的依赖"(数据/参数规模) |

| 性能增益来源 | 1. 物体检测器提供细 粒度 物体级特征 (如"红色杯子在桌子上"的位置/类别信息)<br>2. 高分辨率输入保留图像细节 (如小物体、边缘特征)<br>3. 专用标注数据减少特征歧义(避免"桌子上的杯子"被误判为"桌子上的盒子") | 1. 超大规模数据覆盖更多长尾场景 (降低数据稀疏性)2. 超大模型骨干提升特征表达能力 (捕捉更复杂的图文关联)3. 海量训练迭代优化参数拟合精度(减少泛化误差) | 强依赖模型靠"工具辅助提升特征精度",超大资源模型靠"规模提升特征覆盖度" |

| 成本 结构 | 1. 标注成本极高 :2.5M张图像的边界框标注需专业团队逐图完成,成本远超普通数据集<br>2. 部署成本高 :需同时加载"物体检测器+字幕生成模型",显存占用翻倍,推理速度慢<br>3. 维护成本高:检测器与生成模型需对齐更新,数据/模型迭代周期长 | 1. 数据 成本 高 :1.8B图像的收集、清洗需大量时间/人力,存储成本高 2. 算力成本极高 :训练需数十台高端GPU(如A100),电费/硬件投入是常规模型的10倍以上 3. 推理成本高:超大模型参数量导致单条推理耗时是常规模型的3-5倍 | 强依赖模型的核心成本是"标注+部署维护",超大资源模型的核心成本是"数据+算力" |

| 泛化能力 | 1. 常规场景泛化优 :在COCO等常见物体场景中,细粒度生成精度高(如"猫趴在木质桌子上")<br>2. 长尾场景泛化弱 :面对NoCaps中的罕见物体(如极地冰钻),检测器无法识别,性能骤降<br>3. 跨任务泛化差:依赖特定检测器的类别,难以迁移到无检测器支持的任务(如视频字幕) | 1. 长尾场景泛化优 :超大规模数据覆盖更多罕见物体,零样本泛化能力强(如NoCaps out-domain场景)2. 常规场景泛化稳 :超大模型骨干适配多数图文任务,无需针对场景调整 3. 跨任务泛化强:仅需简单适配(如视频帧特征拼接),即可迁移到视频-语言任务 | 强依赖模型"常规场景精、长尾场景弱",超大资源模型"全场景稳、长尾场景优" |

| 工程落地难度 | 1. 部署门槛高 :需高端GPU支持双模型加载,无法在边缘设备(手机、嵌入式设备)部署<br>2. 复现难度高 :需获取专用检测器权重+标注数据,普通团队难以复现<br>3. 适配难度高:更换任务(如从字幕生成到VQA)需重新训练检测器,灵活性差 | 1. 部署门槛中 :单模型部署,无需额外工具,但需中端以上GPU支持(如A10)<br>2. 复现难度中 :数据/模型权重公开(如SimVLM-huge开源),但训练需高算力<br>3. 适配难度低:跨任务迁移仅需微调输出层,无需修改核心架构 | 强依赖模型"难部署、难复现、难适配",超大资源模型"易适配、可复现、部署门槛较低" |

| 与BLIP-CapFilt-L的对比 | 1. 性能接近 :LEMON large†(强依赖)在COCO Caption的CIDEr(135.7)略高于BLIP-CapFilt-L(133.3)<br>2. 成本碾压 :BLIP无需检测器/高分辨率输入,部署成本仅为LEMON的1/3<br>3. 泛化持平:BLIP在NoCaps out-domain场景的CIDEr(111.5)与LEMON large†(111.3)基本持平 | 1. 性能略逊 :SimVLM-huge的COCO CIDEr(143.3)高于BLIP(133.3),但NoCaps overall的CIDEr(112.2)仅略高于BLIP(109.6)2. 性价比碾压 :BLIP数据量仅为SimVLM的1/13,推理速度是其3倍以上 3. 泛化互补:BLIP靠CapFilt提纯数据提升泛化,SimVLM靠规模提升泛化,二者在不同场景各有优势 | BLIP对强依赖模型的优势是"低成本+泛化灵活性",对超大资源模型的优势是"高性价比+部署效率" |

| 适用场景 | 1. 专业领域场景:如医疗图像字幕(需检测器识别病灶位置)、工业质检标注(需定位缺陷区域)2. 高性能服务器专用场景:如专业图像编辑软件的自动字幕生成(无边缘部署需求)3. 细粒度生成需求场景:如文物修复辅助(需精准描述文物细节) | 1. 通用AI服务场景:如搜索引擎的图文检索(需覆盖多场景)、智能相册的自动字幕(需适配长尾物体)2. 大规模工业化场景:如电商平台的商品图文匹配(需处理千万级商品图像)3. 零样本迁移场景:如视频-语言任务(无专用训练数据,靠泛化能力适配) | 强依赖模型适合"专业细粒度场景",超大资源模型适合"通用大规模场景" |强依赖SOTA模型是"靠专用工具/标注走专精路线 ",适合对细粒度精度有极致需求但可接受高成本的场景;超大资源模型是"靠规模堆砌走通用路线 ",适合需覆盖多场景、高泛化但可接受高算力投入的场景------二者的本质差异是"用工具辅助提升精度 "与"用规模提升覆盖度"的技术路线选择。

Table 7中BLIP系列包含3个版本,通过内部对比直接验证CapFilt的有效性:

|----------------|------|---------------------------------|--------------------------|

| BLIP版本 | 数据量 | 核心差异 | 关键性能(COCO Caption CIDEr) |

| BLIP(基础版) | 14M | 无CapFilt,用原始噪声Web数据 | 129.7 |

| BLIP(基础版) | 129M | 无CapFilt,仅扩大数据量(含噪声) | 131.4 |

| BLIP-CapFilt-L | 129M | 有CapFilt(ViT-L增强的生成器+过滤器),数据经提纯 | 133.3 |-

二、关键补充:BLIP系列内部对比(凸显CapFilt价值)

-

结论:仅扩大数据量(14M→129M),CIDEr仅提升1.7个点;而加入CapFilt后,同样129M数据,CIDEr再提升1.9个点------证明数据质量优化(CapFilt)比单纯扩大数据量更有效。

-

三、实验核心结论(基于真实模型对比)

-

常规SOTA模型:BLIP-CapFilt-L凭借CapFilt提纯的高质量数据,全面超越Enc-Dec和BLIP基础版,验证了"数据驱动性能提升"的核心论点;

-

强依赖SOTA模型:BLIP-CapFilt-L与LEMON base(200M)的CIDEr持平(133.3),但无需物体检测器和高分辨率输入,成本优势显著;

-

超大资源模型:SimVLM huge虽在COCO Caption的CIDEr(143.3)领先,但资源消耗是BLIP-CapFilt-L的数十倍,性价比极低------BLIP-CapFilt-L用"小数据+高质量+轻架构"实现了"以小博大"。

-

-

-

一、 数据集与细分场景标注

|--------------------------------|-----------------------------|----------------------------------------------------------------|--------------------------------------|

| 标注 | 全称/含义 | 核心特点 | 评测目的 |

| NoCaps validation | NoCaps 验证集 | NoCaps 是零样本字幕生成数据集,无训练集标注,仅用验证集/测试集评测模型泛化能力 | 验证模型对训练集未见过的长尾物体/场景的描述能力 |

| - in-domain | 域内场景 | 图像内容与训练集(如 COCO)的物体/场景分布高度相似(如日常的猫狗、桌椅) | 测试零样本场景下,模型对"熟悉域长尾物体"的描述精度 |

| - near-domain | 近域场景 | 图像内容与训练集场景相近但有差异(如训练集有"狗",测试集是"罕见品种的狗") | 测试模型对"相似域长尾物体"的泛化能力 |

| - out-domain | 域外场景 | 图像内容与训练集场景完全无关(如极地科考、小众手工艺) | 测试模型对"全新域长尾物体"的极端泛化能力 |

| - overall | 整体结果 | 整合 in-domain、near-domain、out-domain 三个子场景的指标均值 | 综合衡量模型在 NoCaps 零样本场景下的整体生成性能 |

| COCO Caption Karpathy test | COCO Caption 的 Karpathy 测试集 | 这是 COCO 字幕任务的标准 有监督测试集(由 Karpathy 划分的经典测试子集),包含 5k 张图像 | 验证模型在熟悉场景下的字幕生成质量(有监督微调后的核心评测场景) ||------------------------|---------------------------------------------|-----------------------------------------------------------------------------|----------------------------------------|

| 术语 | 通俗定义 | 核心特点 | 形象举例 |

| 长尾物体 | 数据集中低频出现、不常见的物体,区别于日常高频的"头部物体" | 1. 出现概率低<br>2. 种类繁杂<br>3. 标注成本高 | 头部物体:猫、狗、手机<br>长尾物体:极地冰钻、油纸伞模具、复古打字机 |

| 零样本场景 | 模型从未在训练数据中见过目标物体/场景,却要直接完成任务的场景 | 1. 无目标样本训练<br>2. 考验知识迁移能力<br>3. 不依赖下游标注数据 | 只教模型认过猫狗,却让它识别描述羊驼 |

| 零样本长尾场景 | 零样本场景 + 长尾物体的叠加,是对模型泛化能力的"终极考验" | 1. 无训练样本 + 物体罕见<br>2. 最贴近真实世界的复杂任务<br>3. 普通模型易失效 | 只教模型认过常见宠物,却让它描述藏狐、管水母 |

| NoCaps(零样本字幕生成数据集) | 专门用于测试零样本长尾字幕生成能力的标准评测数据集,相当于模型的"期末考试卷" | 1. 无训练集标注,模型预训练时未接触过<br>2. 包含大量长尾物体与场景<br>3. 分in/near/out-domain三类子场景评测 | 给模型一张管水母的图,要求生成"透明的管水母在海水中舒展触手"的准确字幕 |这三类是 NoCaps 数据集 对零样本长尾物体的细分场景,核心是根据物体与模型训练集(如 COCO)的"语义/场景相似度"划分,用来精准测试模型的泛化能力边界,具体说明和举例如下:

|-------------|--------------------------------------|---------------------------------------------------|----------------------------------------------------------------------------------|

| 类别 | 通俗说明 | 核心特征 | 典型举例 |

| 熟悉域长尾物体 | 和训练集里的头部物体属于同一大类,但具体是该类里的罕见细分品种 | 1. 大类在训练集中见过 2. 具体品种是低频长尾 | 训练集见过"狗"(头部物体),但没见过 藏獒、柯基犬、柴犬 等小众品种;<br>训练集见过"花",但没见过 绿绒蒿、鸽子花 等稀有花卉 |

| 相似域长尾物体 | 和训练集里的物体场景或功能相近,但不是同一大类,属于"近亲"范畴 | 1. 大类不在训练集,但场景/功能相似 2. 可通过迁移训练集知识识别 | 训练集见过"普通自行车",但没见过 山地自行车、折叠自行车、死飞自行车 ;<br>训练集见过"家用碗",但没见过 陶瓷汤碗、不锈钢泡面碗 |

| 全新域长尾物体 | 和训练集里的物体完全无关联,属于模型从未接触过的全新领域 | 1. 大类、场景、功能均不在训练集 2. 无法直接迁移训练集知识,考验模型的"零样本终极泛化能力" | 训练集只有日常物体,没见过 极地冰钻、深海探测器、汉服发簪、传统油纸伞模具 ;<br>训练集只有陆地动物,没见过 管水母、皇带鱼 等深海生物 |这种划分的目的是分层验证模型的泛化能力:

-

熟悉域:考验模型对"大类下细分长尾"的识别能力;

-

相似域:考验模型对"功能/场景迁移"的推理能力;

-

全新域:考验模型对"完全陌生事物"的语义建模能力------这也是最能体现模型优劣的场景。

-

-

二、 指标缩写含义

表格中的 C S B@4 是字幕生成任务的三大核心评价指标,数值越高表示生成字幕质量越好:

|---------|---------------------------------------------------------|---------------------------------------------------------------------|-------------------------------------------------------|

| 缩写 | 全称 | 核心评价逻辑 | 作用 |

| C | CIDEr (Consensus-Based Image Description Evaluation) | 基于"共识"的语义相似度指标:计算生成字幕与人工标注字幕的 TF-IDF 权重 相似度,权重越高表示语义越一致 | 字幕生成任务的核心指标,最贴合人类对"语义准确"的判断 |

| S | SPICE (Semantic Propositional Image Caption Evaluation) | 基于"场景图"的语义匹配指标:将字幕转化为"物体-关系"的结构化场景图,再与人工标注的场景图对比 | 比 CIDEr 更关注细 粒度 语义关系(如"人拿着杯子" vs "人看着杯子") |

| B@4 | BLEU@4 (Bilingual Evaluation Understudy @ 4-gram) | 基于"n元词组重合度"的指标:计算生成字幕与人工标注字幕的 4元词组匹配率 | 衡量生成字幕的流畅度和语法正确性,但对语义一致性的敏感度低于 CIDEr/SPICE |

-

三、 标注组合的完整含义(举例)

以表格中常见的

NoCaps in-domain C S为例,完整含义是:在 NoCaps 验证集的域内子场景 下,模型生成字幕的 CIDEr 指标值 和 SPICE 指标值。

再比如

COCO Caption Karpathy test B@4 C,含义是:在 COCO Caption 的 Karpathy 测试集上,模型生成字幕的 BLEU@4 指标值 和 CIDEr 指标值。

-

四、 关键补充

-

NoCaps 侧重泛化能力 ,因此细分了 in/near/out-domain 三个子场景,而 COCO Caption 侧重常规性能,直接用整体测试集指标;

-

论文中会优先展示

C(CIDEr)指标,因为它是字幕生成任务的"黄金标准",更能体现模型的核心生成能力。

-

NoCaps 对「训练集大类」的定义

你的理解非常对,这个分类的核心矛盾点就在于 "如何定义训练集里的'大类'边界" ------ 这也是 NoCaps 数据集划分场景的关键逻辑,我们拆开讲清楚:

-

一、先明确 NoCaps 对「训练集大类」的定义

在 BLIP 这类模型的预训练中,训练集(如 COCO)标注的粒度是 "粗粒度大类",而非"细粒度子类"。

以自行车为例:

这是划分场景的前提 ------ 场景的"远近",取决于 "物体的细分特征是否能被训练集的粗 粒度 知识覆盖"。

-

训练集里的标注词只有 "bicycle/自行车" 这个粗 粒度 大类,没有标注过任何"山地车""折叠车"的细分属性;

-

模型在预训练时,只学到了"有两个轮子、人骑的交通工具"这个核心特征,没学到"带减震器=山地车""能折叠=折叠车"这些细分特征。

-

-

二、重新区分:熟悉域 vs 相似域(以自行车为例)

我们用 "是否属于同一粗 粒度 大类 + 细分特征是否可迁移" 来界定,就能解决你的疑问:

|-------------|-----------------------------------------------------------------------------|------------------------------------------------------------------------------------|--------------------------------------------------|

| 类别 | 判定标准 | 自行车相关举例 | 核心区别 |

| 熟悉域长尾物体 | 1. 属于训练集的同一粗 粒度 大类 <br>2. 细分特征是 "品种差异",无功能/形态的本质变化 | 训练集见过"狗"→ 长尾是藏獒、柴犬 (都是狗,只是品种不同)<br>训练集见过"花"→ 长尾是绿绒蒿、鸽子花(都是花,只是品种不同) | 细分特征是 "同大类下的品种差异",模型能通过"大类特征"直接迁移识别 |

| 相似域长尾物体 | 1. 属于训练集的同一粗 粒度 大类 <br>2. 细分特征是 "功能/形态的差异化改造",超出训练集的粗粒度知识 | 训练集见过"普通自行车"→ 长尾是山地车、折叠车、死飞<br>(都是自行车大类,但山地车多了减震器、折叠车能变形、死飞无飞轮,这些功能特征训练集没教过) | 细分特征是 "同大类下的功能改造",模型需要通过"功能推理"才能识别,而非简单的品种区分 |

-

三、为什么山地车属于「相似域」而非「熟悉域」?

核心是 "模型需要学习的特征 维度 不同":

-

熟悉域的"品种差异" :只需要识别外观的细微差别,比如藏獒和柴犬的区别是"体型大小、毛发长短",这些都属于"狗"这个大类的外观特征范畴,模型能通过预训练的"狗"特征直接迁移。

-

相似域的"功能差异" :需要识别超出外观的功能属性 ,比如山地车的"减震器"是为了适应越野,折叠车的"折叠结构"是为了便携 ------ 这些功能特征在训练集的"普通自行车"样本里完全没有,模型无法通过外观直接判断,必须结合场景(比如山地车在山路)或形态结构(比如折叠车的关节)推理,这就是"相似域"的核心:大类相同,但功能/形态特征和训练集相似却有差异。

-

-

四、一句话总结划分逻辑

这样一来,山地车属于相似域的原因就很清晰了 ------ 它和普通自行车是"同大类但功能差异化"的关系,和熟悉域的"同大类但品种差异化"有本质区别。

-

熟悉域长尾 :同大类 + 品种差异(看外观就能认);

-

相似域长尾 :同大类 + 功能/形态改造(需要结合功能推理才能认);

-

全新域长尾 :不同大类 + 完全陌生(比如训练集只有自行车,没见过潜水艇)。

-

COCO Caption Karpathy test, 有几个模型,没有产出指标的原因是什么

- COCO Caption Karpathy test 部分模型无指标的原因对照表

|-------------|---------------------------------------|-------------------------------------------------------------------------------------------------------------------------|---------------------------------------|

| 无指标原因分类 | 核心逻辑 | 具体场景/例子 | 对实验严谨性的意义 |

| 评测协议不兼容 | 模型的训练/评测流程不符合 Table 7 的统一标准,指标不具备可比性 | 1. 微调时用强化学习损失(如 SCST),而非论文要求的交叉熵损失<br>2. 测试集用自定义划分,而非标准的 5k 张 Karpathy 测试图像<br>3. 指标用非官方工具计算(如修改 CIDEr 的 TF-IDF 权重) | 排除"规则不一致导致的性能偏差",保证所有对比模型处于同一基准线 |

| 公开信息缺失 | 模型论文未发布该测试集的指标,或仅发布验证集结果,无测试集数据 | 1. 模型专注零样本任务,仅公布 NoCaps 指标,未做 COCO Caption 微调<br>2. 仅发布 COCO val2014 验证集指标,未提交 Karpathy 测试集结果 | 避免"编造/推测指标",只采用公开可复现的实验数据 |

| 对比条件不公平 | 模型依赖额外强约束,与 BLIP-CapFilt-L 的轻量化配置差异过大 | 1. 需要额外物体检测器(如 VinVL† 用 250 万张带框图像预训练)2. 采用超大参数量/训练数据(如 SimVLM-huge 用 13 倍数据)3. 依赖高分辨率输入(800×1333)或特殊硬件 | 突出 BLIP "无额外依赖、低成本"的优势,避免"堆资源碾压"的无效对比 |

| 性能无竞争力 | 模型指标显著低于基线,无参考价值 | 模型在 Karpathy 测试集的 CIDEr 指标比 BLIP 基础版低 10+ 个点 | 精简表格内容,只展示有竞争力的 SOTA 模型,提升论文可读性 |