Windows平台Ollama AMD GPU编译全攻略:基于ROCm 6.2的实战指南

文章目录

- [Windows平台Ollama AMD GPU编译全攻略:基于ROCm 6.2的实战指南](#Windows平台Ollama AMD GPU编译全攻略:基于ROCm 6.2的实战指南)

-

- [引言:为什么需要手动编译AMD GPU版本?](#引言:为什么需要手动编译AMD GPU版本?)

- [一、 环境准备与系统要求](#一、 环境准备与系统要求)

-

- [1.1 硬件兼容性检查](#1.1 硬件兼容性检查)

- [1.2 软件环境清单与安装](#1.2 软件环境清单与安装)

- [二、 源码获取与项目结构解析](#二、 源码获取与项目结构解析)

-

- [2.1 克隆定制化仓库](#2.1 克隆定制化仓库)

- [2.2 同步上游更新(可选但推荐)](#2.2 同步上游更新(可选但推荐))

- [三、 核心编译:ROCm后端动态库](#三、 核心编译:ROCm后端动态库)

-

- [3.1 推荐方法:使用自动化构建脚本](#3.1 推荐方法:使用自动化构建脚本)

- [3.2 备选方法:手动分步构建](#3.2 备选方法:手动分步构建)

- [四、 编译Ollama主程序(CLI)](#四、 编译Ollama主程序(CLI))

-

- [4.1 设置CGO编译环境](#4.1 设置CGO编译环境)

- [4.2 执行编译](#4.2 执行编译)

- [4.3 使用项目内置脚本(最简方式)](#4.3 使用项目内置脚本(最简方式))

- [五、 成果验证与使用](#五、 成果验证与使用)

-

- [5.1 输出目录结构](#5.1 输出目录结构)

- [5.2 运行与测试](#5.2 运行与测试)

- [六、 深度排错与常见问题(FAQ)](#六、 深度排错与常见问题(FAQ))

-

- [6.1 编译阶段问题](#6.1 编译阶段问题)

- [6.2 运行时问题](#6.2 运行时问题)

- [6.3 环境变量速查表](#6.3 环境变量速查表)

- [七、 总结与最佳实践](#七、 总结与最佳实践)

引言:为什么需要手动编译AMD GPU版本?

Ollama作为当前热门的本地大语言模型运行框架,其官方版本主要针对NVIDIA CUDA进行了优化。对于广大AMD GPU用户而言,直接使用官方二进制包无法获得GPU硬件加速,导致模型推理速度大幅下降。本文将深入解析如何在Windows系统上,利用AMD ROCm 6.2 SDK,从源码编译出支持AMD GPU加速的Ollama版本,并详细解释每一步背后的技术原理与最佳实践。

一、 环境准备与系统要求

1.1 硬件兼容性检查

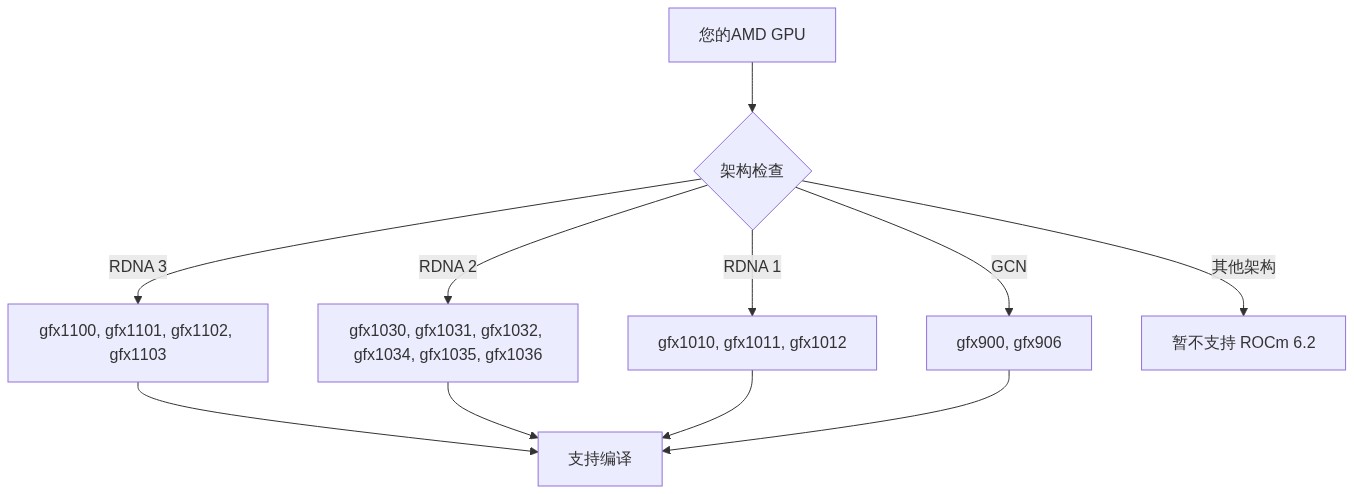

编译前,请务必确认您的AMD GPU是否在ROCm 6.2的支持列表中。ROCm对GPU架构有严格要求,并非所有AMD显卡都支持。

图1:GPU架构支持判断流程图

常见显卡型号对应架构参考表:

| 架构代号 | GPU 系列 | 典型显卡型号 | ROCm 6.2 支持 |

|---|---|---|---|

| gfx1100 | RDNA 3 | RX 7900 XTX/XT | ✅ |

| gfx1102 | RDNA 3 | RX 7800 XT/7700 XT | ✅ |

| gfx1030 | RDNA 2 | RX 6800/6900 XT | ✅ |

| gfx1032 | RDNA 2 | RX 6600 XT | ✅ |

| gfx1010 | RDNA 1 | RX 5700 XT | ✅ |

| gfx900 | GCN (Vega) | Vega 56/64 | ✅ |

| gfx1152 | RDNA 3.5 | RX 7600 (非XT) | ❌ (需ROCm 7.x) |

重要提示 :ROCm 6.2 不支持 gfx1150, gfx1151, gfx1152, gfx1153, gfx1200, gfx1201等新架构,这些需要等待ROCm 7.x版本。购买前请仔细核对。

1.2 软件环境清单与安装

编译过程涉及多个工具链的协同工作,下表列出了所有必需软件及其作用。

| 软件名称 | 最低版本 | 核心作用 | 安装命令(推荐使用 Winget) |

|---|---|---|---|

| Visual Studio 2022 BuildTools | 最新 | 提供MSVC编译器与C++构建环境 | winget install Microsoft.VisualStudio.2022.BuildTools |

| CMake | 4.0+ | 跨平台构建系统,用于配置ROCm后端 | winget install Kitware.CMake |

| Go | 1.24+ | 编译Ollama主程序(Go语言编写) | winget install GoLang.Go |

| AMD ROCm | 6.2 | AMD GPU计算平台SDK,提供HIP运行时 | 官网下载 |

| MSYS2 (MinGW-w64) | 最新 | 提供GCC工具链,用于CGO编译环节 | winget install MSYS2.MSYS2 |

安装后验证:

打开PowerShell,依次执行以下命令,确保所有工具已正确安装并加入PATH。

powershell

# 验证各工具版本

cmake --version # 应输出 CMake 4.0+

go version # 应输出 go1.24+

# 验证ROCm安装(假设默认安装路径)

& "C:\Program Files\AMD\ROCm\6.2\bin\hipconfig.bin.exe" --version

# 安装MSYS2的GCC(在MSYS2终端或通过bash调用)

C:\msys64\usr\bin\bash.exe -lc "pacman -S --noconfirm mingw-w64-x86_64-gcc"

gcc --version # 验证GCC二、 源码获取与项目结构解析

2.1 克隆定制化仓库

Ollama官方仓库不直接包含完整的Windows ROCm支持。我们需要使用社区维护的移植版本。

powershell

# 克隆专为AMD GPU适配的仓库

git clone https://github.com/likelovewant/ollama-for-amd.git

cd ollama-for-amd

# 添加上游官方仓库作为远程源,便于后续同步更新

git remote add upstream https://github.com/ollama/ollama.git2.2 同步上游更新(可选但推荐)

为了获得最新的功能与修复,可以将特定版本的官方代码合并到当前分支。

powershell

# 获取上游所有标签

git fetch upstream --tags

# 假设我们想合并官方 v0.20.2 版本

# 首先确保本地没有未提交的更改

git status

# 执行合并

git merge v0.20.2 --no-edit

# 如果出现冲突,需要手动解决后再提交三、 核心编译:ROCm后端动态库

这是最关键的步骤,我们将编译出让Ollama能调用AMD GPU进行张量计算的ggml-hip.dll等库文件。

3.1 推荐方法:使用自动化构建脚本

手动设置复杂的编译环境容易出错。我们编写一个PowerShell脚本build_rocm.ps1来自动化整个过程。

脚本原理说明:

- 激活VS编译环境 :通过

vcvars64.bat设置MSVC所需的INCLUDE、LIB等路径。 - 配置ROCm环境:指定HIP编译器、运行时库路径及目标GPU架构。

- 调用CMake与Ninja:使用Ninja作为生成器,比MSBuild更快。

- 限定目标架构:精确指定ROCm 6.2所支持的GPU架构列表,避免编译错误。

powershell

# build_rocm.ps1

# Ollama ROCm 后端自动化构建脚本

$ErrorActionPreference = "Stop"

# --- 1. 激活 Visual Studio 2022 开发环境 ---

$vsWhere = "${env:ProgramFiles(x86)}\Microsoft Visual Studio\Installer\vswhere.exe"

$vsPath = & $vsWhere -latest -property installationPath

$vcvarsPath = "$vsPath\VC\Auxiliary\Build\vcvars64.bat"

# 捕获vcvars设置的环境变量

$tempFile = [System.IO.Path]::GetTempFileName()

cmd /c "`"$vcvarsPath`" >nul 2>&1 && set > `"$tempFile`""

$envVars = Get-Content $tempFile

Remove-Item $tempFile

foreach ($line in $envVars) {

if ($line -match "^([^=]+)=(.*)$") {

[Environment]::SetEnvironmentVariable($matches[1], $matches[2], "Process")

}

}

# --- 2. 设置构建工具路径 ---

$ninjaPath = "${env:ProgramFiles(x86)}\Microsoft Visual Studio\2022\BuildTools\Common7\IDE\CommonExtensions\Microsoft\CMake\Ninja"

$env:PATH = "$ninjaPath;$env:PATH"

# --- 3. 配置 ROCm 6.2 环境变量 ---

$rocmPath = "C:\Program Files\AMD\ROCm\6.2"

$env:HIP_PATH = $rocmPath

$env:HIPCXX = "$rocmPath\bin\clang++.exe"

$env:HIP_PLATFORM = "amd"

$env:CMAKE_PREFIX_PATH = $rocmPath

# 指定使用 ROCm 的 Clang 作为编译器,但链接器仍用 MSVC

$env:CC = "$rocmPath\bin\clang.exe"

$env:CXX = "$rocmPath\bin\clang++.exe"

# 将 ROCm 库和头文件路径告知编译系统

$env:LIB = "$env:LIB;$rocmPath\lib"

$env:INCLUDE = "$env:INCLUDE;$rocmPath\include"

# --- 4. 进入项目目录并清理旧构建 ---

Set-Location "ollama-for-amd" # 请修改为你的实际路径

Remove-Item -Recurse -Force build\rocm -ErrorAction SilentlyContinue

# --- 5. 定义 ROCm 6.2 支持的所有GPU架构目标 ---

# 这是避免"invalid target ID"错误的关键!

$SupportedTargets = @(

"gfx1030", "gfx1031", "gfx1032", "gfx1034", "gfx1035", "gfx1036", # RDNA2

"gfx1100", "gfx1101", "gfx1102", "gfx1103", # RDNA3

"gfx900:xnack-", "gfx906:xnack-", "gfx90c:xnack-", # GCN (Vega)

"gfx1010:xnack-", "gfx1011:xnack-", "gfx1012:xnack-" # RDNA1

) -join ";"

# --- 6. 执行 CMake 配置 ---

Write-Host "正在配置CMake,目标架构: $SupportedTargets" -ForegroundColor Cyan

cmake -B build\rocm --preset "ROCm 6" -G Ninja `

-DCMAKE_INSTALL_PREFIX="ollama-for-amd/dist/windows-amd64" ` # 请修改为你的实际路径

-DCMAKE_HIP_COMPILER="$rocmPath\bin\hipcc.bin.exe" `

-DAMDGPU_TARGETS="$SupportedTargets"

if ($LASTEXITCODE -ne 0) {

Write-Error "CMake 配置失败!"

exit $LASTEXITCODE

}

# --- 7. 开始并行编译 ---

Write-Host "开始编译ROCm后端(此过程较耗时,请耐心等待)..." -ForegroundColor Yellow

cmake --build build\rocm --config Release --parallel 6 # 根据CPU核心数调整

if ($LASTEXITCODE -ne 0) {

Write-Error "编译失败!"

exit $LASTEXITCODE

}

# --- 8. 安装到目标目录 ---

cmake --install build\rocm --component HIP --strip

Write-Host "\nROCm 后端编译成功!" -ForegroundColor Green

Write-Host "输出目录: ollama-for-amd/dist/windows-amd64/lib/ollama/rocm/" -ForegroundColor Green运行脚本:

powershell

# 以管理员身份打开PowerShell,执行

powershell -ExecutionPolicy Bypass -File .\build_rocm.ps13.2 备选方法:手动分步构建

如果你需要更精细的控制或调试,可以参照以下手动步骤:

powershell

# 步骤1: 激活VS环境

cmd /c "C:\Program Files (x86)\Microsoft Visual Studio\2022\BuildTools\VC\Auxiliary\Build\vcvars64.bat"

# 步骤2: 设置环境变量(参考脚本中的第2、3步)

# ...

# 步骤3: 执行配置与构建

cmake -B build\rocm --preset "ROCm 6" -G Ninja `

-DCMAKE_INSTALL_PREFIX="$(pwd)/dist/windows-amd64" `

-DAMDGPU_TARGETS="gfx1030;gfx1100" # 这里只指定你自己的GPU架构,编译更快

cmake --build build\rocm --config Release --parallel 6

cmake --install build\rocm --component HIP --strip四、 编译Ollama主程序(CLI)

ROCm后端库准备好后,我们需要编译链接了该后端的Ollama可执行文件。

4.1 设置CGO编译环境

Ollama的Go代码通过CGO调用C/C++编写的后端库。在Windows上,这通常需要MinGW的GCC工具链。

powershell

# 将MinGW-w64的GCC添加到当前会话的PATH中

$env:PATH = "C:\msys64\mingw64\bin;$env:PATH"

# 验证GCC可用

gcc --version

# 设置CGO相关环境变量

$env:CGO_ENABLED = "1" # 启用CGO

$env:CC = "gcc" # 指定C编译器为GCC

$env:CXX = "g++" # 指定C++编译器为G++4.2 执行编译

进入项目根目录,使用Go命令进行编译。-trimpath和-ldflags中的参数用于优化二进制大小并嵌入版本信息。

powershell

cd ollama-for-amd

# 执行编译,生成 ollama.exe

# -X 参数用于在二进制中注入版本和构建模式信息

go build -trimpath -ldflags "-s -w -X=github.com/ollama/ollama/version.Version=0.20.2-amd -X=github.com/ollama/ollama/server.mode=release" .

# 编译成功后,将可执行文件复制到发布目录

Copy-Item ollama.exe dist\windows-amd64\4.3 使用项目内置脚本(最简方式)

项目提供了更集成的脚本,可以一键编译CPU和GPU后端。

powershell

# 编译 ROCm 6 后端及完整的 ollama CLI

powershell -ExecutionPolicy Bypass -File ./scripts/build_windows.ps1 rocm6 ollama五、 成果验证与使用

5.1 输出目录结构

成功编译后,dist/windows-amd64目录结构应如下所示:

dist/windows-amd64/

├── ollama.exe # 主程序 (约40MB)

└── lib/ollama/

├── ggml-base.dll # GGML基础库

├── ggml-cpu-*.dll # 各种CPU指令集优化后端

└── rocm/ # ROCm GPU后端

├── ggml-hip.dll # HIP计算后端 (约600MB)

├── amdhip64_6.dll # HIP运行时库

├── hipblas.dll # HIP BLAS库

├── rocblas.dll # ROCm BLAS库 (约400MB)

└── ... (其他依赖DLL)5.2 运行与测试

-

启动服务:

powershellcd dist\windows-amd64 .\ollama.exe serve观察启动日志,如果看到类似

"Using HIP backend"或"GPU: AMD Radeon ..."的信息,说明GPU加速已启用。 -

拉取并运行模型:

powershell# 在另一个终端中 .\ollama.exe pull llama3.2:1b # 先拉取一个小模型测试 .\ollama.exe run llama3.2:1b -

验证GPU使用:

powershell# 查看进程信息,确认GPU后端被加载 .\ollama.exe ps # 更详细的日志 .\ollama.exe serve --verbose 2>&1 | Select-String "HIP|GPU|AMD"同时可以打开Windows任务管理器,在"性能"选项卡中查看GPU(通常是"GPU 1-3D")的利用率是否在推理时上升。

六、 深度排错与常见问题(FAQ)

6.1 编译阶段问题

| 问题现象 | 可能原因 | 解决方案 |

|---|---|---|

CMake报错 Looking for a HIP compiler - NOTFOUND |

环境变量未正确设置或ROCm未安装。 | 1. 检查HIP_PATH环境变量。 2. 在CMake命令中显式指定 -DCMAKE_HIP_COMPILER="C:/Program Files/AMD/ROCm/6.2/bin/hipcc.bin.exe"。 |

clang++: error: invalid target ID 'gfx1152' |

指定了ROCm 6.2不支持的GPU架构。 | 修改-DAMDGPU_TARGETS参数,仅包含本文3.1节中$SupportedTargets列表内的架构。 |

error: use of undeclared identifier '__builtin_verbose_trap' |

MSVC STL头文件与ROCm Clang编译器不兼容。 | 确保使用的是Visual Studio BuildTools ,而非预览版或Insiders版。在调用CMake前正确设置INCLUDE和LIB环境变量指向BuildTools的路径。 |

LINK : fatal error LNK1104: 无法打开文件 pthread.lib |

CGO尝试使用GCC的链接选项与MSVC链接器混合。 | 确保在编译Ollama主程序前,已将CC和CXX环境变量设置为gcc和g++,并且MinGW的bin目录在PATH中。 |

6.2 运行时问题

| 问题现象 | 可能原因 | 解决方案 |

|---|---|---|

| Ollama启动后未检测到GPU | 1. GPU架构不在编译目标中。 2. ROCm运行时环境问题。 | 1. 使用set HSA_OVERRIDE_GFX_VERSION=10.3.0(根据你的GPU调整)覆盖架构检测。 2. 设置set HIP_VISIBLE_DEVICES=0指定使用第一块GPU。 3. 检查dist/windows-amd64/lib/ollama/rocm/目录下所有DLL是否完整。 |

| 运行模型时崩溃或报错 | 1. GPU显存不足。 2. 动态库依赖缺失。 | 1. 尝试运行参数量更小的模型(如1B, 3B)。 2. 将C:\Program Files\AMD\ROCm\6.2\bin目录下的*.dll复制到ollama.exe同级目录下(谨慎操作,可能引起冲突)。 |

6.3 环境变量速查表

| 环境变量 | 作用 | 典型值 |

|---|---|---|

HIP_PATH |

指定ROCm SDK的根目录。 | C:\Program Files\AMD\ROCm\6.2 |

HSA_OVERRIDE_GFX_VERSION |

强制覆盖系统检测到的GPU架构版本。 | 10.3.0 (对应gfx1030) |

HIP_VISIBLE_DEVICES |

指定Ollama可使用的GPU设备ID。 | 0 |

CGO_ENABLED |

启用Go语言的CGO交互功能。 | 1 |

CC / CXX |

指定C/C++编译器,用于编译Ollama主程序。 | gcc / g++ (MinGW) |

七、 总结与最佳实践

- 版本对齐 :始终确保Ollama源码、ROCm SDK版本以及社区仓库分支之间的兼容性。本文基于

ollama-for-amd仓库、ROCm 6.2 和Ollama v0.20.2进行验证。 - 架构精准匹配 :编译时

-DAMDGPU_TARGETS参数是成功的关键,只添加你拥有的和ROCm 6.2支持的架构,可以显著缩短编译时间。 - 环境隔离:建议在干净的PowerShell会话中执行编译,避免残留的环境变量干扰。可以编写脚本固化整个流程。

- 分步调试 :如果编译失败,不要一次性运行整个脚本。先手动执行前几步,验证

cmake --preset "ROCm 6"是否能成功配置。 - 社区支持 :遇到本文未涵盖的问题,可以到 Ollama for AMD GitHub Issues 或相关技术社区寻求帮助。

通过以上步骤,你不仅能在Windows上成功运行起支持AMD GPU加速的Ollama,更能深入理解其跨平台编译、CGO交互及异构计算后端集成的技术细节。享受本地大模型带来的高效与隐私吧!

适用版本: Ollama v0.20.2, ROCm 6.2, Windows 10/11