本文为个人学习笔记,记录使用OpenCV实现两张图像拼接的完整流程,并重点解析透视变换及拼接函数的参数含义。

引言

图像拼接(Image Stitching)是计算机视觉中的经典任务,它将多张具有重叠区域的图像合成为一张宽视角的全景图。常见应用包括手机全景拍照、无人机航拍拼接、VR内容制作等。

实现图像拼接的核心步骤包括:

-

特征提取:在两幅图中找到稳定的关键点(如角点、斑点)

-

特征匹配:寻找两图之间的对应点对

-

变换估计:根据匹配点计算单应性矩阵(透视变换矩阵)

-

图像变换与融合:将其中一幅图变换到另一幅图的坐标系,再合成

本文使用OpenCV的SIFT特征、BFMatcher匹配、RANSAC鲁棒估计、透视变换等工具,实现一个简单的两图拼接程序。代码详细注释,并重点剖析 findHomography 和 warpPerspective 的参数用法。

环境与依赖

-

Python 3.7+

-

OpenCV(

opencv-python+opencv-contrib-python,SIFT在contrib中) -

NumPy

任务描述

给定两张具有重叠区域的图片 A.jpg(左图)和 B.jpg(右图),要求完成以下任务:

-

使用SIFT算法检测两图的关键点并计算描述符

-

利用BFMatcher进行k近邻匹配(k=2),并通过Lowe's比率测试筛选高质量匹配

-

可视化匹配结果

-

计算单应性矩阵(透视变换矩阵),将右图

B.jpg变换到左图A.jpg的坐标系 -

对右图进行透视变换,并创建足够大的画布

-

将左图叠加到画布左侧,完成拼接

-

保存最终拼接图像

原始图片(请读者自行准备)示意:

| 左图(A.jpg) | 右图(B.jpg) |

|---|---|

|

|

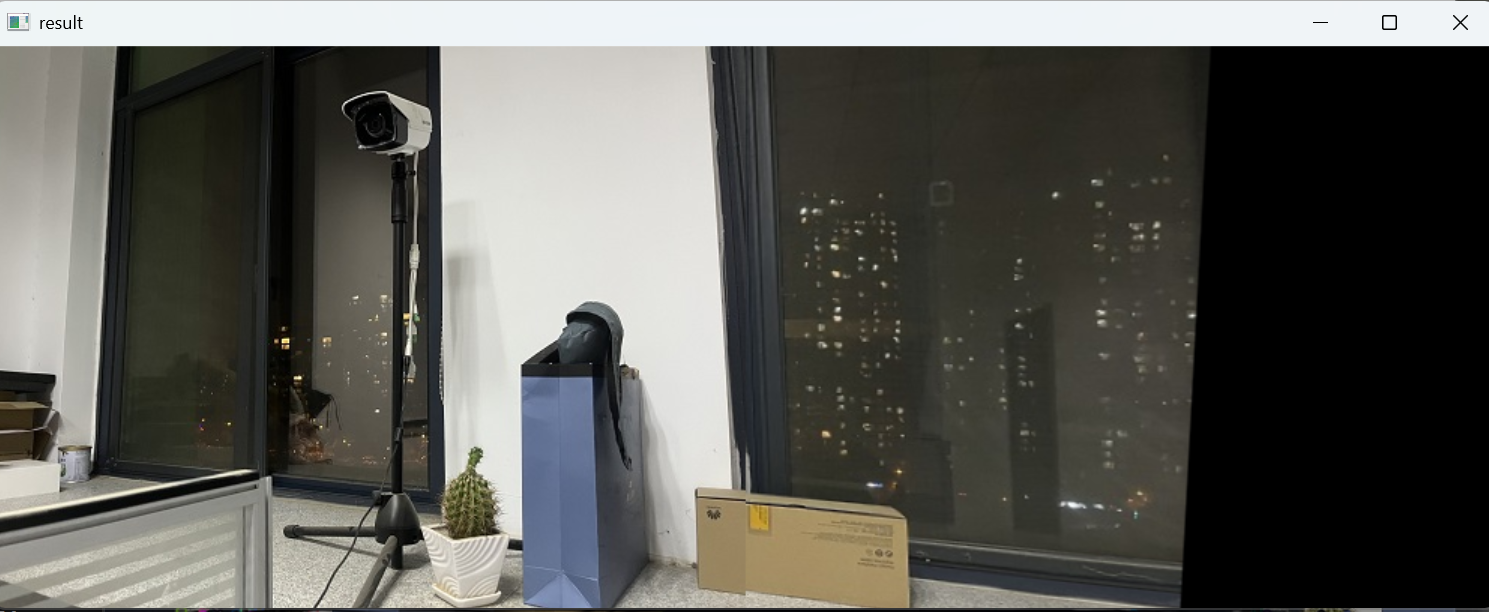

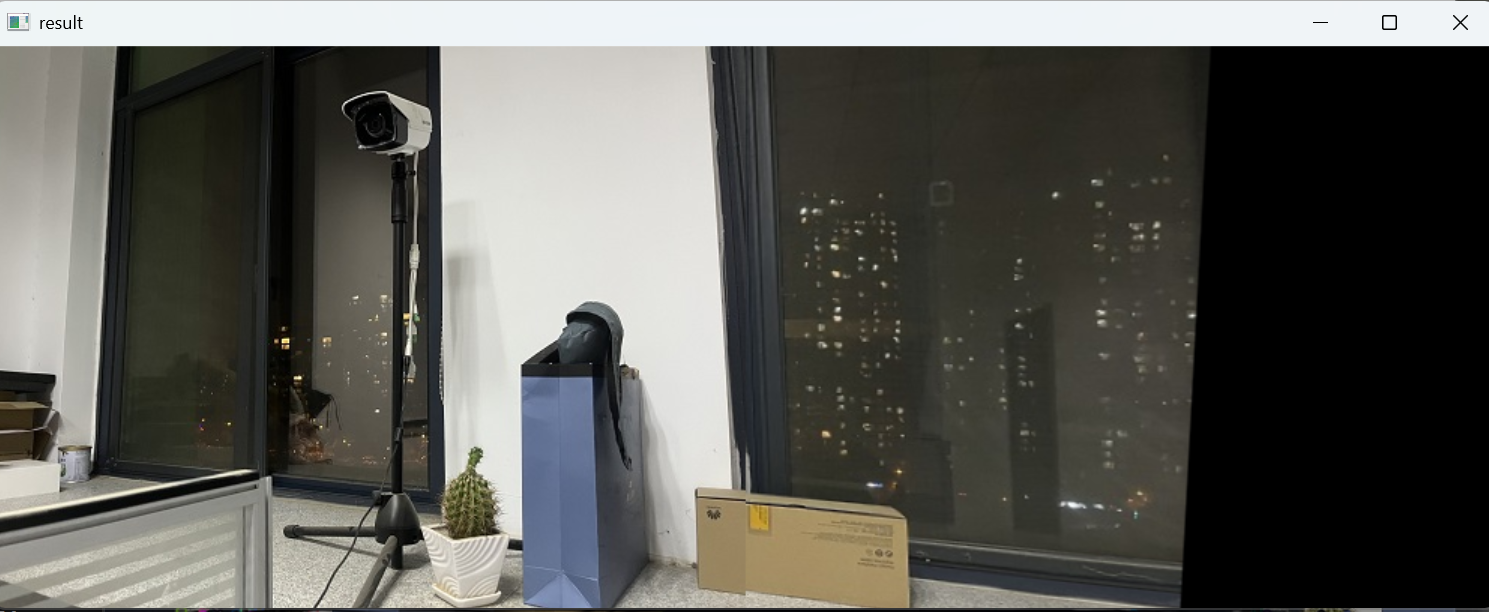

最终拼接结果保存在 pingjie.jpg,效果示意:

| 拼接结果(pingjie.jpg) |

|---|

|

实现步骤详解

1. 工具函数定义

为了方便显示图像,定义一个简单的 cv_show 函数。

import cv2

import numpy as np

import sys

def cv_show(name, img):

cv2.imshow(name, img)

cv2.waitKey(0)2. SIFT特征提取函数

SIFT算法会返回关键点列表(kp)和对应的128维描述符(des)。同时我们提取关键点的坐标(kp.pt)为一个浮点数组,便于后续矩阵运算。

def detectAndDescribe(image):

gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY)

sift = cv2.SIFT_create()

(kps, des) = sift.detectAndCompute(gray, None)

kps_float = np.float32([kp.pt for kp in kps])

return (kps, kps_float, des)3. 读取图像并提取特征

imageA = cv2.imread("A.jpg") # 左图

imageB = cv2.imread("B.jpg") # 右图

cv_show('imageA', imageA)

cv_show('imageB', imageB)

(kpsA, kps_floatA, desA) = detectAndDescribe(imageA)

(kpsB, kps_floatB, desB) = detectAndDescribe(imageB)4. 特征匹配与比率测试

使用 BFMatcher 进行暴力匹配,knnMatch 返回每个点最近的2个匹配(k=2)。然后通过Lowe's比率测试(最近邻距离 < 0.65 * 次近邻距离)筛选高质量匹配。

matcher = cv2.BFMatcher()

rawMatches = matcher.knnMatch(desB, desA, k=2)

good = []

matches = [] # 存储筛选后匹配对的索引

for m in rawMatches:

if len(m) == 2 and m[0].distance < 0.65 * m[1].distance:

good.append(m)

matches.append((m[0].queryIdx, m[0].trainIdx))

print(f"筛选后的匹配点对数: {len(good)}")结果展示:

31

(14, 76), (36, 105), (39, 105), (63, 118), (65, 121), (66, 122), (74, 130), (83, 128), (87, 136), (93, 140), (105, 147), (118, 172), (138, 176), (154, 191), (155, 192), (158, 198), (164, 213), (165, 206), (176, 217), (185, 227), (201, 242), (202, 243), (204, 246), (207, 250), (209, 255), (212, 257), (217, 7), (228, 275), (229, 276), (231, 275), (233, 276)

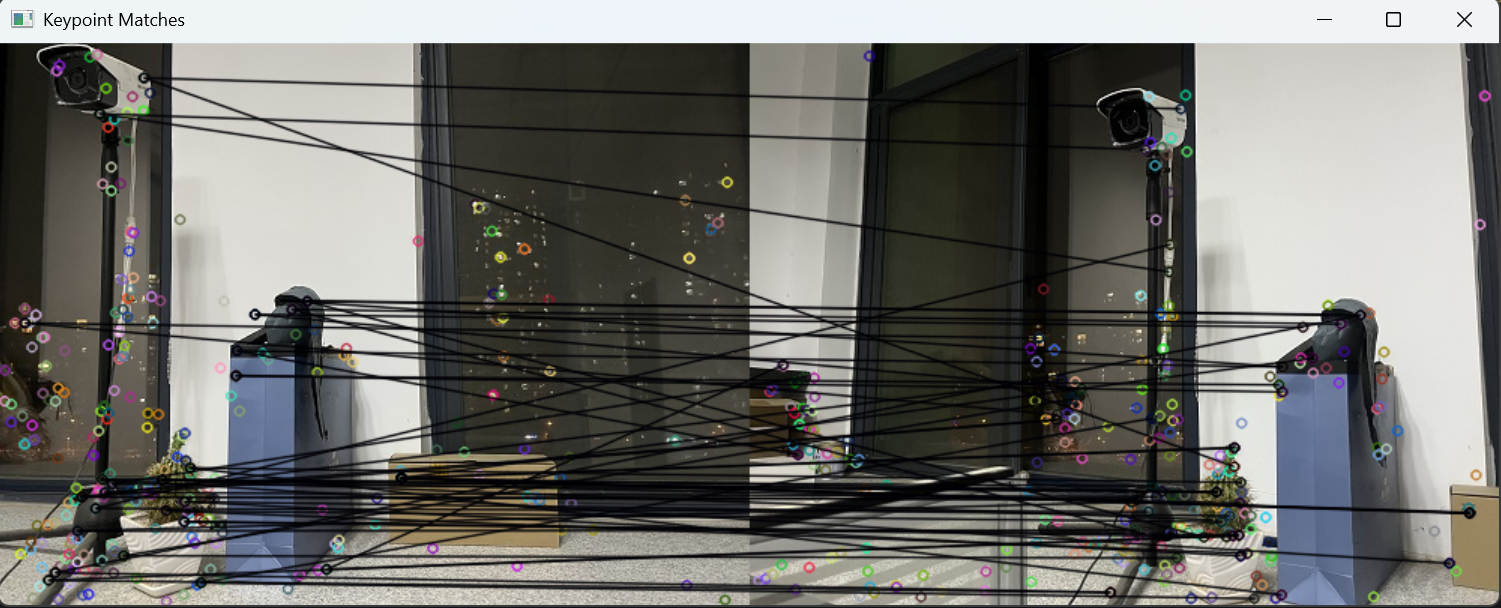

5. 绘制匹配结果

drawMatchesKnn 可以绘制 knnMatch 返回的匹配结果,并显示关键点方向与尺度。

vis = cv2.drawMatchesKnn(imageB, kpsB, imageA, kpsA, good, None,

cv2.DRAW_MATCHES_FLAGS_DRAW_RICH_KEYPOINTS)

cv_show("Keypoint Matches", vis)结果展示:

6. 计算透视变换矩阵(单应性矩阵)

至少需要4对匹配点才能计算单应性矩阵。使用RANSAC算法剔除误匹配,提高鲁棒性。

if len(matches) > 4:

ptsB = np.float32([kps_floatB[i] for (i, _) in matches])

ptsA = np.float32([kps_floatA[i] for (_, i) in matches])

(H, mask) = cv2.findHomography(ptsB, ptsA, cv2.RANSAC, 10.0)

else:

print('图片未找到4个以上的匹配点')

sys.exit()7. 透视变换与拼接

将右图 imageB 根据矩阵 H 进行透视变换,输出画布宽度为两图宽度之和,高度取右图高度(简化处理)。然后将左图直接覆盖到画布左侧。

result = cv2.warpPerspective(imageB, H,

(imageB.shape[1] + imageA.shape[1], imageB.shape[0]))

result[0:imageA.shape[0], 0:imageA.shape[1]] = imageA

cv_show('result', result)

cv2.imwrite('pingjie.jpg', result)结果展示:

完整代码

整合以上步骤,得到完整的图像拼接程序。

import cv2

import numpy as np

import sys

def cv_show(name, img):

cv2.imshow(name, img)

cv2.waitKey(0)

# 2个用法

def detectAndDescribe(image):

gray = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY) # 将彩色图片转换成灰度图

sift = cv2.SIFT_create() # 建立SIFT生成器

# 检测SIFT特征点,并计算描述符,第二个参数为掩膜

(kps, des) = sift.detectAndCompute(gray, None)

# 将结果转换成NumPy数组

kps_float = np.float32([kp.pt for kp in kps])

# kp.pt 包含两个值,分别是关键点在图像中的 x 和 y 坐标。这些坐标通常是浮点数,可以精确地描述关键点在

return (kps, kps_float, des) # 返回特征点集,及对应的描述特征

'''读取拼接图片'''

imageA = cv2.imread("A.jpg")

cv_show('imageA', imageA)

imageB = cv2.imread("B.jpg")

cv_show('imageB', imageB)

'''计算图片特征点及描述符'''

(kpsA, kps_floatA, desA) = detectAndDescribe(imageA)

(kpsB, kps_floatB, desB) = detectAndDescribe(imageB)

'''建立暴力匹配器BFMatcher,在匹配大型训练集合时使用FlannBasedMatcher速度更快。'''

matcher = cv2.BFMatcher()

rawMatches = matcher.knnMatch(desB, desA, k=2)

good = []

matches = []

for m in rawMatches:

# 当最近距离跟次近距离的比值小于0.65值时,保留此匹配对

if len(m) == 2 and m[0].distance < 0.65 * m[1].distance:

good.append(m)

# 存储两个点在featuresA,featuresB中的索引值

matches.append((m[0].queryIdx, m[0].trainIdx))

print(len(good))

print(matches)

vis = cv2.drawMatchesKnn(imageB, kpsB, imageA, kpsA, good, None, cv2.DRAW_MATCHES_FLAGS_DRAW_RICH_KEYPOINTS)

cv_show("Keypoint Matches", vis)

'''透视变换'''

if len(matches) > 4: # 当筛选后的匹配对大于4时,计算视角变换矩阵。

# 获取匹配对的点坐标

ptsB = np.float32([kps_floatB[i] for (i, _) in matches]) # matches是通过阈值筛选之后的特征点对象,

ptsA = np.float32([kps_floatA[i] for (_, i) in matches]) # kps_floatA是图片A中的全部特征点坐标

# 计算透视变换矩阵

# findHomography(srcPoints, dstPoints, method=None, ransacReprojThreshold=None, mask=None, maxIters=None,confidence=None)

# 计算视角变换矩阵,透视变换函数,与cv2.getPerspectiveTransform()的区别在于可多个数据点变换

# 参数srcPoints:图片A的匹配点坐标

# 参数dstPoints:图片B的匹配点坐标

# 参数method:计算变换矩阵的方法。

# 0 - 使用所有的点,最小二乘

# RANSAC - 基于随机样本一致性,见 https://zhuanlan.zhihu.com/p/402727549

# LMEDS - 最小中值

# RHO -基于渐近样本一致性

# ransacReprojThreshold:最大允许重投影错误阈值。该参数只有在method参数为RANSAC或RHO的时启用,默认为3

# 返回值:H为变换矩阵,mask是掩模标志,指示哪些点是内点,哪些是外点。 内点:指那些与估计的模型非常接近的数据点,通常是正确匹配或真实数据。 外点:指那

(H, mask) = cv2.findHomography(ptsB, ptsA, cv2.RANSAC, 10)

else:

print('图片未找到4个以上的匹配点')

sys.exit()

result = cv2.warpPerspective(imageB, H, (imageB.shape[1] + imageA.shape[1], imageB.shape[0]))

cv_show('resultB', result)

# 将图片A传入result图片最左端

result[0:imageA.shape[0], 0:imageA.shape[1]] = imageA

cv_show('result', result)

cv2.imwrite('pingjie.jpg', result)关键点解析

1. SIFT特征提取:detectAndCompute

detectAndCompute 返回的关键点对象 kp 包含坐标 (pt)、尺度 (size)、方向 (angle) 等信息。描述符 des 是一个形状为 (N, 128) 的数组。我们将 kp.pt 单独提取为浮点数组 kps_float,方便后续根据索引取坐标。

2. 比率测试:为什么用0.65?

Lowe在SIFT论文中建议比率阈值在0.4~0.8之间,小于0.4会丢失很多正确匹配,大于0.8会增加误匹配。0.65是一个折中值,可根据实际图像调整。

3. findHomography 参数详解

(H, mask) = cv2.findHomography(srcPoints, dstPoints, method, ransacReprojThreshold)| 参数 | 值 | 说明 |

|---|---|---|

srcPoints |

ptsB |

源图像(右图)中的点坐标,形状 (N, 2) |

dstPoints |

ptsA |

目标图像(左图)中的点坐标,形状 (N, 2) |

method |

cv2.RANSAC |

鲁棒估计算法,可选 0(最小二乘)、RANSAC、LMEDS、RHO |

ransacReprojThreshold |

10.0 |

仅用于RANSAC/RHO,表示重投影误差的最大允许值(像素)。超过此值的点会被视为外点 |

-

为什么需要RANSAC:即便经过比率测试,仍可能存在误匹配(如纹理重复区域)。RANSAC通过随机采样4对点计算单应性矩阵,统计符合该矩阵的内点数量,迭代多次保留内点最多的模型,从而剔除离群点。

-

阈值10.0的含义:若某对匹配点经过变换后的坐标与目标点相差超过10像素,则认为是外点。阈值越大,包容性越强,但可能引入误匹配;阈值越小,匹配要求越严格,但可能丢弃正确匹配。一般取值范围1~10。

4. warpPerspective 参数详解

result = cv2.warpPerspective(src, H, dsize, flags, borderMode, borderValue)| 参数 | 值 | 说明 |

|---|---|---|

src |

imageB |

输入图像(右图) |

H |

H |

3×3单应性矩阵 |

dsize |

(width, height) |

输出图像尺寸,注意顺序:先宽后高 |

flags |

默认 cv2.INTER_LINEAR |

插值方法,线性插值保证平滑 |

borderMode |

默认 cv2.BORDER_CONSTANT |

边界填充方式 |

borderValue |

默认 0 |

边界填充值(黑色) |

重点:dsize 的设定

代码中使用:

dsize = (imageB.shape[1] + imageA.shape[1], imageB.shape[0])-

imageB.shape[1]是右图的宽度(列数) -

imageA.shape[1]是左图的宽度 -

imageB.shape[0]是右图的高度(行数)

这样设置是为了确保变换后的右图不会超出画布右侧。但由于高度只取了右图高度,如果左图更高,左图的上/下部会被裁剪。更严谨的做法是计算变换后四个角点的最小外接矩形,动态决定画布尺寸。

为什么先宽后高?

OpenCV中图像数组索引是 (rows, cols),但很多函数(如 warpPerspective、resize)的尺寸参数要求 (width, height)。这是历史原因,务必注意不要写反。

5. 图像叠加:直接覆盖的优缺点

result[0:imageA.shape[0], 0:imageA.shape[1]] = imageA-

优点:简单、快速

-

缺点:重叠区域会出现明显的接缝(硬过渡)

-

改进 :使用加权融合(如

cv2.addWeighted)或多频段融合

运行结果与讨论

运行代码后,依次弹出窗口显示:

-

左图

A.jpg -

右图

B.jpg -

特征匹配连线图(筛选后的匹配对)

-

透视变换后的右图(单独显示)

-

最终拼接结果

控制台输出匹配点数量,例如:

筛选后的匹配点对数: 127最终保存的 pingjie.jpg 应呈现无缝全景效果。

可能遇到的问题及解决方法

| 问题 | 可能原因 | 解决方案 |

|---|---|---|

| 匹配点过少(<4) | 图像重叠区域太小或纹理单一 | 降低比率测试阈值(如0.7);改用ORB特征(更快但鲁棒性稍差) |

| 拼接后错位严重 | 误匹配较多 | 降低RANSAC阈值(如5.0);增加 findHomography 的迭代次数 |

| 输出图像黑边过大 | 透视变换后右图偏移超出画布 | 计算四个角点变换后的坐标范围,动态设定 dsize |

| 接缝明显 | 直接覆盖未融合 | 使用 cv2.addWeighted 对重叠区域进行线性融合 |

运行时找不到 cv2.SIFT_create() |

OpenCV版本较低或未安装contrib模块 | 执行 pip install opencv-contrib-python |

总结

本文通过一个完整的图像拼接示例,展示了OpenCV在图像处理中的典型应用流程:

-

特征提取:SIFT算法提供尺度不变的关键点和描述符

-

特征匹配:BFMatcher + Lowe's比率测试筛选可靠匹配

-

变换估计:RANSAC + 单应性矩阵鲁棒计算透视变换关系

-

透视变换 :利用

warpPerspective将右图变换到左图坐标系 -

图像融合:简单覆盖(可扩展为更平滑的融合)

重点剖析了 findHomography 和 warpPerspective 的参数含义,特别是RANSAC阈值、输出尺寸顺序等容易出错的地方。

该方案可作为图像拼接的入门实践,读者可在此基础上添加自动画布计算、曝光补偿、多频段融合等高级功能,以适应更复杂的场景。

希望这篇文章对你在图像处理和全景拼接方面有所帮助!如果有任何问题或建议,欢迎留言讨论。

注意 :实际运行代码时,请确保

A.jpg和B.jpg存在于当前目录,并根据图像内容适当调整比率测试阈值和RANSAC阈值。若SIFT不可用,请确认已安装opencv-contrib-python。