《4D Gaussian Splatting for Real-Time Dynamic Scene Rendering》

一、作者与所属单位

Guanjun Wu(共同一作)、Wei Wei:华中科技大学计算机科学学院

Taoran Yi(共同一作)、Wenyu Liu、Xinggang Wang(通讯作者 / 项目负责人):华中科技大学电子信息与通信学院

Jiemin Fang(项目负责人)、Lingxi Xie、Xiaopeng Zhang、Qi Tian:华为公司

注:作者贡献标注为共同一作,Jiemin Fang 与 Xinggang Wang 为项目牵头人。

二、研究动机

动态场景渲染的核心痛点:动态场景的三维表示与渲染是 3D 视觉的重要任务,需精准建模复杂的时空运动,但现有方法难以同时兼顾渲染质量、实时性、训练 / 存储效率,尤其是从稀疏的时空输入中建模复杂运动时,效率损失问题突出。

现有方法的局限性

NeRF 及其变体:能合成高质量新视角图像,但训练和渲染耗时久,难以实现实时性;

3D 高斯溅射(3D-GS):实现了静态场景的实时渲染,表征更显式且易操作,但仅适用于静态场景,直接扩展到动态场景(如为每一帧构建 3D 高斯)会导致存储成本随时间线性增加,无法处理长序列动态场景;

现有动态 NeRF/3D-GS 扩展方法:要么渲染速度慢,要么对复杂运动建模精度不足,或存储 / 训练成本过高。

研究目标:提出一种紧凑的 4D 高斯溅射表示方法,突破 3D-GS 的静态限制,实现高分辨率动态场景的实时渲染,同时保证训练效率高、存储成本低,且渲染质量媲美或优于 SOTA 方法。

三、研究结论与贡献

(一)核心结论

提出的4D-GS首次将 3D 高斯溅射扩展为 4D 时空表征,通过高斯形变场网络精准建模 3D 高斯的运动与形状形变,实现了高分辨率动态场景的实时渲染(合成数据集 82 FPS/800×800、真实数据集 30 FPS/1352×1014),且训练效率高、存储成本低。

时空结构编码器通过多分辨率平面连接相邻 3D 高斯的时空信息,避免了单独建模每个高斯的运动,既提升了复杂形变的建模精度,又有效防止了场景几何的撕裂,保证了渲染质量。

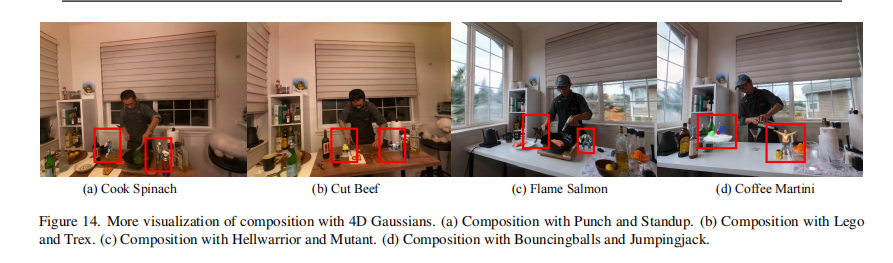

4D-GS 的显式表征特性使其具备4D 目标跟踪、动态场景合成 / 编辑的潜力,超越了单纯的渲染任务,为动态 3D 视觉的下游应用提供了新基础。

4D-GS 在合成 / 真实数据集上均实现了画质、帧率、存储的综合最优,显著优于现有动态 NeRF 和 3D-GS 扩展方法,是动态场景实时渲染的有效解决方案。

(二)主要贡献

方法创新:提出首个 4D 高斯溅射框架,设计高效的高斯形变场网络,实现静态 3D 高斯到动态 4D 表征的扩展,解决了 3D-GS 无法处理动态场景的问题,同时兼顾实时性与紧凑性;

模块创新:提出多分辨率时空结构编码器,融合空间与时间特征,连接相邻 3D 高斯,提升形变建模精度,降低存储与计算成本;

性能突破:实现高分辨率动态场景的实时渲染,在画质、训练效率、存储、拓展性上均超越 SOTA,为动态场景的 3D 表示与渲染提供了新范式;

应用潜力:验证了 4D-GS 在 3D 跟踪、动态场景编辑 / 合成的能力,为 VR/AR、影视制作、动态 3D 重建等应用提供了技术支撑。

(三)未来研究方向

引入深度、光流等先验信息,解决单目稀疏输入下的过拟合与大尺度运动建模问题;

设计静态 / 动态高斯的分离机制,提升复杂场景的建模精度;

优化形变场网络的紧凑性,适配城市级大规模动态场景重建;

结合在线训练方法,提升对超大规模、剧烈运动动态场景的适配能力。