一、引言:为什么需要分布式理论?

在大数据爆发式增长的今天,单机处理能力已无法承载PB级数据的存储、计算与分析需求,分布式架构成为大数据技术的核心支撑。从Hadoop的分布式文件系统(HDFS)到ZooKeeper的分布式协调,从Spark的分布式计算到Kafka的分布式消息队列,背后都离不开分布式理论的支撑。

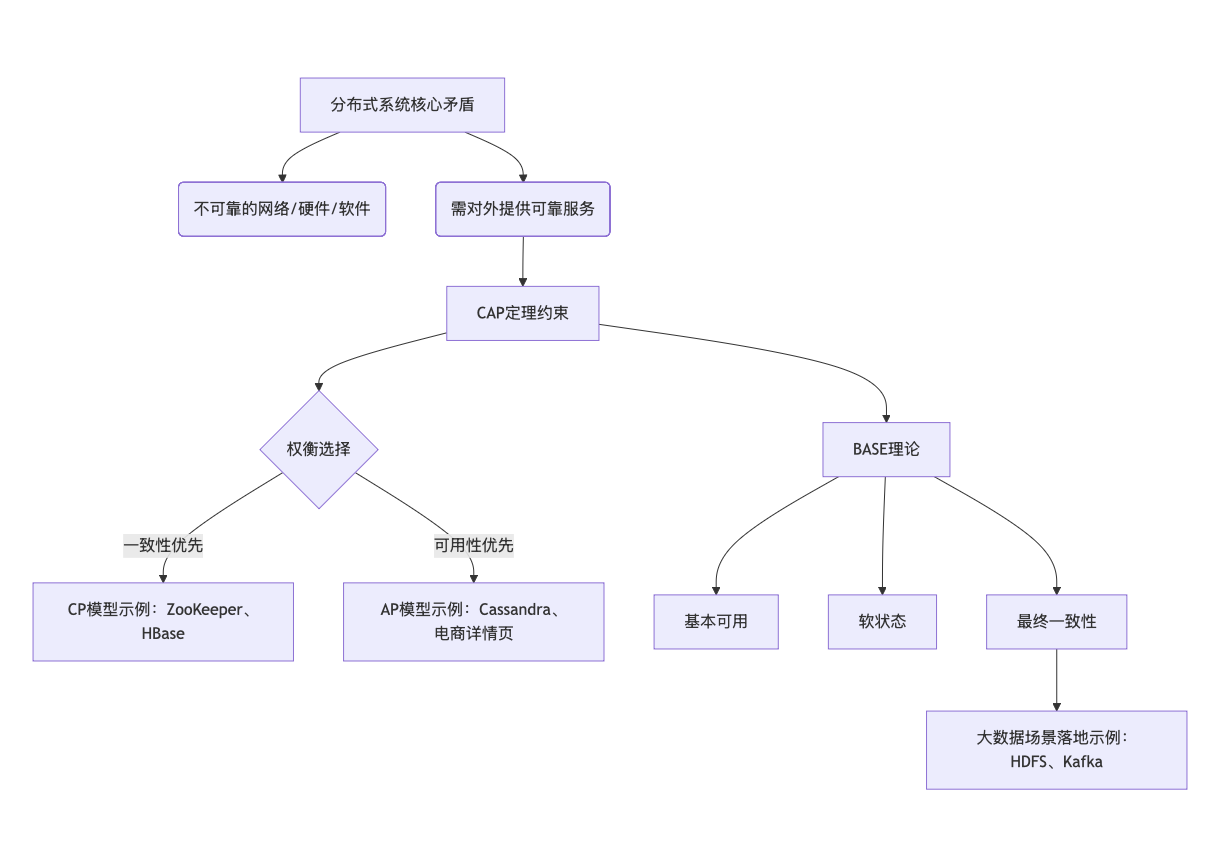

分布式系统的本质是"将多台独立计算机通过网络连接,协同完成单机无法胜任的任务",其核心价值在于突破单机的硬件资源限制,实现高可用、高扩展、高性能的计算与存储能力。然而,分布式系统带来了全新的挑战:网络可能延迟、节点可能宕机、数据可能不一致。面对这些复杂性,一套系统的理论体系成为构建可靠分布式系统不可或缺的指南。

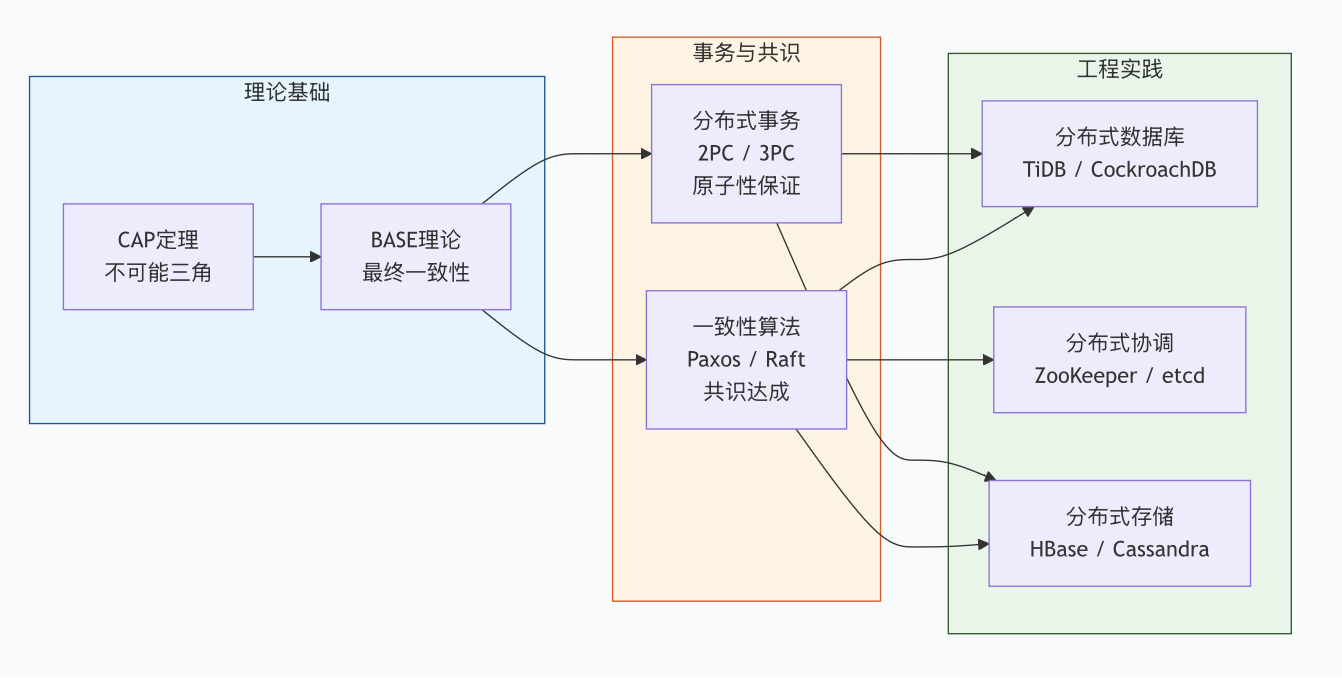

二、分布式理论两大核心定理:CAP与BASE

1.CAP定理------分布式系统的"第一性原理"

CAP定理由Eric Brewer提出,被麻省理工学院学者严格证明,是分布式系统的第一性原理。其核心内容为:分布式系统中,一致性(Consistency)、可用性(Availability)、分区容错性(Partition Tolerance)三者无法同时满足,最多只能满足其中两项。

- 一致性(C):所有节点在同一时间看到的数据完全一致,即更新操作执行后,所有节点的数据都同步更新为最新版本;

- 可用性(A):每一个请求都能收到非错误的响应,不保证返回最新数据,即系统始终处于可服务状态;

- 分区容错性(P):网络出现分区故障(节点间通信中断)时,系统仍能正常运行,这是分布式系统的固有需求,无法避免。

CAP定理的核心洞见在于:CAP并非"三选二",分布式系统中分区容错性P是必须满足的前提------网络分区是分布式环境的固有属性,无法彻底避免。因此架构设计只能在CP(一致性优先)和AP(可用性优先)之间做权衡,不存在同时满足CA的分布式系统,这一"不可能三角"构成了分布式系统设计的第一约束。(CA多用于单体架构设计)

CP vs AP 的典型取舍:

- CP系统(放弃可用性):ZooKeeper、etcd、HBase。宁可暂时不可用,也要保证数据一致。

- AP系统(放弃强一致性):Cassandra、DynamoDB、CouchDB。优先保证服务可用,通过异步复制实现最终一致性。

2.BASE理论------从"强一致"到"最终一致"的务实转身

CAP定理指出了设计的边界,但纯粹的CP或AP取舍在实际场景中往往过于极端。BASE理论由eBay架构师Dan Pritchett提出,是CAP定理在工程实践中的落地延伸,BASE理论的核心思想是放弃强一致性,追求最终一致性,以此在保证可用性和扩展性的同时尽量满足一致性要求。它与传统数据库的ACID模型形成了鲜明的对比------ACID追求强一致性,而BASE支持大型分布式系统通过牺牲强一致性获得高可用性。

- 基本可用(Basically Available):系统故障时,允许损失非核心功能的可用性,保障核心功能正常运行,如电商大促时,暂时关闭评论功能,保障下单、支付核心流程;

- 软状态(Soft State):允许系统数据存在中间状态,且该状态不影响系统整体可用性,如数据同步过程中的临时不一致状态;

- 最终一致性(Eventually Consistent):系统所有数据副本,经过一段时间同步后,最终能达到一致状态,无需实时同步,如HDFS的数据副本同步、Kafka的消息同步。

CAP与BASE的逻辑承接关系:CAP指出分布式系统存在根本约束,而BASE则在这一约束下提供了务实的解决路径------既然无法做到强一致性,就接受"软状态",追求"最终一致"。这一思想深刻影响了后续所有分布式系统的工程实践。

三、分布式事务:大数据分布式处理的"数据一致性保障"

在大数据场景中,分布式事务指"跨多个节点的操作,需保证所有节点操作要么全部成功,要么全部失败",如Hive分表数据插入、Spark Streaming实时数据写入多数据源、分布式数据库的跨节点更新等。分布式事务的核心挑战的是"跨节点通信不可靠",需通过特定协议解决数据一致性问题,常用的分布式事务模型包括2PC、3PC、TCC、SAGA等。

1.两阶段提交协议(2PC):最基础的分布式事务协议

2PC(Two-Phase Commit)是最经典、最基础的分布式事务协议,将事务分为"准备阶段"和"提交阶段",通过协调者(Coordinator)与参与者(Participant)的协同,保证事务原子性,适用于中小型分布式场景(如分布式数据库)。

- 准备阶段:协调者向所有参与者发送准备请求,询问是否可以提交事务。参与者接收请求并进行本地预处理,如果可以提交则返回"准备好"的响应,否则返回"拒绝"响应。

- 提交阶段:如果所有参与者都返回"准备好",协调者向所有参与者发送提交请求,参与者执行真正的提交操作;如果有任何一个参与者返回"拒绝",协调者向所有参与者发送回滚请求。

2PC的优点在于简单直观,能够保证事务的原子性。但其缺点同样显著:存在单点故障(协调者宕机会导致整个事务无法完成)、存在阻塞问题(参与者在准备阶段完成后要等待协调者的命令,期间无法执行其他操作)、性能较差。2PC追求强一致性(CP取向),但以牺牲可用性和性能为代价。

2.三阶段提交协议(3PC):2PC的改进版

3PC(Three-Phase Commit)是为解决2PC的阻塞问题而提出的改进协议,在2PC的基础上增加了"预提交阶段",将协调者的决策过程拆分,减少参与者的阻塞时间,同时引入超时机制,避免协调者故障导致的无限阻塞。

- 准备阶段:与2PC一致,协调者发送准备请求,参与者执行本地事务并返回就绪/拒绝;

- 预提交阶段:协调者确认所有参与者就绪后,发送预提交请求,参与者收到后进入"预提交状态",若未收到预提交请求,超时后自动回滚;

- 提交阶段:协调者发送提交/回滚请求,参与者执行对应操作并返回结果。

3PC的优点包括减少了单点故障的影响(协调者宕机后系统可以继续推进事务)以及减少了阻塞问题(参与者在预提交完成后可以继续其他操作)。但缺点是实现复杂,事务提交时间较长,且仍然存在数据不一致的可能。

从2PC到3PC的演进逻辑:2PC的阻塞问题源于协调者故障时参与者无法自行决策,3PC通过引入"预提交"和超时机制,让参与者在超时后能主动推进事务------这本质上是用更复杂的协议设计换取更好的可用性。

3.TCC与SAGA:大数据高可用场景的分布式事务方案

2PC、3PC适用于强一致性场景,但性能开销较大,无法满足大数据高并发、高可用的需求(如Spark实时计算、Kafka消息投递),因此诞生了TCC、SAGA等补偿性事务模型,以牺牲部分强一致性为代价,换取高可用性与高性能。

- TCC(Try-Confirm-Cancel) :这是一种业务层面 的补偿型事务,TCC将资源锁定从数据库层面提升到业务层面,且锁定时间极短(仅在Try到Confirm/Cancel之间),因此对数据库性能影响小,并发度高。

- Try:检查并预留业务资源(如冻结库存、预扣金额)。

- Confirm:确认执行业务,使用Try阶段预留的资源。要求幂等。

- Cancel:取消执行,释放Try阶段预留的资源。要求幂等。

- Saga事务 :适用于长事务场景。它将一个分布式事务拆分为一系列连续的本地子事务。每个子事务都有对应的补偿事务。执行时顺序执行子事务,若某个子事务失败,则按相反顺序执行已成功子事务的补偿事务进行回滚。Saga模式对业务侵入性较高,需要精心设计每个步骤的补偿操作。

四、分布式一致性算法:解决分布式系统"共识难题"

如果说CAP定义了边界、2PC/3PC处理了事务,那么一致性算法(Consensus Algorithm)则是解决分布式系统中最根本的问题:**多个节点如何就某个值达成一致?**在大数据场景中,一致性算法广泛应用于分布式协调(ZooKeeper的ZAB协议)、分布式存储(HDFS的NameNode选举)、分布式计算(Spark的Driver高可用)等场景,主流算法包括Paxos、Raft、ZAB。

1.Paxos算法:分布式一致性的"理论基石"

Paxos算法由Leslie Lamport提出,是分布式一致性算法的基础,几乎所有后续一致性算法(如Raft、ZAB)都基于Paxos的核心思想演变而来。其核心目标是"在异步系统中,实现节点间的共识",适用于分布式存储、分布式数据库等强一致性场景。

核心思想:将节点分为提议者(Proposer)、接受者(Acceptor)、学习者(Learner),通过"准备阶段"和"接受阶段"的两轮投票,确保所有节点达成一致,核心原则是"少数服从多数"。

- 准备阶段:提议者向所有接受者发送准备请求(包含提案编号),接受者若未接受过更高编号的提案,会回复"承诺"(不接受更低编号的提案),并返回已接受的最高编号提案;

- 接受阶段:提议者收到多数接受者的"承诺"后,发送具体提案(若有已接受的提案,需沿用最高编号的提案内容),接受者若未接受更高编号的提案,会接受该提案;

- 学习阶段(不参与决策):学习者从接受者处获取已被多数接受者接受的提案,达成一致。

Paxos算法理论严谨、容错性强,能保证强一致性;但实现复杂、难以理解,且存在"活锁"问题(多个提议者同时发起提案,相互干扰)。

2.Raft算法:最易理解的分布式一致性算法

Raft算法由斯坦福大学团队提出,其核心目标是"简化Paxos算法的实现,提高可理解性",同时保留Paxos的安全性与容错性,是目前最广泛应用的一致性算法(如etcd、Spark Driver高可用)。

核心改进:将Paxos的复杂流程拆分为"领导者选举""日志复制""安全性保障"三个独立模块,通过"领导者中心化"的方式,简化节点间的协同逻辑。

- 领导者选举:节点分为领导者(Leader)、跟随者(Follower)、候选人(Candidate),正常情况下只有一个领导者;跟随者若在选举超时(随机150-300ms)内未收到领导者的心跳,会转为候选人,发起投票,获得多数选票者成为领导者;若出现选票分裂,随机超时后重新选举。

- 日志复制:所有客户端请求都发送给领导者,领导者将请求记录为日志条目,同步到所有跟随者,跟随者确认收到后返回响应,领导者收到多数跟随者的确认后,提交日志并向客户端返回结果。

- 安全性保障:通过"日志匹配特性""领导者完整性"等规则,确保所有节点的日志一致,避免数据丢失或不一致。

Raft算法实现简单、易理解,容错性与Paxos相当,能容忍n/2-1个节点故障;性能优秀,适用于高并发场景;目前已成为工业界的主流选择。

3.ZAB协议:ZooKeeper的核心一致性协议

ZAB(ZooKeeper Atomic Broadcast)协议是ZooKeeper专门设计的分布式一致性协议,基于Paxos算法演变而来,核心目标是"保证ZooKeeper集群中所有节点的数据一致性",适用于分布式协调场景(如分布式锁、服务注册发现)。

核心特点:ZAB协议分为"崩溃恢复"和"原子广播"两个阶段,崩溃恢复阶段确保集群在领导者故障后,能快速选举新的领导者,并同步所有节点的日志;原子广播阶段确保领导者发送的事务请求,能被所有节点一致执行。

与Paxos的区别:ZAB协议更注重"主备复制系统的状态机同步",而Paxos更注重"通用分布式共识";ZAB的消息类型更简单(Propose/Ack/Commit),实现相对简单,且性能更优。

4.一致性算法对比

| 算法 | 核心思想 | 容错能力 | 可理解性 | 适用场景 |

|---|---|---|---|---|

| Paxos | 两轮投票,少数服从多数 | 容忍n/2-1个节点故障 | 低 | 分布式存储、分布式数据库 |

| Raft | 领导者选举+日志复制,中心化管理 | 容忍n/2-1个节点故障 | 高 | etcd、Spark Driver高可用、分布式协调 |

| ZAB | 崩溃恢复+原子广播,主备同步 | 容忍n/2-1个节点故障 | 中 | ZooKeeper、分布式锁、服务注册发现 |

五、总结展望

分布式理论、分布式事务、分布式一致性算法,是大数据分布式处理的三大核心基石------CAP给出了约束条件,事务协议解决了"原子性"问题,一致性算法解决了"共识"问题。一个成熟的分布式存储系统,通常需要同时运用这些技术:用一致性算法(如Raft)管理元数据和选主,用分布式事务协议(如2PC或TCC)处理跨分片写入,最终在CAP的约束下做出符合业务需求的取舍。

随着大数据技术的不断发展,分布式理论也在不断演进:一方面,一致性算法朝着"更简单、更高性能"的方向发展(如Raft的普及、ZAB的优化);另一方面,分布式事务模型朝着"高可用、低延迟"的方向优化,以适配实时大数据处理场景(如Flink的分布式事务优化)。

在大数据时代,分布式系统已成为标配而非选项。理解这套理论体系,不仅是技术进阶的必经之路,更是设计可靠、高效分布式系统的底层保障。理论与实践的结合点,恰在于此:当我们理解了"为什么"的约束,才更能做出"怎么做"的正确选择。