前言

记录 docker compose部署kafka集群搭建

现在有三台服务器:

172.16.10.80

172.16.10.98

172.16.10.97

通过网盘分享的文件:kafka集群部署.zip

链接: https://pan.baidu.com/s/1HTYEN_eO8kdyka7WvZquDQ?pwd=ravd 提取码: ravd

快速部署

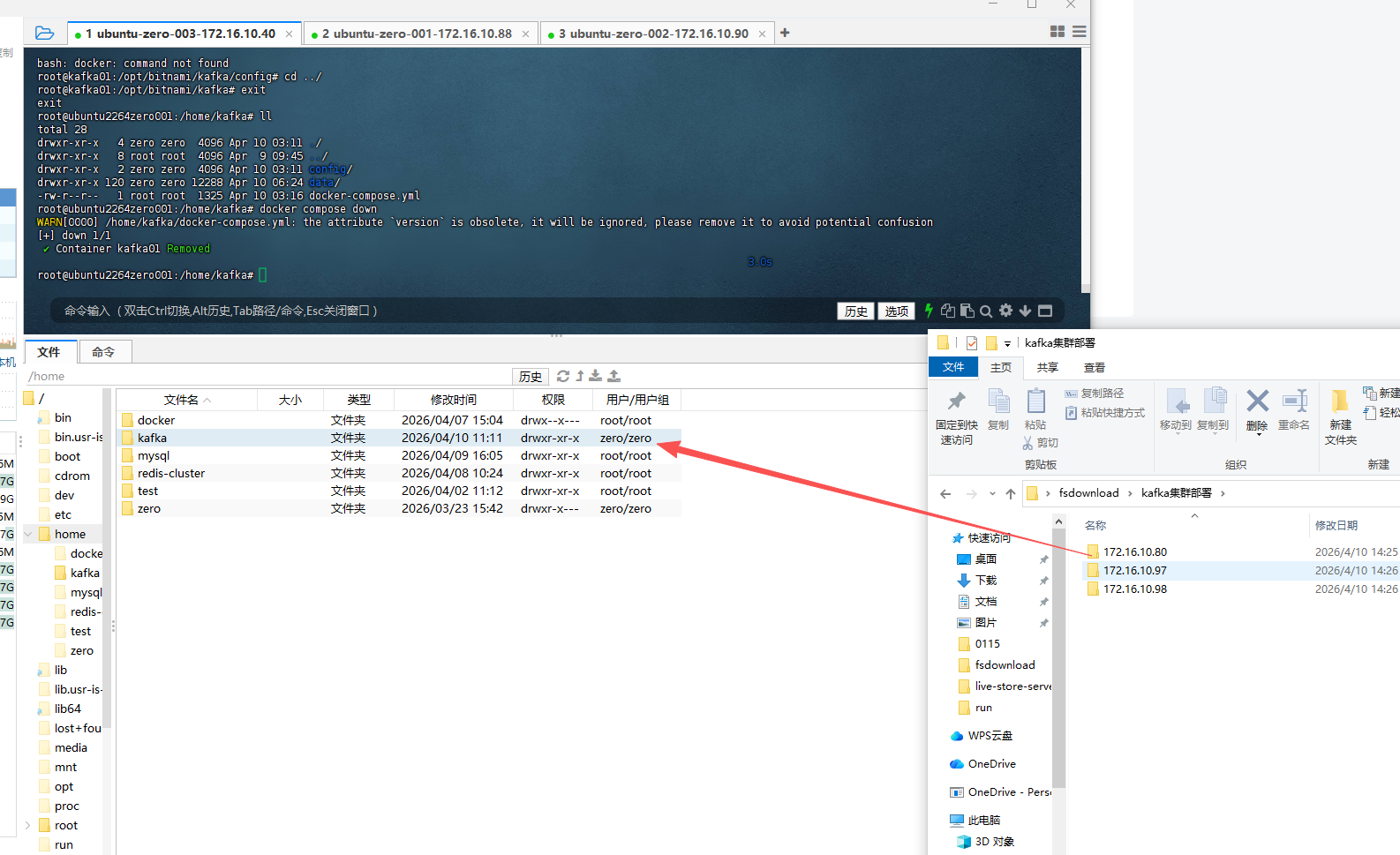

步骤一:下载压缩包解压

将 kafka集群部署\ip\kafka 文件夹上传到对应服务器 /home 文件夹下

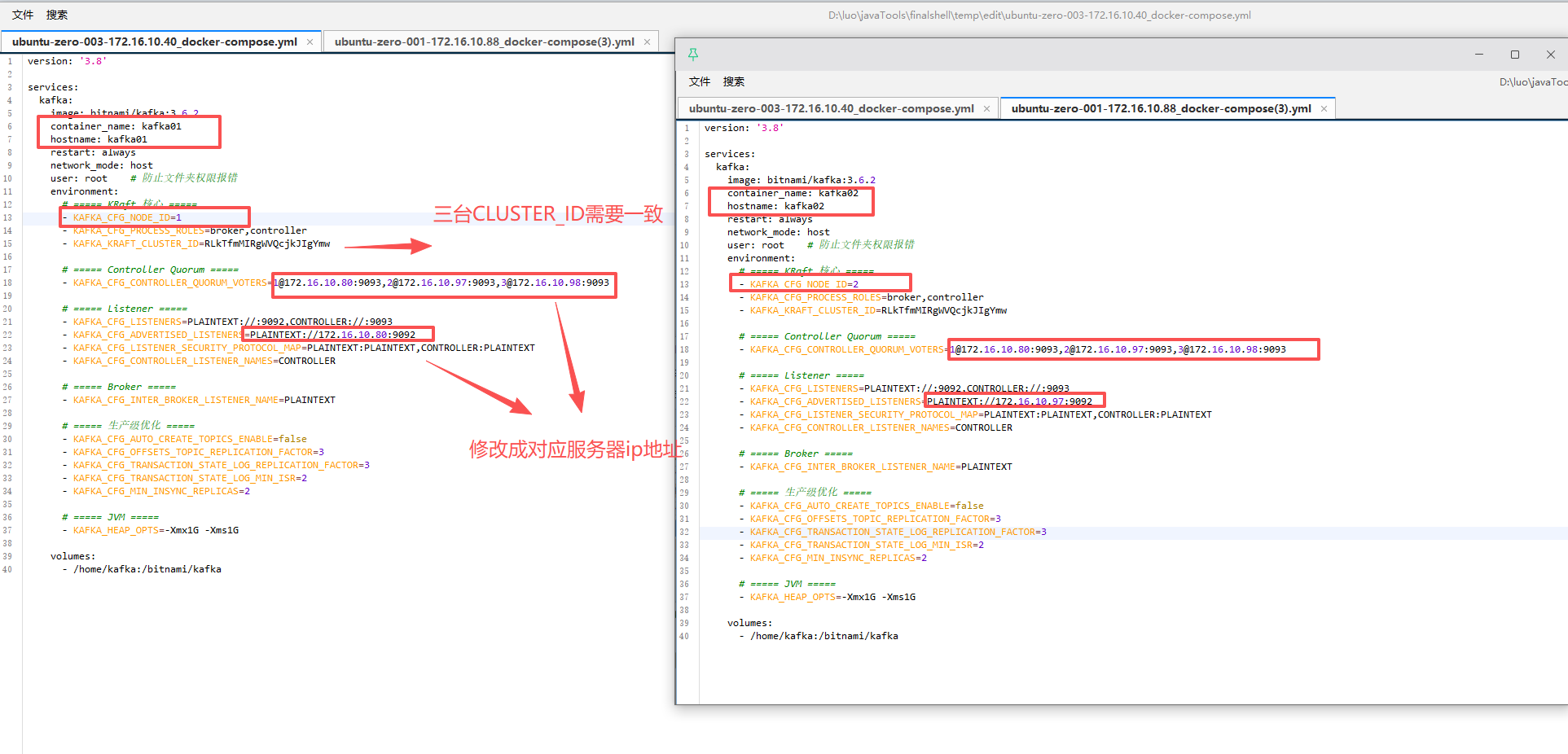

步骤二:修改三台服务器下/home/kafka/docker-compose.yml文件

步骤三:启动容器:

进入80 97 98服务器执行命令启动mysql容器

cd /home/kafka

docker compose up -d

扩展

注 这里得kafka容器默认配置 min.insync.replicas=2 replicas不能小于这个值

注 这里得kafka容器默认配置 min.insync.replicas=2 replicas不能小于这个值

注 这里得kafka容器默认配置 min.insync.replicas=2 replicas不能小于这个值

项目使用yml配置

kafka: topics: - name: lst_export_excel_business partitions: 3 # 注 这里得kafka容器默认配置 min.insync.replicas=2 replicas不能小于这个值 replicas: 2 bootstrap-servers:172.16.10.80:9092,172.16.10.97:9092,172.16.10.98:9092 producer: acks: -1 retries: 32 key-serializer: org.apache.kafka.common.serialization.StringSerializer value-serializer: org.apache.kafka.common.serialization.StringSerializer batch-size: 32768 compression-type: snappy buffer-memory: 67108864 properties: 'linger.ms': 5 consumer: group-id: ${KAFKA_CONSUMER_GROUP_ID:storeServerGroup} key-deserializer: org.apache.kafka.common.serialization.StringDeserializer value-deserializer: org.apache.kafka.common.serialization.StringDeserializer auto-offset-reset: latest enable-auto-commit: false auto-commit-interval: 3 properties: max.poll.retries: 32 # 消费者重试次数 retry.backoff.ms: 100000 #单位毫秒 listener: ack-mode: manual_immediate