引言:算力碎片化下的"资源孤岛"

在 AIoT 落地的最后一百米,我们面临着严峻的"算力碎片化"挑战。企业客户的数据中心可能是基于 Intel X86 的高性能 GPU 集群,而边缘侧的工厂或园区却部署着基于 ARM 架构(如 RK3588、Sophon、K210)的 NPU 盒子。传统的视频分析系统往往被锁定在单一的硬件生态中:要么依赖昂贵的 NVIDIA 显卡,要么受限于特定芯片厂商的私有 SDK。为了打通不同芯片间的壁垒,集成商通常需要编写大量的适配层代码,这种底层算力的"内卷",直接导致了约 95% 的开发成本浪费在非核心业务上。

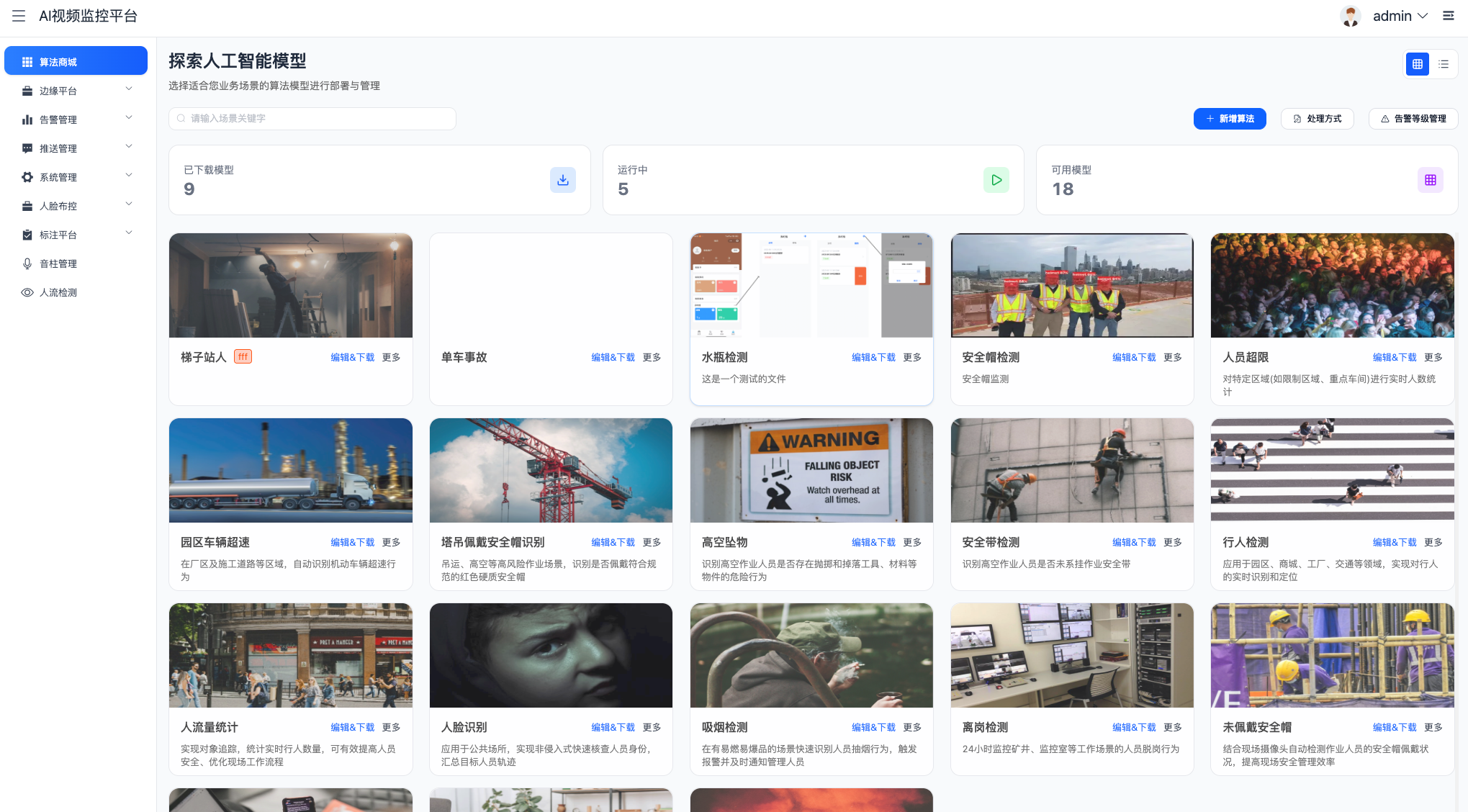

YiheCode Server 提供了一种"软硬解耦"的架构范式。作为一个企业级 AI 视频管理平台,它通过抽象化的算力管理层,实现了对 x86/ARM 指令集 与 GPU/NPU 芯片的统一调度。本文将深入其源码架构,解析它如何构建一个异构兼容的安防底座。

一、 核心架构:微服务与算力资源池化

YiheCode Server 采用 Spring Boot 2.7 + Vue 2.6 的技术栈,后端服务本身具备极高的通用性,能够原生运行在 Linux x86 与 ARM 环境下。其架构设计的核心在于"边缘代理 + 中心管控"的模式。

1.1 算力资源的统一抽象

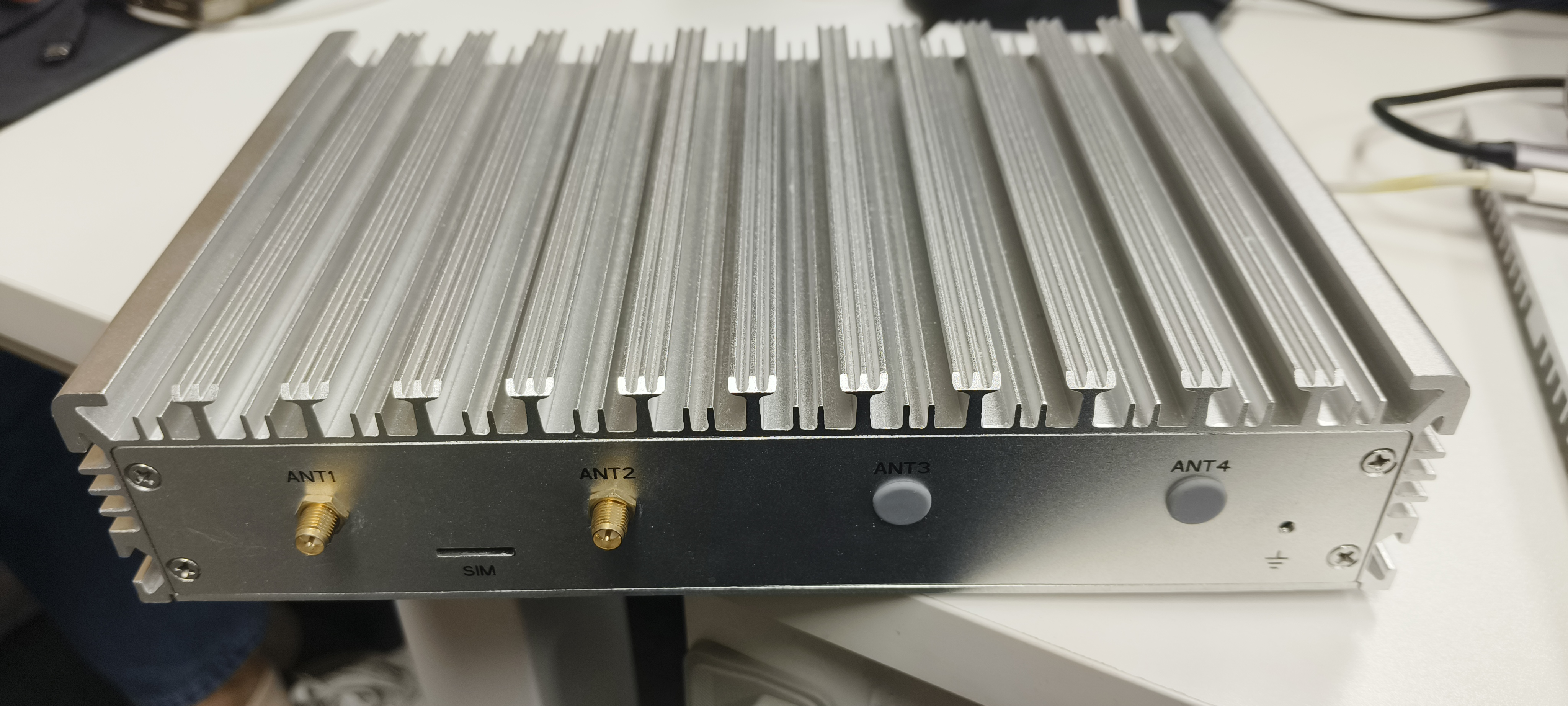

平台并未将推理逻辑硬编码在服务端,而是通过边缘计算节点(Edge Node)进行动态注册。无论是搭载了 NVIDIA Tesla 的中心服务器,还是搭载了 Rockchip NPU 的边缘盒子,都会向中心注册为一个"计算单元"。

- X86 中心集群:负责高负载的通用计算、视频流录制存储(MinIO)、以及 Web 服务。

- ARM 边缘节点:负责实时的视频流拉取、低延时的 AI 推理(模型下发)。

1.2 异构芯片的适配层

文档中提及的"全硬件适配",在架构上体现为插件化的推理引擎适配器。平台支持将客户自训练的模型(ONNX/TensorRT/RKNN)打包下发。在边缘侧,系统会根据硬件指纹自动选择对应的 Runtime:

- NVIDIA 环境:自动加载 TensorRT 或 CUDA 推理后端。

- 国产化 ARM 环境:自动加载 NPU 驱动(如瑞芯微、比特大陆等)。

二、 边缘协同:基于 ZLMediaKit 的流媒体调度

硬件适配只是第一步,如何在异构网络中高效传输视频流才是关键。YiheCode 结合 ZLMediaKit 构建了高性能的流媒体层。

2.1 混合流媒体传输

系统支持根据网络环境和硬件性能,智能选择流媒体传输策略:

| 传输模式 | 适用场景 | 硬件要求 | 架构优势 |

|---|---|---|---|

| 中心拉流 | 内网互通,带宽充足 | 中心 X86 服务器 | 减少边缘设备负载,集中存储 |

| 边缘推流 | 跨网段,无公网 IP | 边缘 ARM 盒子 | 解决 NAT 穿透难题,利用边缘算力转码 |

2.2 负载均衡与节点分配

在 Gitee 文档的架构图中,我们可以看到"摄像头固定分配"的逻辑。当系统检测到多台 ZLMediaKit 节点(流媒体服务器)时,会根据当前节点的 CPU 占用率和连接数,自动将视频流分配到负载最低的节点。这种机制确保了在混合部署(部分服务在 X86,部分在 ARM)环境下,资源的最优利用。

三、 源码级的低代码实现:从"适配硬件"到"专注业务"

对于技术决策者而言,购买一套闭源系统意味着永远无法触及底层性能瓶颈。YiheCode Server 的源码交付模式,让企业拥有了对异构环境的绝对掌控力。

3.1 配置即代码 (Configuration as Code)

平台通过简单的配置文件,即可完成对不同硬件环境的适配。例如,在 application.yml 中定义算力类型:

yaml

ai-engine:

# 自动检测硬件环境

hardware-type: AUTO

# 或手动指定: CUDA, CPU, RK3588, SOPHON

inference-backend:

- TRT # TensorRT 优先

- OPENCV_DNN # 备选方案

# 边缘节点心跳间隔

heartbeat-interval: 30s3.2 算法与硬件的解耦

得益于 Java 的跨平台特性,后端服务无需修改代码即可在 ARM 服务器上运行。开发者只需关注算法模型的训练,平台负责将模型编译为对应硬件的指令集。文档中提到的"支持添加客户自己训练的模型",意味着企业可以利用现有的 PyTorch/TensorFlow 模型,无需考虑底层芯片是英伟达还是华为昇腾,由平台完成算子的映射与优化。

四、 总结

YiheCode Server 通过"Spring Boot 跨平台服务 + ZLMediaKit 流媒体 + 插件化推理引擎"的架构,成功构建了一个"一次开发,处处运行"的 AI 视频底座。

它不仅解决了 X86 与 ARM 之间的"巴别塔"问题,更通过源码开放,让企业能够根据特定的 NPU/GPU 进行深度定制。这种架构设计,直接抹平了硬件差异带来的开发鸿沟,真正实现了95% 开发成本的降低。对于需要构建私有化、国产化或混合云安防平台的技术团队来说,这是一个极具战略价值的基础设施选择。

架构师建议 :

在部署异构集群时,建议将 MinIO(对象存储) 和 Redis(缓存) 独立部署在高性能 X86 服务器上,而将边缘计算服务(Edge Service)部署在 ARM 节点上,以达到性能与成本的最佳平衡。