Guava RateLimiter深度解析:非阻塞令牌桶限流原理与跑批实战

- 一、什么是RateLimiter?

- 二、核心原理深度解析

-

- [1. 令牌桶算法变种实现](#1. 令牌桶算法变种实现)

- [2. 令牌获取流程(reserve()原理)](#2. 令牌获取流程(reserve()原理))

- [3. 预热机制(Warming Up)强化解析](#3. 预热机制(Warming Up)强化解析)

- 三、非阻塞限流的实现关键

-

- [1. 无锁并发设计](#1. 无锁并发设计)

- [2. 免线程发放令牌](#2. 免线程发放令牌)

- [3. tryAcquire快速路径](#3. tryAcquire快速路径)

- 四、跑批场景实战应用

- 五、最佳实践总结

-

- [1. 配置黄金法则:](#1. 配置黄金法则:)

- [2. 跑批场景参数公式:](#2. 跑批场景参数公式:)

- [3. 监控集成:](#3. 监控集成:)

- 六、总结

-

- [1. 时间驱动模型:](#1. 时间驱动模型:)

- [2. 高效并发控制:](#2. 高效并发控制:)

- [3. 预热保护机制:](#3. 预热保护机制:)

如何在大流量场景下保护系统稳定性?Google Guava的RateLimiter给出了优雅的解决方案。掌握其核心原理,你就能轻松应对高并发场景和跑批任务的压力控制!

一、什么是RateLimiter?

com.google.common.util.concurrent.RateLimiter是Google Guava库中用于控制资源访问速率的核心工具。它能确保在单位时间内只能执行指定数量的操作,从而避免突发流量导致系统崩溃。在大数据跑批、API调用限流、资源密集型操作等场景中广泛应用。

主要特性:

• ⚡ 基于令牌桶算法(Token Bucket)的变种实现

• 🚀 非阻塞获取机制,避免线程阻塞带来的性能损耗

• 🔄 支持预热机制(Warming Up),防止冷启动冲击

• 📈 允许短期突发流量,但长期维持稳定速率

二、核心原理深度解析

1. 令牌桶算法变种实现

令牌桶概念 (Token Bucket):

想象一个虚拟的桶,容量固定(桶大小 = 最大突发许可数 maxBurstSeconds * permitsPerSecond)。系统以固定的速率 permitsPerSecond 向桶中添加令牌。当一个操作需要执行时,必须从这个桶中获取一个令牌。桶中有足够令牌时,操作立即执行并消耗令牌;令牌不足时,操作需等待直到桶中累积足够令牌。

Guava RateLimiter 的具体实现:

Guava的实现创新性地采用时间驱动而非显式计数器跟踪机制,通过两个核心状态变量实现高效限流:

// 核心状态变量

java

double storedPermits; // 当前存储的令牌数量(0~maxPermits)

long nextFreeTicketMicros; // 下一个令牌可免费获取的时间戳(微秒级)

double maxPermits; // 桶最大容量(根据突发配置或预热计算)

double permitsPerSecond; // 令牌生成速率2. 令牌获取流程(reserve()原理)

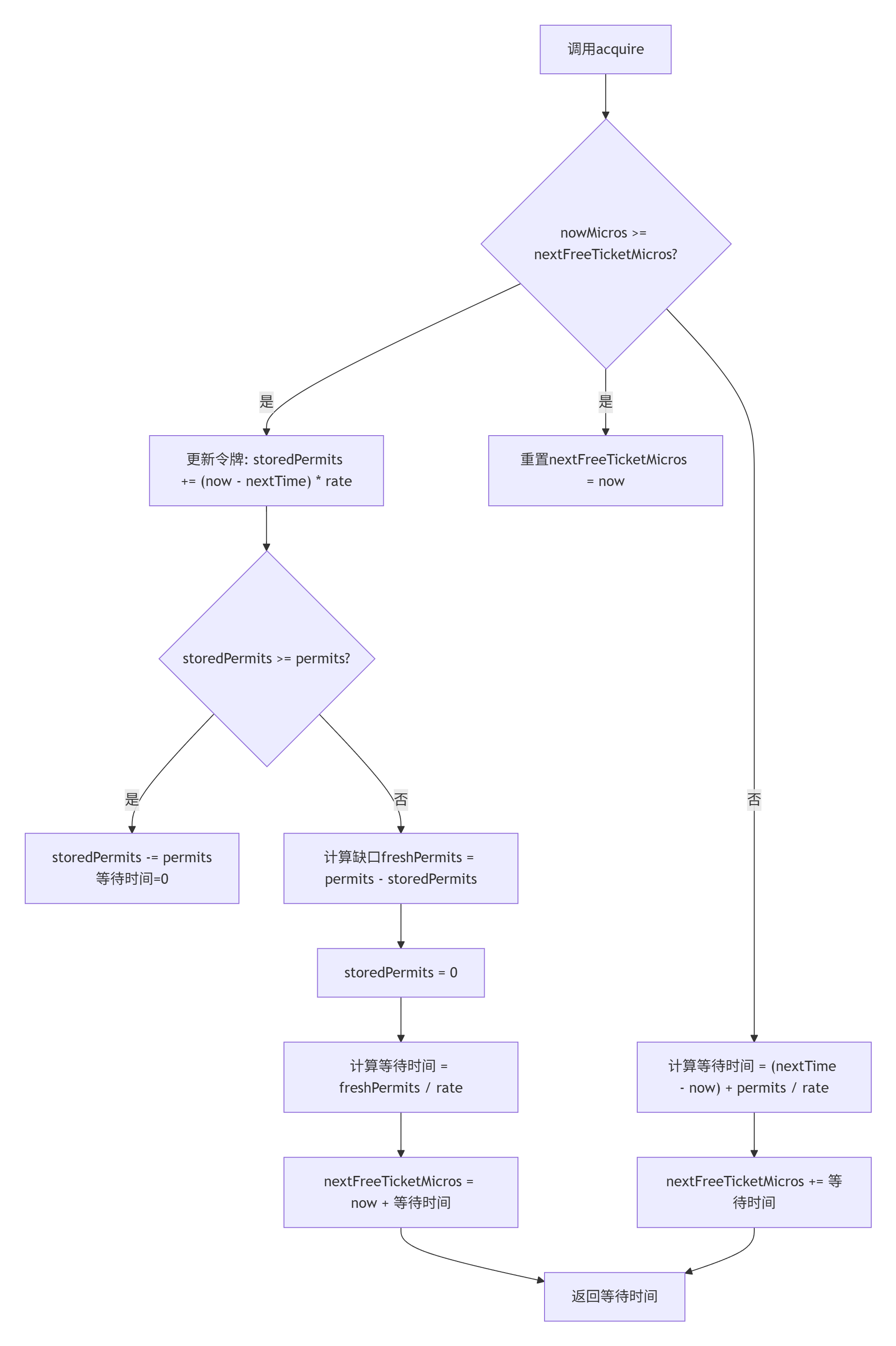

当调用acquire(permits)方法时,RateLimiter执行以下核心流程:

具体步骤分解:

1. 时间检查与令牌更新:

java

long nowMicros = System.nanoTime() / 1000;

if (nowMicros >= nextFreeTicketMicros) {

// 计算并添加这段时间生成的令牌

double newPermits = (nowMicros - nextFreeTicketMicros) * permitsPerSecond / 1e6;

storedPermits = min(maxPermits, storedPermits + newPermits);

nextFreeTicketMicros = nowMicros;

}2. 令牌分配决策:

java

if (storedPermits >= permits) {

// 使用存储的令牌

storedPermits -= permits;

return 0; // 无需等待

} else {

// 需要新生成的令牌

double freshPermits = permits - storedPermits;

storedPermits = 0;

// 计算等待新令牌生成的时间

long waitMicros = (long)(freshPermits * 1e6 / permitsPerSecond);

nextFreeTicketMicros = nowMicros + waitMicros;

return waitMicros;

}3. 处理令牌透支(当时间未到下一个令牌点时):

java

long waitMicros = nextFreeTicketMicros - nowMicros + (long)(permits * 1e6 / permitsPerSecond);

nextFreeTicketMicros += waitMicros; // 累积延迟

return waitMicros;3. 预热机制(Warming Up)强化解析

问题场景:系统长时间空闲后,storedPermits达到maxPermits。此时突发大量请求:

• 按稳定速率需等待freshPermits * 1e6 / permitsPerSecond

• 当freshPermits很大时,等待时间可能达到分钟级

• 这等同于拒绝服务,不符合业务需求

解决方案:RateLimiter.create(permitsPerSecond, warmupPeriod, unit)

预热原理:

// 冷热分区计算

java

double coldFactor = 3.0; // 冷区令牌消耗因子

double coldPermits = warmupPeriodMicros * permitsPerSecond / (coldFactor - 1.0);

double hotPermits = maxPermits - coldPermits;

// 令牌消耗等待时间计算

long waitMicros = storedPermits > coldPermits ?

(long)((storedPermits - coldPermits) * stableIntervalMicros) : // 热区

(long)(storedPermits * coldIntervalMicros); // 冷区运作机制:

-

桶划分为两个区域:

• Cold区:令牌消耗成本是热区的3倍(可配置)

• Hot区:令牌按标准速率消耗

-

令牌分布与消耗成本:

• 冷区令牌占比越高,单个令牌等待时间越长

• 随存储令牌减少,等待时间线性降低

-

效果呈现:

• 冷启动处理速率:1/3 目标速率

• 逐步增加到目标速率

• 形成平滑的梯形速率曲线

三、非阻塞限流的实现关键

1. 无锁并发设计

java

public double acquire(int permits) {

long microsToWait;

synchronized (mutex) { // 轻量级同步块

microsToWait = reserve(permits); // 核心计算

}

ticker.sleep(microsToWait); // 在同步块外等待

return 1.0 * microsToWait / TimeUnit.SECONDS.toMicros(1L);

}优化亮点:

• 🔒 极小同步范围:仅保护状态变量的计算过程(纳秒级)

• ⏳ 等待外部化:阻塞操作在同步块外执行

• ✨ 无竞争获取:一个线程等待时,其他线程仍可获取

2. 免线程发放令牌

传统方案:

• 🚫 需独立线程按秒添加令牌

• 🚫 线程上下文切换开销大

• 🚫 复杂线程安全控制

Guava创新:

• ✅ 惰性计算:请求触发时动态计算令牌

• ✅ 时间差驱动:通过(now - nextTime) * rate计算应生成令牌

• ✅ 零额外线程:减少系统开销和竞争

3. tryAcquire快速路径

java

public boolean tryAcquire() {

synchronized (mutex) {

// 极速判断路径

if (nextFreeTicketMicros <= System.nanoTime()/1000) {

storedPermits--; // 令牌充足

return true;

}

return false; // 立即返回不阻塞

}

}性能优势:

• ⚡ 平均执行时间 < 100ns

• 📉 失败率高的场景下性能优势明显

• 🎯 高并发场景减少线程竞争

四、跑批场景实战应用

在大数据跑批场景中,RateLimiter可完美解决以下痛点:

• 跑批任务突发压力压垮数据库

• 批量调用外部API被限流

• 资源消耗失控导致系统OOM

方案1:控制任务提交速率(生产者限流)

// 创建RateLimiter(每秒50个任务)

java

RateLimiter rateLimiter = RateLimiter.create(50.0);

ExecutorService executor = Executors.newFixedThreadPool(20);

List<Runnable> batchTasks = getBatchTasks(); // 获取批处理任务

for (Runnable task : batchTasks) {

rateLimiter.acquire(); // 阻塞获取令牌

executor.submit(task); // 提交任务到线程池

}适用场景:

• CPU密集型任务

• 任务执行时间短且稳定

• 需控制队列积压

方案2:控制任务完成速率(消费者限流)

java

// 限制数据库写入速率(每秒1000次)

RateLimiter dbRateLimiter = RateLimiter.create(1000.0);

ExecutorService executor = new ThreadPoolExecutor(

20, 20, 0L, TimeUnit.MILLISECONDS,

new LinkedBlockingQueue<>(5000));

for (DataBatch batch : batches) {

executor.submit(() -> {

// 执行批处理任务(如ETL转换)

processBatch(batch);

// 在写入数据库前限流

dbRateLimiter.acquire(batch.size());

saveToDatabase(batch);

});

}优势对比:

方案 控制点 资源保护目标 适用场景

方案1 任务提交 CPU/内存 计算密集型

方案2 任务完成 下游资源(DB/API) I/O密集型

突发流量处理(tryAcquire + 退避策略)

java

ExecutorService executor = Executors.newCachedThreadPool();

RateLimiter rateLimiter = RateLimiter.create(200.0); // 200 QPS

BlockingQueue<Runnable> retryQueue = new LinkedBlockingQueue<>();

// 处理主任务队列

while (!taskQueue.isEmpty()) {

Runnable task = taskQueue.poll();

if (rateLimiter.tryAcquire()) {

executor.submit(task);

} else {

// 退避策略

long backoffTime = exponentialBackoff(retryCount);

Thread.sleep(backoffTime);

retryQueue.add(task); // 加入重试队列

}

}

// 处理重试队列

while (!retryQueue.isEmpty()) {

Runnable task = retryQueue.take();

rateLimiter.acquire(); // 阻塞等待令牌

executor.submit(task);

}五、最佳实践总结

1. 配置黄金法则:

java

// 基础限流(突发上限=1秒)

RateLimiter.create(100.0);

// 带预热的限流器(30秒预热期)

RateLimiter.create(100.0, 30, TimeUnit.SECONDS);

// 调整令牌桶容量(允许2秒突发)

rateLimiter.setRate(100.0);

rateLimiter.setBurstCapacity(200); // 允许200个突发2. 跑批场景参数公式:

最大并发数 = 批处理系统TPS / 单任务平均处理时间

令牌生成速率 = 下游系统最大承受QPS * 安全系数(0.6~0.8)

桶容量 = 下游系统最大突发处理量

3. 监控集成:

java

// 实时监控指标

double qps = rateLimiter.getRate();

double stored = rateLimiter.getStoredPermits();

long nextTime = rateLimiter.nextFreeTicketMicros();

double utilization = stored / maxPermits;

// 集成Prometheus

Gauge.build("rate_limiter_stored", "Current stored permits")

.create().setChild(() -> rateLimiter.getStoredPermits()).register();六、总结

Guava RateLimiter的核心创新在于将令牌桶算法的动态计算与高效的非阻塞机制完美融合:

1. 时间驱动模型:

• 通过nextFreeTicketMicros跟踪令牌可用状态

• 基于时间差动态计算令牌生成数

• 消除后台发放线程

2. 高效并发控制:

• 微秒级同步块保护关键状态

• 等待操作与状态解耦

• tryAcquire极速失败路径

3. 预热保护机制:

• 冷热区令牌成本差异化

• 平滑启动曲线

• 防止冷启动冲击下游

无论您面对高并发API限流还是大数据跑批任务,RateLimiter都能提供优雅的流量控制解决方案。核心要点总结为一句话:用时间换空间,以计算代线程,实现稳定可靠的非阻塞限流!

令牌桶中无令牌,时间驱动巧计算;

冷启热区保平稳,微锁快出控流量。

掌握RateLimiter核心道,系统稳定无烦恼!