我国制造业数字化转型已进入规模化普及阶段,关键指标显著提升:截至2025年12月,全国规模以上工业企业开展数字化改造的比例已达89.6%,数字化设备普及率达到57.7%;分行业看,汽车、船舶和电子信息制造业数字化改造企业占比分别高达94.4%、94.2%和93.9%。然而,高比例的数字化投入并未直接转化为等比例的管理效率提升。大量制造企业正面临一个更棘手的问题:多系统并行运转,数据各自为政。针对这一困境,以KPaaS平台为代表的主数据管理方案,构建统一的主数据治理与分发中枢,帮助企业实现"一数一源、全局共享"的数据管理目标,从根本上解决因主数据分散导致的数据不一致、重复录入、标准不一等顽疾。

一、问题的真实面貌:系统越多,混乱越深

制造企业的IT架构天然是"叠加式"演进的。早期上一套ERP管财务与物料,后来加WMS管仓库,再后来MES管生产执行,CRM、SRM、PLM逐一上线。

理想状态是各司其职。现实却是:同一款物料,ERP里编码A001,WMS里叫A-001,MES里写成A001-Rev1。同一个客户,CRM中地址已更新,ERP里还是三年前的信息。

这不是个别现象。调研显示,实施超过4套业务系统的制造企业中,83% 承认存在跨系统主数据不一致问题,67% 每周至少发生一次因数据错误导致的业务中断。

问题根源在于三点:

第一,维护入口分散。 物料主数据本应在ERP中统一维护,但产线为了赶工,直接在MES里新增物料编码;销售为了快速开单,在CRM中临时创建客户档案。多个源头同时写入,没有仲裁机制。

第二,同步机制原始。 大量企业仍依赖"定期导出Excel + 人工导入"的方式跨系统搬运数据。频率低、延迟高、易出错。一位IT负责人曾直言:"我们每周一上午专门安排两个人对账,光是物料编码不一致就能耗掉半天。"

第三,标准缺失或形同虚设。 虽有数据标准文档,但系统层面没有强制校验。业务人员更关心"能否快速走完流程",而非"录入的数据是否符合规范"。

这些问题的代价是真实的:订单交付延迟、采购重复下单、生产物料错配、财务报表对不上。更深远的影响在于,管理层越来越不敢信任数据------而信任一旦动摇,任何基于数据的决策都会变得犹豫。

二、传统解法的三重困境

企业并非没有意识到问题。常见应对方式有三种,但各有硬伤。

方式一:点对点接口开发。 在A系统和B系统之间写死接口,数据变更时实时同步。短期有效,但当系统数量增加到5个、6个时,接口数量呈N×(N-1)级爆炸。每新增一个系统,需改造所有现有接口。维护成本急剧攀升,且形成"蜘蛛网式"依赖------任何一个接口故障,都可能引发连锁反应。

方式二:引入重型MDM(主数据管理)系统。 国际大厂的MDM方案功能完备,但实施周期通常以年计,投入数百万起步。对中型制造企业而言,门槛过高。更关键的是,重型MDM要求企业先完成全面的数据治理咨询,理清所有标准后再动工。这在快速变化的业务环境中往往不现实------业务不等你。

方式三:人工兜底。 设立专门的数据管理员岗位,定期巡检、清洗、校对。这是最"灵活"的方案,也是最不可持续的。随着数据量增长,人工处理的速度永远追不上错误产生的速度。且人的判断存在不一致性,今天认为重复的记录,明天可能被判定为有效。

以上方案共同的问题是:要么太贵,要么太慢,要么太脆弱。 制造企业需要的是一条中间路径------具备治理能力,但不牺牲灵活性;实现自动化,但无需推倒现有系统。

三、架构演进的正确方向:枢纽模式而非网格模式

解决多系统数据管控问题的本质,不是消灭所有系统,而是改变系统之间的连接方式。

点对点集成(网格模式)的复杂度是O(N²)。当N=10时,理论上需要45组接口。每一组都需要定义协议、字段映射、异常处理、重试机制。这在实际工程中几乎不可维护。

更优的模式是引入一个集成枢纽。所有系统只与枢纽对话:数据变更时推送给枢纽,枢纽负责校验、转换、分发给其他系统。复杂度从O(N²)降至O(N)。当新增系统时,只需建立与枢纽的单一连接。

这就是集成平台即服务的核心逻辑。而主数据管理,正是这个枢纽上最关键的应用场景之一。

在这一架构下,企业可以参考KPaaS平台的两种落地路径:

路径一:以现有成熟系统为主数据源。 适用于已有ERP且其数据质量较高的企业。ERP继续作为主数据的"官方来源",平台负责抓取变更事件,自动推送给WMS、MES、CRM等下游系统。这种方式不改动现有作业习惯,实施周期短,通常是1-2周即可上线核心数据流。

路径二:构建独立的主数据中心。 适用于各系统数据质量参差不齐、或企业不希望长期绑定某一特定业务系统的情况。平台内部建立统一的主数据模型(客户、物料、组织、员工等),通过清洗、去重、标准化后,向外分发。这种方式的中立性更强,便于未来替换或新增业务系统而不影响数据层。

两种模式可并存。企业甚至可以先用路径一快速见效,后续过渡到路径二------这正是平台灵活适配能力的体现。

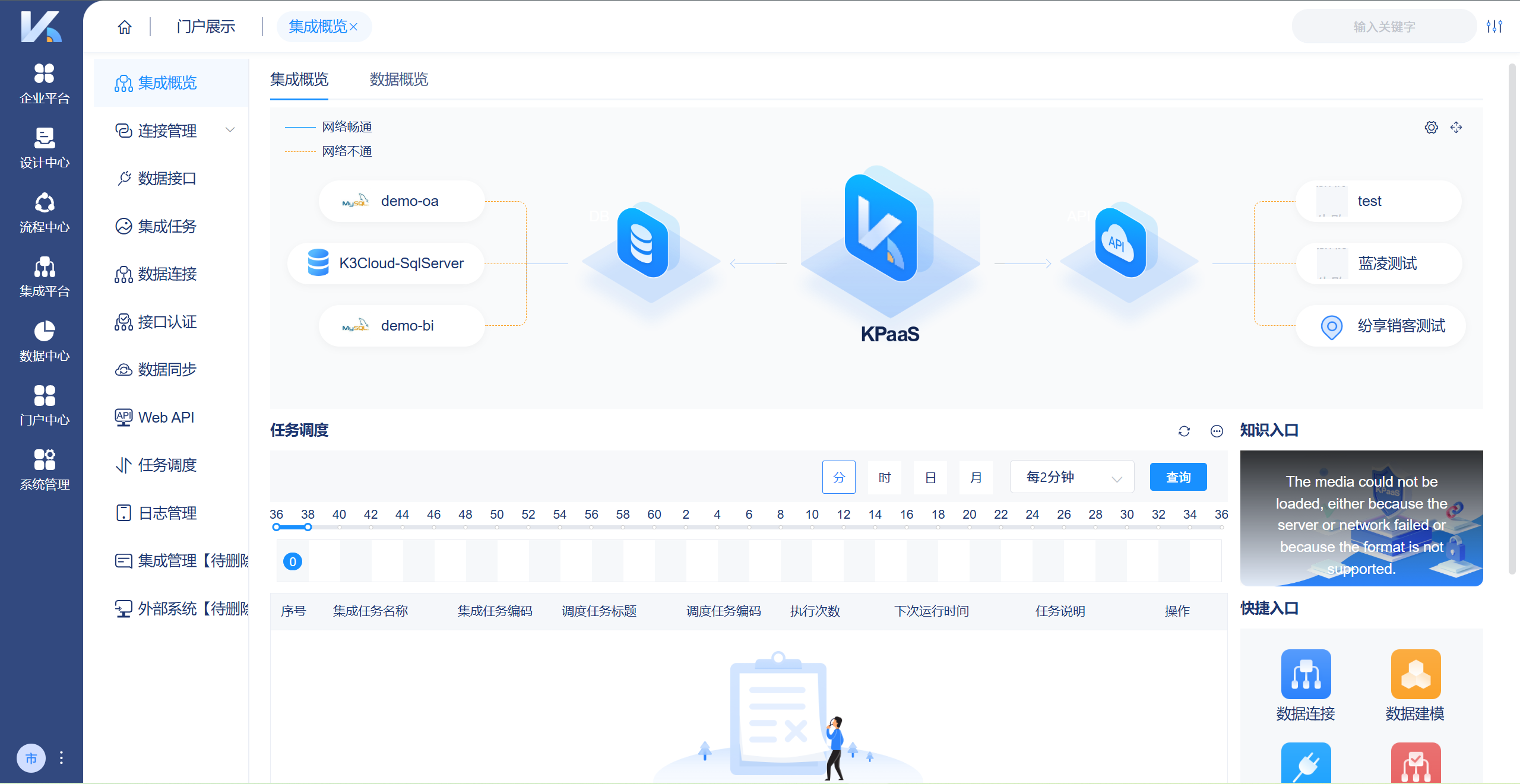

KPaaS平台提供强大的数据集成能力,支持数据接口、连接、认证及同步,通过集成任务、Web API和智能调度实现高效数据流转,并配备完善日志管理,助力企业降本增效。

KPaaS平台提供强大的数据集成能力,支持数据接口、连接、认证及同步,通过集成任务、Web API和智能调度实现高效数据流转,并配备完善日志管理,助力企业降本增效。

四、自动化同步机制:从"人找数据"到"数据找人"

数据不一致的核心症结在于延迟。A系统更新了客户地址,B系统三天后才知道。这三天内发出的所有报价、合同、发货单,都可能基于错误地址。

解决延迟需要从"定时批量"转向"事件驱动"。

事件驱动的逻辑是:当主数据在源系统中发生任何变更(新增、修改、删除),系统立即捕获该事件,秒级触发同步流程。下游系统收到的不是"一份Excel文件",而是一个明确的结构化消息:"客户ID为C12345的'收货地址'字段已从A变更为B,变更时间为2025-12-15 14:23:07。"

基于这种机制的KPaaS平台带来的改变是根本性的:

- 业务侧:销售人员不再需要问"系统里的客户地址是不是最新的",因为所有系统都实时保持一致。

- IT侧:不再需要编写复杂的定时任务脚本,不再需要处理"同步到一半网络中断"导致的半拉子数据。

- 管理层:第一次可以指着任何一个系统的数据说:这就是当前的真实状态。

对于不需要实时性的场景(如历史数据批量修复、非交易类主数据的夜间校准),定时同步模式仍然保留。两种模式按需组合,既不牺牲关键业务的时效性,也不浪费计算资源去同步无关紧要的字段。

KPaaS平台集成任务调度实时掌握任务详情

KPaaS平台集成任务调度实时掌握任务详情

五、数据质量治理:从被动救火到主动防御

同步机制解决的是"传播效率"问题。但如果源头数据本身就是错的、重复的、残缺的,再快的同步也只是把错误加速放大。

因此,数据管控必须包含质量治理环节。关键在于建立前置校验 + 事后清洗的双重机制。

前置校验发生在数据进入枢纽时。系统根据预定义的模型规则(字段类型、长度、必填性、编码格式、值域范围)自动拦截不合格数据。例如:物料编码必须符合"字母+8位数字"格式,否则拒绝接收并返回明确错误提示。这倒逼业务系统在源头就规范录入。

事后清洗用于处理存量历史数据。自动识别并合并重复记录------判断标准不是简单的"名称完全一致",而是基于相似度算法(如编辑距离、余弦相似度)识别"几乎相同"的记录,辅助人工确认后合并。同时修正明显错误的字段,如"创建日期"早于"成立日期"这类逻辑矛盾。

一个容易被忽视但至关重要的功能是数据血缘。当BI报表中某个"库存周转率"指标出现异常时,分析师需要回答:这个数字是怎么来的?血缘分工具提供了可视化追溯链路:从报表引用的视图,追溯到数据仓库中的表,再追溯到源头WMS系统的具体字段,甚至能看到该字段上一次同步的时间和操作人。排查问题的效率从数小时压缩到数分钟。

操作日志审计则是为合规而生。每一次主数据的创建、修改、删除、分发,都留下不可篡改的记录。对于金融、医疗等强监管行业,这是满足审计要求的刚性功能。

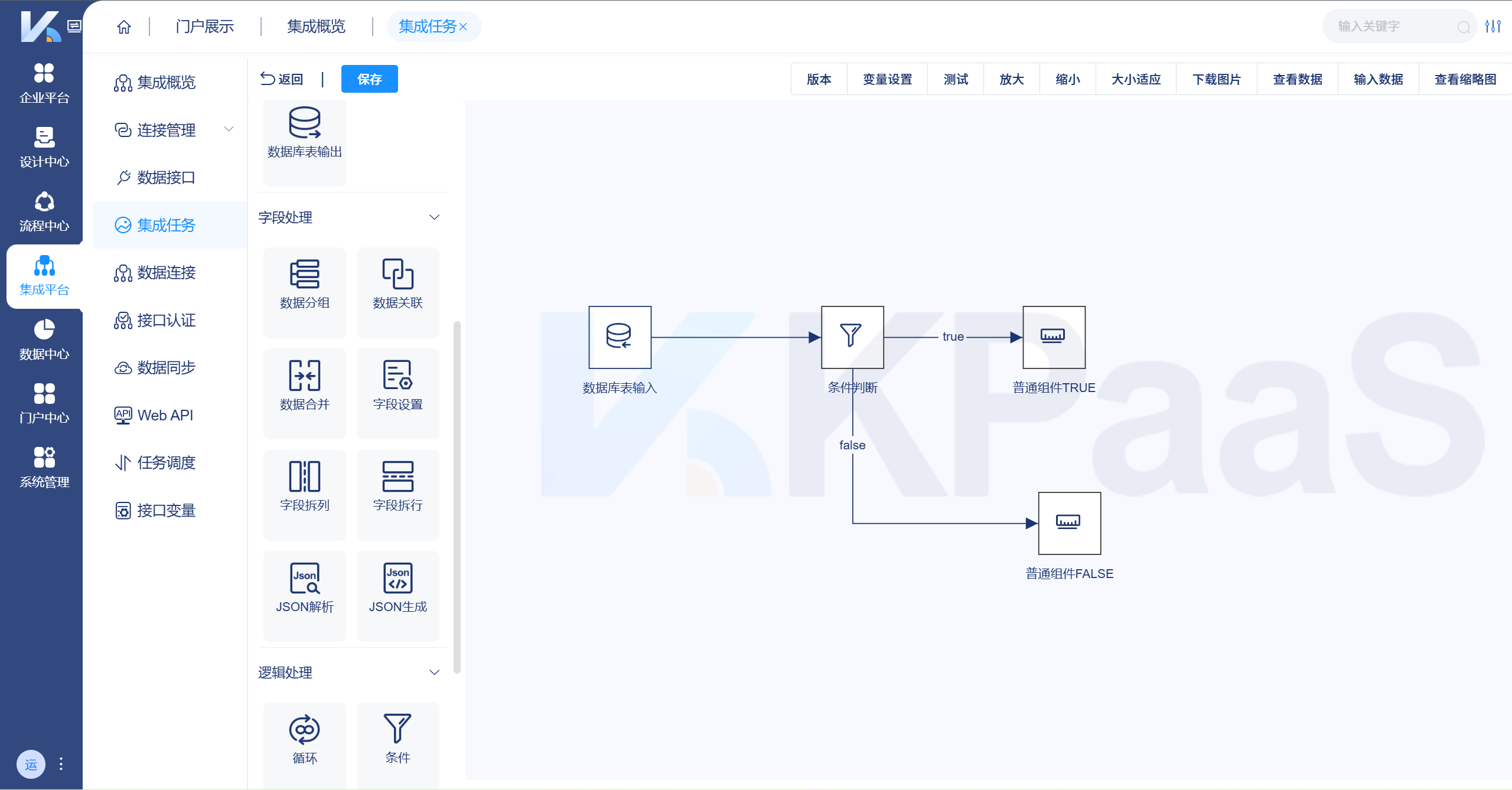

KPaaS平台提供灵活的拖放操作界面,使得企业能够轻松在编辑器中构建集成任务,配置各种节点间的交互,如数据分组、数据合并、数据关联等。

KPaaS平台提供灵活的拖放操作界面,使得企业能够轻松在编辑器中构建集成任务,配置各种节点间的交互,如数据分组、数据合并、数据关联等。

六、总结:数据管控的本质是建立信任

制造企业在多系统环境下的数据管控挑战,表面上是技术问题,实质上是管理问题------对数据的信任被持续侵蚀,而重建信任需要系统性的保障。

主数据管理平台解决方案提供的不是又一个"更强大的系统",而是一套数据治理的基础设施:它承认企业系统异构的现实,不要求统一替换;它尊重现有作业流程,只优化数据流动路径;它提供灵活的治理深度选项,让企业按需选择而非一步到位。

当企业能够做到"任何时刻、任何一个系统中看到的主数据都是真实、准确、一致的",数据就从"麻烦的来源"变成了"决策的底气"。这恰恰是多系统环境下数据管控的终极目标。