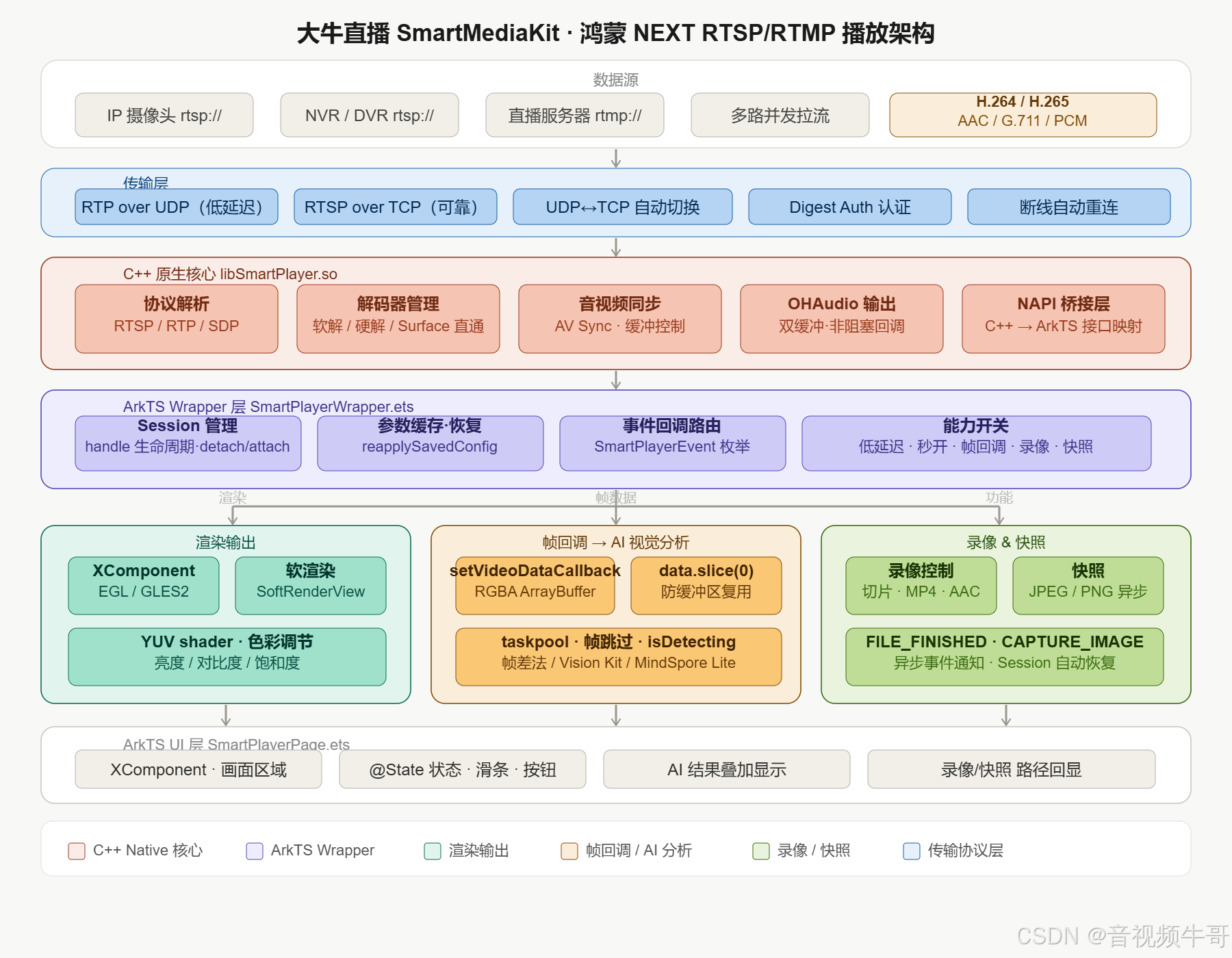

从协议本质出发,理解为什么鸿蒙 NEXT 上的 RTSP 低延迟播放比想象中难,以及大牛直播 SDK(SmartMediaKit)给出的工程答案。

一、先从 RTSP 协议说起

RTSP(Real Time Streaming Protocol,实时流传输协议)是 1998 年由 RealNetworks 和 Netscape 联合提出、经 IETF 标准化的应用层协议(RFC 2326),专门为流媒体控制设计。很多人习惯把它跟 HTTP 对比,两者确实都是文本协议、都是请求-响应模型,但底层逻辑截然不同------HTTP 是"拉取文件",RTSP 是"控制播放"。

RTSP 本身不传输媒体数据,它只负责会话控制:建立连接、协商格式、发 PLAY、发 PAUSE、发 TEARDOWN。真正的音视频数据由 RTP(Real-time Transport Protocol)负责传输,RTCP 负责传输质量反馈。一次完整的 RTSP 播放涉及三层协议的协作:

bash

RTSP(控制层)------ 443/554 端口,TCP

RTP (数据层)------ 偶数端口,默认 UDP

RTCP (反馈层)------ RTP端口+1,UDPRTSP 在行业里的主要阵地是安防监控 。IP 摄像头、NVR、视频矩阵,绝大多数都以 RTSP 作为标准拉流协议,海康、大华、宇视的摄像头默认暴露的都是 rtsp://ip:554/stream1 这样的地址。除此之外,工业视觉、医疗影像传输、无人机图传、广电演播室监看,也大量使用 RTSP。

RTSP 的核心价值在于两点:一是实时性 ,RTP over UDP 的传输方式跳过了 TCP 的握手和重传,延迟天花板远低于 HLS/DASH 这类分片协议;二是标准化,几乎所有摄像头厂商都支持,是行业级互操作的最大公约数。

但 RTSP 的复杂性也远超同类协议。光是 UDP 和 TCP 的传输模式切换(RTSP over TCP,也叫 Interleaved 模式,把 RTP 数据通过 RTSP 的 TCP 连接塞进来)就能卡死很多初级实现;加上丢包重传、RTCP 反馈、多轨同步、H.264/H.265/AAC 不同 payload 格式的解析......一个稳定的 RTSP 客户端,工程复杂度不亚于一个完整的网络库。

二、鸿蒙 NEXT 上的现实困境

2024 年,华为正式推出鸿蒙 NEXT("纯血鸿蒙"),彻底移除了 AOSP 代码,不再兼容 Android 应用。这个决定对生态是一次重启,对工业和安防行业来说冲击尤为直接。

安防行业的终端设备------门禁显示屏、楼宇对讲机、工厂看板、巡检平板------很多正在加速向鸿蒙迁移。这些场景有一个共同特征:必须实时拉取 RTSP 流,延迟不能超过 1 秒,最好在 300ms 以内,还要能同时拉多路。

然而摆在开发者面前的现实是:

系统媒体框架的局限。鸿蒙 NEXT 的 AVPlayer 是面向点播设计的,底层依赖 OH_AVPlayer 的缓冲逻辑,对 RTSP 的支持处于"能播但延迟高、稳定性不足"的阶段。AVPlayer 在面对弱网时容易触发内部缓冲膨胀,延迟从 1 秒累积到 5 秒以上;对于 H.265 主码流、带 B 帧的编码、非标准 SDP 描述符的摄像头,兼容性也存在明显短板。更关键的是,AVPlayer 不提供裸帧回调------如果业务需要在播放的同时做 AI 识别,根本拿不到 RGBA 数据。

NDK 生态的早期阶段 。鸿蒙 NEXT 的 NDK 基于 musl libc,缺少 glibc 的部分扩展,pthread 的行为与 Android Bionic 有细微差异,动态链接器的搜索路径规则也不同。把一个成熟的 Android C++ 音视频库直接迁移到鸿蒙,往往需要解决十几个编译问题(size_t 头文件路径、JNI typedef 冲突、POSIX 线程兼容性......)才能跑起来,而且跑起来还不等于稳定。

ArkTS 与 Native 的边界。鸿蒙 NEXT 的主语言是 ArkTS,视频渲染依赖 XComponent 提供的 OHNativeWindow,音频输出依赖 OHAudio。这套体系和 Android 的 SurfaceView + AudioTrack 并不是一一对应,移植过程中 EGL 上下文管理、Surface 生命周期与 XComponent onLoad/onDestroy 的同步,都是新的工程挑战。一旦处理不当,Surface 重建时会出现黑屏闪烁、EGL 崩溃、音频噪声等问题。

这就是鸿蒙 NEXT 上 RTSP 低延迟播放的真实处境:需求非常迫切,原生系统能力暂时不够,自研门槛又极高。

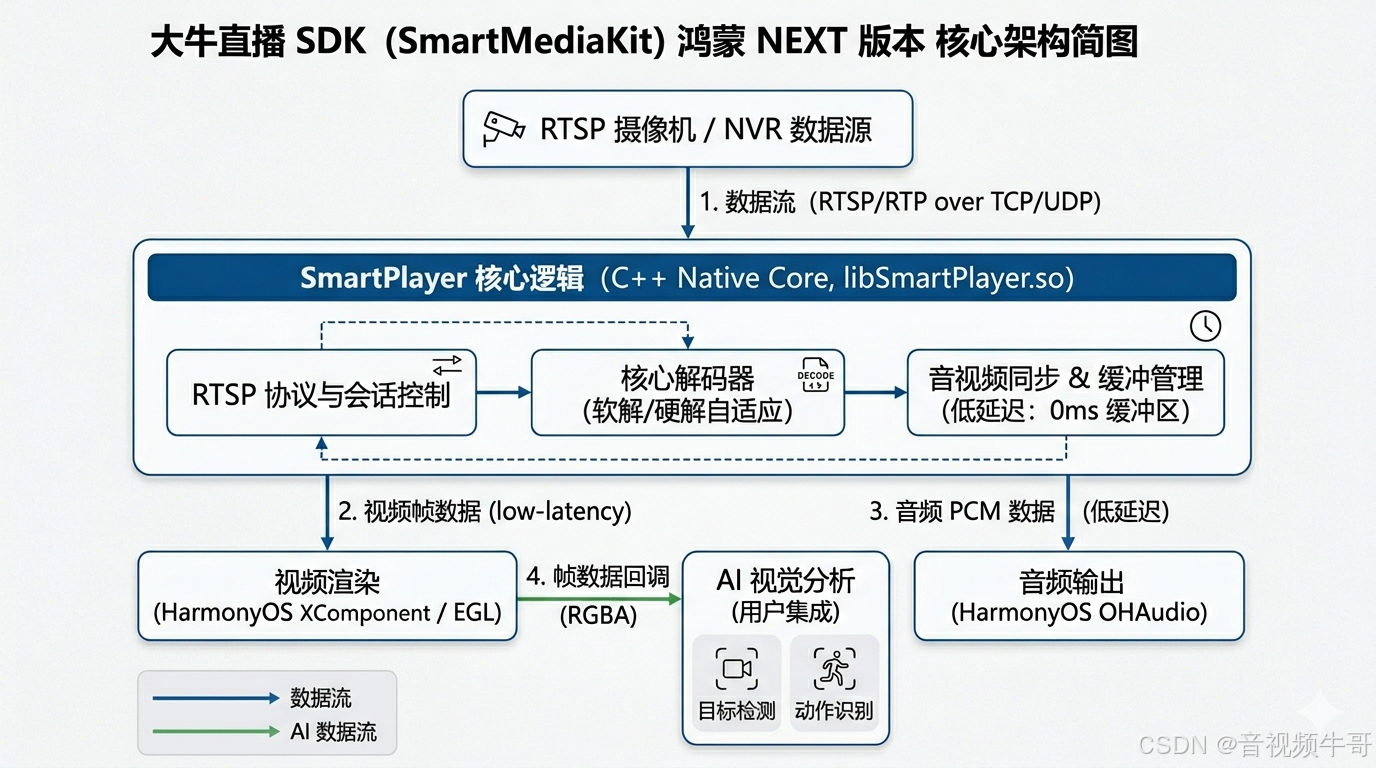

三、大牛直播 SDK(SmartMediaKit)的技术路径

大牛直播 SDK(SmartMediaKit)在 Android 端积累了多年的实时流媒体工程经验,鸿蒙 NEXT 版本(libSmartPlayer.so)是对这套内核的完整移植,而不是从零重写。这个选择本身就代表了一种工程判断:底层的协议解析、解码管线、音视频同步是高度成熟的,需要替换的只是与平台强耦合的渲染层和音频层。

3.1 低延迟的核心:缓冲策略与秒开

RTSP 延迟的主要来源不是网络传输,而是播放器的缓冲区。大多数播放器为了流畅性会预缓冲 1~3 秒再起播,弱网情况下缓冲区还会动态扩大------延迟就是这么一点一点累积的。

SmartPlayer 提供了细粒度的缓冲控制,可以直接把缓冲设为 0(超低延迟模式):

TypeScript

player.setBuffer(0); // 播放缓冲:0ms,极低延迟

player.setLowLatencyMode(true); // 开启低延迟模式

player.setFastStartup(true); // 秒开:收到第一个关键帧立即起播在局域网摄像头场景下,这套配置可以把端到端延迟控制在 100~200ms 之内。在公网场景下,可以根据实际网络条件适当调大缓冲(200~500ms),在延迟和流畅度之间取得平衡。

3.2 RTSP 传输层的细节处理

UDP 模式延迟低但丢包后无法重传;TCP 模式(Interleaved)可靠但引入了额外的封装开销。SmartPlayer 把这个选择权交给应用层,同时提供自动切换策略:

TypeScript

player.setRTSPTcpMode(false); // 默认 UDP(低延迟优先)

player.setRTSPAutoSwitchTcpUdp(true); // 网络差时自动切换到 TCP

player.setRTSPTimeout(10); // 连接超时 10 秒setRTSPAutoSwitchTcpUdp(true) 是一个很实用的参数------很多企业网络会拦截 UDP,纯 UDP 模式会连接失败,加了自动切换之后,SDK 在 UDP 失败时会自动重试 TCP,应用层完全无感知。

对于需要认证的摄像头(基于 Digest Authentication 或 Basic Authentication):

TypeScript

player.setRTSPAuthenticationInfo('admin', 'password123');3.3 解码模式的灵活选择

鸿蒙 NEXT 的硬解码通过 OH_AVCodec 接口访问,SmartPlayer 提供了三种解码模式,覆盖不同场景的需求:

TypeScript

// 软解码:兼容性最好,支持帧回调,适合 AI 分析场景

player.setVideoDecoderMode(0);

// 硬解码(普通模式):性能好,支持帧回调

player.setVideoDecoderMode(1);

// 硬解码 + Surface 直通:延迟最低,但无帧回调

player.setVideoDecoderMode(2);三种模式对应三种业务优先级的权衡:只求低延迟看画面,用 Surface 直通;需要 AI 分析,用软解或普通硬解;兼容老摄像头的非标准码流,优先软解。这个设计把选择权还给开发者,而不是做一个"一刀切"的黑盒。

3.4 渲染层:XComponent + EGL 的稳定实现

鸿蒙 NEXT 的视频渲染核心问题是 XComponent 的 Surface 生命周期管理。XComponent 在页面旋转、前后台切换时会触发 onDestroy + onLoad,Surface 重建,旧的 EGL context 失效。处理不好会直接黑屏。

SmartPlayer 的 Wrapper 层通过 Session 机制将 handle 与页面生命周期解耦:

TypeScript

// XComponent 重建时,不重启播放,只重新绑定 Surface

onLoad(() => {

const surfaceId = this.xComponentController.getXComponentSurfaceId();

this.player.setSurface(surfaceId); // 绑定新 Surface

this.player.reapplySavedConfig(); // 恢复所有参数

})

// 页面销毁时,detach 而不是 close

aboutToDisappear(): void {

if (this.player.isPlayingState()) {

this.player.detach(); // 保留 C++ 实例,只解除页面绑定

}

}detach() 和 close() 的区分是这套设计的精髓:页面重建是常态,播放会话不应该跟着页面一起销毁重建。Session 里的 handle 在页面重建后通过 getSingleRecoverableHandle() 自动找回,用户感知不到任何中断。

3.5 音频输出:OHAudio 的实时性保障

鸿蒙 NEXT 的音频输出基于 OHAudio,与 Android 的 AudioTrack 设计思路类似但接口不同。OHAudio 的 callback 模式要求在回调函数里实时填充 PCM 数据,任何 blocking 操作(锁、队列等待)都会导致 underrun,表现为音频爆音、噪声。

SmartPlayer 的 OHAudio 实现通过双缓冲 + 非阻塞队列解决这个问题:C++ 解码线程往音频队列里写,OHAudio 回调线程从队列里取,两者完全解耦,回调函数里只有一次非阻塞的 try_pop 操作,从根本上消除了 blocking 导致的噪声问题。

3.6 AI 视觉分析:帧回调的标准入口

SmartPlayer 通过 setVideoDataCallback 将每帧解码后的 RGBA 数据回调到 ArkTS:

TypeScript

player.setVideoDataCallback((width: number, height: number, data: ArrayBuffer) => {

// data:RGBA 格式,width × height × 4 字节

// 可在此接入帧差法运动检测、Vision Kit 人脸识别、MindSpore Lite 自定义模型

const frameCopy = data.slice(0); // 复制一份,防缓冲区复用

this.dispatchToAI(frameCopy, width, height);

});这个接口把"播放"和"分析"的关系理清了:播放器专注于低延迟解码渲染,AI 分析是插在帧回调上的独立管线,两者互不干扰。安防行业里最常见的"视频播放 + 实时 AI 告警"需求,就是在这个接口上搭建起来的。

纯血鸿蒙(HarmonyOS )RTSP直播播放器时延测试

四、一个典型的落地场景

以某工厂的设备巡检系统为例,场景要求如下:鸿蒙 NEXT 平板实时拉取 4 路 RTSP 摄像头画面(1080p,25fps,H.264),同时对其中 1 路做实时异常检测,要求端到端延迟不超过 500ms,断网重连不超过 3 秒。

用 SmartPlayer 的配置方案:

TypeScript

// 1. 低延迟播放配置

player.open();

player.setUrl('rtsp://192.168.1.100:554/stream1');

player.setBuffer(100); // 100ms 缓冲,平衡延迟和稳定性

player.setLowLatencyMode(true);

player.setFastStartup(true);

player.setRTSPAutoSwitchTcpUdp(true);

player.setRTSPTimeout(5);

// 2. 解码模式:开启帧回调则用硬解普通模式

player.setVideoDecoderMode(1);

// 3. Surface 绑定

player.setSurface(surfaceId);

// 4. 帧回调接入 AI 分析(降频到 5fps)

let frameCount = 0;

let isDetecting = false;

player.setVideoDataCallback((w, h, data) => {

frameCount++;

if (frameCount % 5 !== 0 || isDetecting) return;

isDetecting = true;

const copy = data.slice(0);

taskpool.execute(runAnomalyDetection, copy, w, h)

.then(result => {

setTimeout(() => { this.alarmText = result; }, 0);

})

.finally(() => { isDetecting = false; });

});

// 5. 启动播放

player.startPlayback();这个方案中,4 路播放各用一个独立的 player 实例(4 个 handle),AI 分析只绑在其中一路,其他三路走 Surface 直通降低功耗。Session 机制保证 4 路播放的状态在页面旋转后全部自动恢复,不需要业务层写任何恢复逻辑。

五、几点更深的思考

RTSP 不会消失,但接入成本必须降低。 过去五年里,WebRTC 和 SRT 在低延迟直播领域攻城略地,但在安防监控这个存量市场里,RTSP 的统治地位短期内不会动摇。原因很简单:几亿台在役摄像头都说 RTSP,没有哪个甲方愿意为了换协议去翻新整个监控网络。鸿蒙生态要进入这个市场,RTSP 播放能力是基础门票。

平台的"能播"和业务的"够用"之间,距离远比想象中大。 系统框架给的 AVPlayer 能播 RTSP,就像浏览器内置的 <video> 标签能播视频一样------对 demo 足够,对生产环境不够。延迟、兼容性、帧回调、多路并发、断线重连......每一个点单独拿出来都是一个工程问题。SDK 的价值不是"又实现了一个播放器",而是把这些边界情况都打磨了一遍,让应用开发者只需要关心业务逻辑。

鸿蒙 NEXT 的纯血化既是挑战也是机会。 从 Android 重写的阵痛期,也是重新审视技术选型的窗口期。那些在 Android 上靠 WebView 凑合跑的 RTSP 播放器、靠系统 MediaPlayer 处理的监控 App,迁移到鸿蒙时不得不面对技术债。而以 Native C++ 内核为基础、正确处理鸿蒙平台接口的 SDK,这个时间节点反而形成了先发优势。

AI 和视频的融合是不可逆的趋势。 边播边分析已经从"高级功能"变成"基本需求"------不只是大型安防项目,普通的门店客流统计、工厂质检线、医院等候区管理,都在往这个方向走。播放器提供帧回调只是第一步,后续的预处理效率、多模型调度、算力分配,还有很长的路要走。大牛直播 SDK 把 RGBA 帧回调做成标准接口,是一个务实的起点。

六、小结

RTSP 协议本身并不复杂,但要在鸿蒙 NEXT 这个全新平台上实现低延迟、稳定、可扩展的 RTSP 播放,需要跨越协议理解、Native 移植、平台接口适配、音视频同步、AI 集成等多个层面的工程挑战。大牛直播 SDK(SmartMediaKit)的鸿蒙 NEXT 版本给出的答案是:用成熟的 C++ 内核保住协议兼容性和低延迟,用精心设计的 ArkTS Wrapper 层屏蔽平台细节,用标准化的帧回调接口打开 AI 扩展的大门。

对于正在鸿蒙 NEXT 上做安防、工业、智慧园区类应用的开发者来说,这是目前能找到的最完整的工程答案之一。

📎 CSDN官方博客:音视频牛哥-CSDN博客