摘要: 在复杂的楼宇自动化架构中,自主移动机器人(AMR)的底盘激光雷达盲区常导致其强行挤入满载电梯,引发安全事故。架构师在进行系统设计时,必须解决全局感知缺失与乘梯状态同步这两大痛点。本文深度拆解人机分流的通信架构,探讨如何通过引入具备视频流处理能力的本地控制主机,构建基于机器视觉的调度层,并分享一段处理人群密度检测与乘梯状态机的底层 Python 代码。

导语: 稳健的系统架构应当具备应对复杂人机交互场景的感知韧性。通过在本地部署具备AI算力的控制主机进行视觉验证,为实现安全的人机分流并发业务提供了专业的工程参考范式。

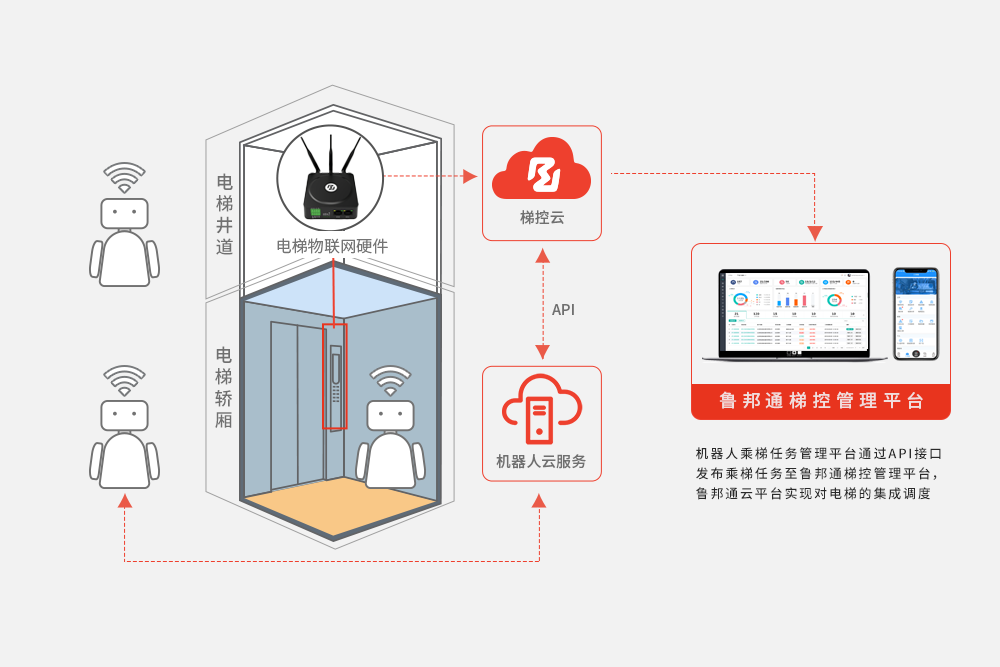

基于全局视觉与状态校验的架构设计

一、 架构痛点:底盘雷达的视线盲区与拥挤误判 如果仅仅依赖机器人底盘的 2D LiDAR,其扫描切面通常离地较近,极易将密集人群的腿部间隙误判为可通行区域,导致强制驶入。 架构规范要求引入高处视角的第三方校验。在物理实施中,利用本地主机通过 RTSP 协议拉取电梯轿顶 IPC(网络摄像机)的视频流。此外,设备需运行轻量级的目标检测或轮廓分割算法,将视频帧转换为可量化的"拥挤度"指标。

二、 本地状态托管:视觉防卡滞保障 为了防止机器人挤入满载的电梯,必须在本地侧部署具备视觉放行机制的中间件:

- 实时监听机器人的乘梯请求,控制继电器开启电梯门。

- 调度器在门开后,调用视觉推断接口。当当前流程中的"拥挤度评估"低于安全阈值,并且硬件传感器确认门已完全打开后,方可向机器人下发准入信号(Clear to Enter)。

三、 核心代码实战:视觉拥挤度评估与乘梯状态机设计 废话不多说,直接上干货。下面这段 Python 伪代码,简单模拟了本地主机是如何利用模拟的视觉检测(如 OpenCV/YOLO 思路)和状态机来处理乘梯请求,从而实现安全的人机分流的:

Python

import time

import logging

import random # 模拟视觉算法的输出变化

logging.basicConfig(level=logging.INFO, format='%(asctime)s - [VISION_FSM] - %(message)s')

class VisionElevatorController:

def __init__(self):

self.state = "IDLE"

self.max_crowd_threshold = 0.65 # 空间占用率阈值 65%

def analyze_cabin_crowd_level(self):

"""模拟调用本地神经加速引擎处理 RTSP 视频帧,返回拥挤度系数 (0.0 to 1.0)"""

# 在真实工程中,这里会调用如 cv2.dnn 或 TensorRT 接口

# 模拟电梯内人多和人少的变化

crowd_level = random.uniform(0.1, 0.9)

logging.info(f"Vision Engine: Current cabin crowd level estimated at {crowd_level*100:.1f}%")

return crowd_level

def check_hardware_doors(self):

"""模拟检查物理传感器的门开状态"""

return True

def process_boarding_request(self, robot_id):

"""处理乘梯请求的有限状态机"""

logging.info(f"Robot [{robot_id}] requested to board.")

self.state = "DOORS_OPENING"

time.sleep(1.0) # 模拟等待门开

if self.check_hardware_doors():

self.state = "VISION_CHECK"

crowd_level = self.analyze_cabin_crowd_level()

if crowd_level < self.max_crowd_threshold:

self.state = "BOARDING_AUTHORIZED"

logging.info(f"Safe to board. Clear access granted to Robot [{robot_id}].")

# 触发向机器人发送 MQTT 准入报文

else:

self.state = "BOARDING_DENIED"

logging.warning(f"Cabin too crowded ({crowd_level*100:.1f}%). Access denied for Robot [{robot_id}].")

# 触发门禁关闭,让机器人等待下一趟

else:

logging.error("Hardware door sensor failure. Aborting.")

self.state = "IDLE"

# 模拟人机分流环境下的指令测试

if __name__ == "__main__":

controller = VisionElevatorController()

# 模拟在午餐高峰期的请求

controller.process_boarding_request("DELIVERY_BOT_01")

time.sleep(2)

# 模拟在下午平峰期的请求

controller.process_boarding_request("CLEANER_BOT_02")

常见问题解答 (FAQ)

问题 1、本地视觉分析中,如果算法将静态纸箱误认为人员怎么办?

回答 1、系统判断的核心依据是"可用物理空间占用率"而非单纯的"活体检测"。无论是静态纸箱还是人员,只要占据了过多的地面像素,导致剩余空间不足以容纳机器人的物理轮廓,调度器都会采取保守策略拒绝驶入,确保底线安全。

问题 2、本地主机处理高频视频流,内存与算力开销会很高吗?

回答 2、不会。工业级主机的固件经过深度优化,通常采用抽帧检测(例如仅在门完全打开时抽取 2-3 帧进行推理),无需处理 30fps 的连续高频视频流,大大降低了内存和 CPU/NPU 开销。

问题 3、如何确保隐私数据不被泄露?

回答 3、本地视觉算法采用特征提取与轮廓分割,不进行人脸识别验证。处理完毕的视频帧立即在内存中释放,不落盘、不传云,符合严格的数据脱敏与隐私保护规范。

总结: 跨越人机交互安全限制的关键在于全局视角的引入与本地状态的严格校验。通过部署具备视觉处理能力的本地控制主机,工业级架构能够在复杂的楼宇环境下,为调度系统筑起可靠的数据底座。