根据《神经网络原理》的经典体系,我将这些概念按照四大部分进行组织,并阐述其内在逻辑与演进关系。

📚 一、导论:基础与框架

- 神经网络 :由简单处理元构成的大规模并行分布式处理器,天然具有存储经验知识和使之可用的特性。核心特征是通过学习过程改变自由参数(突触权值)来适应环境。

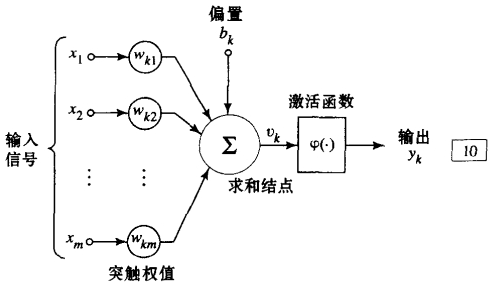

- 神经元 :神经网络的基本信息处理单元。数学模型包含突触(加权)、加法器(求和)、激活函数(非线性输出)和偏置,是构成所有复杂网络结构的"原子"。

- 神经网络学习过程 :神经网络的核心能力。通过调节自由参数(权值与偏置)以有序方式获得设计目标。根据学习范例,可分为有教师学习 (监督学习)和无教师学习(无监督学习)。

关系 :神经元是构建神经网络的基石,而学习过程则是神经网络展现智能的"灵魂"。这三个概念共同定义了神经网络的本质:一种通过学习从数据中自适应地建模的计算范式。

🎯 二、监督学习:有教师的预测与分类

此部分关注网络在有标签数据下,学习从输入到输出的映射。

- 单层感知器 :最简单的监督学习网络,无隐藏层。可学习线性可分模式,学习算法包括LMS算法和感知器收敛定理。

- 多层感知器 :引入隐藏层的前馈网络,能学习非线性映射。其训练由**反向传播算法(BP)**推动,是神经网络发展的里程碑。

- 径向基函数网络(RBF) :另一类分层前馈网络,使用径向基函数作为激活函数。设计强调正则化理论,在逼近问题上有独特优势。

- 支持向量机(SVM) :建立在统计学习理论(VC维、结构风险最小化)之上的学习机器,通过寻找最优超平面实现分类与回归,理论严谨,推广性强。

- 委员会机器 :由多个"学习者"(基网络)组合而成的集成模型。通过总体平均、推举、分层混合专家等方法构建,利用集成提升性能。

演进关系:

- 单层感知器 → 多层感知器:从线性到非线性,解决了XOR等经典问题,引入了隐藏表示。

- 多层感知器 vs RBF网络:不同的基函数选择(sigmoid vs 径向基)和训练哲学(全局 vs 局部)。

- SVM:从优化几何间隔出发,提供了与神经网络不同但更统计的视角。

- 委员会机器:从单一模型到模型集成,追求更鲁棒、更强大的集体智能。

🔍 三、无监督学习:无教师的模式发现与数据压缩

此部分关注网络在无标签数据下,自主发现数据内在结构。

- 主分量分析(PCA) :基于Hebb学习的经典无监督方法,用于降维和特征提取,提取输入数据的正交主分量。

- 自组织映射(SOM) :一种竞争学习形式,将高维输入映射到低维(通常1D或2D)离散网格上,保持拓扑有序性,用于聚类和可视化。

- 信息论模型 :从信息理论(熵、互信息、KL散度)出发设计无监督算法,核心是最大化输出与输入的互信息或减少冗余,与**独立分量分析(ICA)**紧密相关。

- 植根于统计力学的随机机器 :包括Boltzmann机、sigmoid信度网络 等。其学习和运行机制源于统计力学(能量函数、模拟退火、Gibbs抽样),是随机神经网络和概率图模型的基础。

- 神经动态规划 :即增强式学习 。与动态规划相关,通过试错与奖励/惩罚信号学习最优策略,用于序贯决策问题。

演进关系:

- PCA (二阶统计量)→ ICA(高阶统计量):从去相关到独立。

- SOM vs PCA:SOM保留拓扑结构,PCA保留最大方差。

- 信息论模型 为 ICA 和 PCA 提供了统一的信息优化框架。

- 统计力学模型 将神经网络与统计物理连接,为理解学习和推理提供了概率视角。

- 神经动态规划 将学习目标从映射扩展到序贯决策,引入了"策略"和"奖励"的概念。

⚙️ 四、神经网络动力学模型:时间、反馈与稳定性

此部分关注具有反馈连接的动态系统,处理时间序列和记忆。

- 使用前馈网络的时序处理 :通过为前馈网络添加短期记忆(如抽头延迟线,TDL)来处理时间序列。网络仍为前馈结构,但输入包含了历史信息(如时延神经网络TDNN)。

- 神经动力学 :研究反馈非线性动态系统 的核心性质,重点分析稳定性 (吸引子、平衡点)。Hopfield网络 是典型代表,用于联想记忆 和优化问题求解。Cohen-Grossberg定理是重要的稳定性判据。

- 动态驱动的递归网络 :一类由外部输入序列驱动 的递归网络(如RNN),用于建模序列到序列的映射 。其训练涉及通过时间的反向传播(BPTT)和实时递归学习(RTRL) ,核心挑战是消失梯度问题 ,解决方案涉及Kalman滤波器等高级优化方法。

演进与对比关系:

- 时序前馈网络 vs 递归网络:前者用外部结构(TDL)记忆,后者用内部反馈连接(状态)记忆,后者更具表达力但训练更难。

- 神经动力学 (如Hopfield)vs 动态驱动递归网络 :前者关注系统内部的稳态和记忆 (吸引子网络),后者关注对外部输入的动态响应(输入驱动系统)。

- BPTT vs RTRL:前者是离线的、展开计算,后者是在线的、实时计算,但计算复杂度极高。

- 消失梯度问题 是递归网络处理长程依赖的根本障碍,直接催生了LSTM、GRU等门控网络。