一.VMUI界面原理详细解析

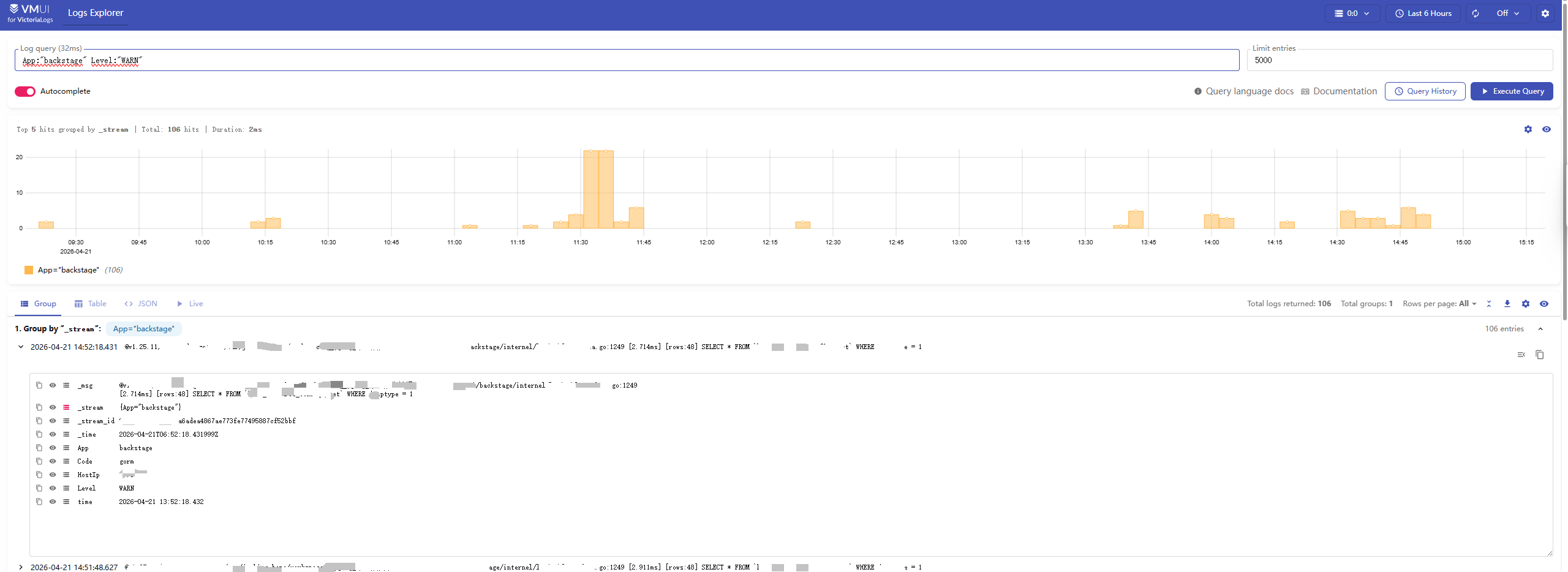

**VictoriaLogs(victoria-logs-single) 的内置用户界面(VMUI)如上图所示,**工作原理可以分为三层:

- 数据存储层(Storage)

- 原理 :VictoriaLogs 将日志数据存储在磁盘上, 与传统的 ElasticSearch 不同,它使用了高度压缩的列式存储格式

- 流(Stream)的概念:它不像传统数据库那样存"行",而是基于"日志流"(Stream),一个日志流由一组**唯一的标签(Labels)**定义,例如

{app="backstage", host="server1"}, 具有相同标签的日志属于同一个流- 查询处理层(LogSQL Engine)

- 原理 :当在搜索框输入命令时,VMUI 通过 HTTP API 将请求发送给 VictoriaLogs 后端

- 倒排索引:VictoriaLogs 维护了一个倒排索引,记录哪个关键词出现在哪个流或时间范围内 ,这使得它能极快地定位到包含

Level:"WARN"的数据块,而无需扫描所有日志- LogSQL:后端使用 LogSQL 引擎对数据进行过滤、解析和聚合

- 展示层(VMUI)

- 原理 :前端接收到 JSON 格式的数据后,绘制出直方图(图表部分)和具体的日志列表

- 直方图:图表中的每一根柱子代表该时间段内匹配的日志数量。

二.查询框命令详解与使用

VictoriaLogs 使用一种名为LogSQL的查询语言,它结合了 PromQL(Prometheus 查询语言 )的标签过滤和类 SQL 的管道操作

1. 基础过滤(标签过滤)

这是最核心的功能,用于从海量日志中筛选出特定的"流"

- 语法 :

{key="value"}或key="value" - 示例 :

app="backstage":查找标签app等于backstage的所有日志app="backstage" AND level="WARN":查找backstage应用中,级别为WARN的日志app="backstage" AND level!="INFO":排除INFO级别的日志{app="backstage", job="prod"}:同时满足多个标签条件

2. 全文搜索(日志内容过滤)

在筛选出流之后,搜索具体的日志内容

- 示例 :

app="backstage" "timeout":在backstage应用中搜索包含单词 "timeout" 的日志app="backstage" "error" OR "fail":搜索包含 "error" 或 "fail" 的日志

3. 管道操作(高级处理)

使用

|符号进行链式处理,类似 Linux 管道

|~ "regex":正则匹配日志内容

- 示例:

app="backstage" |~ "user_id=\d+"(查找包含 user_id=数字 的日志)。

| json:自动解析 JSON 格式的日志,提取字段作为临时标签

- 示例:

app="backstage" | json | duration > 100(解析 JSON,并筛选出duration字段大于 100 的日志)。

| stats by (...):聚合统计

- 示例:

* | stats by (level) count()(统计所有日志中,各个level的数量)时间范围过滤

_time:5m:查询最近 5 分钟的日志。_time:1h:查询最近 1 小时的日志。_time:2025-04-21T10:00:00Z:查询指定时间点之后的日志

三.多个微服务怎么搭建?(详细步骤与原因)

1.搭建原因

为什么要这样做?在单体应用中,日志在一个文件里,用

grep就能查。但在微服务架构下,会出现如下特性:

- 分散性:日志分散在几十台服务器、上百个容器里

- 瞬时性:容器可能随时重启,本地日志会丢失

- 关联性:一个请求经过 A -> B -> C 三个服务,如果 A 报错,需要同时看 B 和 C 的日志才能定位原因

当在微服务架构中,一个请求可能跨越多个服务(如网关 -> 订单服务 -> 用户服务),如果日志分散在各个服务器的文件中,排查问题将是一场噩梦, 故需要搭建集中式日志系统来解决上面微服务架构出现的各种特性问题

选择 VictoriaLogs (及整个 VictoriaMetrics 生态) 的原因:

- 高性能与低成本 :VictoriaLogs 是 VictoriaMetrics 团队开发的,以极高的压缩率和查询速度著称,相比 ELK(Elasticsearch, Logstash, Kibana)栈,它极其节省内存和磁盘空间(通常节省 10 倍以上的资源)。

- 类 PromQL 的查询语言:如果熟悉 Prometheus,VictoriaLogs 的查询语言

LogSQL非常容易上手,且与指标监控体系融合得很好。- 简单易运维 :相比 Elasticsearch 的复杂调优,VictoriaLogs 是一个单一二进制文件(或简单的集群模式),部署极其简单。

- 图片中的 VMUI :VictoriaLogs 自带一个轻量级 UI(即图片中展示的界面),无需额外部署 Grafana 即可查看日志,非常适合快速调试

2.搭建步骤(架构:VL Stack)

架构拓扑:

微服务-> 日志采集器(Promtail/FluentBit)->VictoriaLogs-> VMUI/Grafana

第一步:部署 VictoriaLogs (服务端)

最简单的方式是使用Docker 或 Docker Compose 部署单节点版

# docker-compose.yml

version: '3'

services:

victorialogs:

image: victoriametrics/victoria-logs:v1.5.0

command:

- "-retentionPeriod=1" # 保留1个月

ports:

- "9428:9428" # VMUI 和 API 端口

volumes:

- ./victoria-logs-data:/victoria-logs-data启动后,访问

http://localhost:9428即可看到截图中的界面

第二步:部署日志采集器 (客户端)

需要在每个运行微服务的节点上部署采集器, 这里以 Promtail 为例(因为它对 VictoriaLogs 支持最好,兼容 Loki 协议),Promtail 负责读取日志文件,并打上标签后发送给 VictoriaLogs,配置

promtail-config.yml:

server:

http_listen_port: 9080

clients:

- url: http://<你的VictoriaLogsIP>:9428/insert/loki/api/v1/push # 发送给 VL

positions:

filename: /tmp/positions.yaml

scrape_configs:

- job_name: system

static_configs:

- targets: [localhost]

labels:

job: varlogs

__path__: /var/log/*.log # 采集系统日志

- job_name: my-microservices

static_configs:

- targets: [localhost]

labels:

job: myapp

app: "backstage" # 关键:给日志打上标签,方便在 VMUI 中查询

__path__: /path/to/your/app/logs/*.log # 采集你的微服务日志

- job_name: k8s-pods

kubernetes_sd_configs:

- role: pod

relabel_configs:

# 从 Kubernetes Pod 的标签中提取 app 名称作为日志标签

- source_labels: [__meta_kubernetes_pod_label_app]

target_label: app

- source_labels: [__meta_kubernetes_namespace]

target_label: namespace

- source_labels: [__meta_kubernetes_pod_name]

target_label: pod_name

- action: labelmap

regex: __meta_kubernetes_pod_label_(.+)

- action: replace

source_labels: [__meta_kubernetes_pod_node_name]

target_label: node_name

- action: replace

source_labels: [__meta_kubernetes_pod_container_name]

target_label: container_name

- action: replace

source_labels: [__meta_kubernetes_pod_ip]

target_label: pod_ip第三步:微服务输出日志

确保微服务(Java/Go/Python等)将日志输出到标准输出(stdout)或挂载的文件中,且最好是 JSON 格式

原因:JSON 格式方便 Promtail 解析,能在 VMUI 中自动提取字段(如trace_id, level, time)

四.微服务问题排查与链路追踪

当某个微服务(例如

OrderService)发生问题时,单纯看日志是不够的,需要结合 Trace ID 进行链路追踪

场景模拟: 用户下单失败,涉及链路:Gateway -> OrderService -> PaymentService -> InventoryService

1.排查步骤

-

1.确定入口日志(入口点)

- 在 VMUI 查询框输入:

app="gateway" "500"或app="gateway" "error" - 找到那条失败的请求日志

- 在 VMUI 查询框输入:

-

2.提取 Trace ID(关键)

- 现代微服务框架(如 Spring Cloud Sleuth, OpenTelemetry, go-zero)会自动生成一个全局唯一的

trace_id - 在 VMUI 的日志详情中,找到

trace_id="abc-123-xyz"

- 现代微服务框架(如 Spring Cloud Sleuth, OpenTelemetry, go-zero)会自动生成一个全局唯一的

-

3.全局搜索(横向排查)

- 这是VictoriaLogs 最强大的地方,直接在查询框输入:

trace_id="abc-123-xyz" - 原理 :因为所有微服务(Gateway, Order, Payment...)的日志都被采集到了同一个 VictoriaLogs 中,并且都注入了相同的

trace_id标签或字段 - 结果:会看到该请求在所有服务中的所有日志,按时间顺序排列

- 这是VictoriaLogs 最强大的地方,直接在查询框输入:

-

4.定位瓶颈与根因

- 看时间:哪一步耗时最长?(例如 PaymentService 处理了 5秒)

- 看错误:哪一步抛出了异常?(例如 InventoryService 报了 "库存不足")

2.进阶排查:全链路日志关联追踪

要实现跨服务追踪,微服务代码必须引入分布式链路追踪(如 OpenTelemetry),但 在Go语言的微服务框架中,并不是所有的框架都会自动生成和传递trace_id, 一般都是通过专门的库来处理的, 一般都是通过中间件、插件的方式****集成OpenTelemetry(目前是云原生领域可观测性的标准) 来支持分布式追踪,OpenTelemetry提供了API、SDK和工具,可以自动生成和传递trace_id

步骤如下:

(1).在服务中集成OpenTelemetry SDK

(2).配置适当的导出器(exporter),将追踪数据发送到后端(如Jaeger、Zipkin等)

(3).框架中间件(例如HTTP中间件、gRPC拦截器)会自动为每个请求生成唯一的trace_id,并通过HTTP头或gRPC元数据在服务间传递

举例说明:在一个使用Gin框架的微服务中,可以按照以下步骤实现:

步骤1:导入OpenTelemetry的包步骤2:初始化OpenTelemetry的导出器和追踪提供者

步骤3:使用OpenTelemetry提供的Gin中间件

这样,每个请求都会自动生成一个trace_id,并且在调用下游服务时,会通过HTTP头(如traceparent)将追踪信息传递下去

那么如何为 Golang 微服务添加 trace_id呢?

3.如何为 Golang 微服务添加 trace_id

3.1 方案一:手动实现(简单但功能有限)

// 自定义中间件示例

func TraceMiddleware() gin.HandlerFunc {

return func(c *gin.Context) {

// 1. 尝试从请求头获取 trace_id

traceID := c.GetHeader("X-Trace-ID")

// 2. 如果没有,则生成新的 trace_id

if traceID == "" {

traceID = generateTraceID() // 例如: uuid.New().String()

}

// 3. 存储到上下文

c.Set("trace_id", traceID)

// 4. 设置到响应头(可选)

c.Header("X-Trace-ID", traceID)

// 5. 传递给后续中间件和处理器

c.Next()

}

}

// 日志中间件使用 trace_id

func LogMiddleware() gin.HandlerFunc {

return func(c *gin.Context) {

start := time.Now()

// 获取 trace_id

traceID, _ := c.Get("trace_id").(string)

c.Next()

// 记录带 trace_id 的访问日志

log.Printf("[%s] %s %s %d %s",

traceID,

c.Request.Method,

c.Request.URL.Path,

c.Writer.Status(),

time.Since(start),

)

}

}3.2 方案二:集成 OpenTelemetry(推荐的生产方案)

这是目前云原生领域的标准做法

# 架构对比

手动实现:

客户端 → [手动中间件: 生成trace_id] → 业务逻辑 → 手动传递到下游

OpenTelemetry:

客户端 → [OTel SDK自动插桩] → 业务逻辑 → [OTel传播器自动传递]具体步骤示例:

步骤1:安装依赖

go get go.opentelemetry.io/otel

go get go.opentelemetry.io/otel/trace

go get go.opentelemetry.io/contrib/instrumentation/github.com/gin-gonic/gin/otelgin步骤2:初始化 OpenTelemetry

package tracing

import (

"context"

"go.opentelemetry.io/otel"

"go.opentelemetry.io/otel/exporters/jaeger"

"go.opentelemetry.io/otel/sdk/resource"

sdktrace "go.opentelemetry.io/otel/sdk/trace"

semconv "go.opentelemetry.io/otel/semconv/v1.4.0"

)

func InitTracer(serviceName string) func() {

// 1. 创建Jaeger导出器

exp, _ := jaeger.New(jaeger.WithCollectorEndpoint(

jaeger.WithEndpoint("http://jaeger:14268/api/traces"),

))

// 2. 创建Trace Provider

tp := sdktrace.NewTracerProvider(

sdktrace.WithBatcher(exp),

sdktrace.WithResource(resource.NewWithAttributes(

semconv.SchemaURL,

semconv.ServiceNameKey.String(serviceName),

)),

)

// 3. 设置为全局Tracer Provider

otel.SetTracerProvider(tp)

return func() { tp.Shutdown(context.Background()) }

}步骤3:在Gin中使用

package main

import (

"github.com/gin-gonic/gin"

"go.opentelemetry.io/contrib/instrumentation/github.com/gin-gonic/gin/otelgin"

"go.opentelemetry.io/otel"

)

func main() {

// 1. 初始化OpenTelemetry

shutdown := tracing.InitTracer("order-service")

defer shutdown()

r := gin.Default()

// 2. 添加OpenTelemetry中间件(自动处理trace_id生成和传播)

r.Use(otelgin.Middleware("order-service"))

// 3. 在处理器中获取trace_id

r.GET("/order/:id", func(c *gin.Context) {

// 自动从上下文中获取span

span := trace.SpanFromContext(c.Request.Context())

// 获取trace_id

traceID := span.SpanContext().TraceID().String()

// 记录带trace_id的日志

log.Printf("Processing order. trace_id: %s", traceID)

// 调用下游服务时,trace_id会自动通过HTTP头传递

// 例如: traceparent: 00-<trace_id>-<span_id>-01

c.JSON(200, gin.H{

"order_id": c.Param("id"),

"trace_id": traceID,

})

})

r.Run(":8080")

}步骤4:在日志中集成trace_id

// 使用 zap 日志库 + OpenTelemetry 集成

import (

"go.uber.org/zap"

"go.opentelemetry.io/otel/trace"

)

func LoggerWithTraceID(ctx context.Context) *zap.Logger {

span := trace.SpanFromContext(ctx)

// 从span中提取trace_id

traceID := span.SpanContext().TraceID().String()

// 创建带trace_id字段的日志记录器

return logger.With(zap.String("trace_id", traceID))

}

// 在处理器中使用

func handler(c *gin.Context) {

// 获取带trace_id的日志记录器

log := LoggerWithTraceID(c.Request.Context())

// 所有日志都会自动包含trace_id

log.Info("Processing request")

log.Error("Something went wrong", zap.Error(err))

}3.3. 完整的工作流程示例

假设有3个服务:API Gateway → Order Service → User Service

// API Gateway (使用Gin)

func main() {

r := gin.Default()

r.Use(otelgin.Middleware("api-gateway"))

r.POST("/order", func(c *gin.Context) {

// 1. OpenTelemetry中间件已自动生成trace_id

// 2. 调用订单服务时,trace_id会自动通过HTTP头传递

req, _ := http.NewRequest("POST", "http://order-service/create", nil)

// 重要:必须使用c.Request.Context(),它包含了追踪上下文

req = req.WithContext(c.Request.Context())

// 发送请求(trace_id在traceparent头中自动传递)

resp, _ := http.DefaultClient.Do(req)

// ...

})

}

// Order Service

func main() {

r := gin.Default()

r.Use(otelgin.Middleware("order-service"))

r.POST("/create", func(c *gin.Context) {

// 这里会自动接收到从网关传递来的trace_id

// 调用用户服务

req, _ := http.NewRequest("GET", "http://user-service/info", nil)

req = req.WithContext(c.Request.Context()) // 传递上下文

http.DefaultClient.Do(req)

// 日志示例

span := trace.SpanFromContext(c.Request.Context())

log.Printf("[OrderService] trace_id=%s, processing order",

span.SpanContext().TraceID())

})

}3.4 日志聚合时的trace_id关联

在ELK/EFK中,日志收集器(如**Promtail/**Filebeat)会收集这些带trace_id的日志,然后:

// 网关日志

{

"timestamp": "2024-01-01T10:00:00Z",

"level": "INFO",

"service": "api-gateway",

"trace_id": "4bf92f3577b34da6a3ce929d0e0e4736",

"message": "Received request /order"

}

// 订单服务日志

{

"timestamp": "2024-01-01T10:00:01Z",

"level": "INFO",

"service": "order-service",

"trace_id": "4bf92f3577b34da6a3ce929d0e0e4736", // 相同的trace_id!

"message": "Creating new order"

}

// 用户服务日志

{

"timestamp": "2024-01-01T10:00:02Z",

"level": "INFO",

"service": "user-service",

"trace_id": "4bf92f3577b34da6a3ce929d0e0e4736", // 相同的trace_id!

"message": "Fetching user info"

}4. 推荐的工具栈

| 组件 | 推荐工具 | 说明 |

|---|---|---|

| 追踪SDK | OpenTelemetry | CNCF标准,未来趋势 |

| 日志库 | zap/slog + OTel集成 | 结构化日志,自动注入trace_id |

| 追踪后端 | Jaeger/Tempo | 存储和查询追踪数据 |

| 日志收集 | **Promtail/**Fluent Bit | 轻量级日志收集器 |

| 日志存储 | Loki | 专为日志设计,成本低 |

| 可视化 | VMUI/Grafana | 同时查看日志和追踪数据 |

总结:

要实现图中的效果,核心在于:统一采集(Promtail) + 统一标签(app="...") + 统一存储(VictoriaLogs),排查问题时**,

trace_id是连接各个微服务日志的唯一钥匙**

Golang框架不自动生成trace_id,但通过中间件很容易添加

生产环境强烈推荐使用OpenTelemetry,它是行业标准

关键步骤:

初始化OpenTelemetry TracerProvider

添加OTel中间件(如otelgin.Middleware)

在日志中注入trace_id

通过Context传递请求上下文

优势 :一次集成,全链路自动追踪+日志关联,无需手动管理trace_id的传递

制作不易, 请Star!!!