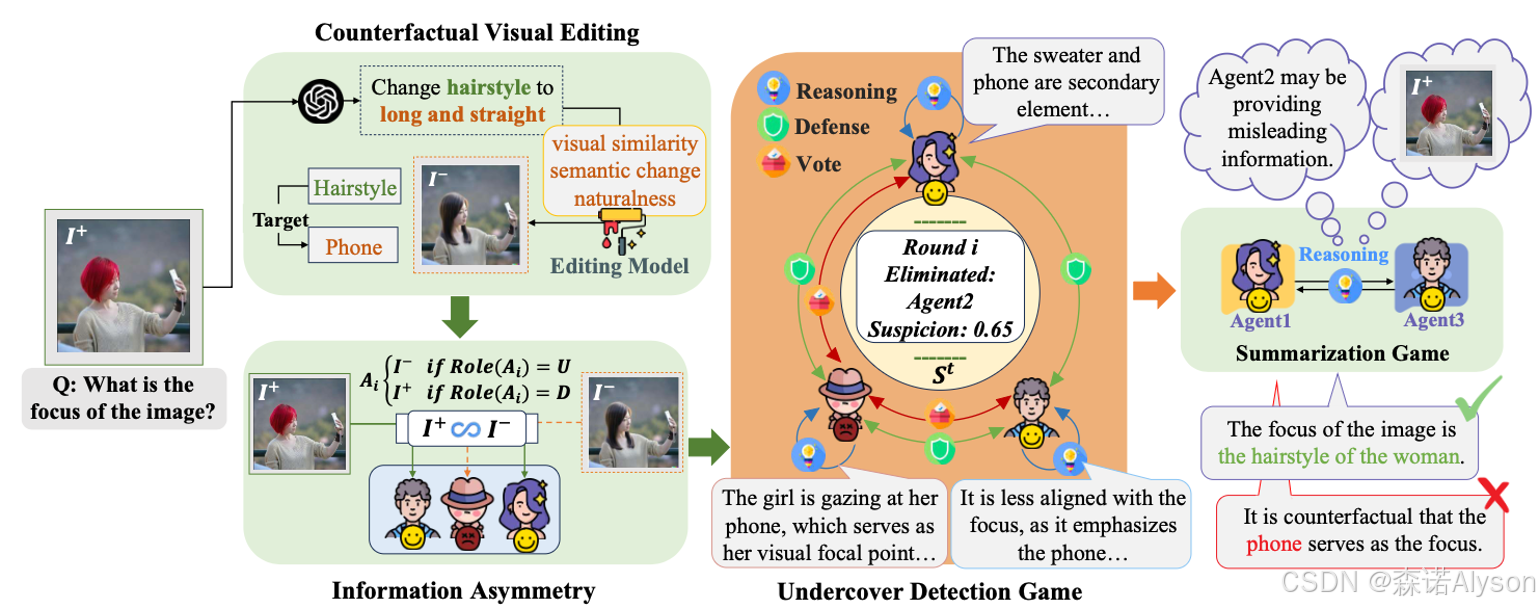

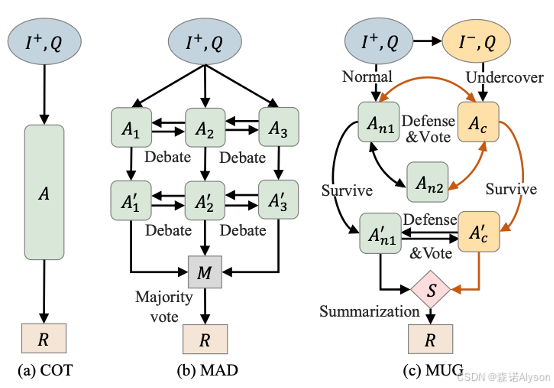

Multi-Agent Undercover Gaming: Hallucination Removal Through Counterfactual Test for Multimodal Reasoning (AAAI 2026) (A会)

核心内容:

这篇论文提出多智能体卧底游戏(MUG),用反事实视觉测试解决多模态大模型的幻觉问题,比传统多智能体辩论(MAD)更可靠、更能揪出幻觉智能体。

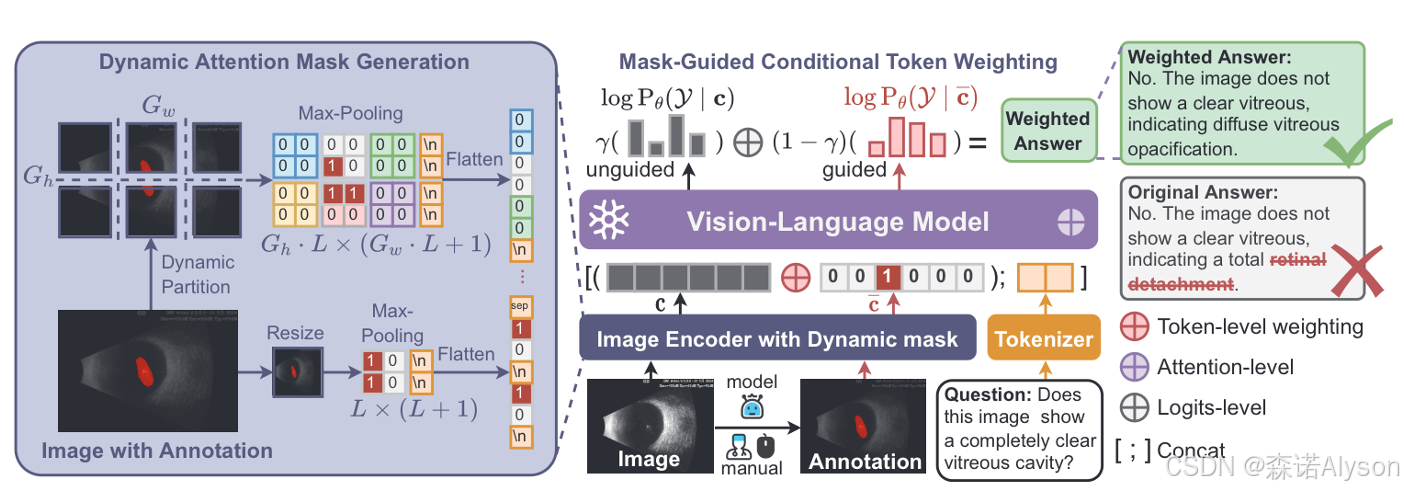

Anatomical Region-Guided Contrastive Decoding: A Plug-and-Play Strategy for Mitigating Hallucinations in Medical VLMs (AAAI 2026) (A会)

核心内容:

提出ARCD(解剖区域引导的对比解码),用无需训练、即插即用的方式,解决医学视觉语言模型(MedVLMs)的幻觉问题,让回答严格锚定影像关键区域,不瞎编。

(挑战)医学多模态模型容易幻觉:

依赖文本先验,不看图像证据

现有方案要么需要昂贵专家标注(训练式),要么全局修正不可靠(无训练)

(方法)用解剖分割掩码,在推理阶段做三级对比引导,强制模型只看关键区域:

- 动态注意力掩码生成

输入:医学影像 + 解剖分割掩码(医生 / MedSAM 标注)

转成和图像 token 对齐的全局 + 局部掩码,告诉模型哪块是诊断关键区 - 掩码引导的三级条件加权在生成的三个层级做对比加权

Token 级:抑制非关键区的 token 嵌入

Attention 级:放大关键区的注意力权重

Logits 级:融合 "引导分支" 与 "普通分支" 的概率

优点:

完全无训练,即插即用;兼容任意 MedVLM 与分割模型;精准、可解释、临床可信

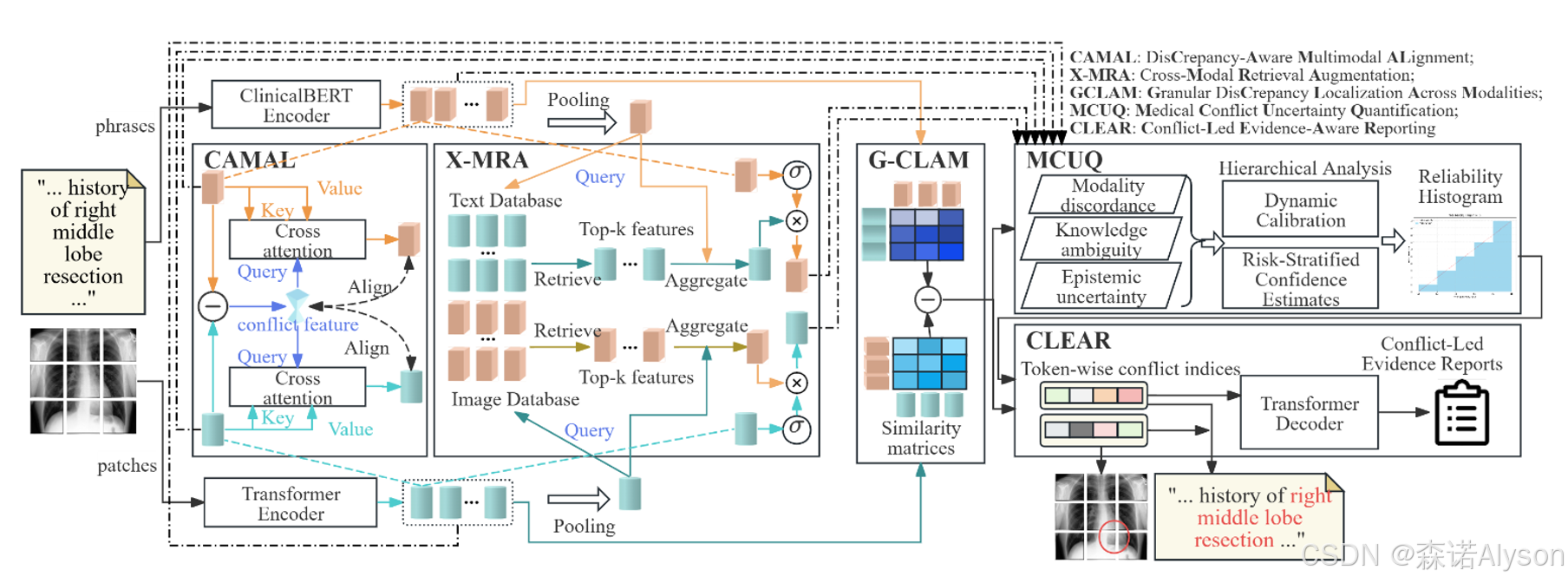

FAMDR: Feature-Aligned Multimodal Denoising for Reliable Diagnostic Reconciliation in Medical Imaging (AAAI 2026) (A会)

核心内容:

提出了FAMDR:一个面向医学影像的特征对齐多模态去噪框架,核心是解决影像发现与临床病史不一致的问题,让 AI 诊断更可靠、可解释、带置信度。

(挑战)现有医学影像报告生成 AI 有两大缺陷:

只追求描述通顺,忽略影像与病历的事实矛盾(比如影像有阴影,病历写 "无异常")。

把跨模态不一致直接当噪声丢掉,错过真正有临床意义的信号,容易误诊。

创新:

FAMDR = 多模态对齐 + 外部知识检索 + 细粒度矛盾定位 + 不确定性量化 + 可信报告生成

输入:医学影像 + 电子病历(EHR)

输出:去噪后的诊断、矛盾位置、置信分数

- CAMAL:差异感知多模态对齐:区分 "真矛盾" 和 "正常差异"。

- X-MRA:跨模态检索增强:从外部医学库检索相似病例 / 知识,解决罕见病、模糊病例。

- G-CLAM:细粒度矛盾定位:在像素级(影像)+ 短语级(文本)定位矛盾。

- MCUQ:医学矛盾不确定性量化:模态不一致、知识检索模糊、模型本身认知不确定

- CLEAR:矛盾引导的报告生成:解码时重点关注矛盾区域,生成带证据、可解释的报告。