1. 现状

在GPT-Image-2发布之前,AI图像生成领域面临一系列突出问题:

- 画质差、排版死板:上一代模型GPT-Image-1.5画质不佳,面对复杂文本时经常崩溃reference:0。

- "抽盲盒式"生成:传统文生图模型本质上是随机拼凑像素,用户扔几个提示词进去,等着模型输出大致符合预期的结果reference:1。

- 缺乏策略理解能力:即便是一些带有联网搜索功能的竞品(如Nano-banana),也只是机械地粘贴搜来的内容,无法理解抽象的商业诉求和文化语境reference:2。

- 角色一致性难题:让AI画一张漂亮的图不难,但让它画多张同一角色且动作、视角连贯的图像,长期以来是业界公认的难题reference:3。

- 多语言文字渲染失败:传统模型生成的图中只要带文字就容易变成"鬼画符",因为模型理解的文字是语义块(Token),而生成的图像是像素点,两者长期割裂reference:4。

- 非标准画幅崩坏:传统扩散模型极其害怕非标准比例,稍微把图拉长,画面里就会长出两个头reference:5。

简言之,该模型主要解决的是:从"能画图"到"懂策略",从"单张随机生成"到"具备规划能力的视觉智能体"这一跃迁问题。

2. GPT-Image-2带来的突破

GPT-Image-2的解决方案核心在于引入两种差异化模式,让图像生成从单纯的像素渲染升级为具备逻辑推理能力的智能体行为:

- 即时模式(Instant Mode) :面向所有用户开放,主打极速响应,能在几秒钟内生成结构完整的图像,主要解决高频、单次的视觉转化需求reference:6。

- 思考模式(Thinking Mode) :面向付费用户开放,在真正开始渲染任何一个像素之前,模型会先进入一段长达十几秒的逻辑推理与联网搜索阶段,让模型第一次真正知道自己该画什么reference:7。

GPT-Image-2更像是一个内置了视觉引擎的智能体,而非传统意义上的文生图模型reference:8。其思考模式能够自主完成调研、策划、文案提取、版式设计的一条龙工作reference:9。

3. 核心方法

-

核心方法:先推理后渲染。在思考模式下,模型收到用户指令后会先暂停画图,启动联网搜索工具,去Reddit、Threads或LinkedIn等平台爬取相关真实信息;然后开始规划海报的版式、留白和字体层级;最后生成真实的二维码并渲染出最终图像reference:10。

-

理解商业意图与文化语境。文章测试了"帮我画一个马斯克在抖音直播带货豆包的截图"这一指令。思考模式并未简单拼凑元素,而是自主调用了对中国互联网的理解,生成了一张像素级复刻的抖音直播间UI截屏,包括关注按钮、在线人数、商品卡、定价信息以及带有真实语境的网友弹幕reference:11。

-

极端微观控制。官方在发布会上展示了"米粒刻字"测试:研究员仅给了一句抽象的大白话指令------"一堆大米,在这堆大米的其中一颗单粒米上写着GPT Image 2"。模型在思考模式下自动调用了微距视角、计算了景深、在潜空间里找到了那颗米的物理坐标,并将文字精准地嵌在了米粒表面的微小弧度上reference:12。

-

底层架构推测。文章通过探针测试推测,即时模式大概率套用了o4-mini或GPT-5家族的轻量级版本(如GPT-5 nano);而思考模式的底座极大概率接入了不断在后台迭代的O系列推理模型(如o4或更新版的o3),先用O系列特有的长考机制在潜空间里把商业逻辑、受众心理、排版坐标全部算清楚,再由视觉模块进行最终的像素渲染reference:13。

-

团队构成揭示技术路径。文章指出,该模型的核心团队成员包括:CLIP核心作者Gabriel Goh(解决多语言排版对齐)、Luma AI前CTO Alex Yu(解决3D空间渲染,在脑海中先建三维场景再渲染2D切片)、MIT CSAIL毕业的Boyuan Chen和Kiwhan Song(解决世界模型与角色一致性),以及O系列推理模型的重要作者Nithanth Kudige等。正是这群人的组合,将底层的逻辑推理、3D空间渲染、图文极致对齐以及物理世界规律缝合在了同一个模型里reference:14。

4. 参考案例

| 实例场景 | 任务描述 | 所用模型 | 实验结果细节 |

|---|---|---|---|

| 海报生成 | 输入:帮我做一张海报,去网上搜一下大家对Duct Tape这个神秘模型的评价,并附上ChatGPT的二维码 | GPT-Image-2思考模式 | 模型暂停画图,联网爬取Reddit等平台的真实评价;规划版式;生成真实可用、可直接扫码跳转的二维码reference:15 |

| 马斯克抖音直播 | 输入:帮我画一个马斯克在抖音直播带货豆包的截图 | GPT-Image-2思考模式 | 生成像素级复刻的抖音直播间UI截屏:左上角关注按钮与小时榜、右上角1023.6万在线人数、底部商品卡(划线价99、特价69、倒计时立即抢购)、左下角真实网友弹幕("科技小白:豆包是什么?好用吗?""星辰大海:支持马斯克!支持国产AI!")reference:16 |

| 电商模特试衣 | 上传一张自拍,要求下个月去海岛度假,帮忙搭几套衣服并看上身效果 | GPT-Image-2 | 先给出8套完全不同风格的夏装图鉴,排版如专业Lookbook,每件单品旁有正确文字标注;精准解析面部特征和身材比例;随后输出侧面、半身等不同视角的换装图reference:17 |

| 漫画一致性生成 | 上传一张与朋友的合照,输入:把我们俩变成主角,画三张三页日式漫画,剧情你定 | GPT-Image-2 | 直接输出三页带标准分镜的黑白漫画;两个基于真人生成的漫画角色在三页不同分镜(近景特写、远景奔跑、背影)中,面孔特征、发型细节和衣服褶皱全部保持完美一致性;漫画情节连贯,对话框文字构成完整故事逻辑reference:18 |

| 多语言排版 | 生成法文时尚杂志封面、带满平假名和汉字的日文餐厅菜单、排版密度极高的俄语注释 | GPT-Image-2 | 一次成型,零拼写错误;模型根据语种匹配当地文化审美和字体设计(如日文传单使用地道日式复古美术字,平假名排版符合竖排阅读习惯)reference:19 |

| 极端画幅 | 要求生成3:1超宽图和1:3竖长图,加上"2015年一次性相机拍摄"的词条 | GPT-Image-2 | 不仅没有崩坏,甚至生成了首尾相连、逻辑闭环的360度全景图;老旧镜头的畸变和闪光灯打在墙上的劣质反光都还原得一清二楚reference:20 |

| 米粒刻字 | 输入:一堆大米。在这堆大米的其中一颗单粒米上写着GPT Image 2(调用实验性4K API) | GPT-Image-2思考模式 + 4K API | 画面放大数十倍后,能在米堆中找到那颗刻了字的微粒;米的质感符合物理定律,文字精准顺着米粒的微小弧度嵌在表面reference:21 |

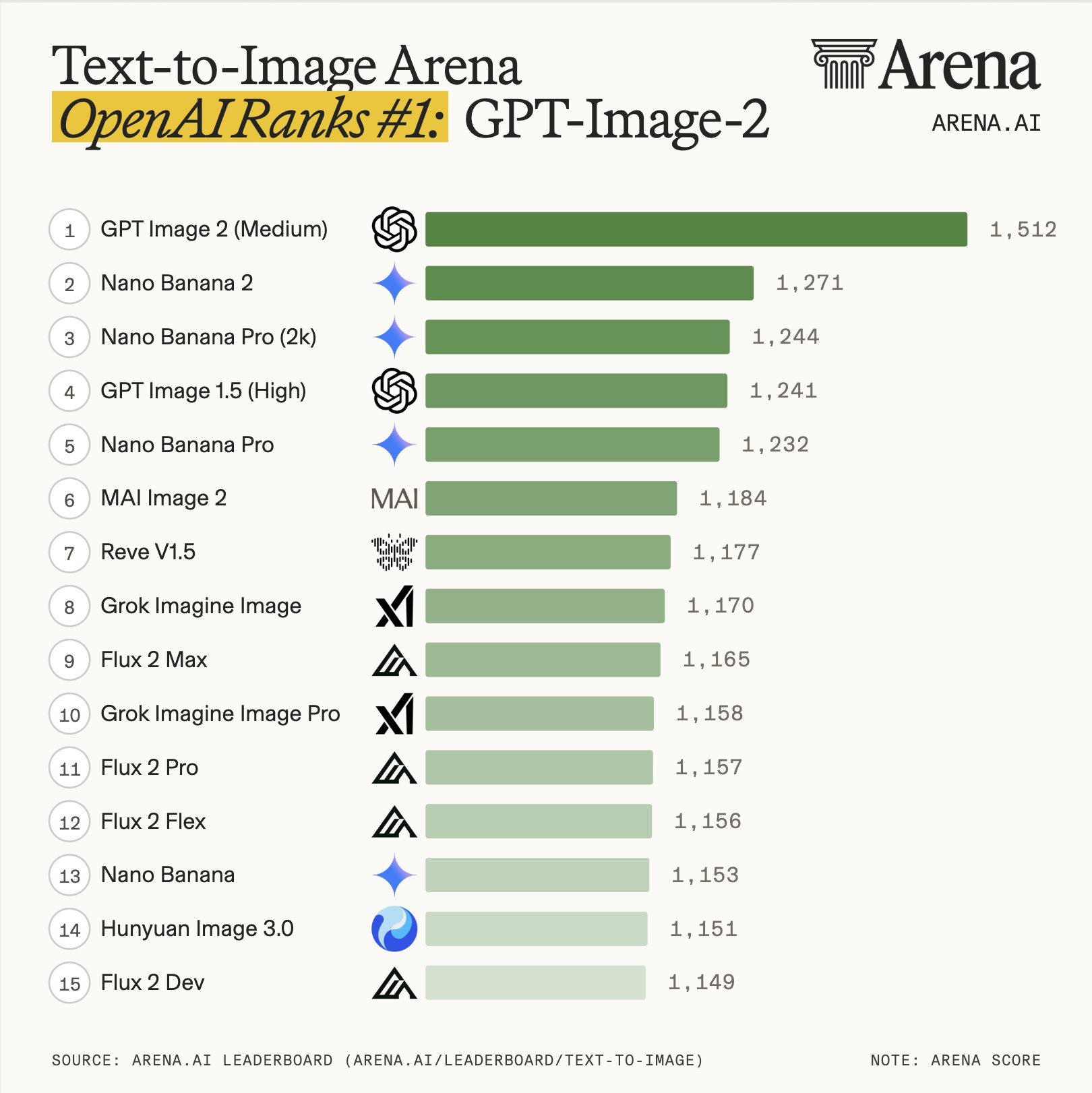

重要量化结果 :GPT-Image-2在Text-to-Image竞技场排行榜中以1512分 空降榜首,领先第二名(Nano-banana-2)整整242分reference:22。文章评论称"在大模型跑分的语境里,大家通常会对零点几或者个位数的超越大书特书......一个242分的领先落差,在竞技场的历史上是绝无仅有的"reference:23。

定价细节 :GPT-Image-2采用按Token计费框架,图像部分输出价格为每百万Token 30美元 ,对比上一代gpt-image-1.5的32美元反而更便宜reference:24。生成一张高质量图像约消耗1000-1500个输出Token,实际成本约0.03到0.045美元 (约合人民币2到3毛钱)。若使用Batch批处理API模式,价格直接腰斩至15美元,生成一张图最低仅1毛多钱reference:25。此外,缓存输入(Cached inputs)机制让连续生成多张图时,从第二张图开始输入成本从8美元暴跌至2美元(仅收25%的钱),边际成本直线下降reference:26。

5. 结论

-

代差级碾压:GPT-Image-2以1512分空降Text-to-Image竞技场榜首,领先第二名242分,这不是微小的版本迭代,而是"粗暴的代差碾压"reference:27。

-

从"画好看"到"懂策略":大模型在图像生成上的评价维度正式从"能不能画好看"跨越到了"懂不懂策略与排版逻辑"reference:28。

-

工业化计费逻辑:缓存输入机制让模型越聪明、画得越多,单张均摊成本反而越低,这种计费逻辑"才是真正能把流水线画师逼上绝路的东西"reference:29。

-

设计行业的分水岭:文章认为,在这个模型面前,"那些我们以为还需要两三年才会被AI彻底替代的视觉设计工作,今天基本可以说是走到头了"reference:30。

-

审美不会消亡:文章最后补充指出,"有品味、有商业洞察、懂策略的人,依然能用它做出极好的东西",并非简单贩卖焦虑reference:31。

6. 注意事项

- 官方坦承的极限场景 :在面对某些极端情况时模型仍会挣扎,具体包括:

- 需要严密物理空间翻转的折纸指南;

- 解魔方;

- 像极其密集的沙粒 这种重复性极高的细节reference:32。

测试中发现一个技术细节:即时模式的训练数据截止日期停留在2024年5月底,思考模式的原生知识库大约停留在2024年6月(但可通过实时联网获得最新信息)reference:34------这意味着模型的"原生知识"存在一定的时间滞后,需要依赖联网搜索来弥补。