从提示词工程到驾驭工程:AI协作的三代进化

一、开场

想象一下:两年前,你还在跟朋友炫耀"我发现了一个神奇的prompt,用这句话AI就会变聪明!";一年前,你开始研究怎么把自己的资料喂给AI,让它更懂你;而到了2026年,那些最懂AI的人,聊的都是"驾驭工程"(Harness Engineering)。

这个变化不是突然发生的。从Prompt Engineering到Context Engineering再到Harness Engineering,这不是谁替代了谁,而是一层一层的升维------就像人类从学会用火,到发明炉子控制火,再到用蒸汽机把火变成动力。

今天这篇文章,我想跟你聊聊这三代技术到底是什么,以及在2026年的今天,我们普通人到底该怎么跟AI协作。

二、三代技术详解

2.1 第一代:提示词工程(Prompt Engineering)

什么是提示词工程?

有个比喻说得好:"提示词是AI的'说明书',提示词工程就是写这本说明书的艺术。"

简单说,提示词工程就是研究怎么跟AI说话,才能让它给出你想要的答案。这不是随便写写就行,这里面结合了语言学、认知科学,甚至一点心理学。

为什么会出现?

还记得2022年底ChatGPT刚出来的时候吗?大家都疯了。有人发现,只要加上一句"Let's think step by step"(让我们一步步来想),AI的智商好像突然就提高了;还有人发现,给AI几个例子,它就能学会做复杂的任务。

2023年简直是提示词工程的黄金年:GPT-4发布了,思维链(Chain-of-Thought)提示火了,甚至"提示词工程师"都成了热门职业。大家突然意识到:原来同一个AI,你问法不一样,结果能差这么多!

你肯定用过这些技巧:

- 直接问:"帮我写个邮件"------这叫零样本学习

- 给几个例子:"比如A情况这么写,B情况那么写,现在帮我写C"------这叫少样本学习

- 让它一步步想:"先分析问题,再给出方案,最后总结"------这叫思维链推理

这个阶段大家都在怎么玩?

提示词工程的进化路线其实很有意思:

- 最开始大家只会直接提问(Zero-Shot)

- 然后发现给几个例子效果更好(Few-Shot)

- 接着学会让AI一步步思考(Chain-of-Thought)

- 后来甚至让AI探索多条思路(Tree-of-Thoughts)

- 再后来,工具出现了------自动帮你优化提示词(APE、OPRO)

- 到最后,有人把提示词工程做成了编程框架(DSPy)

2.2 第二代:上下文工程(Context Engineering)

什么是上下文工程?

2025年6月发生了一件有意思的事:Shopify的CEO Tobi Lütke发了条推特说:"我真的很喜欢'context engineering'这个词,胜过'prompt engineering'。"一周后,Andrej Karpathy(前特斯拉AI负责人)也发推说:"+1"。

什么意思呢?Karpathy解释说:"大家总觉得prompt就是给LLM的那几句简短任务描述。但在每一个工业级的LLM应用里,context engineering其实是填充上下文窗口的精妙艺术与科学。"

简单说:提示词工程问的是"我怎么措辞这个问题?";而上下文工程问的是"模型必须知道什么才能给出好答案?"

为什么突然从"怎么问"变成了"喂什么"?

因为大家发现,光靠一两句话的prompt不够了。你想让AI帮你做复杂的事,得把背景信息都给它:

- 之前的对话历史(但不是逐字记录,而是总结后的要点)

- 你希望它扮演的角色(比如"你是一个资深产品经理")

- 相关的参考资料(通过RAG检索出来的)

- 它调用工具返回的结果

到了2025年,大家都在说"这是AI agents之年"。但决定agent成败的最关键因素是什么?不是选哪个模型,而是你给它的"上下文质量"。

这个阶段的高手都在怎么做?

你看Cursor这个编辑器为什么这么火?Karpathy总结了它成功的四个层次:

- 做好context engineering(把你的代码库上下文喂给AI)

- 编排多个LLM调用(不是一次对话搞定,而是后台串成复杂的流程)

- 提供应用特定的GUI(让你能方便地在循环中干预)

- 提供"自主滑块"(让你选择让AI自主到什么程度)

2.3 第三代:驾驭工程(Harness Engineering)

什么是驾驭工程?

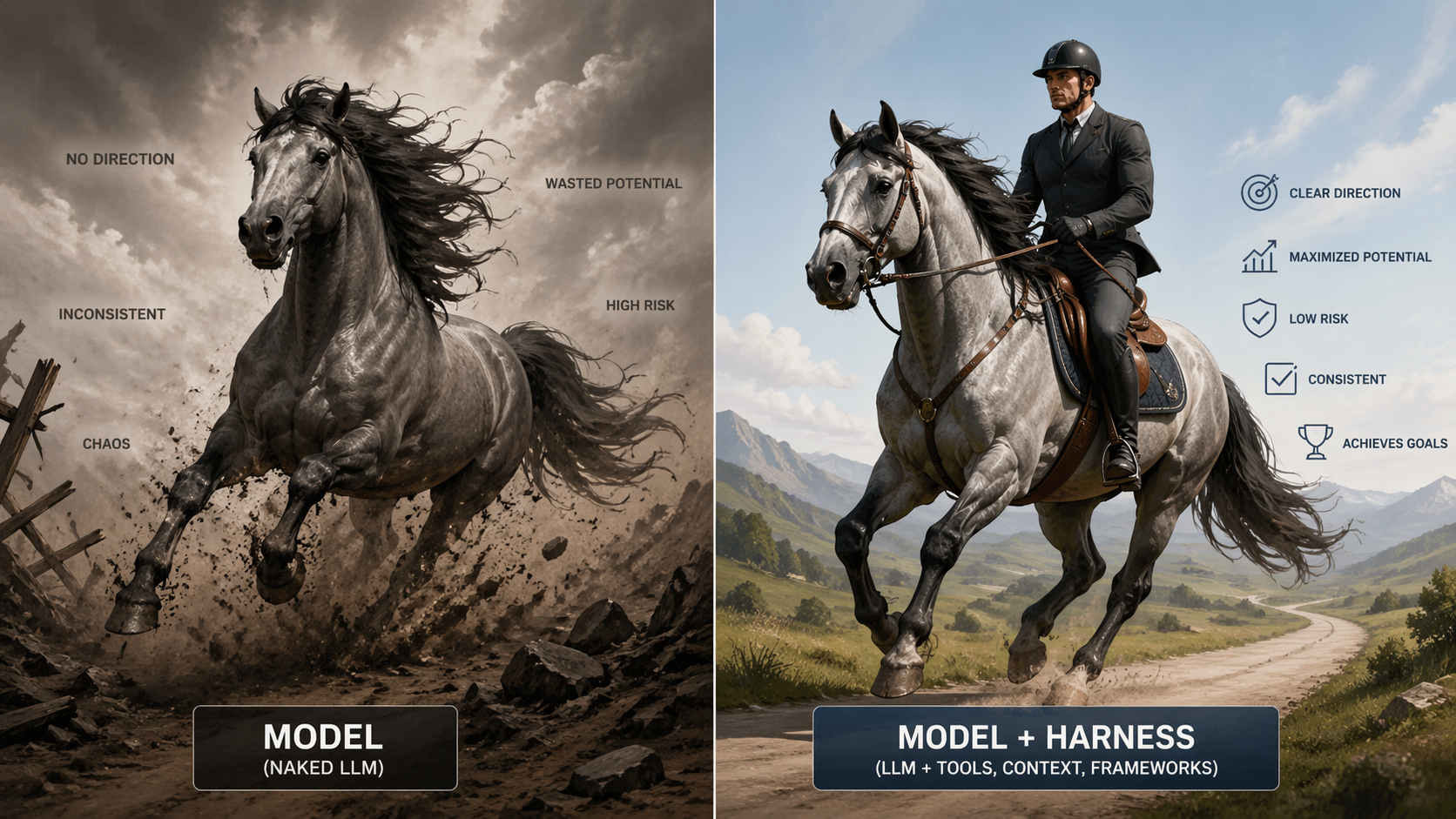

先记住这个公式:Agent = Model + Harness

什么意思?LangChain的博客说得很直白:"如果你不是模型,你就是harness。"Harness就是除了模型本身之外的每一段代码、每一个配置、每一条执行逻辑。

Martin Fowler(就是那个写《重构》的大牛)给了个更务实的定义:"Harness engineering把人类工程师的重点,从写代码,转移到设计环境、明确意图、提供结构化反馈。"

Harness这个词,英文原意是"马具"------缰绳、马鞍、笼头那一套东西。一匹千里马,你不给它套上马具,它只会四处乱跑。大语言模型就是这匹千里马。

为什么现在大家都在聊这个?

OpenAI在2026年2月11日发了篇官方博客,讲了一个疯狂的实验:三个工程师,五个月时间,用Codex从零构建了一个内部产品,大概写了100万行代码。重点是:人类没有手写一行代码。

那这三个人在干嘛?他们在做Harness Engineering:

- 设计架构边界(告诉AI哪部分是哪部分)

- 制定依赖规则(告诉AI什么能用什么不能用)

- 写自动化测试(让AI知道自己写得对不对)

- 配置lint规则(给AI定好代码规范)

- 搭建CI/CD流水线(让AI能自动交付)

- 设计反馈循环机制(让AI能从错误中学习)

"我们团队一直在做一个实验:用0行手写代码,构建和交付一个软件产品的内部测试版。"

数据不会骗人:

LangChain做了个实验,模型固定用gpt-5.2-codex,只改harness,结果编码agent在Terminal Bench 2.0测试上的分数从52.8%提升到66.5%------足足提高了13.7分!排名从Top 30直接升到Top 5。

"我们的编码agent从Top 30升到Top 5。我们只改了harness。"

还有更狠的:"模型是商品。Harness是护城河。"

为什么这么说?Manus这家公司,六个月内重写了五次harness。模型没变,架构变了五次,每次重写都提高了可靠性和任务完成率。LangChain更夸张,一年内四次重构Deep Research------不是因为模型进步了,而是因为他们发现了更好的方式来结构工作流、管理上下文、协调子任务。

你从Hugging Face下载不到好的harness。你必须自己构建、测试、失败、学习、重建。这才是护城河。

这个阶段的高手都在怎么"驾驭"AI?

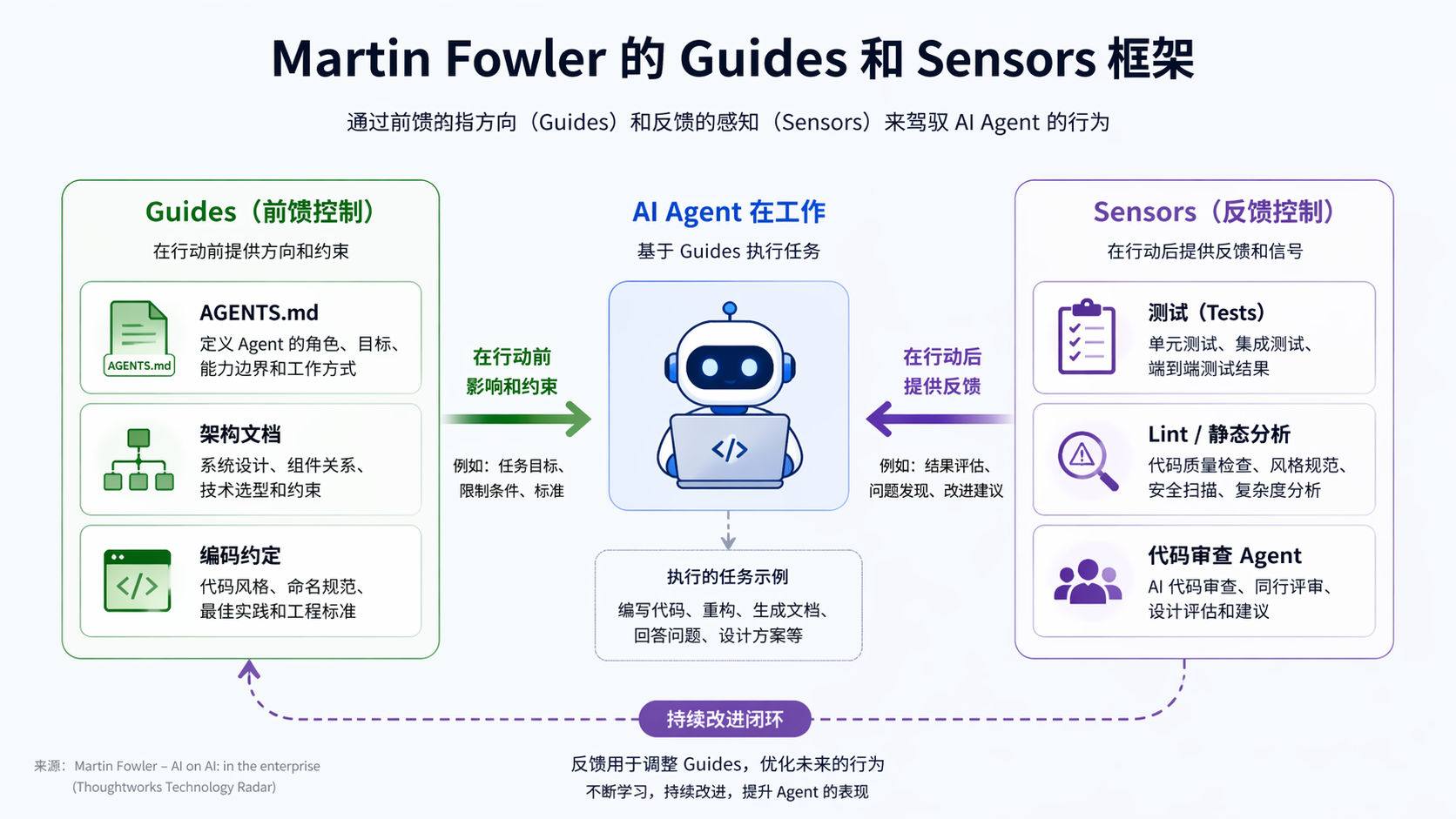

Martin Fowler的框架很清晰:Guides和Sensors

-

Guides(前馈控制):在AI行动前就引导它

- 比如写个AGENTS.md文件,告诉AI"你是谁、你要做什么、你要遵守什么规则"

- 比如写架构文档,告诉AI系统怎么设计

- 比如定好编码约定,让AI按你的风格来

-

Sensors(反馈控制):在AI行动后观察它,帮它自我纠正

- 比如写自动化测试,AI写完代码跑一遍测试就知道对不对

- 比如配置lint规则,AI写得不符合规范立刻提示

- 比如让另一个AI来检查第一个AI的工作

Anthropic的玩法更激进:三个agent互相配合

- Planner(规划者):先想清楚要做什么

- Generator(生成者):真的去写代码

- Evaluator(评估者):直接跟页面交互,打分,挑毛病

评估者的反馈又流回生成者,一次又一次迭代,每次生成跑5到15次。

李宏毅教授的比喻最形象:三根缰绳

- 第一根缰绳:控制"认知框架":给AI读CLAUDE.md、AGENTS.md这些文件------模型每次开始工作前,都会先"复习"这些规则

- 第二根缰绳:控制"能力边界":像权限系统一样,不把所有权限都给AI,只开放它需要的那部分

- 第三根缰绳:控制"行为流程":用Ralph Loop这种反馈循环模式------不让AI一次性盲猜最终答案,而是每次产出一个版本,外部评估给反馈,再基于反馈修正,迭代逼近

还有个更通俗的游戏玩家类比:

- Prompt Engineering时代:你对工人说"这里用胡桃木饰面,接缝处做45度斜拼"------每一块板材、每一颗钉子都得你亲自指挥,工人只会等你一句句指令

- Context Engineering时代:你准备好全套施工图纸、水电管线图、建材清单,定义了房子的骨架和功能

- Harness Engineering时代:你制定用地性质、容积率、绿化率等规则,城市就在这套框架下自主生长演变

单位越聪明、越自主,你越得靠一整套系统去约束它们的行为。

三、普通人与AI协作的四大问题

聊完了这三代技术,你可能会问:那我呢?我不是OpenAI的工程师,也不是LangChain的研究员,我就是个想用好AI的普通人。我该怎么办?

3.1 方法论:我当下应该如何与AI协作?

记住这点:三个时代的Engineering,从来都不是什么替代关系,而是一层一层升维、随着时代前进的嵌套关系。

什么意思?Harness Engineer需要懂Context Engineering,因为给AI提供正确的上下文信息本身就是Harness的一部分。Context Engineer也需要懂Prompt Engineering,因为最终跟AI沟通的单元还是一条条的Prompt。

每一层都没有过时,只是被更大的框架包裹住了。

所以,不要把之前学的都扔了,而是在此基础上升级你的思维:

- 先把提示词写好(这是基础)

- 再学会怎么给AI喂好上下文(这是进阶)

- 最后,开始思考怎么设计一套"系统"让AI帮你干活(这是前沿)

3.2 训练方法/核心竞争力:我要学习什么技能适应AI?

答案很明确:你要成为一个Harness Engineer。

别被这个词吓住了,不是要你去写复杂的代码,而是要你学会这几件事:

- 怎么给AI写"说明书"(比如AGENTS.md这种文件,告诉AI它是谁、要做什么、遵守什么规则)

- 怎么设计"检查机制"(比如自动化测试、核对清单,让AI知道自己做得对不对)

- 怎么给AI划边界(什么能做、什么不能做、做到什么程度)

- 怎么让AI迭代改进(一次做不好,给反馈,让它再来一次)

记住这个惊人的发现:"Agent = Model + Harness。几十亿参数的小模型,加上好的马具,能打败一个万亿级的大模型裸奔。Harness的价值,可能比模型大小更重要。"

未来比的不是谁的模型大,而是谁的马具好。

3.3 工具论:我要学习什么工具提升效率?

推荐几个你可以马上用起来的工具:

- Cursor这种AI编程助手(它已经帮你做好了很多context engineering)

- Claude Code(你可以去试试,这是第一个真的能像个agent一样帮你干活的东西)

- 自动化测试工具(不管你做什么,能自动检查对错的工具都是好Sensors)

- 一些简单的流程工具(让AI按你的流程一步一步来)

但比工具更重要的是,你要有能力给这些工具"定规矩"------也就是写Guides和设计Sensors。

3.4 心态论:我要保持什么心态应对AI发展?

保持这三个心态,你就不会焦虑:

- 升维而非替代:新的技术不是来替代旧的,而是嵌套在旧的之上。你之前学的提示词技巧依然有用,现在只是多了一个更大的框架。

- 设计而非执行:你的价值正在从"亲手把事情做完",转向"设计一个让AI高效把事情做完的环境"。别什么都自己干,想想怎么让AI帮你干。

- 长期主义:从火到炉子到蒸汽机,人类花了几千年;从Prompt到Context到Harness,AI只花了三年------这个变化很快,但也没必要慌,适应这个节奏就好。

四、结语

这场变革的核心驱动力是什么?答案很简单:效率与规模化。

想想看:

- 最开始,你要手写每一行代码

- 后来,你用提示词让AI帮你写代码

- 现在,你设计一套Harness,让AI自主构建整个系统

我们正在把越来越多的工作交给AI,同时把自己的精力聚焦在更有价值的事情上:设计环境、制定规则、创建反馈循环。

"构建软件仍然需要纪律,但纪律更多地体现在脚手架中,而不是代码中。"

这就是Harness Engineering的时代。你准备好了吗?