深入理解AI从感知智能和认知智能

- [AI 入门:搞懂感知智能和认知智能,你的 AI 项目才算真正入了门](#AI 入门:搞懂感知智能和认知智能,你的 AI 项目才算真正入了门)

-

- [一、什么是 AI](#一、什么是 AI)

- [二、AI 的发展流程](#二、AI 的发展流程)

-

- [2.1 起源阶段:图灵与 AI 的诞生(1950s)](#2.1 起源阶段:图灵与 AI 的诞生(1950s))

- [2.2 规则主义时代(1956-1970s)](#2.2 规则主义时代(1956-1970s))

- [2.3 第一次 AI 寒冬(1970s)](#2.3 第一次 AI 寒冬(1970s))

- [2.4 神经网络与统计学习崛起(1980s-2000s)](#2.4 神经网络与统计学习崛起(1980s-2000s))

- [2.5 深度学习爆发(2012-2016)](#2.5 深度学习爆发(2012-2016))

- [2.6 Transformer 与大模型时代(2017-至今)](#2.6 Transformer 与大模型时代(2017-至今))

- [2.7 一句话总结发展脉络](#2.7 一句话总结发展脉络)

- 三、什么是感知智能

-

- [3.1 感知智能在解决什么问题](#3.1 感知智能在解决什么问题)

- [3.2 感知智能的核心特点](#3.2 感知智能的核心特点)

- [3.3 在真实项目里,感知智能负责什么](#3.3 在真实项目里,感知智能负责什么)

- 四、什么是认知智能

-

- [4.1 认知智能在解决什么问题](#4.1 认知智能在解决什么问题)

- [4.2 认知智能比感知智能多了什么](#4.2 认知智能比感知智能多了什么)

- [4.3 为什么大模型天然更偏认知](#4.3 为什么大模型天然更偏认知)

- [4.4 认知智能的关注重点](#4.4 认知智能的关注重点)

- [4.5 在真实项目里,认知智能负责什么](#4.5 在真实项目里,认知智能负责什么)

- 五、感知智能和认知智能的区别

-

- [5.1 表格背后的核心逻辑](#5.1 表格背后的核心逻辑)

- [六、AI 在真实系统中的完整链路:感知 → 认知 → 执行](#六、AI 在真实系统中的完整链路:感知 → 认知 → 执行)

-

- [6.1 例子一:AI 客服系统](#6.1 例子一:AI 客服系统)

- [6.2 例子二:AI 导购助手](#6.2 例子二:AI 导购助手)

- [6.3 例子三:社交系统的 AI 陪聊](#6.3 例子三:社交系统的 AI 陪聊)

- [6.4 例子四:Agent / 智能体执行复杂任务](#6.4 例子四:Agent / 智能体执行复杂任务)

- [6.5 小结:为什么要理解这条链路](#6.5 小结:为什么要理解这条链路)

- 七、站在开发者角度,怎么理解这些概念

-

- [7.1 用分层架构来类比](#7.1 用分层架构来类比)

- [7.2 为什么程序员需要理解这个划分](#7.2 为什么程序员需要理解这个划分)

- [7.3 实际落地中常见的坑](#7.3 实际落地中常见的坑)

- 八、总结

AI 入门:搞懂感知智能和认知智能,你的 AI 项目才算真正入了门

如果你是一个程序员,这两年你一定有一个很强烈的感受------不管是技术群、技术博客还是招聘 JD 里,AI 无处不在。

以前提到 AI,大家第一反应还是"那是搞算法的人干的事",或者"那是 Python 写模型的圈子"。但自从**ChatGPT **火了之后,事情变了。你会发现,前端在用 AI 生成组件,后端在接大模型接口,测试在用 AI 写用例,产品经理在用 AI 写 PRD。AI 不再是一个"方向",而是一个正在渗透到所有技术栈里的"基础能力"。所以,不管你是做 Java 的、做前端的、还是做全栈的,花点时间搞懂 AI 的基本概念,已经不是"锦上添花",而是"迟早要补的课"。

在了解机器学习、深度学习、神经网络、大语言模型、多模态、Agent、RAG之前,我们先熟悉一下,到底什么是AI。

一、什么是 AI

AI,全称 Artificial Intelligence ,中文叫做人工智能。

要理解 AI,最简单的方式就是:让机器去模仿、学习,甚至部分替代人的智能行为。它的核心目标,就是让计算机像人一样去感知世界、理解信息、做出判断,并且能够执行相应的动作。

但你可能会想:传统程序不也能"做判断"吗?比如一个 if-else 就能判断用户年龄是不是大于 18。这算 AI 吗?

严格来说,这不算。传统程序的逻辑是人写死的------你告诉它"如果 A 就做 B",它就老老实实按照你写的规则来。它不会学习,也不会举一反三。你给它一张猫的图片,它不会自己认出来"这是一只猫",除非你手动写了一大堆规则告诉它猫的耳朵长什么样、猫的眼睛是什么颜色。

AI 不一样。AI 的核心是**"从数据中学习规律"**。你不需要手动写规则,而是给它大量的猫和狗的图片,让它自己去找"猫长什么样、狗长什么样"的规律。训练好之后,它看到一张没见过的图片,也能大概率判断出来这是猫还是狗。换句话说:

传统程序 = 人写规则,计算机执行

AI 程序 = 人给数据,计算机自己学规则

那为什么大模型一出来,AI 好像突然"出圈"了呢?因为在大模型之前,AI 虽然已经在很多领域用得很好了(比如人脸识别、语音助手、推荐系统),但这些应用大多数普通人感知不强。你刷短视频的时候,背后的推荐算法确实是 AI,但你不会觉得"哇,这是人工智能"。

但 ChatGPT 不一样------你直接跟它对话,它能写代码、写文章、回答问题、甚至帮你改简历。这种"像人一样聊天"的体验,让普通人第一次真正"感受到"了 AI 的存在。

所以大模型的意义,不只是技术上的突破,更是让 AI 从"幕后工具"走到了"台前体验"。

二、AI 的发展流程

很多人以为 AI 是最近几年才有的东西,其实不是。AI 这个概念已经有七十多年的历史了,只是中间经历了好几次起起落落。

下面我们简单梳理一下 AI 的发展脉络,不用死记硬背,主要是理解每个阶段的核心思路和为什么会发生转变。

2.1 起源阶段:图灵与 AI 的诞生(1950s)

- 1950 年,图灵发表了著名的论文《Computing Machinery and Intelligence》,提出了一个至今仍在讨论的问题:"机器能思考吗?"同时提出了图灵测试的概念------如果一个人无法区分跟他对话的是人还是机器,那这个机器就算通过了测试。

- 1956 年,达特茅斯会议正式提出了"Artificial Intelligence"(人工智能)这个词。这一年通常被认为是 AI 作为一个学科正式诞生的起点。

2.2 规则主义时代(1956-1970s)

早期的 AI 研究者们有一个朴素的想法:既然人是靠知识和逻辑来思考的,那我把这些知识和逻辑"翻译"成规则写进程序里,机器不就能"思考"了?

于是出现了大量基于规则的 AI 系统,比如专家系统------把某个领域专家的经验整理成一条条规则,让程序按照规则来做判断。

这种方法在简单场景下还行,但很快就碰到了天花板:规则写不完。现实世界太复杂了,你没办法把所有情况都用 if-else 覆盖。

2.3 第一次 AI 寒冬(1970s)

理论很美好,但实际上算力不够、数据太少、规则确实写不完。AI 的第一次热潮逐渐降温,政府和企业纷纷减少投入,AI 进入了第一次"寒冬"。

2.4 神经网络与统计学习崛起(1980s-2000s)

- 1980 年代,研究者们重新把目光投向了神经网络。虽然这个概念在 1950 年代就有了,但受限于当时的算力,一直没有得到很好的发展。到了 1980 年代,反向传播算法(Backpropagation)让多层神经网络的训练成为可能,AI 再次回暖。

- 1990 年代 ,统计机器学习崛起。AI 从"写规则"转向了"从数据中学规律"这条路。支持向量机(SVM)、决策树、随机森林等方法开始大量应用。这个阶段的核心特点是:让数据说话,而不是让人写规则。

2.5 深度学习爆发(2012-2016)

2012 年是一个重要的分水岭。AlexNet 在 ImageNet 图像识别大赛中以碾压级的优势获胜,让整个学术界和工业界都意识到:深度学习(Deep Learning)真的行。

为什么这个时候深度学习突然爆发了?主要是三个条件同时成熟了:

- 数据:互联网的发展产生了海量数据

- 算力:GPU 的出现让大规模训练成为可能

- 算法:卷积神经网络(CNN)、循环神经网络(RNN)等架构不断完善

从 2012 年到 2016 年,图像识别、语音识别、自然语言处理等领域都取得了突破性进展。

2.6 Transformer 与大模型时代(2017-至今)

- 2017 年,Google 发表了那篇影响深远的论文《Attention Is All You Need》,提出了 Transformer 架构。这个架构成为了后来几乎所有大语言模型的基础。

- 2018-2020 年,BERT、GPT-2、GPT-3 相继问世,"预训练 + 微调"的范式逐渐成型。2020 年 GPT-3 发布,展示了"大力出奇迹"的可能------模型参数够多、数据够大,它就能涌现出很多意想不到的能力。

- 2022-2023 年,ChatGPT 发布并引爆全球。这是 AI 真正"出圈"的时刻。它不仅能对话,还能写代码、改文章、做总结、当助手,让普通人第一次真切地感受到 AI 的力量。

- 2024 年,GPT-4o 等多模态模型开始落地,同期 Gemini、Claude 等模型也在快速发展。AI 开始从"纯文本对话"走向"看得懂图、听得懂话、能操作工具"的多模态时代。

- 2025 年,DeepSeek-R1 等模型的出现,推动了推理能力的提升和成本的降低,让更多中小企业也能用得起大模型。

- 2026 年,行业逐步进入"智能体 + 基础设施 + 安全治理"的阶段。Claude Code、Codex、Gemini 等工具正在改变程序员的工作方式,AI 不再只是一个"模型",而是变成了一个"能干活的系统"。

下面这张图梳理了 AI 发展的大致脉络,可以帮你建立一个时间线上的整体认知:

如果你想更详细地了解 AI 的发展历史,可以参考这篇文章:AI 发展历史详解

2.7 一句话总结发展脉络

如果把 AI 的发展浓缩成一句话,那就是:

从"人写规则"到"机器学规则",从"学浅层特征"到"学深层语义",从"单任务模型"到"通用大模型",从"模型能力"到"系统能力"。

每一次跨越的背后,都是数据量、算力和算法架构的共同推动。理解了这条线,你就能理解为什么大模型会在这个时间节点出现,而不是更早或更晚。

三、什么是感知智能

前面我们聊了 AI 的定义和发展脉络,接下来要进入这篇文章的核心内容了:什么是感知智能模型 ,它要解决的问题是"让机器能够感知这个世界"。

3.1 感知智能在解决什么问题

什么叫感知?就是人的眼睛能看、耳朵能听、皮肤能感受温度。感知智能做的事情,就是让机器也具备类似的能力------能"看见"图片里有什么,能"听见"语音说了什么,能"读出"文档里写了什么。

说白了,感知智能的本质是:将现实世界的原始信号,变成机器可以处理的结构化数据。

举几个你日常开发中可能接触到的例子:

- OCR 识别:用户上传了一张身份证照片,系统需要自动提取出姓名、身份证号、地址等信息。这就是感知智能在做"看"的工作。

- 语音转文字:用户在 App 里说了一段话,系统需要把它转成文字。这就是感知智能在做"听"的工作。

- 人脸识别:门禁系统需要判断摄像头前面的人是不是小区住户。这也是感知智能。

- 图片审核:用户在社交平台上传了一张图片,系统需要自动判断这张图片有没有违规内容。

- 视频行为检测:监控摄像头需要自动检测画面中是否有人摔倒、是否有异常聚集。

- 自动驾驶感知:车上的摄像头和激光雷达需要实时识别前方是行人、车辆、路牌还是障碍物。

- 工业质检:生产线上的相机需要检测产品表面有没有划痕、缺陷。

- 商品图理解:电商平台需要自动识别用户上传的商品图片里是什么类别、什么颜色、什么品牌。

这些任务有一个共同的特点:它们都在回答"这是什么"的问题。

3.2 感知智能的核心特点

感知智能在实际项目中,有几个比较显著的特点:

第一,它更像系统的"输入层"。 在一个完整的 AI 系统里,感知智能通常是第一步。它的任务是把外部世界的"原始信号"(图片、语音、视频等)变成"结构化信息"(文字、坐标、分类标签等),然后交给后面的模块去处理。

第二,它的首要目标是"识别准"。 感知模型最关心的事情是:识别准不准、速度快不快、对噪声的鲁棒性好不好。比如在自动驾驶场景里,如果摄像头把行人识别成了路灯,那后面的决策再聪明也没用。所以感知这一层,准确率就是生命线。

第三,它通常不太依赖上下文。 感知模型大多数情况下是"看当前输入"来判断的。你给它一张图片,它就分析这张图片;你给它一段语音,它就识别这段语音。它不太需要知道"之前发生了什么"或者"用户的整体意图是什么"。

第四,它擅长回答的问题有边界。 感知智能擅长回答:这是什么、在哪里、看到了什么、听到了什么。但它不擅长回答:为什么要这样做、该怎么做、背后的意图是什么、多步推理后的最佳决策是什么。

举个容易理解的例子:感知智能看到一个人在流泪,它可以识别出"这个人在哭"。但它回答不了"这个人为什么在哭------是激动、委屈还是感动?需不需要安慰?该怎么安慰?"这些问题,需要认知智能来处理。

下面这张图整理了感知智能的核心能力和典型应用场景,帮你建立一个更清晰的认知:

3.3 在真实项目里,感知智能负责什么

站在开发者的角度,你在做 AI 相关的项目时,如果需求是下面这些类型,那你大概率是在做感知智能相关的事情:

- 用户上传一张图片,系统需要识别图片里的内容

- 用户发了一段语音,系统需要把它转成文字

- 用户上传了一个证件/发票/合同,系统需要提取其中的关键信息

- 系统需要实时分析视频画面中的物体和行为

- 系统需要判断一张图片是否违规

这些需求的共同特征是:你要解决的核心问题是"识别",而不是"理解"或"决策"。

在技术选型上,感知智能领域常见的技术路线包括:CNN(卷积神经网络)、YOLO(目标检测)、ResNet(图像分类)、各种 OCR 引擎、ASR(语音识别)模型,以及近年来越来越多的多模态感知模型。

四、什么是认知智能

聊完了感知智能,我们再来看认知智能。如果说感知智能是"眼睛和耳朵",那认知智能就是"大脑"。

4.1 认知智能在解决什么问题

感知智能解决的是"看见了什么"的问题,认知智能解决的是"看见之后怎么想、怎么做"的问题。

你可以这样理解:认知智能具备的是一套理解系统、记忆系统、推理系统、决策系统和语言组织系统 。它的核心任务是:理解、推理、判断、规划、对话、决策和生成。

我们把这些核心任务再拆细一点看:

- 语言理解:理解用户表达的是什么意思,真实意图是什么,有没有上下文依赖。比如用户说"帮我订一张明天去上海的票",认知模型要能理解"明天"是哪天、"票"是机票还是火车票、"上海"是目的地。

- 逻辑推理:通过已知条件推导出结论。比如用户问"如果明天下雨,我该带什么出门?",模型需要推理出雨伞、雨衣等合理答案。

- 知识问答:根据已有知识库回答问题,能结合资料和规则提取要点。比如企业内部的智能客服,需要基于产品文档来回答用户的问题。

- 决策规划:在复杂场景下做出判断和规划。比如自动驾驶中是否需要刹车、AI 助手要不要调用某个工具、一个 Agent 该按什么步骤完成用户交给它的任务。

- 内容生成:根据场景需要生成文本内容------写文章、写代码、写总结、写建议、写回复、写解释等等。

下面这张图梳理了认知智能的核心任务体系,可以帮你更直观地理解它的能力范围:

4.2 认知智能比感知智能多了什么

可能你会问:认知智能到底比感知智能"多"在哪里?

最核心的差别在于,认知智能多了以下几个关键能力:

- 语义理解能力:不只是识别"这是什么字",而是理解"这句话是什么意思"。

- 上下文能力:能根据对话历史、用户画像、场景信息来做判断,而不是只看当前这一条输入。

- 推理能力:能通过已知信息推导出未知结论,而不是简单的模式匹配。

- 规划能力:能把一个复杂任务拆解成多个步骤,按合理顺序执行。

- 生成能力:能根据任务目标生成有意义的内容------文字、代码、方案等。

所以你可以简单记住:

感知智能回答"这是什么",认知智能回答"这意味着什么、我该怎么做"。

4.3 为什么大模型天然更偏认知

你有没有注意到,ChatGPT、Claude、Gemini 这些大模型,更多的能力体现在"对话、理解、推理、生成"上?这就是典型的认知智能范畴。

大语言模型(LLM)的训练目标本质上就是"根据上下文预测下一个 token"。这个过程让模型在海量文本中学到了语言的语义、逻辑关系、常识知识、推理模式等等。所以大模型天然就是在做认知智能的事情。

当然,现在的大模型也在逐步融合感知能力------比如 GPT-4o 能理解图片和语音,这就是在把感知层和认知层融合到一个模型里。但从根本上说,大模型的核心优势仍然在认知层面。

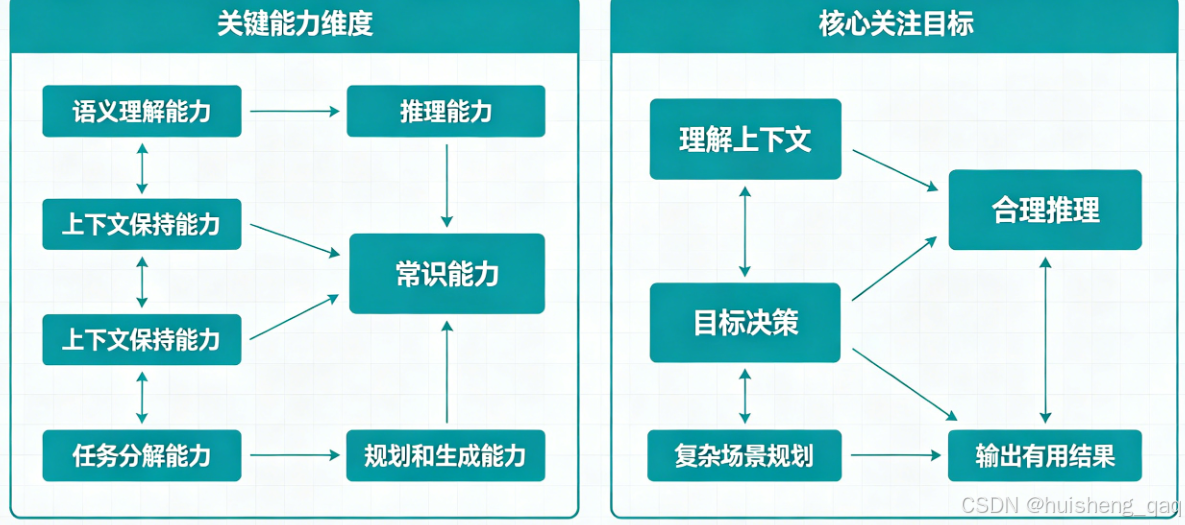

4.4 认知智能的关注重点

与感知智能关注"识别准不准"不同,认知智能更关注的是:

- 能否正确理解上下文

- 能否做出合理的推理

- 能否根据目标做出恰当的决策

- 能否生成对人类有用的结果

- 能否避免"幻觉"(生成看似合理但实际上不正确的内容)

这也是为什么评估一个大模型好不好,我们通常不是看它"认没认出图片里有什么",而是看它"理解能力、推理能力、遵循指令的能力、生成内容的质量"等维度。

下面这张图展示了认知智能关注的核心问题和评估维度:

4.5 在真实项目里,认知智能负责什么

站在开发者角度,如果你的项目需求是下面这些类型,那你大概率是在做认知智能相关的事情:

- AI 客服:用户问了一个问题,系统需要理解问题的意图,从知识库中找到答案,并组织语言回复用户。

- AI 助手:帮用户写代码、改文章、做总结、整理会议纪要。

- AI 导购:根据用户的偏好、历史行为和当前诉求,推荐最合适的商品。

- AI 简历优化:理解用户的简历内容,分析岗位要求,给出有针对性的修改建议。

- AI 陪聊:根据用户的情绪状态和对话上下文,生成有温度、有共情的回复。

- 智能推荐:基于用户画像和行为数据,推理出用户可能感兴趣的内容。

- 工具调用(Function Calling):大模型根据用户的指令,判断需要调用哪个 API、传什么参数、怎么组合结果。

- Agent 任务执行:AI 智能体自主规划任务步骤,调用工具,处理中间结果,最终完成用户交给它的复杂任务。

这些需求的共同特征是:你要解决的核心问题是"理解和决策",而不仅仅是"识别"。

五、感知智能和认知智能的区别

前面我们分别聊了感知智能和认知智能的定义与特点,现在我们把它们放在一起做个系统对比。

下面这张表格,从多个维度来对比两者的核心区别:

| 对比维度 | 感知智能 | 认知智能 |

|---|---|---|

| 核心目标 | 让机器"看见、听见、识别出来" | 让机器"理解、推理、判断、决策" |

| 解决的问题 | 这是什么、在哪里、有哪些特征 | 这代表什么意思、为什么会这样、下一步该怎么做 |

| 处理对象 | 原始信号:图片、语音、视频、传感器数据等 | 已抽取的信息、语义、上下文、知识、目标 |

| 典型任务 | OCR、语音识别、目标检测、人脸识别、图像分类、视频行为检测 | 问答、对话、推理、总结、规划、决策、内容生成、工具调用 |

| 常见输出 | 标签、坐标框、分类结果、置信度、结构化字段 | 判断结论、解释、建议、计划、回复、代码、行动方案 |

| 关注重点 | 识别准不准、速度快不快、抗干扰能力强不强 | 理解对不对、推理顺不顺、决策合不合理 |

| 常见错误 | 看错、听错、漏检、误检、识别不全 | 理解偏差、推理错误、幻觉、上下文断裂、决策不合理 |

| 业务中的角色 | 负责把现实世界的信号转成机器可处理的数据 | 负责基于数据做理解、思考和行动 |

| 是否依赖上下文 | 较弱,更关注当前输入本身 | 很强,通常依赖上下文、历史信息、目标约束 |

| 一句话总结 | 先把东西识别出来 | 再把识别出的东西想明白 |

5.1 表格背后的核心逻辑

看完这张表格,你可能已经有感觉了:感知智能负责的是"输入理解前的识别",认知智能负责的是"识别之后的理解与决策"。

更简洁地说:

- 感知智能强调的是:这是什么

- 认知智能强调的是:这意味着什么,接下来该怎么做

感知偏识别,认知偏思考。

但这两个东西并不是对立的,也不是二选一的关系。在一个真实的业务系统里,它们通常是上下游关系------感知智能在前面负责"采集和识别",认知智能在后面负责"理解和决策"。

没有感知层,认知层就像一个没有眼睛和耳朵的大脑------什么都看不到、听不到。没有认知层,感知层就像一个只会看和听但不会思考的人------看到了也不知道该怎么办。

不过,只聊"感知"和"认知"两个阶段还不够。在真实的工程系统里,AI 识别完了、想明白了,最终还要把结果落成动作------这就是下一节要聊的内容。

六、AI 在真实系统中的完整链路:感知 → 认知 → 执行

前面我们花了不少篇幅分别讲了感知智能和认知智能,也做了详细的对比。但如果你真正上手做过 AI 相关的项目,你就会发现一个问题:光讲"感知"和"认知"还不够,真实系统跑起来远不止这两步。

在实际的业务系统中,AI 的工作流程通常是这样的:

感知(识别外部输入)→ 认知(理解与决策)→ 执行(输出动作、落地结果)

这里的"执行"不是什么新的学术概念,也不是"第三种智能"。它就是工程链路里的最后一环------把认知层的理解和决策结果,真正变成一个动作、一个输出、一个可交付的结果。

你可以这样理解:感知是"眼睛和耳朵",认知是"大脑",执行就是"手和嘴"------想明白了,还得做出来。

为什么要单独拎出来讲?因为很多时候,AI 系统出问题不是"识别错了"或"理解错了",而是"最后一步没做好"。比如大模型理解了用户的意图,也做出了正确的判断,但最终生成的回复格式不对、调用的 API 传参有误、或者执行动作的时机不对------这些都属于执行层的问题。

下面我们通过几个真实的例子,来感受一下这条完整链路在不同场景下是怎么跑起来的。

6.1 例子一:AI 客服系统

假设你在做一个电商平台的智能客服,用户发来了一段语音和一张订单截图,想要退款。

感知层做什么:

- ASR(语音识别)把用户的语音转成文字:"我要退这个订单的款"

- OCR 识别截图中的订单编号、商品名称、金额等信息

认知层做什么:

- 理解用户的意图:这是一个退款请求,不是投诉,也不是咨询

- 结合订单信息判断:这个订单是否在退款期内?商品状态是什么?是否符合退款条件?

执行层做什么:

- 调用订单系统查询退款资格

- 如果符合条件,自动发起退款流程

- 生成一条回复发给用户:"您的订单 XXX 已提交退款申请,预计 1-3 个工作日到账"

- 如果不符合条件,生成解释说明,或者自动转接人工客服

你看,如果只做到"识别了语音和截图"(感知层),或者只做到"判断出用户想退款"(认知层),但没有真正去查订单、发起退款、生成回复,用户的问题就没有被解决。执行层才是让整个流程闭环的关键。

6.2 例子二:AI 导购助手

假设你在做一个电商平台的 AI 导购功能,用户说"帮我推荐一款 2000 块以内的跑步鞋,我平时跑半马"。

感知层做什么:

- 如果用户同时发了图片(比如自己之前穿的鞋子),识别图片中的品牌、款式、类型

- 解析用户输入的文本内容

认知层做什么:

- 理解用户的核心需求:预算 2000 以内、用途是跑步(半马级别)、需要推荐

- 结合用户画像(历史购买记录、偏好品牌等)做综合判断

- 推理出适合半马的鞋子特征:需要缓震好、重量轻、耐磨

执行层做什么:

- 调用商品检索接口,按条件筛选商品

- 对候选商品做排序(结合匹配度、销量、评价等)

- 输出推荐结果,附上推荐理由:"推荐这款 XX 跑鞋,缓震性能好,适合半马距离,当前价格 1899 元"

6.3 例子三:社交系统的 AI 陪聊

假设你在做一个社交 App 的 AI 陪聊功能,用户发了一段语音,语气比较低落,还配了一张下雨天的窗户照片。

感知层做什么:

- 语音识别把语音转成文字:"今天又是一个人,好无聊啊"

- 分析语音的语调和语速,判断情绪倾向:偏低落

- 图像识别判断图片内容:雨天、窗户、室内场景

认知层做什么:

- 综合文字内容、情绪判断和图片信息,判断用户当前的状态:孤独、无聊,可能需要陪伴

- 判断当前不适合推送活动信息或硬广,应该以情绪陪伴为主

- 决定回复策略:温暖、共情、适度引导话题

执行层做什么:

- 生成一条有温度的回复:"下雨天确实容易犯困又犯懒呢,不过一个人待着也挺好的,可以给自己泡杯热茶。最近有没有在追什么剧呀?"

- 控制回复风格和长度,不要太正式也不要太随便

- 记录本次对话状态,为下一轮对话提供上下文

6.4 例子四:Agent / 智能体执行复杂任务

这个场景可能是目前最"工程化"的一个。假设用户对一个 AI 编程助手(Agent)说:"帮我把这个项目的单元测试补全,覆盖率提升到 80% 以上。"

感知层做什么:

- 接收用户的自然语言任务描述

- 读取项目的文件结构、已有代码和现有测试文件

- 读取当前测试覆盖率报告

认知层做什么:

- 理解任务目标:补全单元测试,目标覆盖率 80%

- 分析现有代码,找出哪些模块还没有被测试覆盖

- 规划执行步骤:先分析覆盖率缺口 → 再逐个模块编写测试 → 最后运行验证

- 判断每个测试用例应该覆盖哪些分支和边界条件

执行层做什么:

- 按照规划的步骤,逐个生成测试代码文件

- 调用工具把测试代码写入项目

- 运行测试命令,检查是否通过

- 如果某个测试失败,分析原因,修改后重新执行

- 最终输出结果:"已完成 12 个测试文件的补充,覆盖率从 53% 提升至 82%"

这个例子里,Agent 的工作模式就是典型的"感知 → 认知 → 执行"不断循环。它不只是"想一想"就完了,而是真正地去读文件、写代码、跑命令、看结果、再调整------这就是执行层在做的事情。

6.5 小结:为什么要理解这条链路

通过上面这四个例子,你应该能感受到:在真实的 AI 系统里,光能"看见"不够,光能"想明白"也不够,最终必须"做出来"。

- 感知层解决的是 "信息怎么进来"

- 认知层解决的是 "信息怎么理解、怎么决策"

- 执行层解决的是 "决策怎么落地、结果怎么交付"

这三层加在一起,才构成了一个完整的、能在真实业务中跑起来的 AI 系统。

对开发者来说,理解这条链路的意义在于:当你的 AI 系统出了问题,你能快速判断问题出在哪一层------是识别错了、是理解错了、还是执行错了。这会让你的排查效率高很多。

七、站在开发者角度,怎么理解这些概念

前面讲了那么多定义、对比和链路分析,对我们程序员来说,最实际的问题是:这些概念在做项目的时候到底有什么用?

7.1 用分层架构来类比

如果你习惯用分层架构来思考问题(做后端的应该都很熟悉),那你可以这样类比:

- 感知智能 ≈ 输入层(Input Layer):负责接收外部世界的信号,把它们转化成结构化的数据。就像你后端系统里的 Controller 层------它负责接收请求、解析参数,但本身不做业务逻辑。

- 认知智能 ≈ 思考层(Thinking Layer):负责理解这些数据的含义,做出判断和决策。就像你的 Service 层------拿到数据之后做真正的业务处理。

- 执行 ≈ 动作层(Action Layer):负责把决策落地成具体的输出。就像你的 DAO 层 + 外部调用------最终要把结果写进数据库、发出通知、返回给前端。

当然,这个类比不是百分百精确的,但它能帮你快速建立一个直觉。

7.2 为什么程序员需要理解这个划分

你可能觉得这些概念有点"学术",跟写代码没什么关系。但其实恰恰相反,理解这个划分在实际做 AI 项目时非常实用。

第一,需求拆解更清晰。

当产品经理跟你说"我要做一个智能 XX 功能"的时候,你的第一步应该是判断:这个需求的核心到底是在解决识别问题 还是在解决理解与决策问题?

比如"自动识别用户上传的发票"------这是感知问题,你需要的是一个好的 OCR 模型。

比如"根据发票内容自动归类报销类型并提出审批建议"------这就叠加了认知问题,你可能还需要大模型或规则引擎来做理解和判断。

再比如"识别完发票后自动提交到财务系统并通知审批人"------这就进入了执行层,你需要对接内部系统、写流程编排。

需求拆解得越清楚,你的技术选型就越精准,不会出现"杀鸡用牛刀"或者"选型不匹配"的问题。iii

第二,技术选型更有方向。

搞清楚了"感知"和"认知"之后,你在技术选型时就有了方向:

- 如果核心是感知任务 → 考虑专业的视觉模型、OCR 引擎、ASR 服务等

- 如果核心是认知任务 → 考虑大语言模型、RAG、Agent 框架等

- 如果两者都需要 → 考虑多模态模型,或者"感知模型 + 大模型"的组合架构

- 如果执行环节复杂 → 考虑工作流引擎、Function Calling、Agent 编排框架等

第三,排查问题更高效。

当你的 AI 系统输出结果不对的时候,你可以快速定位问题出在哪一层:

- 如果是"识别错了"(比如 OCR 把 "6" 识别成了 "8")------ 那是感知层的问题

- 如果是"识别对了但理解错了"(比如 OCR 正确提取了文字,但大模型曲解了含义)------ 那是认知层的问题

- 如果是"理解对了但执行错了"(比如大模型判断正确,但调用 API 时参数传错了)------ 那是执行层的问题

这种分层排查思路,在实际项目中能帮你省掉大量的排查时间。

7.3 实际落地中常见的坑

最后分享几个做 AI 项目时常见的认知误区,都跟感知和认知的划分有关:

误区一:"用大模型就能解决一切"

大模型更擅长认知任务,但在一些精确的感知任务上(比如高精度 OCR、实时目标检测),专业的感知模型可能效果更好、成本更低。不要什么问题都想着丢给大模型。

误区二:"感知层不重要,反正大模型都能处理"

感知层的质量直接影响认知层的表现。如果 OCR 识别出来的文字就是错的,大模型拿到的"原材料"就是错的,后面的理解和决策自然也会跟着错。所以感知层的准确率非常关键,这在工程上叫"Garbage In, Garbage Out"。

误区三:"不区分感知和认知,一股脑往上堆"

这种做法往往导致系统架构混乱、排查问题困难、资源浪费严重。在设计阶段就把"输入识别"和"理解决策"分清楚,后面的开发和维护会顺利很多。

误区四:"只关注模型能力,忽略执行层"

很多团队花大量精力在选模型、调 prompt 上,但最终系统上线后出问题的地方反而是执行层------API 调不通、格式解析失败、超时没处理、异常没兜底。模型再强,执行层不稳,系统就不可靠。

八、总结

最后,我们来做一个简洁的总结。

AI 是什么? 简单说就是让机器从数据中学习规律,模仿人类的智能行为。它跟传统程序最大的区别在于:传统程序是人写规则,AI 是机器自己学规则。

AI 怎么发展过来的? 从"人写规则"的专家系统,到"从数据中学规律"的统计学习,到"自动学特征"的深度学习,再到"什么都能干"的大模型时代。每一次跨越都离不开数据、算力和算法的共同进步。

什么是感知智能? 让机器具备"看见、听见、识别"的能力。它更像系统的输入层,负责把现实世界的信号转化成机器可以处理的数据。核心问题是"这是什么"。

什么是认知智能? 让机器具备"理解、推理、判断、决策"的能力。它更像系统的思考层,负责在感知结果的基础上做理解、做判断、做规划。核心问题是"这意味着什么,该怎么做"。

两者的关系? 不是对立的,而是上下游协作的关系。感知负责"把信息拿进来",认知负责"把信息用起来"。在真实的 AI 系统中,它们通常是组合使用的。

AI 在真实系统中怎么跑起来的? 通常是"感知 → 认知 → 执行"三步走------先识别输入,再理解决策,最后落地执行。这三层加在一起,才构成一个能在业务中真正跑起来的 AI 系统。

对开发者的意义? 理解这个划分,能帮你更好地做需求拆解、技术选型和问题排查。当你接到一个 AI 需求时,先想清楚:我要解决的到底是"识别问题"、"理解与决策问题"还是"执行落地问题"------这一步想清楚了,后面的路就好走了。

AI 这个领域确实很大,概念很多,但只要你把基础概念搞扎实了,后面再去学 RAG、Agent、微调、提示工程这些东西,就不会觉得"不知道这些东西在整个体系里是什么位置"。

希望这篇文章对你有帮助。如果有什么讲得不清楚的地方,欢迎在评论区交流。