📋文档说明:

本文基于上一篇文章AI Coding 全景调研:从补全到Agent,IDE、CLI、Agent、编程大模型30+工具3万字深度调研

聚焦 AI Coding 落地过程中的安全问题与应对策略,面向管理层决策参考。

核心立场: 安全可控的前提下,最大化 AI Coding 的提效价值。

- 首发日期:2026 年 4 月 16 日

- 作者: @AGI舰长

本报告主要基于国内企业或员工场景下而生,所以主要基于国产内容分析,对于个人开发者或者小型互联网公司或者小项目,实际上没必要顾虑这么多。

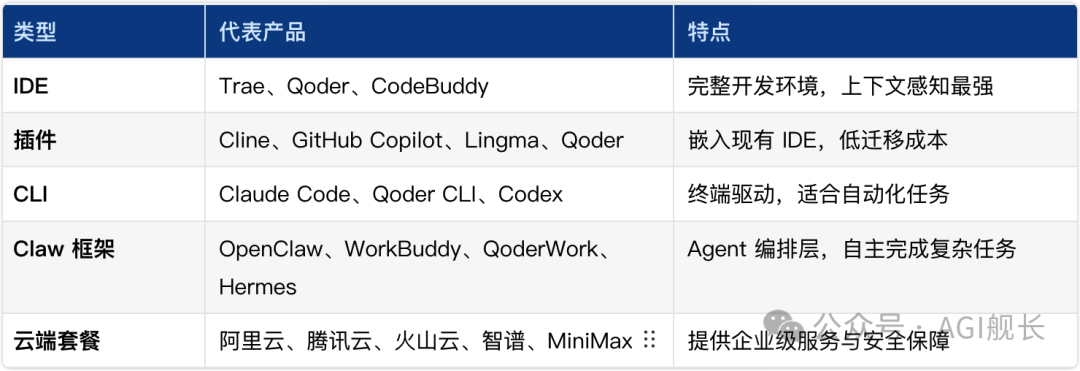

一、工具生态全景

在推进 AI Coding 之前,先明确我们所讨论的工具边界。当前主流形态分为五类

共同点:以上所有工具,在默认公有云模式下,均需要将代码片段或完整上下文发送至 LLM 服务端进行推理。这是安全风险的核心来源。

二、安全风险分类

2.1 四类核心风险

2.2 风险级别判断

2.3 项目情况分类

-

新项目 ✅ 直接用

-

老项目(可本地开发)🟠 有限接入

-

老项目(堡垒机 / 云桌面)🔴 专项方案

三、解决方案

3.1 针对「源码泄露 + 黑客拦截」

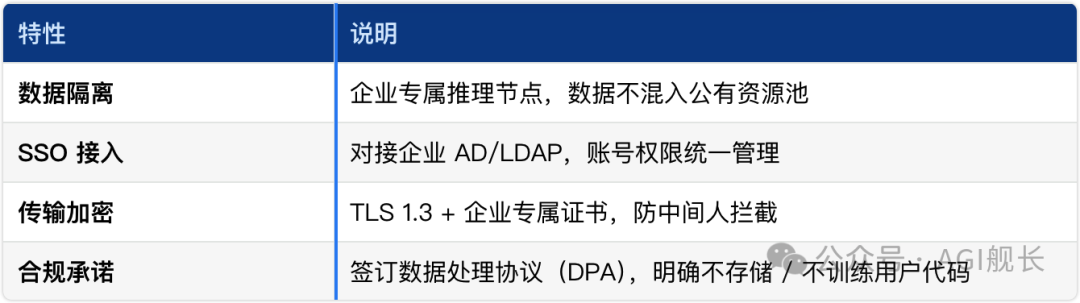

3.1.1 方案 A:企业版 CodingPlan 采购(推荐优先)

国内主流厂商均提供企业级服务,核心增值点:

- 推荐优先选择

腾讯云(CodeBuddy 企业版)、阿里云(百炼 + Qoder 企业版),有国内数据合规背书。 - 成本参考

约 ¥30~200/人/月,相比人工提效 60%+ 的收益,ROI 显著。

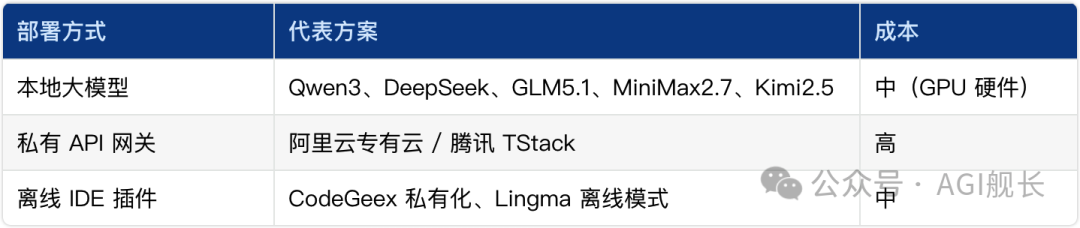

3.1.2 方案 B:私有化部署(高安全需求场景)

适合:涉密项目、金融客户、政务系统。

⚠️现实约束

私有化大模型能力明显弱于顶级公有模型,编码能力有折损,适合作为隔离兜底方案,而非首选。

3.2 针对「LLM 生成恶意代码」

这类风险被高估的程度远大于实际威胁,但仍需建立工程防护机制:

- 代码审查不能省略

AI 生成的代码,必须经过 Code Review,不允许直接推送生产分支。 - 引入 SCA 扫描

在 CI/CD 流水线中集成软件成分分析(如 Snyk、OWASP Dependency-Check),自动扫描依赖漏洞。 - SAST 静态扫描

集成 Semgrep 或 SonarQube,对 AI 生成代码做安全规则校验。 - 测试覆盖率要求

AI 生成的模块须达到与人工编码相同的单元测试覆盖率标准。

核心原则:把 AI 当实习生用------接受它的产出,但不跳过审核流程,稳步成长。

3.3 针对「版权合规」

实际上员工平时开发也是在用 AI Coding,甚至在没有 AI 以前,也是在网络上百度、CSDN、Github Copy 代码。并且代码是本地化部署,并非对互联网的 SaaS 模式,所以,可以基本忽略。

四、三类项目的落地策略

4.1 新项目 ✅ 直接用

安全风险:基本可忽略。

新项目没有既有代码资产的泄露顾虑,是 AI Coding 最理想的应用场景。

实测收益:

- 高级工程师 + AI,1~2 周完成小型前后端微服务 V1.0

- 综合提效 60%+ ,纯后端可覆盖 60%~90% 前端工作

- 架构设计、接口定义、单元测试、文档生成,全流程 AI 参与

💡 建议方式:直接采用企业版 CodingPlan,全量接入 IDE(Qoder / CodeBuddy),无需额外安全措施。

4.2 老项目(可本地开发)🟠 有限接入

核心策略:控制传输粒度,不传敏感上下文。

老项目的核心安全顾虑是:AI 工具的 @codebase / Repo Wiki 等功能会将整个代码库索引并上传至云端。

操作规范:

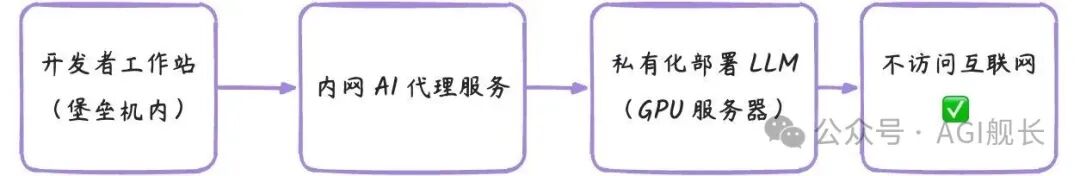

4.3 老项目(堡垒机 / 云桌面)🔴 专项方案

这是最复杂的场景,以金融类企业云端开发环境为典型代表。

⚠️ 核心矛盾:堡垒机网络隔离设计初衷是防止代码外流,而 AI Coding 需要访问互联网 LLM。两者天然冲突

可行路径(三选一):

4.3.1 路径 1:私有化 LLM 内网部署

在内网部署轻量级大模型(DeepSeek-Coder、Qwen-Coder),AI 工具指向内网 API 地址,全程不出网。

- **优点:**彻底解决外传风险。

- **缺点:**模型能力有限,需要 GPU 硬件投入。

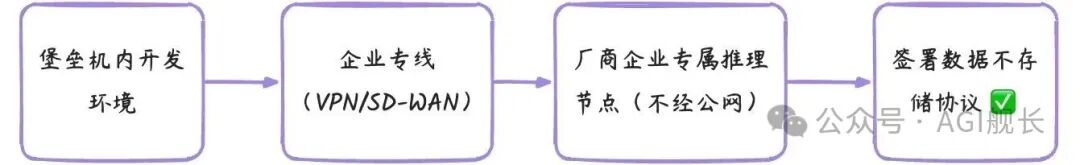

4.3.2 路径 2:企业专线 + 企业版套餐

通过专线(专用 VPN / SD-WAN)访问云厂商企业版 LLM 端点,绕过公共互联网。

- **优点:**模型能力全量保留(可用 GLM-5.1 级别)

- **缺点:**需与网络安全团队协商开通专线通道,周期较长。

4.3.3 路径 3:双区域开发模式(过渡方案)

在完整私有化或专线方案落地之前,可采用「开发隔区 + 安全审查」的折中策略:

- 非敏感的新功能开发:在本地开发机上用 AI 完成,审查后再同步至堡垒机环境

- 敏感存量代码维护:保持传统开发方式,不引入 AI

- 建立代码安全入闸流程:AI 辅助开发的代码,进入堡垒机前须经安全扫描

五、推进建议

-

AI Coding 的安全问题是可管理的,不是不能碰的。

-

新项目立即可用,老项目分场景评估,堡垒机环境有专项方案。

-

推荐从新项目 + 企业版 CodingPlan 切入,用 1~2 个项目验证提效数据,再逐步扩展到更多场景。

推进节奏建议:

第 1 阶段(0~1 个月) ├── 采购企业版 CodingPlan(腾讯云 / 阿里云) ├── 选 1~2 个新项目试点 └── 建立 AI 代码审查规范

第 2 阶段(1~3 个月) ├── 统计试点项目的提效数据(工时、交付质量) ├── 评估老项目本地开发场景的接入可行性 └── 制定堡垒机环境专项方案(私有化 or 专线) 第 3 阶段(3~6 个月) ├── 全团队推广,配套 AI Coding 培训 ├── 集成 SCA / SAST 安全扫描至 CI/CD └── 形成企业内部 AI Coding 安全规范文档本报告基于 2026 年 4 月调研数据

十分欢迎您提供宝贵的方案与建议

🎯 往期推荐👇