【CVPR 2026】LitePT:更轻、更强的点云 Transformer

LitePT: Lighter Yet Stronger Point Transformer

核心创新:浅层卷积、深层注意力 + 无参数 3D 位置编码 PointROPE

LitePT:更轻、更强的点云 Transformer

##注释

点云 Transformer :专门处理3D 点云(激光雷达、三维扫描)的 Transformer 模型

一种专门用来 "看懂 3D 空间点云数据" 的深度学习模型,用 Transformer 架构做核心,专门处理激光雷达、三维扫描出来的 3D 点。

3D 点云:激光雷达 / 深度相机扫出来的一堆三维坐标点,比如:自动驾驶车扫到的路面、车、人、树;比如:室内扫描的墙、桌子、椅子

形式:(x, y, z) 坐标 + 颜色 / 强度 → 一堆散乱的点

Transformer放到 3D 里,就是:让模型知道 "这个点和远处那个点是什么关系"。

##注释

摘要

用于 3D 点云处理的现代神经网络架构同时包含卷积层与注意力模块,但如何最优地组合二者仍不明确。我们分析了 3D 点云网络中不同计算模块的作用,并发现一个直观规律:在网络浅层的高分辨率阶段,卷积足以提取底层几何特征,而此时使用注意力计算代价高昂且无增益;在网络深层的低分辨率阶段,注意力能更高效地捕获高层语义与上下文信息,而卷积会导致参数量急剧膨胀。

基于这一设计原则,我们提出一种全新的改进型 3D 点云主干网络:在浅层使用卷积,深层切换为注意力 。为避免丢弃冗余卷积层后丢失空间位置信息,我们提出一种新颖的无参数 3D 位置编码 PointROPE 。最终得到的 LitePT 模型,参数量仅为当前最优的 Point Transformer V3 的1/3.6 ,推理速度快2 倍 ,内存占用少50% ,同时在各类任务与数据集上持平或超越 后者效果。代码与模型已开源:https://github.com/prs-eth/LitePT。

引言

三维点云的视觉理解在众多应用中处于核心地位,包括机器人技术 [5, 90, 92, 102]、自动驾驶 [22, 72]、定位 [48]、建图 [55, 79, 81] 以及环境监测 [35, 68]。针对非结构化点云,学界已提出多种深度学习架构与神经处理层,但该领域仍缺乏对各类方法优缺点的深入理解 ,也缺少能将它们高效组合成通用、高性能架构的系统性设计准则。

##注释

非结构化点云:一堆没有固定顺序、没有网格、没有排列规则、散乱分布的 3D 坐标点。

形式:(x,y,z) 一大堆点,无序、不规则、疏密不均

结构化:有网格、有顺序、有规律(比如图片的像素、体素)

##注释

近年来,基于 Transformer 的模型在三维基准测试中占据主导地位。其中最新的Point Transformer V3(PTv3) [88] 已被证明优于早期的稀疏卷积模型 [12, 23] 与注意力模型 [26, 87, 103],成为当前最优方法。值得注意的是,PTv3 并非纯 Transformer 架构:其67% 的参数都用于(残差)稀疏卷积层 。这些卷积层与 Transformer 式的注意力 + MLP 模块交替使用,并承担位置编码等功能。这种在类 U-Net 的编码器--解码器结构所有层级都同时使用卷积与注意力 的设计,是现代三维点云架构的常见做法,也自然引出一个关键问题:卷积与注意力各自究竟承担什么作用?

本文更细致地分析了这两种模块的贡献与交互关系。我们发现,在特征层级上存在清晰的分工:

-

网络早期、高分辨率阶段 以编码局部几何信息为主。卷积与注意力在此任务上表现相近,因为卷积的局部性是合适的归纳偏置;但在高分辨率、token 数量大的浅层,注意力计算代价极高。

-

网络后期、低分辨率阶段 开始出现语义与全局上下文。为捕捉长程依赖,表达能力更强的注意力机制更适用、也更省参数。

如前所述,在 PTv3 等架构中,稀疏卷积层主要用于编码位置信息。事实证明,对于这一任务,卷积是可行方案,但并非必需 。我们提出一种受 RoPE 启发的查询--键位置编码,命名为PointROPE ,它能更高效地完成位置编码 ,且不引入可学习参数 。综上,我们的分析得出一条明确的设计原则:聚焦局部几何时用卷积,推理语义与全局布局时用注意力。

##注释

RoPE(旋转位置编码)只对 Query 和 Key 做 "按位置旋转",让注意力分数自动包含相对位置信息,完全不用额外参数、不用训练。

Transformer 的自注意力 天生不知道位置:

-

只算 Q・K 点积,不知道谁在前、谁在后

-

必须加位置编码才能懂顺序 / 空间关系

传统位置编码:

-

加在 embedding 上,和注意力脱节

-

要么要参数,要么长序列不行

RoPE:

-

只动 Q 和 K,不动 embedding

-

无参数、天然支持相对位置、超长序列也稳

核心做法:

-

把每个点 / 每个词的特征算出 Q(查询)、K(键)

-

RoPE 给 Q 和 K 分别按位置旋转一个角度

-

位置不同 → 转的角度不同

-

旋转只和相对距离有关

-

-

再算 Q·K 点积得到注意力分数

→ 位置信息自动藏在注意力里

##注释

基于上述发现,我们设计了LitePT ------ 一种面向三维点云分析的混合网络架构,以最高效的方式利用计算单元:浅层用稀疏卷积,深层用带 PointROPE 的注意力 。通过让信息处理与抽象层级精准匹配,LitePT 的参数量仅为 PTv3 的1/3.6 。本架构将训练内存消耗降低60.3% 、推理内存降低51.2% ;训练延迟降低34.5% 、推理延迟降低58.8% 。更值得一提的是,在三维语义分割、三维实例分割、三维目标检测等多项基准上,LitePT 的性能均优于 PTv3。

相关工作

围绕 LitePT 的研究目标,本文回顾基于深度学习的点云表征方法,重点关注 Transformer 架构 与混合架构。

深度点云理解

为利用成熟的图像网络,早期方法将 3D 点云投影到 2D 平面,再用标准 2D CNN 提取特征。这类基于投影的方法仅在点密度均匀、覆盖充分、表面不透明等严格条件下表现良好。

基于体素的方法将不规则点云转为规则体素网格,再执行 3D 卷积。但体素表示计算与内存开销极大,促使后续研究提出高效稀疏卷积框架。

与投影或量化为规则网格不同,基于点的方法直接在原始点坐标上设计算子,能更好保留几何信息。点云算子从早期基于 MLP 的设计,逐步发展为点卷积、图网络,以及近年的注意力机制。在现代点云主干网络中,基于 Transformer 的架构已成为主流。

点云 Transformer

基于 Transformer 的架构以注意力机制为核心特征提取器。为缓解全局自注意力的平方复杂度,多数方法采用窗口注意力,将计算限制在局部空间邻域。

点云 Transformer 的主要差异在于如何构建局部注意力块以平衡性能与效率,常见策略包括:k 近邻搜索、窗口 / 体素划分、超点、空间填充曲线一维排序等。这类局部注意力常与移位分块、类 U-Net 层级结构结合,以聚合全局上下文。

现有工作通常在层级网络的所有阶段都使用注意力。本文认为:在 token 数量大、以局部模式为主的浅层网络中,注意力计算低效且无必要(详见 3.1、4.1 节)。

点云 Transformer 中的位置编码

注意力本身不感知空间布局,因此位置编码至关重要。

-

PTv1、PTv2 使用相对位置编码(RPE),用 MLP 编码点间相对位置。

-

Stratified Transformer、Swin3D 使用上下文相对位置编码(cRPE),为 x/y/z 轴维护三个可学习查表,计算效率低。

-

OctFormer、PTv3 使用条件位置编码(CPE),在每个注意力模块前加卷积层实现,效率提升但引入大量可学习参数。

本文将旋转位置编码(RoPE)适配到点云学习,提出无参数、高效且性能强劲的位置编码模块。

混合模型

卷积天生擅长提取局部特征,Transformer 则擅长建模长程依赖。自视觉 Transformer 提出以来,大量研究探索卷积与注意力结合以实现高效图像分析。

在 3D 点云领域,诸多工作研究融合二者优势的混合架构:

-

DyCo3D 在稀疏 U-Net 中加入瓶颈 Transformer 以捕获长程上下文。

-

Stratified Transformer 指出 KPConv 块比注意力提供更强的局部特征。

-

Superpoint Transformer 用轻量 PointNet 编码几何齐次超点。

-

PointConvFormer、KPConvX 在卷积核中加入注意力以提升特征建模。

-

ConDaFormer 在每个注意力模块前后各加一个稀疏卷积块,增强局部结构捕捉。

值得注意的是,PTv3 本质也是混合模型:其大量可学习参数用于充当位置编码的稀疏卷积。另一种常见范式是先用稀疏 U-Net 提取特征,再接任务专用的 Transformer 解码器。

与现有工作在所有层级重复使用统一混合块不同,本文从多尺度视角重新思考混合设计,将卷积与注意力解耦,在不同层级分别使用二者,以充分发挥互补优势。

方法

重新审视 PTv3:卷积与注意力的对比

预备知识

PTv3 [88] 是当前点云理解的最优架构。与早期点云主干网络 [12,59,87,103] 类似,它采用U-Net 架构,由多个带跳跃连接的编码器与解码器阶段构成。在相邻编码 / 解码阶段之间,使用池化 / 反池化对点云及其特征进行下采样 / 上采样。每个编码 / 解码阶段由若干块组成。

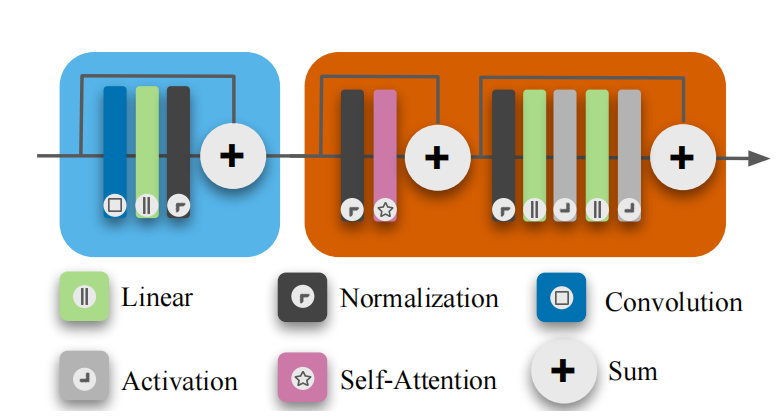

图 2 展示了 PTv3 的单个块,包含卷积位置编码模块 与注意力模块 。受 [13] 启发,PTv3 采用条件位置编码(CPE):在每个注意力模块前加入稀疏卷积、线性投影、LayerNorm 并搭配残差连接。注意力模块采用标准预归一化结构 [91]:先对经序列化排序得到的局部点组执行自注意力,再接多层感知机(MLP)。

图二

图2. PTv3模块。该模块由一个卷积条件位置编码模块和一个注意力模块组成。

##注释

LitePT 前 3 个阶段用的纯卷积块,结构:

输入 → 卷积(Convolution) → 线性层(Linear) → 归一化(Normalization) → 残差连接(Sum,把输入直接加回来)

设计逻辑是:

-

浅层高分辨率点云,用卷积就足够提取局部几何,不需要注意力,既快又省参数

-

没有多余的操作,只保留最核心的卷积 + 线性 + 归一化 + 残差

LitePT 后 2 个阶段用的注意力块,分成两部分:

-

第一部分:位置编码 + 注意力

输入 → 归一化(Normalization) → 自注意力(Self-Attention,带PointROPE位置编码) → 残差连接(Sum)

-

第二部分:MLP(多层感知机)

归一化(Normalization) → 线性层(Linear) → 激活函数(Activation) → 线性层(Linear) → 激活函数(Activation) → 残差连接(Sum)

设计逻辑是:

-

深层低分辨率点云,用注意力捕捉全局语义和上下文,不需要卷积

-

用 PointROPE 位置编码替代了原来 PTv3 里的卷积位置编码,完全无参数,更轻量

-

后面的 MLP 进一步提炼特征,增强模型表达能力

##注释

条件位置编码(尤其是稀疏卷积层)是架构的重要组成部分,但其确切作用仍不清晰 :它究竟只是编码流经注意力层的 token 空间布局,还是像传统卷积网络一样充当局部特征提取器?

下文我们沿 U-Net 层级分析不同组件的参数效率 与计算代价,揭示各阶段间的显著差异。

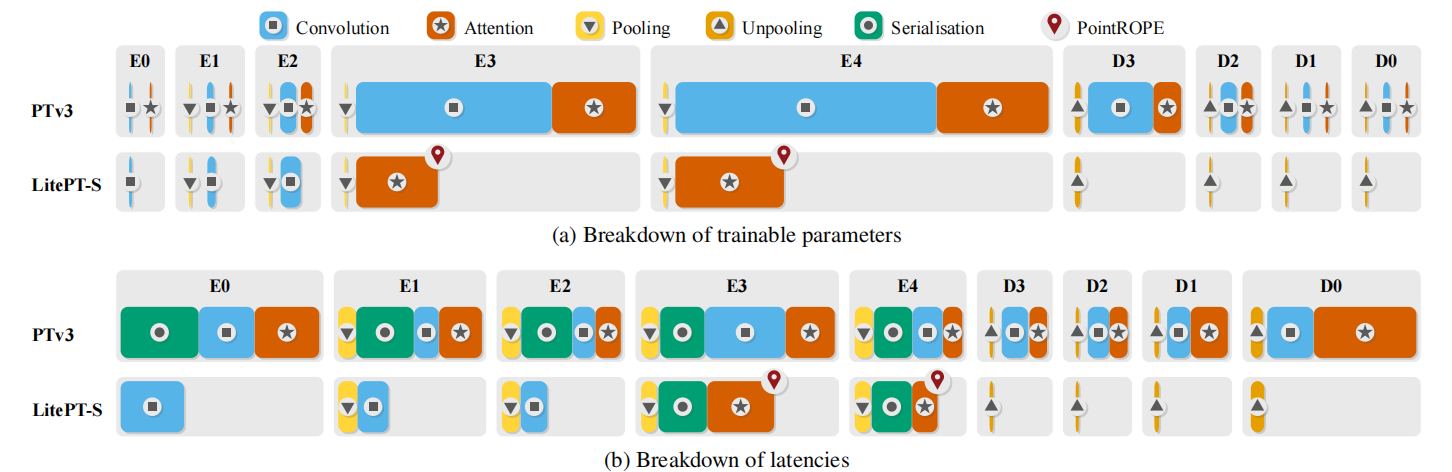

参数量

一个常被忽视却关键的事实:PTv3 中 67% 的参数 用于位置编码的稀疏卷积层,而 Transformer 部分(注意力 + MLP)仅占 30%。此外,稀疏卷积层的参数量随深度显著增加,在瓶颈附近达到最大,因为后期编码器与前期解码器的特征维度很高(见图 3a)。

图三

图3. 参数数量与延迟。E0-E4表示从浅层到深层的编码器阶段,D3-D0表示从深层到浅层的解码器阶段。每根柱状图的长度反映了对应模块的相对参数数量或延迟值。上图:在PTv3模型中,通过卷积块实现的位置编码占据了其大部分参数,尤其是在后期阶段。相比之下,我们的PointROPE模型完全无需参数。下图:PTv3的延迟图揭示了早期阶段注意力机制带来的显著成本。LitePT将注意力机制限制在后期阶段------该阶段注意力机制效果最佳且成本最低。

延迟

图 3b 展示了注意力与卷积在不同网络阶段的计算延迟。注意力因平方复杂度 占据主要计算开销。重要的是,随着网络深入到瓶颈阶段,该开销不断下降,因为层级下采样会平方级减少点 token 数量。

卷积 vs 注意力

目前已明确:卷积占大部分可学习参数 ,注意力占主要计算开销,且二者在 U-Net 各阶段差异巨大。

为分离两个模块的贡献,我们设计两种 PTv3 简化变体:

-

移除注意力模块 → 退化为传统稀疏 U-Net [12,23]

-

仅移除稀疏卷积层 → 得到 "纯 Transformer"

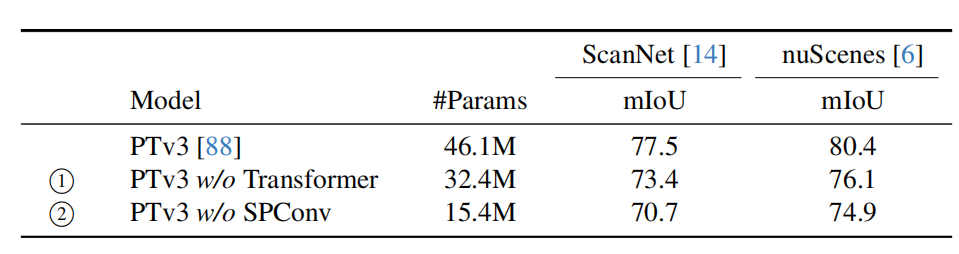

表 1 对比了两种变体在 ScanNet [14] 与 nuScenes [6] 上的语义分割性能。结果表明:移除卷积带来的性能下降比移除注意力更大,说明 "位置编码" 实际承担了大量核心工作。

表一

表1.重新审视PTv3。我们评估了两种PTv3变体:在1中,注意力模块和 MLP 模块被移除;在2中,仅稀疏卷积层被移除。

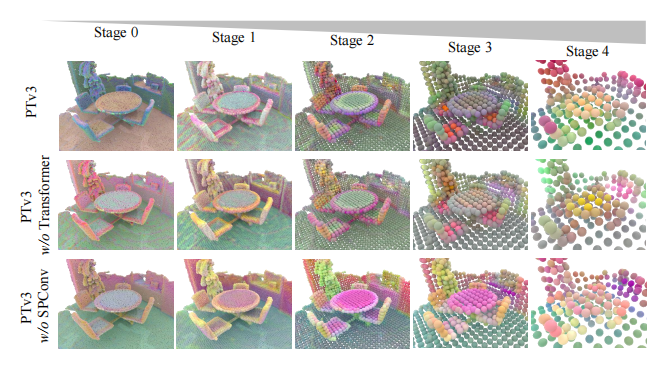

我们用 PCA 可视化三种变体在各编码阶段学到的嵌入(图 4),发现无论使用卷积、注意力还是二者并用,网络层级上都呈现明确分工:

-

早期阶段:主要编码局部几何

-

后期阶段:捕捉高层语义

图四

图4. 层次式U-Net编码器学习到的表征。该编码器具有与运算符无关的特征层级结构:浅层阶段持续编码局部几何结构,而语义信息则在更深的阶段显现。

讨论

上述分析引出以下假设:

-

不必在每个阶段都同时用卷积和注意力。早期以局部特征提取为主,卷积足够;深层关注长程上下文与语义概念,注意力是关键。

-

若能在浅层避开昂贵的注意力 、在深层避开导致参数量膨胀的卷积,将实现效率最优。

-

纯注意力块需要替代型位置编码 ;但卷积的核心功能显然不只是存储空间布局,因此存在更省参数的替换方案。

适配不同网络阶段的定制块

基于上述研究结论,我们提出一种简洁高效的设计:每个阶段只保留核心操作。

-

早期阶段(高空间分辨率、低通道数):使用卷积

-

深层阶段(token 少、高维特征):使用注意力

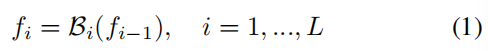

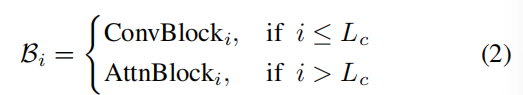

形式化表示如下:

设层级编码器包含 L 个阶段,第 i 个阶段通过函数 B_i (・) 将特征 f_{i−1} 转为 f_i:

根据阶段序号,每个块 B_i 为纯卷积或纯注意力:

早期阶段(i ≤ L_c) 处理高分辨率、高密度点集,局部几何推理至关重要。卷积能以极低参数开销高效聚合局部感受野信息。

进入深层阶段(i > L_c) ,点 token 数量大幅减少,语义抽象更重要,因此切换为注意力块。

可选地,可设置一个过渡阶段同时包含卷积与注意力(见 4.1 节消融实验)。两种机制间更平滑的过渡理论上可行,但会不必要地复杂化设计。

LitePT 与 PTv3 及其他混合点云 Transformer 的设计理念完全不同:

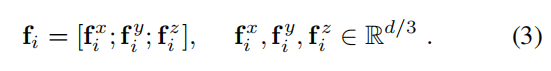

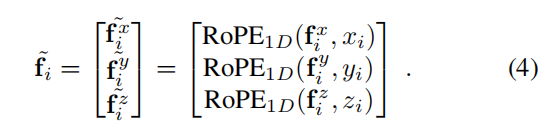

20,76,86\] 等方法在所有阶段**重复相同的混合块**,因此必须同时包含注意力与卷积。 与之相反,我们尽可能**简化单个块** ,并根据网络阶段采用不同简化形式。实验表明:沿层级**策略性分配定制块**可在显著降低内存与计算开销的同时提升性能。 #### 点旋转位置编码(PointROPE) 在深层移除昂贵卷积层会带来副作用:**丢失位置编码** 。因此需要一种**更省参数**的替代方案。 旋转位置编码(RoPE)\[71\] 在自然语言处理中极为有效。它通过**特征空间旋转** 为注意力机制引入相对位置感知。该方法最初为**一维序列**设计,无法直接推广到三维空间中的不规则点云。 我们将 RoPE 直接扩展到三维,得到 **PointROPE(点旋转位置编码)**。 给定位置 p_i=(x_i,y_i,z_i) 处的点特征向量 f_i ∈ R\^d,将嵌入维度 d 均分为对应 x、y、z 轴的三个子空间:  然后对每个子空间**独立应用一维 RoPE**,再拼接得到最终点表示:  坐标 (x_i,y_i,z_i) 直接使用网格坐标,已在池化阶段完成正确缩放。 该编码方案**保留三维点的方向可分性**,同时编码特征的位置相位旋转,有效捕捉相对几何关系。 与 PTv3 中可学习的卷积位置编码相比: * PointROPE **无参数** * **轻量** * **天然支持旋转** 我们在开源代码中提供了**优化的 CUDA 实现**。 #### 整体架构 模型采用经典 **U-Net 结构**,共 5 个阶段。我们构建三种编码器变体,各阶段通道数 C 与块数 B 不同。 注意:使用 PointROPE 的阶段,通道数 C 必须能被 6 整除。 * LitePT-S:C=(36,72,144,252,504),B=(2,2,2,6,2) * LitePT-B:C=(54,108,216,432,576),B=(3,3,3,12,3) * LitePT-L:C=(72,144,288,576,864),B=(3,3,3,12,3) 实验以 **LitePT-S** 为主,它在所有基准上已达到优异效果。模型缩放性见表 5。 默认设置 **L_c=3**,即阶段 1、2、3 用卷积块,阶段 4、5 用注意力块。 * 每个 ConvBlock_i:稀疏卷积 + 线性 + LayerNorm + 残差连接 * 每个 AttnBlock_i:PointROPE + 局部注意力(采用与 PTv3 相同的序列化分组) ##### **解码器设计** * 语义分割:解码器极简设计,每阶段仅含线性投影 + LayerNorm * 实例分割:解码器采用与编码器对称的阶段专属设计,反向分配卷积块与注意力块