你知道吗?在学习大语言模型的时候,小编发现一件很有趣的事情:大语言模型输入的是自然语言(也就是我们前面所说的"代码"),它输出的也是自然语言(同样是"代码")。这种输出可以继续作为后续的输入。

如果大语言模型输出的"代码"比输入的"代码"更加完善,那么从某种角度来看,大语言模型就能够进行"自我迭代"。这里的自我迭代是指不断迭代优化和完善它的输出,直到达到一个令人满意的效果。

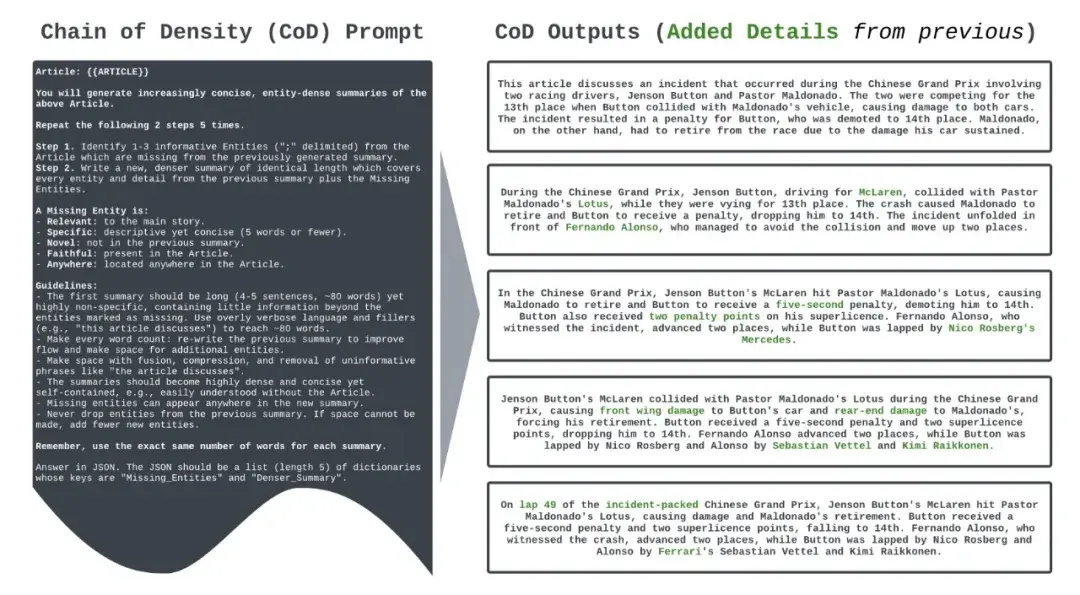

实际上,2023年9月发表的一篇论文《From Sparse to Dense: GPT-4 Summarization with Chain of Density Prompting》就是采用了这种思路。该论文利用GPT-4不断对自己的输出进行迭代优化,最终实现了一个非常好的总结文档的效果。

上图是CoD的提示模板以及对应的例子。