仓库地址: https://github.com/rtk-ai/rtk

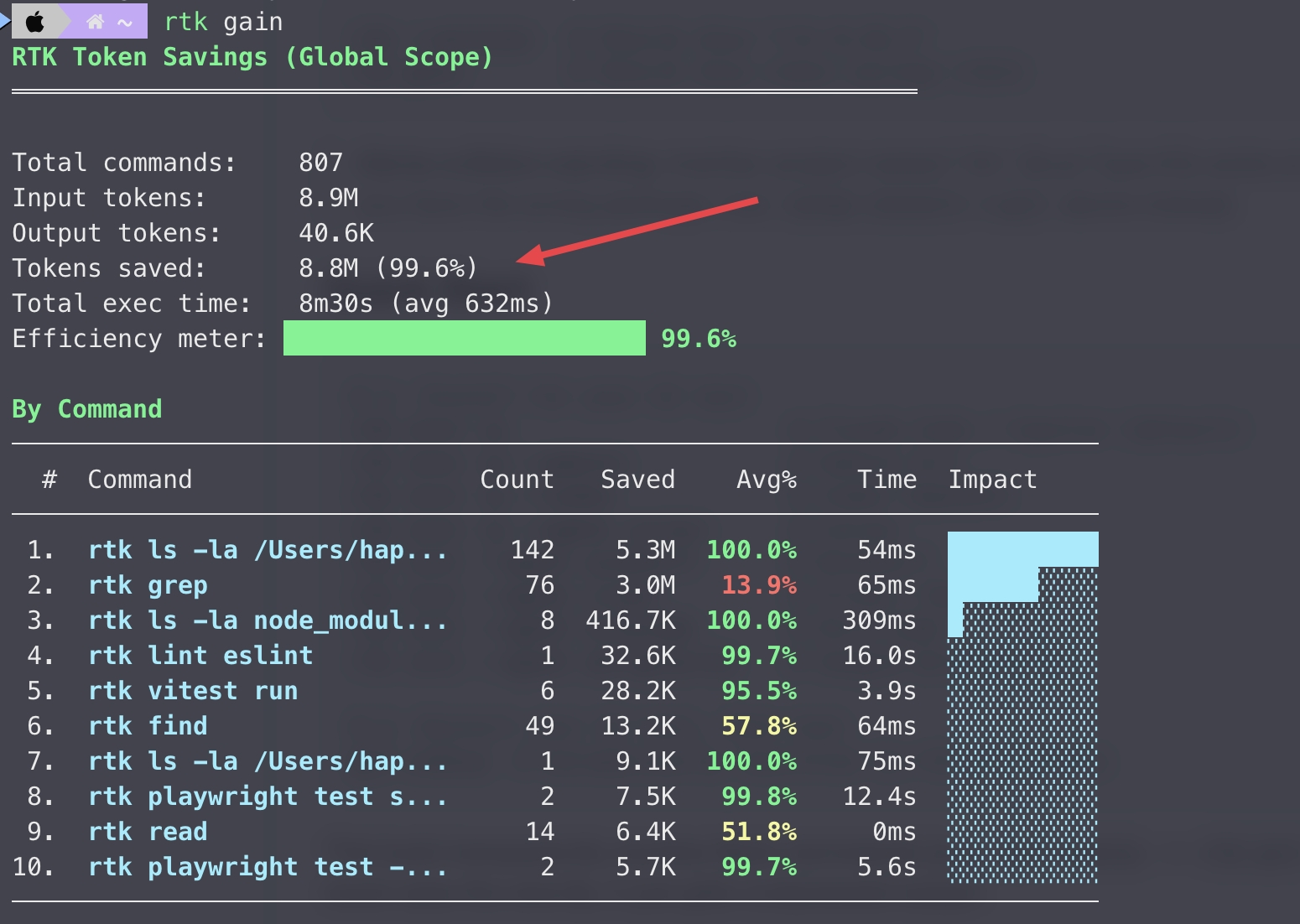

这个仓库是 rtk (Rust Token Killer),是一款由 Rust 开发的高性能 CLI 代理工具,核心目标是大幅降低大语言模型(LLM)使用过程中的 Token 消耗,官方数据显示可实现 60%-90% 的 Token 节省,且仅带来 <10ms 的性能开销。

核心功能

rtk 会在命令行输出传递到 LLM 上下文之前,对输出内容进行过滤和压缩处理。它支持 100+ 种常见命令,覆盖开发场景中高频操作,比如:

- 文件/目录操作:

ls/tree/cat - 文本检索:

grep/rg - Git 操作:

git status/diff/log/commit等 - 测试/校验:

cargo test/npm test/pytest/ruff check/go test - 容器操作:

docker ps

通过针对性的压缩/过滤逻辑,不同命令的 Token 消耗可降低 70%-92% 不等(30 分钟 Claude 代码会话场景下,整体 Token 消耗从 ~118,000 降至 ~23,900,节省 80%)。

技术特性

- 轻量化:单 Rust 二进制文件,无额外依赖,跨平台兼容;

- 低开销:处理延迟 <10ms,几乎不影响命令行使用体验;

- 易集成:无需修改原有命令使用习惯,通过代理层自动处理输出。

安装方式

支持多种主流安装途径,适配不同系统:

- Homebrew(推荐,macOS/Linux) :

brew install rtk; - 快速安装(Linux/macOS) :通过官方脚本一键安装

curl -fsSL https://raw.githubusercontent.com/rtk-ai/rtk/refs/heads/master/install.sh | sh; - Cargo 安装 :

cargo install --git https://github.com/rtk-ai/rtk(需注意避免与 crates.io 上同名的 "Rust Type Kit" 冲突); - 预编译二进制包:支持 macOS(x86_64/aarch64)、Linux(x86_64/aarch64)、Windows(x86_64),可从 Releases 页面下载。

多语言支持

仓库提供多语言文档,包括英文、中文、法语、日语、韩语、西班牙语,降低不同地区用户的使用门槛。

适用场景

尤其适合开发者在与 LLM(如 Claude、GPT 等)交互时,减少因粘贴命令行输出产生的高额 Token 消耗,降低使用成本,同时保持上下文信息的有效性。

生态与支持

- 提供详细的文档(架构、故障排除、使用指南);

- 维护 Discord 社区,方便用户交流问题;

- 持续迭代更新,有完善的 CI 流程和安全检查。

总结来说,rtk 是面向开发者的 LLM 成本优化工具,通过轻量化的命令行输出处理,在不影响开发体验的前提下,显著降低 LLM 交互的 Token 开销。