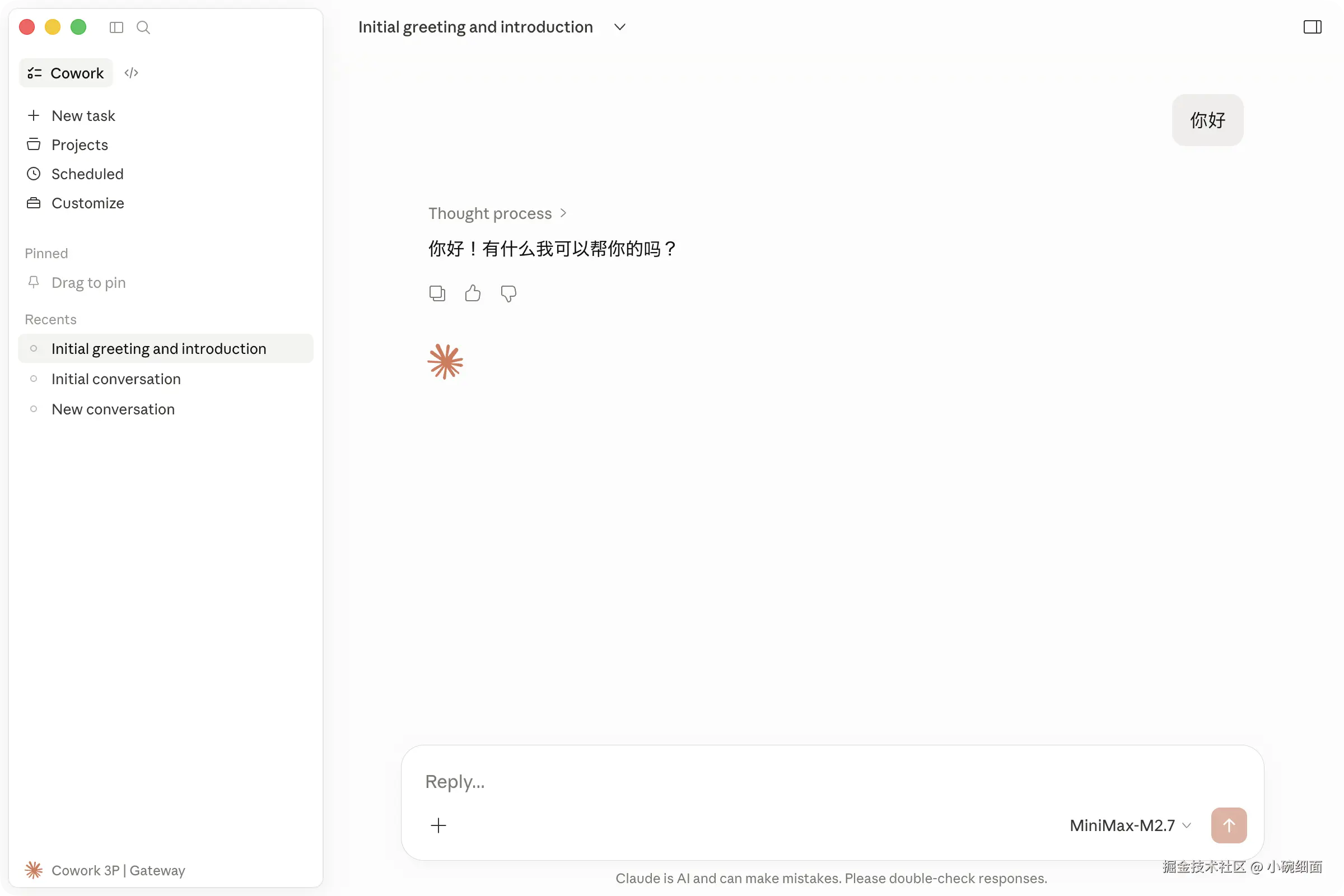

Claude 桌面端开启开发者模式,并配置第三方模型完整教程

适用时间:2026-04-29

适用对象:想在 Claude Desktop 中开启 Developer 菜单,并把 Claude Cowork / Code 的推理请求路由到 Vertex AI、Amazon Bedrock、Microsoft Foundry 或自建 LLM Gateway 的用户。

说明:本文截图位置已预留,你可以后续补图。

很多人第一次配置 Claude Desktop 的"第三方模型"时,会卡在两个地方:

第一,不知道 Developer 菜单在哪里。

第二,把 MCP 配置、Claude Code 配置、第三方推理配置混在一起。

这篇文章把流程拆开讲清楚:

- 如何开启 Claude Desktop 的开发者模式。

- 如何进入第三方推理配置入口。

- 如何配置 Gateway、Bedrock、Vertex AI、Foundry。

- 如何验证是否真的进入 3P 模式。

- 常见报错怎么排查。

先说结论:第三方模型配置不是普通 Chat 页面的模型切换,也不是 MCP Server 配置。它对应的是 Claude Cowork on 3P,也就是让 Claude Desktop 的 Cowork / Code 能力走你配置的第三方推理后端。

一、先弄清楚:这里的"第三方模型"到底是什么

Anthropic 官方把这套能力叫做 Cowork on third-party platforms,也就是 Cowork on 3P。

它的作用是:

- Claude Desktop 仍然提供 Cowork 和 Code 这类桌面端能力;

- 但模型推理不走 Anthropic 默认接口;

- 而是走你配置的 Google Vertex AI、Amazon Bedrock、Microsoft Foundry,或者你自己的 LLM Gateway;

- 会话历史存储在用户本机;

- 推理费用由你配置的云厂商或网关侧承担。

官方文档里也明确写到,Cowork on 3P 是 Claude Desktop 的一种部署模式,会把推理路由到你配置的 provider。支持的后端包括 Vertex AI、Bedrock、Foundry 或兼容的 gateway。

这里要特别注意两点:

第一,这不等于让普通 Claude Chat 随便切换成任意第三方大模型 。

如果你要接入自建网关,网关需要兼容 Anthropic Messages API,至少要支持 POST /v1/messages、流式输出和工具调用。

第二,它也不是 MCP 配置 。

MCP 是给 Claude 增加工具和数据源;3P 推理配置是换掉模型推理后端。两者可以同时存在,但配置文件和排查思路不一样。

二、准备工作

开始前,你需要准备这些东西。

1. Claude Desktop

安装最新版 Claude Desktop。

macOS 要求 macOS 13 Ventura 或更高版本。Windows 需要 Windows 10 或 Windows 11,并且 Windows 侧还需要启用 Virtual Machine Platform。

2. 一个第三方推理后端

你需要四选一:

| 后端 | 适合场景 | 需要准备 |

|---|---|---|

| LLM Gateway | 自建代理、LiteLLM、Portkey、企业内部网关 | Gateway HTTPS 地址、API Key、认证方式 |

| Amazon Bedrock | AWS 企业环境 | Region、Bearer Token 或 AWS Profile、模型 ID |

| Google Vertex AI | GCP 企业环境 | Project ID、Region、凭据文件或 OAuth、模型 ID |

| Microsoft Foundry | Azure / Foundry 环境 | Foundry Resource、API Key、部署名称 |

如果只是个人测试,最容易理解的是 Gateway 模式:你准备一个兼容 Anthropic Messages API 的 HTTPS 网关,然后把 Claude Desktop 指向它。

3. 模型 ID

模型列表里的值要使用 provider 侧的精确模型 ID 或部署名称。

比如:

- Vertex AI 使用 publisher model ID;

- Bedrock 使用 inference profile ID;

- Foundry 使用模型部署名称;

- Gateway 使用网关

/v1/models返回的模型 ID。

如果你要展示多个模型,列表里第一个就是默认模型。

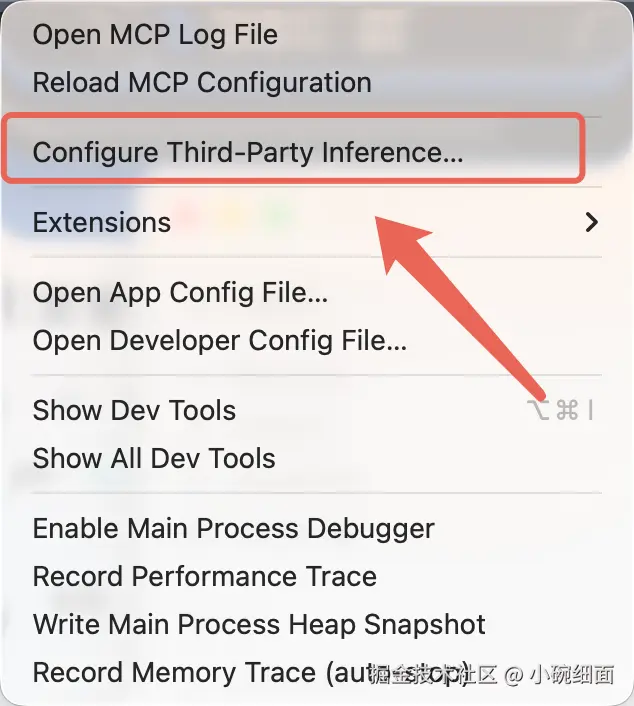

三、开启 Claude Desktop 开发者模式

打开 Claude Desktop,不需要先登录。

在菜单栏中依次进入:

text

Help → Troubleshooting → Enable Developer Mode开启后,菜单栏会出现一个新的 Developer 菜单。

如果你看不到 Developer 菜单,先完全退出 Claude Desktop,再重新打开一次。macOS 上建议用:

text

Claude Desktop → Quit Claude不要只关闭窗口。

四、进入第三方推理配置界面

开发者模式开启后,在菜单栏进入:

text

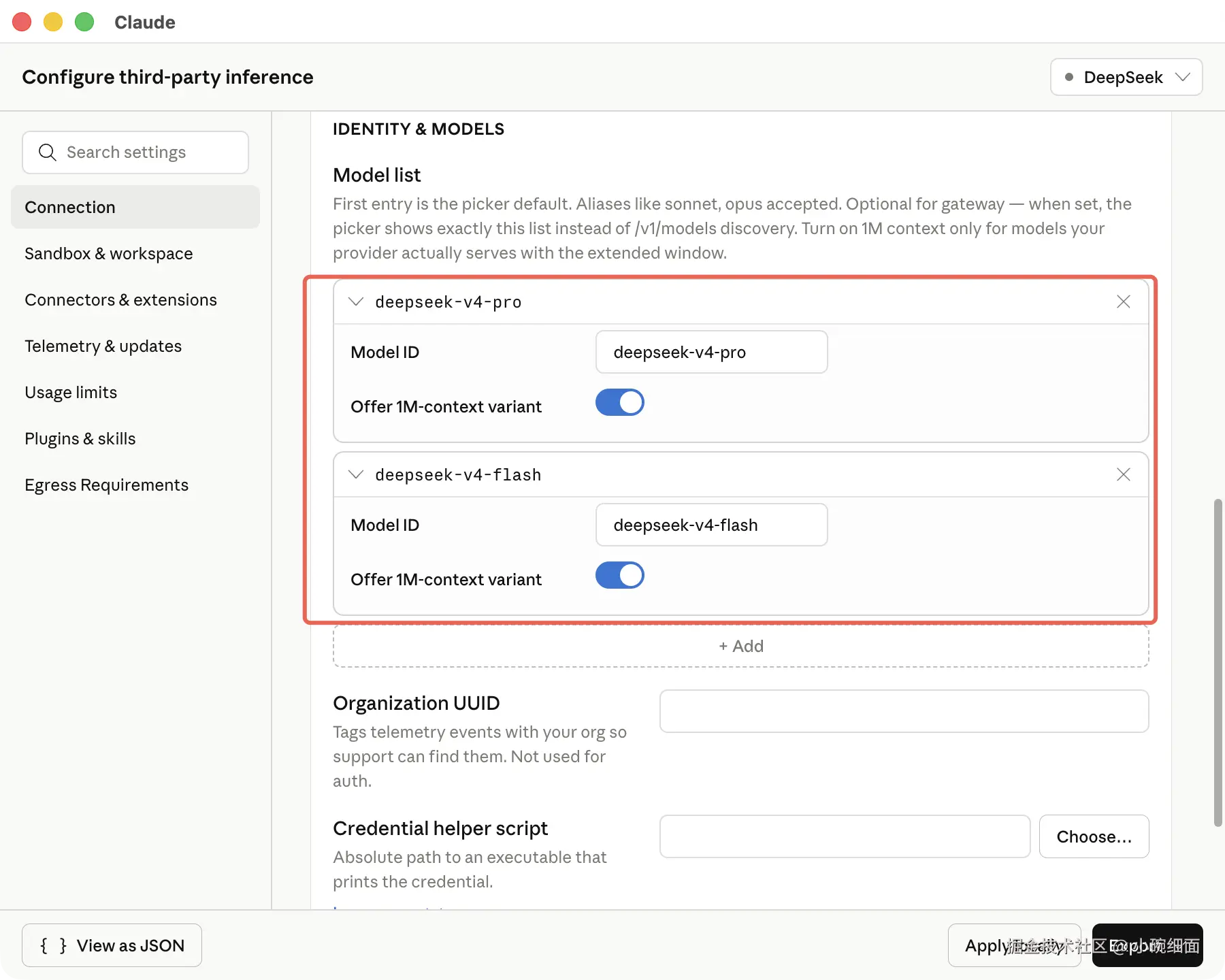

Developer → Configure third-party inference这里会打开第三方推理配置界面。官方推荐用这个 UI 来配置,因为它会校验字段,并能导出 macOS 的 .mobileconfig 或 Windows 的 .reg 配置。

这一步是整篇文章最关键的入口。

如果你只是配置 MCP Server,不应该走这里。MCP 通常走 Settings / Developer / Connectors 相关入口,或者编辑普通 Claude Desktop 的 claude_desktop_config.json。

如果你是配置 3P 推理,就走 Configure third-party inference。

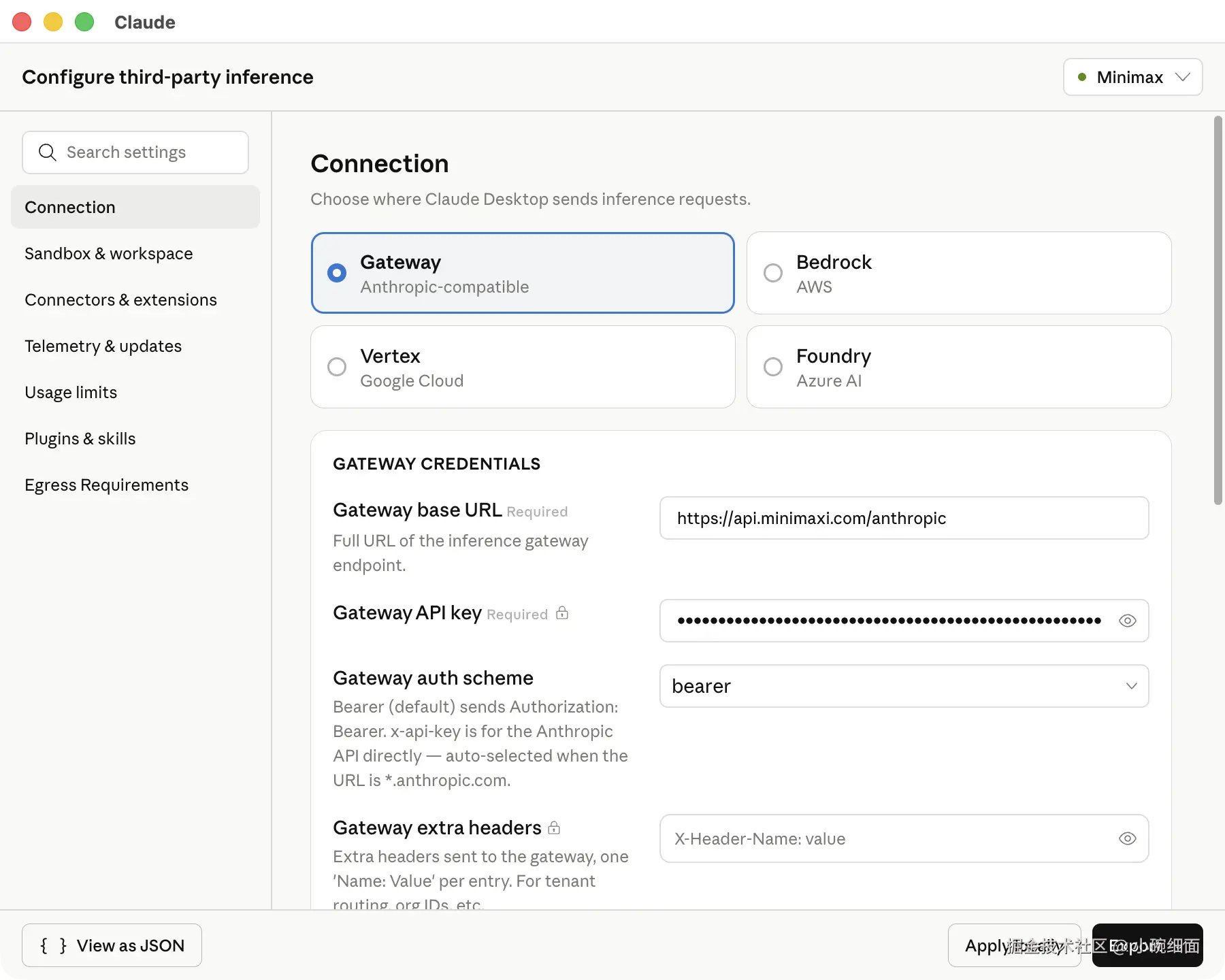

五、配置方式一:LLM Gateway

Gateway 模式适合这些情况:

- 公司内部已有统一 LLM 网关;

- 你用 LiteLLM、Portkey 或自建代理;

- 你希望在网关后面再路由到不同模型服务;

- 你想统一做审计、限流、成本统计。

在配置界面选择:

text

Inference Provider: gateway然后填写:

| 字段 | 说明 |

|---|---|

inferenceGatewayBaseUrl |

Gateway 基础 URL,必须是 https:// |

inferenceGatewayApiKey |

Gateway API Key |

inferenceGatewayAuthScheme |

认证方式,可选 auto、x-api-key、bearer |

inferenceGatewayHeaders |

可选,额外请求头,JSON 数组字符串 |

inferenceModels |

可选;如果网关没有 /v1/models 或模型未正确发现,就手动填写 |

Gateway 必须至少支持:

text

POST /v1/messages并支持:

- streaming;

- tool use;

- 你在 Claude Desktop 中要用到的模型 ID。

如果网关支持:

text

GET /v1/modelsClaude Desktop 可以自动发现模型。否则就需要手动设置 inferenceModels。

手写配置时,可以参考这个结构:

json

{

"enterpriseConfig": {

"inferenceProvider": "gateway",

"inferenceGatewayBaseUrl": "https://llm-gateway.example.com",

"inferenceGatewayApiKey": "sk-your-gateway-key",

"inferenceGatewayAuthScheme": "auto",

"inferenceModels": "[\"claude-sonnet-4-6\", \"claude-opus-4-7\"]",

"deploymentOrganizationUuid": "11111111-1111-4111-8111-111111111111"

}

}注意:inferenceModels 在托管配置里是 JSON 字符串,不是原生数组。很多配置失败都出在这里。

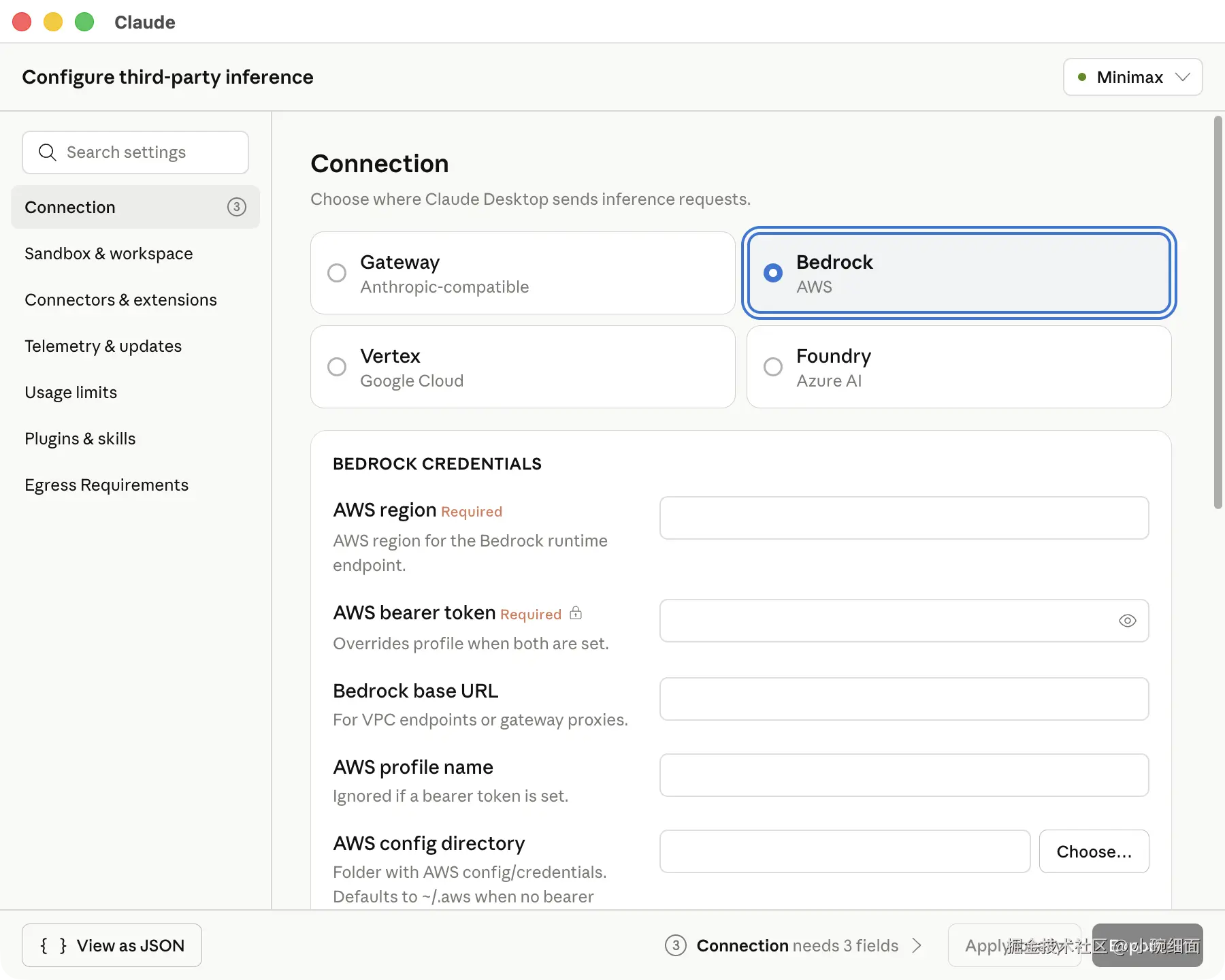

六、配置方式二:Amazon Bedrock

如果你的公司主要用 AWS,Bedrock 是更常见的企业选择。

在配置界面选择:

text

Inference Provider: bedrock常用字段:

| 字段 | 说明 |

|---|---|

inferenceBedrockRegion |

AWS Region,例如 us-west-2 |

inferenceBedrockBearerToken |

Bedrock API Key / Bearer Token |

inferenceBedrockProfile |

AWS Profile 名称,适合用 AWS CLI、SSO 或企业凭据流程 |

inferenceBedrockAwsDir |

如果不用默认 ~/.aws,填写 AWS config / credentials 目录的绝对路径 |

inferenceBedrockBaseUrl |

可选,私有 VPC endpoint 或代理地址 |

inferenceModels |

必填,Bedrock inference profile ID 列表 |

Bedrock 认证有两类:

- 使用 Bearer Token;

- 使用 AWS Profile。

如果用 Bearer Token,底层 IAM Principal 需要有对应调用权限。

如果用 AWS Profile,一般需要能调用 bedrock:InvokeModel 和 bedrock:InvokeModelWithResponseStream。

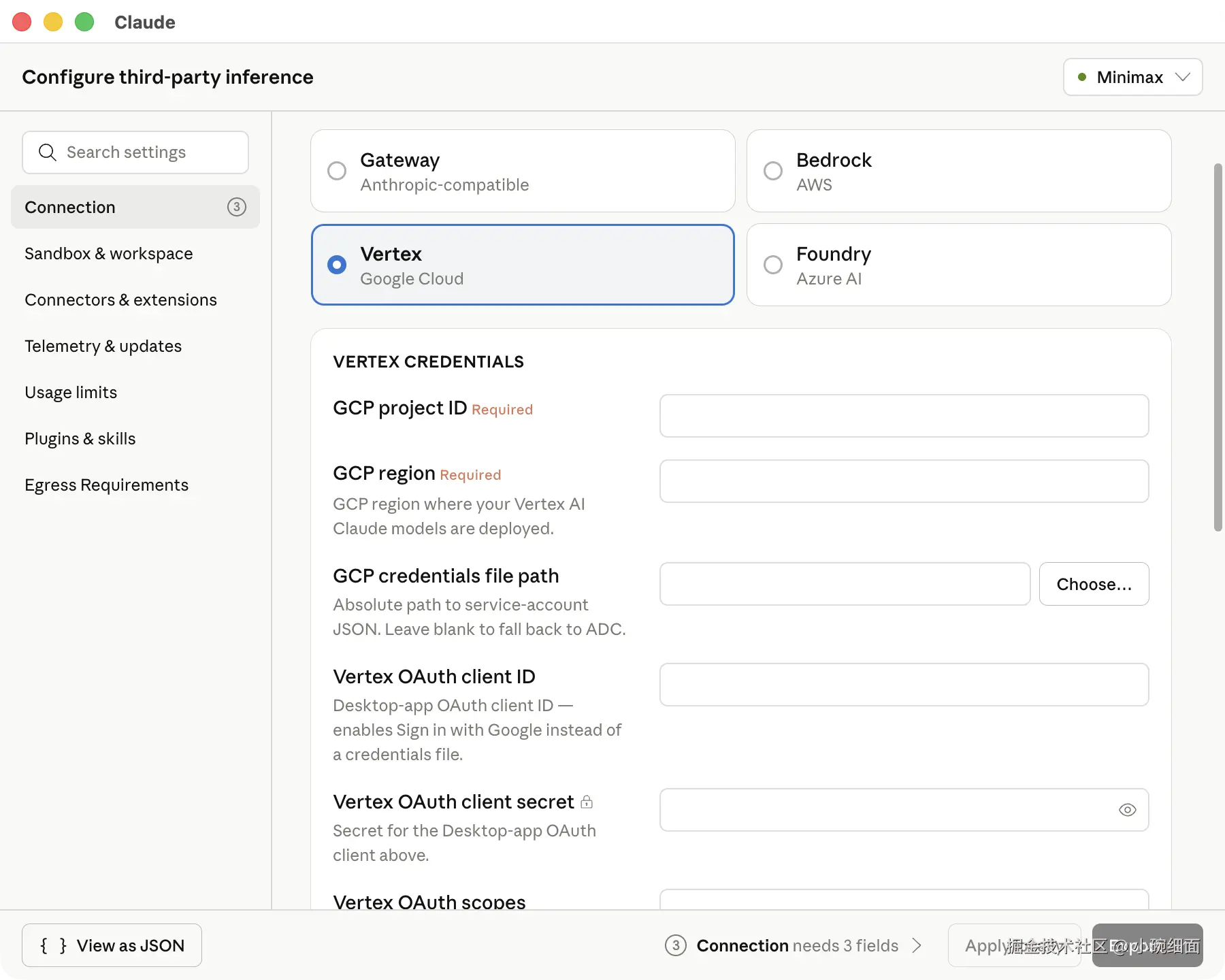

七、配置方式三:Google Vertex AI

如果你在 GCP 上使用 Claude 模型,可以选 Vertex AI。

在配置界面选择:

text

Inference Provider: vertex常用字段:

| 字段 | 说明 |

|---|---|

inferenceVertexProjectId |

GCP Project ID |

inferenceVertexRegion |

GCP Region,例如 us-east5、europe-west4 |

inferenceVertexCredentialsFile |

服务账号 JSON 或 ADC 文件的绝对路径 |

inferenceVertexOAuthClientId |

可选,交互式 Google 登录用 |

inferenceVertexOAuthClientSecret |

可选,OAuth Client Secret |

inferenceVertexBaseUrl |

可选,私有服务连接或自定义 endpoint |

inferenceModels |

必填,Vertex 侧模型 ID 列表 |

这里最容易错的是凭据路径。

不要写:

text

~/keys/vertex-sa.json要写完整绝对路径:

text

/Users/yourname/keys/vertex-sa.json官方文档明确提醒,凭据文件路径不做 ~ 或环境变量展开。

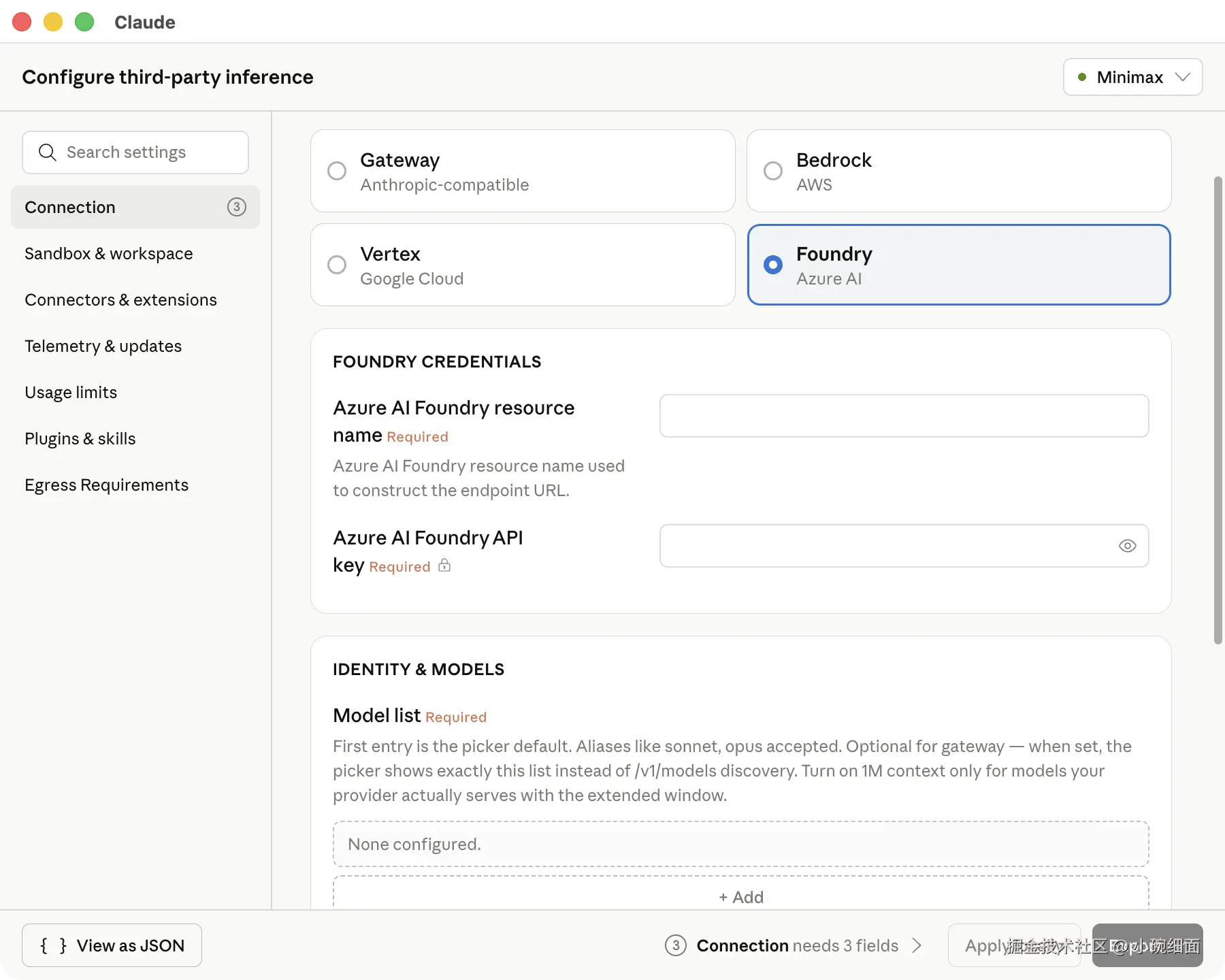

八、配置方式四:Microsoft Foundry

如果你的企业环境在 Azure / Microsoft Foundry,可以选择 Foundry。

在配置界面选择:

text

Inference Provider: foundry常用字段:

| 字段 | 说明 |

|---|---|

inferenceFoundryResource |

Foundry resource name |

inferenceFoundryApiKey |

Foundry API Key |

inferenceModels |

必填,Foundry 中的模型部署名称列表 |

Foundry 的模型列表通常不是通用模型名,而是你在 Foundry 里创建的 deployment name。

九、设置模型列表和默认模型

无论你使用哪个 provider,都要理解 inferenceModels。

它决定了 Claude Desktop 模型选择器里出现哪些模型。

示例:

json

"inferenceModels": "[\"claude-sonnet-4-6\", \"claude-opus-4-7\"]"第一个模型会作为默认模型。

如果你的 provider 支持 1M token 上下文,可以用对象形式声明:

json

"inferenceModels": "[{\"name\":\"claude-opus-4-7\",\"supports1m\":true},\"claude-sonnet-4-6\"]"但要谨慎。supports1m 是你对部署能力的声明,Claude Desktop 不会自动帮你验证。如果模型实际上不支持 1M,上下文变长后会在会话中途失败。

十、应用配置并重启 Claude Desktop

配置完成后,根据界面提示:

- 单机测试:优先选择本地应用配置;

- 企业分发:导出

.mobileconfig或.reg,再通过 MDM、Intune、Group Policy 等方式下发。

然后完全退出 Claude Desktop,再重新打开。

配置被读取的时机是在应用启动时。只改配置但不重启,通常不会生效。

重启后,你应该能看到类似入口:

text

Start in Cowork on 3P或看到通过 Gateway / provider 登录的选项。

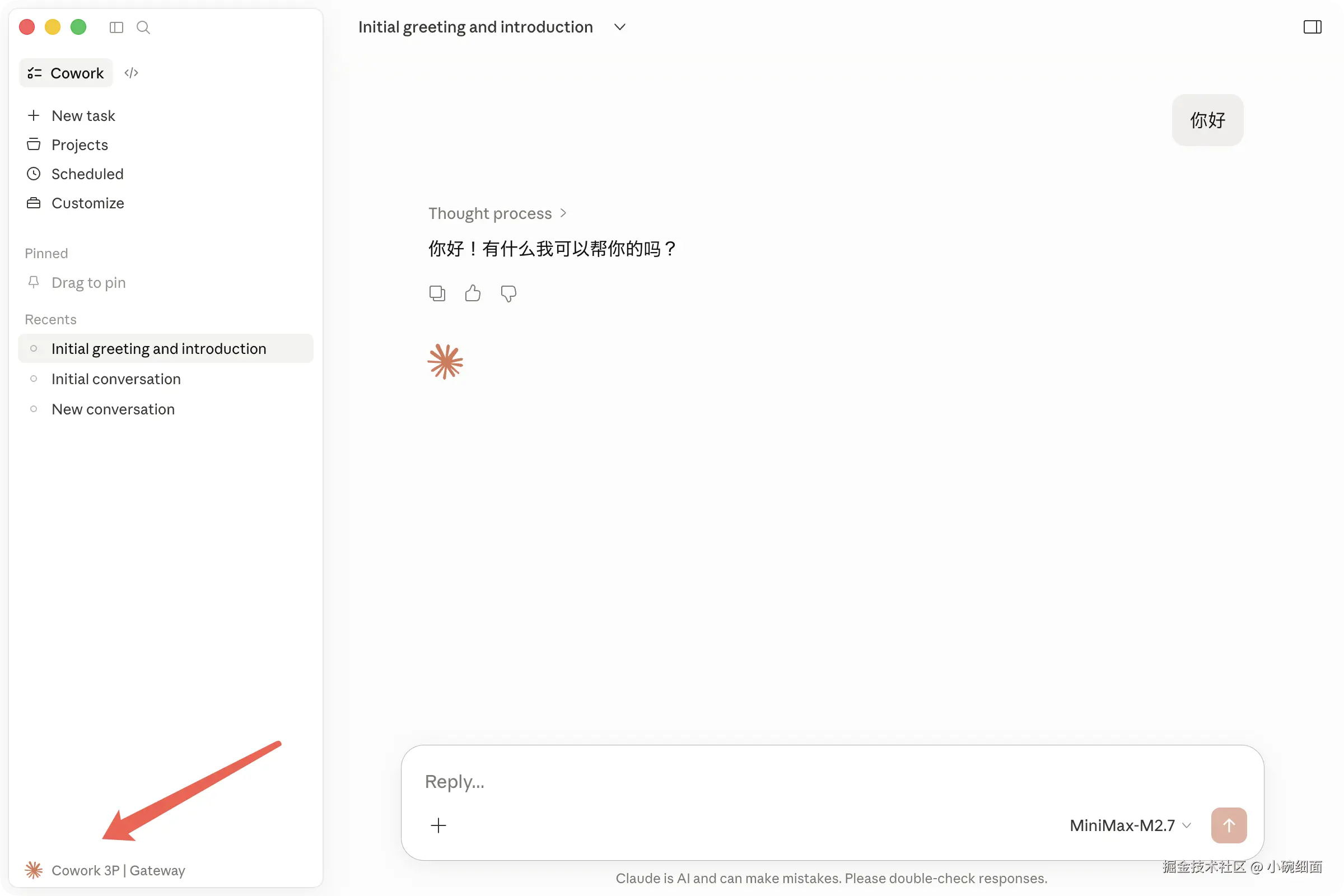

如果配置成功,Claude Desktop 的左侧通常会出现:

- Cowork;

- Code。

在这个 3P 部署模式下,官方说明普通 Chat tab 不可用。

十一、配置文件路径:不要写错地方

这里很容易混。

1. Claude Desktop 普通 MCP 配置

普通 Claude Desktop 的 MCP 配置通常在:

macOS:

text

~/Library/Application Support/Claude/claude_desktop_config.jsonWindows:

text

%APPDATA%\Claude\claude_desktop_config.json这个文件常用于 mcpServers。

例如把 Claude Code 当成 MCP Server 暴露给 Claude Desktop:

json

{

"mcpServers": {

"claude-code": {

"type": "stdio",

"command": "claude",

"args": ["mcp", "serve"],

"env": {}

}

}

}如果 claude 不在 PATH 里,就要写完整路径。否则会遇到 spawn claude ENOENT。

2. Claude Cowork on 3P 本地配置

3P 本地配置位置是另一套。

macOS:

text

~/Library/Application Support/Claude-3p/claude_desktop_config.jsonWindows:

text

%LOCALAPPDATA%\Claude-3p\claude_desktop_config.json配置内容放在 enterpriseConfig 里。

企业托管配置优先级更高。如果机器上存在 MDM / Registry Policy 配置,本地写入的值可能会被忽略。

3. Claude Code Desktop 配置

Claude Desktop 的 Code tab 和 Claude Code CLI 共享一部分配置,例如:

~/.claude.json~/.claude/settings.json- 项目中的

.mcp.json - 项目里的

CLAUDE.md

但官方也说明,Claude Desktop Chat app 里通过 claude_desktop_config.json 配置的 MCP Server,不会自动出现在 Code tab 里。Code tab 要用 ~/.claude.json 或项目 .mcp.json 配置。

一句话总结:

| 你要配置什么 | 常见位置 |

|---|---|

| 普通 Claude Desktop MCP | ~/Library/Application Support/Claude/claude_desktop_config.json |

| Claude Cowork on 3P 推理 | ~/Library/Application Support/Claude-3p/claude_desktop_config.json |

| Claude Code / Code tab MCP | ~/.claude.json 或项目 .mcp.json |

十二、常见问题排查

1. 没有 Developer 菜单

检查是否真的点了:

text

Help → Troubleshooting → Enable Developer Mode然后完全退出并重启 Claude Desktop。

2. 还是进入普通 Claude 模式

重点检查:

inferenceProvider是否设置;- provider 必填凭据是否完整;

- base URL 是否是

https://; - 本地配置是否被 MDM 托管配置覆盖;

- 修改配置后是否完全重启。

官方文档提到,只有 inferenceProvider 和所选 provider 的凭据有效时,3P 模式才会激活。否则应用会回到标准模式。

3. 模型列表不显示

检查:

- Gateway 是否实现了

GET /v1/models; - 如果没实现,是否手动设置了

inferenceModels; - 模型 ID 是否和 provider 返回值完全一致;

inferenceModels是否写成了 JSON 字符串。

错误示例:

json

"inferenceModels": ["claude-sonnet-4-6"]在托管配置里,这通常不对。

更稳的写法:

json

"inferenceModels": "[\"claude-sonnet-4-6\"]"4. Gateway 返回 401 或 403

检查:

- API Key 是否正确;

inferenceGatewayAuthScheme是否和网关要求一致;- 网关需要

Authorization: Bearer还是x-api-key; - 是否还需要额外 header;

- 企业代理或网关是否拦截了 streaming。

5. Vertex 凭据文件找不到

不要使用 ~。

写绝对路径。

同时检查 Claude Desktop 是否有权限读取该文件。

6. Bedrock 能连上但无法调用模型

检查:

- Region 是否和模型所在 region 一致;

- Bearer Token 或 AWS Profile 是否有效;

- IAM 权限是否包含模型调用;

inferenceModels是否使用了正确的 inference profile ID。

7. MCP 配置后 Code tab 里看不到

这是正常现象。

普通 Claude Desktop 的 claude_desktop_config.json 和 Claude Code / Code tab 使用的 MCP 配置不是同一套。Code tab 要配置 ~/.claude.json 或项目 .mcp.json。

十三、安全建议

第三方推理配置通常会接触企业凭据,建议至少做到这几件事:

- 不要把 API Key 写进公开仓库。

- 企业环境优先使用 MDM、Registry Policy 或凭据 helper。

- Gateway 模式必须使用 HTTPS。

- 明确数据会流向哪个 provider。

- 对 Bedrock、Vertex、Gateway 的日志留存策略做一次审计。

- 如果要限制 Cowork 访问本地文件,配置

allowedWorkspaceFolders。 - 如果要限制沙箱访问外网,配置

coworkEgressAllowedHosts。

需要注意,官方对"对话内容不发送到 Anthropic"的说明,主要适用于 Vertex AI、Bedrock,以及不把请求路由到 Anthropic 基础设施的 Gateway。Foundry 当前有自己的预览期说明,合规边界要以 Microsoft / Anthropic 当前文档和企业协议为准。

十四、最小可用流程复盘

如果你只想跑通一次,可以按这个最小流程:

- 安装最新版 Claude Desktop。

- 打开

Help → Troubleshooting → Enable Developer Mode。 - 进入

Developer → Configure third-party inference。 - 选择

gateway、bedrock、vertex或foundry。 - 填写 provider 必填字段。

- 设置模型列表,确认第一个模型是默认模型。

- 应用配置并完全重启 Claude Desktop。

- 在启动页选择

Start in Cowork on 3P。 - 进入 Cowork / Code 后,用模型下拉框确认模型是否出现。

- 发一条简单请求测试,例如"用一句话介绍当前模型来源"。