本文介绍两篇结合卷积神经网络(CNN)进行时间序列(Time Series) 分析的前沿工作。面对数据缺失和池化操作导致时间位置信息丢失的挑战,两项研究均通过创新特征传输路由来打破瓶颈。

第一篇论文聚焦多变量时间序列(Multivariate Time Series) 插补,通过CNN通道与注意力头的严格绑定,隔离了缺失数据的噪声传播;第二篇论文针对时间序列分类,设计了一种多尺度路由算子,将时间位置转化为通道结构,优化了模型的归纳偏置(Inductive Bias) 。两篇研究在兼顾提取长程相关性的同时,大幅提升了模型的鲁棒性与计算效率。

另外我整理了这2篇论文的完整架构图+复现教程 以及时间序列+CNN相关论文合集,感兴趣的dd!

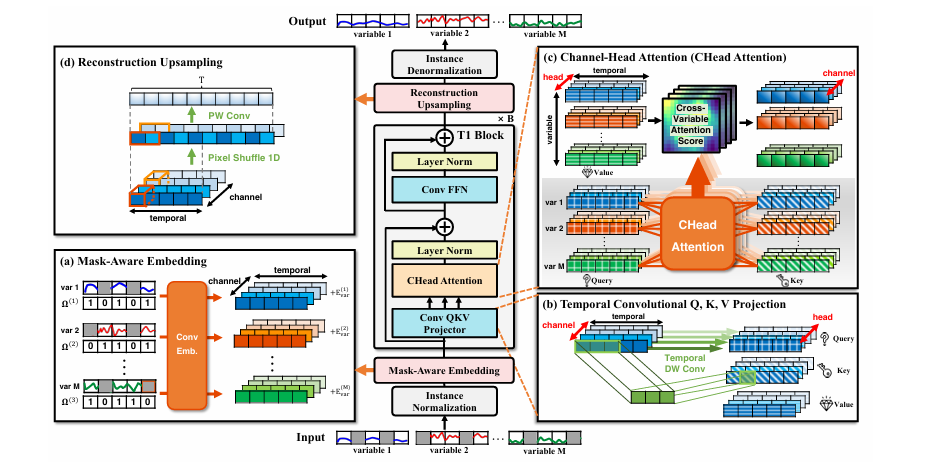

一、论文1:[ICLR 2026] T1: ONE-TO-ONE CHANNEL-HEAD BINDING FOR MULTIVARIATE TIME-SERIES IMPUTATION

方法:

-

提出了一种针对多变量时间序列插补的CNN-Transformer混合架构T1。

-

核心策略是引入通道-头绑定(Channel-Head Binding) 机制,为CNN提取的特征通道和Transformer的注意力头建立一对一的映射对应关系。

-

关键特征维度的注意力交互操作如下表示以实现跨变量转移:

创新点:

-

摒弃了传统的全通道混合混合注意力机制,实现了特征级别(细粒度)的选择性信息传输。

-

当缺失特定数据时,绑定机制允许注意力头动态降低对受损特征通道的依赖,防止噪声级联扩散。

-

在70%极度稀疏的极端缺失表现下,无需针对性重训练就能泛化到未见过的缺失模式中,达到了极高的鲁棒性。

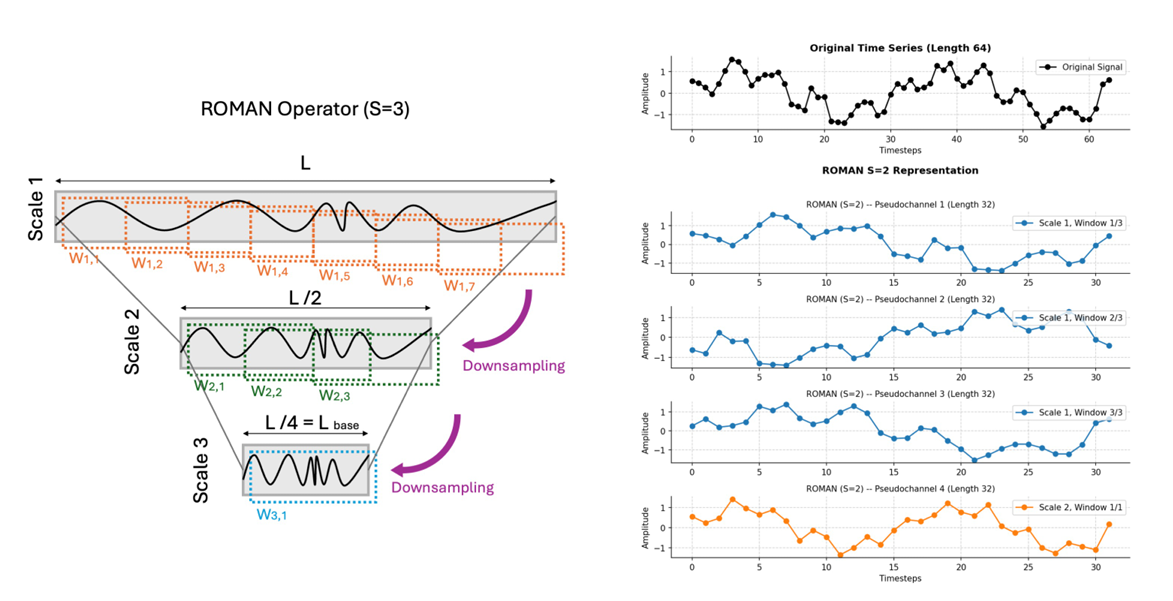

二、论文2:[Stockholm University] ROMAN: A Multiscale Routing Operator for Convolutional Time Series Models

方法:

-

提出了一种即插即用的确定性预处理前端算子ROMAN(ROuting Multiscale representAtioN),用于时间序列分类。

-

该算子首先构建抗混叠多尺度金字塔,随后在每一尺度提取固定长度的时间窗口,并沿着通道维度堆叠拼接成伪通道(Pseudochannels) 。

-

经过ROMAN变换后,原始长序列转化为显式包含尺度和粗略位置信息的短序列输入。

创新点:

-

无需修改任何下游标准CNN分类器架构,即可把"尺度"与"时间位置"显式转化为通道特征,可控地调节CNN算法固有的归纳偏置。

-

有效弥合了传统全局池化(把位置信息平滑掉)带来的固有缺陷,巧妙利用伪通道来保留长序列相关性和特征局部位置。

-

不仅提升了多尺度交互特征下的分类精度,同时因为缩短了时序轴的长度,极大地提高了长序列数据的训练与推理效率。