Apache ActiveMQ 是一个被广泛使用的消息代理,能实现分布式应用程序之间的无缝通信。然而,随着消息量的增加,可能会出现性能瓶颈,从而导致消息处理缓慢、高延迟、代理崩溃以及内存不足(OOM)错误。

影响 ActiveMQ 的最关键问题之一是 OOM 错误,当代理超出其分配的堆内存时就会发生此错误。这可能会导致服务故障、消息丢失以及长时间的停机。

那么,如何在这些问题恶化之前进行检测和预防呢?关键在于日志分析。通过监控 ActiveMQ 日志,管理员可以识别内存耗尽的早期警告迹象,实时进行故障排除,并确保代理平稳运行。

在本文中,我们将重点探讨 OOM 错误,以及如何利用日志分析高效地诊断和解决这些问题。我们还将探讨 Site24x7 的日志监控和插件如何为代理性能提供实时的可视化支持。

日志分析如何帮助诊断 ActiveMQ 中的 OOM 错误

ActiveMQ 日志为代理的运行状况、内存使用率以及系统健康状态提供了极具价值的洞察。通过分析这些日志,管理员可以:

在系统崩溃前发现内存警告。

准确定位导致内存占用过高的原因。

将 OOM 错误与特定的队列、主题或消息模式关联起来。

采取预防措施来优化代理性能。

真实用例:在 ActiveMQ 日志中检测 OOM 错误

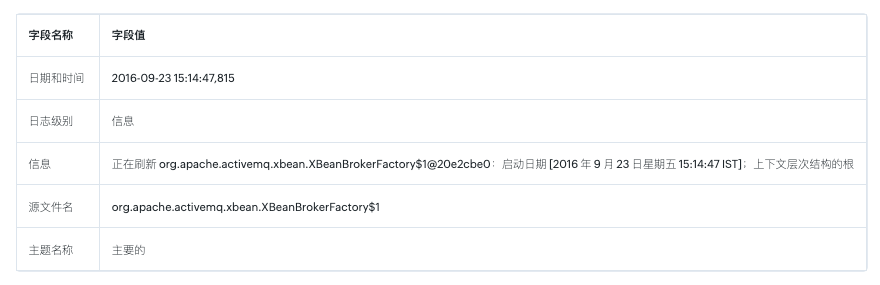

表明出现 OOM 错误的日志条目示例:

2024-01-29 10:45:12,678 | ERROR | java.lang.OutOfMemoryError: Java heap space | org.apache.activemq.broker.BrokerService | ActiveMQ Broker

该日志的含义:

日志级别 (ERROR):表示代理发生了严重故障。

消息内容 (java.lang.OutOfMemoryError: Java heap space):证实 ActiveMQ 已耗尽其分配的内存。

组件 (org.apache.activemq.broker.BrokerService):指出受影响的是代理服务。

影响:代理可能会崩溃,导致消息投递失败并可能造成数据丢失。

ActiveMQ 中 OOM 错误的常见原因

1. 庞大的消息积压

如果消息消费速度不够快,它们就会在内存中不断堆积。

消费者处理缓慢或消费者缺失都会导致内存占用过高。

2. 内存配置不当

堆内存大小(Java 虚拟机(JVM)的-Xmx和-Xms选项)可能设置得过低。

代理的内存限制(memoryLimit、storeLimit和tempLimit)可能配置有误。

3. 持久化消息缺乏足够的磁盘空间

如果消息需要持久化但磁盘存储空间已满,代理可能会将它们保存在内存中。

KahaDB、Java 数据库连接(JDBC)或其他持久化存储的错误配置都可能导致内存问题。

4. 消息体量过大

ActiveMQ 在分发大消息之前会将其保存在内存中。

如果大消息没有被正确地以流的形式处理,就会导致内存溢出。

5. 未确认的消息

如果消费者没有对消息进行确认,ActiveMQ 可能会一直将其保留在内存中。

重新投递的尝试会进一步增加内存压力。

如何诊断和解决 OOM 错误

步骤 1:监控 ActiveMQ 日志以获取内存警告

在因 OOM 崩溃之前,ActiveMQ 通常会生成 WARN(警告)日志,表明内存使用率过高。

警告日志示例:

2024-01-29 10:30:00,123 | WARN | Memory usage exceeded threshold: 90% | org.apache.activemq.usage.MemoryUsage | ActiveMQ Broker

执行操作:

利用日志监控工具针对此类警告设置自动警报,以便主动检测并处理内存问题。

步骤 2:检查 Java 堆大小并调整内存限制

修改 ActiveMQ 的启动脚本,为代理分配更多的内存。

配置示例 (activemq.sh):

export ACTIVEMQ_OPTS_MEMORY="-Xms2g -Xmx4g"

执行操作:

根据流量模式和内存需求增加堆的大小。

步骤 3:启用消息持久化以减少内存负载

将消息存储在磁盘上而不是保留在内存中,有助于防止 OOM 错误。

配置示例 (activemq.xml):

XML

<persistenceAdapter>

<kahaDBdirectory="activemq-data/kahadb"journalMaxFileLength="32mb"cleanupInterval="5000"/>

persistenceAdapter>

执行操作:

启用持久化存储,将消息从内存中卸载。

步骤 4:为队列设置内存限制以避免过载

限制每个队列的内存使用量,防止消息过度堆积。

配置示例 (activemq.xml):

" producerFlowControl="true" memoryLimit="50mb"/>

执行操作:

为每个队列配置内存限制,以防止代理过载。

步骤 5:优化垃圾回收以防止内存碎片

频繁的垃圾回收 (GC) 暂停会导致内存耗尽。使用 JVM 日志监控 GC 活动。

JVM GC 日志监控命令示例:

-XX:+PrintGCDetails -XX:+PrintGCTimeStamps

执行操作:

根据内存消耗模式调整 GC 设置。

步骤 6:使用 Site24x7 的日志监控和插件进行主动监控

手动分析日志可能非常耗时。Site24x7 的日志监控可针对以下情况提供实时的可见性:

用于探测 OOM 错误早期迹象的内存使用趋势。

当内存使用率越过关键阈值时的自动警报。

Site24x7 日志监控和插件的主要功能:

集中式的日志收集与分析

预配置的内存和性能指标仪表板

针对 OOM 错误、消息处理缓慢以及代理故障的自定义警报

与 ActiveMQ 无缝集成,实现实时的异常检测

执行操作:

部署 Site24x7 的 ActiveMQ 日志分析功能和插件,以实现持续监控和主动的故障解决。

诊断 ActiveMQ 代理的性能问题需要有效的日志管理和分析。通过主动监控 ActiveMQ 日志,您可以防止代价高昂的宕机,并确保消息代理平稳运行。