简要整理下20260502机器人仿真/测试智岗位以及职能需求

1、宇树、云深处

都不需要仿真岗位,emmm

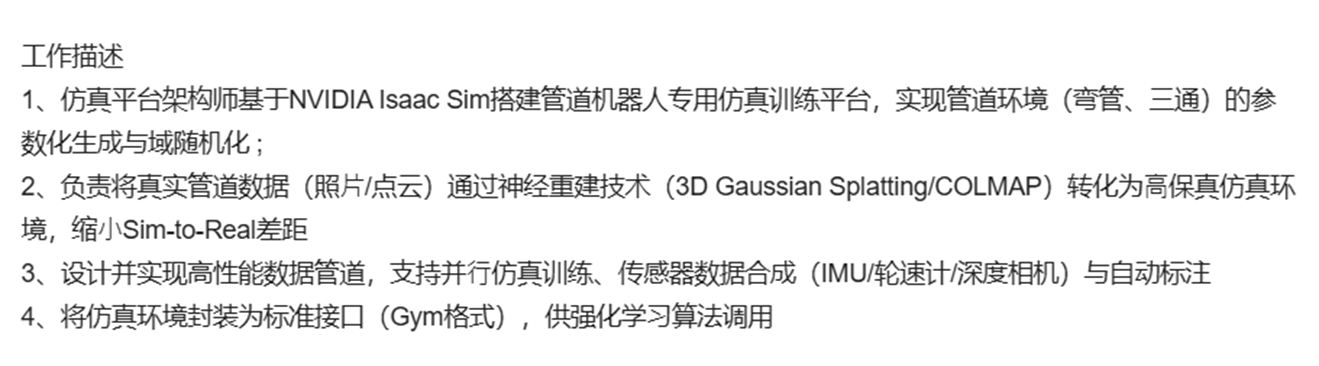

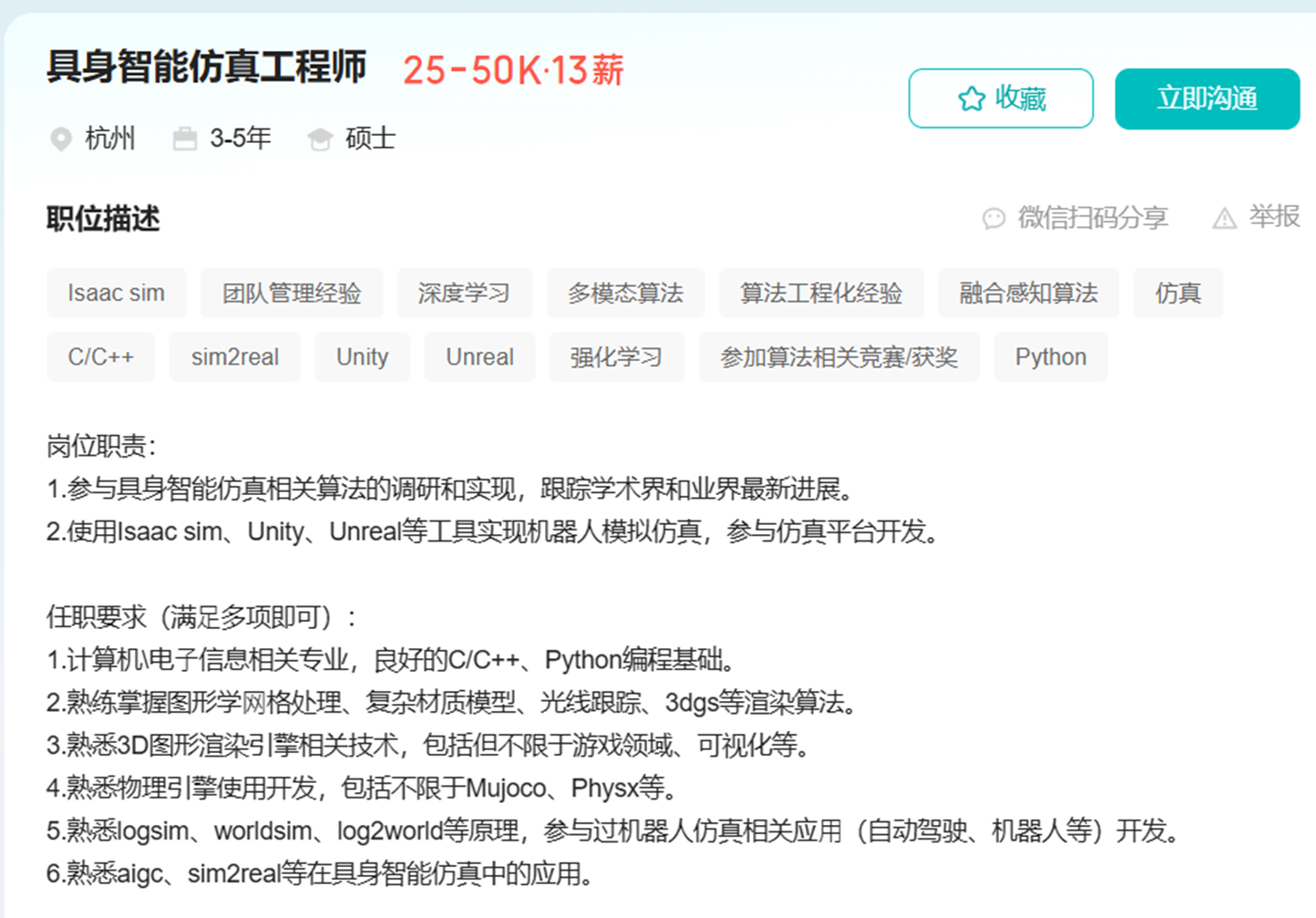

2、哥仑布机器人

技能点:issac sim、3D高斯、仿真训练、传感器数据合成

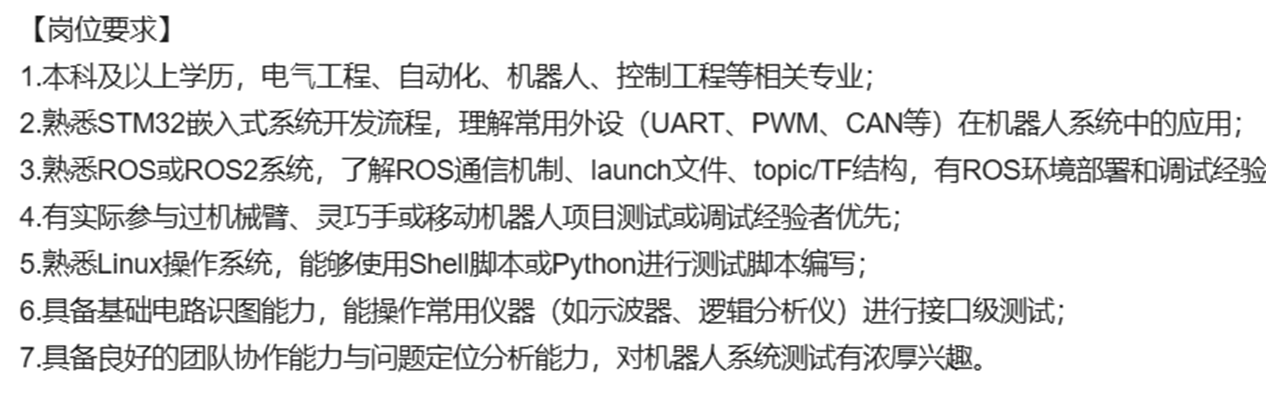

3、曦诺未来

技能点:STM32、ros\ros2、实际机器人项目

4、拉格朗日机器人

技能点:issac sim (USD、oMniverse架构)/刚体动力学

目标:打通仿真 - 真机部署的数据闭环;模型评估与部署工具链。

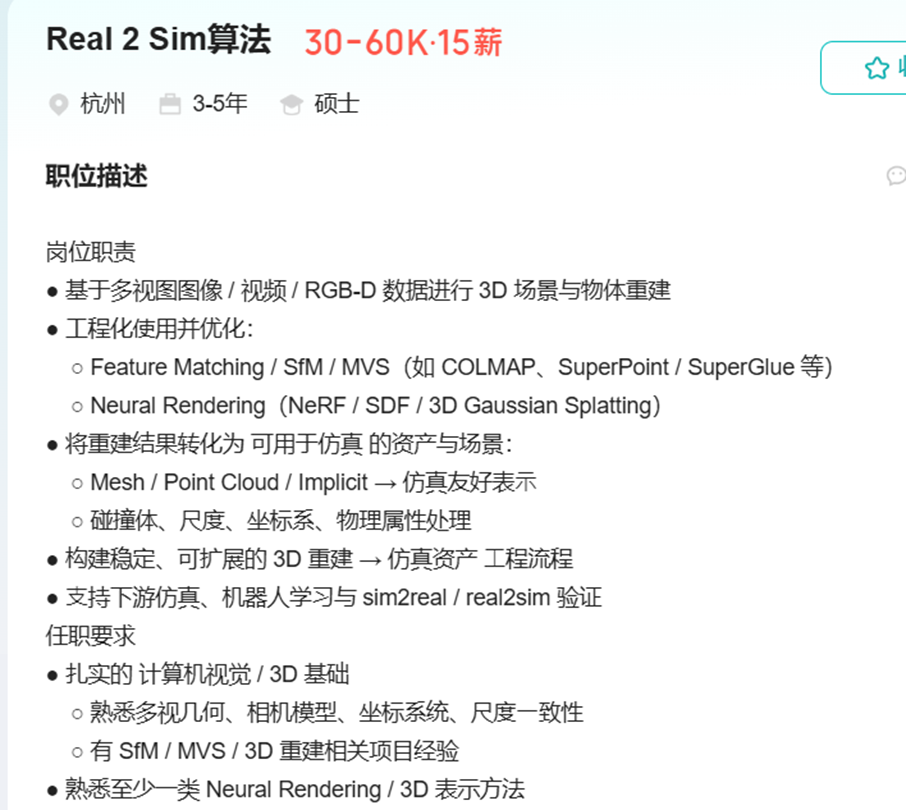

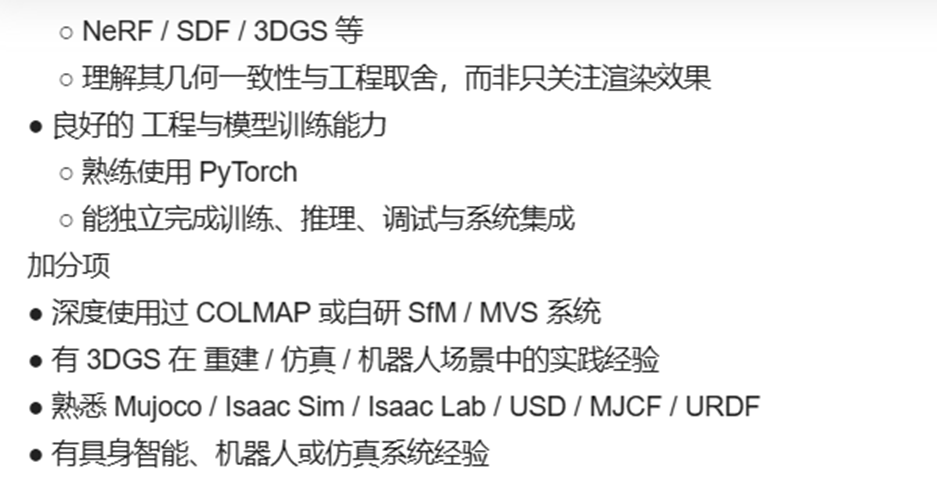

5、原力无限

可惜也不需要仿真,但是看到一个搭建仿真环境的算法岗位

这个岗位的描述大白话版:

powershell

一句话:把真实世界的场景,做成仿真里能用的 3D 数字孪生资产,打通「真实数据 → 仿真场景」的全流程。

它叫 Real2Sim 算法岗,目标是解决机器人 / 自动驾驶里的核心痛点:

现实里采集的图像 / 视频数据,没法直接给仿真器(比如 Isaac Lab、Carla)用

它要把这些数据 "翻译" 成仿真能直接加载的 3D 场景,让机器人在仿真里练完,能直接用到真机上(Sim2Real)岗位职责大白话版:

powershell

1. 用相机数据重建 3D 世界

基于多视图图像 / 视频 / RGB-D 数据进行 3D 场景与物体重建

就是用普通相机、深度相机拍一堆照片 / 视频,把现实里的场景(比如办公室、工厂、道路),在电脑里重建出完整的 3D 模型。

核心工具就是后面提到的 COLMAP、SfM/MVS 这些。

2. 工程化优化这些重建算法

工程化使用并优化:

Feature Matching / SfM / MVS(如 COLMAP、SuperPoint / SuperGlue 等)

Neural Rendering(NeRF / SDF / 3D Gaussian Splatting)

【解释:

Feature Matching 特征匹配;

SfM(运动恢复结构)

MVS(多视图立体匹配)NeRF(神经辐射场)

3D Gaussian Splatting(3DGS)

SDF(符号距离函数 】

说白了,就是不能只会调开源工具,得能把它们改成工业级能用的:

用 SuperPoint/SuperGlue 这些做图像特征匹配,把照片对齐、算出相机位置

用 COLMAP 跑 SfM/MVS,生成稀疏 / 稠密点云

用 NeRF/3DGS 这些神经渲染方法,做高保真的 3D 重建

还要解决速度慢、鲁棒性差、工业场景不适用的问题名词解释:

bash

一、Feature Matching(特征匹配)

一句话:它是让多张照片 "认出同一个东西" 的技术,是所有 3D 重建的地基。

它会在每张照片里提取出独特的 "特征点"(比如杯子把手的拐角、桌角的纹理),然后在所有照片里把这些特征点一一对应起来,建立匹配关系。

二、Neural Rendering(神经渲染)

一句话:用神经网络把真实世界 "数字化",再渲染出照片级别的新视角画面,是现在 3D 重建的 "黑科技"。

1. 它到底在干嘛?

传统 3D 重建(比如 COLMAP)只能生成点云、粗糙的 Mesh,很难还原真实的光影、纹理。而 Neural Rendering 是这么做的:

用一堆不同角度的照片训练一个神经网络

这个网络会学习场景里每一个点的颜色、密度、光照

你随便给它一个新的相机视角,它就能合成出一张 "看起来像真的" 的照片

岗位里提到的:

NeRF(神经辐射场):最经典的神经渲染方法,能生成超高保真的新视角图像。

3D Gaussian Splatting(3DGS):现在最火的技术,比 NeRF 快 100 倍,还能实时渲染,是仿真场景重建的新宠。

SDF(符号距离函数):另一种 3D 表示方式,能生成平滑、带体积的 Mesh,适合做仿真碰撞体。

2. 为什么这个岗位需要它?

传统重建的场景,要么太糙(点云 / 低模),要么太占空间(高精度 Mesh),没法直接给仿真用。

神经渲染可以:

生成照片级别的高保真场景,让机器人训练更真实

转换成轻量的仿真资产(比如简化的 Mesh、碰撞体)

解决真实场景到仿真场景的 "数字孪生" 问题,打通 Real2Sim

总结:Feature Matching:负责从一堆照片里,算出相机在哪里、场景的几何结构是什么,搭好骨架。

Neural Rendering:负责给骨架 "贴皮",还原真实的光影、纹理,甚至生成仿真友好的模型。

两者结合,就是岗位里说的「基于真实数据,重建出可用于仿真的 3D 场景」。技能点:特征匹配、运动恢复结构、多视图立体匹配;工具(COLMAP、SuperPoint / SuperGlue);神经渲染,工具(NeRF / SDF / 3D Gaussian);issac;

需求:将真实场景重建为轻量的仿真资产场景,还原光影、纹理。

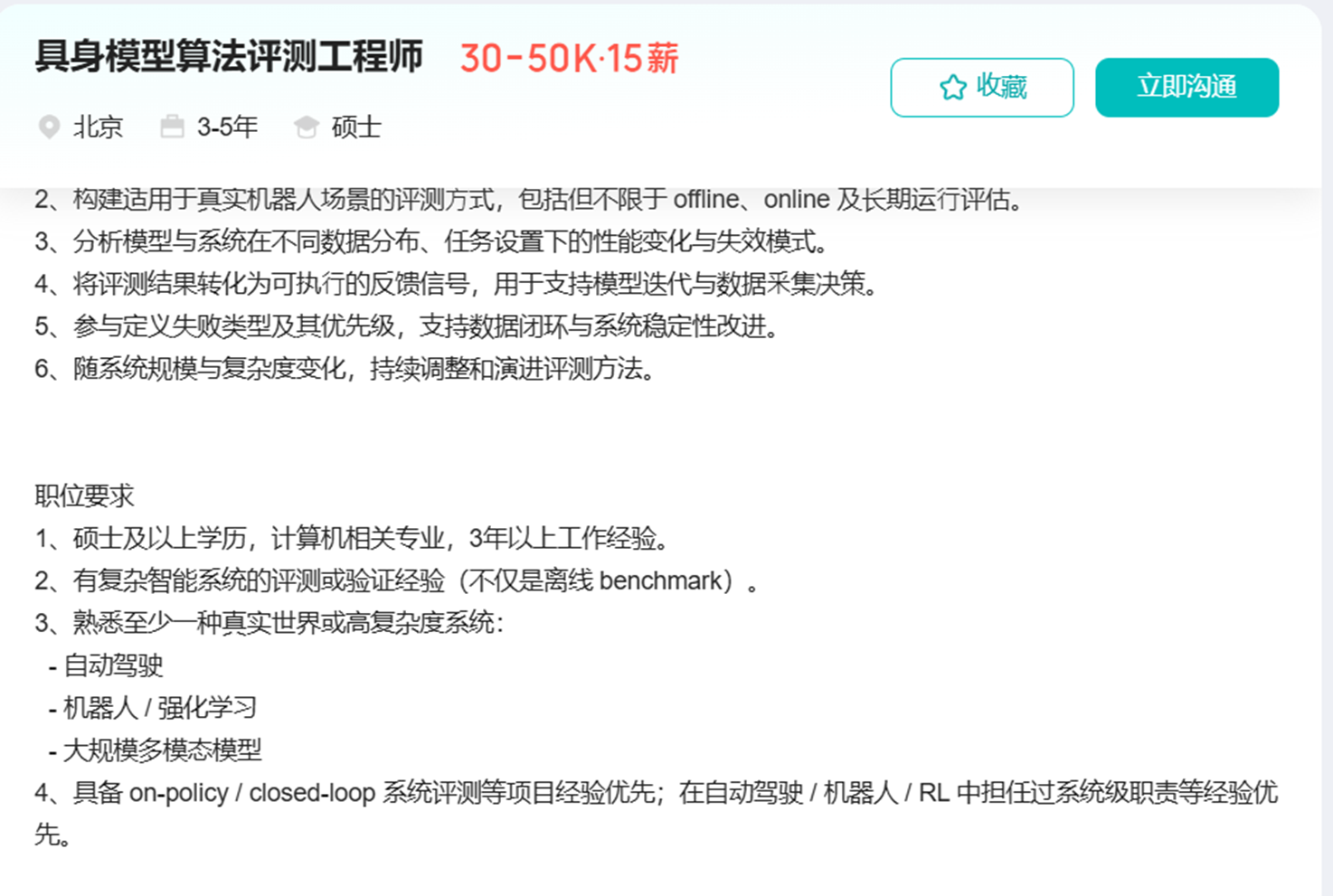

6、千寻智能

技能点:on-policy(在线策略学习 / 在线强化学习);close-loop(闭环仿真);搭建real2sim的数字衍生仿真环境

解释:

c

开环(Open-loop)评测:只测单个模块,比如:

单独测相机识别准确率

单独测控制算法的跟踪误差

这些都是 "局部指标",不代表整个机器人能正常干活。

闭环(Close-loop)评测:把所有模块串起来,像真机一样跑,看最终结果:

比如:机械臂从相机识别目标 → 规划路径 → 抓取动作 → 成功放到指定位置,这一整条链路都跑通,才算一次成功

指标不是 "识别准确率 99%",而是 "100 次任务里,真正成功完成了多少次、碰撞了多少次、超时了多少次"

benchmark 评测

比如在 OpenAI Gym、MuJoCo、Isaac Gym 的标准任务上跑

用固定的环境、固定的初始化、固定的评估脚本,看算法的回报值、成功率

优点:公平、可复现、好对比;缺点:场景简单、固定,和真实机器人要面对的复杂场景差很远

"不仅是 benchmark" 是什么意思?

就是说:

你不能只会在这些标准环境里刷分、调超参数

你要能在自己搭建的、真实 / 复杂的、非标准化的场景里,做系统级的评测

比如:

你自己用 Real2Sim 建了一个工厂的仿真场景,里面有各种障碍物、动态物体、光照变化

你要在这个场景里,给机械臂做闭环评测:测不同光照、不同位置、不同物体的抓取成功率、碰撞率、鲁棒性

这些场景不是现成的 benchmark,需要你自己定义评测指标、写评测脚本、设计实验方案

为什么岗位要这个?7、魔法原子

不需要仿真,只要机械的仿真

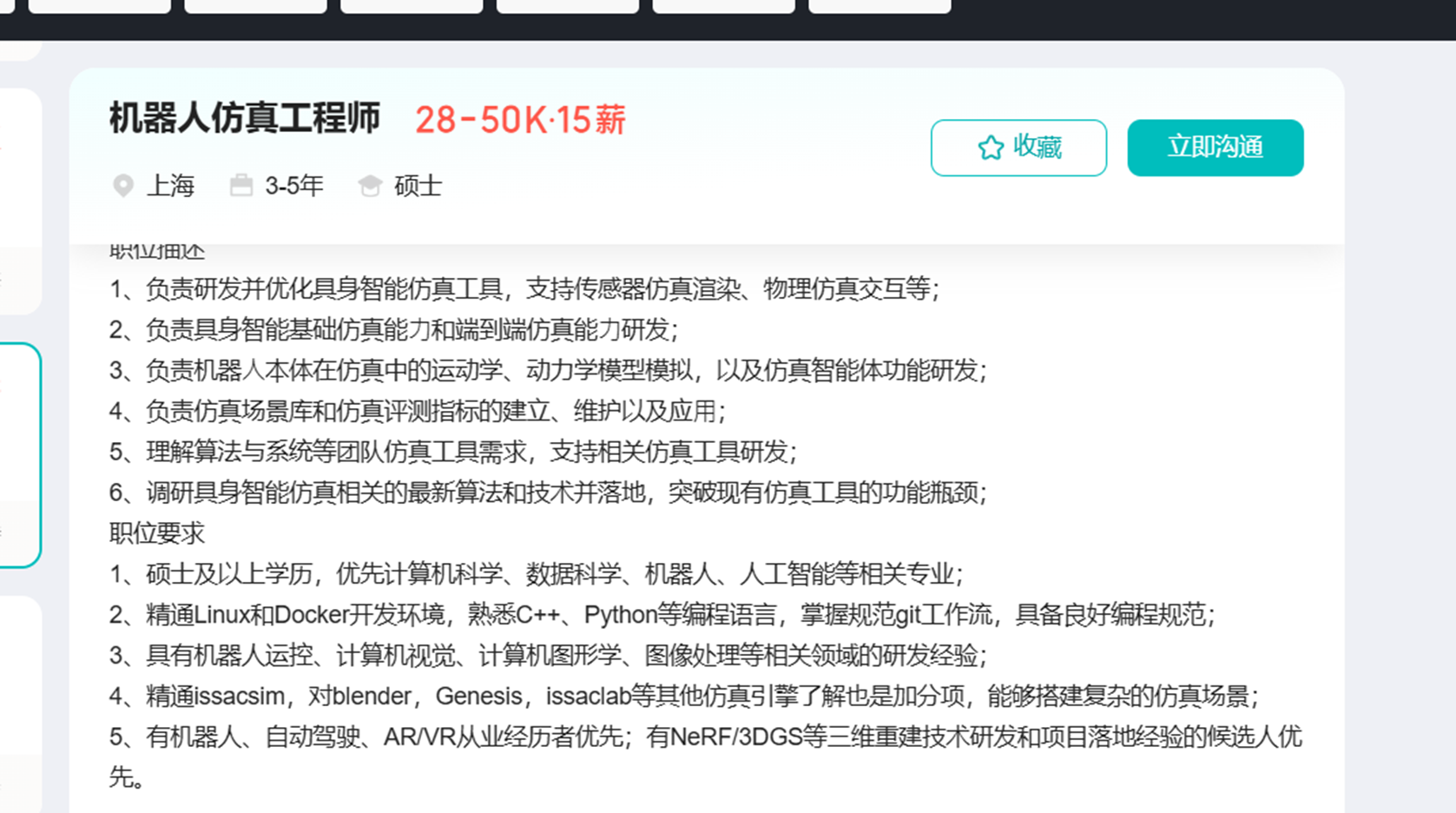

8、树根互联

技能点:issac、unity、3DGS

9、智元机器人(不是杭州岗位)

技能点:issac、NeRf、3Dgs三维重建

总结:

1、当前杭州的机器人仿真岗位并不多。个位数。

2、杭州当前的机器人龙头企业如宇树、云深处并不需要仿真。

3、机器人仿真的技能点总结:a、Issac sim b、3DGS场景重建,搭建real2sim场景库;c、 NeRf;d、on-policy、close-loop仿真,使用场景库进行一段式闭环在线强化学习仿真。e、进阶:COLMAP/SuperPoint / SuperGlue;NeRF / SDF / 3D Gaussian;

最终总结:

1、当前机器人的仿真需要:step1 使用issac进行简单场景仿真;2、建设sim2real仿真场景库;3、搭建on-policy、close-loop仿真平台,使用sim2real的场景库进行仿真。