AI 是在循环中运行的。智能体会思考,然后行动,接着再次思考。单个用户任务就可能跨越数十万个 token,调用五六个工具,访问知识库,编写代码,执行代码,并持久化状态,这一切都发生在返回答案之前。我们现有的云并非为此而生。超大规模的云厂商(例如 AWS、GCP)提供数百种为昨日应用而构建的服务,却把集成工作留给了你。而那些只提供推理服务的新型平台则搭建在别人的算力之上,并加价出售给你。GPU 租赁商(常被称为"新型云")给你的是芯片,而不是一个完整的系统。

本周,在 DigitalOcean 主办的 Deploy 2026 大会上,我们推出了 DigitalOcean AI 原生云,一个专为推理和智能体时代打造的平台,它将从芯片到智能体的五层能力整合在一个开放的栈中。

我们在周二交付了十五款产品。以下是详细介绍。

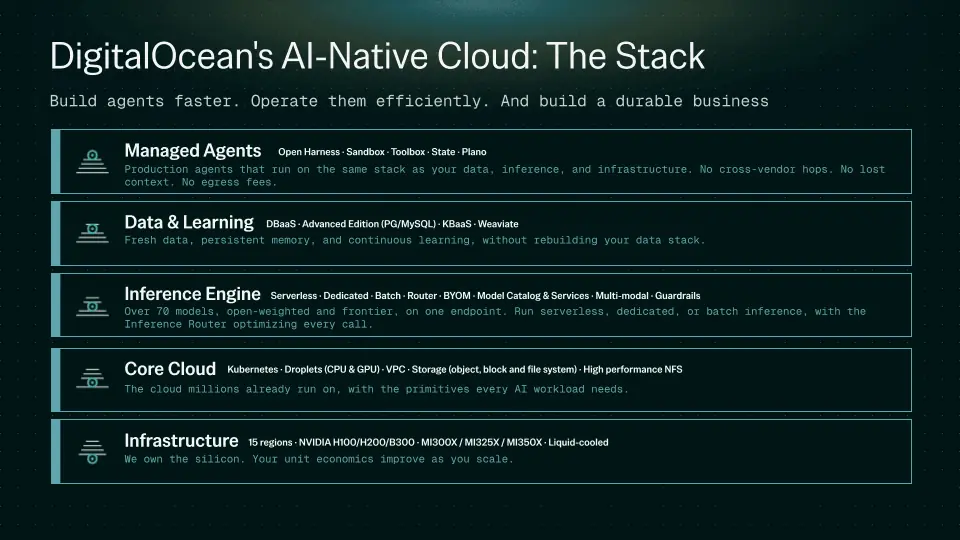

DigitalOcean AI 原生云的五层技术栈

我们的 AI 原生云由五层构成,每一层都对应着我们所观察到的客户正在努力解决的真实工作负载模式。

它们既能独立发挥价值,也能完美集成:

- 托管智能体: 智能体的生产运行时,提供沙箱、持久状态和通用数据平面

- 数据与学习: 托管数据库、向量存储、知识库和反馈闭环

- 推理引擎: 每个开放和前沿模型共用一个端点,在内核层面进行优化

- 核心云: 为 AI 调优过的计算、网络和存储原语

- 基础设施: DigitalOcean 自有的芯片与设施,与业界顶尖伙伴共同设计

开源在任何一层都不是附加项,而是基石:PostgreSQL、MySQL、MongoDB、Valkey、OpenSearch、Kafka、Weaviate、vLLM、SGLang、OpenCode、LangGraph、CrewAI。彻底的开源。你带上自己的模型权重、框架和工具。我们提供运行时。

让我们从底层开始,逐层介绍。

一、基础设施:掌握芯片,掌握经济

DigitalOcean 的全球布局现已覆盖 19 个数据中心 和 200 多个网络接入点,未来还将在 堪萨斯城和孟菲斯 上线更多资源。其中还包括我们首批液冷机柜,专为下一代高密度 GPU 工作负载而建。

DigitalOcean 的 里士满数据中心 现已正式上线 ,提供 NVIDIA HGX™ B300 和 AMD Instinct™ MI350X GPU 服务器,与整个集群中已在运行的 H100、H200、MI300/MI325 芯片并存。我们与 NVIDIA 和 AMD 在内核层面进行共同设计。我们不是转租算力,而是自己拥有硬件。所以你在 DigitalOcean 这儿用得越多,单次推理的成本就越实惠,而不会像在其他平台那样,用得越多越贵。

二、核心云:每个智能体之下的基础

每天都有数十万客户在 DigitalOcean 的核心云上运行:Droplets、Kubernetes (DOKS)、VPC 网络以及对象/块/网络文件存储。我们已将这些产品服务扩展以适应 AI 工作负载,包括无阻塞的 RDMA 网络结构、支持 RDMA 的 NFS,以及开箱即用的 VPC 原生推理。

在 Deploy 大会上,DigitalOcean 发布了Burstable CPU 和MicroVM Droplet,目前处于预览阶段。这些是基于 Firecracker 的实例,启动时间约 200 毫秒,非常适合智能体沙箱和轻量级、突发型工作负载。智能体需要 GPU 来思考,也需要 CPU 来执行。这两者 DigitalOcean 都有,而且现在它们的规格是真正按照智能体的实际行为来设计的。如果需要申请在预览阶段体验,可直接联系卓普云(aidroplet.com)。

三、推理引擎:所有模型,一个端点

这是DigitalOcean彻底重建的一层。DigitalOcean与合作伙伴 Hippocratic AI 共同开发了它,其成果是当今市场上性能最高的推理引擎之一:在独立机构 Artificial Analysis 按 token 吞吐量进行的基准测试中,实现了对 Qwen 3.5 和 DeepSeek V3.2 的最快推理速度,这个推理速度超过了其他云平台。

以下是新功能:

- 推理路由器(公共预览版):一个偏好感知的控制平面,为每个请求选择最佳模型,在无需代码更改的情况下平衡成本、延迟和质量

- 专用推理(正式版):为生产工作负载提供预留容量,实现可预测的性能和经济效益

- 自带模型 (BYOM)(正式版):一项让你在我们的服务栈上托管自定义微调模型,并继承内核级优化的服务

- 多模态模型支持(正式版):在单一 API 上支持文本、图像、音频和视频

- 批量推理(正式版):专为异步工作负载(文档处理、评估运行、合成数据生成)而建,价格约为高峰无服务器定价的 50%

- 内容安全护栏(正式版):集成在推理层的策略控制

- 支持多模态的无服务器推理(正式版):单一 API,可缩容至零,仅按消耗的 token 付费

- 评估(公共预览版):依据黄金数据集或内置裁判模型进行自动化评分,让你可以在不盲目飞行的前提下切换模型

推理路由器是一个偏好感知的控制平面,为每个请求选择最佳模型,在无需触碰应用代码的情况下平衡成本、延迟和质量。与静态路由规则不同,它运行在一个专门构建的小语言模型上,能在 200 毫秒内解析意图,并根据实时的成本和延迟数据对候选模型进行排序,从而确保无论是凌晨 2 点还是下午 2 点,最合适的模型都能胜出。大多数 AI 构建者起初只使用单个前沿模型。一旦实现产品-市场契合 (PMF),账单便会随用量线性增长,单位经济性迅速恶化。我们合作过的大多数成功 AI 公司都在生产环境中运行三个或更多的大模型。走在AI行业前沿的公司甚至运行二十个以上的模型。推理路由器让这一切成为可能,且无需重写代码。

以 Celiums.AI 为例,在通过推理路由器处理的 2920 万个 token 中,他们 83% 的流量现在流向了开源模型,而此前这个数字是零。

"我们的 AI 伦理引擎是用开源 AI 构建的,所以将其运行在闭源模型上感觉非常违和。DigitalOcean 的推理路由器闭合了这个循环:我们将前沿闭源模型替换为开放的替代模型,单 token 成本降低了 61%,同时将 P95 延迟保持在 400 毫秒以下。同样的 API,零代码更改。路由器为每个请求找到最优模型。我们只管构建。"

------ Mario Gutiérrez ,Unity Financial Network 首席技术官,Celiums.AI 创始人

我们还为模型目录新增了超过 25 个新模型,包括:

- NVIDIA Nemotron 3 Nano Omni

- DeepSeek V3.2

- Llama 3.3 70B

- Qwen 3.5

- MiniMax-M2.5

四、数据与学习:AI 就绪的数据,无需重建

有状态的智能体需要上下文、记忆,以及从生产环境中学习的能力。数据与学习层建立在成千上万客户已经信赖的托管服务之上,并针对 AI 系统的实际运行方式进行了扩展。

新功能包括:

- 知识库(正式版):托管检索,提供有依据、带引用的答案;默认情况下,每个知识库都作为一个 MCP 工具暴露

- 学习与反馈循环(正式版):捕获生产信号并将其引导回模型改进流程,无需单独的数据管道

- 托管 Weaviate(私有预览版):开源向量存储,全托管

- PostgreSQL 高级版 和 MySQL 高级版(公共预览版):容量可达 50 TiB,数分钟内完成 1 TiB 的扩缩,基于代理的秒级故障转移,以及超过 100 项可观测性指标

事务性数据库依然是 AI 的基础。我们使其达到了智能体时代的生产级水准。

五、托管智能体:一个生产运行时,而非单体

这是全栈最新的一层,也是我们花最长时间倾听的一层。我们观察到客户在 App Platform(应用托管平台)上将智能体作为容器部署了成千上万个。我们也看到,当智能体的循环、工具调用、状态、可观测性和代码执行都缠绕在一个单体中时,他们就会碰壁。

于是我们问了一个简单的问题:什么能帮你们真正跑得更快?答案就是托管智能体:五个原语(Primitives),将"管道"与智能体的业务逻辑分离开来。

新功能包括:

- 托管智能体(正式版):生产运行时

- 开放式框架 (Open Harness)(正式版):可带入你自己的智能体框架,包括 OpenCode、LangGraph、CrewAI 或任何其他框架

- 托管沙箱(正式版):兼容 E2B,基于 Firecracker,亚秒级冷启动,安全执行模型生成的代码

- 持久状态管理(正式版):框架可以信赖的检查点和内存原语

- Plano(正式版):我们的智能体编排框架和数据平面,以 Apache 2.0 协议发布

- Launchpad(正式版):点击几下即可从原型到部署智能体

- 模型上下文协议 (MCP)(正式版):在整个平台上扩展支持

- ToolBox(即将推出):超过 3000 个工具连接器,让你的智能体能够在你业务实际运行的系统上执行操作

全栈的复合效应

这个技术栈中的任何单独一层都能独立发挥作用。而将它们整合在一起运行的理由在于,优化效果会复合叠加。

当你的AI 智能体、AI 推理、数据和计算位于同一个 VPC、运行在同一块芯片上、出在同一张账单下时,你就消除了一般因缝合三家供应商和三份账单而产生的出口流量费、成本叠加以及集成成本。

我们见证过像 Workato 这样的客户,以降低 67% 的成本运行一万亿次自动化任务。Character.AI 每天处理超过十亿次查询,推理吞吐量提升 2 倍。LawVo 通过转用我们的服务,零代码更改即降低了 42% 的推理成本。Hippocratic AI 正为超过 2000 万次患者互动提供支持,延迟降低了 40%。这些都不是演示,而是规模化运行的生产工作负载。

从这里开始,在这里扩展

如果你是一名 AI 构建者,无论你是在写第一行代码,还是正加速跨越产品-市场契合点,这个栈都为你而建。你无需在超大规模云厂商的队列中排在前沿实验室后面苦等。你无需将一家新型云、一个推理包装器和一个向量数据库厂商强行拼接起来。你无需在开放性、经济效益或开发者体验上做出妥协。

欢迎来到 AI 原生云。一起构建吧。如需了解更多,或申请测试,可直接联系卓普云。