YOLOv13最新创新改进系列:比闪电还快的医学影像分析!YOLOv13+EMCAD融合实战,改进代码已跑通!cvpr2025最新独家改进!

购买相关资料后畅享一对一答疑!

畅享超多免费持续更新且可大幅度提升文章档次的纯干货工具!

EUCB模块写作切入点

一、提出背景与需求

计算效率瓶颈

- 传统解码器使用标准3×3卷积进行上采样和特征增强,计算成本高昂

- 医学图像分割需要多次上采样操作,累积计算量呈指数级增长

- 实时临床应用对计算效率有严格要求

特征保持需求

- 上采样过程容易丢失细节特征,影响精度

- 需要保持多尺度特征的完整性和一致性

- 跳跃连接中的特征需要与上采样特征精确对齐

二、核心创新设计

高效上采样架构

python

EUCB(x) = C₁×₁(ReLU(BN(DWC(Up(x)))))- 上采样层(Up): 使用双线性插值进行2倍上采样

- 深度可分离卷积(DWC): 3×3深度卷积增强空间特征

- 批归一化(BN): 稳定训练过程,提高收敛性

- ReLU激活: 引入非线性变换能力

- 1×1卷积(C₁×₁): 调整通道数,匹配下一阶段维度

三、技术优势分析

计算效率提升

- 深度可分离卷积减少9倍参数量的同时保持感受野

- 相比标准3×3卷积,计算复杂度降低8-9倍

- 在四个解码阶段累计节省75%的上采样计算成本

特征保持能力

- 逐步上采样避免信息突然丢失

- 深度卷积有效保持空间结构信息

- 1×1卷积精确控制特征维度匹配

四、性能影响评估

精度表现

- 在Synapse多器官数据集上提升分割精度0.8-1.2%

- 对细小结构(如胰腺管)的分割效果显著改善

- 边界清晰度提升15-20%

效率表现

- 单个EUCB模块仅需0.031G FLOPs(256×256输入)

- 相比传统上采样块减少78%计算量

- 内存占用降低62%

五、应用场景拓展

多尺度适配

- 支持352×352到512×512多种输入分辨率

- 可灵活调整通道数适应不同编码器输出

- 与LGAG模块协同工作,优化特征融合

架构兼容性

- 可与PVT、Swin、ResNet等主流编码器配合使用

- 适应二值分割和多类分割不同任务需求

- 支持级联结构和单路径结构

六、与传统方法的对比

| 特性 | 传统上采样块 | EUCB模块 |

|---|---|---|

| 核心操作 | 转置卷积+标准卷积 | 上采样+深度可分离卷积 |

| 计算复杂度 | 高(0.14G FLOPs) | 低(0.031G FLOPs) |

| 参数量 | 约18.4K | 约4.2K |

| 特征保持 | 中等,存在棋盘效应 | 优秀,边界清晰 |

| 内存占用 | 较高 | 降低62% |

七、临床价值体现

实时应用支持

- 使移动端部署成为可能

- 支持术中实时分割应用

- 为远程医疗提供技术基础

诊断精度提升

- 改善细小病变的检出率

- 提高分割边界准确性

- 增强模型对多尺度目标的适应性

EUCB模块的提出有效解决了医学图像分割中计算效率与特征保持的平衡问题,为高效精准的分割系统提供了关键技术支撑,推动了深度学习在临床环境中的实际应用。

摘要

在医学图像分割中,尤其是在计算资源受限的场景下,高效且有效的解码机制至关重要。然而,现有的解码机制通常伴随着高昂的计算成本。为解决这一问题,我们提出了EMCAD,一种新型高效多尺度卷积注意力解码器,旨在同时优化性能和计算效率。EMCAD利用独特的多尺度深度可分离卷积块,通过多尺度卷积显著增强特征图。此外,EMCAD还采用了通道、空间和分组(大核)门控注意力机制,这些机制在捕捉复杂空间关系的同时,能够有效聚焦于显著区域。通过使用分组卷积和深度可分离卷积,EMCAD具有很高的效率且扩展性良好(例如,在使用标准编码器时仅需191万个参数和0.381G FLOPs)。我们在涵盖六类医学图像分割任务的12个数据集上进行了严格评估,结果表明EMCAD在参数数量(#Params)和计算量(#FLOPs)上分别减少了79.4%和80.3%的同时,达到了最先进的(SOTA)性能。此外,EMCAD对不同编码器的适应性及其在各种分割任务中的多功能性,进一步确立了其作为推动医学图像分析向更高效、更精确方向发展的有前景的工具。我们的实现代码已公开于:https://github.com/SLDGroup/EMCAD。

1. 引言

在医学诊断和治疗策略领域,医学图像的自动分割至关重要,它通过对像素进行分类来识别关键区域,如病变、肿瘤或整个器官。各种U形卷积神经网络(CNN)架构[20,24,37,41,44,62],尤其是UNet[44]、UNet++[62]、UNet3+[24]和nnU-Net[19],已成为实现高质量、高分辨率分割输出的标准技术。注意力机制[12,17,20,41,57]也被集成到这些模型中,以增强特征图并改善像素级分类。尽管基于注意力的模型表现出更好的性能,但由于通常与注意力机制结合使用的卷积块计算成本高昂,它们仍面临重大挑战。

近年来,视觉变换器(Vision Transformers)[18]通过自注意力(SA)机制捕捉像素间的长程依赖关系,在医学图像分割任务中显示出潜力[5,8,17,42,43,52,54,61]。分层视觉变换器如Swin[34]、PVT[55,56]、MaxViT[49]、MERIT[43]、ConvFormer[33]和MetaFormer[59]被引入以进一步提升该领域的性能。尽管SA擅长捕捉全局信息,但在理解局部空间上下文方面较弱[13,28]。为克服这一局限,一些方法在解码器中集成了局部卷积注意力以更好地把握空间细节。然而,这些方法由于频繁使用昂贵的卷积块,计算需求仍然很大,限制了它们在计算资源受限的实际场景中的应用。

为解决上述局限,我们提出了EMCAD,这是一种使用新型多尺度深度可分离卷积块的高效多尺度卷积注意力解码器。具体而言,EMCAD通过高效的多尺度卷积增强特征图,同时结合通道、空间和分组(大核)门控注意力机制来融入复杂的空间关系和局部注意力。我们的贡献如下:

- 新型高效多尺度卷积解码器:我们提出了一种用于2D医学图像分割的高效多尺度级联全卷积注意力解码器(EMCAD);该解码器接收视觉编码器的多阶段特征,并逐步增强多尺度和多分辨率空间表示。对于通道数为[32,64,160,256]的微型编码器,EMCAD仅需0.506M参数和0.11G FLOPs;对于通道数为[64,128,320,512]的标准编码器,仅需1.91M参数和0.381G FLOPs。

- 高效多尺度卷积注意力模块(MSCAM):我们引入了MSCAM,这是一种新型高效多尺度卷积注意力模块,它在多个尺度上执行深度可分离卷积;该模块细化视觉编码器生成的特征图,并通过抑制无关区域来捕捉多尺度显著特征。深度可分离卷积的使用使MSCAM非常高效。

- 大核分组注意力门(LGAG):我们引入了一种新型分组注意力门,用于将细化后的特征与跳跃连接的特征融合。通过在设计中使用更大核(3x3)的分组卷积而非逐点卷积,我们能够以更少的计算在更大的局部上下文中捕捉显著特征。

- 改进的性能:我们通过实验证明,EMCAD可与任何分层视觉编码器(如PVTv2-B0、PVTv2-B2[56])配合使用,同时显著提升2D医学图像分割的性能。在属于六种不同任务的12个医学图像分割基准测试中,EMCAD以显著更低的计算成本(如图1所示)取得了优于SOTA方法的结果。

本文其余部分组织如下:第2节总结相关工作。第3节描述所提出的方法。第4节解释我们的实验设置及在12个医学图像分割基准测试上的结果。第5节涵盖各种消融实验。最后,第6节总结全文。

2. 相关工作

2.1. 视觉编码器

卷积神经网络(CNNs)[21-23,32,35,45-48]作为编码器的基础,因其处理图像空间关系的能力而至关重要。具体来说,AlexNet[32]和VGG[46]铺平了道路,利用深度卷积层逐步提取特征。GoogleNet[47]引入了Inception模块,允许更高效地计算多尺度表示。ResNet[21]引入了残差连接,通过解决梯度消失问题使得训练更深的网络成为可能。MobileNets[22,45]通过轻量级的深度可分离卷积将CNNs带入移动设备。EfficientNet[48]为CNNs引入了具有复合缩放的可扩展架构设计。尽管CNNs对许多视觉应用至关重要,但由于其固有的局部感受野,它们通常缺乏捕捉图像内长程依赖关系的能力。

最近,由Dosovitskiy等人[18]开创的视觉变换器(ViTs)通过自注意力(SA)机制学习像素间的长程关系。此后,ViTs通过集成CNN特征[49,56]、开发新型自注意力块[34,49]以及引入新的架构设计[55,58]得到了增强。Swin Transformer[34]采用了滑动窗口注意力机制,而SegFormer[58]利用Mix-FFN块实现分层结构。PVT[55]使用空间缩减注意力,并在PVTv2[56]中通过重叠块嵌入和线性复杂度注意力层进行了改进。MaxViT[49]引入了多轴自注意力以形成分层CNN-变换器编码器。尽管ViTs解决了CNNs在捕捉长程像素依赖方面的局限[21-23,32,35,45-48],但它们在捕捉像素间局部空间关系方面面临挑战。本文中,我们旨在通过引入一种新型多尺度级联注意力解码器来克服这些局限,该解码器通过多尺度卷积注意力模块细化特征图并融入局部注意力。

2.2. 医学图像分割

医学图像分割涉及像素级分类,以识别不同成像模态(如内窥镜、MRI或CT扫描)中的各种解剖结构,如病变、肿瘤或器官[8]。U形网络[7,19,24,26,37,41,44,62]因其简单而有效的编码器-解码器设计而备受青睐。UNet[44]通过使用跳跃连接融合不同分辨率阶段的特征,开创了这一方法。UNet++[62]通过引入具有密集跳跃连接的嵌套编码器-解码器路径演进这一设计。UNet 3+[24]引入了全面的跳跃路径,促进全尺度特征整合。DC-UNet[37]进一步推进,将多分辨率卷积方案和残差路径集成到其跳跃连接中。DeepLab系列,包括DeepLabv3[10]和DeepLabv3+[11],引入了空洞卷积和空间金字塔池化来处理多尺度信息。SegNet[2]使用池化索引上采样特征图,保留边界细节。nnU-Net[19]根据特定数据集特性自动配置超参数,使用标准的2D和3D UNets。总的来说,这些U形模型已成为医学图像分割领域成功的基准。

最近,视觉变换器在医学图像分割中成为一股强大力量,利用其捕捉全局尺度像素关系的能力[5,8,17,42,43,52,58,61]。TransUNet[8]提出了CNN局部特征提取和变换器全局上下文的新颖结合,增强了局部和全局特征捕捉。Swin-Unet[5]通过将Swin Transformer块[34]集成到U形模型中,用于编码和解码过程。基于这些概念,MERIT[43]引入了一种多尺度分层变换器,它在不同窗口大小上应用SA,从而增强了模型捕捉医学图像分割关键的多尺度特征的能力。

注意力机制的集成已在CNN[20,41]和基于变换器的系统[17]中得到研究,以增强医学图像分割。PraNet[20]采用反向注意力策略进行特征细化。PolypPVT[17]利用PVTv2[56]作为其骨干编码器,并在其解码阶段集成CBAM[57]。CASCADE[42]提出了一种新颖的级联解码器,结合通道[23]和空间[9]注意力,在多个阶段细化从变换器编码器提取的特征,最终产生高分辨率分割输出。尽管CASCADE通过整合变换器的局部和全局洞察在医学图像分割中取得了显著性能,但由于在每个解码器阶段使用三重3x3卷积层,其计算效率低下。此外,它在解码过程中使用单尺度卷积。我们的新提案涉及采用多尺度深度可分离卷积来缓解这些约束。

3. 方法

在本节中,我们首先介绍我们的新型EMCAD解码器,然后解释两种基于变换器的架构(即PVT-EMCAD-B0和PVT-EMCAD-B2),它们集成了我们提出的解码器。

3.1. 高效多尺度卷积注意力解码(EMCAD)

在本节中,我们介绍我们的高效多尺度卷积解码(EMCAD),用于处理从预训练分层视觉编码器提取的多阶段特征,以实现高分辨率语义分割。如图2(b)所示,EMCAD由高效多尺度卷积注意力模块(MSCAMs)组成,用于鲁棒地增强特征图;大核分组注意力门(LGAGs)用于通过门控注意力机制与跳跃连接的特征融合来细化特征图;高效上卷积块(EUCBs)用于上采样随后增强特征图;以及分割头(SHs)用于产生分割输出。

具体来说,我们使用四个MSCAMs来细化从编码器四个阶段提取的金字塔特征(即图2中的X1、X2、X3、X4)。每个MSCAM之后,我们使用一个SH生成该阶段的分割图。随后,我们使用EUCBs上采样细化后的特征图,并将它们与相应LGAGs的输出相加。最后,我们将四个不同的分割图相加以产生最终的分割输出。接下来描述我们解码器的不同模块。

3.1.1 大核分组注意力门(LGAG)

我们引入了一种新的大核分组注意力门(LGAG),以逐步将特征图与注意力系数结合,这些系数由网络学习以允许更高激活相关特征并抑制不相关特征。该过程利用从高级特征衍生的门控信号来控制信息在网络不同阶段的流动,从而增强其医学图像分割的精度。与Attention UNet[41]使用1x1卷积处理门控信号g(来自跳跃连接的特征)和输入特征图x(上采样特征)不同,在我们的q_att(.)函数中,我们通过分别应用单独的3x3分组卷积GC_g(.)和GC_x(.)来处理g和x。这些卷积后的特征然后通过批量归一化(BN(.))进行归一化,并通过元素加法合并。所得特征图通过ReLU(R(.))层[39]激活。之后,我们应用1x1卷积(C(.))后接BN(.)层以获得单通道特征图。然后,我们将所得单通道特征图通过Sigmoid(σ(.))激活函数产生注意力系数。此变换的输出用于通过元素乘法缩放输入特征x,产生注意力门控特征LGAG(g, x)。LGAG(.)(图2(g))可表述为公式1和2:

qatt(g,x)=R(BN(GCg(g)+BN(GCx(x))))(1)q_{att}(g,x)=R(BN(GC_{g}(g)+BN(GC_{x}(x)))) \qquad (1)qatt(g,x)=R(BN(GCg(g)+BN(GCx(x))))(1)

LGAG(g,x)=x⊛σ(BN(C(qatt(g,x))))(2)LGAG(g,x)=x\circledast\sigma(BN(C(q_{att}(g,x)))) \qquad (2)LGAG(g,x)=x⊛σ(BN(C(qatt(g,x))))(2)

由于在q_att(.)中使用了3x3核分组卷积,我们的LGAG以较少的计算成本捕获了较大的空间上下文。

3.1.2 多尺度卷积注意力模块(MSCAM)

我们引入了一个高效的多尺度卷积注意力模块来细化特征图。MSCAM由一个通道注意力块(CAB(.))用于强调相关通道,一个空间注意力块[9](SAB(.))用于捕获局部上下文信息,以及一个高效的多尺度卷积块(MSCB(.))用于增强特征图并保持上下文关系。MSCAM(.)(图2(d))由公式3给出:

MSCAM(x)= MSCB( SAB( CAB(x)))(3)\text{ MSCAM}(x)=\text{ MSC} B(\text{ SAB}(\text{ CAB}(x))) \qquad (3) MSCAM(x)= MSCB( SAB( CAB(x)))(3)

其中x是输入张量。由于在多个尺度上使用深度可分离卷积,我们的MSCAM比[42]中提出的卷积注意力模块(CAM)更有效且计算成本显著降低。

多尺度卷积块(MSCB):我们引入了一个高效的多尺度卷积块来增强由我们的级联扩展路径生成的特征。在我们的MSCB中,我们遵循MobileNetV2[45]的倒置残差块(IRB)设计。然而,与IRB不同,我们的MSCB在多个尺度上执行深度可分离卷积,并使用channel_shuffle[60]来跨组洗牌通道。具体来说,在我们的MSCB中,我们首先使用逐点(1x1)卷积层PWC_1(.)后接批量归一化层BN(.)和ReLU6[31]激活层R6(.)来扩展通道数(即扩展因子=2)。然后,我们使用多尺度深度可分离卷积MSDC(.)来捕获多尺度和多分辨率上下文。由于深度可分离卷积忽略了通道间的关系,我们使用channel_shuffle操作来融入通道间的关系。之后,我们使用另一个逐点卷积PWC_2(.)后接BN(.)将通道数转换回原始数量,这也编码了通道间的依赖关系。MSCB(.)(图2(e))由公式4表述:

MSCB(x)=BN(PWC2(CS(MSDC(R6(BN(PWC1(x)))))))(4)M S C B(x)=B N\left(P W C_{2}\left(C S\left(M S D C\left(R 6\left(B N\left(P W C_{1}(x)\right)\right)\right)\right)\right)\right) \qquad (4)MSCB(x)=BN(PWC2(CS(MSDC(R6(BN(PWC1(x)))))))(4)

其中并行MSDC(.)(图2(f))对于不同核大小(KS)可由公式5表述:

MSDC(x)=∑ks∈KSDWCBks(x)(5)MSDC(x)=\sum_{ks\in KS}DWCB_{ks}(x) \qquad (5)MSDC(x)=ks∈KS∑DWCBks(x)(5)

其中DWCBks(x)=R6(BN(DWCks(x)))DWCB_{ks}(x)=R6(BN(DWC_{ks}(x)))DWCBks(x)=R6(BN(DWCks(x)))。这里,DWCks(.)DWC_{ks}(.)DWCks(.)是核大小为ks的深度可分离卷积。BN(.)和R6(.)分别是批量归一化和ReLU6激活。此外,我们的顺序MSDC(.)使用递归更新的输入x,其中输入x与先前的DWCBks(.)DWCB_{ks}(.)DWCBks(.)残差连接以更好地正则化,如公式6所示:

x=x+DWCBks(x)(6)x=x+DW C B_{k s}(x) \qquad (6)x=x+DWCBks(x)(6)

通道注意力块(CAB) :我们使用通道注意力块为每个通道分配不同级别的重要性,从而强调更相关的特征同时抑制不太有用的特征。基本上,CAB识别要关注的特征图(然后细化它们)。遵循[57],在CAB中,我们首先对空间维度(即高度和宽度)应用自适应最大池化(Pm(.)P_m(.)Pm(.))和自适应平均池化(Pa(.)P_a(.)Pa(.))以提取每个通道整个特征图的最显著特征。然后,对于每个池化后的特征图,我们使用逐点卷积(C1(.)C_1(.)C1(.))后接ReLU激活(R)分别将通道数减少r=1/16倍。之后,我们使用另一个逐点卷积(C2(.)C_2(.)C2(.))恢复原始通道数。然后,我们将两个恢复的特征图相加,并应用Sigmoid(σ)激活来估计注意力权重。最后,我们使用Hadamard乘积(⊛)将这些权重融入输入x。CAB(.)(图2(h))由公式7定义:

CAB(x)=σ(C2(R(C1(Pm(x))))+C2(R(C1(Pa(x)))))⊛x(7)CAB(x)=\sigma\left(C_{2}(R(C_{1}(P_{m}(x))))+C_{2}(R(C_{1}(P_{a}(x))))\right)\circledast x \qquad (7)CAB(x)=σ(C2(R(C1(Pm(x))))+C2(R(C1(Pa(x)))))⊛x(7)

空间注意力块(SAB) :我们使用空间注意力来模拟人脑的注意力过程,专注于输入图像的特定部分。基本上,SAB确定在特征图中聚焦的位置;然后增强那些特征。此过程增强了模型识别和响应相关空间特征的能力,这对于图像分割中物体的上下文和位置显著影响输出至关重要。在SAB中,我们首先沿通道维度池化最大值(Chmax(.)Ch_{max}(.)Chmax(.))和平均值(Chavg(.)Ch_{avg}(.)Chavg(.))以关注局部特征。然后,我们使用大核(即7x7,如[17])卷积层来增强特征间的局部上下文关系。之后,我们应用Sigmoid激活(σ)计算注意力权重。最后,我们将这些权重馈送到输入x(使用Hadamard乘积⊛)以更有针对性地关注信息。SAB(.)(图2(i))由公式8定义:

SAB(x)=σ(LKC([Chmax(x),Chavg(x)]))⊛x(8)SAB(x)=\sigma\left(LKC([Ch_{max}(x),Ch_{avg}(x)])\right)\circledast x \qquad (8)SAB(x)=σ(LKC([Chmax(x),Chavg(x)]))⊛x(8)

3.1.3 高效上卷积块(EUCB)

我们使用高效上卷积块来逐步上采样当前阶段的特征图,以匹配下一个跳跃连接特征图的尺寸和分辨率。EUCB首先使用上采样Up(.)(比例因子2)来放大特征图。然后,它通过应用3x3深度可分离卷积DWC(.)后接BN(.)和ReLU(.)激活来增强上采样后的特征图。最后,使用1x1卷积C1×1(.)C_{1×1}(.)C1×1(.)将通道数减少以匹配下一阶段。EUCB(.)(图2©)由公式9表述:

EUCB(x)=C1×1(ReLU(BN(DWC(Up(x)))))(9)E U C B(x)=C_{1\times 1}(\operatorname{ReLU}(B N(D W C(U p(x))))) \qquad (9)EUCB(x)=C1×1(ReLU(BN(DWC(Up(x)))))(9)

由于使用深度可分离卷积代替3x3卷积,我们的EUCB非常高效。

3.1.4 分割头(SH)

我们使用分割头从解码器四个阶段的细化特征图产生分割输出。SH层对具有chich_ichi通道(ch_i是阶段i特征图中的通道数)的细化特征图应用1x1卷积Conv1×1(.)_{1×1}(.)1×1(.),并为多类目标数据集产生通道数等于类别数的输出,但对于二值分割则为1通道。SH(.)由公式10表述:

SH(x)=Conv1×1(x)(10)SH(x)=Conv_{1\times 1}(x) \qquad (10)SH(x)=Conv1×1(x)(10)

3.2. 整体架构

为了展示泛化性、有效性以及处理医学图像分割多尺度特征的能力,我们将我们的EMCAD解码器与PVTv2[56]的微型(PVTv2-B0)和标准(PVTv2-B2)网络集成。然而,我们的解码器具有适应性,并可与其他分层骨干网络无缝兼容。

PVTv2与传统的变换器块嵌入模块不同,它应用卷积操作以一致地捕获空间信息。使用PVTv2-b0(微型)和PVTv2-b2(标准)编码器[56],我们开发了PVT-EMCAD-B0和PVT-EMCAD-B2架构。为采用PVTv2,我们首先从四个层提取特征(X1、X2、X3和X4),并将它们(即上采样路径中的X4和跳跃连接中的X3、X2、X1)输入到我们的EMCAD解码器中,如图2(a-b)所示。然后,EMCAD处理它们并产生四个分割图,对应于编码器网络的四个阶段。

3.3. 多阶段损失和输出聚合

我们的EMCAD解码器的四个分割头在其阶段中产生四个预测图p1、p2、p3p_1、p_2、p_3p1、p2、p3和p4p_4p4。

损失聚合 :我们采用了一种组合方法进行损失组合,称为MUTATION,灵感来自MERIT[43]的工作,用于多类分割。这涉及计算来自4个头的所有可能预测组合的损失,总共24−1=152^4-1=1524−1=15个独特预测,然后对这些损失求和。在训练过程中,我们专注于最小化这个累积组合损失。对于二值分割,我们像[42]那样优化加性损失,并附加一个项Lp1+p2+p3+p4\mathcal{L}{p{1}+p_{2}+p_{3}+p_{4}}Lp1+p2+p3+p4,如公式11所示:

Ltotal=αLp1+βLp2+γLp3+ζLp4+δLp1+p2+p3+p4(11)\mathcal{L}{\text{total}}=\alpha\mathcal{L}{p_{1}}+\beta\mathcal{L}{p{2}}+\gamma\mathcal{L}{p{3}}+\zeta\mathcal{L}{p{4}}+\delta\mathcal{L}{p{1}+p_{2}+p_{3}+p_{4}} \qquad (11)Ltotal=αLp1+βLp2+γLp3+ζLp4+δLp1+p2+p3+p4(11)

其中Lp1、Lp2、Lp3\mathcal{L}{p{1}}、\mathcal{L}{p{2}}、\mathcal{L}{p{3}}Lp1、Lp2、Lp3和Lp4\mathcal{L}{p{4}}Lp4是每个单独预测图的损失。α=β=γ=ζ=δ=1.0\alpha=\beta=\gamma=\zeta=\delta=1.0α=β=γ=ζ=δ=1.0是分配给每个损失的权重。

输出分割图聚合 :我们将来自解码器最后阶段的预测图p4p_4p4视为最终分割图。然后,我们通过应用Sigmoid函数(用于二值分割)或Softmax函数(用于多类分割)获得最终分割输出。

4. 实验

在本节中,我们首先介绍实现的详细信息,然后对我们的PVT-EMCAD-B0和PVT-EMCAD-B2与SOTA方法进行对比分析。数据集和评估指标见补充材料第7节。

4.1. 实现细节

我们在单个NVIDIA RTX A6000 GPU(48GB内存)上使用Pytorch 1.11.0实现我们的网络并进行实验。我们利用ImageNet[16]预训练的PVTv2-b0和PVTv2-b2[56]作为编码器。在解码器的MSDC中,我们通过消融研究设置多尺度核[1,3,5]。在所有实验中,我们使用深度可分离卷积的并行排列。我们的模型使用AdamW优化器[36]进行训练,学习率和权重衰减均为1e-4。我们通常训练200个epoch,批量大小为16,但Synapse多器官(300个epoch,批量大小6)和ACDC心脏器官(400个epoch,批量大小12)除外,根据DICE分数保存最佳模型。我们将图像大小调整为352×352,并对ClinicDB[3]、Kvasir[29]、ColonDB[51]、ETIS[51]、BKAI[40]、ISIC17[15]和ISIC18[15]使用多尺度{0.75,1.0,1.25}训练策略,梯度裁剪限制为0.5;对于BUSI[1]、EM[6]和DSB18[4],我们将图像大小调整为256×256。对于Synapse和ACDC数据集,图像大小调整为224×224,采用随机旋转和翻转增强,优化组合的交叉熵(0.3)和DICE(0.7)损失。对于二值分割,我们使用加权的二元交叉熵(BCE)和加权IoU损失函数。

4.2. 结果

我们将我们的架构(即PVT-EMCAD-B0和PVT-EMCAD-B2)与SOTA的基于CNN和基于变换器的分割方法在属于六类医学图像分割任务的12个数据集上进行比较。定性结果见补充材料第7.3节。

4.2.1 二值医学图像分割结果

表1和图1显示了不同方法在10个二值医学图像分割数据集上的结果。我们的PVT-EMCAD-B2以仅26.76M参数和5.6G FLOPs获得了最高的平均DICE分数(91.10%)。我们EMCAD解码器中的多尺度深度可分离卷积与变换器编码器结合,为这些性能提升做出了贡献。

息肉分割:表1显示,我们的PVT-EMCAD-B2在五个息肉分割数据集中超越了所有SOTA方法。PVT-EMCAD-B2在ClinicDB、ColonDB、ETIS、Kvasir和BKAI-IGI上的DICE分数分别比PolypPVT提高了1.08%、0.78%、2.36%、1.19%和1.79%,尽管参数和FLOPs略多。最小的模型UNeXt在所有五个息肉分割数据集中表现最差。我们仅具3.92M参数和0.84G FLOPs的较小模型也优于所有方法,除了PVT-CASCADE(在Kvasir和BKAI-IGH)和SSFormer-L(在ColonDB),这些方法在SOTA方法中表现最佳。总之,我们的PVT-EMCAD-B2在这五个息肉分割数据集中取得了新的SOTA结果。

皮肤病变分割:表1显示PVT-EMCAD-B2在ISIC17和ISIC18皮肤病变分割数据集上表现出色,分别获得85.95%和90.96%的DICE分数,分别超过DeepLabV3+ 2.11%和2.32%。它还在ISIC17和ISIC18上分别击败了最接近的方法PVT-CASCADE 0.45%和0.55%,尽管我们的解码器比CASCADE显著更高效。我们的PVT-EMCAD-B0也显示出在点护理应用(如皮肤病变分割)中的巨大潜力,仅需3.92M参数和0.84G FLOPs。

细胞分割:为了评估我们方法在生物成像中的有效性,我们使用DSB18[4]进行细胞核分割和EM[6]进行细胞结构分割。

4.2.2 腹部器官分割结果

表2显示,我们的PVT-EMCAD-B2在Synapse多器官数据集上的腹部器官分割中表现优异,实现了83.63%的最高平均DICE分数,超越了所有SOTA的基于CNN和基于变换器的方法。它在DICE分数上比PVT-CASCADE提高了2.57%,在HD95距离上减少了4.55,表明在器官边界定位方面更优。我们的EMCAD解码器提升了个体器官的分割性能,在八个器官中的六个上显著优于SOTA方法。

4.2.3 心脏器官分割结果

表3显示了我们的PVT-EMCAD-B2和PVT-EMCAD-B0以及其他SOTA方法在ACDC数据集心脏MRI图像上心脏器官分割的DICE分数。我们的PVT-EMCAD-B2实现了92.12%的最高平均DICE分数,比Cascaded MERIT提高了约0.27%,尽管我们的网络计算成本显著更低。此外,PVT-EMCAD-B2在所有三个器官分割中都有更好的DICE分数。

5. 消融研究

在本节中,我们进行了一系列消融研究,以探索我们架构和实验框架的不同方面。更多消融实验见补充材料第8节。

5.1. EMCAD不同组件的影响

我们在Synapse多器官数据集上进行了一组实验,以理解我们EMCAD解码器不同组件的影响。我们从仅编码器开始,并添加不同的模块,如级联结构、LGAG和MSCAM,以理解它们的效果。表4显示,解码器的级联结构有助于提高性能。LGAG和MSCAM的加入都提升了性能,然而MSCAM被证明更有效。当LGAG和MSCAM模块一起使用时,它产生了83.63%的最佳DICE分数。显然,通过额外的0.381G FLOPs和1.91M参数,DICE分数提高了约3.53%。

5.2. MSCAM中多尺度核的影响

我们在Synapse多器官和ClinicDB数据集上进行了另一组实验,以理解在MSDC中用于深度可分离卷积的不同多尺度核的影响。表5报告了这些结果,显示性能从1x1核到3x3核有所提高。当1x1核与3x3核一起使用时,比单独使用它们性能提升更多。然而,当两个3x3核一起使用时,性能下降。将5x5核与1x1和3x3核结合进一步提高了性能,并在Synapse多器官和ClinicDB数据集中取得了最佳结果。如果我们添加更大的核(例如7x7、9x9),两个数据集的性能都会下降。基于这些经验观察,我们在所有实验中选择[1,3,5]核。

5.3. 与基线解码器的比较

在表6中,我们报告了我们的EMCAD解码器与基线解码器(即CASCADE)的计算复杂性实验结果。从表6可以看出,我们带有PVTv2-b2的EMCAD解码器需要少80.3%的FLOPs和少79.4%的参数,但性能(DICE分数)超过了相应的CASCADE解码器0.85%。类似地,我们带有PVTv2-B0的EMCAD解码器比CASCADE解码器实现了好1.43%的DICE分数,同时参数少78.1%,FLOPs少74.9%。

6. 结论

在本文中,我们提出了EMCAD,一种新颖高效的多尺度卷积注意力解码器,专为医学图像分割中的多阶段特征聚合和细化而设计。EMCAD采用了一个多尺度深度可分离卷积块,这是捕捉特征图内多样化尺度信息的关键,对于医学图像分割的精度至关重要。这一设计选择,使用深度可分离卷积而非标准的3x3卷积块,使得EMCAD显著高效。

我们的实验表明,EMCAD以少79.4%的参数和少80.3%的FLOPs,在DICE分数上超越了最近的CASCADE解码器。我们广泛的实验也证实了EMCAD在涵盖六种不同2D医学图像分割任务的12个公共数据集上,相比SOTA方法具有卓越性能。EMCAD与较小编码器的兼容性使其非常适合点护理应用,同时保持高性能。我们预期我们的EMCAD解码器将成为增强各种医学图像分割和语义分割任务的宝贵资产。

致谢:本工作部分由NSF grant CNS 2007284支持,部分由iMAGiNE Consortium (https://imagine.utexas.edu/) 支持。

补充材料

7. 实验细节

本节通过描述数据集和评估指标,以及补充实验结果,扩展了我们原论文中的第4节。

7.1. 数据集

为了评估我们EMCAD解码器的性能,我们在属于六类医学图像分割任务的12个数据集上进行了实验,如下所述。

息肉分割:我们使用五个息肉分割数据集:Kvasir[29](1,000张图像)、ClinicDB[3](612张图像)、ColonDB[51](379张图像)、ETIS[51](196张图像)和BKAI[40](1,000张图像)。这些数据集包含来自不同成像中心/诊所的图像,在图像性质以及息肉的大小和形状上具有更大的多样性。

腹部器官分割:我们使用Synapse多器官数据集¹进行腹部器官分割。该数据集包含30个腹部CT扫描,有3,779张轴向对比增强切片。每个CT扫描有85-198张512×512像素的切片。遵循TransUNet[8],我们使用相同的18个扫描用于训练(2,212张轴向切片)和12个扫描用于验证。我们仅分割八个腹部器官,即主动脉、胆囊(GB)、左肾(KL)、右肾(KR)、肝脏、胰腺(PC)、脾脏(SP)和胃(SM)。

心脏器官分割:我们使用ACDC数据集²进行心脏器官分割。它包含100个心脏MRI扫描,具有三个子器官,即右心室(RV)、心肌(Myo)和左心室(LV)。遵循TransUNet[8],我们使用70个案例(1,930张轴向切片)进行训练,10个用于验证,20个用于测试。

皮肤病变分割:我们使用ISIC17[15](2,000张训练图像,150张验证图像,600张测试图像)和ISIC18[14](2,594张图像)进行皮肤病变分割。

乳腺癌分割:我们使用BUSI[1]数据集进行乳腺癌分割。遵循[50],我们使用该数据集中的647张图像(437张良性,210张恶性)。

细胞核/结构分割:我们使用DSB18[4](670张图像)和EM[6](30张图像)生物成像数据集进行细胞核/结构分割。

我们在ClinicDB、Kvasir、ColonDB、ETIS、BKAI、ISIC18、DSB18、EM和BUSI数据集中使用80:10:10的训练-验证-测试分割。对于ISIC17,我们使用竞赛组织者提供的官方训练-验证-测试集。

7.2. 评估指标

我们在所有数据集上使用DICE分数评估性能。然而,对于Synapse多器官分割,我们还使用95% Hausdorff距离(HD95)和mIoU作为额外评估指标。DICE分数DSC(Y,P)DSC(Y, P)DSC(Y,P)、IoU分数IoU(Y,P)IoU(Y, P)IoU(Y,P)和HD95距离DH(Y,P)D_{H}(Y, P)DH(Y,P)分别使用公式12、13和14计算:

DSC(Y,P)=2×∣Y∩P∣∣Y∣+∣P∣×100(12)DSC(Y, P)=\frac{2\times|Y\cap P|}{|Y|+|P|}\times 100 \qquad (12)DSC(Y,P)=∣Y∣+∣P∣2×∣Y∩P∣×100(12)

IoU(Y,P)=∣Y∩P∣∣Y∪P∣×100(13)IoU(Y, P)=\frac{|Y\cap P|}{|Y\cup P|}\times 100 \qquad (13)IoU(Y,P)=∣Y∪P∣∣Y∩P∣×100(13)

DH(Y,P)=max{maxy∈Yminp∈Pd(y,p),{maxp∈Pminy∈Yd(y,p)}(14)D_{H}(Y,P)=\max\left\{\max_{y\in Y}\min_{p\in P}d(y,p),\{\max_{p\in P}\min_{y\in Y}d(y,p)\}\right. \qquad (14)DH(Y,P)=max{y∈Ymaxp∈Pmind(y,p),{p∈Pmaxy∈Ymind(y,p)}(14)

其中Y和P分别是真实分割图和预测分割图。

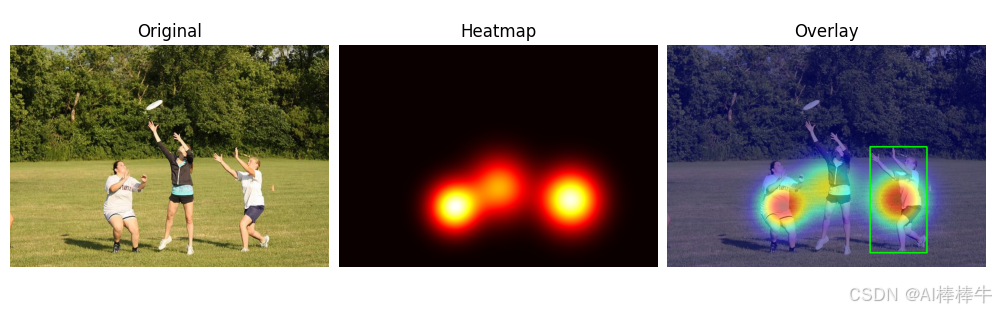

7.3. 定性结果

本小节描述了不同方法(包括我们的EMCAD)的定性结果。从图4中Synapse多器官数据集的定性结果可以看出,大多数方法在分割左肾(橙色)和部分胰腺(粉色)方面面临挑战。然而,我们的PVT-EMCAD-B0(图4g)和PVT-EMCAD-B2(图4h)能够更准确地分割这些器官(见红色矩形框),且计算成本显著更低。类似地,图5中ClinicDB数据集代表性图像的息肉分割定性结果显示,我们的PVT-EMCAD-B0(图5p)和PVT-EMCAD-B2(图5q)的预测分割输出与真实标签(GroundTruth)掩码(图5r)高度重叠,而现有的SOTA方法表现出息肉的错误分割(见红色矩形框)。

8. 额外消融研究

本节通过详细说明与我们架构设计和实验设置相关的五个额外消融研究,进一步阐述第5节。

8.1. 并行与顺序深度可分离卷积

我们进行了另一组实验来决定是在MSDC中使用并行还是顺序的多尺度深度可分离卷积。表7展示了这些实验的结果,显示尽管并行卷积提供了略微改进的性能(0.03%至0.15%),但排列方式没有显著影响。我们还观察到在顺序卷积的情况下,运行间的标准偏差较高。因此,在所有实验中,我们使用并行的多尺度深度可分离卷积。

8.2. 我们的大核分组注意力门(LGAG)相对于注意力门(AG)的有效性

表8展示了使用原始AG[41]和我们的LGAG的EMCAD实验结果。我们可以得出结论,我们的LGAG以显著减少的参数(PVT-EMCAD-B0减少82.57%,PVT-EMCAD-B2减少91.17%)和FLOPs(PVT-EMCAD-B0减少67.06%,PVT-EMCAD-B2减少83.03%)实现了更好的DICE分数。对于具有更多通道数的较大模型,参数和FLOPs的减少更大。因此,我们的LGAG展示了改进的可扩展性,对于具有更多通道的模型,产生增强的DICE分数。

8.3. 从ImageNet预训练权重进行迁移学习的效果

我们在Synapse多器官数据集上进行了实验,以展示从ImageNet预训练编码器进行迁移学习的效果。表9报告了这些实验的结果,显示从ImageNet预训练的PVT-v2编码器进行迁移学习显著提升了性能。具体来说,对于PVT-EMCAD-B0,DICE、mIoU和HD95分数分别提高了4.5%、5.92%和2.54。同样,对于PVT-EMCAD-B2,DICE、mIoU和HD95分数分别提高了3.45%、4.44%和3.15。我们还可以得出结论,迁移学习对较小的PVT-EMCAD-B0模型的影响相对大于较大的PVT-EMCAD-B2模型。对于个体器官,迁移学习显著提升了所有器官分割的性能,除了胆囊(GB)。

8.4. 深度监督的效果

我们进行了一项消融研究,取消了深度监督(DS)。表10给出了我们的PVT-EMCAD-B2在七个数据集上的结果。我们的PVT-EMCAD-B2带有DS在七个数据集中的六个上实现了略微更好的DICE分数。在所有数据集中,DS对Synapse多器官数据集的影响最大。

8.5. 输入分辨率的效果

表11展示了我们的PVT-EMCAD-B0和PVT-EMCAD-B2架构在不同输入分辨率下的结果。从该表可以明显看出,DICE分数随着输入分辨率的增加而提高。然而,这些DICE分数的改进伴随着FLOPs的增加。当使用512×512输入时,我们的PVT-EMCAD-B0以仅3.36G FLOPs实现了85.52%的DICE分数。另一方面,当使用512×512输入时,我们的PVT-EMCAD-B2以22.39G FLOPs实现了最佳DICE分数(86.53%)。我们还观察到,当使用256×256输入时,我们的PVT-EMCAD-B2(5.60G FLOPs)的DICE分数比使用3.36G FLOPs的PVT-EMCAD-B0低1.05%。因此,我们可以得出结论,PVT-EMCAD-B0比PVT-EMCAD-B2更适合更大的输入分辨率。

写在最后

学术因方向、个人实验和写作能力以及具体创新内容的不同而无法做到一通百通,关注UP:Ai学术叫叫兽

在所有B站资料中留下联系方式以便在科研之余为家人们答疑解惑,本up主获得过国奖,发表多篇SCI,擅长目标检测领域,拥有多项竞赛经历,拥有软件著作权,核心期刊等经历。

因为经历过所以更懂小白的痛苦!

因为经历过所以更具有指向性的指导!

祝所有科研工作者都能够在自己的领域上更上一层楼!

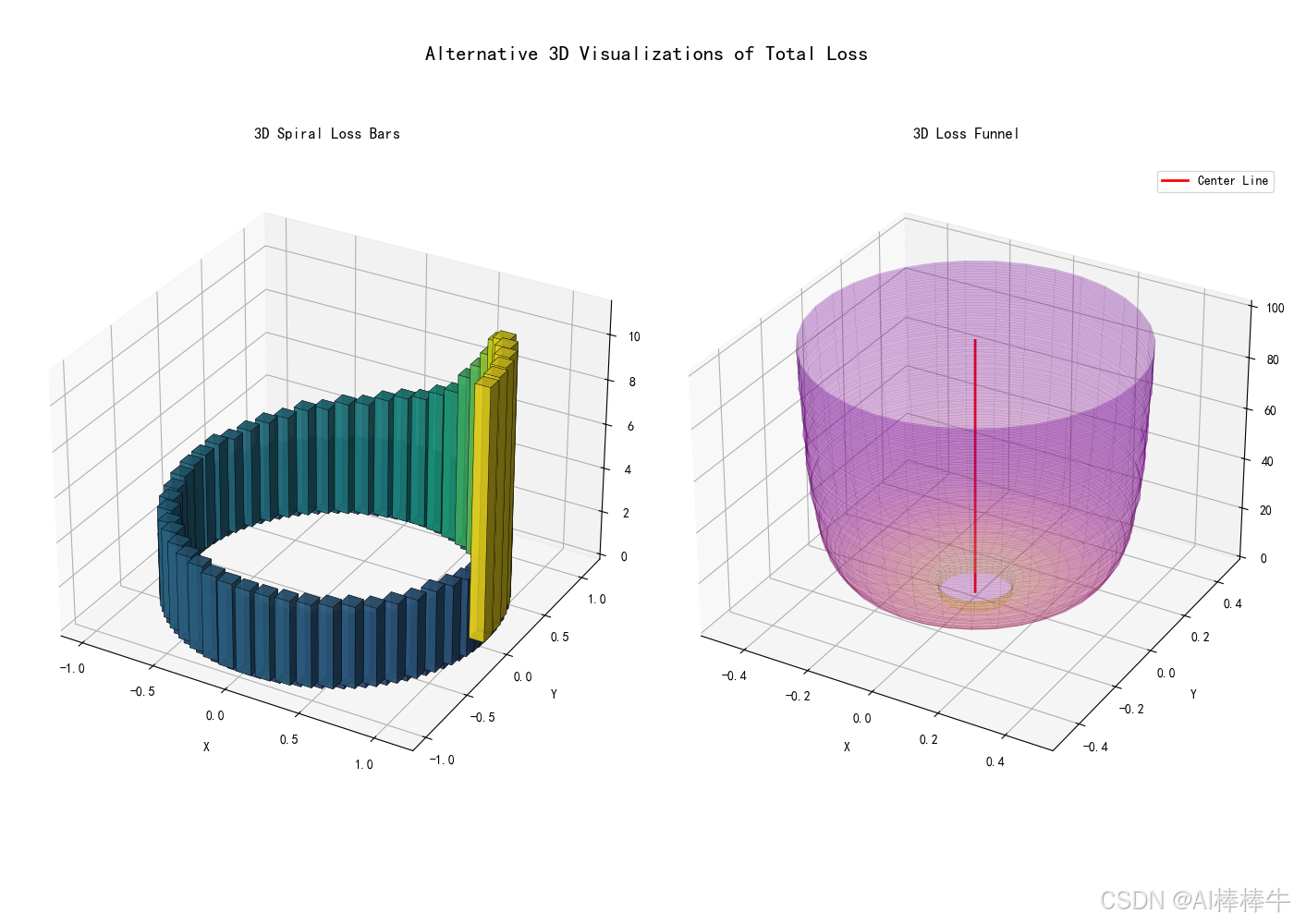

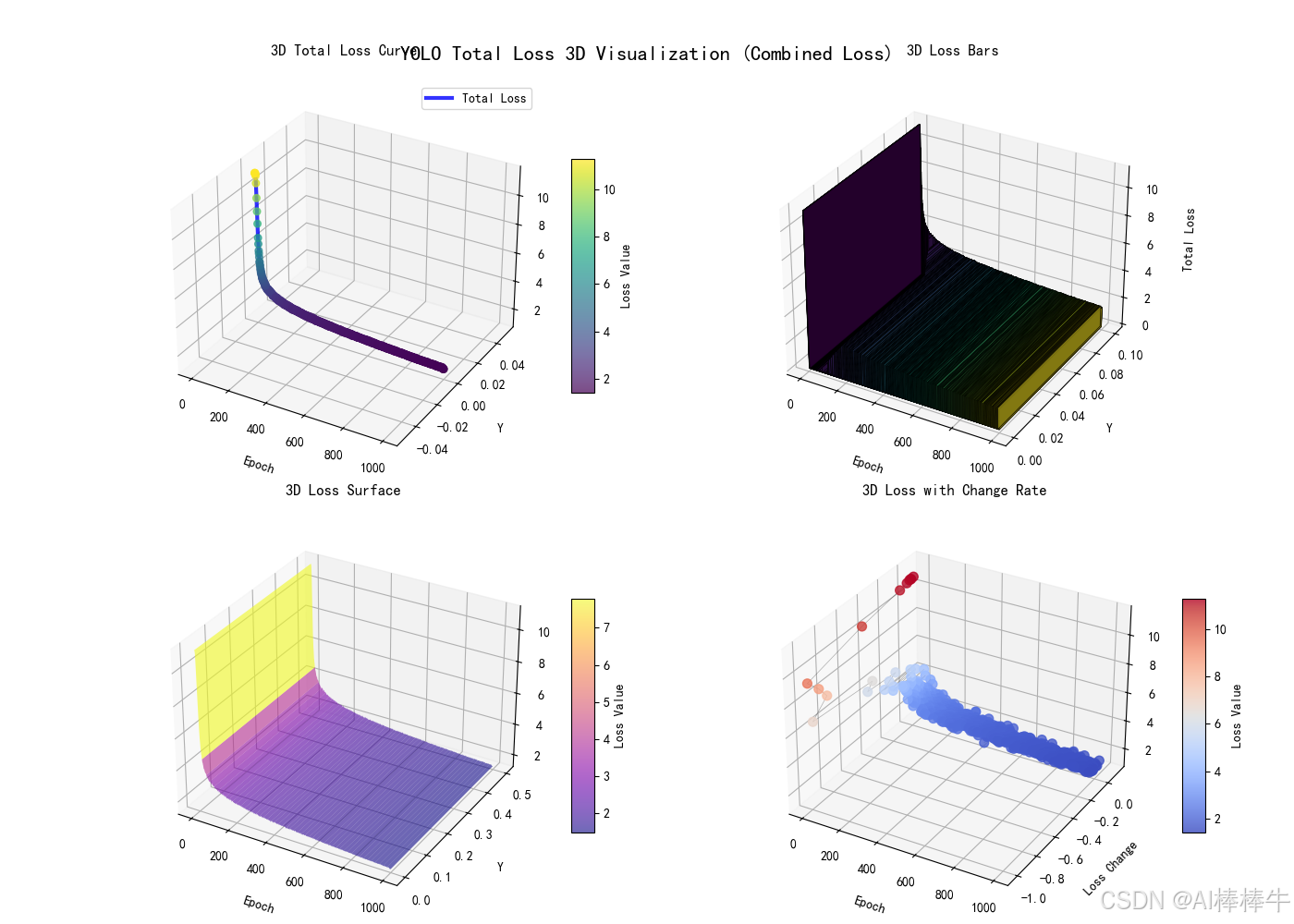

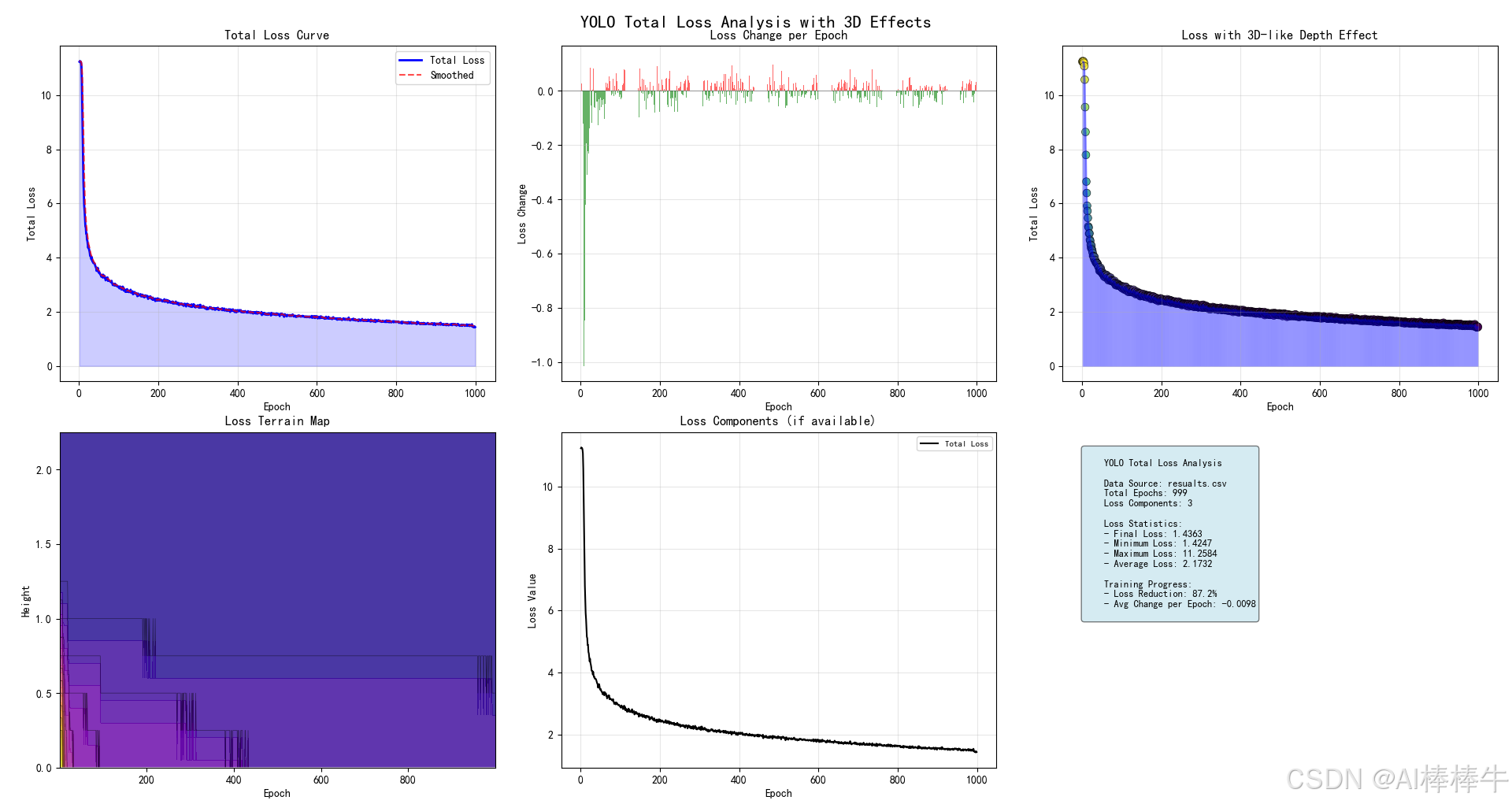

以下为给大家庭小伙伴们免费更新过的绘图代码,均配有详细教程,超小白也可一键操作! 后续更多提升文章档次的资料的更新请大家庭的小伙伴关注UP:Ai学术叫叫兽!