YOLOv13最新创新改进系列:YOLOv13特征可视化,特征提取图,科技感满满,丰富实验神器!!!

购买相关资料后畅享一对一答疑!

畅享超多免费持续更新且可大幅度提升文章档次的纯干货工具!

一、 目的

核心观点

YOLO算法与可视化是相辅相成、互为因果 的关系。可视化并非事后添加的"装饰",而是驱动YOLO算法理解、调试、优化和赢得信任的核心组成部分。

1、前因:为什么YOLO算法离不开可视化?

这源于YOLO算法本身的核心思想和技术特点。

-

革命性的"单阶段"端到端设计

- 背景:在YOLO之前,主流的两阶段检测器(如R-CNN系列)将"目标定位"和"目标分类"分开进行。这个过程相对复杂,中间结果(如候选区域)也较容易可视化理解。

- YOLO的挑战 :YOLO将检测任务视为一个单一的回归问题,直接从图像像素到边界框坐标和类别概率。这个"端到端"的黑盒模型,内部运作机制不像两阶段方法那样直观。

- 可视化的必要性 :为了理解这个"黑盒"究竟是如何做出决策的,研究人员和开发者必须借助可视化工具来窥探其内部工作状态,否则无法进行有效的调试和改进。

-

"分而治之"的网格预测机制

- 核心思想:YOLO将输入图像划分为 S x S 的网格。每个网格单元负责预测固定数量的边界框。

- 可视化的需求 :这种设计天然地提出了一个问题:"每个网格单元到底'看到'了什么?学到了什么?" 如果不将每个网格的预测结果可视化出来,就无法验证算法是否按照预期工作。例如,我们需要看到是否一个负责预测狗的网格,真的对狗的特征敏感。

-

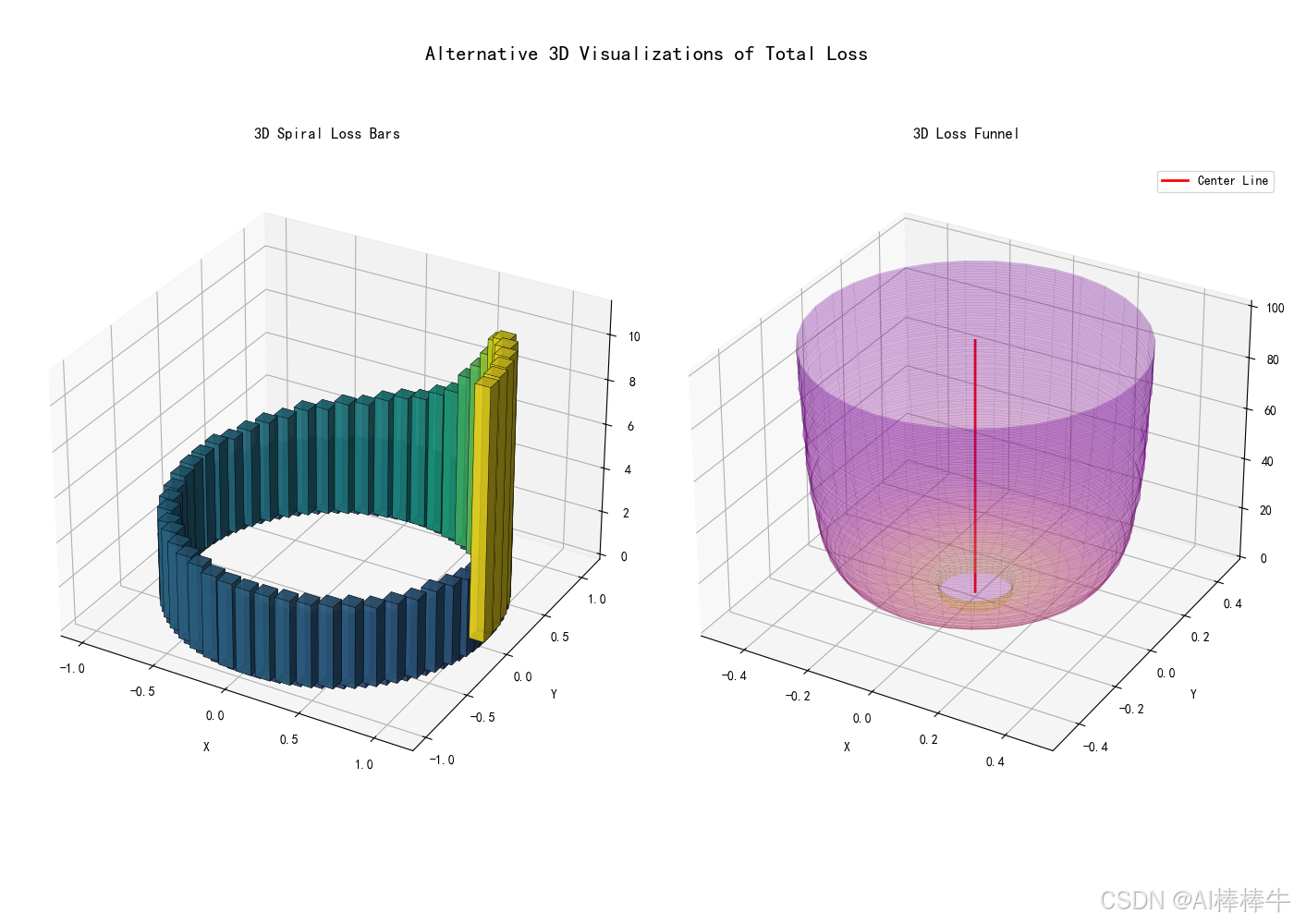

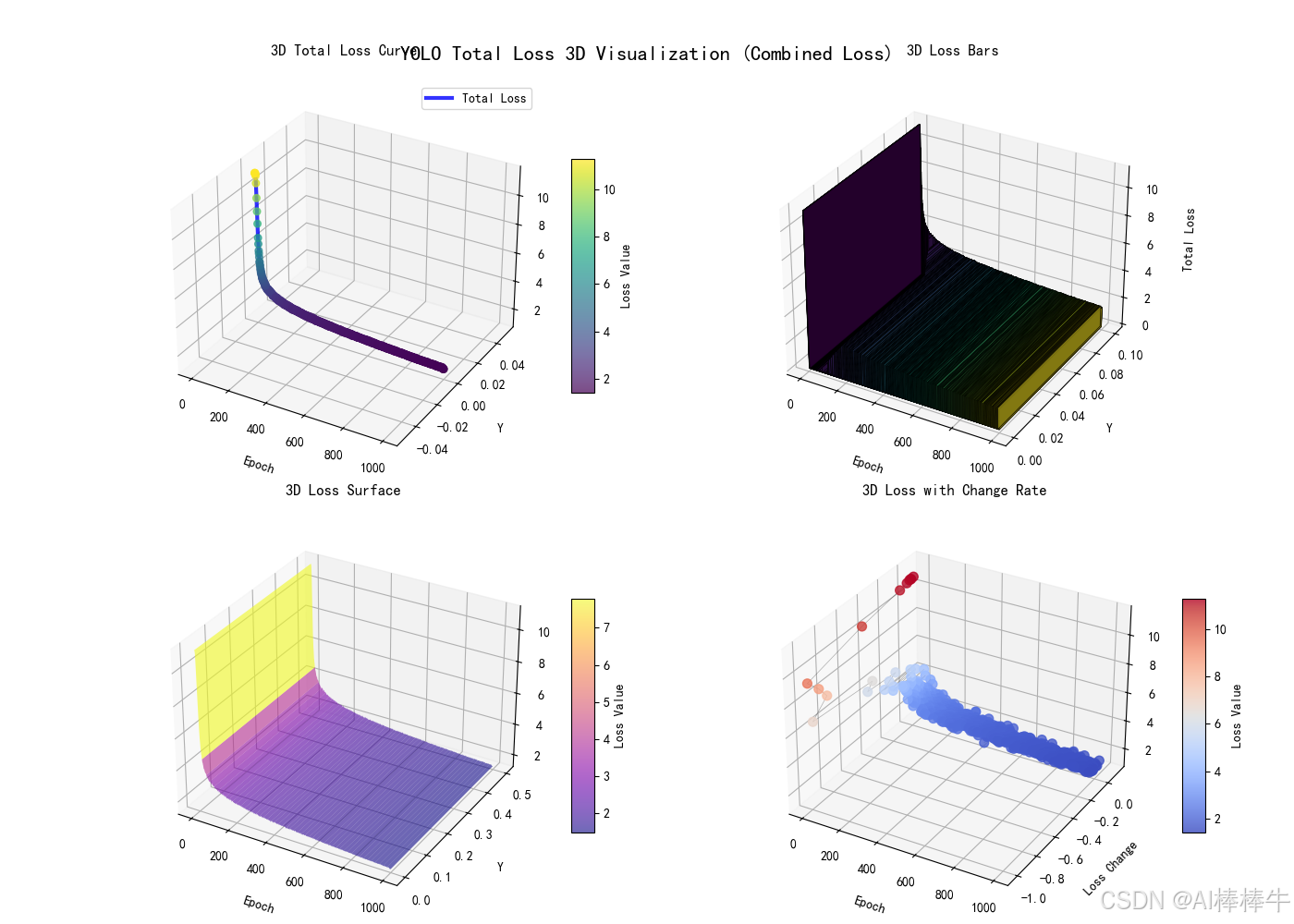

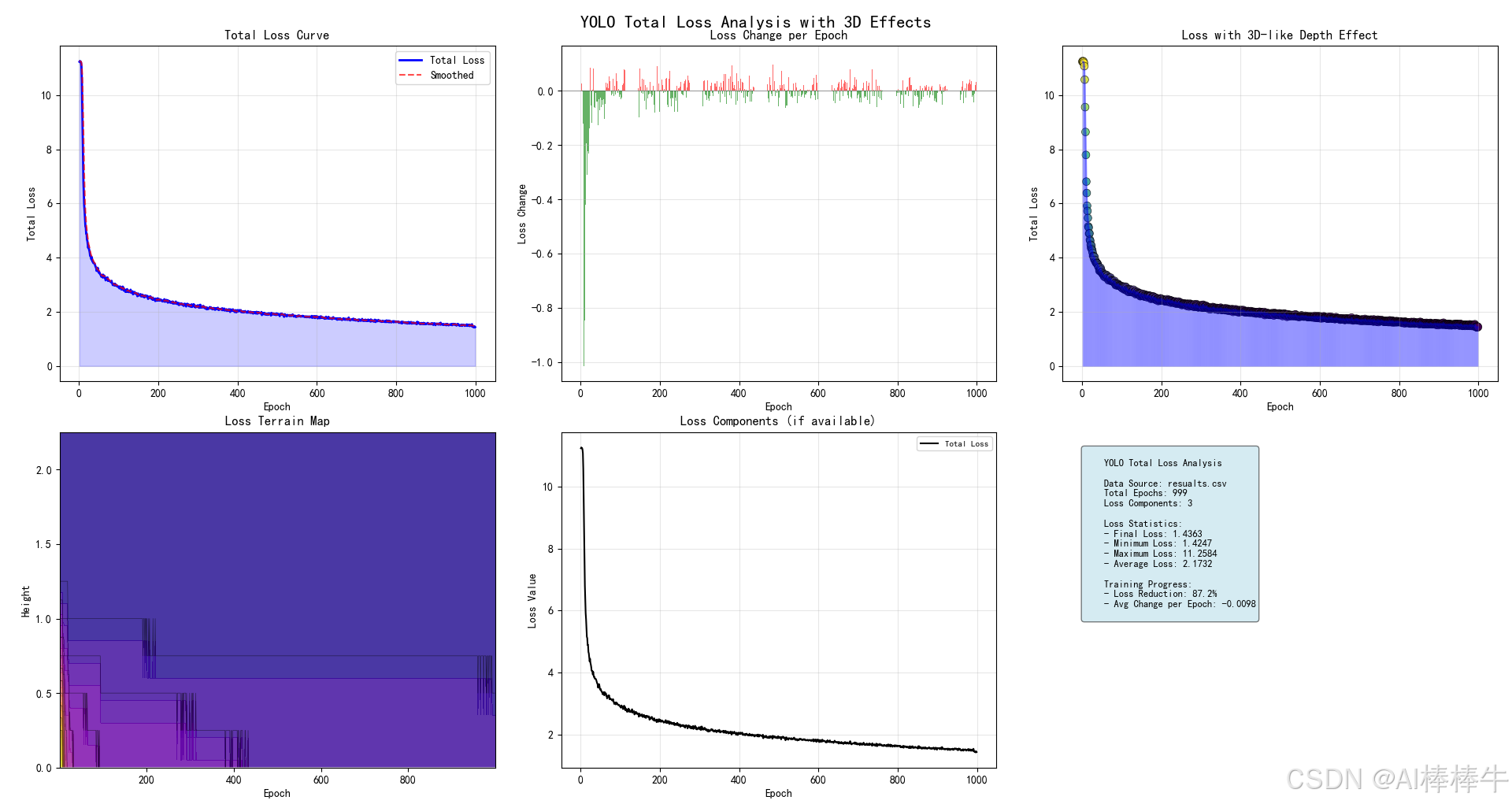

复杂的损失函数

- 多任务学习:YOLO的损失函数同时优化边界框坐标(x, y, w, h)、置信度(是否有物体)和分类概率。这些任务之间存在权衡。

- 调试需求 :当模型表现不佳时,是定位不准?还是误检太多?或是分类错误?仅仅看一个最终损失值是不够的。必须通过可视化损失函数的各个组成部分(如

coord_loss,obj_loss,cls_loss)的变化曲线,才能定位问题根源。

-

建立信任与解释性的需求

- 安全关键应用:在自动驾驶、医疗影像等领域,模型的决策必须是可解释、可信任的。用户不能接受一个"黑盒"突然指出一个行人。

- 可视化的作用:通过可视化模型的注意力区域(如Grad-CAM等技术),可以展示出模型是基于目标的哪些特征(如车头、车轮)做出判断的,从而增加模型的透明度和可信度。

2后果:可视化带来了什么?

可视化技术的应用,直接导致了以下一系列积极的"后果"。

-

促进了算法的理解与迭代(对研究者/开发者)

- 发现模型局限 :早期YOLOv1通过可视化被发现对小物体和密集物体检测效果差。这是因为一个网格只能预测两个框且属于同一类别。这个直观的观察直接驱动了后续版本的改进,如YOLOv2的锚框(Anchor Boxes)、多尺度特征融合等。

- 锚框尺寸的确定 :YOLOv2开始使用锚框。如何确定锚框的尺寸和比例?答案是可视化------对训练集所有标注框的宽高进行聚类分析(如K-means),并将聚类中心可视化,从而得到一组最符合数据分布的先验框尺寸。

-

赋能了模型的调试与优化(对工程师)

- 损失曲线可视化:训练过程中实时绘制损失曲线,可以轻松判断模型是否收敛、是否过拟合,从而调整学习率、早停等。

- 特征图可视化:将中间层的特征图可视化出来,可以看到浅层网络学习边缘、色彩等低级特征,深层网络学习更复杂的语义特征(如车轮、狗头)。这有助于诊断网络是否学到了有效特征。

- 错误分析可视化 :将验证集上的预测结果可视化,可以系统性地分析错误类型:

- 定位错误:框的位置不准。

- 背景误检:把背景当成物体。

- 分类错误:框对了,但类别错了。

- 漏检:没检测到存在的物体。

- 这种可视化的错误分析是优化模型性能(如数据增强、调整损失权重)的最直接依据。

-

增强了结果的直观性与可用性(对终端用户)

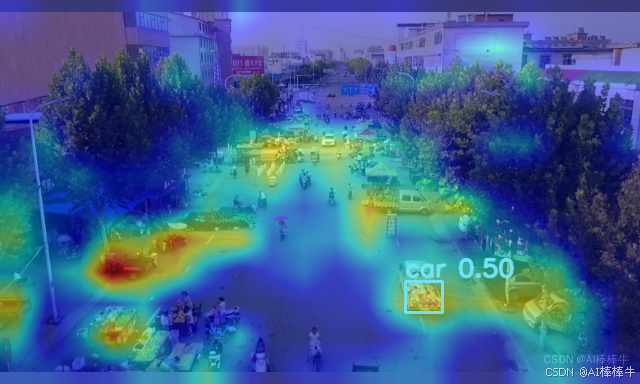

- 最终输出可视化:这是最直接的应用。在图像或视频流上,用不同颜色的框和标签实时标出检测到的物体、置信度。这是YOLO算法价值的最终体现,使其能够应用于视频监控、自动驾驶、机器人等需要人机交互的场景。

- 实时性展示:YOLO的"You Only Look Once"特性,结合实时视频流的可视化,极具冲击力地展示了其高速优势,是其区别于慢速两阶段检测器的"杀手锏"应用。

-

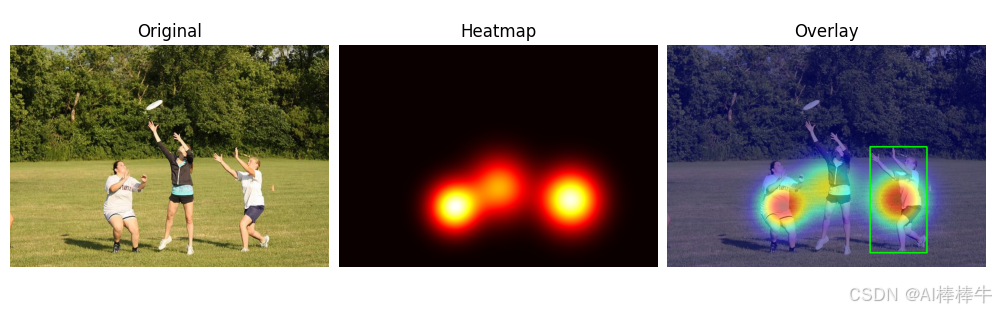

提升了模型的透明性与可信度

- 注意力图可视化:使用类激活图等技术,可以生成一张热力图,显示模型在做出某个特定分类决策时,更关注图像中的哪些区域。如果模型检测到一只"猫",热力图显示它关注的是猫的头部和躯干,那么这个结果就是可信的;如果它关注的是背景中的沙发,那么这个结果就值得怀疑。

总结

| 方面 | 前因(为什么需要可视化) | 后果(可视化带来了什么) |

|---|---|---|

| 算法设计 | YOLO端到端的黑盒特性、网格预测机制需要被理解。 | 驱动了算法迭代(如锚框、FPN的引入),解决了早期版本的缺陷。 |

| 模型开发 | 复杂的多任务损失函数需要精细调试。 | 赋能了高效的模型调试、错误分析和超参数优化。 |

| 应用落地 | 需要直观展示"一次扫描"的快速和准确结果。 | 实现了实时、直观的检测效果展示,是各类应用的基础。 |

| 信任建立 | 在安全关键领域,模型决策必须可解释。 | 通过注意力机制可视化,提升了模型的透明度和可信度。 |

因此,可视化是YOLO算法从诞生、发展到最终广泛应用的生命线 。它既是理解和改进YOLO的原因 ,也是YOLO价值得以体现和放大的结果。

二、 改进教程

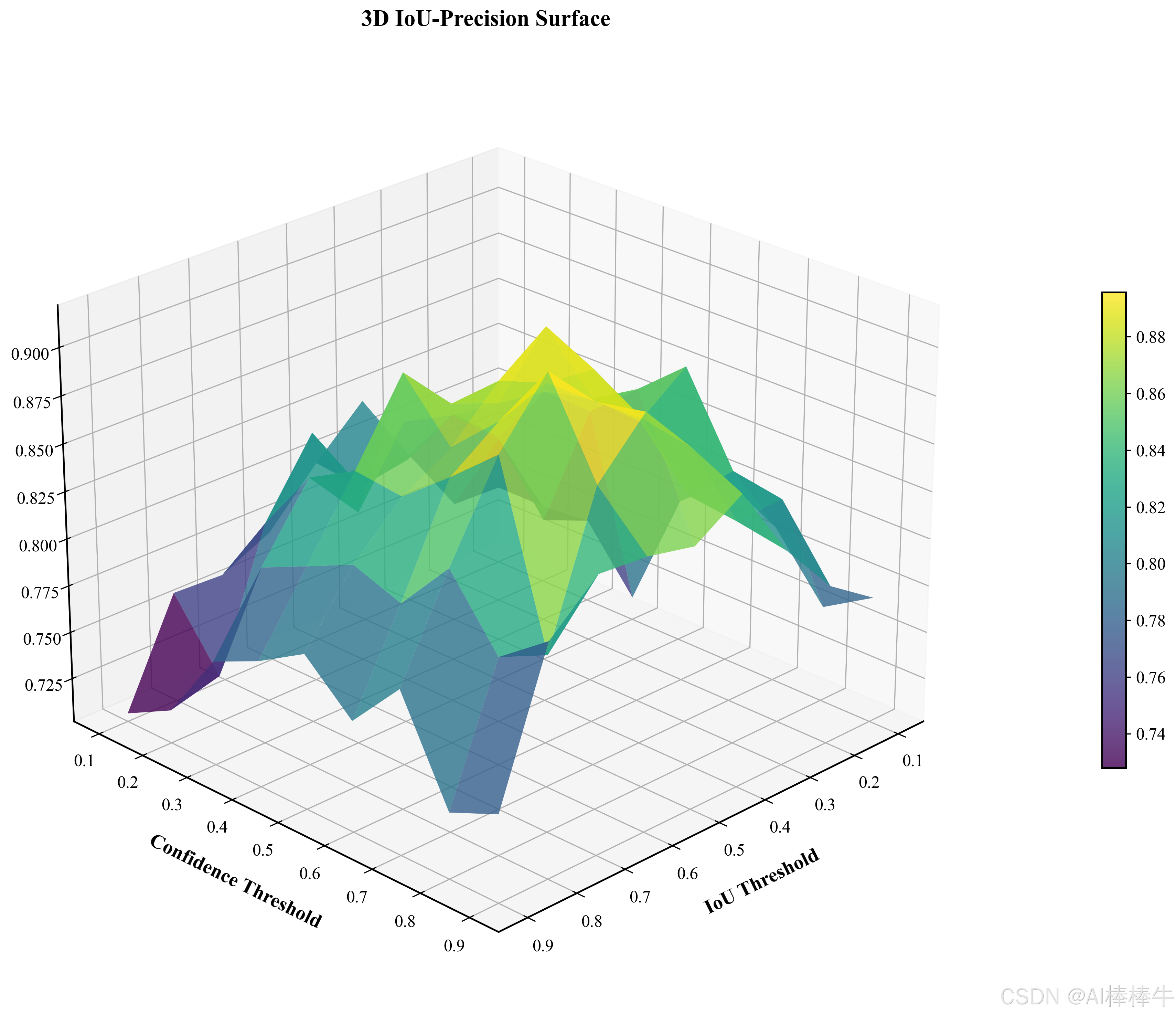

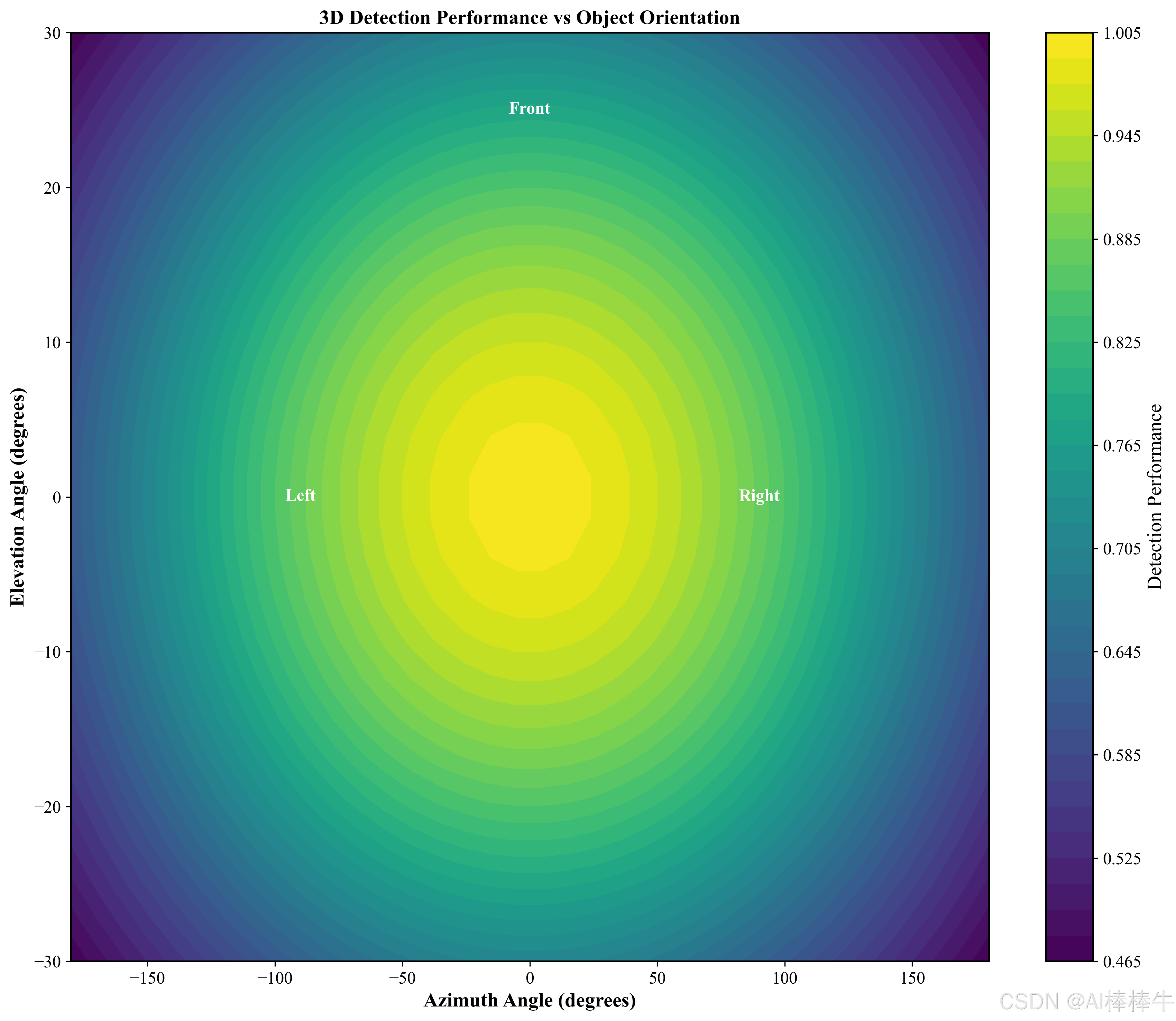

三、效果图

写在最后

学术因方向、个人实验和写作能力以及具体创新内容的不同而无法做到一通百通,关注UP:Ai学术叫叫兽

在所有B站资料中留下联系方式以便在科研之余为家人们答疑解惑,本up主获得过国奖,发表多篇SCI,擅长目标检测领域,拥有多项竞赛经历,拥有软件著作权,核心期刊等经历。

因为经历过所以更懂小白的痛苦!

因为经历过所以更具有指向性的指导!

祝所有科研工作者都能够在自己的领域上更上一层楼!

以下为给大家庭小伙伴们免费更新过的绘图代码,均配有详细教程,超小白也可一键操作! 后续更多提升文章档次的资料的更新请大家庭的小伙伴关注UP:Ai学术叫叫兽!