《九宫元AI具身智能体联合协同指挥防御系统》

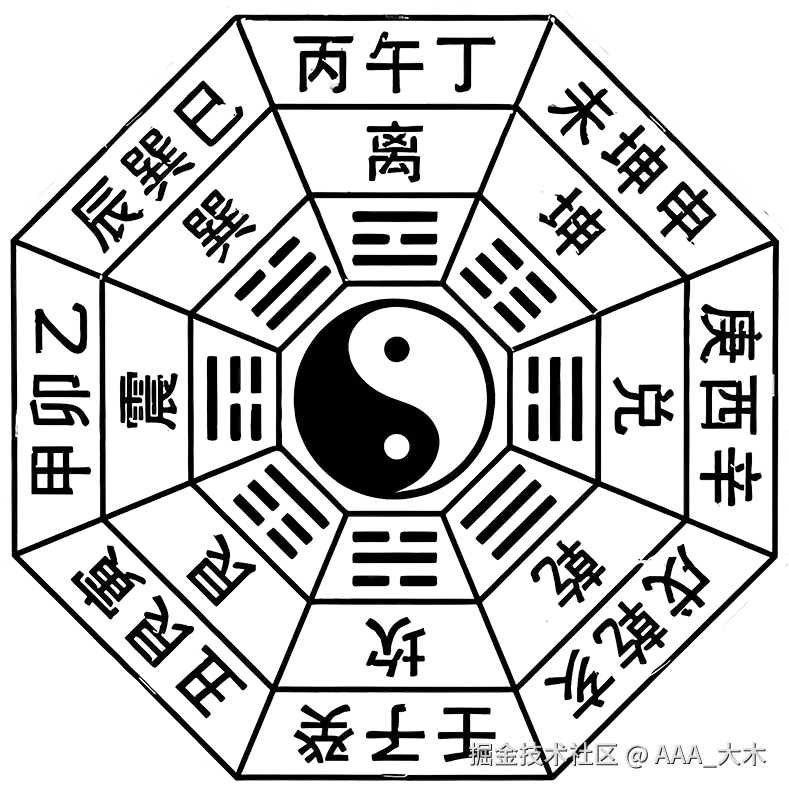

摘要 :本文研究并提出一种将传统阵法智慧与现代AI具身智能体深度融合的创新框架。我构建了一种基于后天九宫八卦阵驱动模型的分布式集群协同防御架构。该架构旨在利用后天八卦阵法的动态演化特性,驱动多智能体系统在复杂动态环境下的自适应编队重构、协同路径规划与弹性防御决策,从而解决传统集群控制方法在非结构化场景中存在的协同效率低、环境适应性差等关键问题。

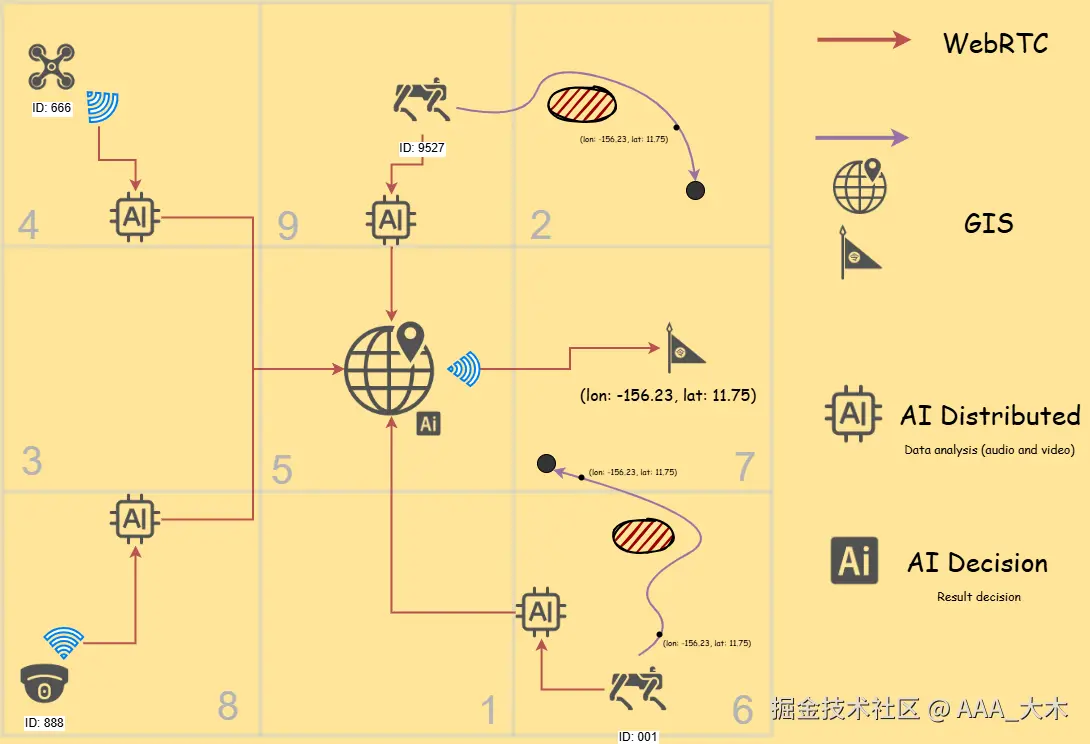

"基于上述融合框架,本文设计了如下的系统架构。该架构在逻辑上划分为七大核心模块,全域通信神经网络,并集成了三种基于传统阵法演化的驱动算法模型。"

- 传统阵法智慧与现代AI具身智能体深度融合

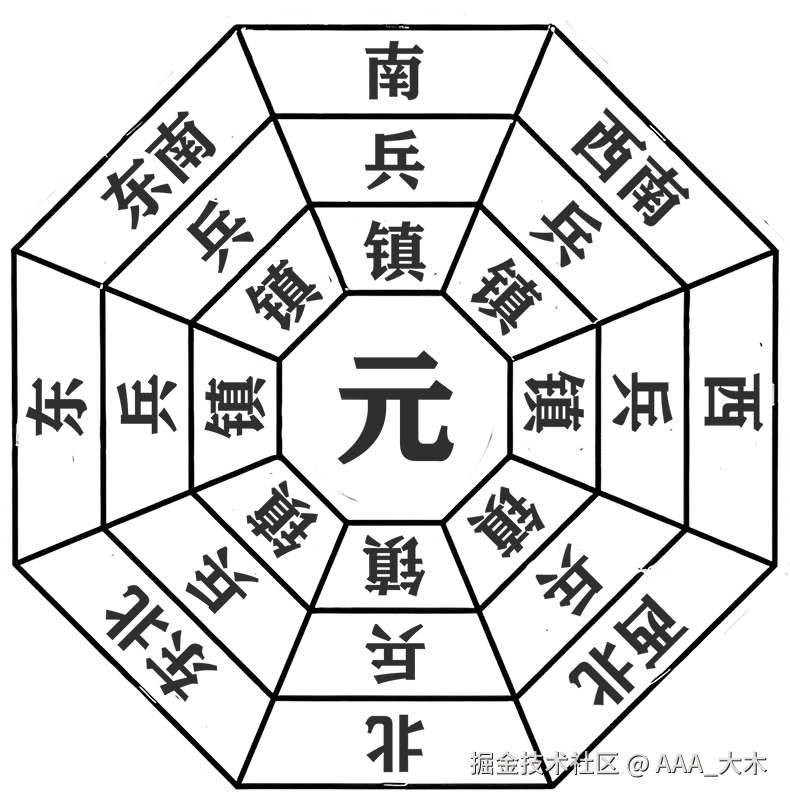

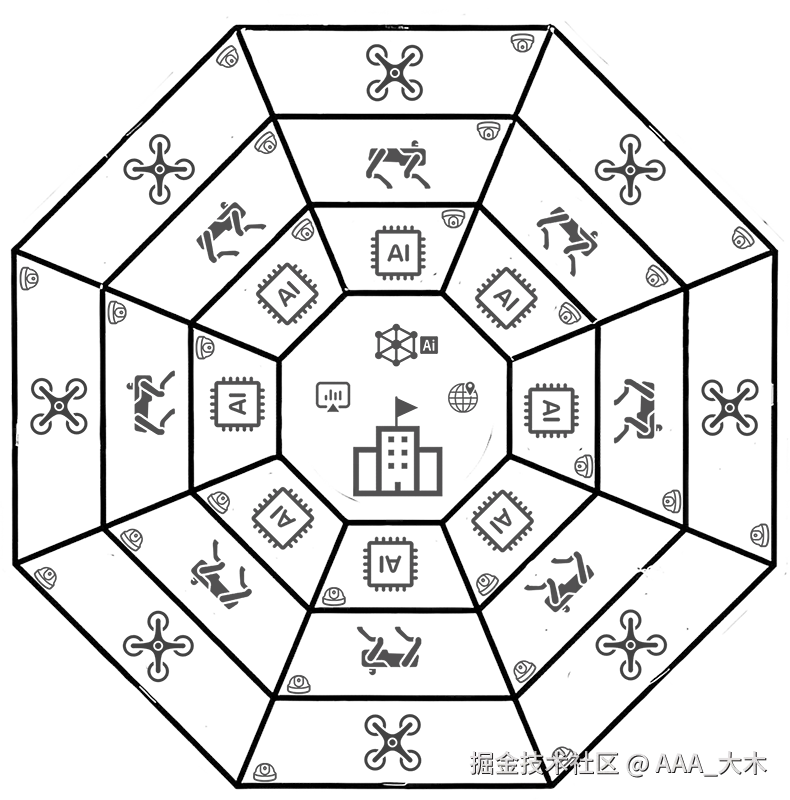

在这一节,重点介绍了"将传统阵法和边缘计算与软件工程如何进行映射 "。

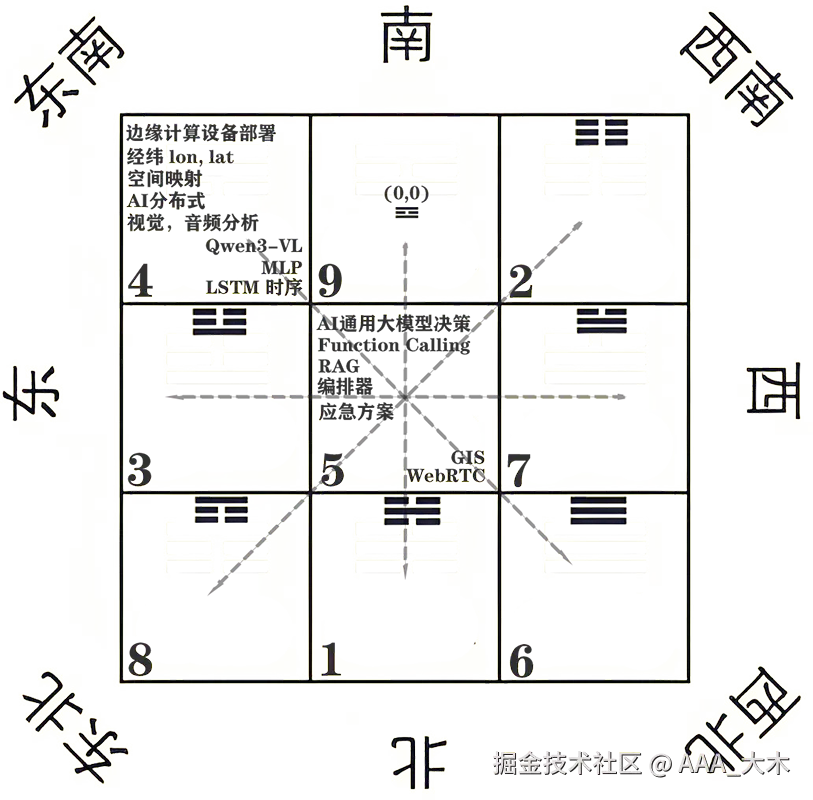

为了清晰展示传统阵法与现代AI系统的映射逻辑,我们首先给出核心映射关系示意图。接下来,将基于该图深入讲解融合机制的设计原理,并结合核心代码片段说明具体实现过程。

图一

图二

图三

图四

-

七大核心模块

在这一节,重点介绍了"整套系统架构中的七大核心模块 "。

这一节,我们将重点攻克整套系统架构中的七大核心模块。经过上一节的介绍,想必大家对架构的深度融合与应用已经有了初步的概念。下面,我将配合上一节的图一至图四,为大家分别做具体的讲解。

(1) 阵为经纬 :经纬模块的核心机制在于构建传统阵法与物理空间之间的精准映射。该模块依据南、西南、西、西北、北、东北、东、东南八个方位,将空间精细切分为九宫格局:[1]。通过这一布局,实现了阵法逻辑、设备部署与资源配置的就绪与统筹。

(2) 兵为武备 :装备部署与资源配置。武备模块依托"阵为经纬"所构建的九宫格局,执行设备的精准部署与资源的优化配置。其核心装备体系包括:内圈机器狗(具备负重能力)、外圈无人机、以及用于态势感知的监控设备等。

(3) 镇为星罗 :星罗模块的核心职能在于提供强大的AI分布式分析能力。该模块依托"兵为武备"前端设备感知回传的多模态数据(涵盖视觉、音频、距离等),利用Qwen3-VL、MLP、LSTM等AI模型及训练方式进行实时处理与深度解析,从而输出精准的分析结果。

(4) 元为枢机 :枢机模块作为系统的核心"元",是最高决策中枢与指挥中心。该模块集成了全方位GIS可视化决策系统与AI通用大模型,并拥有系统的最高权限,能够通过Function Calling、RAG编排器等技术,实现对整个系统的高效指挥与智能调度。

(5) 谋为韬略 :韬略模块,它的主要作用是提供多种应急方案。通过引入由传统阵法演化而来的驱动算法模型,它能够辅助"元"最高指挥官根据数据分析的结果,进行精准的决策和用计。

(6) 通为信令 :信令模块作为整个系统的高速通信神经网络,其地位至关重要。该模块遵循"令"为兵符,"信"为网络的设计哲学,承担着核心指令传输的重任。"元"为最高指挥官通过WebRTC技术P2P对等网络通信模块下发兵符指令,延迟<500ms,实现对系统的全局调动。网络传输的速率与稳定性,直接决定了整体系统的响应效率与最终结果走向。

(7) 易为神变 :最后何为神变,该"九宫元"整套系统架底层逻辑为通用框架,具备极高的可移植性,可深度适配并赋能多行业:[2]业务场景,实现快速开发、部署与上线。

注解:

:[1] :图四为九宫矩阵,可为九宫方位方向分配 1-9 数字权重,"元"为 5 携"令"。

:[2] :智慧安防、智慧工厂、智慧仓储、应急救援等。 -

三种基于传统阵法演化的驱动算法模型

(1) 斗转星移:基于相对坐标变换的动态平移算法首先我们来对照一下图四九宫格局

4 9 2

3 5 7

8 1 6

设想当权重为 9 区域检测到异常时,位于 5 区域的"元"最高指挥官即刻启动决策程序。指挥官携"令"通过GIS系统,将部署中心坐标锁定至 9 区域。随即,系统调度4、9、2、3、7、8、1、6号机器狗(具备负重能力),以目标中心坐标为基准,计算各单元至偏移X米处的终点位置,并基于经纬度规划最优路线,执行协同平移与机动部署。

(2) 相生相克:基于五行属性映射的动态分配算法首先我们来对照一下图四九宫格局

4 9 2

3 5 7

8 1 6

我们提前进行 1-9 区域的属性职责,位于 5 区域的"元"最高指挥官属性为火,3、7 区域机器狗(具备负重能力)属性为水,8、1、6、4、9、2 区域机器狗(具备负重能力)属性为土为封。设想当权重为 3 区域检测到火灾时,位于 5 区域的"元"最高指挥官即刻启动决策程序,指挥官携"令"通过GIS系统,将部署中心坐标锁定至 3 区域进行属性映射。每个区域开始各施其职,3、7区域属性为水的机器狗(具备负重能力)进行灭火,8、1、6、4、9、2区域属性为土为封的机器狗(具备负重能力)进行周边封锁避免出现安全问题。

(3) 请君入瓮:基于状态机同步的动态合围算法首先我们来对照一下图四九宫格局

4 9 2

3 5 7

8 1 6

提前进行 1-9 区域的职责,位于 5 区域的"元"最高指挥官职责为阱,1、9、3、7区域机器狗(具备负重能力)职责为剿,4、2、8、6区域机器狗(具备负重能力)职责为封,设想当权重为 8 区域检测到威胁时,位于 5 区域的"元"最高指挥官即刻启动决策程序,立刻关闭 8 区域防御系统,指挥官携"令"通过GIS系统,将部署中心坐标锁定至 8 区域,其他区域所有的机器狗(具备负重能力)平移并进行围剿和封锁,待 4、2、6区域机器狗(具备负重能力)已就绪时,8 区域开启防御系统。

-

本章内容总结:

综上所述,七大核心模块、三种基于传统阵法演化的驱动算法模型以及全域通信神经网络,共同构建了一个环环相扣的联合协同指挥防御系统闭环。该系统具备高度的灵活性与适应性,既可实施由外而内的纵深防御,亦可执行由内而外的主动出击,实现了全方位的态势感知与精准打击。

摘要 :接下来我们就通过上述章节的内容进行软件工程系统的架构与实现。

-

全域通信神经网络与协同指挥的架构与实现

-

整套系统架构中的相关代码片段

(1) 物理空间映射-坐标系核心在于使用基于GIS系统构建物理空间映射,通过全局坐标系实现空间数据的精准对齐,从而支撑强大的全局掌控与灵活部署能力。

js

static CreateMatrixAxis(lon, lat, scene) {

const center = Cesium.Cartesian3.fromDegrees(lon, lat);

const transform = Cesium.Transforms.eastNorthUpToFixedFrame(center);

// ...

}

static SwitchGeocentricCenterPoint(camera, map, key) {

transform = Cesium.Transforms.eastNorthUpToFixedFrame(center);

camera.lookAtTransform(transform, new Cesium.Cartesian3(-120000.0, -120000.0, 120000.0));

}

FyLocalScopeTag(obj, isFy, howFly) {

billboards.modelMatrix = Cesium.Transforms.eastNorthUpToFixedFrame(center);

billboards.add({

position: new Cesium.Cartesian3(item.center.x, item.center.y, item.center.z)

});

}

DrawMatrixModeling(texture, key, sw) {

const modelBoxMatr = Cesium.Matrix4.multiplyByTranslation(

Cesium.Transforms.eastNorthUpToFixedFrame(psoition),

new Cesium.Cartesian3(0.0, 0.0, model.z * 0.5),

new Cesium.Matrix4()

);

}

let cartographic = Cesium.Cartographic.fromCartesian(cartesian);

let lon = Cesium.Math.toDegrees(cartographic.longitude);

let lat = Cesium.Math.toDegrees(cartographic.latitude);(2) AI分布式数据分析结果至AI通用大模型结果决策-AI架构

核心在于通过全方位的协调调度,把AI模型的应用、微调、训练以及RAG增强检索等技术完美结合起来,让AI的能力和响应速度发挥到最大化。比如,我们用前端设备传来的视频流FFmpeg进行流处理在通过Qwen3-VL来做视觉行为的分析,用MLP神经网络来预测各种环境感知数据,再用LSTM这种擅长处理时序数据的模型,来精准预测音频的波动变化。

rust

#[derive(Debug, Clone)]

#[allow(unused)]

pub struct NetworkLSTM {

lstm: LSTM,

decoder: Linear,

}

#[allow(unused)]

impl NetworkLSTM {

pub fn new(input_size: usize, hidden_size: usize, vb: VarBuilder) -> Result<Self> {

let lstm_config: LSTMConfig = LSTMConfig {

..Default::default()

};

Ok(Self {

lstm: lstm(input_size, hidden_size, lstm_config, vb.pp("lstm"))?,

decoder: linear(hidden_size, 1, vb.pp("decoder"))?,

})

}

pub fn forward(&self, xs: &Tensor, train: bool) -> Result<Tensor> {

let (batch_size, seq_len, _) = xs.dims3()?;

let device: &Device = xs.device();

let mut state: candle_nn::rnn::LSTMState = self.lstm.zero_state(batch_size)?;

for t in 0..seq_len {

let x_t: Tensor = xs.i((.., t, ..))?.contiguous()?;;

state = self.lstm.step(&x_t, &state)?;

}

let h: Tensor = state.h().squeeze(1)?;

self.decoder.forward(&h)

}

pub fn train(

&self,

vm: VarMap,

x_train: Tensor,

y_train: Tensor,

lr: f64,

epochs: usize,

seq_len: usize,

batch_size: usize

) -> Result<()> {

let mut train_loader: DataLoader<'_> = DataLoader::new(

MLPDataset::new(x_train, y_train)?,

batch_size,

true

)?;

// let mut eval_loader: DataLoader<'_> = DataLoader::new(

// MLPDataset::new(x_eval, y_eval)?,

// batch_size,

// false

// )?;

let mut optimizer: AdamW = AdamW::new_lr(vm.all_vars(), 1e-3)?;

let mut train_loss: Vec<f32> = Vec::new();

for epoch in 0..epochs {

train_loader.reset()?;

for batch in &mut train_loader {

let (x_batch, y_batch) = batch?;

let (batch_size, seq_len, _) = x_batch.dims3().expect("error");

let logits: Tensor = self.forward(&x_batch, true)?.squeeze(1)?;

let loss: Tensor = loss::binary_cross_entropy_with_logit(&logits, &y_batch)?;

optimizer.backward_step(&loss)?;

let loss_: f32 = loss.to_scalar::<f32>()?;

train_loss.push(loss_);

println!("--train loss: {:.6}", &loss_);

}

}

Ok(())

}

}

#[derive(Debug, Clone)]

pub struct TFNetworQwen{}

#[allow(unused)]

impl TFNetworQwen{

pub async fn new(config: Qwen3Config4B, io: SocketIo, qdr: Qdrant, device: &Device) -> Result<()> {

/* load -> model tokenizer */

let tokenizer: Tokenizer = Tokenizer::from_file(config.tokenizer_file)

.expect("xxx tokenizer.json file not found. xxx");

/* load -> model config */

let conf: Config =

serde_json::from_slice(&std::fs::read(config.config_file)?)

.expect("xxx config file read failed. xxx");

/* load -> model weight(read-only) */

let vb: VarBuilderArgs<'_, Box<dyn SimpleBackend>> = unsafe {

VarBuilder::from_mmaped_safetensors(

&config.weight_files,

DType::F16,

&device,

).expect("error")

};

let mut model: ModelForCausalLM = ModelForCausalLM::new(&conf, vb).expect("error");

let mut logits_processor: LogitsProcessor = LogitsProcessor::new(299792458, None, None);

let mut history_prompt_vec: Vec<u32> = Vec::new();

loop {

/* /* Student Model */ */

let varmap_j_d: VarMap = VarMap::new();

let vb_j_d: VarBuilderArgs<'_, Box<dyn SimpleBackend>> = VarBuilder::from_varmap(&varmap_j_d, DType::F32, &device);

let config_j_d: NetConfigLLM = NetConfigLLM::default()?;

/* /* Build Student Model Network */ */

let mut model_j_d: NetworkLLM = NetworkLLM::new(vb_j_d, &config_j_d)?;

// println!("{:?}", &history_prompt_vec);

Self::just_distillation(&mut model_j_d, varmap_j_d, &config_j_d, &history_prompt_vec, &tokenizer, &device)?;

continue;

}

/* function calling */

if start_context.trim().eq("f_c") {

println!("Hello, sir! input bye quit...");

let mut start_f_c_context: String = String::new();

std::io::stdin()

.read_line(&mut start_f_c_context)

.expect("xxx Unable to read input for chat. xxx");

let config: BertConfigRag = BertConfigRag::default()?;

let mut net: BERTNetworRAG = BERTNetworRAG::new(config, &device)?;

continue;

}

start_context += "<think></think>";

let tokens: Vec<u32> = Self::str_escape_ids(&start_context, &tokenizer, &device)?

.squeeze(0)?

.to_vec1()?;

history_prompt_vec.extend(&tokens);

let _ = Self::run(

&mut model,

&tokenizer,

&mut logits_processor,

&mut history_prompt_vec,

tokens,

10000,

1.1,

64,

&device,

)?;

}

Ok(())

}

pub fn str_escape_ids(str: &str, tokenizers: &Tokenizer, device: &Device) -> Result<Tensor> {

let encode: tokenizers::Encoding = tokenizers

.encode(str, true)

.map_err(|e| Error::Msg(format!("xxx tokenizer encode error{} xxx", e)))?;

let token_ids: &[u32] = encode.get_ids();

let len: usize = token_ids.len();

let tensor: Tensor = Tensor::from_slice(token_ids, (1, len), device)?;

Ok(tensor)

}

}

js

import { Injectable, OnModuleInit } from '@nestjs/common';

import ffmpeg from 'fluent-ffmpeg';

import ffmpegPath from 'ffmpeg-static';

import { promises as fs } from 'fs';

import * as path from 'path';

@Injectable()

export class TemplateApiFFmpegService implements OnModuleInit {

private isFfmpegAvailable = false;

async onModuleInit() {

await this.initializeFfmpeg();

};

private async initializeFfmpeg() {

try {

if (ffmpegPath) {

ffmpeg.setFfmpegPath(ffmpegPath);

// console.log('FFmpeg path already set:', ffmpegPath);

} else {

ffmpeg.setFfmpegPath('ffmpeg');

};

this.isFfmpegAvailable = true;

console.log('FFmpeg init');

} catch (error) {

console.error('FFmpeg init failure:', error);

this.isFfmpegAvailable = false;

};

};

public isAvailable(): boolean {

return this.isFfmpegAvailable;

};

public async getVideoInfo(filePath: string): Promise<any> {

return new Promise((resolve, reject) => {

if (!this.isFfmpegAvailable) {

reject(new Error('FFmpeg Unavailable'));

return;

};

ffmpeg.ffprobe(filePath, (err, metadata) => {

if (err) {

reject(err);

return;

};

resolve(metadata);

});

});

};

public async extractVideoFrames(

videoPath: string,

outputFiletDir: string,

outputFileName: string,

options: { fps?: number; count?: number; size?: string } = {},

): Promise<string[]> {

return new Promise(async (resolve, reject) => {

if (!this.isFfmpegAvailable) {

reject(new Error('FFmpeg Unavailable'));

return;

};

try {

await fs.mkdir(outputFiletDir, { recursive: true });

} catch (error) {

};

const fps = options.fps || 1;

const size = options.size || '64x64';

ffmpeg(videoPath)

.outputOptions([

`-r ${fps}`,

`-s ${size}`,

'-q:v 2'

])

.output(path.join(process.cwd(), outputFiletDir, outputFileName))

.on('start', (commandLine) => {

console.log(`start-extract-video-frames-${new Date().toLocaleTimeString()}:`, commandLine);

})

.on('progress', (progress) => {

console.log(`Processing: ${progress.percent}% done`);

})

.on('end', async () => {

try {

const files = await fs.readdir(outputFiletDir);

const frameFiles = files

.filter(file => file.startsWith('frame-') && file.endsWith('.jpg'))

.sort()

.map(file => path.join(process.cwd(), 'static/game/images', file));

console.log(`success-${frameFiles.length}-frame`);

resolve(frameFiles);

} catch (error) {

reject(error);

};

})

.on('error', (err) => {

console.error('frame error:', err);

reject(err);

})

.run();

});

};

public async extractVideoAudio(

videoPath: string,

outputFiletDir: string,

outputFileName: string,

options: { format?: string; bitrate?: string } = {},

): Promise<string[]> {

return new Promise(async (resolve, reject) => {

if (!this.isFfmpegAvailable) {

reject(new Error('FFmpeg Unavailable.'));

return;

};

try {

await fs.mkdir(outputFiletDir, { recursive: true });

} catch (error) {

};

const bitrate = options.bitrate || '128k';

ffmpeg(videoPath)

.outputOptions([

`-b:a ${bitrate}`,

'-vn',

'-acodec', 'libmp3lame'

])

.output(path.join(process.cwd(), outputFiletDir, outputFileName))

.on('start', (commandLine) => {

console.log(`start-extract-video-audio-${new Date().toLocaleTimeString()}:`, commandLine);

})

.on('progress', (progress) => {

console.log(`Processing: ${progress.percent}% done`);

})

.on('end', async () => {

try {

const files = await fs.readdir(outputFiletDir);

const frameFiles = files

.filter(file => file.startsWith('frame-') && file.endsWith('.mp3'))

.sort()

.map(file => path.join(process.cwd(), 'static/game/audio', file));

resolve(frameFiles);

} catch (error) {

reject(error);

};

})

.on('error', (err) => {

console.error('audio extraction error:', err);

reject(err);

})

.run();

});

};

};(3) 全域神经网络通讯-毫秒级

核心在于依托 WebRTC 协议的低延迟特性,构建全军毫秒级的响应能力,从而精准掌控并决定整体战局的最终走向。

rust

#[allow(unused)]

pub async fn io_service(socket: SocketRef) {

println!("Socket connected: {}", socket.id);

// ======================================= New WebRTC Client Receiver ============================================

let h264_writer: Arc<Mutex<dyn webrtc::media::io::Writer + Send + Sync>> =

Arc::new(Mutex::new(H264Writer::new(File::create("video.h264").expect("error"))));

let ogg_writer: Arc<Mutex<dyn webrtc::media::io::Writer + Send + Sync>> = Arc::new(Mutex::new(

OggWriter::new(File::create("audio.ogg").expect("error"), 48000, 2).expect("error"),

));

let mut m: MediaEngine = MediaEngine::default();

/* WebRTC Signaling Service Please use. WebRTC Client Receiver Please Close. */

m.register_default_codecs().expect("error");

m.register_codec(

RTCRtpCodecParameters {

capability: RTCRtpCodecCapability {

mime_type: MIME_TYPE_H264.to_owned(),

clock_rate: 90000,

channels: 0,

sdp_fmtp_line: "".to_owned(),

rtcp_feedback: vec![],

},

payload_type: 102,

..Default::default()

},

RTPCodecType::Video,

).expect("error");

m.register_codec(

RTCRtpCodecParameters {

capability: RTCRtpCodecCapability {

mime_type: MIME_TYPE_OPUS.to_owned(),

clock_rate: 48000,

channels: 2,

sdp_fmtp_line: "".to_owned(),

rtcp_feedback: vec![],

},

payload_type: 111,

..Default::default()

},

RTPCodecType::Audio,

).expect("error");

let mut registry: Registry = Registry::new();

registry = register_default_interceptors(registry, &mut m).expect("error");

let api: API = APIBuilder::new()

.with_media_engine(m)

.with_interceptor_registry(registry)

.build();

let config: RTCConfiguration = RTCConfiguration {

ice_servers: vec![RTCIceServer {

urls: vec!["stun:stun.l.google.com:19302".to_owned(), "stun:stun1.l.google.com:19302".to_owned()],

..Default::default()

}],

..Default::default()

};

// data stream

let peer_connection: Arc<RTCPeerConnection> = Arc::new(api.new_peer_connection(config).await.expect("error"));

// Allow us to receive 1 audio track, and 1 video track

peer_connection

.add_transceiver_from_kind(RTPCodecType::Audio, None)

.await.expect("error");

peer_connection

.add_transceiver_from_kind(RTPCodecType::Video, None)

.await.expect("error");

let notify_tx: Arc<Notify> = Arc::new(Notify::new());

let notify_rx: Arc<Notify> = notify_tx.clone();

// audio and video stream

let pc: std::sync::Weak<RTCPeerConnection> = Arc::downgrade(&peer_connection);

peer_connection.on_track(Box::new(move |track: Arc<TrackRemote>, _, _| {

// Send a PLI on an interval so that the publisher is pushing a keyframe every rtcpPLIInterval

let media_ssrc: u32 = track.ssrc();

let pc2: std::sync::Weak<RTCPeerConnection> = pc.clone();

tokio::spawn(async move {

let mut result: std::prelude::v1::Result<usize, anyhow::Error> = Result::<usize>::Ok(0);

while result.is_ok() {

let timeout: Sleep = tokio::time::sleep(Duration::from_secs(3));

tokio::pin!(timeout);

tokio::select! {

_ = timeout.as_mut() =>{

if let Some(pc) = pc2.upgrade(){

result = pc.write_rtcp(&[Box::new(PictureLossIndication{

sender_ssrc: 0,

media_ssrc,

})]).await.map_err(Into::into);

}else {

break;

}

}

};

}

});

let notify_rx2: Arc<Notify> = Arc::clone(¬ify_rx);

let h264_writer2 = Arc::clone(&h264_writer);

let ogg_writer2 = Arc::clone(&ogg_writer);

Box::pin(async move {

let codec: RTCRtpCodecParameters = track.codec();

let mime_type: String = codec.capability.mime_type.to_lowercase();

if mime_type == MIME_TYPE_OPUS.to_lowercase() {

println!("Got Opus track, saving to disk as output.opus (48 kHz, 2 channels)");

tokio::spawn(async move {

let _ = save_to_disk(ogg_writer2, track, notify_rx2).await;

});

} else if mime_type == MIME_TYPE_H264.to_lowercase() {

println!("Got h264 track, saving to disk as output.h264");

tokio::spawn(async move {

let _ = save_to_disk(h264_writer2, track, notify_rx2).await;

});

}

})

}));

// data stream

let (done_tx, mut done_rx) = tokio::sync::mpsc::channel::<()>(1);

peer_connection.on_peer_connection_state_change(Box::new(move |s: RTCPeerConnectionState| {

println!("Peer Connection State has changed: {s}");

if s == RTCPeerConnectionState::Failed {

println!("Peer Connection has gone to failed exiting");

let _ = done_tx.try_send(());

}

Box::pin(async {})

}));

peer_connection.on_data_channel(Box::new(move |d: Arc<RTCDataChannel>| {

let d_label: String = d.label().to_owned();

let d_id: u16 = d.id();

println!("New DataChannel {d_label} {d_id}");

Box::pin(async move {

let d2: Arc<RTCDataChannel> = Arc::clone(&d);

let d_label2: String = d_label.clone();

let d_id2: u16 = d_id;

d.on_close(Box::new(move || {

println!("Data channel closed");

Box::pin(async {})

}));

d.on_open(Box::new(move || {

println!("Data channel '{d_label2}'-'{d_id2}' open. Random messages will now be sent to any connected DataChannels every 5 seconds");

Box::pin(async move {

let mut result: Result<usize, _> = Result::<usize>::Ok(0);

while result.is_ok() {

let timeout: Sleep = tokio::time::sleep(Duration::from_secs(5));

tokio::pin!(timeout);

tokio::select! {

_ = timeout.as_mut() =>{

let message = math_rand_alpha(15);

println!("Sending '{message}'");

result = d2.send_text(message).await.map_err(Into::into);

}

};

}

})

}));

// Register text message handling

d.on_message(Box::new(move |msg: DataChannelMessage| {

let msg_str: String = String::from_utf8(msg.data.to_vec()).unwrap();

println!("Message from DataChannel '{d_label}': '{msg_str}'");

Box::pin(async {})

}));

})

}));

// ======================================= Socket.io ============================================

socket.on(

"join_room",

|socket: SocketRef, Data::<JoinRoom>(data)| async move {

println!("User {} joined room: {}", data.username, data.room);

socket.join(data.room.clone()).ok();

socket

.to(data.room.clone())

.except(vec![socket.id.to_string()])

.emit("user_joined", data.username.clone())

.ok();

},

);

socket.on(

"chat_message",

|socket: SocketRef, Data::<ChatMessage>(data)| async move {

println!("Message from {}: {}", data.username, data.message);

socket.emit("new_message", &data).ok();

},

);

socket.on("disconnect", |socket: SocketRef| async move {

println!("Socket disconnected: {}", socket.id);

});

socket.on("ping", |socket: SocketRef| async move {

socket.emit("pong", ()).ok();

});

socket

.emit("welcome", "Connected to Socket.io server!")

.ok();

// ========================== WebRTC Signaling Service ==============================

socket.on("offer", |socket: SocketRef, Data::<serde_json::Value>(offer)| async move {

println!("📨 Received Offer forward");

// ======================================= WebRTC Client Receiver ============================================

// let session_desc: RTCSessionDescription = serde_json::from_value(offer).expect("error");

// peer_connection.set_remote_description(session_desc.clone()).await.expect("error");

// let answer: RTCSessionDescription = peer_connection.create_answer(None).await.expect("error");

// let mut gather_complete: tokio::sync::mpsc::Receiver<()> = peer_connection.gathering_complete_promise().await;

// peer_connection.set_local_description(answer).await.expect("error");

// let _ = gather_complete.recv().await;

// if let Some(local_desc) = peer_connection.local_description().await {

// let json_str: String = serde_json::to_string(&local_desc).expect("error");

// println!("answer: {:?}", json_str);

// socket

// .emit("answer", local_desc)

// .ok();

// } else {

// println!("generate local_description failed!");

// }

// ================================================ END =======================================================

// WebRTC Signaling Service Please use.

socket

.to("test_room")

.emit("offer", offer)

.ok();

});

socket.on("answer", |socket: SocketRef, Data::<serde_json::Value>(answer)| async move {

println!("📨 Received Answer forward");

// WebRTC Signaling Service Please use.

socket

.to("test_room")

.emit("answer", answer)

.ok();

});

socket.on("ice", |socket: SocketRef, Data::<serde_json::Value>(ice)| async move {

println!("📨 Received ICE Candidate");

// WebRTC Signaling Service Please use.

socket

.to("test_room")

.emit("ice", ice)

.ok();

});

}结语:

💖 非常感谢您宝贵的时间与耐心审阅,希望"九宫元"这套底层通用框架架构,能够为您的研究与实践提供有益的参考 💖。