引言:当大模型还在比拼谁更"博学"时,另一场静默的革命已经发生了------AI开始从"答题者"变成"办事员"。

一、一个真实的困惑:为什么GPT类大模型越用越累

去年秋天,我负责一个AI助理工具的项目。需求很明确:让AI帮销售团队整理客户拜访记录,自动生成跟进邮件,并把关键信息写回CRM系统。

我第一时间想到了豆包。毕竟,它写邮件的水平比很多实习生都强。

于是我开始了一段令人疲惫的旅程:

第一步,我打开豆包,把拜访记录贴进去,让它生成邮件草稿。效果不错,措辞得体,格式规范。但问题是,我得手动复制粘贴到邮件客户端,再手动修改收件人地址。

第二步,我尝试用API自动化。写了个脚本调用OpenAI接口,生成邮件内容。但CRM里的客户数据怎么取出来?我得再写一段代码调CRM的API,把客户信息拼进Prompt里。

第三步,销售总监提了个新要求:"如果客户提到竞品,邮件里要自动附上我们的对比资料。"这意味着AI不能只管生成文字,还得先"读懂"拜访记录里的潜台词,再判断要不要触发附件发送------这已经超过了一次API调用能解决的范畴。

第四步,测试时我发现,有时候AI生成的邮件里客户名字写错了。因为CRM里的姓名格式不统一,有的是"张三",有的是"张先生",AI随机挑选了一个。我得在脚本里加校验逻辑,但校验规则本身又需要另一轮AI判断......

项目做到第三周,我的代码已经变成了一团浆糊:主流程里嵌套着各种条件分支,API调用、数据查询、错误处理、重试逻辑搅在一起。任何一个环节出错,整个流程就崩了。更可怕的是,这团代码只有我能维护,换个人来,半天都理不清头绪。

那一刻我突然意识到:我手里的豆包AI大模型,本质上还是一个"答题机器"。它能给出完美的答案,但答案之后的整件事------判断、调用、校验、补救------全得靠我手动缝合。

这不是豆包的错。这是应用范式的问题。

二、LLM是大脑,但大脑本身不会走路

要理解智能体的本质,得先回到一个基本事实:大语言模型(LLM)到底是什么?

从技术上说,LLM是一个概率模型。它通过海量文本训练,学会了预测"下一个词该是什么"。当你问它"北京今天天气怎么样",它并不是真的去查了天气,而是基于训练数据里关于北京天气的统计模式,生成一段看似合理的文字。如果训练数据截止在去年,它甚至可能一本正经地告诉你去年今天的天气。

换句话说,LLM的能力边界止于"生成内容"。它是一台顶级的"文字发动机",但发动机本身不会开车,不会修车,也不会根据路况调整路线。它只能坐在驾驶座上,给你描述一段"如果我在开车,我会怎么做"的虚构场景。

这就是为什么我们常说"LLM有幻觉"。其实不是它在"撒谎",而是它的设计目标从来就不是"求真",而是"生成连贯的文本"。当你要求它做数学题,它不是打开计算器,而是在"扮演"一个擅长数学的人,凭记忆里的模式"编"一个答案。

这个局限性,在问答场景下并不明显。毕竟,写一篇散文、翻译一段文字、解释一个概念,本质上都是"内容生成"。但当你需要它完成一个实际任务------比如订一张机票、更新数据库、或者像我的项目那样,走完"读记录→写邮件→回写CRM"的完整链路------问题就暴露了。

LLM缺的不是知识,而是"行动力"的三件套:

- 目标分解能力:把"帮我安排一次出差"拆成"查航班→订酒店→写行程→发邮件确认";

- 工具调用能力:在需要查航班时,真的去调用携程API,而不是"想象"一个航班时刻表;

- 闭环校验能力:发现酒店满房时,不是报错退出,而是自动改订另一家,并通知相关人员。

这三样东西,LLM原生不具备。而智能体(AI Agent),就是为LLM装上这三件套的系统。

三、智能体的核心定义:对"结果"负责,而非对"回答"负责

业内对智能体有一个经典定义:

Agent = LLM + Planning + Memory + Tools。

这个公式很简洁,但容易让人误以为智能体就是"LLM套了个壳"。

真正的区别比这深刻得多。

想象两个场景:

场景A:你问LLM,"帮我写一份季度销售报告"。它生成了一份3000字的报告,结构完整,数据详实------但所有数据都是它"编"的,因为LLM无法访问你的销售系统。你拿到这份报告,还得自己打开ERP,把真实数据填进去。LLM对这件事的"责任",到"生成文本"就结束了。

场景B:你对着一个智能体说,"帮我生成一份季度销售报告,数据要来自ERP,格式参照上季度的模板,完成后发邮件给张总,如果张总回复了修改意见,自动更新并重新发送。"

智能体接到这个指令后,会启动一个完整的闭环:

理解目标:不是"写报告",而是"完成一次报告编制与分发的全流程";

分解任务:拆解为"读取ERP数据→读取上季度模板→填充数据→生成报告→发送邮件→监控回复→按需迭代";

调用工具:在"读取ERP数据"这一步,它不是"想象"数据,而是真的调用ERP的API;在"发送邮件"这一步,它真的调邮件网关;

自检与重试:如果ERP接口超时,它会等待重试;如果邮件地址格式错误,它会从通讯录重新查询;如果张总回复"Q3数据不对",它会重新提取数据并生成修正版;

交付结果:最终交付给你的,不是一段文字,而是**"事情已经办完了"**的状态确认。

这就是范式革命的核心:从"内容生成"到"任务执行",从"给你答案"到"替你完成",从"对回答负责"到"对结果负责"。

Google在2026年初发布的《AI Agents》白皮书中,把这个转变概括为从"知识引擎"到"行动引擎"的跃迁 。白皮书中有一句话很犀利:"Agent ≠ Model。传统的生成式AI模型被困在对话框里,无法与现实世界交互。而Agent的核心在于行动力。"

四、拆解智能体的"四步闭环":它是怎么"办事"的

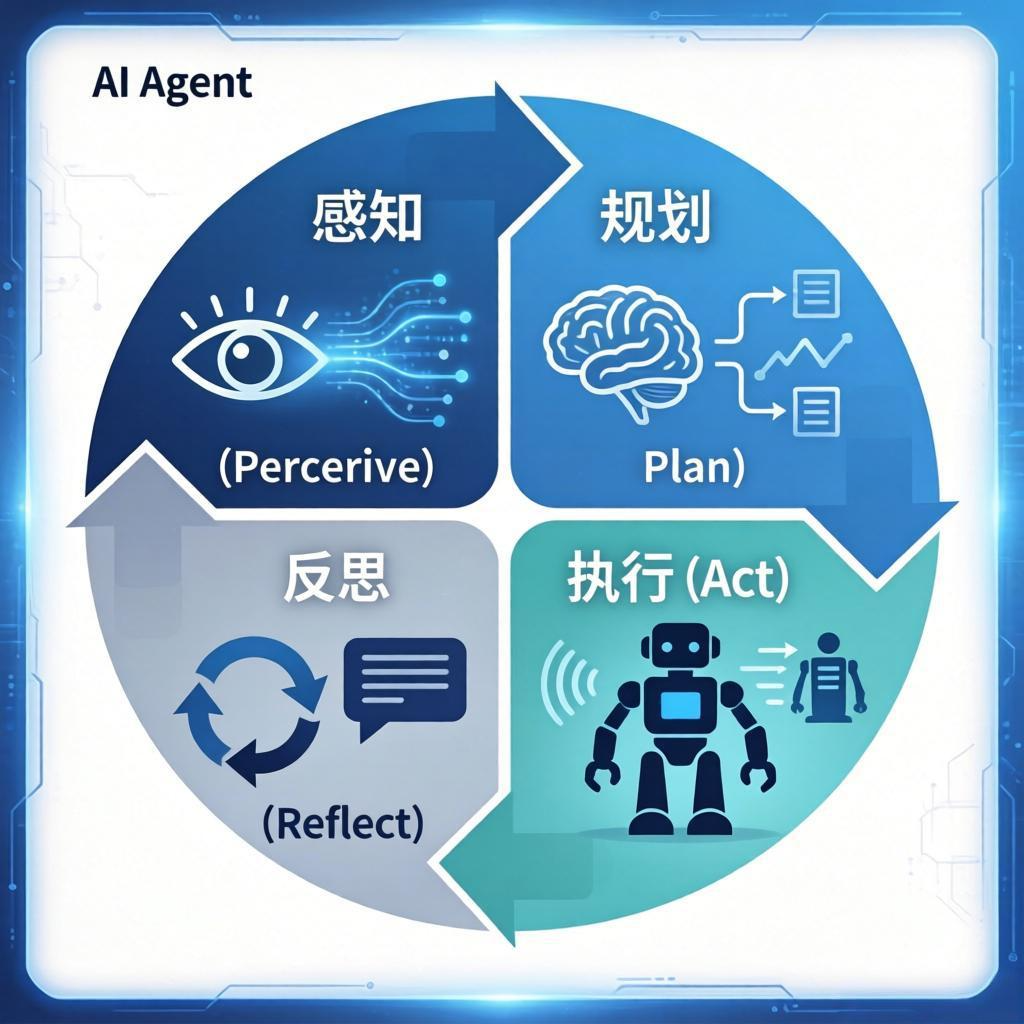

智能体不是魔法。它的"自主性",本质上是一套精心设计的循环机制 。理解这个循环,就理解了智能体与LLM的根本分野。这个循环通常被描述为四个阶段:感知(Perceive)→ 规划(Plan)→ 执行(Act)→ 反思(Reflect) 。

下面我用一个比较接地气的示例来说明。

假设你有一个"智能采购助手",目标是"下周三前为公司采购50台显示器,预算不超过8万元,优先京东自营,次日达优先"。

第一步:感知------不只是"听懂",而是"理解意图"

LLM接收到这个指令,首先做的不是"生成回复",而是提取目标参数 :数量 (50台)、预算 (≤8万)、时间约束 (下周三前)、平台偏好 (京东自营)、物流约束(次日达)。

但智能体的感知不止于此。它还会主动检查:"下周三是具体哪天?""8万是税前还是税后?""显示器需要什么接口?"------如果信息缺失,它会追问,而不是盲目执行。这种主动澄清的能力,是智能体区别于被动问答系统的关键。

第二步:规划------把"大目标"切成"小步骤"

这是智能体最核心的能力,也是LLM最擅长的部分------毕竟,推理和规划本质上还是"生成文本",只是生成的不是散文,而是任务清单。

智能体可能会这样分解:

1. 查询京东API,筛选自营、次日达、预算内的显示器型号;

2. 按性价比排序,生成候选清单;

3. 调用内部审批系统,提交采购申请;

4. 等待审批通过后,调用下单接口;

5. 监控物流状态,确认下周三前到货;

6. 到货后调用资产管理系统入库。每一步都有明确的输入、输出、成功标准和失败分支 。这不是简单的"待办清单",而是一个有向图:步骤3依赖步骤2的结果,步骤5可能触发步骤2的重做(如果物流不满足次日达)。

第三步:执行------从"说"到"做"的关键一跃

这一步是智能体与LLM的物理分野 。LLM到"生成任务清单"就结束了,它不会真的去调京东API。而智能体必须有一个执行层,把规划翻译成具体的工具调用。

这些工具可能是:

- 外部API:京东商品查询、内部审批系统、邮件网关;

- 代码执行:计算总价、比价、生成Excel报表;

- 数据库操作:查询库存、写入采购记录。

每一次工具调用,都是智能体从数字世界跨入现实世界的一步。它不再是"描述"怎么买东西,而是真的在帮你买东西。

第四步:反思------不是"一次过",而是"直到对"

这一步最容易被忽视,但也最能体现"对结果负责"的精神。

假设智能体执行到步骤5,发现京东显示"预计周五送达",不满足"下周三前"的约束。这时,它有两个选择:

- 路径A(传统脚本逻辑):报错退出,抛出一个异常,让人类来处理;

- 路径B(智能体逻辑):反思------"当前方案失败,原因:物流不满足。可选策略:① 换一家平台试试天猫;② 加钱选更快的物流;③ 拆分订单,从多个仓库调货。"然后重新规划,直到找到一个满足所有约束的方案。

这种自检→诊断→重试→重规划 的能力,让智能体具备了真正的韧性。它不是按剧本走的演员,而是遇到问题会自己想办法解决的办事员。

五、为什么说这是"范式革命",而不是"功能升级"

有人可能会说:这不就是工作流引擎+RPA+LLM的缝合怪吗?用传统技术也能做啊。

表面看,确实如此。但底层逻辑有根本差异。

差异一:从"确定性执行"到"不确定性决策"

传统工作流引擎(如BPM、RPA)的核心假设是:流程是确定的。每一步的输入、输出、分支条件,都预先写死在代码里。如果出现了未预料的情况,系统就崩了。

但真实世界的任务,充满了不确定性。客户的要求可能含糊,API可能返回异常,数据可能格式不统一。智能体的核心能力,恰恰是在不完美信息下做决策。LLM的"模糊推理"能力,在这里反而成了优势:它能理解"尽量便宜"和"预算内"的细微差别,能在多个冲突约束中找平衡,能在信息缺失时做出合理假设并验证。

差异二:从"人适应系统"到"系统适应人"

传统系统要求人按它的规矩来:填固定格式的表单、点特定的按钮、走预设的流程。而智能体的交互模式是目标驱动的。你说"帮我搞定这件事",它自己去琢磨怎么搞定。你不需要告诉它"先点A再点B",你只需要告诉它"我要什么结果"。

这种转变,在用户体验上是降维打击。就像从"命令行"进化到"图形界面",再从"图形界面"进化到"自然语言指令"。

差异三:从"工具"到"同事"

LLM时代,AI是"工具"------你用它,它才动。智能体时代,AI是"同事"------你给它定个目标,它自己推进,遇到困难会汇报,完成之后会通知你。

这种自主性 的跃迁,改变了人机协作的基本模式。你不再需要手把手教它每一步怎么做,你只需要授权 和监督。就像你不会教你的下属"怎么写邮件",你只需要说"给客户发封跟进邮件,强调我们的交付优势",剩下的他自己搞定。

Gartner预测,到2026年将有40%的企业应用嵌入任务型AI智能体。这个预测的背后,正是对范式转移的确认:企业需要的不是更聪明的"答题器",而是能真正分担工作的"数字员工"。

六、写在最后:我们还在低估这场革命

回到开头那个项目。如果当时我用的是智能体架构,而不是裸调API,事情会简单很多:

我只需要定义目标------"读取拜访记录,生成跟进邮件,回写CRM,触发条件:提及竞品时附加资料";

然后给智能体配备工具------CRM查询接口、邮件发送API、文档检索服务;

再设定约束------"客户称呼必须与CRM一致"、"邮件主题必须包含项目名称";

剩下的,智能体自己分解、执行、校验、重试。我只需要在关键节点审批,在异常情况下介入。

这就是"从会回答到会完成"的真正含义。它不只是技术架构的升级,而是我们对AI能力边界的重新想象。

过去两年,我们惊叹于LLM能写诗、能编程、能通过律师考试。但这些,本质上还是在"生成内容"的范畴里打转。智能体带来的,是AI从"内容生产"跨入"任务执行"的历史性一步。

这一步,让AI从"图书馆里的博学家"变成了"办公室里的办事员"。它不再只是告诉你"该怎么做",而是真的去"做",并且对做的结果负责。

如果你还在用API调用的思维做AI应用,不妨停下来想一想:你的用户真正需要的,是一段漂亮的文字,还是一件办妥的事情?

答案,可能决定了你站在范式革命的哪一边。