@TOC ((让 C++ 程序长出大脑:从"语音遥控器"到具身智能 Agent 的进化之路)------OpenGL渲染与几何内核那点事------(二-1-(15)))

背景:

试想一下,如果你是一个造机器人的工程师,想让机器人的 AI 视觉大模型学会精准抓取一个螺栓,你需要多少张照片来训练它? 答案是: 成千上万张不同角度、带有精准像素级标注的照片。【同时,真实世界中采集带标注的三维数据成本极高,我们称之为 Sim2Real(仿真到现实)的鸿沟。】

手工一张张拍?人工用鼠标去抠图?这得干到猴年马月! 为了解决这个痛点,我用 C++ 写了一个「AI 数据工厂」看这里。

代码仓库入口:

- github源码地址(https://github.com/AIminminAI/Huhb3D-Viewer)。

- gitee源码地址(https://gitee.com/aiminminai/Huhb3D-Viewer)。

本文涉及:

- https://github.com/AIminminAI/Huhb3D-Viewer/blob/main/src/core/tool_registry.cpp

- https://github.com/AIminminAI/Huhb3D-Viewer/blob/main/src/agent/AIAgentController.cpp

解决方案:

- 只要丢给它一个工业 CAD 模型(比如 STL文件),它就能自动在虚拟空间中 360° 环绕拍照,瞬间吐出:

- 📸 RGB 真实渲染图:rgb/frame_XXXX.png

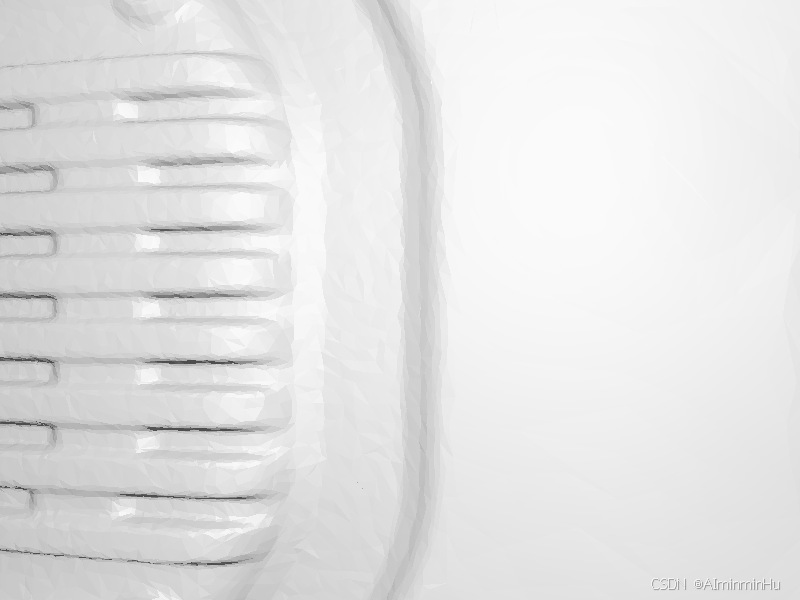

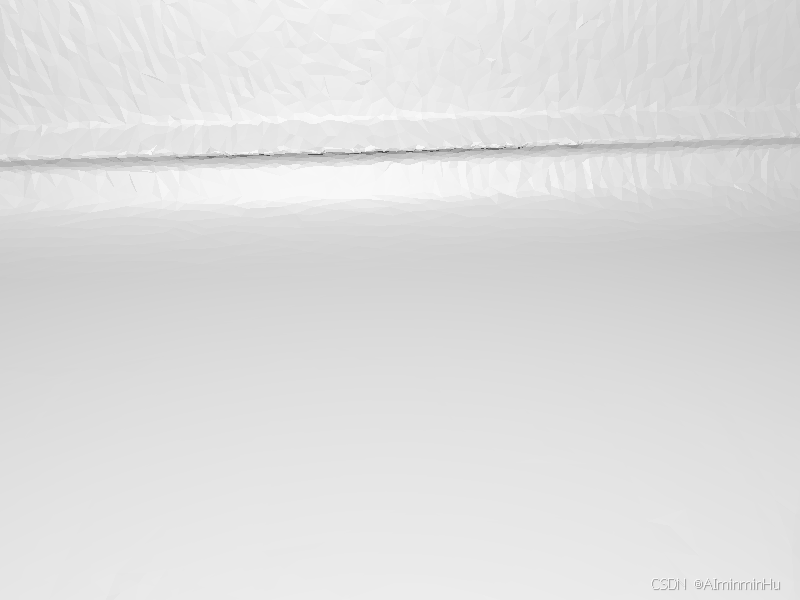

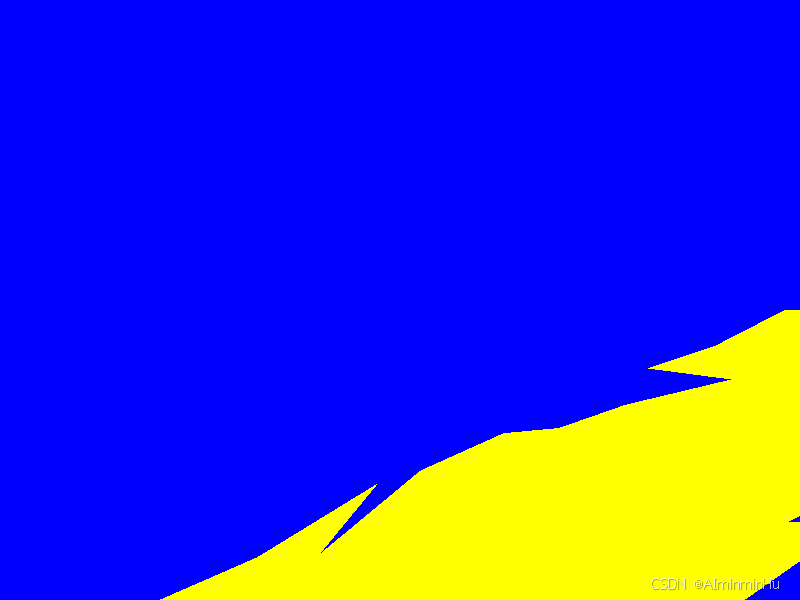

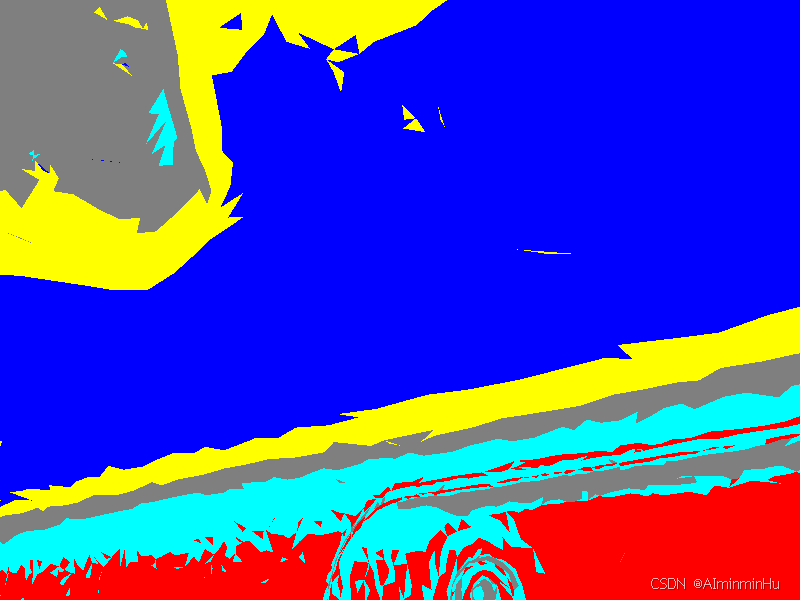

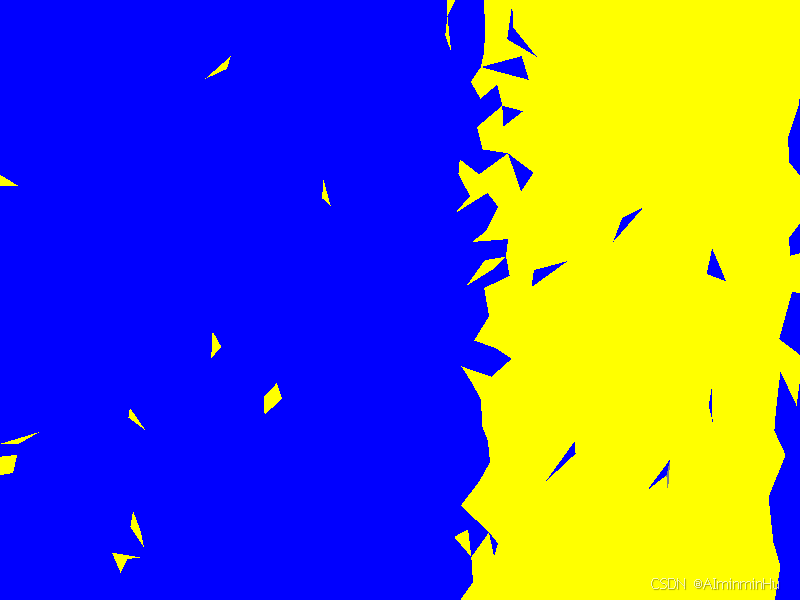

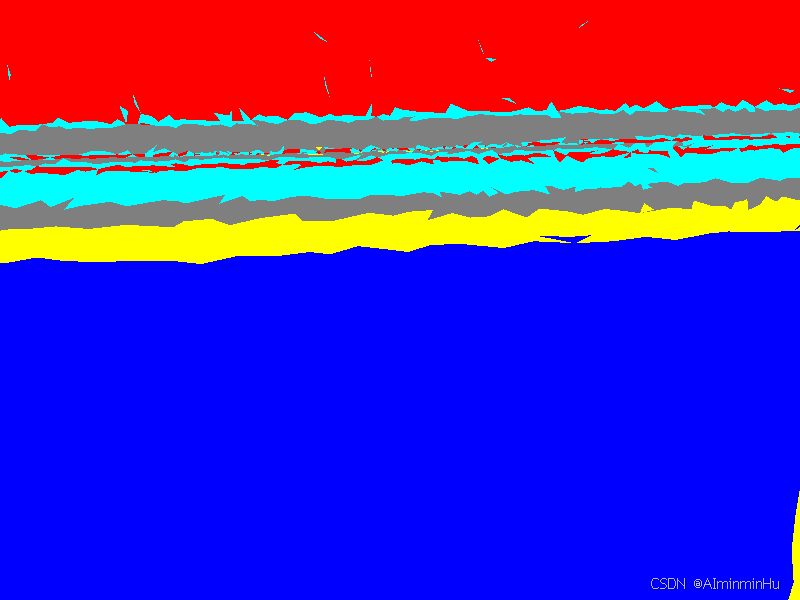

- 🏷️ 像素级语义分割 Mask (基于曲率算法,自动认出哪里是螺栓、孔洞、法兰):mask/mask_XXXX.png

- 📏 深度图(Depth) (告诉机器人距离多远),depth/depth_XXXX.png + .raw

- 📐 6DoF 相机位姿 (告诉机器人从哪个角度抓),camera_poses.json

- 📂 最后直接打包成 AI 训练最爱吃的 COCO/YOLO 格式。

- label_legend.txt【类别ID→名称→RGB颜色映射】、description.json【DeepSeek-V3 视觉API生成零件特征描述】

实际效果:

- 想看视频:

huhb_synthetic_data

- 不想看视频:也有图片:

【还有附带的:camera_poses.json、label_legend.txt、manifest.json,具体内容见附录】

巨人的肩膀:

- OpenGL 4.6 Specification

- Vulkan 1.3 Specification

- Khronos Group SPIR-V Whitepaper

- 历代GPU架构白皮书(NVIDIA Fermi至Blackwell,AMD GCN至RDNA 4)

系列文章规划:

你的"数据工厂【啥数据工厂~看这里:((AI升级篇)OpenGL渲染与几何内核那点事-(二-1-(14):你的3D查看器,是怎么一步步先试着造个数据工厂,向学会"教"机器人看世界的而努力)】"已经能批量造"粮食"了,但隔壁AI部门的小王又找上门了,他带来了一个新的挑战:能不能让这个C++程序,直接"听懂"人说的话,并自己动手干活?

这就像一个优秀的工匠,不仅要有最好的工具,还得学会"接单"和"思考"。咱们来看看,你是怎么给这个C++程序一步步"注入灵魂",让它从"人工智障"进化成"具身智能Agent"的。

《让 C++ 程序长出大脑:从"语音遥控器"到具身智能 Agent 的进化之路》

🌟在3D图形学领域,底层几何算法(如计算面片厚度、曲率)通常是晦涩且参数繁琐的。传统的做法是给用户一堆滑块和按钮,但真正的智能应该是:用户动动嘴,底层跑断腿。 那应该如何让大模型直接指挥 C++ 底层算法的?这经历了一个从"人工智障"到"具身智能"的进化过程。咱们的故事,接着上次"数据工厂"开张之后讲起。

第一代:硬编码的"机械臂" (Hardcoded Logic)

你的"数据工厂"能自动生成训练数据,但本身的控制还是靠按钮和脚本。这天,AI部门的小王跑过来:"哥们,你这工厂牛是牛,但每次都得我手动配参数、点按钮。咱们能不能更智能点?比如我直接对它说'帮我找出模型中所有壁厚小于1mm的薄弱部位'?"

最初的想法 :

你一听,这简单啊!这不就是个语音命令映射吗?你立刻在代码里加了一段硬编码逻辑:

c++

// 第一代:硬编码的"人工智能"

void processVoiceCommand(const std::string& command) {

if (command.find("薄弱") != std::string::npos) {

float threshold = 1.0f; // 默认值写死

// 尝试从"1mm"、"2毫米"等词中瞎猜参数...

geometryAPI_->getThinParts(threshold);

}

}就像一个老式录音机,你按"播放"它就播放,换个词儿说"放歌"它就听不懂了。

- 问题所在:

- 语义死板 :用户说"哪里容易断"、"厚度不够"或者"结构检查",硬编码就哑火了。你总不能把世界上所有同义词都写进

if-else里吧? - 参数僵化:用户想把阈值从1mm改成2mm,你得再写一堆复杂的字符串解析逻辑,试图从"2毫米"、"2mm"、"厚度小于2"等说法里把数字抠出来,还经常抠错。

这就像一个只能执行固定口令的机械臂,笨重且没有任何理解能力。显然,这条路行不通。

第二代:只会聊天的小黑盒 (Naive LLM)

你一拍脑门,现在AI大模型这么火,让它来理解自然语言不就行了?

改进方案 :

你把用户的指令原封不动地丢给一个开源大模型(LLM),然后期待它给你一个明确的指令。你的提示词大概是:"用户说:'帮我看看哪里壁厚不够',请告诉我他想干嘛。"

大模型回答:"用户想分析模型的薄弱部位,他关注的是结构强度,建议你检查壁厚,阈值可以设为1.5mm。"

你拿着这段回复,傻眼了。

- 问题重重:

- 不可靠的输出 :LLM有时会说一大堆废话,C++程序无法稳定地从"建议你可以检查一下壁厚,阈值设为1.5mm会比较合适哦"这串文本里,精确提取出函数名

analyze_weak_structure和参数1.5。这次是"建议设为1.5",下次可能就变成"我推荐1.2",格式千奇百怪。 - 结构断层:大模型就像一个只会打字的顾问,它不理解它推荐的"1.5"到底要传给哪个C++函数,更不知道这个函数能返回什么。它和你的C++程序之间隔着一道深深的鸿沟,两者活在完全不同的世界里。

第三代:规则森严的"工具箱" (Tool Calling & JSON Schema)

"不能让LLM瞎猜了!"你决定给它立规矩。你要让它知道,你不是一个能说会道的朋友,而是一个拥有具体技能的工匠。这就是 tool_registry.cpp 诞生的背景。

改进方案 :

你不再向LLM提开放性问题,而是给它一份标准功能说明书。这份说明书,就是用JSON Schema写的。

- 技术实现:

- 定义工具 :你在

tool_registry.cpp里,通过registerAllToLLM函数,向LLM注册了一个名为analyze_weak_structure的工具。这个工具的"说明书"上明确写着:我需要的参数名叫threshold_mm,类型是number,作用是"薄弱部位的壁厚阈值(毫米)"。 - 语义映射 :你通过函数

description("分析模型所有壁厚小于给定阈值的薄弱区域")告诉大模型,用户口中所谓"容易断"、"太薄"这些自然语言,在你这儿对应就这一个标准操作。

这样一来,当用户说"找找厚度不够1mm的地方"时,LLM的输出不再是随机的文本,而是一个结构化的指令:CALL tool:analyze_weak_structure, threshold_mm: 1.0。你的C++程序就像一个拿到了标准工单的工人,能立刻准确地开始干活。

- 残留不足:

- 虽然LLM知道要调工具了,但它就像一个指挥官在黑屋子里下令,看不见前线的战火。它不知道执行完

optimize_view(zoom_to_bottom)后,画面是否真的对准了底部,如果没对准,它也只能干瞪眼。

第四代:现在的"具身智能 Agent" (The Embodied Agent)

这就是你目前代码中实现的 AIAgentController + ToolRegistry** 系统的终极形态。它不仅仅是工具调用,而是一个拥有感知-决策-执行-反馈**闭环的具身智能Agent。现在,它真的能"干活"了。

1. 语义桥接 (Semantic Bridging) 🌉

在 tool_registry.cpp 中,你完成了一次跨维度的转换,这是连接两个世界的桥梁:

- 输入:用户说"这模型哪容易裂?"。

- 决策 :LLM解析意图,精准映射为你注册的工具

analyze_weak_structure,并填好参数threshold_mm: 0.8。 - 底层执行:C++接到函数调用,遍历成千上万个三角面片,找出所有符合几何定义的薄弱面片索引。

- 语义化输出 :你没把

[3145, 2891, ...]这串晦涩的索引直接扔回给LLM,而是将其封装成一个LLM能看懂的JSON报告:{"found": true, "severity": "high", "thin_wall_count": 12, "description": "在法兰连接处发现12处壁厚低于0.8mm的区域。"}。LLM看到这个报告,就能组织语言,像专家一样向用户汇报:"您的模型在法兰连接处有高风险,发现12处壁厚不达标的薄弱点。"

2. 视觉验证与自我纠错 (Self-Correction) 🛠️

这是 AIAgentController.cpp 最核心的亮点。Agent不再是一个盲目执行的瞎子。

- 空间感知 :在调用

optimize_view把镜头对准"模型底部"前,Agent会先调用一个感知接口,获取renderManager当前的相机位置和模型的包围盒信息,像人先确认自己的方位一样。 - 闭环验证 :执行完

optimize_view后,Agent会再次读取相机状态。代码会自动检查相机的新位置是否真的到达了包围盒的底部附近。如果没有(比如被其他物体挡住或算法出错),它会判断目标未达成,然后触发自我纠错逻辑:调整参数,重新执行视角优化,直到确认画面无误。

总结 🌟

"在这个项目中,你用C++实现了一套LLM Tool Registry 。它的核心价值在于:把晦涩的C++几何算法封装成了大模型可以理解的JSON接口,彻底打通了自然语言与底层图形学之间的屏障。 >

区别于普通的聊天机器人,你实现的是一个具身Agent。它能感知3D空间状态(包围盒、相机位置),根据用户指令生成技能序列,并在执行完成后进行视觉验证与自我纠错。当用户问'哪里薄弱'时,它会自动完成从'语义理解'到'几何计算',最后到'OpenGL高亮显示'的全链路闭环。"

亮点代码速览 💻

- 注册闭环 :

ToolDefinition结构体直接绑定C++ Lambda表达式,让工具注册像搭积木一样,实现即插即用。 - 反馈闭环 :

executeSkills函数在执行前后都记录世界状态(preState与postState),通过对比实现了AI Agent的"视觉检查"能力。

深度解析:从工具调用到具身智能的进化

1. Tool Calling:从野心勃勃到标准协议

- OpenAI Function Calling的序幕 :2023年6月,OpenAI在GPT-4和GPT-3.5-turbo上推出了Function Calling能力,这在业界投下了一枚重磅炸弹。它首次允许开发者向模型描述函数签名(名称、描述、参数JSON Schema),模型会智能地选择返回一个包含函数名和参数的JSON对象。它的开创性在于,它定义了人与模型、模型与工具 之间的标准化交互协议,而你的

ToolRegistry正是这一思想的C++实现。- JSON Schema:LLM可解析的"世界说明书" :为什么是JSON Schema?因为它提供了一种严格的、编程语言无关的方式来描述数据格式。对于LLM而言,

{"type": "number", "description": "壁厚阈值"}这种结构化提示,远比一段自然语言"一个表示壁厚的数字"要稳定得多。这背后是**约束性生成(Constrained Decoding)**思想的工程应用,强制模型在规定的"语法赛道"上输出,极大地降低了"幻觉"率。2. 从Agent到具身智能:感知-行动循环(Perception-Action Loop)的成形

- 认知架构的抽象 :你的

AIAgentController本质上实现了一个经典的**感知-规划-行动(Sense-Plan-Act)**循环,并创造性地加入了"验证"环节。这区别于纯软件层的AI Agent(如AutoGPT),后者只能操作互联网文本。你的Agent操作的是一个真实的、有物理和几何法则的3D世界。- 具身性的核心:与世界状态的交互 :

preState和postState的对比,是"具身性"的最终体现。它意味着Agent不再只是一个"发出命令者",而是一个"观察结果者"。它通过RenderManager这个"眼睛"来感知空间,并根据感知结果修正行为,这正是机器人学中闭环控制理论在AI时代的优雅应用------将原本用于物理机器人的控制论思想,注入到了操控3D世界的软件Agent中。

- 如果想像唠嗑一样,去了解一些小知识,快去看看视频吧:

- 认准一个头像,保你不迷路:

- 抖音:搜索"GodWarrior"

- 快手:搜索"AIYWminmin"

- B站:搜索"宇宙第一AIYWM"

您要是也想站在文章开头的巨人的肩膀啦,可以动动您发财的小指头,然后把您的想要展现的名称和公开信息发我,这些信息会跟随每篇文章,屹立在文章的顶部哦

附录:

camera_poses.json

bash

[

{

"frame_id": 0,

"position": [0.0, 0.0, 5.0],

"rotation_euler": [0.0, 0.0, 0.0],

"fov_degrees": 45.0,

"view_matrix": [

[1.0, 0.0, 0.0, 0.0],

[0.0, 1.0, 0.0, 0.0],

[0.0, 0.0, 1.0, -5.0],

[0.0, 0.0, 0.0, 1.0]

],

"projection_matrix": [

[2.414, 0.0, 0.0, 0.0],

[0.0, 2.414, 0.0, 0.0],

[0.0, 0.0, -1.002, -0.200],

[0.0, 0.0, -1.0, 0.0]

]

},

{

"frame_id": 1,

"position": [1.18, 0.0, 4.86],

"rotation_euler": [0.0, -13.6, 0.0],

"fov_degrees": 45.0,

"view_matrix": [

[0.972, 0.0, 0.236, -0.0],

[0.0, 1.0, 0.0, 0.0],

[-0.236, 0.0, 0.972, -5.0],

[0.0, 0.0, 0.0, 1.0]

],

"projection_matrix": [

[2.414, 0.0, 0.0, 0.0],

[0.0, 2.414, 0.0, 0.0],

[0.0, 0.0, -1.002, -0.200],

[0.0, 0.0, -1.0, 0.0]

]

}

]label_legend.txt

bash

Semantic Label Color Legend

Category -> (R, G, B) in 0-255 range

0 FreeSurface 127 127 127

1 HorizontalPlane 0 0 255

2 LateralPlane_X 0 255 0

3 LateralPlane_Z 255 0 0

4 NearHorizontal 255 255 0

5 NearLateral_X 255 0 255

6 NearLateral_Z 0 255 255

7 Degenerate 255 127 0

8 Reserved1 127 0 255

9 Reserved2 0 127 255manifest.json

bash

{

"version": "2.0",

"generator": "Huhb3D-SyntheticDataPipeline",

"rgb_count": 100,

"mask_count": 100,

"depth_count": 0,

"has_legend": true,

"has_ai_description": false,

"has_camera_poses": false

}