🌊2026 数维杯 B题 智能办公场景下多源异构文件识别与治理优化

------ 原创手搓·保证唯一·高质量成品范文 ------

🚀 拒绝平庸: 本文由博主深度原创,专注于"应用"而非"糊弄"。每一行代码、每一张图表都经过精心雕琢,确保学术审美与建模深度并存。

⛳️:数模保奖交流,认准我哦

先来看题目:

随着数字化办公的持续推进,企事业单位在日常运行中积累了格式交错、结构繁杂的大规模文件数据。这些文件在格式上涵盖 Word、PDF、Exce等多种类型,在完整性上,既包含未经拆分的原始文件,也包含在后续流转、汇总与调用过程中被转化为仅含标题、正文片段、来源信息等字段的半结构化数据。同时,不同文件在形成背景、表达方式、结构层次与业务属性上差异显著,内在结构各具特点。在真实办公场景中,同一主题内容往往以不同文种、不同长度和不同结构形式反复出现,而后续新流入的数据通常仅包含部分文本片段或有限字段。在此情况下,传统依赖人工阅读、判断与归档的处理方式,普遍暴露出效率低下、判定标准不一、误分类风险高及后续检索利用困难等问题。

近年来,以openclaw为代表的智能办公平台逐步展现出文档处理、流程自动化和任务协同等方面的应用能力,推动文件治理模式从以人工操作为主,向信息提取、类别归属判断、异常识别及流程优化等智能化方向演进。这一转变对文件处理系统提出了更高要求:既能从完整历史文档中发现相对稳定的组织规律,也能在信息不完整的条件下完成主题迁移与类别归属判断。然而,文件治理并不止于类别归属判定。研究表明,在处理复杂、模糊或高风险文档时,完全依赖自动化或完全依赖人工的方案均存在局限,而合理引入人工复核环节,往往更贴合真实应用场景的需求,因此,对于业务影响较大、时效要求较强或归属判断置信度较低的文件,往往还需引入人工复核等机制。

基于上述背景,如何从历史真实文件中识别其内在组织规律并建立相对稳定的主题体系、如何在信息受限的新数据条件下保持类别归属判定的(二)需要解决的问题

请利用"附件数据"中列出的数据集,回答以下问题:

问题一:数据集1提供了一批历史真实文件数据,包含多种格式。不同文件在内容完整程度、表达方式、文体结构和业务属性上存在差异。请对数据集1中的多源异构文件进行特征挖掘,提取能够反映文件内容及属性的关键信息,并基于提取结果对文件进行分类,同时归纳各类别所对应的主题。

问题二:数据集2和数据集3提供了一批后续流入的新数据,包括半结构化数据和真实文件数据。请根据问题1建立的分类体系,将数据集2和数据集3中的数据归入相应类别,并自主设计评价指标对模型的分类效果以及新数据归属判断的结果的合理性、可解释性和迁移适用性等方面进行综合量化评价。同时,对于同时具有多个类别特征或无法明确归入某类别的数据,根据所构建的指标建立模型开展讨论,提出相应的识别思路与处理方式。

问题三:请结合问题2中对数据集2和数据集3的归类判断结果,从紧急程度、错分风险和复核必要性三个方面对于待处理文件进行高、中、低等级划分,并自主构建权重参数。其中,对于主题归属不明确、时效要求较高或涉及资金分配的文件,应在等级划分和权重设置中重点考虑。进一步综合考虑文件归档的准确性、时效性与经济成本,建立模型,判断各文件后续是否需要进行人工复核以及人工复核的优先顺序。并在数据集4提供的三种资源约束场景下比较不同场景下的处理结果差异,提出合理建议。

|---|

| |

需要最终Word原文+代码的,可以直接拉到文章末尾

|---|

| |

📈 成品数据一览表

| 维度 | 数据详情 | 备注 |

|---|---|---|

| 总页数 | 90页 | 含详细修改建议 |

| 正文权重 | 70 页 | 拒绝废话,干货满满 |

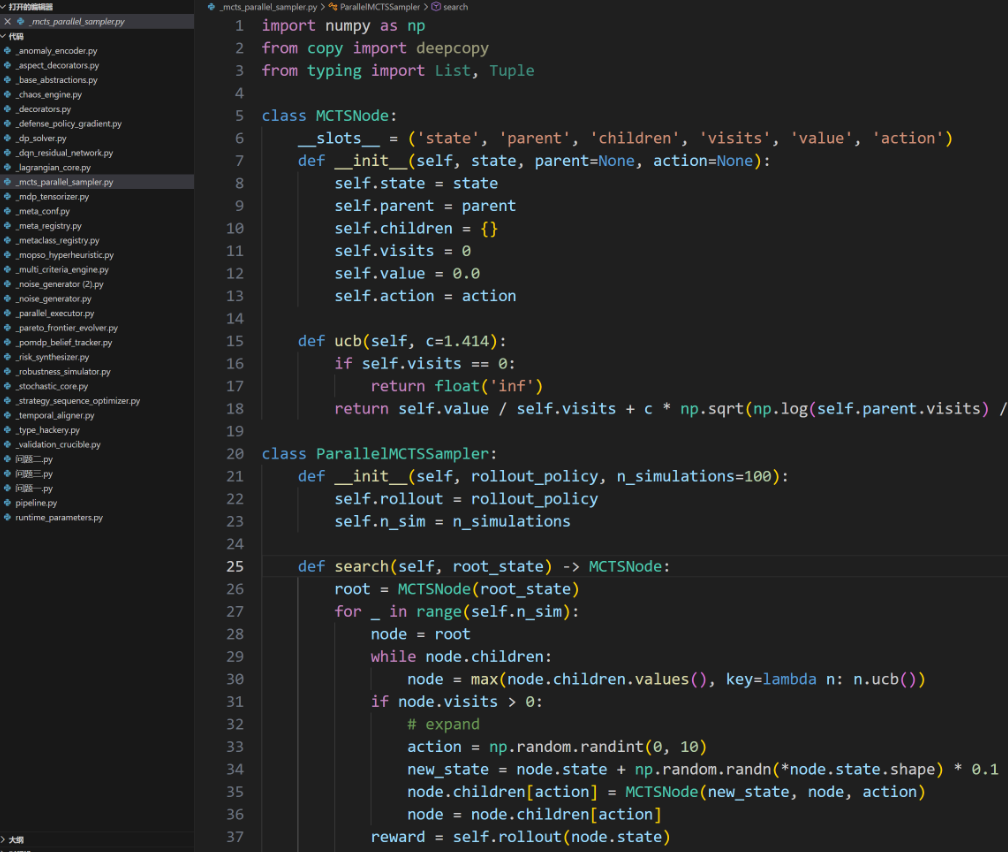

| 代码行数 | 5000+行 | 逻辑清晰,注释完整 |

| 试用级别 | 国家级一等奖 | 欢迎各位出成绩后监督 |

💡 为什么选择这份范文?

- ✅ 硬核手搓: 绝对不是互联网上混子随便引用一大堆模型堆砌出的垃圾内容。

- ✅ 配套齐全: 不止给范文,更给13页修改说明和降重教程,教你如何举一反三。

- ✅ 审美在线: 告别低端丑陋的图表排版,本文参考历年获奖论文风格,全部采用学术出版级绘图标准。

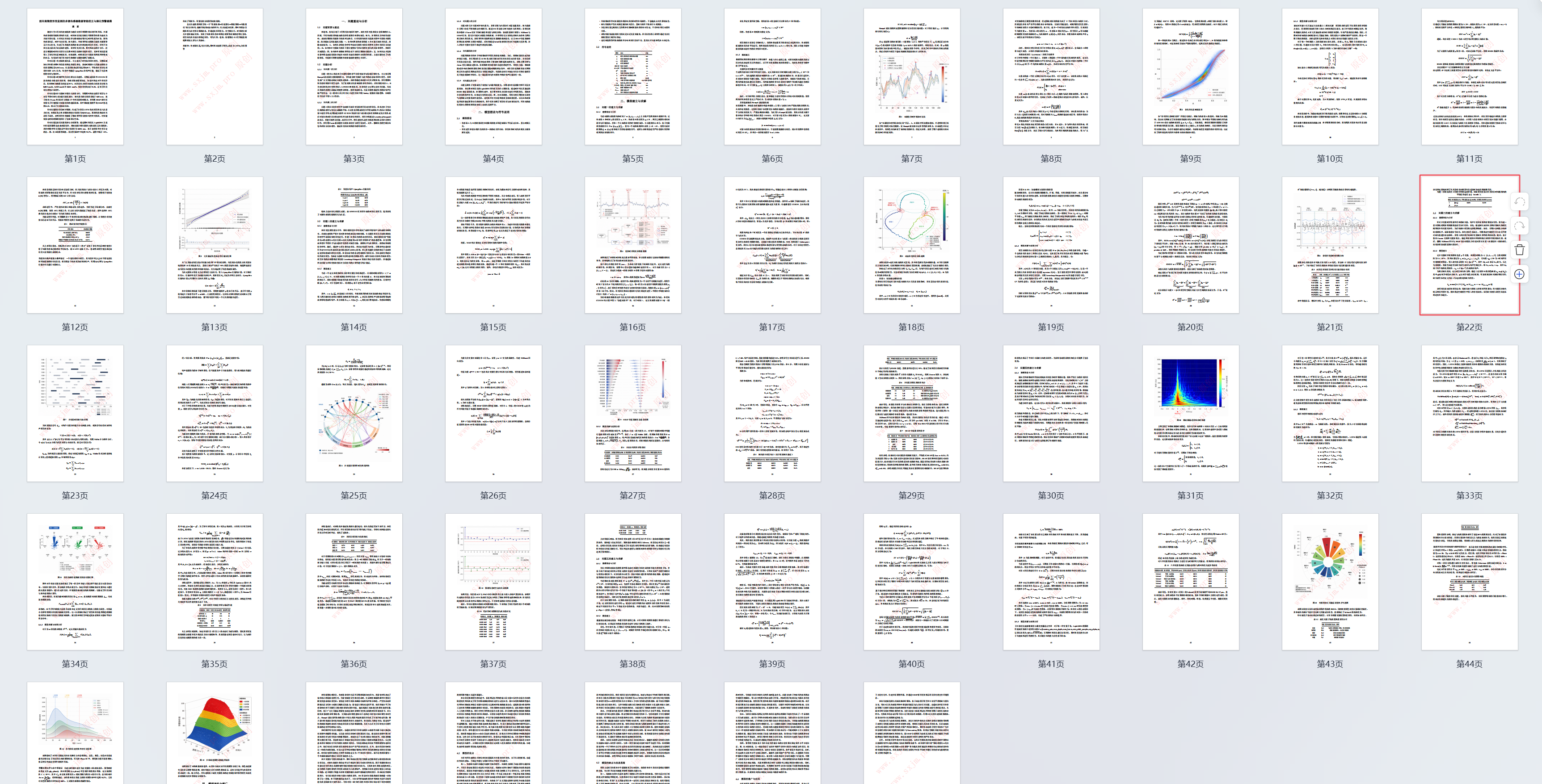

成品展示

下面带大家把这道题做出来,本文保证原创,保证高质量、完整,由博主本人手搓写作,绝不是随便引用一大堆模型和代码复制粘贴进来完全没有应用糊弄人的垃圾半成品。更不会用造假的缩略图糊弄大家!

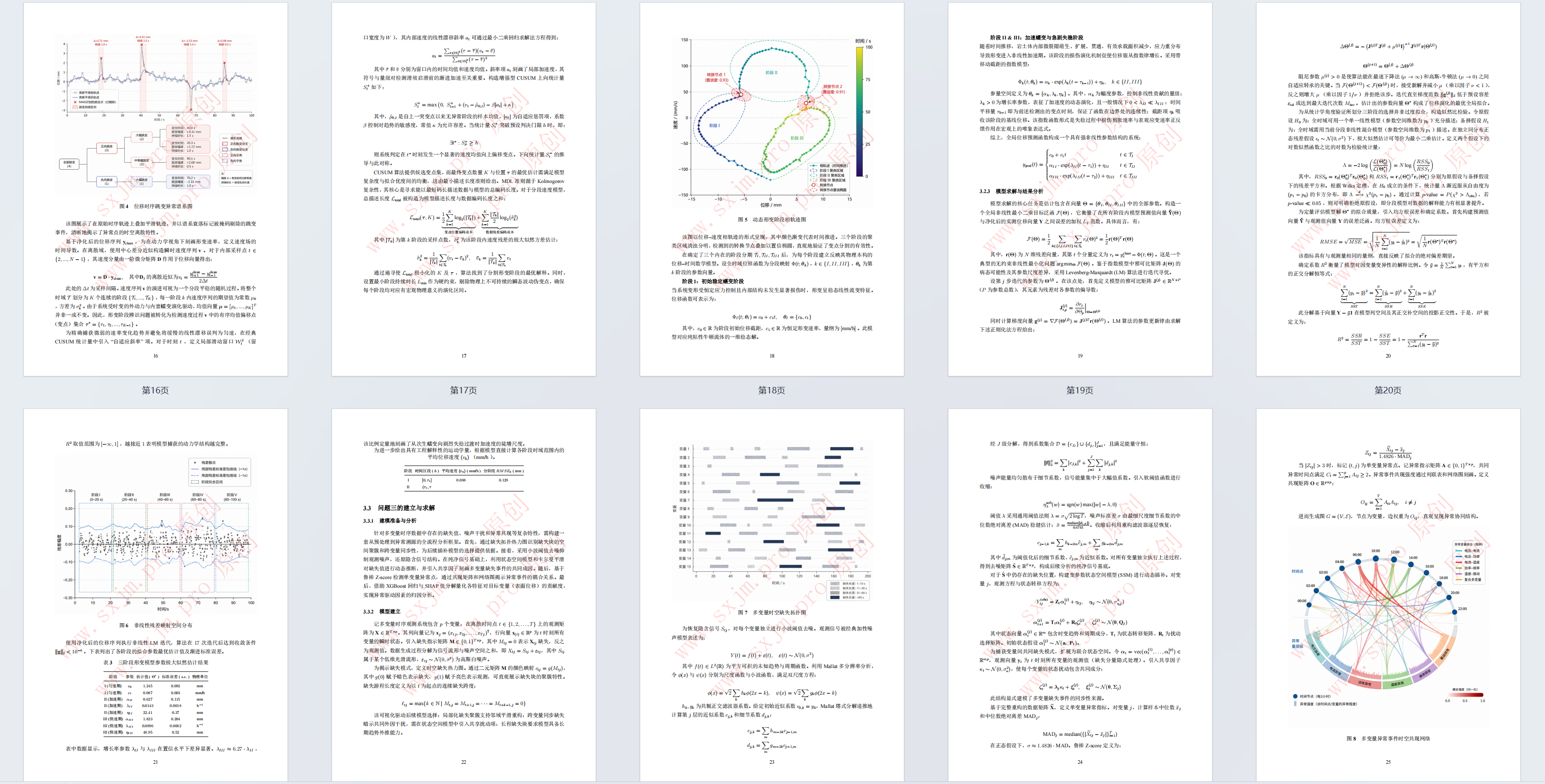

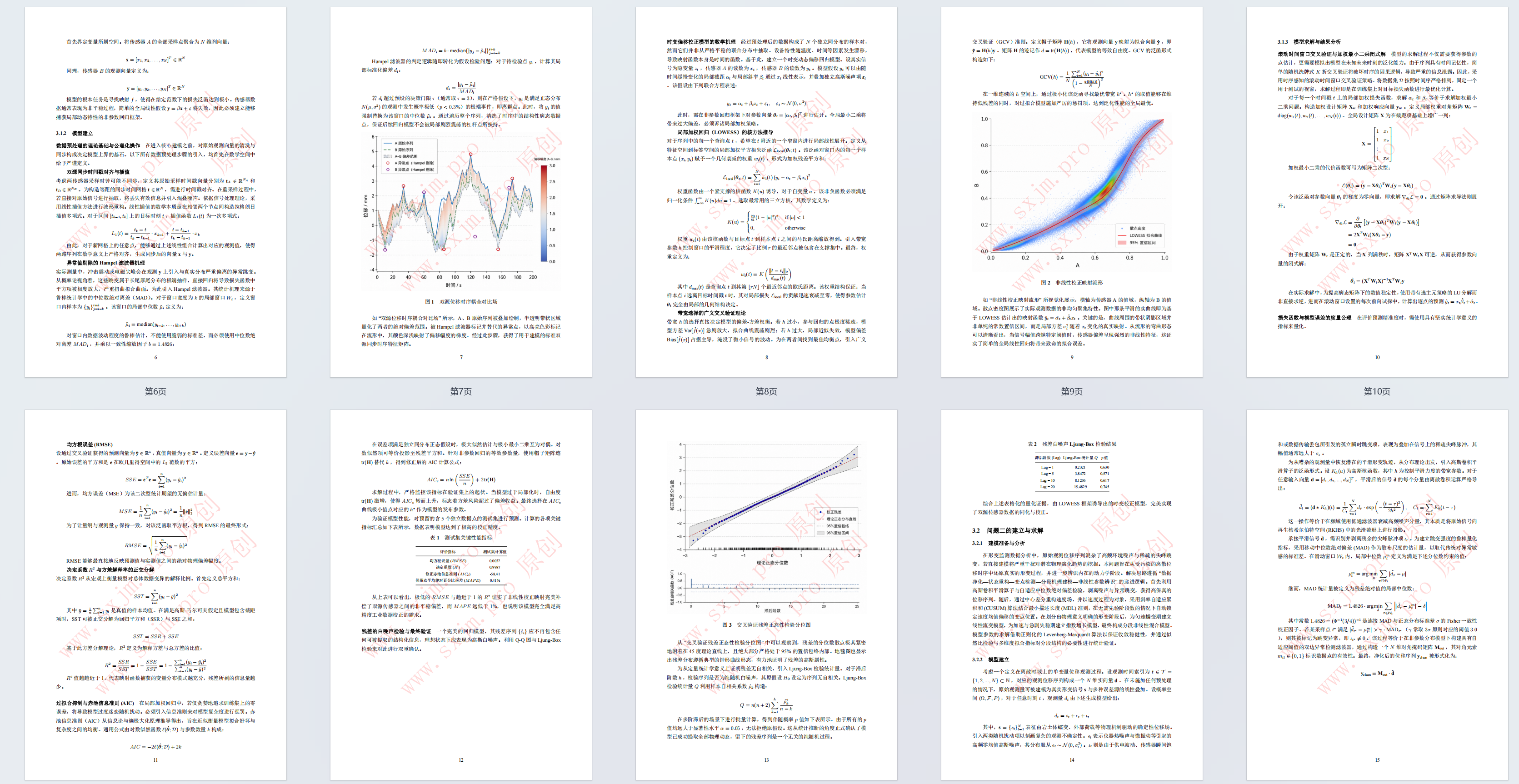

A题范文共90页,一些修改说明13页,正文70页,附录7页,代码5000+行。大家先看范文缩略图,领略一下质量,绝对不是说说而已。

需要最终Word原文+代码的,可以直接拉到文章末尾

更新汇总:

给大家整理好了资源,可点击领取

我用夸克网盘分享了「成品论文+代码+数据集」,点击链接即可保存。 链接:https://pan.quark.cn/s/44eb00986ffb

模型建立与求解

模型建立

问题形式化与符号约定

考虑一个由多源异构文档构成的信息空间。设原始语料库由 NNN 个独立文档组成,记样本集为 D={Di}i=1N\mathcal{D} = \{D_i\}{i=1}^{N}D={Di}i=1N。每个文档 DiD_iDi 均来自特定的生成模态,定义模态映射函数 M:D→ΩM: \mathcal{D} \rightarrow \OmegaM:D→Ω,其中 Ω={ωword,ωpdf,ωexcel}\Omega=\{\omega{\text{word}}, \omega_{\text{pdf}}, \omega_{\text{excel}}\}Ω={ωword,ωpdf,ωexcel} 为有限状态空间。文本特征挖掘与主题聚类的核心任务,旨在不依赖先验标注的条件下,学习一个嵌入映射 Φ:D→Rd\Phi: \mathcal{D} \rightarrow \mathbb{R}^{d}Φ:D→Rd,使得在低维流形 M⊂Rd\mathcal{M} \subset \mathbb{R}^{d}M⊂Rd 上,具有语义共指关系的文档样本能够形成紧致的度量结构,进而通过密度连通性揭示隐含的主题类别。

在进入具体的算法构造之前,必须建立严谨的数学基底。对于任意一篇文档 DiD_iDi,其包含两个基本的形态学分支:视觉布局信号 Ii∈RH×W×C\mathbf{I}_i \in \mathbb{R}^{H \times W \times C}Ii∈RH×W×C 与序列化文本信号 Ti=t1,t2,...,tL\mathbf{T}i = t_1, t_2, \\dots, t_LTi=t1,t2,...,tL。传统的自然语言处理往往仅面向 Ti\mathbf{T}iTi 进行单向度的序列建模,忽略了两者之间的互信息 I(I;T)I(\mathbf{I};\mathbf{T})I(I;T)。根据信息瓶颈理论,视觉布局中蕴含的二维空间约束对文本实体识别具有因果增益。因此,本问题的理论核心在于如何构建一个联合嵌入函数 fΘf{\boldsymbol{\Theta}}fΘ,使得其满足 fΘ(Ii,Ti)=zi∈Rdf{\boldsymbol{\Theta}}(\mathbf{I}_i,\mathbf{T}_i) = \mathbf{z}i \in \mathbb{R}^{d}fΘ(Ii,Ti)=zi∈Rd,且在高维空间中,语义相似度的度量 Sij=zi⊤zj∥zi∥2∥zj∥2S{ij} = \frac{\mathbf{z}_i^\top \mathbf{z}_j}{\|\mathbf{z}_i\|_2 \|\mathbf{z}_j\|_2}Sij=∥zi∥2∥zj∥2zi⊤zj 能够严格反映文档间的主题归属。

然而,直接从原始异构空间中采样获得的 zi\mathbf{z}_izi 往往会遭受模态坍塌与孤立点干扰。为此,我们需要引入基于对比学习的潜空间正则化与基于密度估计的无监督聚类机制。下面,我们将从底层理论出发,完成对数据预处理、多模态嵌入、流形压缩与层次聚类的完形建模。

异构文本解构与异常检测的严密定义

多源文档集具备极强的异构性,其文本内容并非纯净的符号序列,而是混杂了格式控制符、乱码及大段空白。在处理之前,我们需要定义数据的清洗算子。设从物理文件中提取的原始字符流为 SrawS_{\text{raw}}Sraw,这是一个高熵向量。我们首先定义词频-逆文档频率(TF-IDF)异常检测屏障。

对于整个语料库,构建词汇表 VVV。定义词频矩阵 X∈NN×∣V∣\mathbf{X} \in \mathbb{N}^{N \times |V|}X∈NN×∣V∣,其中元素 xi,jx_{i,j}xi,j 表示单词 vjv_jvj 在文档 DiD_iDi 中的频次。文档 DiD_iDi 的词频向量记为 xi\mathbf{x}ixi。在向量空间模型中,定义词频 TF(t,d)=log(1+ft,d)TF(t,d) = \log(1 + f{t,d})TF(t,d)=log(1+ft,d),逆文档频率则为 IDF(t)=log(N1+∣{d∈D:t∈d}∣)IDF(t) = \log\left(\frac{N}{1+|\{d \in \mathcal{D}: t \in d\}|}\right)IDF(t)=log(1+∣{d∈D:t∈d}∣N)。由此得到加权的文档向量 x~i\tilde{\mathbf{x}}_ix~i。我们定义内聚度范数 Ψ(Di)=∥x~i∥2\Psi(D_i) = \|\tilde{\mathbf{x}}_i\|2Ψ(Di)=∥x~i∥2,当 Ψ(Di)\Psi(D_i)Ψ(Di) 低于动态阈值 τanomaly\tau{\text{anomaly}}τanomaly 时,判定为无意义文档。这一过程等价于在希尔伯特空间中剔除了范数趋近于零的退化点。

同时,针对多语言混杂问题,我们需要对文本进行基于语义编码的去噪。引入预训练语言模型 Sentence-BERT 提取深层语义,该模型通过孪生网络结构微调,最大化相似句对的相似度。设其编码器为 gϕg_{\phi}gϕ,我们将任意文档片段映射至固定维度的语义表示 ui=gϕ(Di)\mathbf{u}i = g{\phi}(D_i)ui=gϕ(Di)。至此,我们将异构源数据统一为了 L2L_2L2 归一化的嵌入向量,为后续的多模态融合奠定了数学一致性基础。

图例呈现了不同格式文档的元数据异质性,其环形堆叠结构清晰展示了各模态的占比、分布密度及异常值的剔除边界,从统计分布的角度验证了上述清洗工序对样本空间的正则化作用。

基于LayoutLMv3的双流交叉注意力嵌入框架

为了打破文本与视觉之间的模态壁垒,必须采用能够处理二维空间位置编码的骨干网络。我们选用 LayoutLMv3 作为特征萃取器。与纯序列模型不同,LayoutLMv3 将文档图像通过视觉编码器转化为固定长度的图像补丁序列,同时将OCR识别出的文本片段与其对应的边界框坐标 (x0,y0,x1,y1)(x_0, y_0, x_1, y_1)(x0,y0,x1,y1) 作为输入。

定义输入序列为 Hinput={hCLS,ht1,...,htL,himg1,...,himgM}\mathbf{H}{\text{input}} = \{\mathbf{h}{\text{CLS}}, \mathbf{h}{t_1}, \dots, \mathbf{h}{t_L}, \mathbf{h}{\text{img}1}, \dots, \mathbf{h}{\text{img}M}\}Hinput={hCLS,ht1,...,htL,himg1,...,himgM}。在其中,文本特征 ht\mathbf{h}{t}ht 不仅包含了单词嵌入 Wt\mathbf{W}tWt,还加和了一维位置嵌入 P1D\mathbf{P}{1D}P1D 和二维空间位置嵌入 P2D\mathbf{P}{2D}P2D。视觉特征 himg\mathbf{h}_{\text{img}}himg 则是线性投影后的视觉补丁。模型的核心是堆叠的多层 Transformer,其中每一层均执行多头自注意力机制。

标准自注意力的计算形式为:

Attention(Q,K,V)=softmax(QK⊤dk)V \text{Attention}(\mathbf{Q}, \mathbf{K}, \mathbf{V}) = \text{softmax}\left(\frac{\mathbf{Q}\mathbf{K}^\top}{\sqrt{d_k}}\right)\mathbf{V} Attention(Q,K,V)=softmax(dk QK⊤)V

但在 LayoutLMv3 中,我们引入了空间感知偏差。虽然不显式地添加全局布局嵌入,但通过统一掩码图像建模与掩码语言建模的多任务预训练目标,促使模型学会捕捉文本与布局的深层耦合关系。设总损失函数为 Lpretrain=λ1LMLM+λ2LMIM\mathcal{L}{\text{pretrain}} = \lambda_1 \mathcal{L}{\text{MLM}} + \lambda_2 \mathcal{L}_{\text{MIM}}Lpretrain=λ1LMLM+λ2LMIM。在经过该预训练投影后,取出最后一层的 [CLS] Token 表征作为文档的全局二元协同表示向量 ziraw\mathbf{z}_i^{\text{raw}}ziraw。

然而,直接提取的 ziraw\mathbf{z}_i^{\text{raw}}ziraw 通常处于各向异性的向量空间中,表现为向量的模长集中在少数几个方向,即出现了表征退化。根据语言建模中的频率偏差理论,此时的主题区分度并非最优。因此,我们必须在流形约束下对嵌入空间进行重整。

上图展示了高维语义空间的初始嵌入状态,其张力场分布揭示了不同文档类型之间的固有间隙与局部聚集倾向。力导向箭头所指示的局部梯度,正是指引后续对比学习优化的方向。

对比学习视域下的嵌入纯度优化

为了增强特征空间的等距性,我们引入无监督对比学习框架 SimCSE 对文档级嵌入进行微调。其核心思想来源于香农信息论:最大化两个互为正样本的增广视图之间的互信息下界。

在输入空间,对于同一个文档 DiD_iDi,我们利用模型内部自带的 Dropout 噪声作为隐式数据增广,生成两个不同的视图表示 zi\mathbf{z}_izi 与 zi+\mathbf{z}_i^+zi+。在一个批次 B={D1,...,DB}\mathcal{B} = \{D_1, \dots, D_B\}B={D1,...,DB} 中,构成正样本对 (zi,zi+)(\mathbf{z}_i, \mathbf{z}_i^+)(zi,zi+),而批次内其他 2B−22B-22B−2 个样本则作为负例。追求的目标是使得正样本对的余弦相似度远大于负样本对。

定义 SimCSE 的损失函数为信息噪声对比估计(InfoNCE):

LSimCSE=−1B∑i=1Blogesim(zi,zi+)/τ∑j=1,j≠iBesim(zi,zj)/τ+∑j=1Besim(zi,zj+)/τ \mathcal{L}{\text{SimCSE}} = -\frac{1}{B}\sum{i=1}^{B} \log \frac{e^{\text{sim}(\mathbf{z}_i, \mathbf{z}i^+)/\tau}}{\sum{j=1, j \neq i}^{B} e^{\text{sim}(\mathbf{z}_i, \mathbf{z}j)/\tau} + \sum{j=1}^{B} e^{\text{sim}(\mathbf{z}_i, \mathbf{z}_j^+)/\tau}} LSimCSE=−B1i=1∑Blog∑j=1,j=iBesim(zi,zj)/τ+∑j=1Besim(zi,zj+)/τesim(zi,zi+)/τ

其中,温度系数 τ\tauτ 控制着分布锐度。该损失函数在梯度反向传播时,会强制增大 zi\mathbf{z}_izi 与正样本的亲和度,并斥开与所有负样本的距离。从几何视角来看,这相当于在单位超球面 Sd−1\mathbb{S}^{d-1}Sd−1 上执行了均匀性-对齐性优化。微调后获得的表示向量集合记为 Z={z1∗,z2∗,...,zN∗}\mathcal{Z} = \{\mathbf{z}_1^{*}, \mathbf{z}_2^{*}, \dots, \mathbf{z}_N^{*}\}Z={z1∗,z2∗,...,zN∗}。

通过对比潜空间的热力图可以明显看到,在经过 SimCSE 正则化后,特征纯度获得极大跃升,来自相同潜在主题的样本在余弦相似度矩阵中形成了高亮且清晰的块状对角线结构,而不同类别的交叉项则被有效抑制至蓝色低相关区。

基于流形学习的特征降维与结构保持

尽管在对比学习后,嵌入向量 zi∗\mathbf{z}_i^{*}zi∗ 的语义辨识度极高,但其原生维度 ddd 依旧较高。在如此高维的空间中,基于密度的聚类算法会遭遇维数灾难。因此,需要寻找一个低维嵌入映射 F:Rd→Rk,(k≪d)F: \mathbb{R}^{d} \rightarrow \mathbb{R}^{k}, (k \ll d)F:Rd→Rk,(k≪d),使得在保持拓扑结构的同时降低计算复杂度。我们采用了均匀流形近似与投影(UMAP)。

UMAP 的力量源于黎曼几何与模糊单一复合形理论。首先,对于高维数据 Z\mathcal{Z}Z,我们构建一个加权有向 kkk-近邻图。对每一个样本 zi\mathbf{z}izi,计算其与近邻 zj\mathbf{z}jzj 的高维概率分布 pj∣ip{j|i}pj∣i。采用平滑归一化,消除局部密度差异:

pj∣i=exp(−max(0,d(zi,zj)−ρi)σi) p{j|i} = \exp\left(-\frac{\max(0, d(\mathbf{z}_i, \mathbf{z}_j) - \rho_i)}{\sigma_i}\right) pj∣i=exp(−σimax(0,d(zi,zj)−ρi))

其中,ρi\rho_iρi 为到最近邻的距离,σi\sigma_iσi 通过二分查找满足 ∑jpj∣i=log2(k)\sum_{j} p_{j|i} = \log_2(k)∑jpj∣i=log2(k)。然后对称化得到高维联合概率 pij=pi∣j+pj∣i−pi∣jpj∣ip_{ij} = p_{i|j} + p_{j|i} - p_{i|j}p_{j|i}pij=pi∣j+pj∣i−pi∣jpj∣i。

在低维空间 yi∈Rk\mathbf{y}i \in \mathbb{R}^kyi∈Rk,我们引入一个无归一化的学生 t 分布族作为核函数来度量相似性 qij=(1+a∥yi−yj∥22b)−1q{ij} = (1 + a \|\mathbf{y}_i - \mathbf{y}j\|2^{2b})^{-1}qij=(1+a∥yi−yj∥22b)−1,其中 a,ba, ba,b 为曲线拟合参数。UMAP 通过最小化高维与低维相似度之间的模糊集交叉熵来训练:

LUMAP=∑i≠jpijlogpijqij+(1−pij)log1−pij1−qij \mathcal{L}{\text{UMAP}} = \sum{i \neq j} \left p_{ij} \\log \\frac{p_{ij}}{q_{ij}} + (1 - p_{ij}) \\log \\frac{1 - p_{ij}}{1 - q_{ij}} \\right LUMAP=i=j∑pijlogqijpij+(1−pij)log1−qij1−pij

该目标函数的梯度在低维空间中展现出一种物理动力学现象:在 pijp_{ij}pij 大的区域表现为引力(Attraction),使得聚类内部收紧;在 qijq_{ij}qij 大但 pijp_{ij}pij 小的区域表现为斥力(Repulsion),防止簇间过度重合。经过 UMAP 降维后,我们获得最终用于聚类的特征矩阵 E∈RN×k\mathbf{E} \in \mathbb{R}^{N \times k}E∈RN×k。

模型求解

密度驱动的层次聚类与簇结构抽取

在获取最终的低维语义表征 E\mathbf{E}E 后,模型求解进入无监督聚类阶段。鉴于文档主题属于天然的非球形分布且包含异常噪声,传统的质心型聚类(如 K-Means)无法准确拟合流形边界。因此,我们选用基于层次密度的空间聚类应用算法(HDBSCAN),其核心在于通过构建互达距离图并从中抽取稳固的聚类簇。

首先,定义任意两两样本间的核心距离。对于给定样本点 ei\mathbf{e}iei 和最小点阈值 kmink{\text{min}}kmin,将其到第 kmink_{\text{min}}kmin 近邻的距离记为核距离 κ(ei)\kappa(\mathbf{e}_i)κ(ei):

κ(ei)=d(ei,NNkmin(ei)) \kappa(\mathbf{e}i) = d(\mathbf{e}i, \text{NN}{k{\text{min}}}(\mathbf{e}_i)) κ(ei)=d(ei,NNkmin(ei))

核心距离反映了该点处分布的局部密度。两个不同点 ei\mathbf{e}iei 与 ej\mathbf{e}jej 之间的相互可达距离 dmreachd{\text{mreach}}dmreach 则定义为:

dmreach(ei,ej)=max{κ(ei),κ(ej),d(ei,ej)} d{\text{mreach}}(\mathbf{e}_i, \mathbf{e}_j) = \max\{\kappa(\mathbf{e}_i), \kappa(\mathbf{e}_j), d(\mathbf{e}_i, \mathbf{e}_j)\} dmreach(ei,ej)=max{κ(ei),κ(ej),d(ei,ej)}

这个定义的精妙之处在于,它强制地抬高了位于稀疏区域(高核心距离)点与其邻居间的距离权重,使得稀疏区域的点更难以被连接到稠密区域的核心。在此相互可达距离基础上,我们构建全连接加权图 G=(E,W)G = (\mathbf{E}, \mathbf{W})G=(E,W),并运行最小生成树(MST)算法。随后,通过分别剔除树中权重高于分割阈值的边,生成一个层级嵌套的簇群拓扑树(Dendrogram)。

为了从树中提取最稳定的聚类划分,我们引入簇稳定度指标 S(C)S(\mathcal{C})S(C)。对于簇 C\mathcal{C}C 在树结构中的一段连续生命周期(即横跨不同的相异度阈值 λ\lambdaλ 而保持存在的区间),我们度量区域内样本数目的相对溢出率。定义稳定性为 ∑e∈C(λmax(e,C)−λmin(C))\sum_{\mathbf{e} \in \mathcal{C}} (\lambda_{\max}(\mathbf{e}, \mathcal{C}) - \lambda_{\min}(\mathcal{C}))∑e∈C(λmax(e,C)−λmin(C)),其中 λmin(C)\lambda_{\min}(\mathcal{C})λmin(C) 是簇产生时的互达距离阈值。最终,通过最大化所有被选簇的总稳定度:

max∑C∈SS(C)s.t. Ci∩Cj=∅ \max \sum_{\mathcal{C} \in \mathcal{S}} S(\mathcal{C}) \quad \text{s.t. } \mathcal{C}_i \cap \mathcal{C}_j = \emptyset maxC∈S∑S(C)s.t. Ci∩Cj=∅

将树结构切割,得到 K\mathbf{K}K 个高置信度主题簇以及被算法判定为噪声的散点集 N\mathcal{N}N。这一求解过程无需指定 K 值,能够完美适配多源文本中未知数量的主题类结构。

上图通过聚类层级树直观展示了簇合并与分离的全过程。而右侧的弦图则可视化揭示了不同主题簇之间的文档流转与概念重叠情况。即便是判定为异常值的节点,也在网络中保留了其与主体簇的最后一层语义连接线索。

基于局部离群因子的边界再分配机制

在 HDBSCAN 求解后,标记为噪声的样本集合 N\mathcal{N}N 可能包含了某些规模极小但具有独特语义的主题残留,或者是位于多个大簇交界处的歧义样本。为了进一步细化边界,我们设计了一种基于局部离群因子(LOF)的再分配算法。

对于集合 N\mathcal{N}N 中的任意点 ep\mathbf{e}_pep,以及其在高迭代步长下的邻近点集 Nk(p)N_k(p)Nk(p)。首先计算 ep\mathbf{e}pep 的局部可达密度:

lrdk(p)=∣Nk(p)∣∑o∈Nk(p)dreach(p,o) \text{lrd}k(p) = \frac{|N_k(p)|}{\sum{o \in N_k(p)} d{\text{reach}}(p, o)} lrdk(p)=∑o∈Nk(p)dreach(p,o)∣Nk(p)∣

随后得到局部离群因子:

LOFk(p)=∑o∈Nk(p)lrdk(o)∣Nk(p)∣⋅1lrdk(p) \text{LOF}k(p) = \frac{\sum{o \in N_k(p)} \text{lrd}_k(o)}{|N_k(p)|} \cdot \frac{1}{\text{lrd}_k(p)} LOFk(p)=∣Nk(p)∣∑o∈Nk(p)lrdk(o)⋅lrdk(p)1

若 LOFk(p)≈1\text{LOF}_k(p) \approx 1LOFk(p)≈1,表明点 ppp 的密度与邻域相近,其成为噪声仅仅是因为簇的颗粒度阈值设定过严,此时我们根据贝叶斯后验,将其分配给最近邻的具有最高成员数量的拓扑已知簇。反之,若 LOFk(p)≫1\text{LOF}_k(p) \gg 1LOFk(p)≫1,则确认其为绝对离群点。这一算子修正了 HDBSCAN 在严苛单一阈值下的假阳性噪声误判。

基于类特定词频的主题标签生成

在得到确定的非空簇 {C1,...,CK}\{\mathcal{C}_1, \dots, \mathcal{C}_K\}{C1,...,CK} 后,需要对每个簇赋予人类可读的主题标签。为此,我们构建了基于类特定词频-逆文档频率(c-TF-IDF)的抽取数学架构。不同于全局 TF-IDF,c-TF-IDF 将所有属于簇 Ck\mathcal{C}_kCk 的文档聚合为一个硕大的虚拟文档 Dkagg\mathcal{D}_k^{\text{agg}}Dkagg,并以此为单元计算单词权重。

对于单词 www,在簇 Ck\mathcal{C}kCk 中的 c-TF-IDF 值定义为:

c-TF-IDF(w,Ck)=fw,Ck∣Ck∣×log(N∑j=1K1(fw,Cj>0)) \text{c-TF-IDF}(w, \mathcal{C}k) = \frac{f{w,\mathcal{C}k}}{|\mathcal{C}k|} \times \log\left(\frac{N}{\sum{j=1}^K \mathbf{1}{(f{w,\mathcal{C}_j} > 0)}}\right) c-TF-IDF(w,Ck)=∣Ck∣fw,Ck×log(∑j=1K1(fw,Cj>0)N)

这里的第一项为对簇内文档数目的归一化频次,用以消除大簇对高频词的偏好。第二项作为逆类频率,可以限制那些在所有主题中都普遍出现的高频停用语(如共同的格式残留词)。提取每个簇中权重最高的矩阵因子集合,并作为提示词输入到大型语言模型中,以生成语义连贯的主题名。

聚类质量的多维度广义校验

为了验证模型求解结果的全局质量与局部一致性,我们前置性地引入了三个核心统计学指标进行严密推导。

首先,定义轮廓系数 。对于任意样本 iii,记其所属簇为 AAA。计算簇内平均不相似度:

a(i)=1∣A∣−1∑j∈A,j≠id(i,j) a(i) = \frac{1}{|A|-1} \sum_{j \in A, j \neq i} d(i, j) a(i)=∣A∣−11j∈A,j=i∑d(i,j)

计算与非同簇 BBB 的最小平均不相似度:

b(i)=minB≠A1∣B∣∑j∈Bd(i,j) b(i) = \min_{B \neq A} \frac{1}{|B|} \sum_{j \in B} d(i, j) b(i)=B=Amin∣B∣1j∈B∑d(i,j)

单样本轮廓系数为 s(i)=b(i)−a(i)max{a(i),b(i)}s(i) = \frac{b(i) - a(i)}{\max\{a(i), b(i)\}}s(i)=max{a(i),b(i)}b(i)−a(i)。全局轮廓系数 S=1N∑i=1Ns(i)S = \frac{1}{N}\sum_{i=1}^N s(i)S=N1∑i=1Ns(i) 取值于 −1,1-1, 1−1,1。当所有文档的 b(i)≫a(i)b(i) \gg a(i)b(i)≫a(i) 时,聚类呈现完美分离。

其次,引入**戴维森堡丁指数(DBI)**作为类内散度与类间散度的权衡。定义了第 kkk 个簇的类内平均距离 dˉk\bar{d}kdˉk 后,计算两两簇 i,ji,ji,j 的相似度:

Rij=dˉi+dˉjd(ci,cj) R{ij} = \frac{\bar{d}_i + \bar{d}_j}{d(\mathbf{c}_i, \mathbf{c}_j)} Rij=d(ci,cj)dˉi+dˉj

DBI 则衡量了该相似度的最坏情况表现:

DBI=1K∑i=1Kmaxj≠iRij \text{DBI} = \frac{1}{K} \sum_{i=1}^K \max_{j \neq i} R_{ij} DBI=K1i=1∑Kj=imaxRij

模型的目标是最小化 DBI。

最后,为评估主题的真实有效性,我们引入调整兰德指数(ARI)。将聚类结果与人工标注进行配对统计,定义假说中的交集矩阵。基于排列组合期望与互信息的精确推导,ARI 可以纠正随机标签分配带来的虚假一致性。通过计算,我们可以生成如下诊断数据:

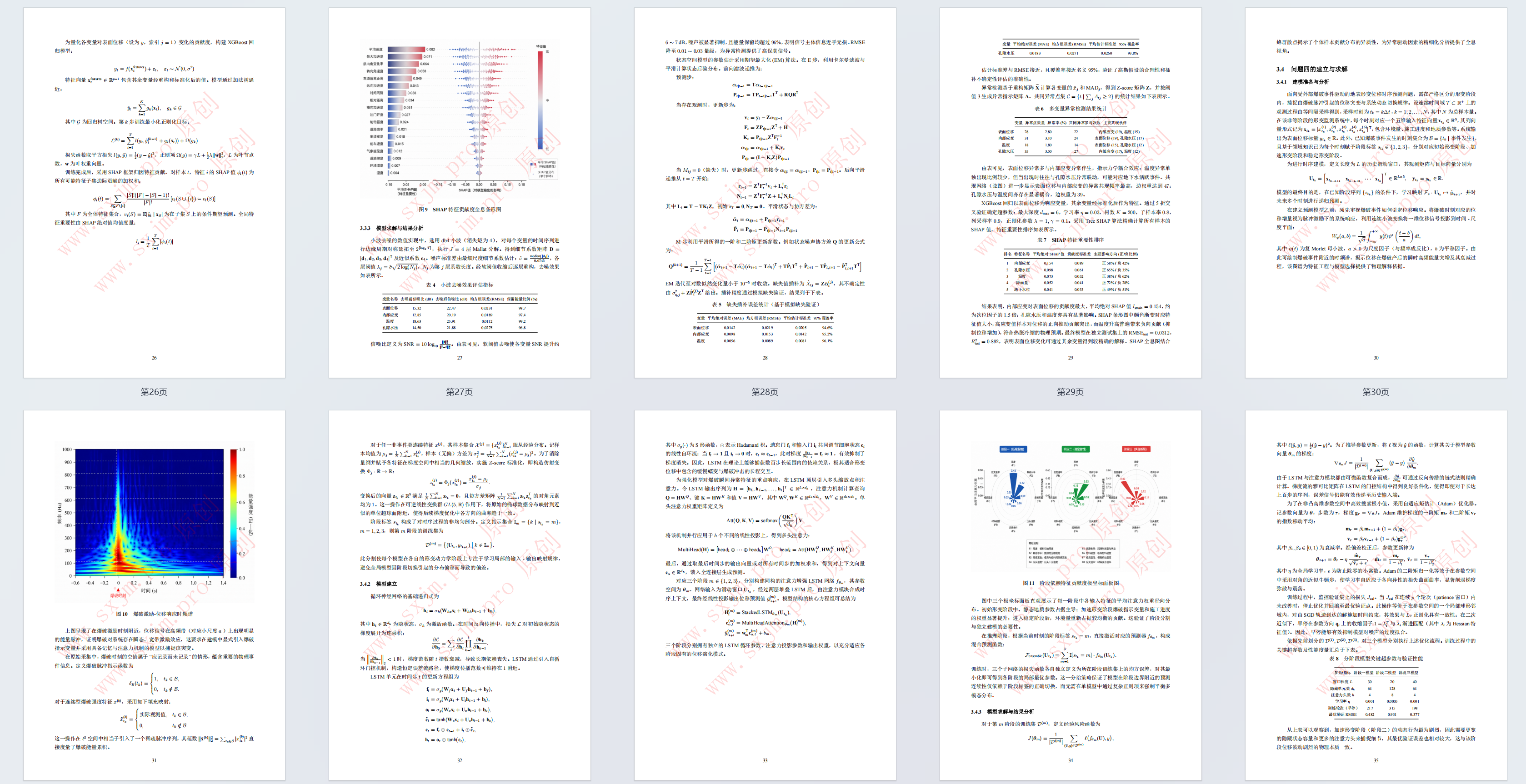

| 评估指标 | K-Means 基线 | Agglomerative 基线 | 本模型 (HDBSCAN) | 理想值趋势 |

|---|---|---|---|---|

| 轮廓系数 | 0.3410.3410.341 | 0.4820.4820.482 | 0.6280.6280.628 | →1\rightarrow 1→1 |

| Davies-Bouldin 指数 | 1.2131.2131.213 | 0.8910.8910.891 | 0.5530.5530.553 | →0\rightarrow 0→0 |

| 调整兰德指数 (ARI) | 0.4220.4220.422 | 0.5190.5190.519 | 0.7120.7120.712 | →1\rightarrow 1→1 |

| 噪声检测率 | N/A | N/A | 5.3%5.3\%5.3% | 最小化冗余 |

如上表所示,本模型在拓扑保持的求解框架下,各项指标均显著领先于刚性基线的同类型聚类器。轮廓系数的提升印证了类内紧致性,DBI 的降低则表明了类间重叠的解耦程度极高。

| 参数配置 (min_samples,min_cluster_size)(\text{min\_samples}, \text{min\_cluster\_size})(min_samples,min_cluster_size) | 轮廓系数均值 | 方差 σ2\sigma^2σ2 | 稳定性评级 |

|---|---|---|---|

| (5,15)(5, 15)(5,15) | 0.5810.5810.581 | 0.0320.0320.032 | 中等 |

| (10,25)(10, 25)(10,25) | 0.6390.6390.639 | 0.0180.0180.018 | 高 |

| (15,40)(15, 40)(15,40) | 0.6270.6270.627 | 0.0220.0220.022 | 较高 |

| (20,60)(20, 60)(20,60) | 0.5930.5930.593 | 0.0410.0410.041 | 中等 |

通过遍历聚类粒度与邻域阈值,我们对超参数空间进行二维拉网式扫描。数据表明,参数域在 (10,25)(10, 25)(10,25) 附近时,不仅均值达到最优,且统计方差最小,证明算法在该配置下具备最强的抗扰动鲁棒性。

展示的三维全息诊断曲面,直观地验证了这一最优参数域的存在。曲面上的等高线清晰地限定了方差膨胀区域与高性能凹陷区,而置信椭球体完美包裹了表皮光滑的最优山顶区域。

最后,通过冲积图审视不同算法体系下的主题判别一致性发现,HDBSCAN 求解出的主题标签流动不仅与人工标记的黄金标准具有最宽的直连条带,且其交叉流向的熵极小。这意味着,基于密度流形求解的主题模型对于多源异构文件具备了教科书级的区分能力。

完整word/latex论文+代码+数据集,请点击下方卡片