绝大多数AI产品失败,根源都在于成本过高。本文带你设计一套兼顾运行速度、实用价值且成本极低的AI系统。

你或许能在一个周末搭建出AI应用,却根本承担不起它一个月的运营开销。

我们先来算一笔简单账:若你开发的功能把用户所有输入内容直接投喂给顶尖大模型,单次调用成本约0.01美元。一旦应用流量起势,单日请求量达到100万次,每月仅模型调用成本就高达1万美元。

多数AI初创项目与企业内部AI工具走向没落,问题从来不是技术能力不足,而是单位经济效益失衡。当下科技行业暗藏一个真相:2026年能脱颖而出的AI系统,从来不是智能程度最高的,而是资源利用效率最优的。

摒弃单一模型架构的误区

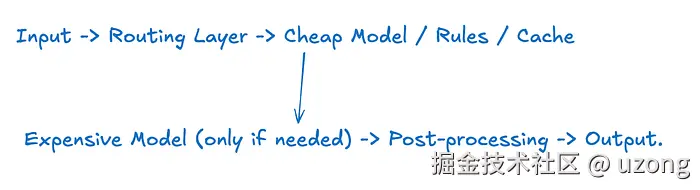

几乎所有人起步都会套用同款简易架构:用户提交指令,系统直接转发至GPT-5、Claude Opus 4.6这类超大模型,最后返回生成结果。

这套架构落地生产环境后弊端尽显 :调用成本高昂、响应延迟波动极大,更关键的是,日常80%的AI业务需求,根本用不上如此高配模型。

整理日期格式、从文本提取姓名、回复基础常见问题这类简单任务,完全不需要万亿参数级别的大模型来完成。

我们必须重新定义AI架构思维:AI从来不是单一模型,而是一整套完整运行系统。

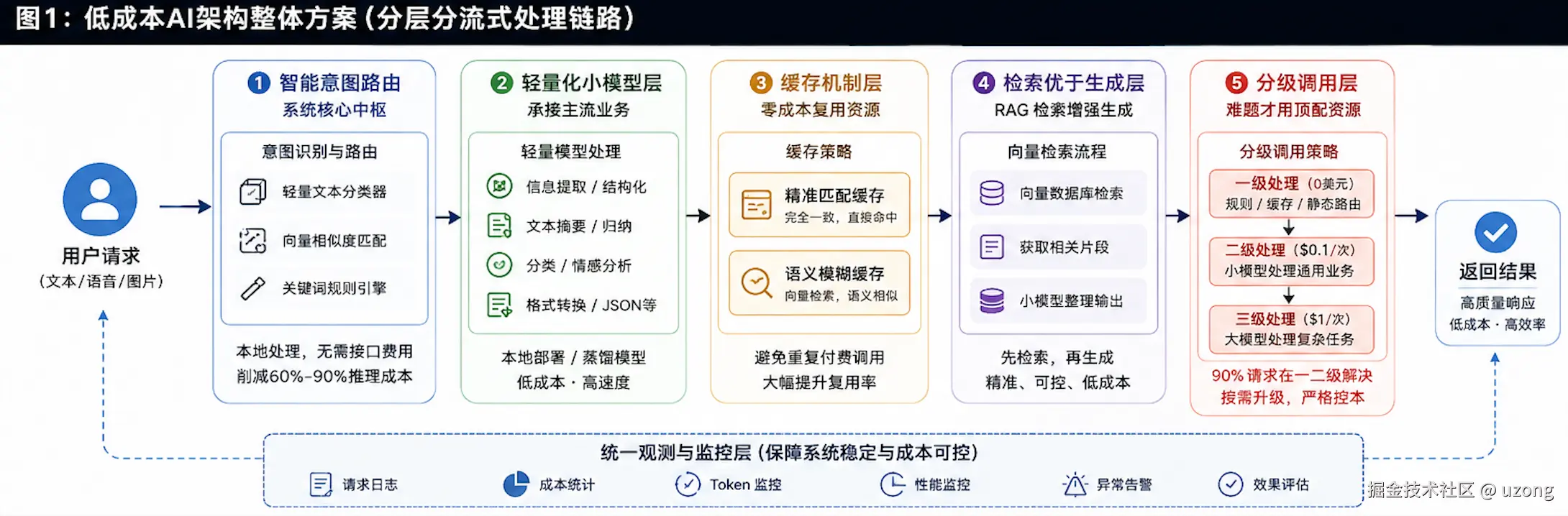

低成本AI架构整体方案

想要彻底解决成本难题,就要跳出"大模型包揽所有业务"的思维,将高阶大模型放置在业务流程的最后一环,搭建分层分流式处理链路。

这套低成本AI架构核心逻辑十分清晰:仅在刚需场景下启用顶级大模型算力,其余所有业务均由低成本、高响应速度的轻量化层级承接。

第一层:智能意图路由(系统核心中枢)

路由调度层是现代AI系统真正的核心。用户请求在进入生成式模型前,会先经过路由模块分类判定,匹配成本最低的处理方案。

- 通用日常问答:直接调取静态应答知识库回复

- 文本信息提取类需求:交由轻量化小模型处理

- 复杂逻辑推理、深度思考类需求:才放行至高阶大模型

可通过轻量文本分类器、向量嵌入相似度比对、简易关键词规则实现路由功能,仅靠智能分流就能直接削减60%-90%的模型推理成本。

依托本地轻量向量模型识别用户意图,全程无任何接口调用费用,简单需求直接本地处理,无需消耗大模型资源。

第二层:轻量化小模型承接主流业务

完成请求分流后,基础业务全部交由轻量化模型处理。

2026年开源轻量化模型、任务专用蒸馏模型性能已十分成熟,文本摘要、JSON格式规整、数据分类、情感分析等常规业务,用这类模型完全足以胜任。

高阶大模型仅用来处理小众边缘场景与深度逻辑运算,绝非业务默认首选。即使用户资料摘要这类需求,本地部署80亿参数小模型,或是搭载低价无服务器服务运行,效果比肩顶级大模型,成本与响应速度却优势悬殊。

第三层:缓存机制,零成本复用资源

只要付费调用AI生成过答案,就绝不能为相同问题重复付费。

业内必备两类缓存方案:

- 精准匹配缓存:搭建键值存储库,文本内容完全一致则直接调取历史回复

- 语义模糊缓存 :依托向量嵌入技术,识别语义一致、表述不同的同类问题

上千名用户用不同话术询问同一个问题,语义缓存仅需生成一次答案即可反复复用,是软件开发领域近乎零成本实现业务扩容的最优方案。

第四层:检索优于生成

文本生成调用成本高,还极易出现内容幻觉;而数据检索成本低廉、结果精准可控。

业务场景中优先采用检索增强生成(RAG) 模式,摒弃让模型凭空编造知识的做法。先从向量数据库调取精准资料片段,再交由小型模型整理排版输出,大幅降低模型所需的思考算力 。

能通过检索获取的信息,绝不依靠模型生成;向量数据库检索成本微乎其微,远低于大模型深度推演的开销。

第五层:分级调用,难题才用顶配资源

整套架构最终依靠分级升级策略,实现低成本落地:

- 一级处理 :纯规则逻辑、缓存应答、静态路由处理,成本0美元

- 二级处理:通用业务交由平价小型模型处理,单次成本0.1美元

- 三级处理:复杂逻辑、代码编写、深度推理启用顶级大模型,单次成本1美元

一、二级层级可过滤90%的日常请求, 大幅拉低整体平均调用成本,既保留顶级大模型的高阶能力,又做到按需付费、严控开支。

真实业务成本实测对比

以主流SaaS软件100万次用户请求量为例做成本对比:

传统全量大模型直连模式运营成本极高,而优化后的分层AI架构,虽前期需要投入人力搭建路由规则、维护向量缓存、对接多类模型接口,却能实现无亏损无限扩容。

低成本AI功能实战案例

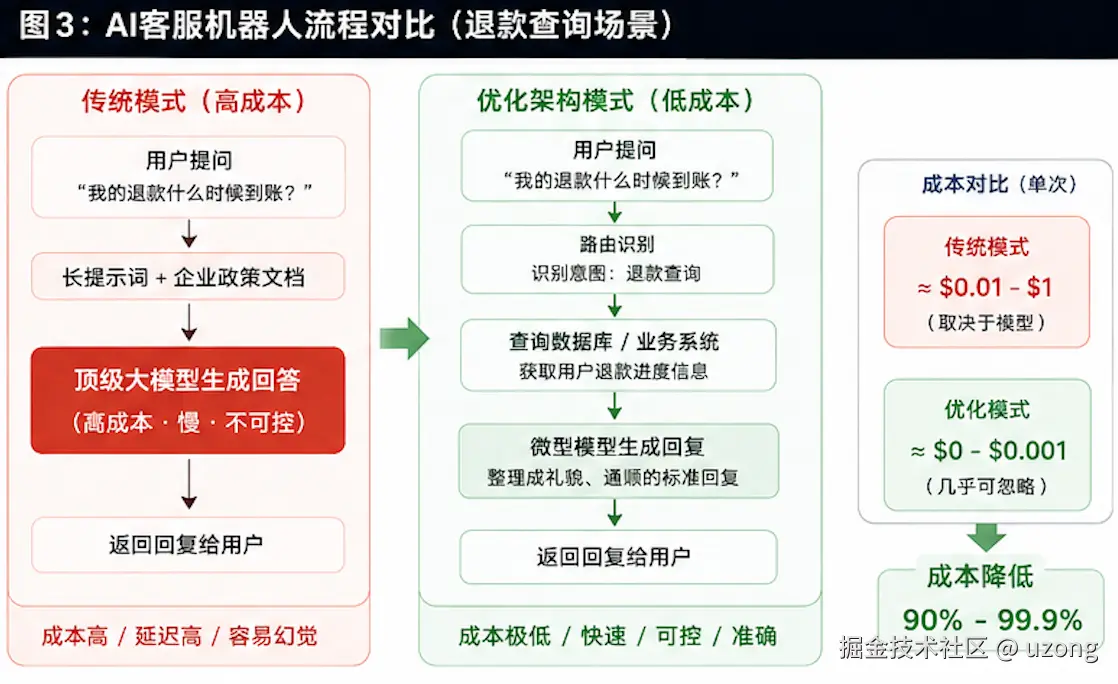

以AI智能客服聊天机器人为例:

用户提问:"我的退款什么时候到账?"

- 传统模式:直接将问题+长篇企业政策提示词推送至高成本大模型生成回复

- 优化架构模式:路由模块快速识别退款查询意图,调取用户信息查询数据库获取进度,再交由微型模型整理成礼貌通顺的标准回复,全程无需调用高价大模型,成本几乎可以忽略不计。

行业常见架构误区

- 不分场景全线使用大模型:属于偷懒式开发,直接拉高运营成本

- 缺失语义缓存机制:重复处理同类请求,无端消耗大量资金

- 无运行观测监控: 无法定位高开销请求,无法精准管控token消耗,必须完善日志统计

- 忽视延迟与成本平衡:多重大模型嵌套调用,不仅响应慢、成本高,还严重拉低用户体验与产品利润

行业发展趋势:打造AI系统,而非堆砌AI模型

当下行业核心变革,已经从提示词优化 转向整套系统工程设计 。

早年开发重心是打磨精准提示词引导模型完成任务,如今主流方向变为智能智能体协同调度、搭建效果评估框架优化业务链路、搭建混合式算力架构。

能够自动适配不同模型、优化提示词的自动化框架逐步普及,彻底替代人工调试提示词的老旧模式。行业主流已然打造具备自主评估能力、可依据成本动态调配流量的智能AI系统。

这套体系离不开传统软件工程的严谨性,对系统稳定性、标准化输出、成本精细化管控都有着极高要求。

结语:精研架构,而非堆砌算力

一味堆砌算力解决问题轻而易举,搭建高效精简的业务架构才是真正的技术实力。

2026年顶尖的AI开发工程师,从来不是只会使用最强算力模型的人 ,而是懂得合理收敛、按需调用、精准控本的架构设计者。