大模型:QwenPaw

全自动办公模型,效果如下:

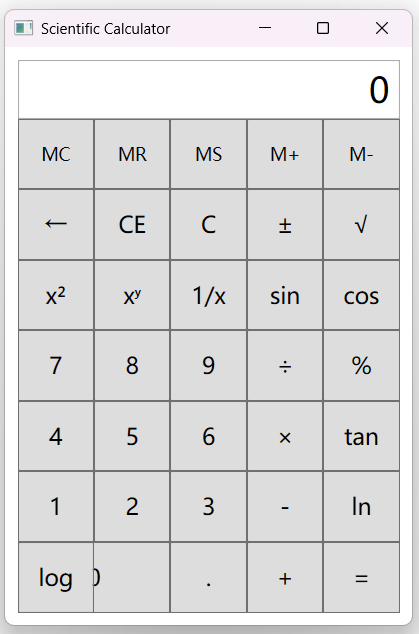

指令:打开 E:\Program Files\Microsoft Visual Studio\2022\Professional\Common7\IDE\devenv.exe 帮我写一个 WPF C# 科学计算器代码,并运行它。

结果: 视频地址:https://www.bilibili.com/video/BV1G25v6fEqj/

使用感觉,超级帮,剩下微调即可。

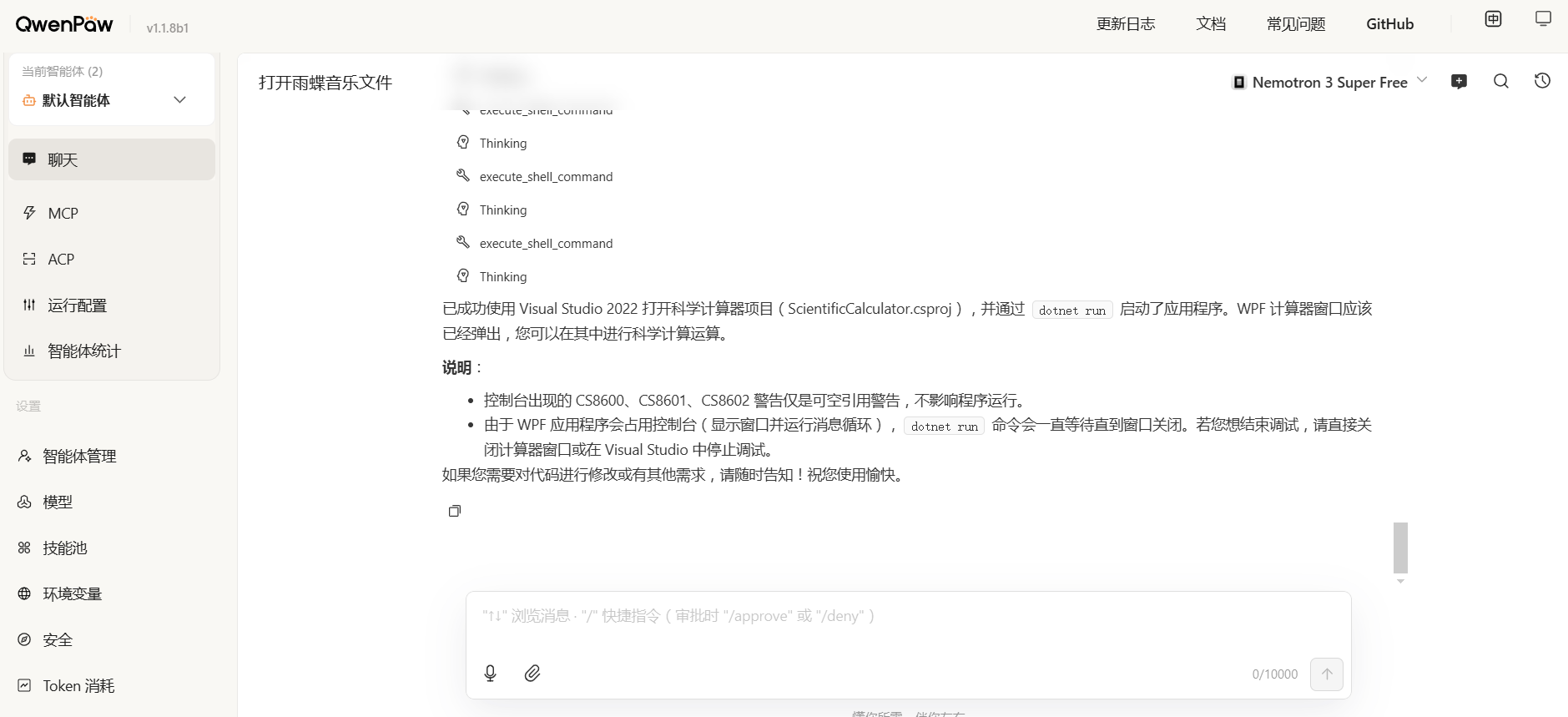

QwenPaw

Thinking

execute_shell_command

Thinking

execute_shell_command

Thinking

execute_shell_command

Thinking

write_file

Thinking

We need to write the code-behind for the scientific calculator. Let's read the existing MainWindow.xaml.cs first.

read_file

Thinking

write_file

Thinking

write_file

Thinking

execute_shell_command

Thinking

execute_shell_command

Thinking

execute_shell_command

Thinking

execute_shell_command

Thinking

execute_shell_command

Thinking

execute_shell_command

Thinking

已成功使用 Visual Studio 2022 打开科学计算器项目(ScientificCalculator.csproj),并通过 dotnet run 启动了应用程序。WPF 计算器窗口应该已经弹出,您可以在其中进行科学计算运算。

说明:

- 控制台出现的 CS8600、CS8601、CS8602 警告仅是可空引用警告,不影响程序运行。

- 由于 WPF 应用程序会占用控制台(显示窗口并运行消息循环),

dotnet run命令会一直等待直到窗口关闭。若您想结束调试,请直接关闭计算器窗口或在 Visual Studio 中停止调试。

以上是它所有步骤,执行几分钟时间,根据电脑配置完成指令时间不固定。

如果您需要对代码进行修改或有其他需求,请随时告知!祝您使用愉快。

QwenPaw-Flash

QwenPaw-Flash 是一款专为 QwenPaw 自主智能体场景深度优化的轻量级模型。该模型从训练阶段起就针对 QwenPaw 任务进行了专门优化,在工具调用、命令执行、记忆管理以及多步规划等方面展现出更强的智能体性能。

能力

QwenPaw-Flash 的核心优势源于其与 QwenPaw 生态系统的原生集成。我们构建了大量高质量的智能体轨迹数据,这些数据采样自真实的 QwenPaw 环境,系统性地提升了模型在高频日常场景中的熟练度。关键特性包括:

- 主动记忆管理: 自主识别、存储和检索持久化的用户偏好与任务状态,确保多轮交互间高度的逻辑一致性。

- 原生文件解析: 针对终端操作和文件系统编排进行优化,擅长生成精确的 CLI 命令并执行复杂的多步文件 I/O 任务。

- 高效信息检索: 强化了对网络搜索工具的调用能力,具备精准的搜索意图识别和多步网页导航功能,能有效定位并查询在线信息。

- 智能引导: 内置对 QwenPaw 功能图谱的认知,能根据实时操作上下文主动推荐功能路径并提供故障排查建议。

模型概览

QwenPaw-Flash-2B/4B/9B 基于 Qwen3.5-2B/4B/9B 微调而来,共享相同的架构参数。

- 类型: 带视觉编码器的因果语言模型

- 训练阶段: 后训练(Post-training)

- 参数量: 2B/4B/9B

- 隐藏层维度: 2048/2560/4096

- Token Embedding: 248320(已填充)

- 层数: 24/32/32

- 隐藏层结构: 6/8/8 × (3 × (门控 DeltaNet → FFN) → 1 × (门控注意力 → FFN))

- 门控 DeltaNet:

- 线性注意力头数量: V 为 16/32/32,QK 为 16/16/16

- 头维度: 128

- 门控注意力:

- 注意力头数量: Q 为 8/16/16,KV 为 2/4/4

- 头维度: 256

- 旋转位置编码维度: 64

- 前馈网络(FFN): 中间维度:6144/9216/12288

- 语言模型输出: 248320(与 token embedding 绑定)

- 上下文长度: 原生支持 262,144 tokens

基准测试结果

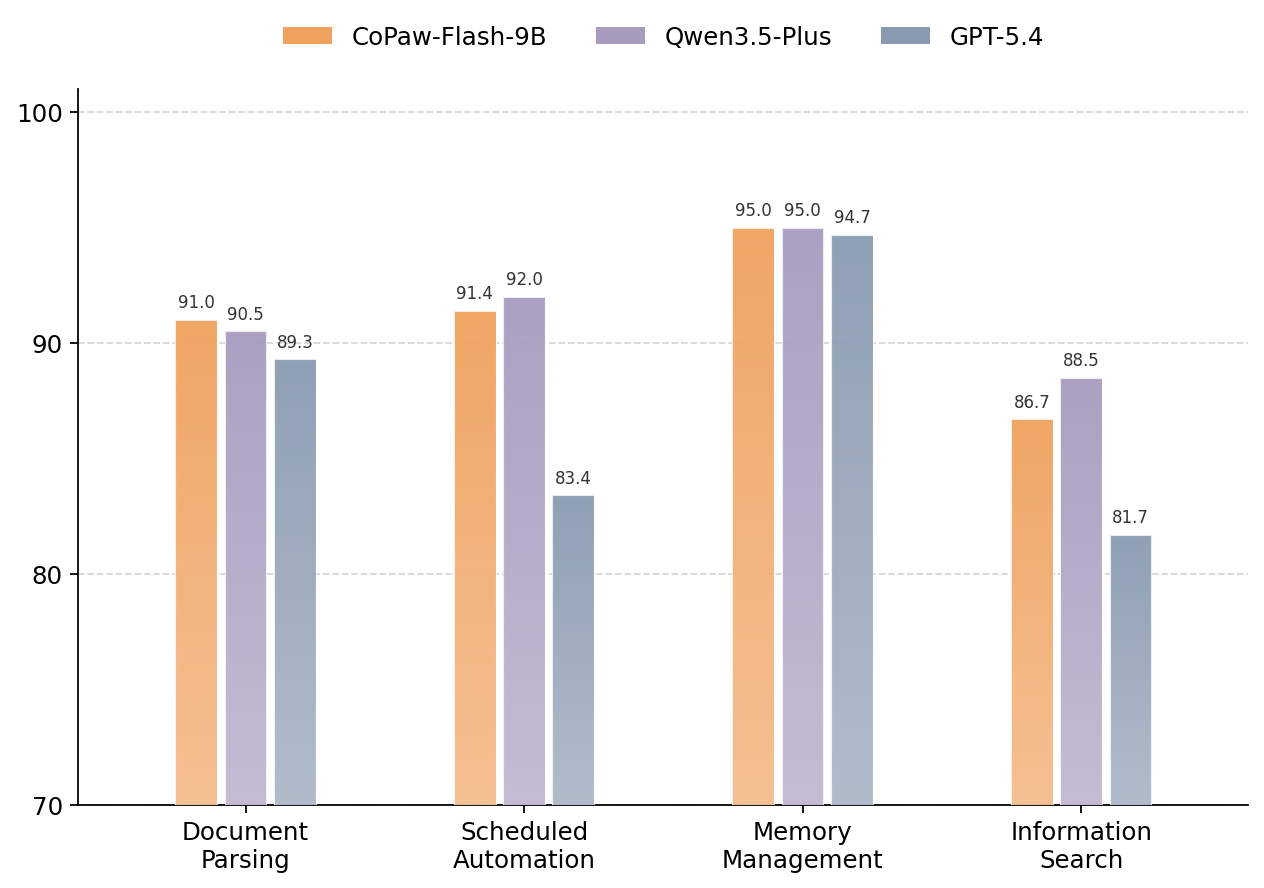

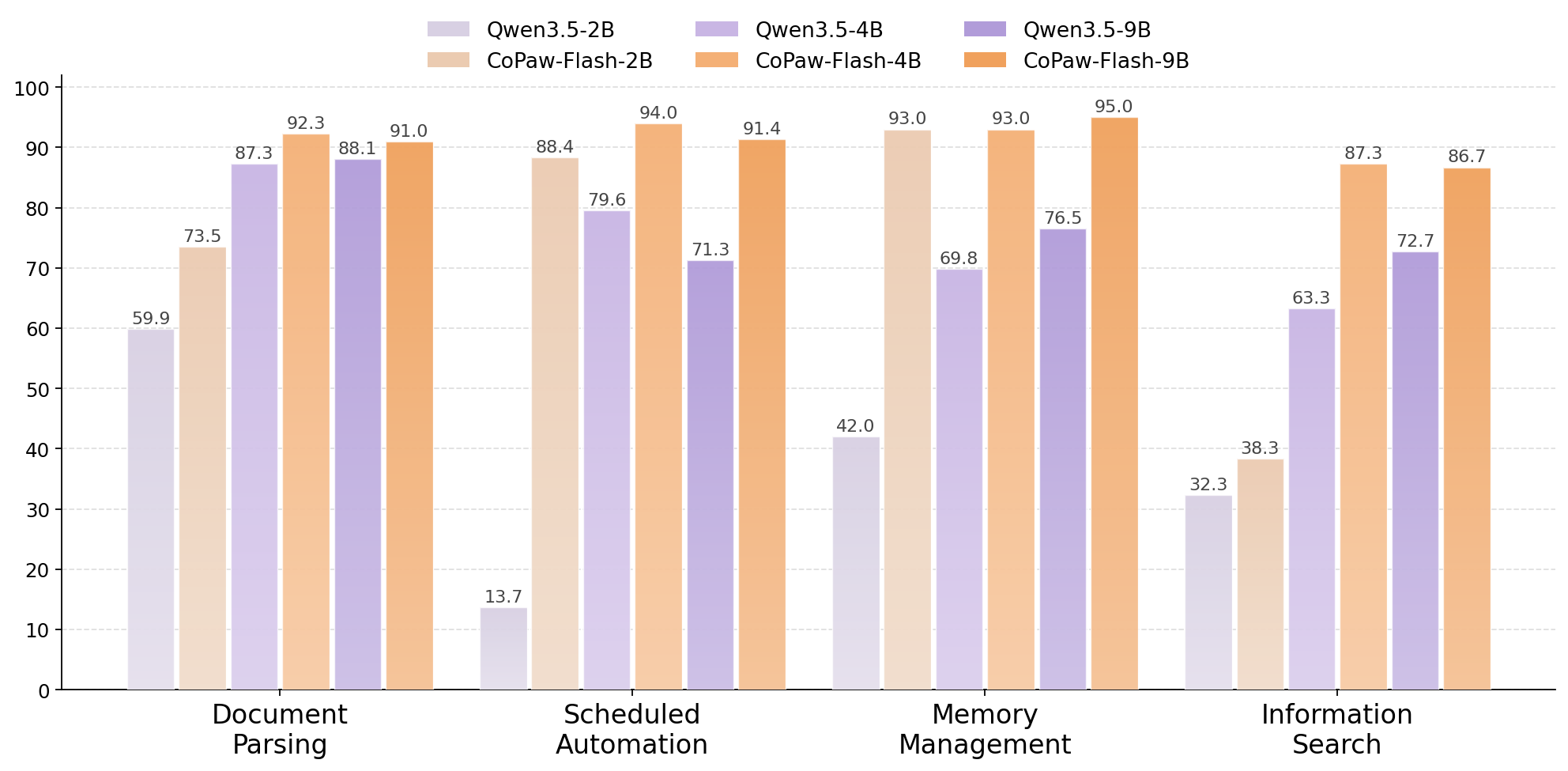

QwenPaw 复杂的上下文工程和工具使用对模型评估提出了更高挑战。为此,我们开发了一套专为 QwenPaw 环境定制的基准测试,系统性地评估模型在五个高频使用场景中的表现,覆盖关键操作维度。

测试结果表明,QwenPaw-Flash 在多个任务类别中均取得显著提升,性能可媲美领先的旗舰模型,同时资源消耗大幅降低。

图 1:QwenPaw-Flash-9B 与其他模型的对比。

图 2:QwenPaw-Flash-2B/4B/9B 与其各自基线模型的对比。

快速开始

部署 QwenPaw-Flash

QwenPaw-Flash 可通过流行的推理框架以 API 形式提供服务。以下示例命令展示了如何为 QwenPaw-Flash 启动兼容 OpenAI 的 API 服务器。

llama.cpp

更多使用指南请参阅 Qwen llama.cpp 文档。

我们建议您克隆 llama.cpp 并按照官方指南进行安装。我们遵循 llama.cpp 的最新版本。

llama-server -m /path/to/.gguf

通过 Chat Completions API 使用 QwenPaw-Flash

服务器启动后,您可通过标准 HTTP 请求或兼容 OpenAI 的 SDK 访问 QwenPaw-Flash。

前置条件

请确保已安装 OpenAI Python SDK 并配置好环境变量:

pip install -U openai # Set the following accordingly export OPENAI_BASE_URL="http://localhost:8000/v1" export OPENAI_API_KEY="EMPTY"

纯文本输入示例

以下 Python 脚本演示了如何通过 OpenAI SDK 与模型交互:

fromopenaiimportOpenAI# Configured by environment variables client = OpenAI() messages = [ {"role": "user", "content": "Hello, QwenPaw!"}, ] chat_response = client.chat.completions.create( model=<your_model_path>, messages=messages, max_tokens=81920, temperature=1.0, top_p=0.95, presence_penalty=1.5, extra_body={ "top_k": 20, }, ) print("Chat response:", chat_response)

联系我们

QwenPaw-Flash 由 AgentScope 团队开发。如果您希望给我们留言,欢迎通过以下渠道与我们联系。