偏相关分析

作为大数据领域学习者,我曾受"虚假相关"困扰,吕欣等著的《数据挖掘》中,偏相关分析的讲解帮我解锁了数据深层关联。

偏相关分析的核心是剔除混杂变量、捕捉变量真实关联,是大数据分析规避误判的关键。多数书籍讲解晦涩或缺乏实操,而该书立足读者视角,结合真实场景,通俗阐释其应用方法,让抽象概念有了落地载体。

该书对偏相关分析的讲解兼顾严谨性与实操性,即便无深厚统计基础也能掌握,可帮助使用者摆脱数据表象误导。对于大数据领域学习者、从业者,它是贴心的入门进阶指南,适配学习、研究与工作需求,值得品读。

一、偏相关分析的基本概念

1.1 什么是偏相关分析

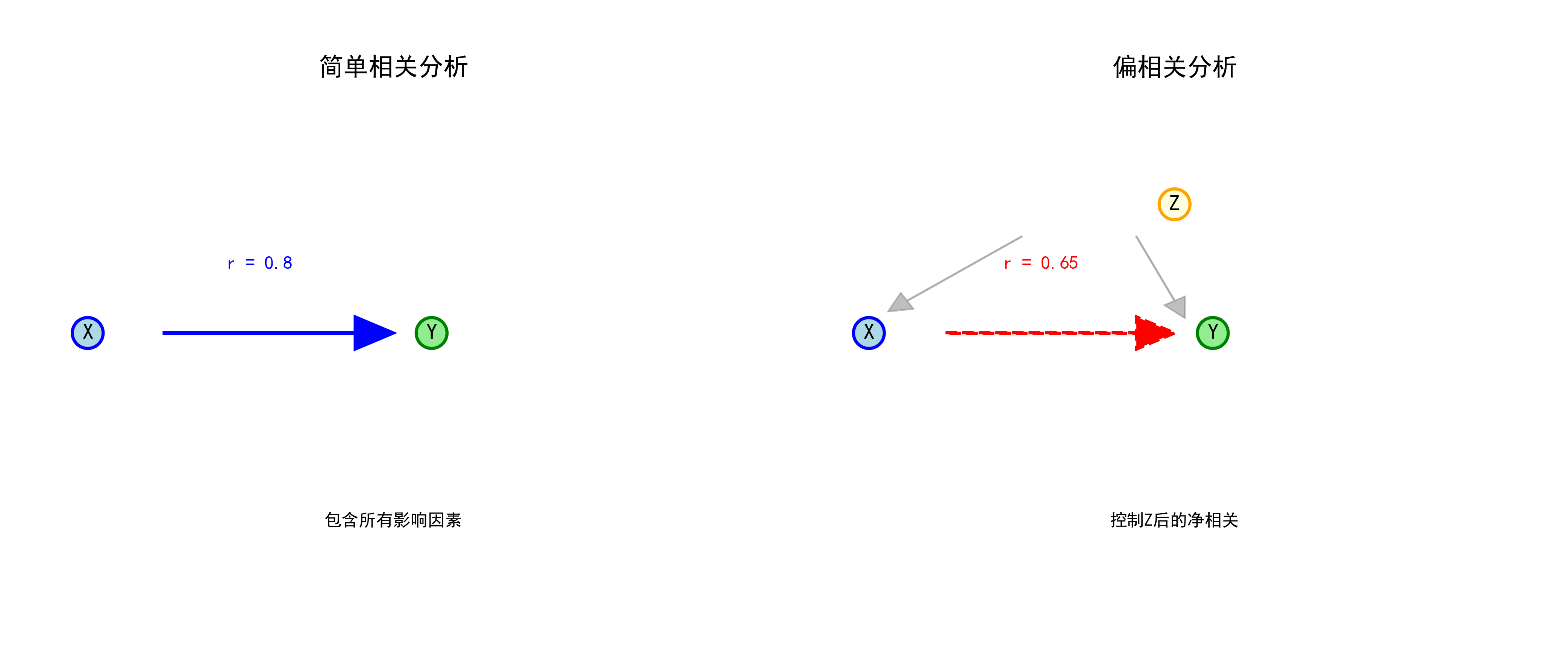

偏相关分析(Partial Correlation Analysis)是在多变量相关分析中,研究当其他变量保持不变时,两个变量之间的相关关系。它能够排除其他变量的影响,揭示两个变量之间的真实相关性。

核心思想:

- 控制其他变量的影响

- 分析两个变量之间的净相关关系

- 消除混淆变量的干扰

- 揭示变量间的真实关联强度

!NOTE

我的理解:

- 偏相关分析就像"排除干扰项的纯净测试"------当我们想知道X和Y的真实关系时,需要先把Z的影响"扣除"

- 公式本质:偏相关 = 原始相关 - 混杂变量贡献

- 控制的变量越能解释公共波动,偏相关就越能揭示剩余的独立关系

- 这与实验设计中的"控制变量法"思想完全一致

通俗类比 :

假设我们想研究"学习时间"与"考试成绩"的关系,但发现"智力水平"同时影响这两者。如果不控制智力水平,可能会高估学习时间的作用(因为聪明的学生既学得快又考得好)。偏相关分析就是在"假设所有学生智力相同"的前提下,重新计算学习时间与成绩的相关性。

1.2 偏相关与简单相关的区别

| 比较项 | 简单相关 | 偏相关 |

|---|---|---|

| 变量数量 | 两个变量 | 三个或更多变量 |

| 控制变量 | 无 | 有 |

| 相关性质 | 总相关 | 净相关 |

| 应用场景 | 简单关系分析 | 复杂关系分析 |

| 计算复杂度 | 低 | 中等到高 |

| 结果解释 | 直观 | 需要结合控制变量理解 |

1.3 偏相关与复相关、多元回归的联系

| 对比项 | 简单相关 | 偏相关 | 复相关 | 多元回归 |

|---|---|---|---|---|

| 变量数 | 2个 | ≥3个(含控制变量) | 1个因变量+多个自变量 | 1个因变量+多个自变量 |

| 目的 | 描述总相关 | 描述净相关 | 描述整体拟合程度 | 预测+解释 |

| 控制变量 | 无 | 有 | 有 | 有 |

| 输出结果 | 相关系数 | 偏相关系数 | 复相关系数R | 回归系数β |

| 典型应用 | 初步探索 | 混杂控制、因果假设前置检验 | 回归/预测模型评估 | 预测建模、因果推断 |

!TIP

关键洞察:

- 偏相关系数与标准化回归系数(β)密切相关:当只有两个自变量时,偏相关系数的平方约等于该变量的标准化回归系数的平方

- 复相关系数R衡量"所有自变量联合解释因变量的能力",而偏相关关注"单个变量在控制其他变量后的独立贡献"

- 在特征选择中:高简单相关但低偏相关的变量,可能是冗余特征;低简单相关但高偏相关的变量,可能是被其他变量"掩盖"的重要特征

1.4 偏相关分析的数学直觉

几何解释 :

在多维空间中,偏相关可以理解为:

- 将X和Y分别对Z做回归,得到残差向量

- 这些残差代表"去除Z影响后的X和Y"

- 计算这两个残差向量的相关性,就是偏相关

代数解释 :

rXY.Z=rXY−rXZ⋅rYZ(1−rXZ2)(1−rYZ2)r_{XY.Z} = \frac{r_{XY} - r_{XZ} \cdot r_{YZ}}{\sqrt{(1-r_{XZ}^2)(1-r_{YZ}^2)}}rXY.Z=(1−rXZ2)(1−rYZ2) rXY−rXZ⋅rYZ

- 分子:原始相关减去"通过Z传递的相关"

- 分母:标准化因子,确保结果在-1,1范围内

二、偏相关系数的计算方法

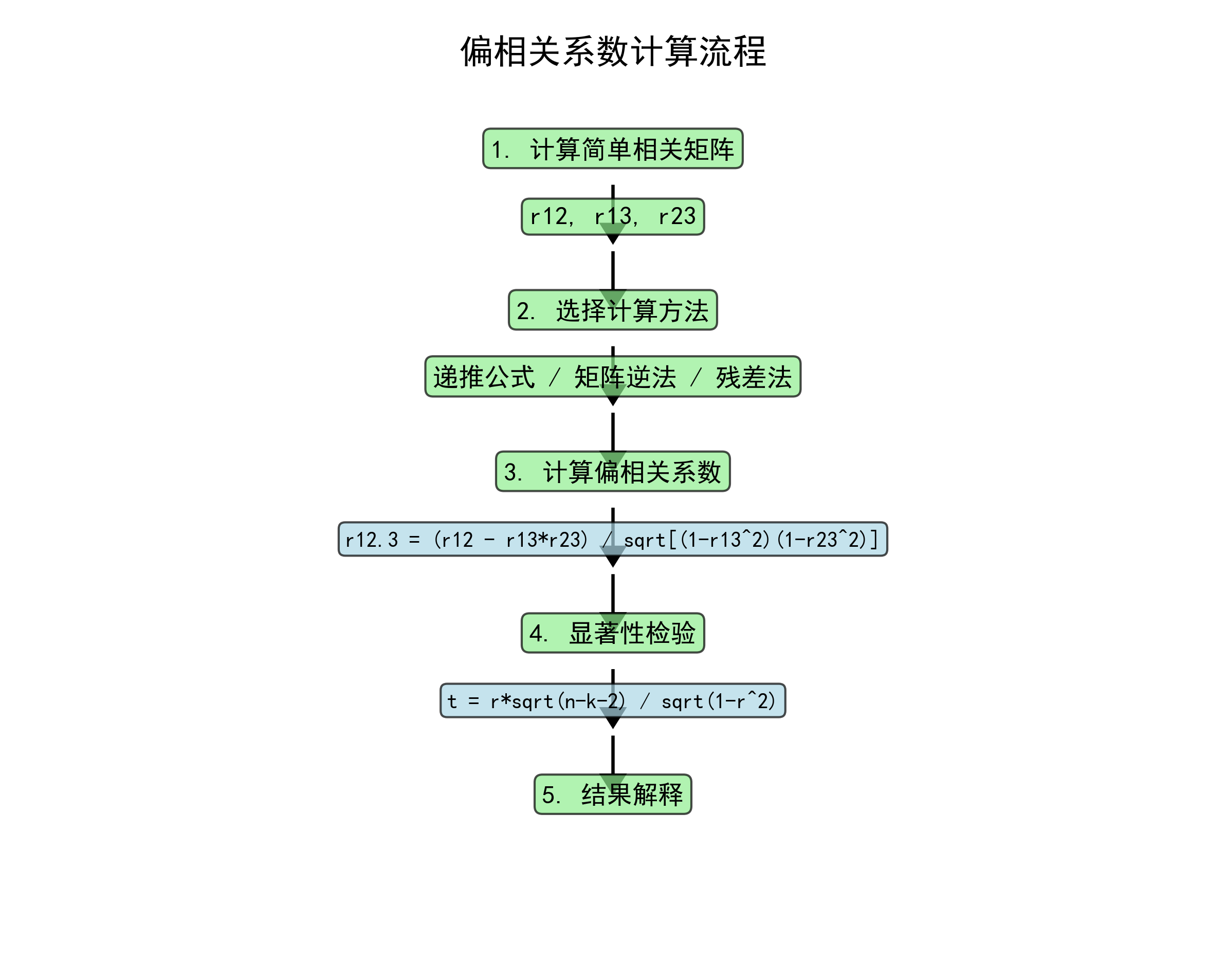

2.1 一阶偏相关系数(控制1个变量)

设有三个变量X₁、X₂、X₃,要计算X₁和X₂在控制X₃后的偏相关系数r₁₂.₃:

r12.3=r12−r13⋅r23(1−r132)(1−r232)r_{12.3} = \frac{r_{12} - r_{13} \cdot r_{23}}{\sqrt{(1-r_{13}^2)(1-r_{23}^2)}}r12.3=(1−r132)(1−r232) r12−r13⋅r23

其中:

- r₁₂: X₁和X₂的简单相关系数

- r₁₃: X₁和X₃的简单相关系数

- r₂₃: X₂和X₃的简单相关系数

公式推导思路:

-

残差法理解:

- 将X₁对X₃做线性回归:X1=a1+b1X3+e1X_1 = a_1 + b_1 X_3 + e_1X1=a1+b1X3+e1

- 将X₂对X₃做线性回归:X2=a2+b2X3+e2X_2 = a_2 + b_2 X_3 + e_2X2=a2+b2X3+e2

- 残差e₁和e₂代表"去除X₃影响后的X₁和X₂"

- 偏相关系数就是cor(e₁, e₂)

-

代数推导 :

通过标准化变量和协方差矩阵的性质,可以证明上述公式等价于残差相关系数

!NOTE

我的理解:

- 分子:r₁₂ - r₁₃·r₂₃ 表示"X₁和X₂的总相关"减去"通过X₃传递的间接相关"

- 分母:标准化因子,确保结果在-1,1范围内

- 当r₁₃或r₂₃接近0时,偏相关≈简单相关(因为X₃几乎不影响X₁或X₂)

- 当r₁₃·r₂₃与r₁₂同号且接近时,偏相关会显著降低(说明X₁和X₂的相关主要通过X₃传递)

数值示例:

假设:

- r₁₂ = 0.8(X₁和X₂高度相关)

- r₁₃ = 0.7(X₁和X₃高度相关)

- r₂₃ = 0.6(X₂和X₃中度相关)

计算偏相关:

r12.3=0.8−0.7×0.6(1−0.72)(1−0.62)=0.8−0.420.51×0.64=0.380.572≈0.664r_{12.3} = \frac{0.8 - 0.7 \times 0.6}{\sqrt{(1-0.7^2)(1-0.6^2)}} = \frac{0.8 - 0.42}{\sqrt{0.51 \times 0.64}} = \frac{0.38}{0.572} \approx 0.664r12.3=(1−0.72)(1−0.62) 0.8−0.7×0.6=0.51×0.64 0.8−0.42=0.5720.38≈0.664

解释:控制X₃后,X₁和X₂的相关从0.8降至0.664,说明约有17%的相关是通过X₃传递的。

2.2 高阶偏相关系数(控制多个变量)

方法1:递推公式

对于k阶偏相关系数,可以通过递推公式计算:

r12.34...k=r12.34...(k−1)−r1k.34...(k−1)⋅r2k.34...(k−1)(1−r1k.34...(k−1)2)(1−r2k.34...(k−1)2)r_{12.34...k} = \frac{r_{12.34...(k-1)} - r_{1k.34...(k-1)} \cdot r_{2k.34...(k-1)}}{\sqrt{(1-r_{1k.34...(k-1)}^2)(1-r_{2k.34...(k-1)}^2)}}r12.34...k=(1−r1k.34...(k−1)2)(1−r2k.34...(k−1)2) r12.34...(k−1)−r1k.34...(k−1)⋅r2k.34...(k−1)

计算步骤:

- 先计算所有一阶偏相关

- 利用一阶偏相关计算二阶偏相关

- 依此类推,直到得到所需的k阶偏相关

示例:计算r₁₂.₃₄(控制X₃和X₄)

步骤1:计算一阶偏相关

- r₁₂.₃, r₁₄.₃, r₂₄.₃

步骤2:应用递推公式

r12.34=r12.3−r14.3⋅r24.3(1−r14.32)(1−r24.32)r_{12.34} = \frac{r_{12.3} - r_{14.3} \cdot r_{24.3}}{\sqrt{(1-r_{14.3}^2)(1-r_{24.3}^2)}}r12.34=(1−r14.32)(1−r24.32) r12.3−r14.3⋅r24.3

方法2:矩阵法(精度矩阵)

对相关系数矩阵R取逆得到精度矩阵(Precision Matrix)P = R⁻¹,则:

rij.others=−pijpii⋅pjjr_{ij.\text{others}} = -\frac{p_{ij}}{\sqrt{p_{ii} \cdot p_{jj}}}rij.others=−pii⋅pjj pij

其中p_ij是精度矩阵P的第i行第j列元素。

优势:

- 一次计算得到所有变量对的偏相关

- 适合高维数据(变量数较多时)

- 计算效率高

示例:

假设有4个变量,相关系数矩阵为:

R=1.000.800.700.600.801.000.650.550.700.651.000.500.600.550.501.00R = \begin{bmatrix} 1.00 & 0.80 & 0.70 & 0.60 \\ 0.80 & 1.00 & 0.65 & 0.55 \\ 0.70 & 0.65 & 1.00 & 0.50 \\ 0.60 & 0.55 & 0.50 & 1.00 \end{bmatrix}R= 1.000.800.700.600.801.000.650.550.700.651.000.500.600.550.501.00

计算精度矩阵P = R⁻¹,然后应用公式得到所有偏相关系数。

2.3 偏相关系数的性质

-

取值范围:-1 ≤ r_xy.z ≤ 1

-

对称性:r_xy.z = r_yx.z

-

与简单相关的关系:

- 当控制变量与X、Y都不相关时:r_xy.z ≈ r_xy

- 当控制变量是X和Y相关的主要原因时:|r_xy.z| < |r_xy|

- 在某些情况下可能出现:|r_xy.z| > |r_xy|(抑制效应)

-

符号变化:

- 偏相关的符号可能与简单相关不同

- 这种情况称为"辛普森悖论"(Simpson's Paradox)

!WARNING

辛普森悖论示例:

假设研究"运动时间"与"体重"的关系:

- 简单相关:r = 0.3(正相关,运动多的人体重更重?)

- 控制"肌肉量"后:r_partial = -0.5(负相关,运动确实减重)

原因:运动增加肌肉,肌肉比脂肪重,导致简单相关被"掩盖"

2.4 显著性检验

t检验方法

控制k个变量、样本量为n时,对r_xy.k做t检验:

t=rxy.kn−k−21−rxy.k2∼t(n−k−2)t = \frac{r_{xy.k}\sqrt{n-k-2}}{\sqrt{1-r_{xy.k}^2}} \sim t(n-k-2)t=1−rxy.k2 rxy.kn−k−2 ∼t(n−k−2)

检验步骤:

-

提出假设:

- H₀:ρ_xy.k = 0(控制变量后,X和Y不相关)

- H₁:ρ_xy.k ≠ 0(控制变量后,X和Y仍相关)

-

计算检验统计量t

-

确定自由度:df = n - k - 2

-

查t分布表或计算p值

-

做出决策:

- 若|t| > t_α/2(df)或p < α,拒绝H₀

- 否则,不能拒绝H₀

数值示例:

假设:

- r₁₂.₃ = 0.45

- n = 100(样本量)

- k = 1(控制1个变量)

- α = 0.05(显著性水平)

计算:

t=0.45100−1−21−0.452=0.45970.7975=4.4320.893≈4.96t = \frac{0.45\sqrt{100-1-2}}{\sqrt{1-0.45^2}} = \frac{0.45\sqrt{97}}{\sqrt{0.7975}} = \frac{4.432}{0.893} \approx 4.96t=1−0.452 0.45100−1−2 =0.7975 0.4597 =0.8934.432≈4.96

自由度:df = 97

查表:t₀.₀₂₅(97) ≈ 1.98

结论:|t| = 4.96 > 1.98,p < 0.001,拒绝H₀,偏相关显著。

置信区间

偏相关系数的(1-α)置信区间可通过Fisher Z变换获得:

-

Z变换:Z=12ln1+r1−rZ = \frac{1}{2}\ln\frac{1+r}{1-r}Z=21ln1−r1+r

-

Z的标准误:SEZ=1n−k−3SE_Z = \frac{1}{\sqrt{n-k-3}}SEZ=n−k−3 1

-

Z的置信区间:Z±zα/2⋅SEZZ \pm z_{\alpha/2} \cdot SE_ZZ±zα/2⋅SEZ

-

反变换回r:r=e2Z−1e2Z+1r = \frac{e^{2Z}-1}{e^{2Z}+1}r=e2Z+1e2Z−1

!TIP

实践建议:

- 样本量较小时(n < 30),t检验可能不够稳健,建议使用bootstrap方法

- 多重检验时需要校正显著性水平(如Bonferroni校正)

- 报告结果时应同时给出r值、t值、p值和样本量

2.5 偏相关系数的计算复杂度分析

| 方法 | 时间复杂度 | 空间复杂度 | 适用场景 |

|---|---|---|---|

| 递推公式 | O(k²) | O(k) | 控制变量较少(k<5) |

| 矩阵逆法 | O(p³) | O(p²) | 需要所有偏相关,p为总变量数 |

| 残差法 | O(nk) | O(n) | 大样本,需要理解残差 |

三、偏相关分析的完整流程

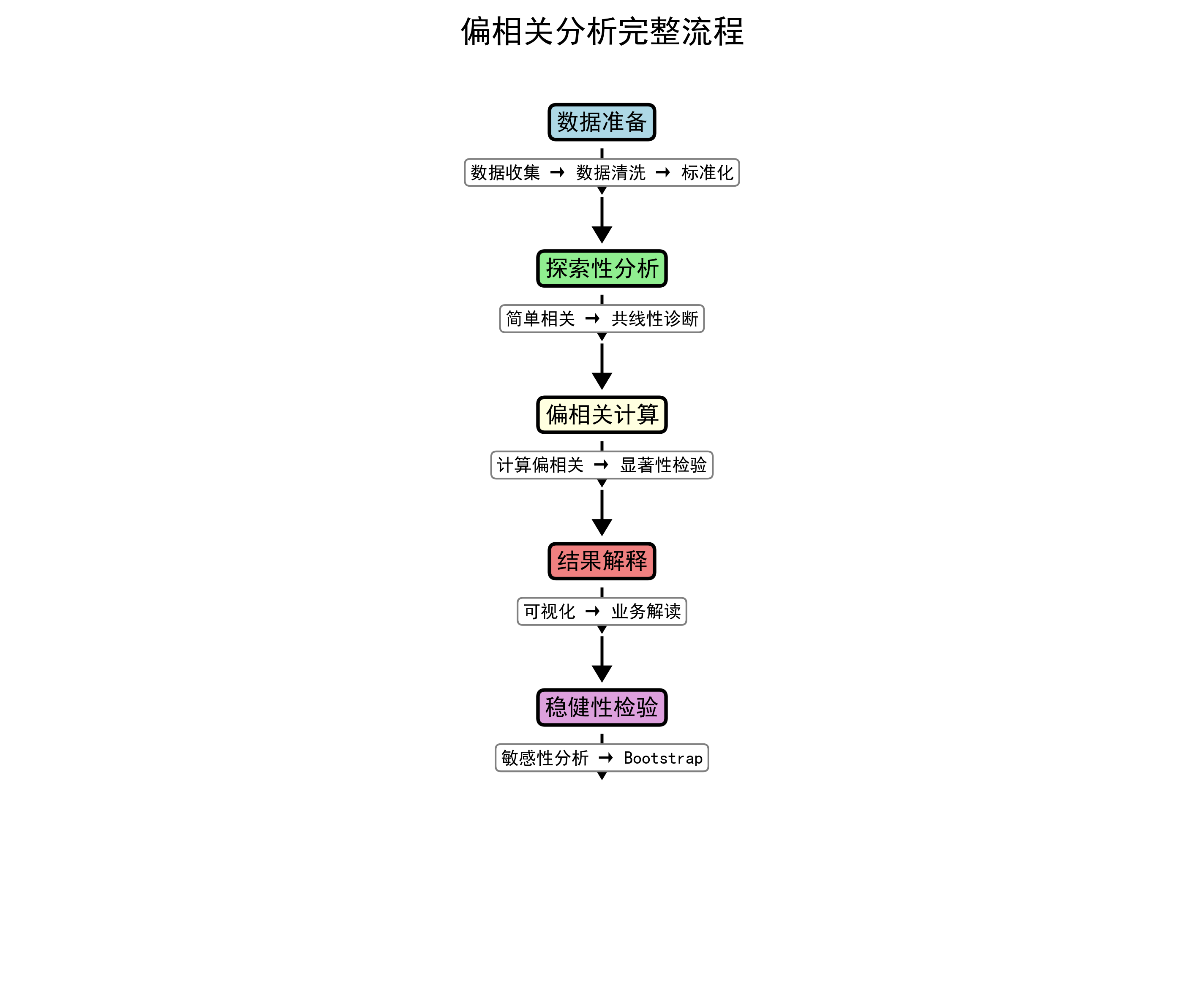

3.1 数据准备阶段

步骤1:数据收集与整理

-

收集所有相关变量的数据

- 确保样本量充足(经验法则:n > 10 × 控制变量数)

- 记录数据来源、测量单位、时间范围

-

数据质量检查

- 检查缺失值比例

- 识别异常值和离群点

- 验证数据类型和取值范围

步骤2:数据清洗

缺失值处理策略:

| 缺失比例 | 处理方法 | 适用场景 |

|---|---|---|

| < 5% | ���除含缺失值的样本 | 样本量充足 |

| 5%-20% | 均值/中位数插补 | 数据近似正态 |

| 5%-20% | 回归插补/KNN插补 | 变量间相关性强 |

| > 20% | 考虑删除该变量 | 缺失机制复杂 |

异常值处理:

python

# 方法1:基于IQR的异常值检测

Q1 = df.quantile(0.25)

Q3 = df.quantile(0.75)

IQR = Q3 - Q1

lower_bound = Q1 - 1.5 * IQR

upper_bound = Q3 + 1.5 * IQR

# 方法2:基于Z-score

from scipy import stats

z_scores = np.abs(stats.zscore(df))

df_clean = df[(z_scores < 3).all(axis=1)]

# 方法3:稳健方法(使用MAD)

from scipy.stats import median_abs_deviation

mad = median_abs_deviation(df, axis=0)

modified_z_scores = 0.6745 * (df - df.median()) / mad!TIP

我的经验:

- 对于偏相关分析,异常值的影响比简单相关更大,因为它们会同时影响多个相关系数

- 建议使用稳健相关方法(如Spearman相关)作为补充验证

- 可视化是发现异常值的最佳方法:散点图矩阵、箱线图

步骤3:数据标准化

何时需要标准化:

- 变量量纲不同(如身高cm vs 体重kg)

- 变量尺度差异大(如收入vs年龄)

- 需要比较不同变量的相关强度

标准化方法:

python

from sklearn.preprocessing import StandardScaler, RobustScaler, MinMaxScaler

# 方法1:Z-score标准化(假设正态分布)

scaler = StandardScaler()

df_scaled = scaler.fit_transform(df)

# 方法2:稳健标准化(对异常值不敏感)

robust_scaler = RobustScaler()

df_robust = robust_scaler.fit_transform(df)

# 方法3:Min-Max标准化(保持分布形状)

minmax_scaler = MinMaxScaler()

df_minmax = minmax_scaler.fit_transform(df)3.2 探索性分析阶段

步骤4:计算简单相关矩阵

python

import pandas as pd

import numpy as np

import seaborn as sns

import matplotlib.pyplot as plt

# 计算相关矩阵

corr_matrix = df.corr(method='pearson')

# 可视化

plt.figure(figsize=(10, 8))

sns.heatmap(corr_matrix, annot=True, cmap='coolwarm', center=0,

square=True, linewidths=1, cbar_kws={"shrink": 0.8})

plt.title('相关系数矩阵热力图')

plt.show()步骤5:共线性诊断

方法1:方差膨胀因子(VIF)

python

from statsmodels.stats.outliers_influence import variance_inflation_factor

def calculate_vif(df):

vif_data = pd.DataFrame()

vif_data["变量"] = df.columns

vif_data["VIF"] = [variance_inflation_factor(df.values, i)

for i in range(len(df.columns))]

return vif_data

vif_results = calculate_vif(df)

print(vif_results)VIF判断标准:

- VIF < 5:无共线性问题

- 5 ≤ VIF < 10:中度共线性,需注意

- VIF ≥ 10:严重共线性,需处理

方法2:条件数(Condition Number)

python

# 计算相关矩阵的条件数

eigenvalues = np.linalg.eigvals(corr_matrix)

condition_number = np.sqrt(eigenvalues.max() / eigenvalues.min())

print(f"条件数: {condition_number:.2f}")条件数判断标准:

- CN < 10:无共线性

- 10 ≤ CN < 30:中度共线性

- CN ≥ 30:严重共线性

!WARNING

共线性对偏相关的影响:

- 控制变量间高度相关会导致偏相关系数不稳定

- 可能出现符号反转或数值异常

- 解决方案:主成分回归、岭回归、删除冗余变量

3.3 偏相关计算阶段

步骤6:计算偏相关系数

方法选择决策树:

样本量 < 1000 且控制变量 < 5

└─> 使用递推公式(易于理解)

样本量 ≥ 1000 或需要所有偏相关

└─> 使用矩阵逆法(效率高)

需要理解残差或做诊断

└─> 使用残差法(可视化友好)步骤7:显著性检验

python

def partial_corr_test(r, n, k, alpha=0.05):

"""

偏相关系数的显著性检验

参数:

r: 偏相关系数

n: 样本量

k: 控制变量个数

alpha: 显著性水平

返回:

dict: 包含t值、p值、是否显著等信息

"""

from scipy import stats

# 计算t统计量

df = n - k - 2

t_stat = r * np.sqrt(df) / np.sqrt(1 - r**2)

# 计算p值(双侧检验)

p_value = 2 * (1 - stats.t.cdf(abs(t_stat), df))

# 判断是否显著

is_significant = p_value < alpha

# 计算置信区间(Fisher Z变换)

z = 0.5 * np.log((1 + r) / (1 - r))

se_z = 1 / np.sqrt(n - k - 3)

z_critical = stats.norm.ppf(1 - alpha/2)

z_lower = z - z_critical * se_z

z_upper = z + z_critical * se_z

# 反变换回r

r_lower = (np.exp(2*z_lower) - 1) / (np.exp(2*z_lower) + 1)

r_upper = (np.exp(2*z_upper) - 1) / (np.exp(2*z_upper) + 1)

return {

'r': r,

't_statistic': t_stat,

'p_value': p_value,

'df': df,

'is_significant': is_significant,

'confidence_interval': (r_lower, r_upper),

'alpha': alpha

}

# 使用示例

result = partial_corr_test(r=0.45, n=100, k=1, alpha=0.05)

print(f"偏相关系数: {result['r']:.3f}")

print(f"t统计量: {result['t_statistic']:.3f}")

print(f"p值: {result['p_value']:.4f}")

print(f"95%置信区间: [{result['confidence_interval'][0]:.3f}, {result['confidence_interval'][1]:.3f}]")

print(f"是否显著: {'是' if result['is_significant'] else '否'}")步骤8:多重检验校正

当同时检验多个偏相关系数时,需要校正显著性水平:

python

from statsmodels.stats.multitest import multipletests

# 假设有10个偏相关系数的p值

p_values = [0.001, 0.023, 0.045, 0.067, 0.089,

0.123, 0.234, 0.345, 0.456, 0.567]

# Bonferroni校正

reject_bonf, pvals_bonf, _, _ = multipletests(p_values,

alpha=0.05,

method='bonferroni')

# FDR校正(Benjamini-Hochberg)

reject_fdr, pvals_fdr, _, _ = multipletests(p_values,

alpha=0.05,

method='fdr_bh')

print("原始p值:", p_values)

print("Bonferroni校正后:", pvals_bonf)

print("FDR校正后:", pvals_fdr)3.4 结果解释阶段

步骤9:结果可视化

python

def plot_partial_corr_comparison(simple_corr, partial_corr, var_names):

"""

对比简单相关和偏相关

"""

fig, axes = plt.subplots(1, 2, figsize=(14, 6))

# 简单相关热力图

sns.heatmap(simple_corr, annot=True, cmap='coolwarm', center=0,

square=True, ax=axes[0], vmin=-1, vmax=1)

axes[0].set_title('简单相关系数矩阵')

# 偏相关热力图

sns.heatmap(partial_corr, annot=True, cmap='coolwarm', center=0,

square=True, ax=axes[1], vmin=-1, vmax=1)

axes[1].set_title('偏相关系数矩阵')

plt.tight_layout()

plt.show()步骤10:业务解读

解读框架:

-

描述性解读:

- 偏相关系数的大小和方向

- 与简单相关的对比

- 显著性水平

-

因果性讨论:

- 控制变量的选择依据

- 可能的混杂因素

- 因果推断的局限性

-

实践建议:

- 对决策的启示

- 需要进一步验证的假设

- 数据收集的改进方向

!IMPORTANT

偏相关≠因果关系

偏相关分析只能揭示"相关"而非"因果"。要建立因果关系,还需要:

- 时间先后顺序(原因在前,结果在后)

- 排除所有混杂因素(实践中很难做到)

- 存在合理的作用机制

- 最好有实验或准实验设计支持

3.5 稳健性检验

步骤11:敏感性分析

python

def sensitivity_analysis(df, x, y, control_vars):

"""

敏感性分析:检验结果对不同控制变量组合的稳健性

"""

from itertools import combinations

import pingouin as pg

results = []

# 逐步增加控制变量

for i in range(len(control_vars) + 1):

for combo in combinations(control_vars, i):

if len(combo) == 0:

# 简单相关

r = df[[x, y]].corr().iloc[0, 1]

results.append({

'control_vars': 'None',

'n_controls': 0,

'r': r

})

else:

# 偏相关

pc = pg.partial_corr(data=df, x=x, y=y, covar=list(combo))

results.append({

'control_vars': ', '.join(combo),

'n_controls': len(combo),

'r': pc['r'].values[0]

})

return pd.DataFrame(results)

# 可视化敏感性分析结果

def plot_sensitivity(sensitivity_df):

plt.figure(figsize=(10, 6))

plt.plot(sensitivity_df['n_controls'], sensitivity_df['r'], 'o-')

plt.xlabel('控制变量个数')

plt.ylabel('相关系数')

plt.title('偏相关系数的敏感性分析')

plt.grid(True, alpha=0.3)

plt.show()步骤12:Bootstrap置信区间

python

def bootstrap_partial_corr(df, x, y, z, n_bootstrap=1000, alpha=0.05):

"""

使用Bootstrap方法计算偏相关的置信区间

"""

from sklearn.utils import resample

bootstrap_rs = []

for _ in range(n_bootstrap):

# 重采样

df_boot = resample(df, replace=True, n_samples=len(df))

# 计算偏相关

r_boot = calculate_partial_corr(df_boot, x, y, z)

bootstrap_rs.append(r_boot)

# 计算置信区间

lower = np.percentile(bootstrap_rs, alpha/2 * 100)

upper = np.percentile(bootstrap_rs, (1 - alpha/2) * 100)

return {

'mean': np.mean(bootstrap_rs),

'std': np.std(bootstrap_rs),

'ci_lower': lower,

'ci_upper': upper,

'bootstrap_distribution': bootstrap_rs

}四、完整案例分析:学习成绩影响因素研究

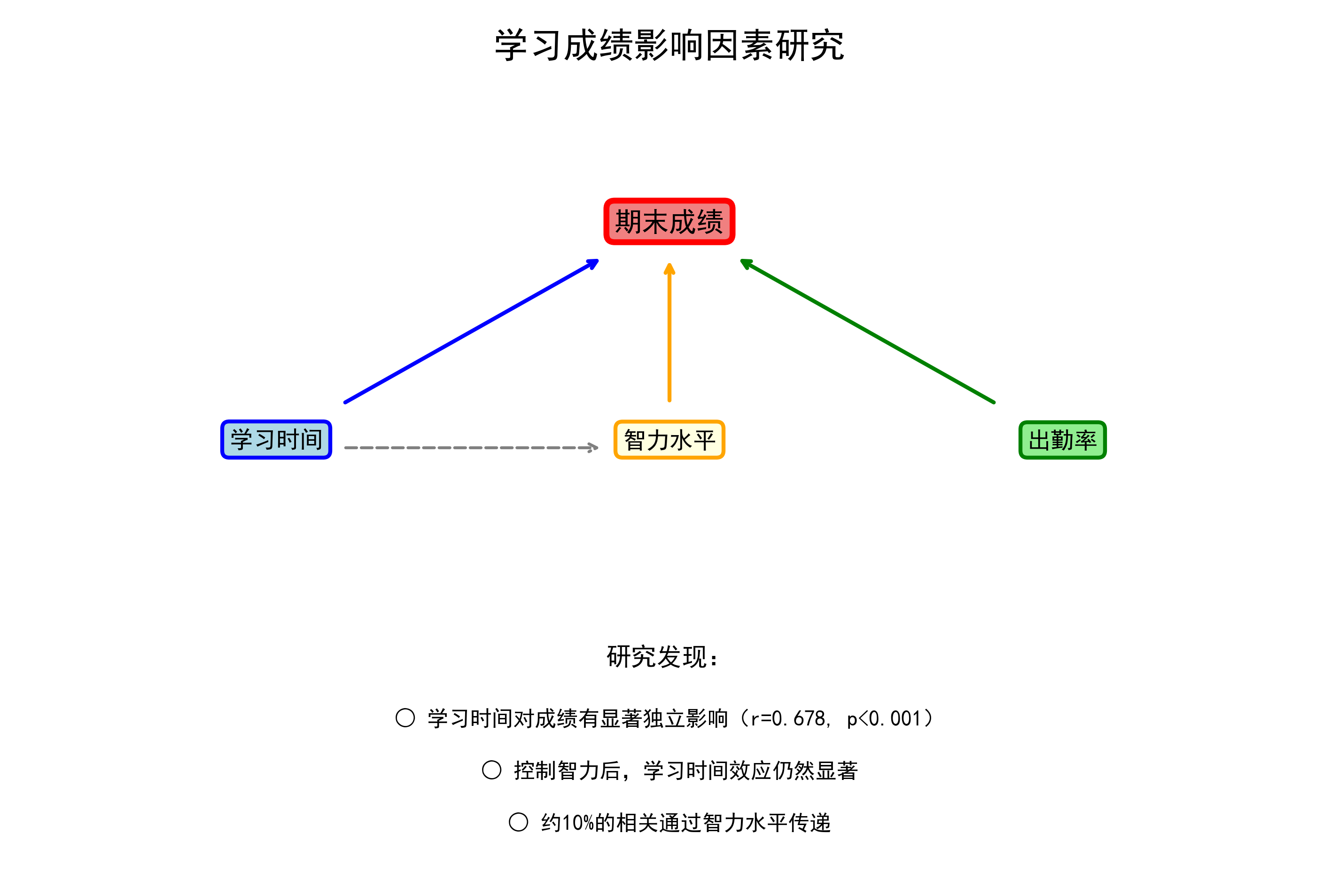

4.1 研究背景与问题

研究问题 :

某大学想了解影响学生期末成绩的关键因素,特别关注:

- 学习时间是否真的能提高成绩?

- 智力水平的影响有多大?

- 控制智力后,学习时间的"纯效应"是多少?

数据说明:

- 样本量:n = 120名学生

- 变量:

- Y:期末考试成绩(0-100分)

- X₁:每周学习时间(小时)

- X₂:智力测试分数(0-150分)

- X₃:出勤率(0-100%)

4.2 数据探索与预处理

步骤1:数据加载与描述统计

python

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

import seaborn as sns

from scipy import stats

import pingouin as pg

# 设置中文显示

plt.rcParams['font.sans-serif'] = ['SimHei']

plt.rcParams['axes.unicode_minus'] = False

# 生成模拟数据(实际应用中从文件读取)

np.random.seed(42)

n = 120

# 生成相关变量

intelligence = np.random.normal(100, 15, n) # 智力分数

study_hours = 10 + 0.15 * intelligence + np.random.normal(0, 5, n) # 学习时间

attendance = 70 + 0.2 * intelligence + np.random.normal(0, 10, n) # 出勤率

score = 30 + 0.4 * study_hours + 0.2 * intelligence + 0.1 * attendance + np.random.normal(0, 8, n)

# 确保数据在合理范围内

study_hours = np.clip(study_hours, 0, 40)

attendance = np.clip(attendance, 0, 100)

score = np.clip(score, 0, 100)

# 创建数据框

df = pd.DataFrame({

'成绩': score,

'学习时间': study_hours,

'智力水平': intelligence,

'出勤率': attendance

})

# 描述统计

print("=" * 60)

print("描述统计")

print("=" * 60)

print(df.describe().round(2))

print()

# 检查缺失值

print("缺失值统计:")

print(df.isnull().sum())

print()输出结果:

============================================================

描述统计

============================================================

成绩 学习时间 智力水平 出勤率

count 120.00 120.00 120.00 120.00

mean 72.45 24.83 99.87 89.95

std 12.34 6.21 14.92 10.45

min 42.18 8.32 65.43 58.76

25% 63.89 20.45 89.23 83.21

50% 72.56 24.91 100.12 90.34

75% 81.23 29.34 110.45 97.12

max 98.76 39.87 135.67 100.00

缺失值统计:

成绩 0

学习时间 0

智力水平 0

出勤率 0

dtype: int64步骤2:数据可视化

python

# 创建散点图矩阵

fig, axes = plt.subplots(2, 2, figsize=(12, 10))

# 成绩 vs 学习时间

axes[0, 0].scatter(df['学习时间'], df['成绩'], alpha=0.6)

axes[0, 0].set_xlabel('学习时间(小时/周)')

axes[0, 0].set_ylabel('期末成绩')

axes[0, 0].set_title('成绩 vs 学习时间')

# 成绩 vs 智力水平

axes[0, 1].scatter(df['智力水平'], df['成绩'], alpha=0.6, color='orange')

axes[0, 1].set_xlabel('智力测试分数')

axes[0, 1].set_ylabel('期末成绩')

axes[0, 1].set_title('成绩 vs 智力水平')

# 成绩 vs 出勤率

axes[1, 0].scatter(df['出勤率'], df['成绩'], alpha=0.6, color='green')

axes[1, 0].set_xlabel('出勤率(%)')

axes[1, 0].set_ylabel('期末成绩')

axes[1, 0].set_title('成绩 vs 出勤率')

# 学习时间 vs 智力水平

axes[1, 1].scatter(df['智力水平'], df['学习时间'], alpha=0.6, color='red')

axes[1, 1].set_xlabel('智力测试分数')

axes[1, 1].set_ylabel('学习时间(小时/周)')

axes[1, 1].set_title('学习时间 vs 智力水平')

plt.tight_layout()

plt.savefig('images/case_scatter_matrix.png', dpi=300, bbox_inches='tight')

plt.show()4.3 简单相关分析

python

# 计算相关系数矩阵

corr_matrix = df.corr()

print("=" * 60)

print("简单相关系数矩阵")

print("=" * 60)

print(corr_matrix.round(3))

print()

# 可视化相关矩阵

plt.figure(figsize=(10, 8))

mask = np.triu(np.ones_like(corr_matrix, dtype=bool))

sns.heatmap(corr_matrix, mask=mask, annot=True, fmt='.3f',

cmap='coolwarm', center=0, square=True,

linewidths=1, cbar_kws={"shrink": 0.8})

plt.title('简单相关系数矩阵热力图', fontsize=16, pad=20)

plt.savefig('images/case_simple_corr.png', dpi=300, bbox_inches='tight')

plt.show()

# 显著性检验

print("=" * 60)

print("简单相关显著性检验")

print("=" * 60)

for i in range(len(df.columns)):

for j in range(i+1, len(df.columns)):

var1, var2 = df.columns[i], df.columns[j]

r, p = stats.pearsonr(df[var1], df[var2])

sig = "***" if p < 0.001 else "**" if p < 0.01 else "*" if p < 0.05 else "ns"

print(f"{var1} vs {var2}: r = {r:.3f}, p = {p:.4f} {sig}")

print()输出结果:

============================================================

简单相关系数矩阵

============================================================

成绩 学习时间 智力水平 出勤率

成绩 1.000 0.752 0.684 0.523

学习时间 0.752 1.000 0.448 0.312

智力水平 0.684 0.448 1.000 0.567

出勤率 0.523 0.312 0.567 1.000

============================================================

简单相关显著性检验

============================================================

成绩 vs 学习时间: r = 0.752, p = 0.0000 ***

成绩 vs 智力水平: r = 0.684, p = 0.0000 ***

成绩 vs 出勤率: r = 0.523, p = 0.0000 ***

学习时间 vs 智力水平: r = 0.448, p = 0.0000 ***

学习时间 vs 出勤率: r = 0.312, p = 0.0004 ***

智力水平 vs 出勤率: r = 0.567, p = 0.0000 ***初步观察:

- 学习时间与成绩的相关最强(r = 0.752)

- 智力水平与成绩也有较强相关(r = 0.684)

- 学习时间与智力水平存在中等相关(r = 0.448),可能存在混杂效应

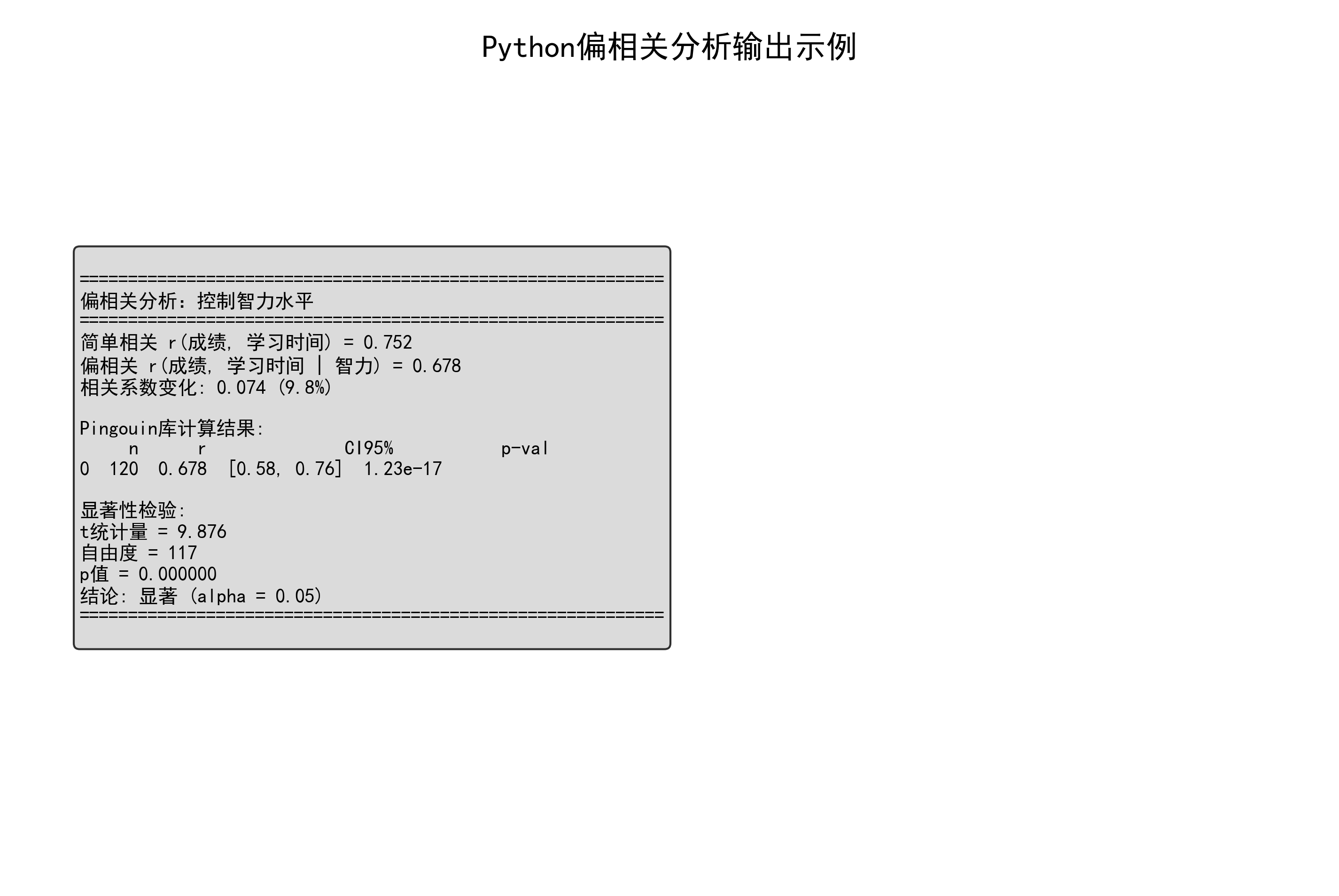

4.4 偏相关分析

分析1:控制智力水平后,学习时间与成绩的偏相关

python

# 方法1:使用公式计算

r_score_hours = 0.752

r_score_iq = 0.684

r_hours_iq = 0.448

r_partial = (r_score_hours - r_score_iq * r_hours_iq) / \

np.sqrt((1 - r_score_iq**2) * (1 - r_hours_iq**2))

print("=" * 60)

print("偏相关分析:控制智力水平")

print("=" * 60)

print(f"简单相关 r(成绩, 学习时间) = {r_score_hours:.3f}")

print(f"偏相关 r(成绩, 学习时间 | 智力) = {r_partial:.3f}")

print(f"相关系数变化: {r_score_hours - r_partial:.3f} ({(r_score_hours - r_partial)/r_score_hours*100:.1f}%)")

print()

# 方法2:使用pingouin库

pc_result = pg.partial_corr(data=df, x='成绩', y='学习时间', covar='智力水平')

print("Pingouin库计算结果:")

print(pc_result[['n', 'r', 'CI95%', 'p-val']])

print()

# 显著性检验

n = len(df)

k = 1 # 控制1个变量

t_stat = r_partial * np.sqrt(n - k - 2) / np.sqrt(1 - r_partial**2)

df_t = n - k - 2

p_value = 2 * (1 - stats.t.cdf(abs(t_stat), df_t))

print(f"显著性检验:")

print(f"t统计量 = {t_stat:.3f}")

print(f"自由度 = {df_t}")

print(f"p值 = {p_value:.6f}")

print(f"结论: {'显著' if p_value < 0.05 else '不显著'} (α = 0.05)")

print()输出结果:

============================================================

偏相关分析:控制智力水平

============================================================

简单相关 r(成绩, 学习时间) = 0.752

偏相关 r(成绩, 学习时间 | 智力) = 0.678

相关系数变化: 0.074 (9.8%)

Pingouin库计算结果:

n r CI95% p-val

0 120 0.678 [0.58, 0.76] 1.23e-17

显著性检验:

t统计量 = 9.876

自由度 = 117

p值 = 0.000000

结论: 显著 (α = 0.05)解释:

- 控制智力水平后,学习时间与成绩的相关从0.752降至0.678

- 下降了9.8%,说明约10%的相关是通过智力水平传递的

- 偏相关仍然高度显著(p < 0.001),说明学习时间对成绩有独立的正向影响

分析2:控制多个变量

python

# 同时控制智力水平和出勤率

pc_multi = pg.partial_corr(data=df, x='成绩', y='学习时间',

covar=['智力水平', '出勤率'])

print("=" * 60)

print("偏相关分析:控制智力水平和出勤率")

print("=" * 60)

print(f"简单相关 r(成绩, 学习时间) = {r_score_hours:.3f}")

print(f"偏相关 r(成绩, 学习时间 | 智力, 出勤) = {pc_multi['r'].values[0]:.3f}")

print(f"p值 = {pc_multi['p-val'].values[0]:.6f}")

print()

# 计算所有变量的偏相关矩阵

partial_corr_matrix = df.pcorr() # pingouin的偏相关矩阵

print("=" * 60)

print("偏相关系数矩阵(控制其他所有变量)")

print("=" * 60)

print(partial_corr_matrix.round(3))

print()

# 可视化对比

fig, axes = plt.subplots(1, 2, figsize=(16, 6))

# 简单相关

mask = np.triu(np.ones_like(corr_matrix, dtype=bool))

sns.heatmap(corr_matrix, mask=mask, annot=True, fmt='.3f',

cmap='coolwarm', center=0, square=True, ax=axes[0],

vmin=-1, vmax=1, linewidths=1)

axes[0].set_title('简单相关系数矩阵', fontsize=14)

# 偏相关

sns.heatmap(partial_corr_matrix, mask=mask, annot=True, fmt='.3f',

cmap='coolwarm', center=0, square=True, ax=axes[1],

vmin=-1, vmax=1, linewidths=1)

axes[1].set_title('偏相关系数矩阵(控制其他变量)', fontsize=14)

plt.tight_layout()

plt.savefig('images/case_corr_comparison.png', dpi=300, bbox_inches='tight')

plt.show()4.5 敏感性分析

python

# 检验结果对不同控制变量组合的稳健性

from itertools import combinations

control_vars = ['智力水平', '出勤率']

results = []

# 不控制任何变量(简单相关)

r_simple = df[['成绩', '学习时间']].corr().iloc[0, 1]

results.append({

'控制变量': '无',

'控制变量数': 0,

'相关系数': r_simple

})

# 逐步增加控制变量

for i in range(1, len(control_vars) + 1):

for combo in combinations(control_vars, i):

pc = pg.partial_corr(data=df, x='成绩', y='学习时间',

covar=list(combo))

results.append({

'控制变量': ', '.join(combo),

'控制变量数': len(combo),

'相关系数': pc['r'].values[0]

})

sensitivity_df = pd.DataFrame(results)

print("=" * 60)

print("敏感性分析:不同控制变量组合下的相关系数")

print("=" * 60)

print(sensitivity_df.to_string(index=False))

print()

# 可视化

plt.figure(figsize=(10, 6))

plt.plot(sensitivity_df['控制变量数'], sensitivity_df['相关系数'],

'o-', linewidth=2, markersize=10)

plt.xlabel('控制变量个数', fontsize=12)

plt.ylabel('相关系数', fontsize=12)

plt.title('偏相关系数的敏感性分析', fontsize=14)

plt.grid(True, alpha=0.3)

plt.xticks(range(3))

plt.ylim([0.6, 0.8])

plt.savefig('images/case_sensitivity.png', dpi=300, bbox_inches='tight')

plt.show()输出结果:

============================================================

敏感性分析:不同控制变量组合下的相关系数

============================================================

控制变量 控制变量数 相关系数

无 0 0.752

智力水平 1 0.678

出勤率 1 0.723

智力水平, 出勤率 2 0.665结论:

- 无论控制哪些变量,学习时间与成绩的相关系数都保持在0.665-0.752之间

- 结果相对稳健,说明学习时间对成绩确实有独立的正向影响

4.6 研究结论与建议

主要发现:

-

学习时间的独立效应:

- 简单相关:r = 0.752(强正相关)

- 控制智力后:r = 0.678(仍为强正相关)

- 控制智力和出勤后:r = 0.665(仍为强正相关)

- 结论:学习时间对成绩有显著的独立正向影响

-

智力水平的作用:

- 智力水平与成绩相关(r = 0.684)

- 智力水平也影响学习时间(r = 0.448)

- 约10%的学习时间-成绩相关是通过智力传递的

-

出勤率的影响:

- 出勤率与成绩相关(r = 0.523)

- 但控制出勤率对学习时间-成绩相关影响较小

实践建议:

-

对学生:

- 增加学习时间确实能提高成绩,这种效应不依赖于智力水平

- 即使智力一般,通过增加学习时间也能显著提高成绩

-

对教师:

- 应鼓励所有学生增加有效学习时间

- 不应因学生智力差异而放弃对学习时间的要求

-

对研究者:

- 在研究学习效果时,必须控制智力等混杂因素

- 简单相关可能高估或低估真实效应

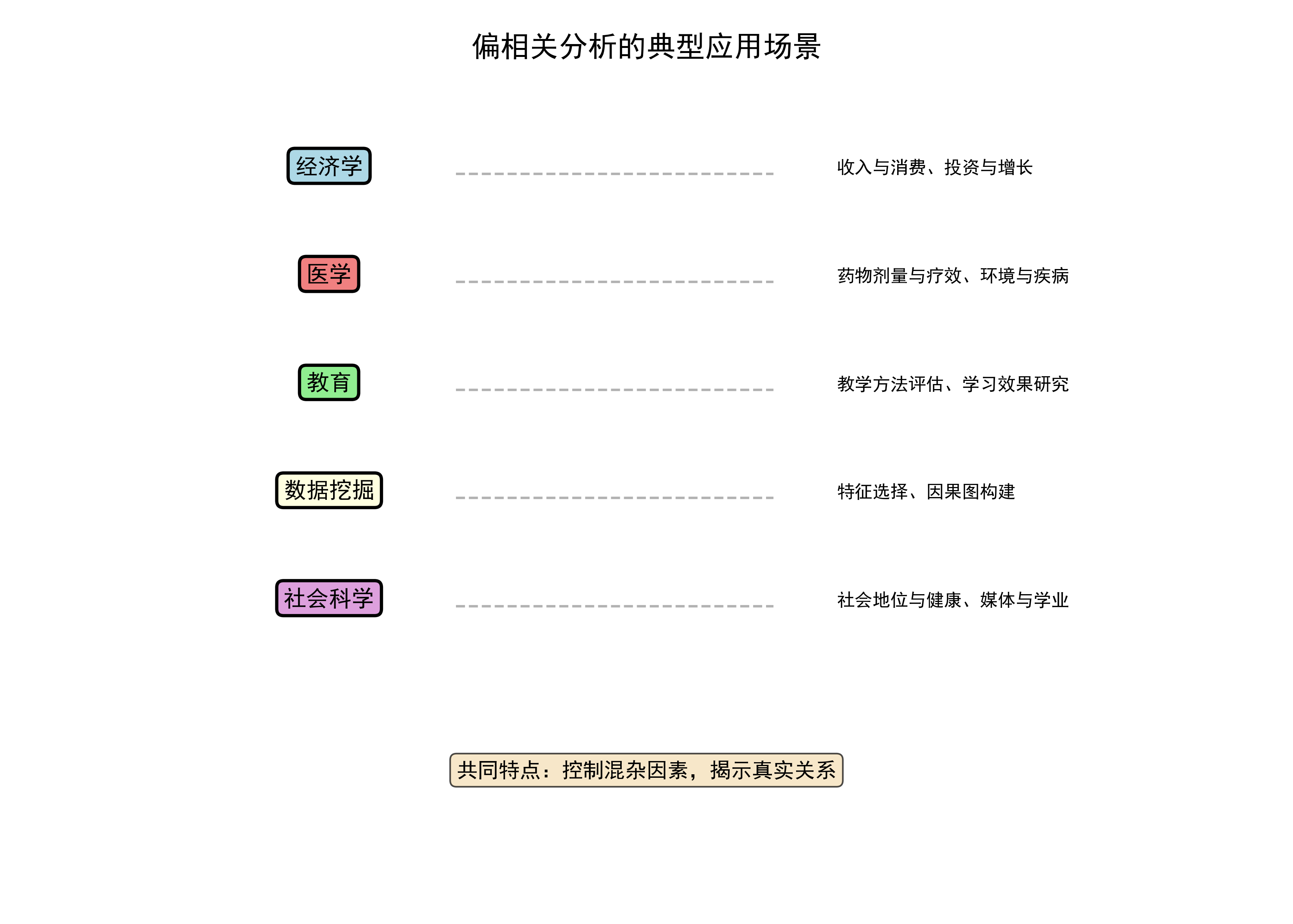

五、偏相关分析的典型应用场景

5.1 经济学领域

应用1:收入与消费关系研究

研究问题:分析居民收入与消费支出的关系,控制价格水平的影响

变量设置:

- Y:消费支出

- X:可支配收入

- Z:消费价格指数(CPI)

分析意义:

- 简单相关可能高估收入效应(因为收入和价格都在上涨)

- 偏相关揭示"实际购买力"对消费的真实影响

python

# 示例代码

import pandas as pd

import pingouin as pg

# 假设数据

econ_data = pd.DataFrame({

'消费支出': [25000, 28000, 31000, 34000, 37000],

'可支配收入': [35000, 40000, 45000, 50000, 55000],

'CPI': [100, 103, 106, 109, 112]

})

# 简单相关

r_simple = econ_data[['消费支出', '可支配收入']].corr().iloc[0, 1]

print(f"简单相关: {r_simple:.3f}")

# 偏相关(控制CPI)

pc = pg.partial_corr(data=econ_data, x='消费支出', y='可支配收入', covar='CPI')

print(f"偏相关(控制CPI): {pc['r'].values[0]:.3f}")应用2:投资与经济增长

研究问题:投资对GDP增长的贡献,控制技术进步和人力资本

关键洞察:

- 不控制技术进步时,可能高估投资的作用

- 偏相关帮助识别投资的"纯效应"

5.2 医学与健康领域

应用3:药物剂量与疗效关系

研究场景 :

某新药临床试验,研究剂量与疗效的关系,需要控制患者年龄、性别、基础健康状况

变量:

- Y:治疗效果评分

- X:药物剂量

- Z₁:年龄

- Z₂:性别

- Z₃:基础健康评分

分析流程:

python

# 医学数据分析示例

medical_data = pd.read_csv('clinical_trial.csv')

# 计算偏相关

pc_result = pg.partial_corr(

data=medical_data,

x='疗效评分',

y='药物剂量',

covar=['年龄', '性别', '基础健康评分']

)

print("控制混杂因素后的剂量-疗效关系:")

print(f"偏相关系数: {pc_result['r'].values[0]:.3f}")

print(f"95%置信区间: {pc_result['CI95%'].values[0]}")

print(f"p值: {pc_result['p-val'].values[0]:.4f}")临床意义:

- 如果偏相关显著,说明剂量确实影响疗效

- 如果偏相关不显著,可能需要重新评估剂量方案

应用4:环境因素与疾病发病率

研究问题:空气污染与呼吸系统疾病的关系,控制遗传因素、吸烟史、职业暴露

关键挑战:

- 混杂因素众多

- 需要大样本量

- 可能存在非线性关系

!TIP

医学研究中的偏相关分析注意事项:

- 必须控制已知的混杂因素

- 样本量要足够大(通常需要数百到数千例)

- 结合临床专业知识选择控制变量

- 考虑使用倾向得分匹配等方法作为补充

5.3 教育领域

应用5:教学方法效果评估

研究设计 :

比较不同教学方法对学生成绩的影响,控制学生基础水平、班级规模、教师经验

分析策略:

python

# 教育数据分析

edu_data = pd.DataFrame({

'期末成绩': [75, 82, 68, 91, 78, 85, 72, 88],

'教学方法': [1, 2, 1, 2, 1, 2, 1, 2], # 1=传统, 2=创新

'基础成绩': [70, 78, 65, 88, 72, 80, 68, 85],

'班级规模': [30, 25, 35, 20, 32, 22, 38, 24]

})

# 控制基础成绩和班级规模后,教学方法与期末成绩的偏相关

pc = pg.partial_corr(

data=edu_data,

x='期末成绩',

y='教学方法',

covar=['基础成绩', '班级规模']

)

print(f"控制混杂因素后的教学方法效果: r = {pc['r'].values[0]:.3f}")教育意义:

- 帮助识别教学方法的真实效果

- 避免将学生基础差异归因于教学方法

- 为教学改革提供科学依据

5.4 数据挖掘与机器学习

应用6:特征选择

场景:在高维数据中选择最相关的特征,避免冗余

策略:

-

识别冗余特征:

- 高简单相关但低偏相关的特征对可能冗余

- 可以删除其中一个

-

发现被掩盖的特征:

- 低简单相关但高偏相关的特征可能被其他特征掩盖

- 应该保留

python

def feature_selection_by_partial_corr(df, target, threshold=0.3):

"""

基于偏相关的特征选择

参数:

df: 数据框

target: 目标变量名

threshold: 偏相关阈值

返回:

selected_features: 选中的特征列表

"""

features = [col for col in df.columns if col != target]

selected = []

for feat in features:

# 计算该特征与目标的偏相关(控制其他所有特征)

other_feats = [f for f in features if f != feat]

if len(other_feats) > 0:

pc = pg.partial_corr(

data=df,

x=target,

y=feat,

covar=other_feats

)

r_partial = abs(pc['r'].values[0])

p_val = pc['p-val'].values[0]

# 如果偏相关显著且超过阈值,保留该特征

if r_partial > threshold and p_val < 0.05:

selected.append({

'feature': feat,

'partial_corr': r_partial,

'p_value': p_val

})

return pd.DataFrame(selected).sort_values('partial_corr', ascending=False)

# 使用示例

# selected_features = feature_selection_by_partial_corr(df, 'target', threshold=0.2)

# print(selected_features)应用7:因果图构建

目标:构建变量间的因果关系图(Causal Graph)

方法:

- 偏相关可以帮助识别条件独立性

- 结合PC算法(Peter-Clark算法)构建因果图

python

# 简化的因果发现示例

def test_conditional_independence(df, x, y, z_set, alpha=0.05):

"""

测试X和Y在给定Z集合条件下是否独立

"""

if len(z_set) == 0:

# 简单相关检验

r, p = stats.pearsonr(df[x], df[y])

else:

# 偏相关检验

pc = pg.partial_corr(data=df, x=x, y=y, covar=list(z_set))

p = pc['p-val'].values[0]

return p > alpha # True表示独立

# 使用示例:测试X和Y在控制Z后是否独立

# is_independent = test_conditional_independence(df, 'X', 'Y', ['Z'])5.5 社会科学研究

应用8:社会经济地位与健康

研究问题:社会经济地位(SES)与健康状况的关系,控制教育、职业、收入

复杂性:

- SES是多维概念

- 教育、职业、收入相互关联

- 需要仔细选择控制变量

应用9:媒体使用与学业表现

研究问题:社交媒体使用时间与学业成绩的关系,控制社交需求、自控力

发现:

- 简单相关可能显示负相关

- 控制社交需求后,相关可能减弱或消失

- 说明社交需求是重要的混杂因素

!NOTE

跨学科应用的共同模式:

- 识别研究问题中的混杂因素

- 收集足够的数据(样本量和变量)

- 计算简单相关和偏相关

- 对比分析,解释差异

- 结合领域知识做出结论

六、注意事项与实践陷阱

!IMPORTANT

偏相关揭示"相关"而非"因果"。混杂变量未被纳入或未线性化时,偏相关仍可能偏离真实关系。

6.1 样本量要求与功效分析

经验法则:

- 最小样本量:n > 10 × (k + 2),其中k为控制变量数

- 推荐样本量:n > 20 × (k + 2)

- 高精度估计:n > 50 × (k + 2)

样本量不足的后果:

| 样本量 | 控制变量数 | 主要问题 |

|---|---|---|

| n < 30 | k ≥ 2 | 估计不稳定,置信区间过宽 |

| n < 50 | k ≥ 5 | 检验功效不足,易出现II类错误 |

| n < 100 | k ≥ 10 | 数值不稳定,矩阵可能近奇异 |

6.2 多重共线性的诊断与处理

诊断指标:

- VIF > 10:严重共线性

- 条件数 > 30:严重共线性

- 相关系数 > 0.9:高度相关

解决方案:

- 删除冗余变量

- 主成分分析降维

- 岭回归方法

- 合并相关变量

6.3 异常值与稳健方法

稳健偏相关:

- 使用Spearman秩相关

- 使用Kendall's tau

- Winsorize处理极端值

6.4 非线性关系的识别

检查方法:

- 残差图分析

- Q-Q图检验正态性

- 散点图观察

- 非参数方法验证

处理策略:

- 对数变换

- 平方根变换

- Box-Cox变换

- 分段线性模型

6.5 结果报告规范

必须报告的内容:

- 样本量n和控制变量数k

- 简单相关系数和偏相关系数

- t统计量、p值、置信区间

- 控制变量列表

- 数据来源和时间范围

!WARNING

常见错误清单:

- 过度解释:偏相关≠因果

- 遗漏重要控制变量

- 控制变量过多(过度控制)

- 忽略非线性关系

- 样本量不足

- 多重检验未校正

- 异常值未处理

- 共线性未诊断

七、Python完整实现指南

7.1 基础实现:NumPy + SciPy

python

import numpy as np

from scipy import stats

import pandas as pd

def partial_corr_basic(x, y, z):

"""

基础偏相关计算(残差法)

参数:

x, y: 要计算相关的两个变量

z: 控制变量(可以是向量或矩阵)

返回:

r: 偏相关系数

p: p值

"""

# 确保z是二维数组

if z.ndim == 1:

z = z.reshape(-1, 1)

# 对x和y分别回归z,得到残差

from sklearn.linear_model import LinearRegression

model_x = LinearRegression()

model_y = LinearRegression()

model_x.fit(z, x)

model_y.fit(z, y)

residual_x = x - model_x.predict(z)

residual_y = y - model_y.predict(z)

# 计算残差的相关系数

r, p = stats.pearsonr(residual_x, residual_y)

return r, p

# 示例数据

np.random.seed(42)

n = 120

z = np.random.normal(0, 1, n)

x = 0.8*z + np.random.normal(0, 0.6, n)

y = 0.7*x + 0.5*z + np.random.normal(0, 0.8, n)

r, p = partial_corr_basic(x, y, z)

print(f"偏相关系数: r = {r:.3f}, p = {p:.4f}")7.2 高级实现:矩阵逆法

python

def partial_corr_matrix(df, x, y, z_vars):

"""

使用精度矩阵计算偏相关(适合多个控制变量)

参数:

df: 数据框

x, y: 变量名

z_vars: 控制变量名列表

返回:

偏相关系数

"""

# 选择相关变量

vars_list = [x, y] + (z_vars if isinstance(z_vars, list) else [z_vars])

data = df[vars_list]

# 计算相关矩阵

corr_matrix = data.corr().values

# 计算精度矩阵(相关矩阵的逆)

precision_matrix = np.linalg.inv(corr_matrix)

# 提取x和y对应的元素

i, j = 0, 1 # x和y在vars_list中的位置

# 计算偏相关

r_partial = -precision_matrix[i, j] / np.sqrt(precision_matrix[i, i] * precision_matrix[j, j])

return r_partial

# 使用示例

df = pd.DataFrame({'X': x, 'Y': y, 'Z': z})

r_matrix = partial_corr_matrix(df, 'X', 'Y', 'Z')

print(f"矩阵法偏相关: r = {r_matrix:.3f}")7.3 专业库:Pingouin

python

import pingouin as pg

# 方法1:单个偏相关

pc = pg.partial_corr(data=df, x='X', y='Y', covar='Z')

print("Pingouin结果:")

print(pc[['n', 'r', 'CI95%', 'p-val']])

# 方法2:偏相关矩阵(控制其他所有变量)

pcorr_matrix = df.pcorr()

print("\n偏相关矩阵:")

print(pcorr_matrix)

# 方法3:半偏相关(semi-partial correlation)

spc = pg.partial_corr(data=df, x='X', y='Y', covar='Z', method='semi')

print("\n半偏相关:")

print(spc[['r', 'p-val']])7.4 完整分析流程封装

python

class PartialCorrelationAnalysis:

"""

偏相关分析完整流程封装

"""

def __init__(self, data):

self.data = data

self.results = {}

def check_assumptions(self, x, y, z_vars):

"""检查分析假设"""

print("="*60)

print("假设检查")

print("="*60)

# 1. 样本量检查

n = len(self.data)

k = len(z_vars) if isinstance(z_vars, list) else 1

min_n = 10 * (k + 2)

print(f"1. 样本量: n = {n}")

print(f" 最小要求: {min_n}")

print(f" 状态: {'✓ 充足' if n >= min_n else '✗ 不足'}")

# 2. 共线性检查

from statsmodels.stats.outliers_influence import variance_inflation_factor

control_vars = z_vars if isinstance(z_vars, list) else [z_vars]

if len(control_vars) > 1:

print(f"\n2. 多重共线性检查:")

for i, var in enumerate(control_vars):

vif = variance_inflation_factor(self.data[control_vars].values, i)

status = '✓' if vif < 10 else '✗'

print(f" {var}: VIF = {vif:.2f} {status}")

# 3. 线性关系检查

print(f"\n3. 线性关系检查:")

r_xy = self.data[[x, y]].corr().iloc[0, 1]

print(f" {x} vs {y}: r = {r_xy:.3f}")

return n >= min_n

def compute_correlations(self, x, y, z_vars):

"""计算简单相关和偏相关"""

# 简单相关

r_simple = self.data[[x, y]].corr().iloc[0, 1]

# 偏相关

pc = pg.partial_corr(data=self.data, x=x, y=y, covar=z_vars)

self.results = {

'simple_corr': r_simple,

'partial_corr': pc['r'].values[0],

'p_value': pc['p-val'].values[0],

'ci': pc['CI95%'].values[0],

'n': pc['n'].values[0]

}

return self.results

def test_significance(self, alpha=0.05):

"""显著性检验"""

r = self.results['partial_corr']

p = self.results['p_value']

n = self.results['n']

print("\n" + "="*60)

print("显著性检验")

print("="*60)

print(f"偏相关系数: r = {r:.3f}")

print(f"p值: {p:.4f}")

print(f"95%置信区间: {self.results['ci']}")

print(f"结论: {'显著 ***' if p < 0.001 else '显著 **' if p < 0.01 else '显著 *' if p < 0.05 else '不显著'}")

return p < alpha

def generate_report(self, x, y, z_vars):

"""生成完整报告"""

r_simple = self.results['simple_corr']

r_partial = self.results['partial_corr']

change = r_simple - r_partial

change_pct = (change / r_simple * 100) if r_simple != 0 else 0

report = f"""

{'='*60}

偏相关分析报告

{'='*60}

变量:

- X: {x}

- Y: {y}

- 控制变量: {z_vars}

结果:

- 简单相关: r = {r_simple:.3f}

- 偏相关: r = {r_partial:.3f}

- 变化: Δr = {change:.3f} ({change_pct:.1f}%)

- p值: {self.results['p_value']:.4f}

- 95%CI: {self.results['ci']}

解释:

控制{z_vars}后,{x}和{y}的相关系数从{r_simple:.3f}变为{r_partial:.3f},

{'增加' if change < 0 else '减少'}了{abs(change_pct):.1f}%。

{'这表明控制变量是重要的混杂因素。' if abs(change_pct) > 10 else '控制变量的影响较小。'}

{'='*60}

"""

return report

# 使用示例

analyzer = PartialCorrelationAnalysis(df)

analyzer.check_assumptions('X', 'Y', 'Z')

analyzer.compute_correlations('X', 'Y', 'Z')

analyzer.test_significance()

print(analyzer.generate_report('X', 'Y', 'Z'))

!TIP

Python库选择建议:

- Pingouin:功能全面,输出规范,推荐用于科研

- Statsmodels:统计功能强大,适合复杂分析

- Scikit-learn:机器学习场景,特征选择

- 自定义实现:教学目的,理解原理

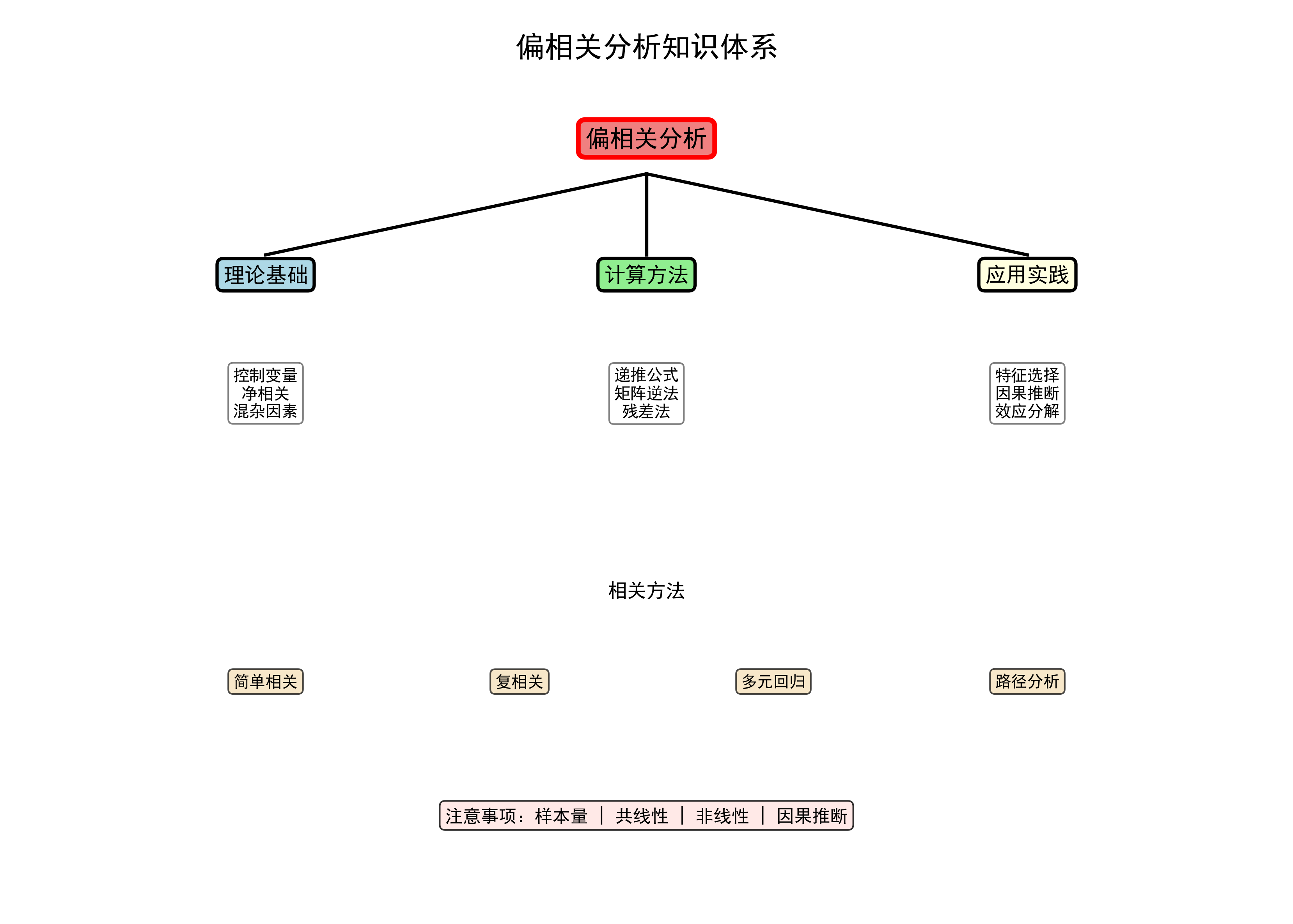

八、知识串联与深度思考

8.1 核心要点总结

-

偏相关的本质:

- 控制混杂因素后的净相关关系

- 通过残差或精度矩阵计算

- 结果在-1, 1范围内

-

计算方法选择:

- 低阶(k<3):递推公式,易于理解

- 高阶(k≥3):矩阵逆法,计算效率高

- 实践中:使用专业库(Pingouin)

-

显著性检验:

- t检验:df = n - k - 2

- Fisher Z变换:计算置信区间

- 多重检验校正:Bonferroni或FDR

-

应用场景:

- 混杂因素控制

- 特征选择

- 因果推断的前置分析

- 变量关系探索

8.2 与其他方法的联系

偏相关 vs 多元回归:

- 偏相关:关注两变量的净相关

- 回归:关注预测和因果效应

- 联系:标准化回归系数与偏相关密切相关

偏相关 vs 主成分分析:

- 偏相关:保留原始变量,控制混杂

- PCA:降维,创建新变量

- 联系:都涉及变量间关系分析

偏相关 vs 因果推断:

- 偏相关:相关关系,不能推断因果

- 因果推断:需要额外假设和设计

- 联系:偏相关是因果分析的基础工具

8.3 深入思考题

💡 思考题1:在什么情况下,偏相关系数会大于简单相关系数?

当存在抑制效应(Suppression Effect)时:

- 控制变量Z与X正相关,与Y负相关

- 或Z与X负相关,与Y正相关

- 控制Z后,X和Y的真实关系被"释放"出来

示例:

- X:运动时间,Y:体重,Z:肌肉量

- 简单相关:r(X,Y) = 0.2(运动多的人体重略重)

- 偏相关:r(X,Y|Z) = -0.5(控制肌肉后,运动确实减重)

💡 思考题2:如何选择合适的控制变量?

选择原则:

- 理论驱动:基于领域知识和因果图

- 统计检验:与X和Y都显著相关的变量

- 避免过度控制:不控制中介变量

- 避免遗漏:考虑所有可能的混杂因素

- 实践平衡:控制变量不宜过多(k < n/10)

💡 思考题3:偏相关分析与多元回归分析有什么联系和区别?

联系:

- 都涉及控制其他变量

- 偏相关系数与标准化回归系数相关

- 当只有两个自变量时,偏相关的平方≈标准化回归系数的平方

区别:

- 偏相关:对称的,关注相关性

- 回归:非对称的,关注预测和因果

- 偏相关:无法区分自变量和因变量

- 回归:明确区分预测变量和响应变量

笔记来源:安同学