一、概念

1.支持向量机(support vector machine,SVM):

(1)基于统计学理论的监督学习方法,但不属于生成式模型,而是判别式模型。

(2)支持向量机在各个领域内的模式识别问题中都有广泛应用,包括人脸识别、文本分类、笔迹识别等。

(3)在解决小样本、非线性及高维模式识别等问题中表现出了许多特有的优势。

(4)在函数模拟、模式识别和数据分类等领域也取得了极好的应用效果。

2.分三种,但是前两种差不多:

(1)线性可分时,通过硬间隔最大化。

(2)近似线性可分时,通过软间隔最大化。

(3)不可分时,通过使用核技巧以及软间隔最大化。

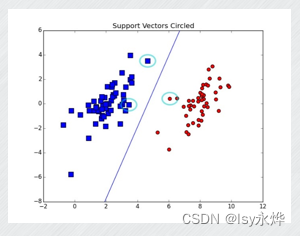

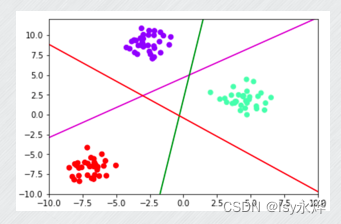

3.线性可分SVM

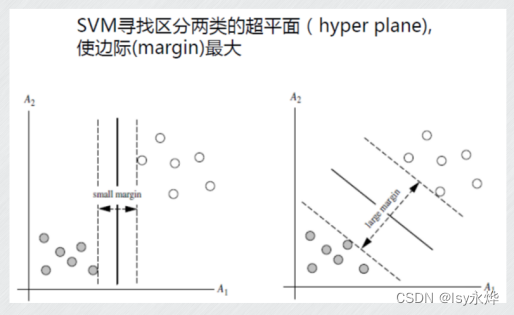

(1)原理:在这n维的数据空间中找到一个超平面(Hyper Plane),将所有的正例划分到超平面的一侧,将所有的负例划分到超平面的另一侧。

(2)超平面可以有无数个,所以寻找边际最大的平面。

(3)硬间隔缺点:

对于异常值过于敏感,就是有的值它离超平面异常的近,导致一系列问题

(4)所以引入了软间隔,也就是上面的近似线性可分,它nb在允许少量分类错误,以此消除硬间隔所产生的问题。

(5)上述只是二分类,但是多分类也可以,不要产生思维禁锢,了解即可。

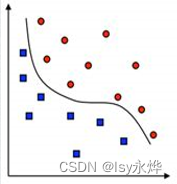

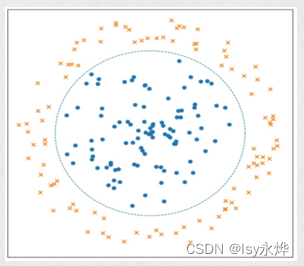

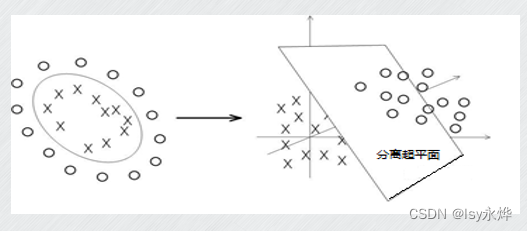

4.非线性问题(核函数)

(1)在空间中无法用一条直线(线性)将数据集中的正例和负例正确地分隔开,但可以用一条圆形曲线(非线性)分隔。

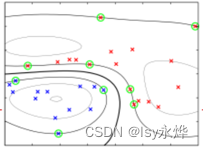

(2)对此,采用核函数来解决,原理是从低纬升至高维,是的,你没有看错,相当于从一张纸变成一块积木。

但是看似复杂了,但是实际上也确实很难。

但是解释起来很简单,就是把正例和负例从原来在一个面上剥离,一个全部在"上面",一个全部在下面。

(3)对此产生的问题:维度灾难

二、习题

多选题:

- 下列关于支持向量机的说法正确的是( ABC )

A、可用于多分类问题

B、超平面的位置仅由支持向量决定,与其他样本点无关。

C、支持非线性的核函数

D、是一种监督式的学习方法,属于生成式模型。