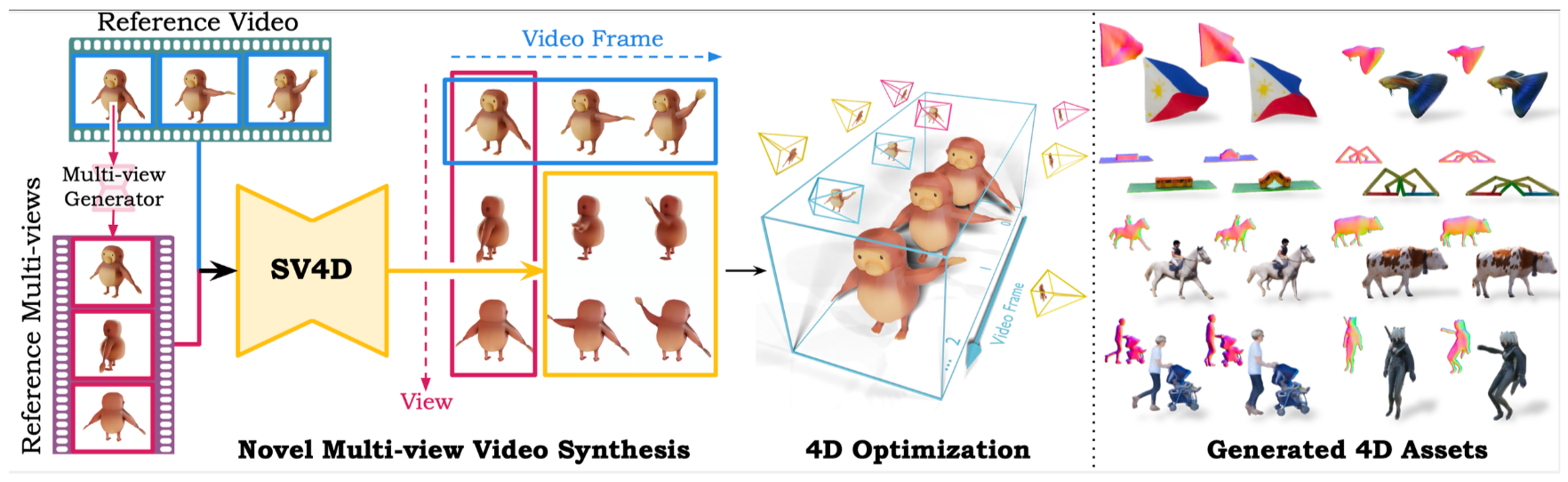

开放生成式人工智能初创公司Stability AI在3月发布了Stable Video 3D,是一款可以根据图像中的物体生成出可旋转的3D模型视频工具。Stability AI在7月24日发布了新一代的Stable Video 4D,增添了赋予3D模移动作的功能。

Stable Video 4D能在约40秒内生成8个视角的5帧视频,整个4D优化过程大约需要20到25分钟。该技术预计在游戏开发、视频编辑和虚拟现实等领域有广泛应用前景,专业人士可从多角度视角观察物体,提升产品的真实感和沉浸感。

Stable Video 4D,这是一种创新模型,允许用户上传单个视频并接收八个新角度/视图的动态新视图视频,提供全新水平的多功能性和创造力。

Stable Video 4D 模型以稳定视频扩散模型(将图像转换为视频)为基础 ,以视频作为输入,从不同角度生成多个新视角视频。这一进步代表着我们能力的飞跃,从基于图像的视频生成转向全 3D 动态视频合成。

相关链接

arXiv 页面:https://arxiv.org/abs/2407.17470 Huggingface:https://huggingface.co/stabilityai/sv4d

存储库:https://github.com/Stability-AI/generative-models

技术报告:https://sv4d.github.io/static/sv4d_technical_report.pdf

视频摘要:https://www.youtube.com/watch?v =RBP8vdAWTgk

关键要点

Stable Video 4D 将单个物体视频转换为八个不同角度/视图的多个新视图视频。

Stable Video 4D 通过一次推理,在大约 40 秒内生成 8 个视图中的 5 帧。

用户可以指定摄像机角度,定制输出以满足特定的创作需求。

该模型目前处于研究阶段,未来将应用于游戏开发、视频编辑和虚拟现实,预计会不断改进。它目前在Hugging Face上可用。

工作原理

用户首先上传一段视频并指定所需的 3D 摄像机姿势。Stable Video 4D 随后会根据指定的摄像机视角生成八个新视角视频,从而提供拍摄对象的全面、多角度视角。生成的视频随后可用于有效优化视频中拍摄对象的动态 3D 表示。

目前,Stable Video 4D 可以在大约 40 秒内生成 8 个视图中的 5 帧视频,整个 4D 优化大约需要 20 到 25 分钟。我们的团队设想未来将其应用于游戏开发、视频编辑和虚拟现实。这些领域的专业人士可以从从多个角度可视化物体的能力中受益匪浅,从而增强其产品的真实感和沉浸感。

一流的性能

与以前的方法不同,以前的方法通常需要从图像扩散模型、视频扩散模型和多视图扩散模型的组合中进行采样,而 SV4D 能够同时生成多个新视图视频,从而大大提高了空间和时间轴的一致性。此功能不仅可以确保跨多个视图和时间戳的一致对象外观,还可以实现更轻量的 4D 优化框架,而无需使用多个扩散模型进行繁琐的分数蒸馏采样 (SDS)。

与现有作品相比,Stable Video 4D 能够生成新颖的视图视频,这些视频更加详细、忠实于输入视频,并且跨帧和视图保持一致。

研究与开发

Stable Video 4D 已在Hugging Face上推出,这是我们的第一个视频到视频生成模型,标志着 Stability AI 的一个激动人心的里程碑。我们正在积极完善该模型,对其进行优化,使其能够处理更广泛的现实世界视频,而不仅仅是目前训练它的合成数据集。

Stability AI 团队致力于不断创新,探索这项技术和其他技术的实际用例。我们预计,各公司将采用我们的模型,并进一步微调以满足其独特需求。这项技术在制作逼真的多角度视频方面潜力巨大,我们很高兴看到随着持续的研究和开发,它将如何发展。

技术报告

论文链接:https://arxiv.org/abs/2407.17470

结合此公告,我们将发布一份全面的技术报告,详细介绍该模型开发过程中所采用的方法、挑战和突破。

Stable Video 4D 代表了最先进的开源新视角视频生成技术。通过将单一视频输入转换为动态、多角度的 3D 输出,我们为各个行业的创造力和创新开辟了新途径。请继续关注我们的进一步更新,我们将继续增强和扩展这项激动人心的技术的功能。