转自AI技术实战

ChatGLM3 是智谱AI和清华大学 KEG 实验室联合发布的对话预训练模型。ChatGLM3-6B 是 ChatGLM3 系列中的第三代开源模型,对话流畅、部署门槛低,测评显示其基础模型ChatGLM3-6B-Base 具有在 10B 以下的基础模型中最强的性能,同时支持工具调用(Function Call)、代码执行(Code Interpreter)和Agent任务等复杂场景。

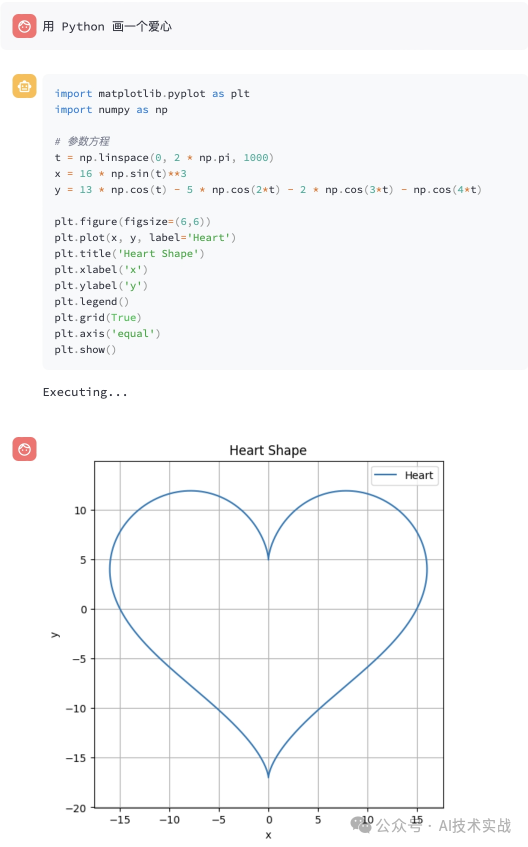

function call效果:

code interpreter效果:

github地址在文末,推理需要大约14G显存,本文基于ubuntu系统部署,windows系统类似。

1. 下载模型

下载模型需要用到git的LFS扩展,windows系统在https://git-lfs.com下载LFS,下面是ubuntu系统安装LFS的方式,其他linux系统可以参考文档https://github.com/git-lfs/git-lfs/blob/main/INSTALLING.md

curl -s https://packagecloud.io/install/repositories/github/git-lfs/script.deb.sh | sudo bash

apt-get install git-lfs

git lfs install安装好LFS后就可以下载了,huggingface比较慢,可以在魔搭社区下载

https://modelscope.cn/models/ZhipuAI/chatglm3-6b/summary

执行以下命令,等待下载完成,总共24G。

git clone https://www.modelscope.cn/ZhipuAI/chatglm3-6b.git2.安装部署

本文介绍两种部署方式,一种是使用上一篇介绍的25.7k star! 用langchain-chatchat部署私有化RAG知识库,另一种是使用ChatGLM官方项目部署。

2.1 在langchain-chatchat中使用

在上一篇文章中,我们使用docker部署了langchain-chatchat,但是默认模型是chatglm2-6b,现在只需要将模型修改为chatglm3-6b就可以了,将下载好的chatglm3-6b拷贝到docker容器的根目录下:

docker cp chatglm3-6b 你的容器名称:/chatchat在容器的/langchain-chatchat目录,进入容器,再进入configs目录:

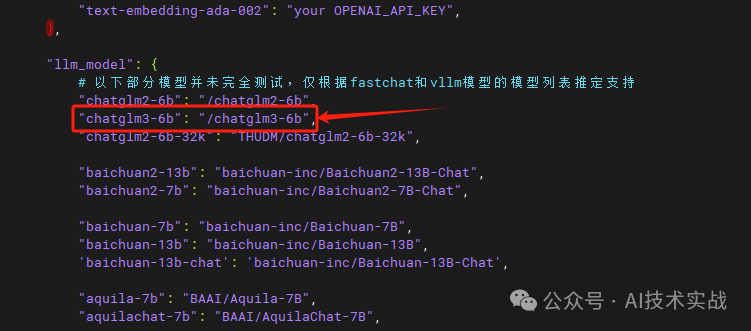

docker exec -it 你的容器名称 /bin/bashcd /langchain-chatchat/configs编辑model_config.py文件,在llm_model中增加chatglm3-6b,如图所示:

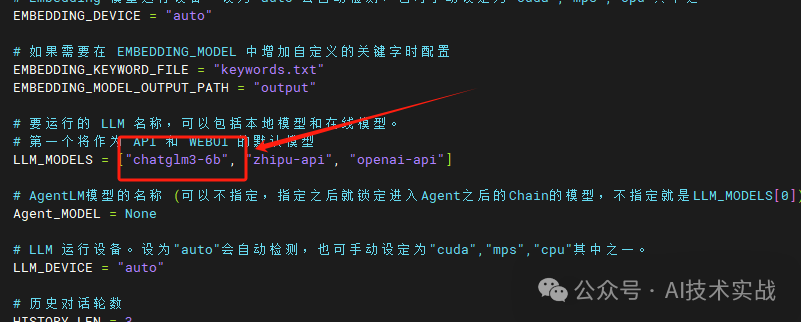

将LLM_MODELS中的chatglm2-6b修改为chatglm3-6b,如图所示:

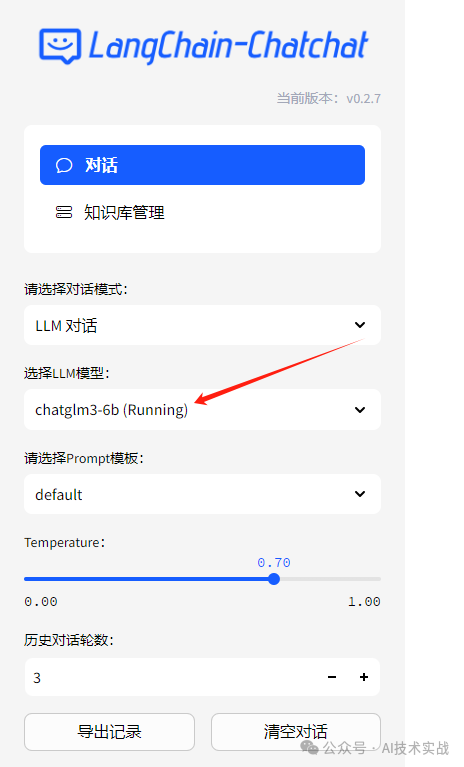

修改后重启容器,再打开,这里就变成chatglm3-6b了。

2.2 使用ChatGLM官方项目部署

如果没有部署chatchat,也可以使用ChatGLM官方项目部署。

使用git下载ChatGLM源码

git clone git@github.com:THUDM/ChatGLM3.git进入ChatGLM3源码目录,使用清华镜像安装依赖:

cd ChatGLM3-mainpip install -i https://pypi.tuna.tsinghua.edu.cn/simple -r requirements.txt3. 运行

如果使用chatchat项目部署,直接在页面上选择chatglm3-6b就可以聊天了。下面是使用ChatGLM3项目部署的用法。

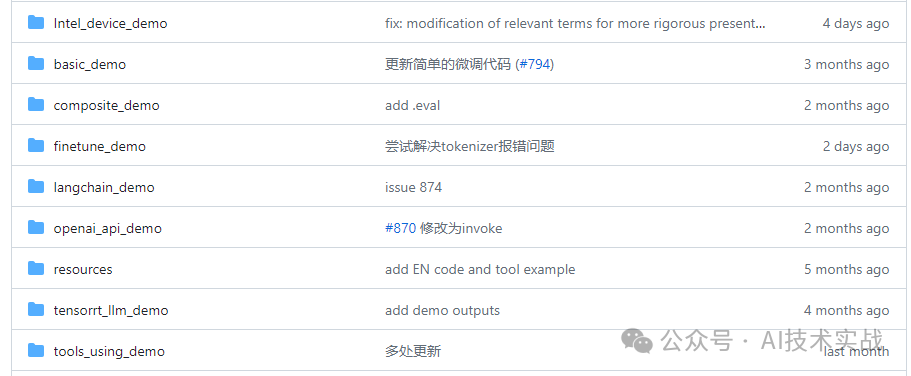

ChatGLM3项目提供了多个demo,进入相应demo目录下,修改模型路径运行就可以,下面以gradio网页demo举例说明,其他同理。

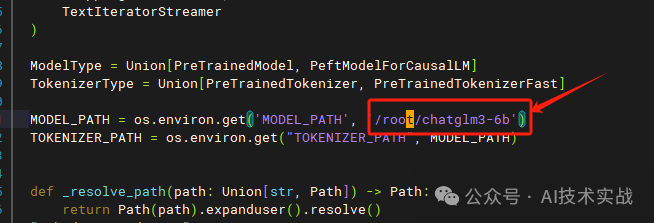

进入basic_demo目录

cd basic_demo修改web_demo_gradio.py,将MODEL_PATH的值改为第一步下载好的模型路径:

运行

python3 web_demo_gradio.py在浏览器打开http://localhost:7870就可以聊天了

4. 无缝替换openAI

ChatGLM提供了openai标准的API,通过这个API我们可以将任何接入openai的应用无缝切换为私有化部署的ChatGLM3。

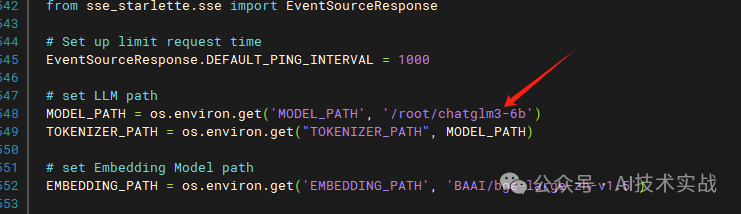

cd openai_api_demo修改api_server.py,将MODEL_PATH的值改为第一步下载好的模型路径:

后台运行:

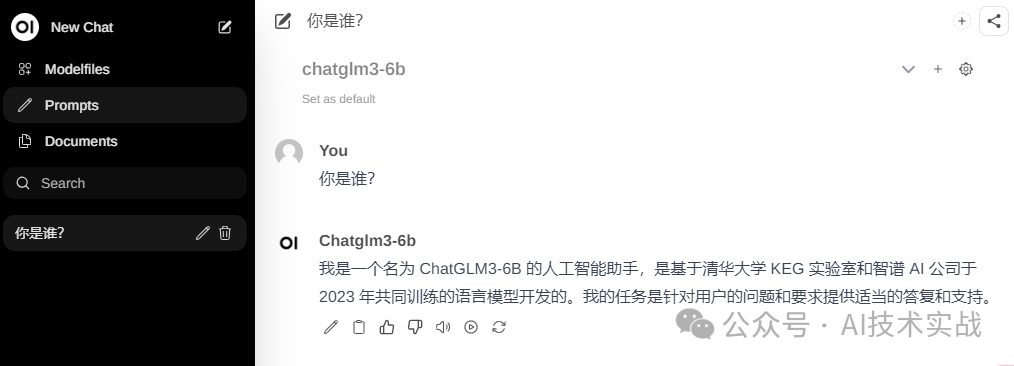

nohup python3 api_server.py &这样就启动了openai接口的服务,可以把私有化部署的ChatGLM3当openai用了,比如之前文章中247.2k star! 超强大的私有化ChatGPT,支持图像识别/文生图/语音输入/文本朗读,个人电脑可运行!有接入openai的功能,现在我们可以把配置的openai的地址改为本地,从而将open-webui接入ChatGLM3:

其他像各种基于openai的插件、应用等,只要可以配置url,都可以无缝切换为ChatGLM3。

github地址