上一篇:基于Transformer的路径规划 - 第四篇 GPT模型优化

在上一篇中,我尝试优化GPT路径生成模型,但没有成功。在随机生成的测试集上,路径规划成功率只有99%左右。而使用传统的路径规划算法,例如A*,路径规划成功率能达到100%。显然,如果想让模型具备一定的实用价值,还需要继续提升指标。在本篇中,我将尝试通过优化GPT生成策略(在有些文章中又称为解码策略)来提升路径规划成功率。

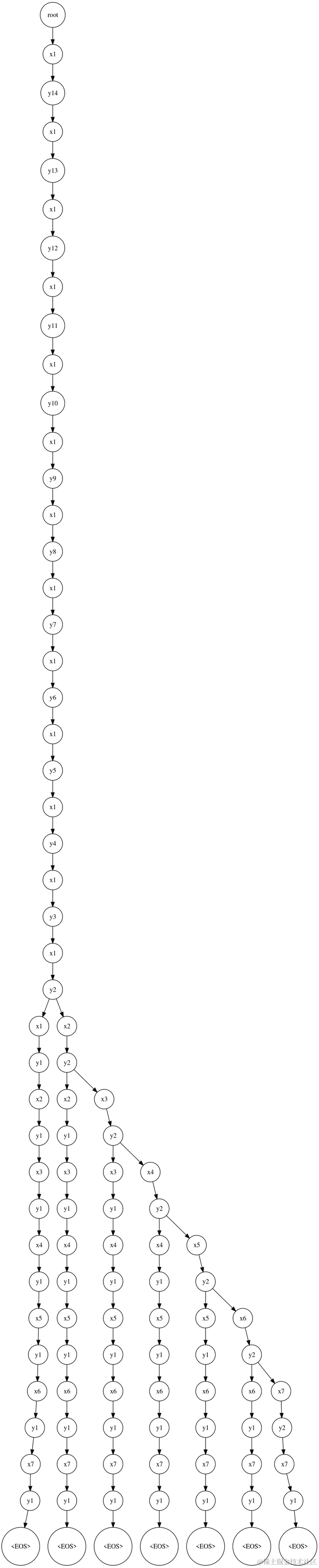

我们将生成的路径用Tree来表示,在贪心搜索中,每次选择置信度最大的节点,因此只会生成一条路径。如果考虑置信度大于设定阈值ε的所有节点,那会是什么情况呢?

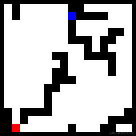

以下图为例:

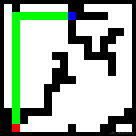

若使用贪心搜索,生成的路径会发生碰撞,如下图所示:

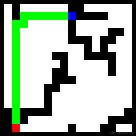

若考虑置信度大于0.1的所有节点,则可以生成7条路径,如下图所示:

可视化结果如下:

可以看到,除了贪心搜索得到的路径发生了碰撞外,其它6条路径都是正确的。

这个实验结果让人看到了GPT模型在路径规划问题上的潜力:我们可以设置更低的阈值ε,一次生成多条路径,然后选择最好的一条路径,这样路径规划成功率就逼近100%了。

实验总结:

- 基于Transformer的模型至少能够解决简单的路径规划问题

- GPT生成模型需要搭配合适的生成策略才能挖掘出模型的潜力

全篇完